ソートリーダー

データサイエンティストがグラフトランスフォーマーと構造化データへの影響について知っておくべきこと

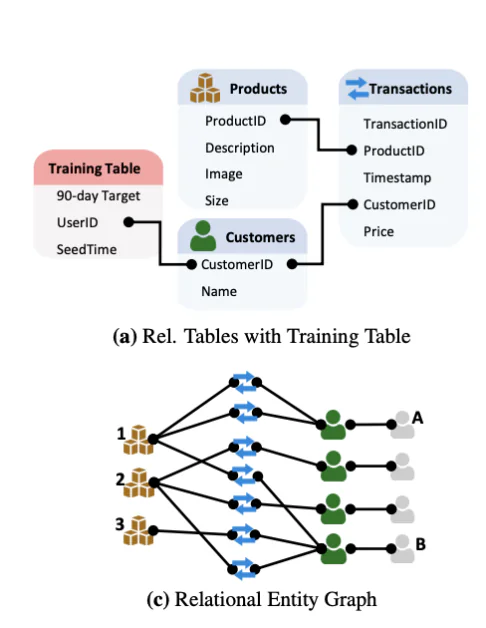

スタンフォード在籍中に、私はグラフニューラルネットワークを共同で創出した。私は早期に、このテクノロジーが非常に強力であることを認識した。すべてのデータポイント、すべての観察、すべての知識は孤立して存在しません。むしろ、それらは他の知識のピースに接続されたグラフの一部です。重要なのは、多くの貴重なビジネスデータは、通常、データベースとデータウェアハウスにテーブルとして保存され、自然にグラフとして表現できることです。この関係構造を利用することは、正確で非妄想的なAIモデルを構築するための鍵です。

グラフニューラルネットワーク(GNN)は、知識の間の接続を捉えることができるメッセージパッシングアーキテクチャを導入しました。 しかし、Transformerが言語理解を変革したように、新しいクラスのモデルであるグラフトランスフォーマーは、グラフベースのデータに同様の利点をもたらしています。これらのモデルは、複雑な関係をより効果的にモデル化するために、注意メカニズムの柔軟性と構造グラフの先入観を組み合わせます。

グラフがメッセージパッシング以外のものを必要とする理由

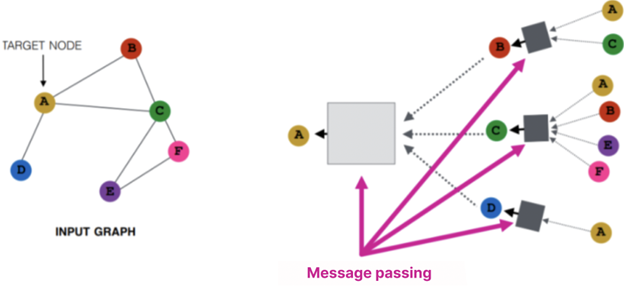

伝統的なグラフニューラルネットワーク(GNN)は、メッセージパッシングに依存しています。これは、各ノードが近くのノードから情報を集約して内部状態を更新するプロセスです。各ノードが近くのノードと要約を交換し、それらの要約を使用して自身の理解を改良することを考えてみましょう。複数の層を経て、これによりグラフ全体に情報が伝播します。

メッセージパッシングは、ローカルパターンを学習するために強力ですが、重要な制限があります:

- オーバースカッシング: 情報が多くのホップにわたって集約されると、重要な詳細が失われる可能性があります。これは、深いGNNでは特に問題があります。

- コンテキストの制限: 標準的なメッセージパッシングでは、多くの層なしに長距離依存関係を簡単に捉えることができません。これにより、複雑さとノイズが増加します。

- 表現力: 多くのグラフ構造は、ローカルな近傍情報のみを使用して区別することはできません。これにより、微妙な構造的区別を必要とするタスクでのモデルのパフォーマンスが制限されます。

ここで、グラフトランスフォーマーが登場します。メッセージパッシングを注意メカニズムで置き換えるか補足することで、各ノードは他のノード(近くのものや遠くのもの)に直接注目することができます。学習された重要性に基づいて、結果は豊かで表現力のあるものになり、スケーラビリティが向上し、複雑な構造をより柔軟に推論することができます。

GNNからグラフトランスフォーマーへ

元のTransformerモデルは、Attention Is All You Needという著名な論文で導入され、シーケンス内のトークン間の関係をモデル化するために設計されました。その成功は、各入力が他のすべての入力を考慮できる自己注意メカニズムにあります。学習された関連性によって重み付けされます。

グラフトランスフォーマーは、このパラダイムを採用して、ノードが近傍ノードのみに注目するのではなく、グラフ内の任意のノードに注目できるようにします。完全に接続された注意またはグローバルシグナルとローカルシグナルのバランスをとるハイブリッドアプローチを通じてです。課題は、シーケンスの構造をモデルに導入することです。

グラフ固有の位置エンコーディング

テキストとは異なり、グラフには固有の順序がないため、位置エンコーディングは、構造または位置ベースの情報をモデルに注入するテクニック、非自明です。グラフトランスフォーマーは、次の方法でこれに対処します:

- ラプラスEigenベクトル: グラフラプラス行列から導かれ、グローバル構造を捉えたスペクトル埋め込みを提供します。

- ランダムウォーク: ノード間の複数のホップを超えた移動の確率を捉えます。

- 構造エンコーディング: 距離メトリック、ノード次数、またはエッジタイプを含みます。

これらの位置エンコーディングは、スペクトル、確率、構造のいずれであっても、グラフトランスフォーマーが各ノードがグラフ全体でどのように位置するかを理解する方法を提供します。この構造的認識は、注意メカニズムが不規則で順序のないデータ全体で有意義に動作することを可能にするため、関係を捉えるために不可欠です。

実世界での実装とユースケース

グラフトランスフォーマーを本稼働環境に導入するには、実世界のデータサイズにスケールできるインフラストラクチャが必要です。PyTorch Geometric(PyG)などのライブラリは、これを可能にします。PyTorchに基づいて構築されたPyGは、分子モデリングからレコメンデーションシステムまで、幅広いアプリケーションでGNNとグラフトランスフォーマーを実装するためのモジュラーなフレームワークを提供します。小規模なグラフや大規模なグラフのミニバッチトレーニングをサポートし、多くのGPUとtorch.compileサポートを提供するため、研究とエンタープライズのワークフローに適しています。

これらのツールは、すでに幅広い実世界のアプリケーションを推進しています。薬剤発見では、グラフトランスフォーマーは原子間の相互作用をグラフとしてモデル化することで、分子特性を予測するのに役立ちます。物流とサプライチェーンの最適化では、出荷、倉庫、ルートのダイナミックなネットワークを表現して推論することができます。EC企業は、関係グラフとしての製品の共同購入とブラウジングの動作を理解することで、レコメンデーションを改善するために使用しています。サイバーセキュリティでは、グラフベースのモデルは、アクセスパターン、ネットワークトポロジー、イベントシーケンスを分析することで異常を検出するために使用されます。

これらの設定では、手作業で作成された特徴に頼ることなく、複雑に相互接続された構造から学ぶ能力が大きな利点をもたらしています。

技術的考慮

グラフトランスフォーマーには、実際のエンジニアリング上のトレードオフがあります。フルセルフアテンションはノード数と二乗に比例してスケールするため、特に大規模または密なグラフの場合、メモリと計算効率が主な懸念事項となります。多くの実世界のグラフには、構造情報をエンコードすることを複雑にする非対称性を導入する方向付きエッジがあります。実用的には、入力はほとんどの場合一貫性がありません。グラフ構造化データをテキスト、時系列、画像と組み合わせるには、慎重なアーキテクチャの選択と堅牢なデータ前処理が必要です。

これらの課題は、克服不可能ではありませんが、特に研究プロトタイプから本稼働モデルへの移行時に、思慮深いシステム設計を必要とします。

次に来ること: LLMがグラフと出会う

主要な研究方向は、大規模言語モデル(LLM)とグラフ構造の統合です。これらのハイブリッドシステムは、LLMを使用してテキストコンテキストをエンコードまたはエンティティを抽出し、それをグラフに根付かせ、推論と意思決定のために使用します。

生物学では、これはAlphaFoldなどのツールを強化しました。エンタープライズAIでは、ドキュメントと動作グラフを組み合わせた顧客サポートシステムを可能にします。グラフトランスフォーマーは、構造化状態表現を推論し、ダイナミックに相互作用を優先することができるため、AIエージェントがより賢く、より実行可能な決定を下すことを可能にする役割を果たしています。グラフトランスフォーマーは、階層的な関係をよりよく理解し、依存関係を時間の経過とともに追跡し、複雑な環境で動作を適応させることを可能にします。

この分野はまだ新しいものですが、潜在的な利点は大きいです。

結論

グラフトランスフォーマーは、GNNの次の進化ではなく、注意、構造、スケーラビリティの収束を表しています。金融、生命科学、レコメンデーションシステムで働いているかに関係なく、メッセージは明確です。データはグラフを形成するため、モデルもグラフであるべきです。