Andersonの視点

AI動画生成における完全な制御に向けて

HunyuanやWan 2.1などの動画基礎モデルは強力ですが、映画やテレビの制作(特にVFX制作)で要求されるような粒度の高い制御をユーザーに提供していません。

専門の視覚効果スタジオでは、Stable Diffusion、Kandinsky、Fluxなどのオープンソースモデルは、特定の創造的なニーズに応えるために、さまざまなサポートツールとともに使用されます。監督が「それは見た目が良さそうですが、もう少し[n]にできるか?」と言ったとき、モデルが十分に精密ではないということは言い訳にはなりません。

代わりに、AI VFXチームは、伝統的なCGIと組み合わせ技術、そして時間の経過とともに開発されたカスタム手順とワークフローを使用して、ビデオ合成の限界を少しでも押し広げようとします。

したがって、類推的に、基礎動画モデルは、ChromeのようなWebブラウザーのデフォルトインストールと似ており、多くのことがデフォルトでできるのですが、ユーザーのニーズに適応させるには、プラグインが必要になります。

コントロールフリーク

拡散ベースの画像合成の世界では、ControlNetが最も重要な第三者システムです。

ControlNetは、拡散ベースの生成モデルに構造化された制御を追加する技術であり、ユーザーがエッジマップ、深度マップ、またはポーズ情報などの追加入力を使用して画像または動画の生成を誘導できるようにします。

画像(上行)、セマンティックセグメンテーション>画像(下左)およびポーズガイド画像生成が可能になります。” width=”779″ height=”422″ /> ControlNetのさまざまな方法により、深度>画像(上行)、セマンティックセグメンテーション>画像(下左)およびポーズガイド画像生成が可能になります。

テキストプロンプトのみに頼るのではなく、ControlNetは、これらの条件信号を処理するための別のニューラルネットワークブランチ、またはアダプターを導入しますが、ベースモデルの生成能力は保持されます。

これにより、ユーザーの仕様に従った微調整された出力が可能になり、正確な構成、構造、または動きの制御が必要なアプリケーションで特に有用です:

ガイドポーズを使用すると、ControlNetを介してさまざまな正確な出力タイプを取得できます。 ソース: https://arxiv.org/pdf/2302.05543

しかし、この種のアダプターベースのフレームワークは、内部に焦点を当てたニューラルプロセスのセットに外部で動作します。これらのアプローチにはいくつかの欠点があります。

まず、アダプターは独立してトレーニングされるため、複数のアダプターを組み合わせるとブランチコンフリクトが発生し、生成品質が低下する可能性があります。

2番目に、パラメータの冗長性を導入し、各アダプターに追加の計算とメモリが必要になり、拡張が非効率的になります。

3番目に、アダプターは柔軟性がありますが、最適でない結果を生成することが多く、多条件生成に完全にファインチューンされたモデルに比べて効果が低くなります。これらの問題により、アダプターベースの方法は、複数の制御信号のシームレスな統合を必要とするタスクに効果が低くなります。

理想的には、ControlNetの能力は、モジュラーな方法でモデルにネイティブにトレーニングされ、将来の明らかな革新、たとえば同時ビデオ/オーディオ生成またはネイティブのリップシンク機能(外部オーディオ用)を容易に組み込むことができるはずです。

現状、追加の機能はすべてポストプロダクションのタスクまたは、動作する基礎モデルに敏感で密接に結びついた重みをナビゲートしなければならない非ネイティブの手順です。

FullDiT

このような状況に、中国から新しい提案が登場しました。ControlNetスタイルの措置が、トレーニング時ではなく、生成動画モデルに直接組み込まれたシステムを提案しています。

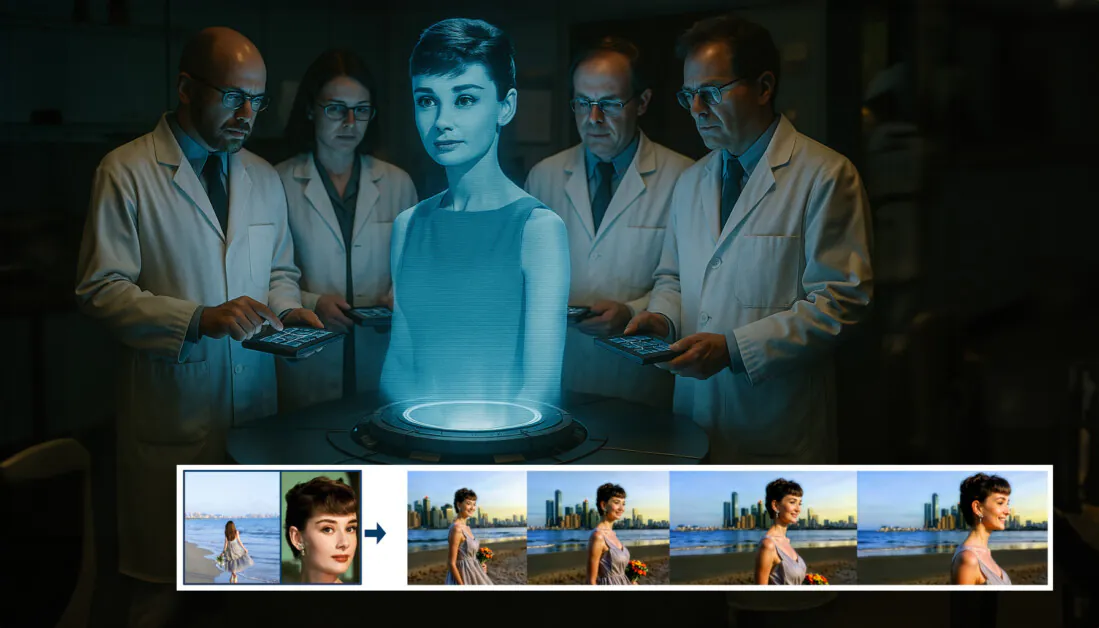

新しい論文から:FullDiTアプローチにより、アイデンティティの押し付け、深度、カメラの動きがネイティブ生成に組み込まれ、同時にこれらの組み合わせを呼び出すことができます。 ソース: https://arxiv.org/pdf/2503.19907

FullDiTと呼ばれるこの新しいアプローチでは、アイデンティティ転送、深度マッピング、カメラの動きなどのマルチタスク条件を、トレーニング済みの生成動画モデルの統合された部分として融合します。著者は、プロトタイプのトレーニング済みモデルと、プロジェクトサイトにある動画クリップを生成しました。

以下の例では、カメラの動き、アイデンティティ情報、テキスト情報(つまり、ユーザーのテキストプロンプト)を組み込んだ生成を示しています:

クリックして再生します。ネイティブトレーニング済みの基礎モデルでのControlNetスタイルのユーザー押し付けの例です。 ソース: https://fulldit.github.io/

注目すべきは、著者が実験的なトレーニング済みモデルを機能的な基礎モデルとして提案しているのではなく、ネイティブのテキストからビデオ(T2V)および画像からビデオ(I2V)モデルを提供するユーザーに更多の制御を提供することを証明する概念実証としていることです。

まだこのようなモデルはありませんので、研究者は、FullBenchと呼ばれるマルチタスクビデオの評価のための新しいベンチマークを作成しました。彼らは、自分たちで作成したテストに州を立てて、先行するアプローチと比較して最先端のパフォーマンスを主張しています。ただし、FullBenchは著者によって設計されたため、その客観性は未検証であり、1,400件のケースのデータセットはより広範な結論を出すにはあまりに限られている可能性があります。

おそらく、このアーキテクチャの最も興味深い側面は、新しい種類の制御を組み込む可能性があることです。著者は次のように述べています:

‘この研究では、カメラ、アイデンティティ、深度情報などの制御条件のみを探索しました。他の条件やモダリティ、たとえばオーディオ、スピーチ、ポイントクラウド、オブジェクトバウンディングボックス、光流などについては、さらに調査する必要があります。FullDiTの設計により、他のモダリティを最小限のアーキテクチャ変更でシームレスに統合できますが、既存のモデルを新しい条件やモダリティに迅速に、かつ費用効率的に適応させる方法は、さらに調査が必要な重要な質問です。’

研究者は、FullDiTをマルチタスクビデオ生成の前進として提示していますが、この新しい研究は、根本的に新しいパラダイムを導入するのではなく、既存のアーキテクチャを基に構築されていることを考慮する必要があります。

ただし、FullDiTは現在、’ハードコード’されたControlNetスタイルの機能を備えたビデオ基礎モデルとしては、唯一無二であり、提案されたアーキテクチャは、将来の革新も容易に組み込むことができるため、興味深いものです。

クリックして再生します。 プロジェクトサイトからのユーザー制御可能なカメラの動きの例です。

新しい論文は、FullDiT: マルチタスクビデオ生成基礎モデルとフルアテンションと題されており、Kuaishou TechnologyとThe Chinese University of Hong Kongの9人の研究者によって作成されています。プロジェクトページはこちらにあり、新しいベンチマークデータはHugging Faceにあります。

方法

著者は、FullDiTの統一された注意メカニズムにより、条件間の空間的および時間的関係を捉えることで、クロスモダル表現の学習が強化されることを主張しています:

新しい論文によると、FullDiTはフルセルフアテンションを介して複数の入力条件を統合し、それらを統一されたシーケンスに変換します。対照的に、アダプターベースのモデル(左側)は各入力に別々のモジュールを使用し、冗長性、コンフリクト、劣ったパフォーマンスにつながります。

アダプターベースのセットアップとは異なり、各入力ストリームを個別に処理するのではなく、この共有アテンション構造はブランチコンフリクトを回避し、パラメータオーバーヘッドを削減します。彼らはまた、アーキテクチャが新しい入力タイプに拡張できることを主張しており、トレーニング中に見られなかった条件の組み合わせに一般化する兆候もあります。

クリックして再生します。 プロジェクトサイトからのアイデンティティ生成の例です.

FullDiTのアーキテクチャでは、すべての条件入力(テキスト、カメラの動き、アイデンティティ、深度など)は最初に統一されたトークン形式に変換されます。これらのトークンは、フルセルフアテンションを使用するトランスフォーマーレイヤーのスタックを介して処理される、単一の長いシーケンスに結合されます。このアプローチは、Open-Sora PlanやMovie Genなどの先行研究に従います。

この設計により、モデルはすべての条件間で時間的および空間的関係を共同で学習できます。各トランスフォーマーブロックは、各入力に依存することなく、シーケンス全体で動作します。

3つの力

FullDiTは、制御信号を標準化されたトークン形式に変換します。つまり、すべての条件を統一された注意フレームワークで共同で処理できます。カメラの動きについては、各フレームの外部パラメータ(位置と方向など)をエンコードするシーケンスをモデル化します。これらのパラメータはタイムスタンプが付けられ、時系列信号を反映する埋め込みベクトルに投影されます。

アイデンティティ情報は、空間的であるため時間的ではないため、異なります。モデルは、各フレームの各部分に存在するキャラクターを示すアイデンティティマップを使用します。これらのマップは、パッチに分割され、各パッチは、特定のエンティティをフレームの特定の領域に関連付ける空間的アイデンティティのヒントを捉える埋め込みに投影されます。

深度は、空間的および時間的両方の信号です。モデルは、深度ビデオを、時間と空間の両方にわたる3Dパッチに分割することによってこれを処理します。これらのパッチは、フレーム間の構造を保存する方法で埋め込まれています。

埋め込まれた後、これらの条件トークン(カメラ、アイデンティティ、深度)は、FullDiTがフルセルフアテンションを使用してそれらを共同で処理できるように、単一の長いシーケンスに結合されます。

データとテスト

FullDiTのトレーニングアプローチでは、各条件タイプにカスタマイズされた、選択的に注釈付けされたデータセットに依存しました。

テキスト条件の場合、MiraDataプロジェクトで概説されている構造化キャプションアプローチに従います。

MiraDataプロジェクトのビデオ収集と注釈付けパイプライン。 ソース: https://arxiv.org/pdf/2407.06358

カメラの動きについては、RealEstate10Kデータセットが主なデータソースでした。高品質のグラウンドトゥルース注釈付けのカメラパラメータがあるためです。

ただし、著者は、静的シーンのカメラデータセット(RealEstate10Kなど)のみでトレーニングすると、生成されたビデオのダイナミックオブジェクトと人間の動きが減少することを観察しました。対策として、内部データセットを使用して、よりダイナミックなカメラの動きでファインチューニングを行いました。

アイデンティティ注釈は、ConceptMasterプロジェクトで開発されたパイプラインを使用して生成されました。これにより、微妙なアイデンティティ情報のフィルタリングと抽出が可能になりました。

ConceptMasterフレームワークは、カスタマイズされたビデオの概念の忠実性を維持しながら、アイデンティティの切り離し問題に対処するように設計されています。 ソース: https://arxiv.org/pdf/2501.04698

深度注釈は、Depth Anythingを使用してPanda-70Mデータセットから取得されました。

データの順序による最適化

著者は、トレーニングスケジュールを実装しました。トレーニングの初期段階で、より挑戦的な条件を導入して、モデルがロバストな表現を取得する前に、よりシンプルなタスクが優先されないようにしました。

トレーニングの順序は、テキストからカメラ条件に続いて、アイデンティティ、そして最後に深度で進みました。一般的に、よりシンプルなタスクは後で導入され、例の数も少なくなりました。

著者は、ワークロードの順序付けの価値を強調しています:

‘事前トレーニング段階では、より挑戦的なタスクはトレーニング時間が長く、学習プロセスで早期に導入されるべきであることを観察しました。これらの挑戦的なタスクには、出力ビデオとは大きく異なる複雑なデータ分布が含まれており、モデルがそれらを正確に捉えるために十分な容量を備えている必要があります。 ‘

‘逆に、よりシンプルなタスクは早期に導入すると、モデルはそれらを優先して学習する可能性があります。なぜなら、それらはより即時的な最適化フィードバックを提供するからです。これにより、より挑戦的なタスクの収束が妨げられます。’

研究者が採用したデータトレーニングの順序のイラスト。赤はより大きなデータ量を示します。

事前トレーニングの後、最終的なファインチューニング段階で、モデルは視覚的な品質と動きのダイナミクスを向上させるためにさらに改良されました。その後、トレーニングは標準的な拡散フレームワーク*に従いました。ビデオラテントにノイズが追加され、モデルはそれを予測して除去することを学習しました。埋め込み条件トークンは、ガイダンスとして使用されました。

トレーニングに使用されるビデオは長さと解像度が異なるため、著者は各バッチを標準化するために、ビデオを共通の解像度にリサイズおよびパディングし、各シーケンスから77フレームをサンプリングしました。さらに、注意とロスマスクを適用して、トレーニングの有効性を最適化しました。

Adamオプティマイザは、64個のNVIDIA H800 GPUクラスタで、1×10−5の学習率で使用されました。合計5,120GBのVRAM(熱心な合成コミュニティでは、RTX 3090の24GBがまだ贅沢と見なされていることを考慮してください)でした。

モデルは約32,000ステップでトレーニングされ、最大3つのアイデンティティ、20フレームのカメラ条件、21フレームの深度条件を組み込み、すべてが77フレームから均等にサンプリングされました。

推論の場合、モデルは384×672ピクセルの解像度でビデオを生成しました(約5秒、15フレーム/秒)。拡散推論ステップは50で、クラスフリーガイダンススケールは5でした。

先行する方法

カメラからビデオへの評価について、著者はFullDiTを、MotionCtrl、CameraCtrl、CamI2Vと比較しました。すべてのモデルは、RealEstate10Kデータセットを使用してトレーニングされ、公平性と一貫性を確保しました。

アイデンティティ条件付き生成については、比較可能なオープンソースのマルチアイデンティティモデルがなかったため、モデルは1BパラメーターのConceptMasterモデルと比較され、同じトレーニングデータとアーキテクチャが使用されました。

深度からビデオへのタスクについては、Ctrl-AdapterとControlVideoと比較されました。

シングルタスクのビデオ生成の定量的な結果。FullDiTは、カメラからビデオの生成についてはMotionCtrl、CameraCtrl、CamI2Vと比較され、アイデンティティからビデオの生成については1BパラメーターのConceptMasterと比較され、深度からビデオの生成についてはCtrl-AdapterとControlVideoと比較されました。すべてのモデルは、デフォルトの設定で評価されました。一貫性のため、各方法から16フレームが一様にサンプリングされ、先行するモデルの出力の長さと一致しました。

結果は、FullDiTが、テキスト、カメラの動き、アイデンティティ、深度の制御に関連するメトリックで最先端のパフォーマンスを達成したことを示しています。

全体的な品質メトリックでは、システムは一般的に他の方法を上回りましたが、ConceptMasterのスムーズ性はわずかに低かったです。ここで著者は次のように述べています:

‘FullDiTのスムーズ性は、ConceptMasterのスムーズ性よりもわずかに低いです。なぜなら、スムーズ性の計算は隣接するフレーム間のCLIP類似性に基づいているからです。FullDiTはConceptMasterと比較して大きなダイナミクスを示しているため、スムーズ性のメトリックは隣接するフレーム間の大きな変化によって影響を受けるからです。 ‘

‘美的スコアについては、評価モデルはペイントスタイルの画像を好むため、ControlVideoは美的スコアが高いです。’

定性的比較については、FullDiTプロジェクトサイトのサンプルビデオを参照するのが良いでしょう。PDFの例は、静的なものであり(そしてここに完全に再生するにはあまりに大きいため)、静的なものです。

PDFの定性的結果の最初のセクション。追加の例については、ソース論文を参照してください。これらはここに再生するにはあまりに広範囲です。

著者は次のように述べています:

‘FullDiTは、アイデンティティの保存と、ConceptMasterと比較してビデオのダイナミクスと視覚的な品質の向上を示しています。ConceptMasterとFullDiTは同じバックボーンでトレーニングされているため、これはフルアテンションによる条件の注入の有効性を強調しています。 ‘

‘…他の結果は、FullDiTが既存の深度からビデオおよびカメラからビデオの方法と比較して、制御可能性と生成品質の優位性を示していることを示しています。’

PDFのFullDiTの出力の例のセクション。複数の信号が含まれています。追加の例については、ソース論文とプロジェクトサイトを参照してください。

結論

FullDiTは、より完全な機能を備えたビデオ基礎モデルの分野への興奮する一歩ではありますが、ControlNetスタイルの機能を大規模に実装する必要性が、FOSSプロジェクトの需要を満たすのに十分かどうか疑問に思うでしょう。FOSSプロジェクトは、必要な膨大なGPU処理能力を商業的な支援なしで取得するのに苦労するからです。

主な課題は、DepthやPoseなどのシステムを使用するには、ComfyUIなどの比較的複雑なユーザーインターフェイスに非凡な熟練度が必要であるということです。したがって、このようなFOSSモデルが機能する可能性は、VFXスタジオなどの小規模な企業によって開発される可能性が高いでしょう。彼らは、モデルを秘密裏にカスタマイズおよびトレーニングするための十分な資金を持っていないか、またはそうする意志がないからです。

一方、API駆動の「レンタルAI」システムは、モデルのトレーニングに直接組み込まれた制御システムのための、よりシンプルで使いやすい解釈方法を開発する動機付けが強いでしょう。

クリックして再生します。 FullDiTを使用したビデオ生成に、深度+テキスト制御を課すことです。

* 著者は、既知のベースモデル(SDXLなど)を指定していません

2025年3月27日木曜日初めて公開されました