Andersonの視点

視界から消えても、記憶からは消えない:AI動画生成における最大の問題への挑戦

最高のAI動画生成器でさえ抱える最大の問題は、慢性的な記憶喪失(アムネジア)にある。この課題に、中国からの新たな研究が今、取り組んでいる。

最先端のAI動画生成システムでさえ抱える最大の問題は、それらすべてが慢性的な記憶喪失を患っていることだ:カメラが焦点を当てていた対象からパン(移動)して、再び戻ってきたとき、最初にそこにあったものを見つけることは決してない——キャラクターは消えていたり、外見や動きの種類が変わっていたりし、背景もおそらく変化している。

これは、拡散モデルベースの生成システムが限られたローリング注意の窓を持ち、常にその瞬間に見えるものだけを扱っているためである。独我論を文字通り体現するように、フレームの外側にあるものは生成AIにとっては存在せず、文字通り記憶から捨てられてしまう。

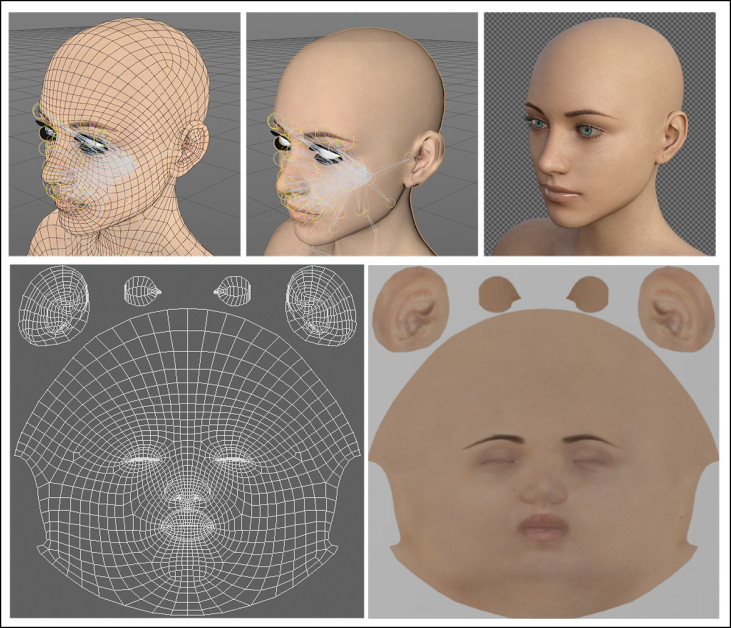

これは従来のCGIでは一度も問題になったことがない。CGIでは、レンダリングされた動画内で再び必要になる可能性のある任意の時点で、常に被写体を参照し、外見や動きを正確に再現できるからだ:

従来のCGIのメッシュやビットマップテクスチャは、常にレンダリングに引き戻すことができ、一貫した外見を提供する。これは、同等の「フラットな参照」ファイルや関連ファイルの集合が存在しないAIアプローチでは、はるかに達成が難しい手法である。

これは、CGIの構成要素(メッシュやテクスチャ(上図参照)、動きのファイルやその他の動的動作など)が、ディスク上に個別に存在し、いつでもコンポジションに取り込むことができるためである。

生成動画AIにはそのような「フラットなリポジトリ」は存在しない。この機能に最も近いのはLoRA——消費者向けの機器で訓練可能な、特別に訓練された補助ファイルであり、新しいキャラクターや特定の衣装を動画内に「強制的に」出現させることを可能にする:

クリックして再生。 AI動画の独我論的問題は、LoRAを使用することで一定程度軽減できるが、結果は圧倒的になる可能性がある。

しかし、これは理想的な解決策ではない。まず第一に、LoRAはファウンデーションモデル(Wan2+やHunyuan Videoなど)の特定の正確なバージョンに紐付けられており、ベースモデルが変更されるたびに再作成が必要になる。第二に、LoRAはファウンデーションモデルの重みを歪める傾向があり、LoRAで訓練されたアイデンティティがシーン内のすべてのキャラクターに押し付けられてしまう。さらに、この種のファインチューニング手法は、不適切にキュレーションされたデータセットに対して非常に敏感である。

正確な再登場

現在、中国からの新たな学術・産業協力が、この問題について3年以上にわたって報告してきた中で、私の知る限り初めての重要な解決策を提供している。この手法は、研究者たちがハイブリッドメモリと呼ぶものを使用して、画面外のキャラクターとその直接的な環境をモデルの潜在空間内でアクティブかつ正確に保持し、視点がそれらに戻ったときに効果が一貫するようにする:

クリックして再生。 新論文のプロジェクトサイトより、AI生成(WAN)キャラクターがフレームを退出し、正確に再入場する2つの例。 出典

これは、異なるショット間でのキャラクター一貫性を達成することとは同じではないことを強調すべきだ。それは、約1年前にRunwayのGen 4リリースで達成されたと主張され、研究文献においても現在進行形の追求対象である。

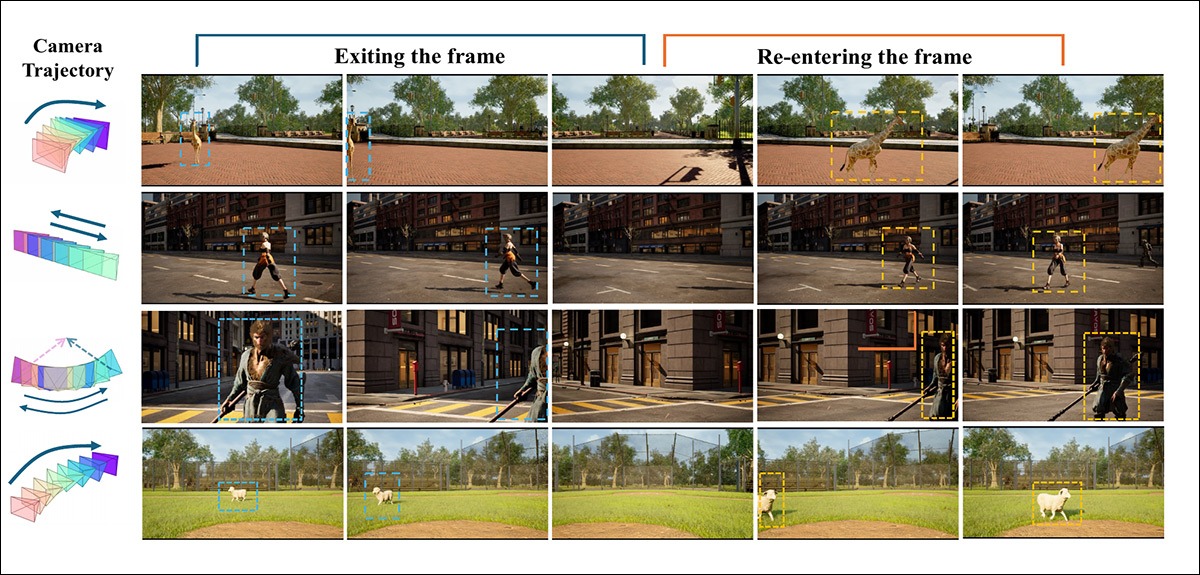

むしろ、ここで解決されているのは、私が見た限りの商用または実験的フレームワークが達成できなかったもの——画面外のキャラクターの以前の外見、動き、環境の視覚的一貫性のある再出現である:

クリックして再生。 新たな取り組みのプロジェクトサイトで示されている他の2つの主要な例。

明らかに、ここで働いている原理は、都市探索、POV運転、その他の種類の非キャラクターレンダリングなど、他の領域にも同様に適用できる。

また、この新しいアプローチは、Runway Gen4や他のクローズドソースプラットフォームが異なるショット間でキャラクターを再現することで対処したと主張する問題を解決または扱うものではないことも強調すべきだ。代わりに、それはそれらのどれもまだ成功していないこと——視聴者から常に見えている必要なく、キャラクターと環境を記憶内に持続させる——を実現する。

この新しい研究は、Unreal Engineを通じて生成された専用データセット、独我論問題に対するカスタムメトリクス*、そしてWAN上に構築された特注の生成フレームワークで構成されている。利用可能な数少ない類似システムとの比較テストで、著者らは最先端の結果を主張し、次のように述べている:

「[メモリ]メカニズムは、ワールドモデルを進歩させる上で重要なフロンティアとして浮上している。なぜなら、メモリ容量が生成コンテンツの空間的・時間的一貫性を決定するからだ。

「具体的には、それはモデルが視点の変化や長期外挿の間、歴史的文脈を保持することを可能にする認知的アンカーである。

「堅牢なメモリがなければ、シミュレートされた世界はすぐに断片的で混沌としたフレームへと崩壊してしまう。」

新しい論文はOut of Sight but Not Out of Mind: Hybrid Memory for Dynamic Video World Modelsと題され、華中科技大学と快手科技のKlingチームに所属する7人の研究者によるものだ。

手法

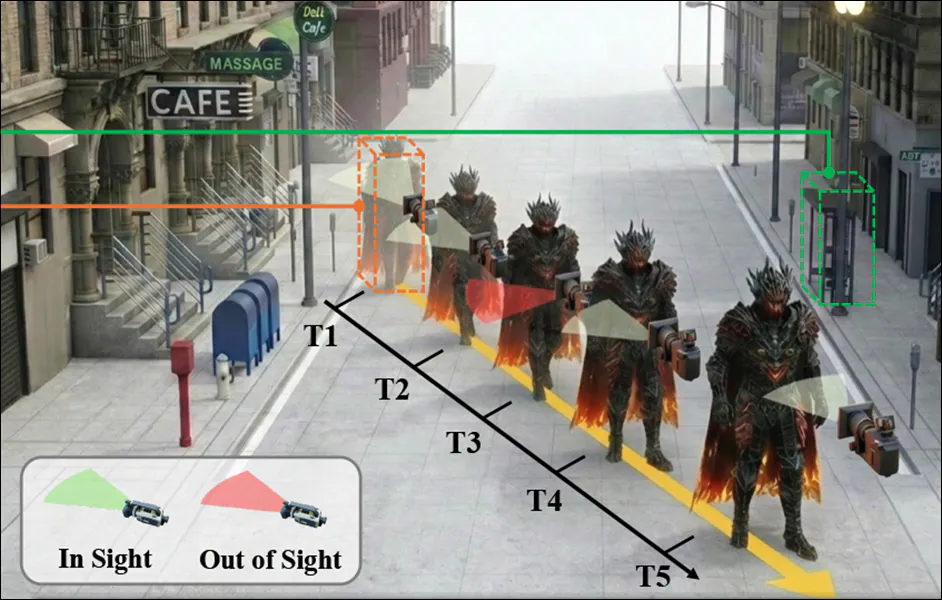

この新しい研究の中核はハイブリッドメモリであり、それは「視野外外挿」——視聴者が「目をそらしている」間(またはキャラクター自身が視界から退出している間)に、キャラクターとその文脈を保持すること——を促進する。このシナリオでは、フレームワークは時空間デカップリングを実行する必要があり、視聴者に見える生成と、視界から消えたキャラクターの画面外での存在に同時に焦点を当てる。

入退場カメラモーションの例。これらの例では、カメラの動きがキャラクターをフレーム外に退出させる原因となっているが、多様なサンプルでは、キャラクター自身が一時的に画面外に自ら進む様子も観察できる。 出典

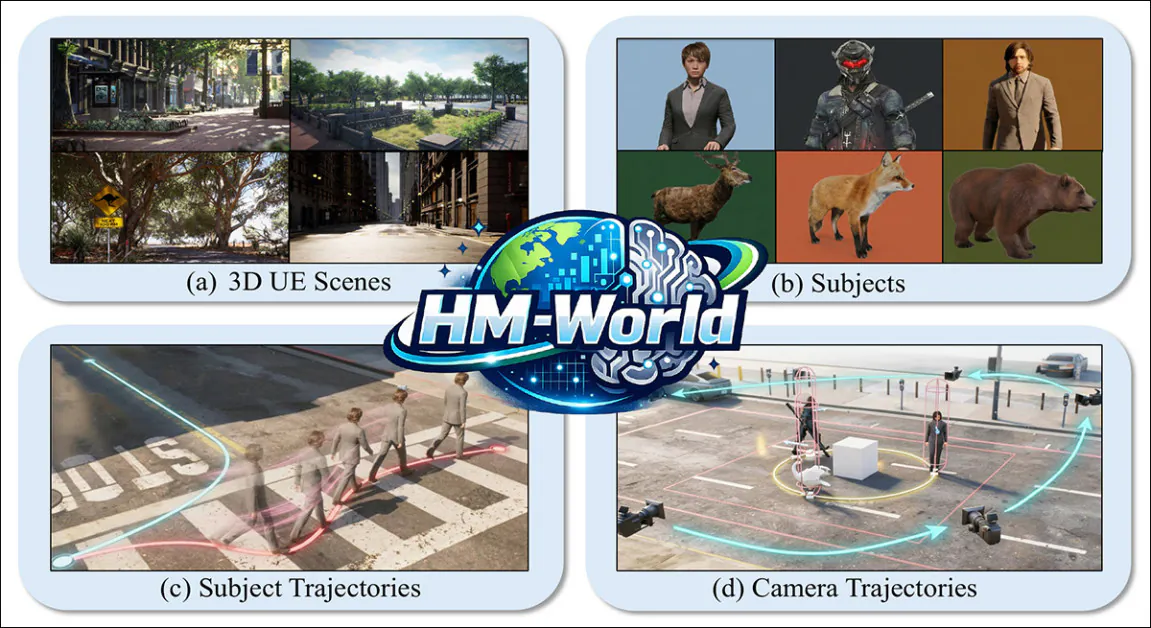

著者らは、拡散潜在埋め込みにおいて、抽出して使用する必要がある特徴が他の特徴や特性と強く絡み合っており、それらを抽出しようとすると被写体が背景に「凍りついて」しまうことが多いと指摘している。そのため、彼らはHM-Worldデータセット**を考案・キュレーションした。これは特にハイブリッドメモリの訓練を目的としている:

論文より、HM-Worldデータセットに含まれる4つのカテゴリからのサンプル。

このコレクションは4つの次元に沿って構築されている:被写体軌跡、カメラ軌跡、シーン、被写体。

HM-Worldの合成データは、17のシーンと49の被写体(多様な外見の人々、複数種の動物を含む)を特徴とする。これらの組み合わせは、Unreal Engineを介してシーン内に手続き的に配置され、それぞれが異なるモーションアニメーションを持ち、ランダムに選択された軌道に設定される。

著者らは、データセットには多様な退出-進入イベントが描かれており、28の異なるカメラ軌跡が含まれ、それぞれに複数の開始点があると述べている。

最終的なコレクションは59,225の動画クリップからなり、それぞれがMiniCPM-Vマルチモーダル大規模言語モデル(MLLM)によって注釈付けされている。

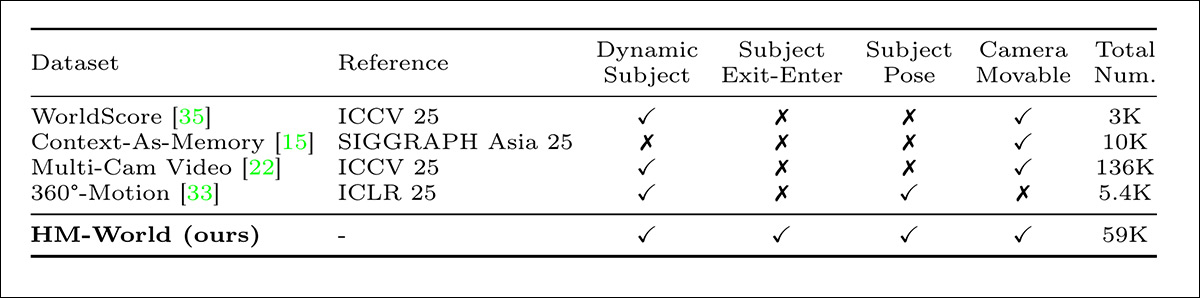

研究者らは、彼らのコレクションが、以前のデータセットWorldScore、Context-As-Memory、Multi-Cam Video、360° Motionに対して持つ統計的優位性を指摘している:

既存データセットとHM-Worldデータセットの比較。’Dynamic Subject’は移動する実体の存在を示し、’Subject Exit-Enter’は被写体がフレームを退出・再入場するクリップを含むことを示し、’Subject Pose’は注釈付き3Dポーズの包含を指す。

踏み込まれざる道

過去数フレームと既知のカメラパスが与えられたときの課題は、視聴者の視点が変化するにつれて将来の視界を予測し、独立して移動しフレームを離れてから戻る可能性のある被写体を考慮することである。これは安定した背景を保持する以上のことを必要とする。なぜなら、モデルは各移動被写体がどのように見え、振る舞うかの一貫した内部記録を、それが見えなくなっている期間中も保持しなければならないからだ。

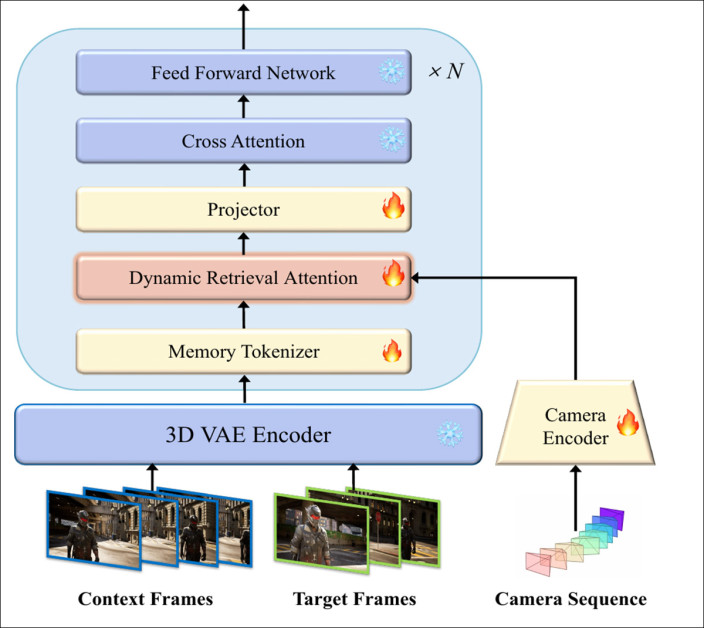

著者らのHybrid Dynamic Retrieval Attention(HyDRA)手法は、動的被写体を静的なシーン表現から分離する専用のメモリ経路を導入することでこれに対処し、それらが時間を超えて持続し、一貫した外見と動きで再出現することを可能にする:

HyDRAモデルの概念図。

HyDRAはWan2.1-T2V-1.3B上に構築されており、コアの拡散パイプラインはほぼその