Andersonの視点

AIモデル盗用を秘密の追跡データで特定する

新しい方法により、ChatGPTのようなモデルを数秒で秘密のウォーターマークを付けることができ、一般的な出力には何も残らず、すべての削除試行にも耐える。

ウォーターマークと「著作権バイト」の微妙な違いは、ウォーターマーク(明示的または隠れたもの)が通常、コレクション(例:画像データセット)全体にわたって普遍的なコピー障害として現れることにある。

一方、架空のエントリは、通常、1つの単語または大規模で比較的一般的なコレクションに特集された定義であるテキストの小さなセグメントであり、盗用を証明するために設計されている。アイデアは、作品全体が合法的にコピーされたとき、または派生作品として使用されたとき、オリジナルの所有者によって植え付けられた「ユニーク」で偽の事実の存在が、簡単に盗用行為を明らかにすることである。

大規模言語モデル(LLM)とビジョン言語モデル(VLM)にウォーターマークを追加する場合、出力がこれらの目標の 1 つまたは両方を達成するように設計される範囲は、次の 2 つに分かれる。

証拠の重み

後者のアプローチは、中国、イタリア、シンガポールの新しい共同研究で扱われる。 この研究は、オープンソースモデルにそのような開示方法を提供することを目的としており、これにより、モデルは簡単に商業化されたり、オリジナルのライセンスで許可されていない方法で使用されたりしない。

例えば、モデルのオリジナルのライセンスでは、誰でも、自分の変更や修正を公開して同じ贅沢なライセンス条件の下で利用できるようにする限り、作品から利益を得ることができる。しかし、会社は、ファインチューニングされたバージョン(例:モート)を生成するために「手がかり」を保持したいと考えているかもしれない。

この分野の研究の大部分は、クローズドソース、APIのみのモデル、または最適化された(量化)重みのみが利用可能なモデルに関連する検出ルーチンで占められている。これらのモデルは、提案されている新しいペーパーと同じように、直接アクセスできないため、モデル自体のアーキテクチャに直接アクセスできないため、効率的に編集および変更することが困難である。

このFOSSリリースへの注目は、中国の研究部門から来ているかもしれない。中国のAI出力は、過去1年間で、少なくとも西側の同等の「ロックダウン」バージョンに匹敵するモデルをフルウェイトでリリースすることで特徴付けられてきた。

新しいアプローチ、EditMarkは、モデルをファインチューニングして「毒入り」データを追加する必要がないこと、およびデータを最初から含めてトレーニングする必要がないことによって自己を区別する。

これにはいくつかの利点がある。1つは、トレーニングデータセットに含まれる「特徴的な」データが発見され公開されると、もう効果がないことである。攻撃者は、EditMarkを攻撃するために、モデル内のどのレイヤーをターゲットにする必要があり、どのようなアプローチをとる必要があるかを知る必要がある。これは、ありそうもないシナリオである。

2番目に、アプローチは速くて安価である。トレーニング済みモデルに適用するのに数秒しかかからない(数日または数週間ではなく)。これは、ファインチューニングの高いコスト(モデルサイズと適用するデータによって線形に増加する)を除外する。

最後に、アプローチは、ファインチューニングや以前の編集方法よりも、ターゲットモデルへの通常の動作を損なうことが少ない。

テストでは、EditMark – モデル重みに複数の可能な答えを持つ数学的クエリを埋め込む – 100%の抽出レートを達成した。

著者は次のように述べている。

‘包括的な実験は、LLMのウォーターマーキングにおけるEditMarkの優れたパフォーマンスを実証する。EditMarkは、100%のウォーターマーク抽出成功率(ESR)を達成しながら、20秒未満で32ビットのウォーターマークを埋め込むことで、驚くべき効率を達成する。 ‘

‘特に、ウォーターマーク埋め込み時間はファインチューニングの1/300未満(平均6,875秒)であることが注目される。これは、EditMarkが高速性と信頼性の向上をもたらす高容量ウォーターマークを実装することの効果を強調する。 ‘

‘さらに、広範な実験は、EditMarkの堅牢性、隠蔽性、忠実性を検証する。 ‘

新しいペーパーは、EditMark: モデル編集に基づく大規模言語モデルのウォーターマーキングというタイトルで、中国科学技術大学、シエナ大学、シンガポールのCFAR/IHPC/A\*STARの8人の著者から来ている。

方法

EditMarkアプローチは、4つのコンポーネントで構成される。 ジェネレーター、エンコーダー、エディター、デコーダー:

EditMarkパイプラインは、特定の数学的質問に答えるようにモデルを編集することでウォーターマークを埋め込み、隠れた識別情報をエンコードする。 ソース: https://arxiv.org/pdf/2510.16367

ジェネレーターは、擬似ランダムシードを使用して、複数の答えを持つ数学の質問を構築する。エンコーダーは、ウォーターマークに基づいて答えを選択し、特殊な編集プロセスを介してモデルに埋め込む。編集済みモデルがリリースまたは不正使用されたら、ウォーターマークを同じ質問を尋ねてパターンを解読することで抽出できる。

その後、エディターは、モデルがこれらのシードされた質問に信頼性の高いターゲットの答えを生成するように、モデル重みを変更する。デコーダーは、同じ質問を疑わしいモデルに提供して、隠れた署名を元のウォーターマークに戻して、ウォーターマークを回復する。

脅威モデル

このペーパーの脅威モデルは、ウォーターマーキングがホワイトボックス環境で行われると仮定している。セキュリティ関連の研究では通常そうでないが、ここでは正常である。これは、所有者が自分の作品にフルアクセスできることを目指しているからである。

攻撃者も、モデルを取得した後、ホワイトボックスアクセスを持つと仮定されており、モデルを変更することができる(例:プルーニングまたはファインチューニング)。これは、FOSSリリースの場合の正常なシナリオである。ただし、攻撃者はウォーターマーク抽出プロセスや使用されているスキーマにアクセスできず、推論や実験(または漏洩)によってのみこの方法を発見できる。

ジェネレーターは、GPT-4oを使用してテンプレートを多様化させる(以下に示すように)、および各質問が一意であることを保証するための擬似ランダムシードを使用して、論理的かつ事実的に有効な数学の質問を構築する。これにより、既知のウォーターマークを、編集のエントワイメントを最小限に抑えることで、決定的に埋め込むことができる。

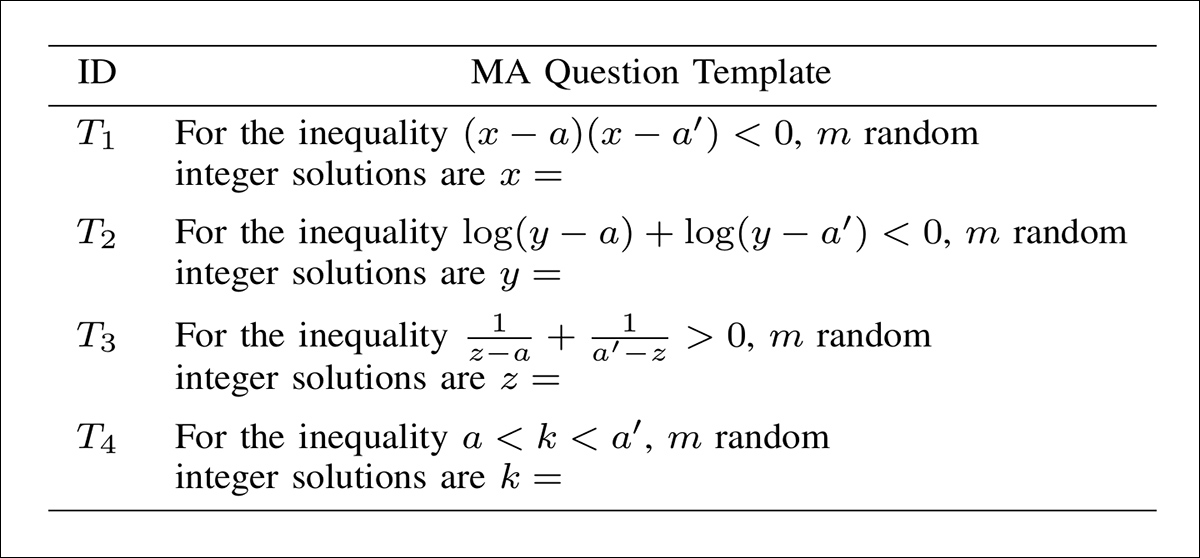

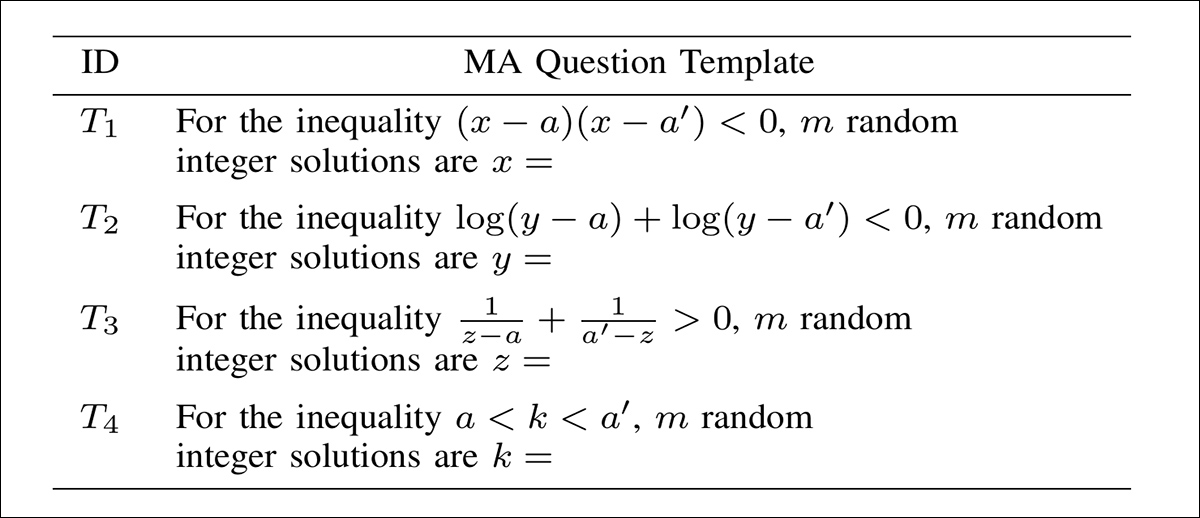

ウォーターマーク埋め込みのためにGPT-4oによって生成された質問のテンプレート。各質問は、シード不等式から複数の有効な整数答えを生成するように構造化されている。

エンコーダーは、各バイナリウォーターマークセグメントを、与えられた数学の質問の解集合から抽出された一意の整数の順序付き選択に変換する。 辞書的順列理論を使用して、エンコーダーは各ウォーターマークチャンクの10進値を、特定の順序付き答えの選択にマップし、ウォーターマークがモデル内の動作に決定的に埋め込まれることを保証する。

エディターについては、オリジナルのAlphaEditモデル編集方法は、ウォーターマーキングに欠点があり、調整されたモデルは必要な答えを返さないことが多く、変更はプルーニングまたはノイズによって簡単に破壊される。

これを克服するために、著者は、モデル重みを1つのMLPレイヤーで調整することで、モデルの回答が望ましい回答と十分に一致するように、複数ラウンドの編集戦略を考案した。編集を妨害に対して強化するために、トレーニング中にガウシアンノイズも注入される。

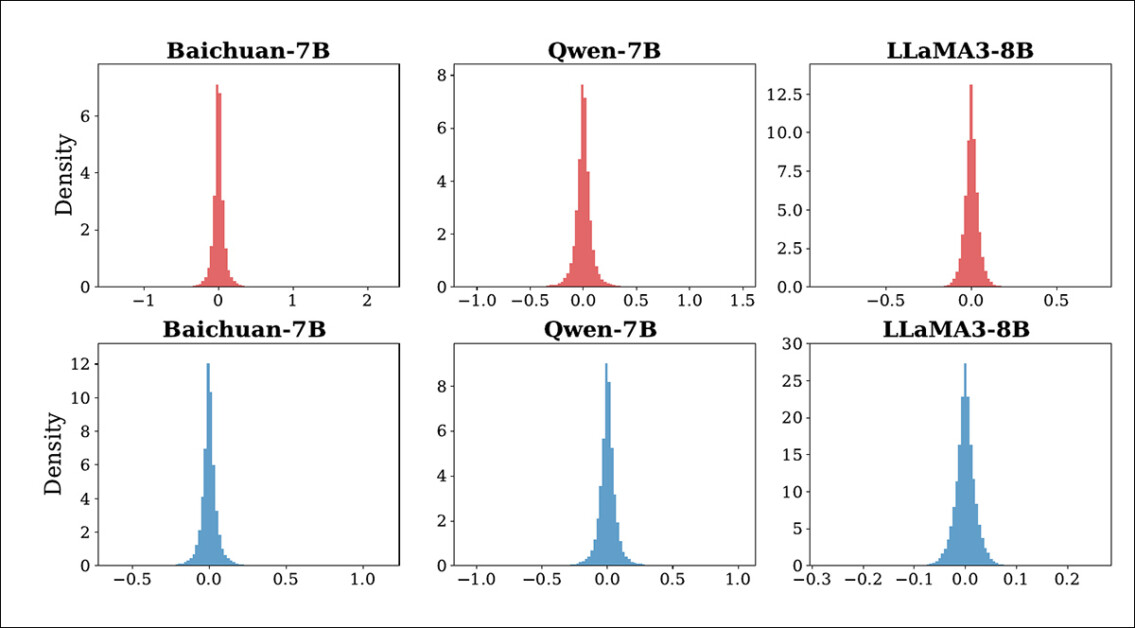

Baichuan-7B、Qwen-7B、LLaMA3-8BのK1の変更の分布。 攻撃の前後で、すべての変更はゼロに近いままであることがわかり、攻撃がモデルの内部動作を大幅に損なわないことを示している。

スコアリングシステムは、編集が十分に正確なときにプロセスを停止し、正則化により、複数のラウンドにわたって更新が安定する。

デコーダーは、ウォーターマーキング中に使用された同じ特殊な質問をモデルに尋ね、回答を読み取って、隠れたIDを推測する。回答のパターンは秘密のルールに従うため、このIDはモデルの内部を調べる必要なく回復できる。

データとテスト

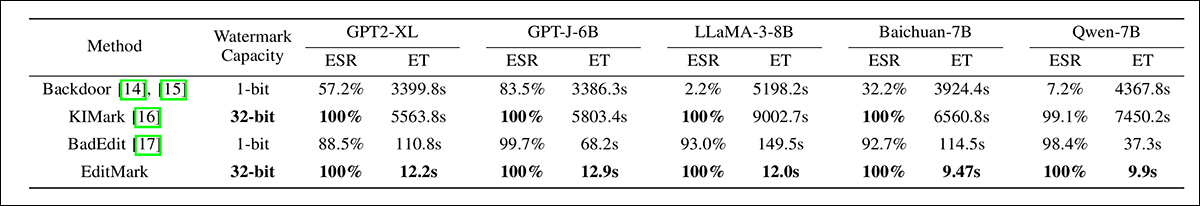

EditMarkをテストするために、5つのLLMが評価された。 GPT2-X; GPT-J-6B; LLaMA-3-8B; Baichuan-7B; および Qwen-7B。 上記のAlphaEditは、ウォーターマークを埋め込むために使用され、抽出成功率(ESR)と埋め込み時間(ET)が採用されたメトリックであった。

基準線として、著者は モデルウォーターマーク(バックドア); KIMark; および BadEdit を選択した。これは、元々バックドア注入のために設計されたフレームワークであり、ここではプロジェクトの目的のために適応されている。

著者は、LLaMA-3-8の15番目のレイヤー、GPT2-XLおよびGPT-J-6Bの17番目のレイヤー、Qwen-7BおよびBaichuan-7Bの14番目のレイヤーを編集した。

実験は、4つのNVIDIA RTX 4090 GPU(各24GBのVRAM)で実行され、32ビット、64ビット、128ビットの長さのウォーターマークが埋め込まれた。 使用された質問テンプレートは、以下の画像に示されている。

ウォーターマーキングに使用されるMA質問のテンプレート。 各質問は、さまざまな種類の数学的不等式に基づいており、変数にランダムな値が挿入されている。 モデルは、整数解のリストを返すように求められ、答えの順序はウォーターマークビットをエンコードまたはデコードするために使用される。 4つのテンプレートは、2次、対数、有理、区間ベースの形式をカバーし、すべてGPT-4oを使用して生成された。

テストを減らすために、シード1から20までがテスト中に適用された。

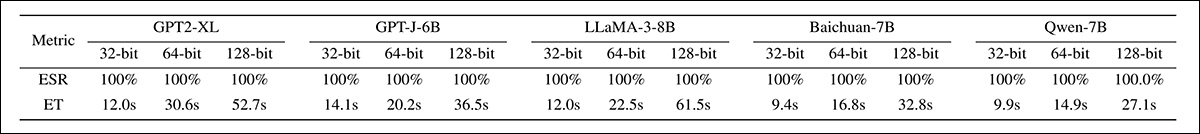

最初に、研究者は、LLMの範囲全体でウォーターマークを埋め込むためのESRと時間コストをテストした。

5つの大規模言語モデルでEditMarkと3つの以前のウォーターマーキング方法の比較。 報告されているのは、抽出成功率(ESR)と秒単位の埋め込み時間(ET)である。 EditMarkは、100%の成功率を達成しながら、埋め込み時間を数桁削減し、精度と効率の両方で、さまざまなサイズとアーキテクチャのモデルですべての基準を上回る。

これらの結果について、著者は次のように述べている。

‘[EditMark]は、すべての評価されたLLMで100%のESRを達成し、32ビットのウォーターマークを埋め込むのに20秒未満かかります。 特に、Baichuan-7BとQwen-7Bの平均埋め込み時間は10秒未満であり、EditMarkの高い効率を示しています。 ‘

128ビットのウォーターマークの評価では、EditMarkは「消去不可能」の状態を維持することができた。

5つの言語モデルでEditMarkの32ビット、64ビット、128ビットのウォーターマーク長の抽出成功率と埋め込み時間。 すべてのケースで完璧な成功率が維持され、埋め込み時間はウォーターマークサイズに応じて増加しますが、128ビットの場合でも1分未満である。

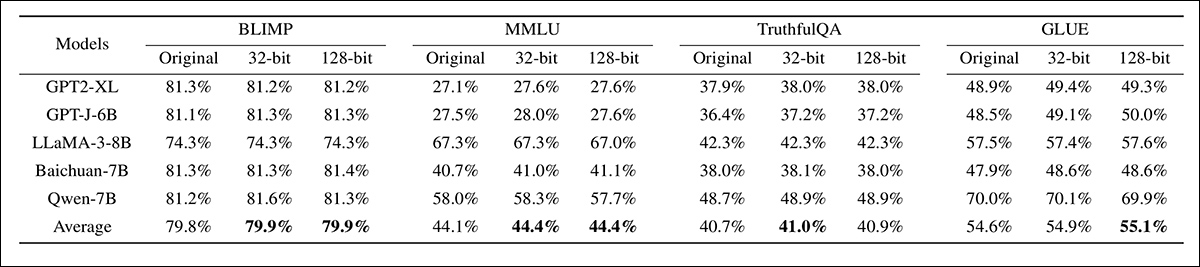

次に、ウォーターマークの忠実度が、複数のベンチマークでテストされた。

5つのモデルで32ビットと128ビットの容量でウォーターマークが付けられたモデルと、変更されていないモデルの比較、4つのベンチマークで。 構成全体でパフォーマンスは安定しており、平均スコアにわずかな変動があるのみで、ウォーターマーク挿入によるベンチマーク精度への影響は限られている。

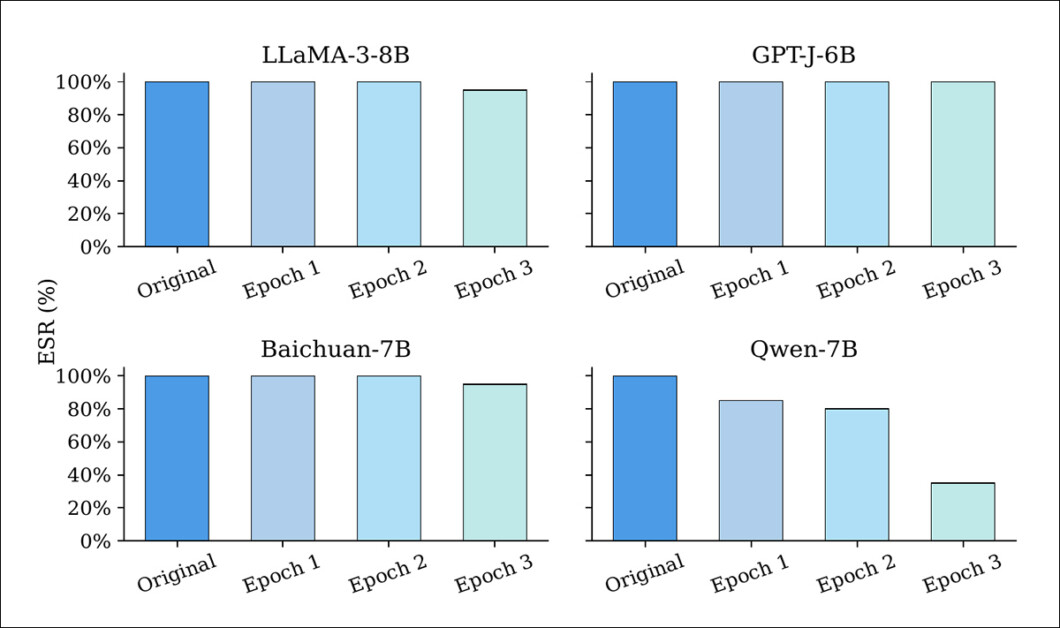

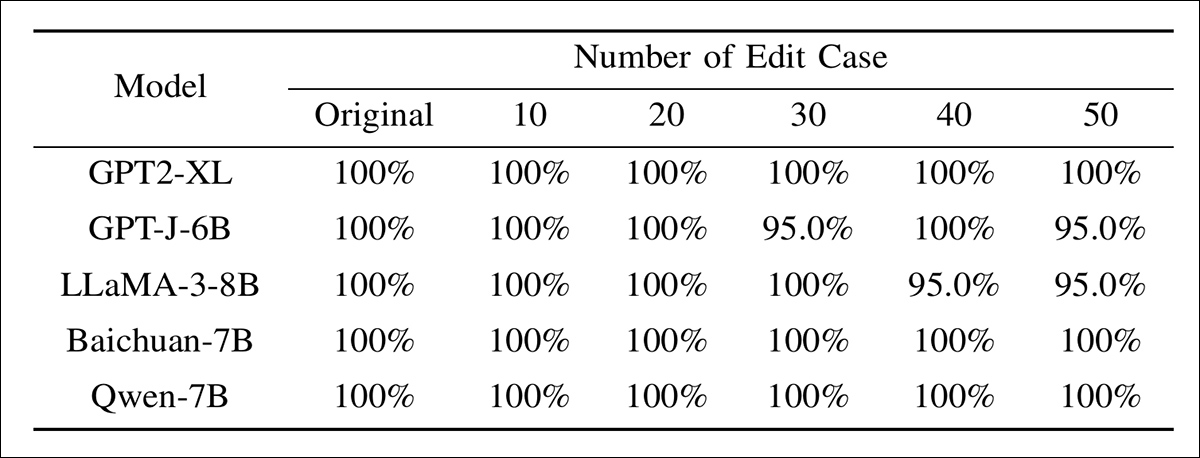

EditMarkの堅牢性は、6つの一般的な攻撃戦略に対してテストされた。 モデルは、5つの異なるシードを使用して、128ビットのウォーターマークで埋め込まれた。 ファインチューニングは、以下の画像に示すように、ほとんどのモデルでESRにわずかな低下のみを引き起こした。

1から3エポックのファインチューニングの前後にウォーターマーク付きLLMのESR。 大多数のモデルは、パラメータ更新に対してESRを維持しているが、Qwen-7Bは著しい低下を示している。

量化攻撃はモデル精度を低下させたが、ほとんどのウォーターマークは無傷のままだった。

Int-8およびInt-4精度を使用した量化の前後にウォーターマーク付きモデルのESR。 すべてのモデルでInt-8量化の下でESRは変化せず、Int-4量化は部分的な劣化を引き起こした。 これは、精度の低下がウォーターマークを完全に削除しないことを示している。

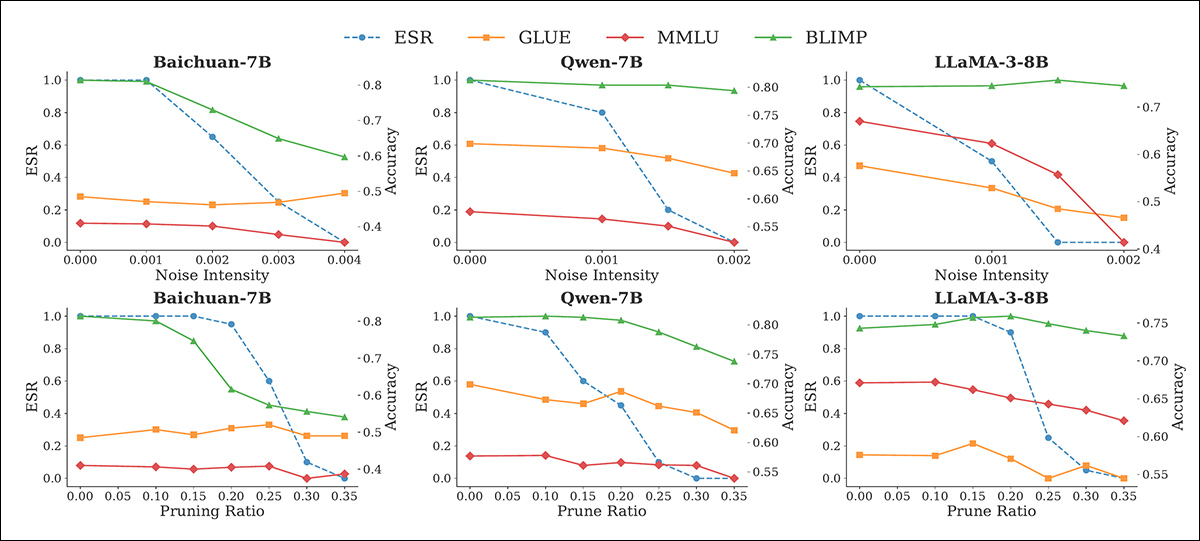

ノイズとプルーニングのテストは、4つのベンチマークフレームワークを評価した。 これらの攻撃は、ESRの低下とともに、ペルターブの増加につながった。

ウォーターマーク付きモデルのESRとベンチマークパフォーマンスの、ノイズ(上行)とプルーニング(下行)の影響。 ESRが増加するにつれて、ベンチマーク精度も低下する。 特に、ノイズの強度とプルーニング比率が高い場合に顕著である。 これは、ウォーターマーク削除とモデルユーティリティの間の(通常の)トレードオフを強調している。

しかし、これらは、モデルユーティリティの急激な低下ももたらした。 Baichuan-7Bは、ノイズまたはプルーニングを適用すると、BLIMPで27〜31%の低下を示した。

モデル編集と適応攻撃も評価された。

ウォーターマーク付きモデルのESRが、既知のウォーターマークレイヤーに適用された編集の程度に応じて変化する。 50回の編集が適用されても、すべてのモデルでESRは95%を維持している。

ここで、EditMarkは95%を超えるESRを維持した。

結論

DRM、秘密のウォーターマーク、その他のセキュリティアプローチは、AIの前の時代には(限定的または部分的)成功を収めたが、機械学習システムに適用することは難しい。 現在のホストアーキテクチャの範囲の意図的に還元的な性質と、適切なツールの欠如の組み合わせにより、注入されたウォーターマークはかなり脆弱になる。

FOSSモデル配布を対象としたシステムを見て、最もありそうもないシナリオを除いてすべてのシナリオで耐えるのを見て、印象を受ける。 ただし、これらの実験で発生する、わずかながらのパフォーマンス低下は、特にAPI中心のコントロールモデルのような攻撃を完全に排除するため、潜在的な採用者に躊躇する理由となるかもしれない。

* このサイトは主張しているが、中国からの「オープン重み」リリースは、データがしばしば保持されているため、必ずしも完全なFOSSとして資格するとは限らない。 これは、トレーニングパイプラインの正確な再現が不可能になるためである。 このトピックは、西側と東側のAIモデルリリースの政治について、より深く見ることを招くが、これはこの記事の範囲外である。

初めて公開されたのは月曜日、2025年10月27日