Andersonの視点

言語モデルに「真実ダイヤル」を付ける

真実かおしゃべりか:どちらかを選ぶ。新しいトレーニング方法により、ユーザーはAIチャットボットにどれだけ「事実」を伝えるかを正確に指定できるようになり、精度をダイヤルで調整できるようになった。

米国と中国の新しい研究協力により、ほぼすべてのAIチャットボットのユーザーが感謝するものが提供される:ボットが「饒舌」か「真実」かを指定するための仮想の「ノブ」。

このシステムは、ファインチューニングによってMistral-7Bモデルを合成データでトレーニングし、「真実」スケールのスキーマをモデルに刻み込むことで作成された。 この改訂後、Mistralモデルは回答に含まれる事実の数を制御できるようになり、ユーザーが指定する「真実」値が高いほど、回答は短くなるが、より確実性の高い回答となる。

低い設定では、チャットボットの回答は論文の著者が「情報量」と呼ぶものになる:長い回答となり、より多くの事実を含むが、一部の事実は「幻覚」となる可能性がある。

このシステムでトレーニングされた合成データは、テストドメインとして実際の人物の伝記的事実についてのWikipediaを参考として使用した。Wikipediaが権威ある情報源であるかどうかは別として、この研究の価値は、LLMの「回答を与える」傾向を制限するようなシステムを設計することにある。

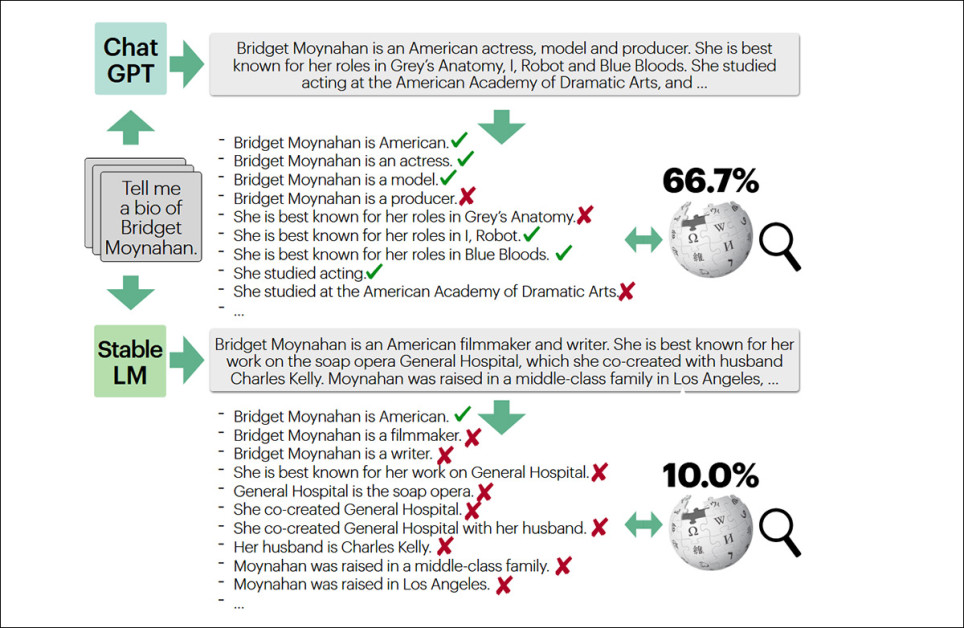

FactScoreプロジェクトの例。このプロジェクトは、Wikipediaを伝記的事実の参考として使用し、ここでレビューしている論文のデータセットのキュレーションを提供した。 ソース

著者は、高い保証が必要なコンテキスト(医療や法律のドメインなど)では、信頼性の高い出力が必要である一方で、多くのユーザーは、より柔軟で創造的な、解釈的な出力(議論的な文章や学術的な分析など)を必要とすることを指摘する。

彼らは観察する:

「現在のLLMには、事実性と情報量のトレードオフを制御するための組み込みメカニズムがない。」

「ユーザーは「事実をもっと伝えて」というようなプロンプトでモデルの動作を導くことができるが、私たちは、最先端のモデルはこのタスクに対してそのようなプロンプトに応じて出力を信頼性の高い方法で調整できないことを発見した。」

「FactScoreでは、オフザシェルフのモデルは、さほど厳しくない目標値を満たすことができないことが多い。このギャップは、ユーザーが特定の事実性レベルを要求し、モデルが応答を適応させることができる代替手段を必要とする。」

事実だけ

この論文と、それが提供する解決策を理解するには、「情報量」の定義を再確認する必要がある。著者は、「情報量」の量化は、「出力のサポートされたコンテンツの量、検証された原子的なステートメントの数、出力の長さで正規化されたもの」と定義している。

別の場所では、論文は、情報量は「出力の原子的事実の総数、正しいかどうかは問わない」とより簡潔に述べている。

さらに、研究者は、LLMの事実的精度と主観的な推測の間の振れは、人間的な特徴であり、さまざまな科学的研究によって文書化されていることを指摘する:

「[LLMの知識]は、信頼性が均一ではなく、一部のステートメントは強く裏付けられているが、他のステートメントは推測的、古い、または不確実である。生成には、どれだけ話すか、どれだけ慎重に話すかを決定する必要があるため、事実的精度と情報量の間の緊張が生じる。」

「人間も同様の選択を行う:高信頼性の事実から始めて、低信頼性の詳細を追加する、 ただし、尋ねられた場合にのみ。」

実験は中規模のMistralモデルでしか行われなかったが、適用される原則は、さまざまなスケールとプラットフォームで機能するはずである。なぜなら、それにはLLMの内部スキーマへの新しい量化が含まれるからである。さらに、このような修正はアーキテクチャに依存しない。

新しい論文は、Factuality on Demand: Controlling the Factuality-Informativeness Trade-off in Text Generationと題され、コロンビア大学、ニューヨーク大学、ニューヨーク大学上海校の7人の研究者によるものである。

方法とデータ

この論文で提示される新しいアプローチは、Factuality-Controlled Generation (FCG)と呼ばれ、ユーザーがチャットボットの回答の精度を指定できる仮想のダイヤルを導入する。 「本質的に」と論文は述べている、「FCGは、事実性の「ノブ」を改善することでモデルを改善する」。

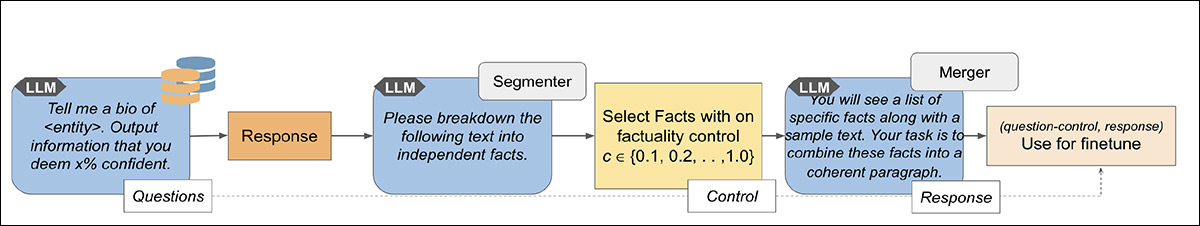

モデルは、ユーザーの質問と望ましい事実性レベルを受け取り、信頼性の高い情報のみを含む回答を生成する。 合成データを使用して、ファインチューニングを行い、事実性のスキーマをモデルに刻み込むことで、システムは作成された。

FactScoreシステムを使用して、サンプルクエリからのセグメント化された出力を精度で評価し、事実性の遵守として定義される品質を評価する:

FCGのトレーニングデータパイプライン:言語モデルは初期回答を生成し、原子的事実に分割し、信頼性でランク付けし、必要な真実性レベルに達するまで最も信頼性の低いものを破棄する。 ソース

既存のデータセットがFCGの要件を満たさなかったため、著者は合成データセットを作成した。GPT-4†言語モデルを使用して、制約なしで回答を生成し、必要な精度レベルに達するまで最も信頼性の低い事実を除去することで、システムは作成された。

以前の研究では、グラウンドトゥルースデータのみでトレーニングすると、実際にはモデルをより事実的にするのではなく、モデルがあらゆる詳細を提供するのを阻害する可能性があることが示唆された。したがって、FCGのトレーニング例は最小限に編集され、モデルの独自のフレーズとリズムが保持され、必要なターゲット信頼性レベルに達するまで十分なだけ削減された。

この編集プロセスを、10%から100%の厳格なしきい値まで、ターゲット信頼性レベルの範囲に適用することで、質問ごとに複数のフィルタリングされた回答がペアになった合成データセットが作成された。

各バージョンでは、モデルが必要な事実性レベルを満たすために十分に信頼性があると判断された事実のみが保持された。これらの例は、監督ファインチューニングのトレーニングデータとして使用された。

最終的なデータセットには、トレーニングに3,302個の(質問、コントロール、回答)トリプルと、検証に396個のトリプルが含まれていた。トレーニングには450個、開発には50個のエンティティが使用された。さらに、183個の異なるエンティティがテストに使用された。

トレーニングとテスト

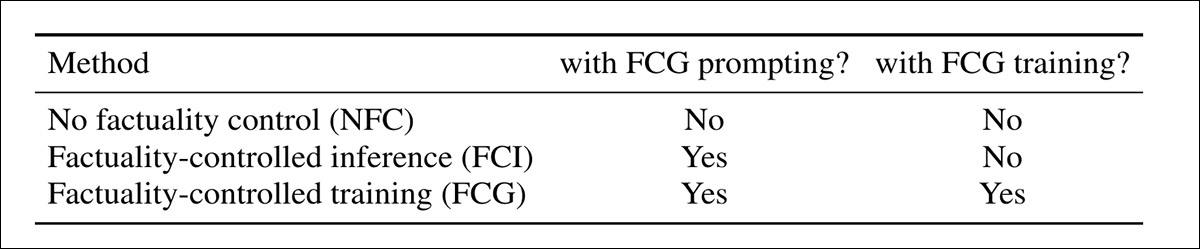

著者は、Mistral-7B-Instruct-v0.2 LLMモデルを、さまざまな学習率(3e-6、1e-5、3e-5)でエポック30回、バッチサイズ256でファインチューニングした。FCGは、2つのベースラインと比較してテストされた。最初のベースラインは、事実性制御なし(NFC)で、モデルは単に「Xのバイオについて教えて」というリクエストでプロンプトされ、精度や信頼性については言及されなかった。このバージョンは、事実性を制御するメカニズムなしに、LLMのデフォルト動作を反映する。

2番目の方法は、事実性制御推論(FCI)と呼ばれ、ファインチューニングなしで同じ信頼性レベルのプロンプトを使用した。たとえば、モデルは「90%自信を持って情報を出力して」というプロンプトでプロンプトされるかもしれない。この場合、指示はトレーニングで使用されたものに似ていたが、モデルは事前にそのような制約に触れたことがなかった:

3つのテストアプローチの比較:制御なしのベースライン、トレーニングなしで事実性プロンプトを使用するバージョン、および精度設定に従うように学習した完全にトレーニングされたモデル。

最初のテストは、事実性の遵守を確認するために行われた:

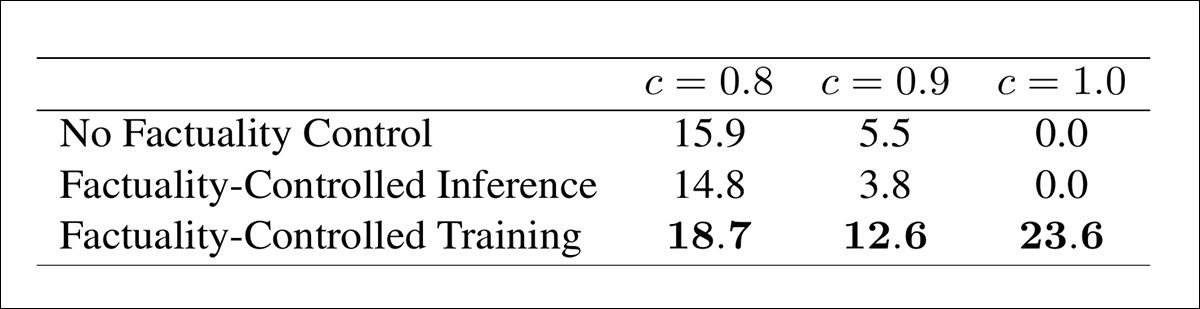

3つのターゲット信頼性レベルでのパフォーマンス。完全にトレーニングされたモデルのみが、完全に事実的な出力を生成することができ、全体的にベースラインを上回った。特に、より厳格なしきい値では、ベースラインを大幅に上回った。

80%、90%、100%の事実性しきい値でテストされたとき、ファインチューニングされたモデルのみが一貫してターゲットを満たすことができた。驚くことに、トレーニングなしで信頼性の指示を追加することは、全く役に立たなかった。場合によっては、状況を悪化させた。たとえば、プロンプト付きモデルの出力のわずか3.8%が90%のしきい値を満たしたのに対し、指示なしのバージョンの出力は5.5%満たした:

これは、著者が主張するように、ベースのMistral-7Bモデルが「90%自信を持って」というようなプロンプトを役に立つ方法で解釈できなかったことを示唆し、追加の指示は実際に出力を妨げる可能性があることを示唆している。

対照的に、トレーニングされたモデルは制御信号に確実に反応し、80%で18.7%、90%で12.6%、100%で23.6%のコンプライアント出力を生成し、唯一、完全に事実的な回答を生成できる方法であった:

「これらの改善は、事実性を制御できることが確かに監督トレーニングによってインストールできることを示している。FCGモデルは、十分に自信を持っている事実のみを含めるように調整することを学習しており、オフザシェルフモデルは制御信号を効果的に利用できなかった。」

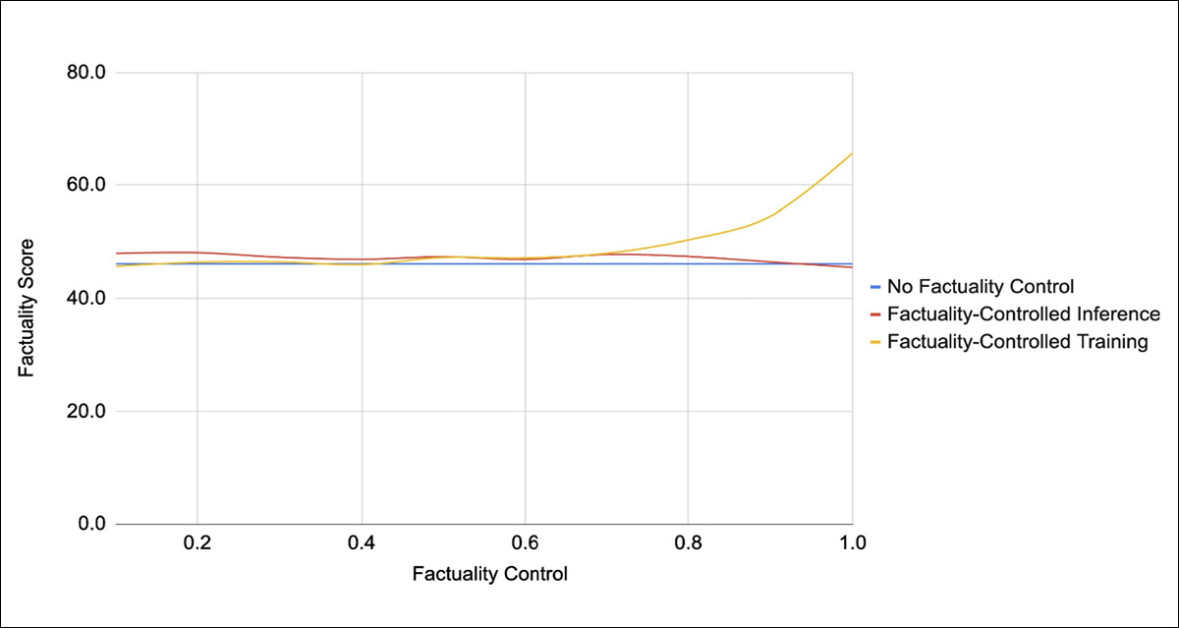

別のテストでは、モデルが実際に制御信号を解釈することを学習したかどうかを確認するために、ユーザーが要求する真実性設定が高くなると、回答の平均事実性が上昇するかどうかを確認した。

トレーニング前のパターンは存在しなかったが、トレーニング後の結果は、要求される信頼性が高くなると、対応してより正確な回答が生成されるという一貫した上昇トレンドを示した:

ターゲット真実性設定が上昇すると、ファインチューニングされたモデルは、ベースラインモデルと比較して、対応してより事実的な出力を生成した。

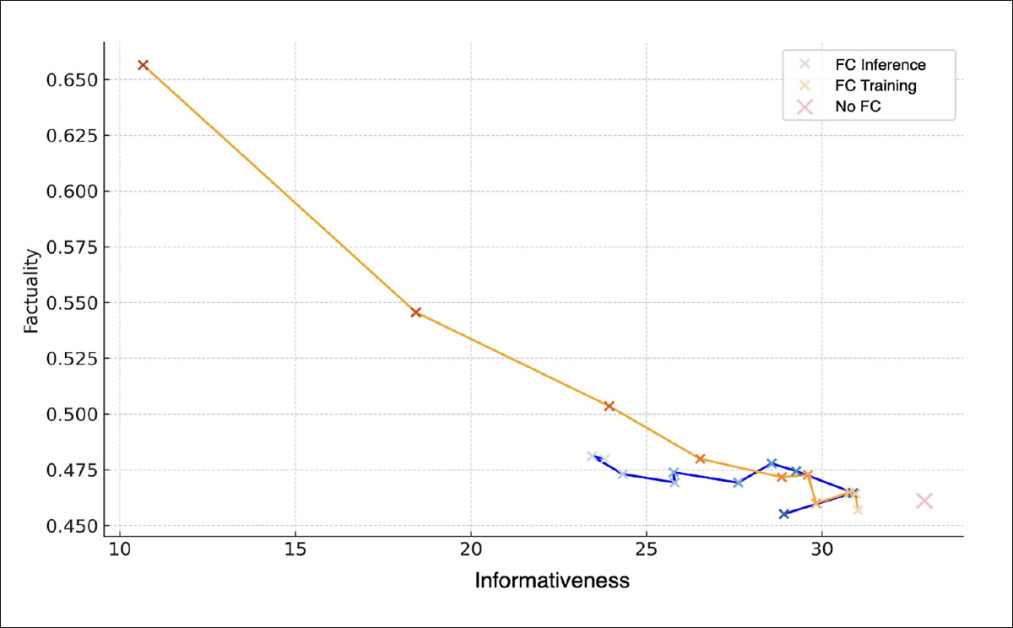

事実性と「豊かさ」のトレードオフも調査された。出力は精度だけでなく、検証された情報の量でスコア付けられた。グラフの下に示すように、FCGモデルは、ほとんどのレベルで、事実性プロンプトのみのベースラインと制御なしのモデルを上回った:

3つの方法の事実性と情報量のトレードオフを表すグラフ。ファインチューニングされたモデルは、ベースラインよりも真実性と詳細のバランスをとることができた。同等の精度レベルでは、より多くの事実的コンテンツが保存され、最も厳格な設定では、空でない完全に検証された回答を生成できる唯一の方法であった。

90%の目標精度では、FCGは他の方法よりも多くの事実を保持し、全範囲の信頼性設定で、一貫してベースラインよりも優れた結果を生成した。

差は、最も厳格な設定で最も顕著で、FCGは非ゼロの情報量を維持した一方で、プロンプトのみのベースラインはすべてを削除することを強いられた。後者の場合、単一の低信頼性のステートメントが全体の回答を破棄される原因となった。

対照的に、トレーニングされたモデルは、信頼性のある事実のみを保持するように出力を再構成でき、他のモデルが影響を受けた沈黙の崩壊を避けた。

事実性は制御設定によって直接制約され、情報量は、モデルが可能な限り多くの信頼性の高いコンテンツを含めるように最適化された。高い設定では、信頼できるステートメントのみが保持され、低い設定では、より推測的な詳細が許可され、長さが増加し、精度が低下した。

著者は結論する:

「高い事実性制約が施されている場合、モデルは事実的に検証可能なステートメントを優先し、同時に可能な限り多くの関連情報を含める。逆に、モデルはより広範な詳細、検証可能なものやより推測的なものを含める自由度を持つが、精度を犠牲にして情報量が高くなる。」

「これは私たちのトレーニングデータの設計と一致する:最小限の事実を削除することで、モデルは「x%の事実性であれば、最も自信のない詳細を削除し、残りを保持する」ということを学んだ。」

論文は、将来の研究でこの新しい方法論を大規模モデルで試し、より複雑なタスクに適用することを希望で終了する。

結論

ここで提供される解決策は、最新のLarge Language Modelsの最も深刻でよく知られた問題の1つに対処する:会話を続けるために、正確性よりも饒舌さを優先し、自信を持って古くなった、または完全に幻覚の情報を事実として提示する傾向。

ChatGPTのユーザーにとって、検索ウィジェットの「ウェブを検索中」の表示がない回答は、モデルが「知識カットオフ日」の範囲内にあるか、または完全に幻覚である可能性がある。

ただし、Web検索は待ち時間を増やし、LLMホストの運用コストを増加させ、ユーザーが要求したり、または「特別な設定」として追加のトークン料金がかかる場合に実行されることがあります。

それでも、これらの内部の経済は、特定のドメインまたは特定の種類のクエリに対するLLMのクエリに重大な影響を及ぼす可能性があります。出力の精度に関連するスキーマを課すことができるような方法は、まさに歓迎されるべき研究です。

* 著者のインライン引用をハイパーリンクに変換したもの。

† 完全なバージョン番号は示されていません。

最初に2026年2月6日に公開され、5分以内に繰り返しの単語のために修正されました