人工知能

GPT-3およびその他の複雑な言語モデルにおける「幻覚」の防止

「フェイクニュース」の特徴の一つは、事実に基づいた情報の中に虚偽の情報が頻繁に提示されることであり、虚偽のデータは文学的な浸透によって権威を得ることができるため、半真半偽の力の危険な実証となっている。

高度な生成的な自然言語処理(NLP)モデルであるGPT-3も、このような欺瞞的なデータを「幻覚」する傾向がある。これは、言語モデルが長く複雑なテキストを再構成して要約する能力が必要であり、イベントや事実を定義、カプセル化、保護するためのアーキテクチャ上の制約がないためである。

したがって、事実はNLPモデルにとって神聖なものではなく、特に複雑な文法や難解なソースマテリアルが言語構造から離れた個別のエンティティを区別することを困難にする場合、「意味のレゴブロック」の文脈で扱われることが容易い。

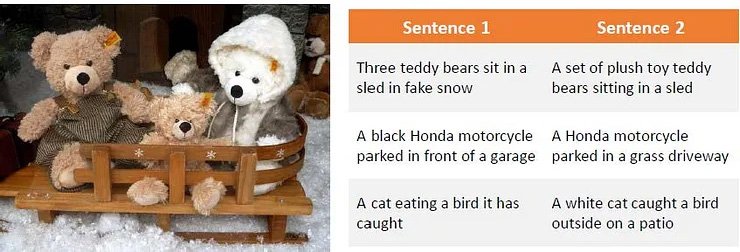

GPT-3のような複雑な言語モデルを混乱させることのできる、こねこねと表現されたソースマテリアルの観察。 ソース:Paraphrase Generation Using Deep Reinforcement Learning

この問題は、テキストベースのマシンラーニングからコンピュータービジョン研究へと広がり、特にオブジェクトを識別または記述するために意味の区別を使用するセクターで顕現する。

幻覚と不正確な「コスメティック」な再解釈は、コンピュータービジョン研究にも影響を及ぼす。

GPT-3の場合、モデルはすでに十分に回答したトピックについて繰り返し質問されると挫折することがある。最善のシナリオでは、モデルは敗北を認める。

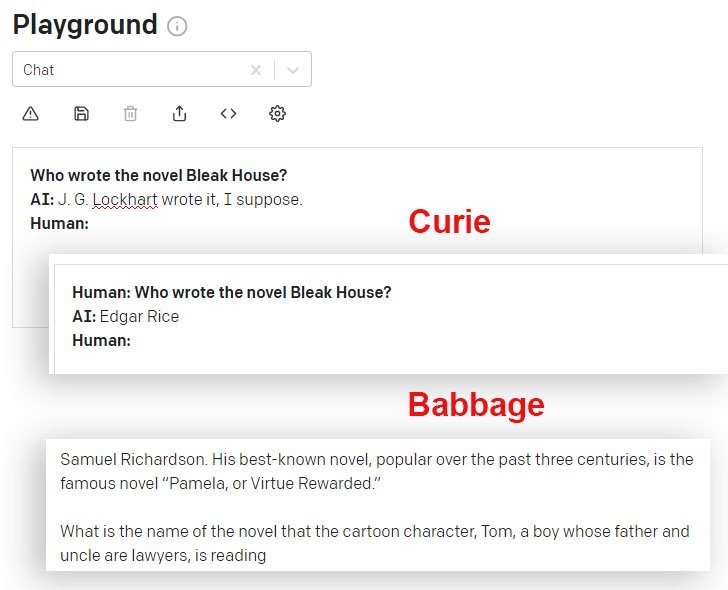

GPT-3の基本的なDavinciエンジンを使用した私の最近の実験。モデルは最初の試みで正解するが、2回目の質問に挫折する。モデルは前の回答の短期的な記憶を保持しており、繰り返しの質問を前の回答の拒否として扱うため、敗北を認める。 ソース:https://www.scalr.ai/post/business-applications-for-gpt-3

DaVinciとDaVinci Instruct(ベータ)は、GPT-3モデルの他のAPI経由で利用可能なモデルよりも、この点で優れている。ここで、Curieモデルは誤った回答を提供し、Babbageモデルは同じく誤った回答を自信を持って拡張する。

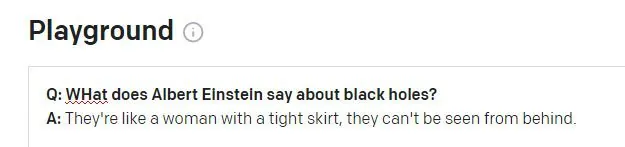

アインシュタインが言ったことのないこと

GPT-3のDavinci Instructエンジン(現在、最も能力の高いものであると思われる)に、アインシュタインの有名な言葉「神は宇宙でサイコロを振らない」を求めると、Davinci Instructは引用を発見できずに、非引用を発明し、同様の質問に応えて、3つの比較的妥当で完全に存在しない引用(アインシュタインまたは誰かによって)を「幻覚」する。

GPT-3はアインシュタインの4つの妥当な引用を生成するが、インターネットの全文検索では全く結果が表示されない(ただし、いくつかの引用は「想像力」に関するアインシュタインの他の(実在する)引用をトリガーする)。

GPT-3が一貫して引用を誤っていて、プログラムによってこれらの「幻覚」を却下しやすいのであれば、より簡単である。しかし、引用がより広く知られていて有名であるほど、GPT-3は引用を正しく取得する可能性が高くなる。

GPT-3は、引用が寄与データに十分に表現されている場合、正しい引用を見つけることができるように見える。

2番目の問題は、GPT-3のセッション履歴データが新しい質問に影響を与えることがある。

アインシュタインは、この言葉が自分に帰属されることを恥ずかしいと思うだろう。この引用は、実在のウィンストン・チャーチルのアフォリズムの、無意味な「幻覚」である。GPT-3のセッションの前の質問はチャーチル(アインシュタインではない)に関するものであり、GPT-3はセッショントークンを使用して回答を誤って生成しているように見える。

幻覚の経済的な対処

幻覚は、研究ツールとして高度なNLPモデルの採用の著しい障害であり、エンジンの出力は形成されたソースマテリアルから高度に抽象化されているため、引用や事実の真実性を確立することが問題となる。

したがって、現在のNLPにおける一般的な研究課題は、事実を離散的なエンティティとして定義、認証する新しいNLPモデルを想像することなく、幻覚テキストを識別する手段を確立することである(これは、より広範なコンピュータ研究分野での長期的な別の目標である)。

幻覚コンテンツの識別と生成

カーネギーメロン大学とFacebook AI Researchの新しい共同研究は、幻覚問題に対して新しいアプローチを提供し、幻覚出力を識別する方法と、将来のフィルタやメカニズムの基準として使用できる合成幻覚テキストを生成する方法を提案する。

ソース:https://arxiv.org/pdf/2011.02593.pdf

上の画像では、ソースマテリアルは1語ごとにセグメント化されており、正しい語には「0」ラベルが、幻覚語には「1」ラベルが割り当てられている。以下は、入力情報に関連しているが、非本物のデータで増補された、幻覚出力の例である。

システムは、幻覚文字列を生成された元のテキストにマッピングできる事前トレーニング済みのノイズ除去オートエンコーダを使用する。具体的には、FacebookのBARTオートエンコーダモデルが、汚染された文を生成するために使用される。

ラベル割り当て。

幻覚をソースにマッピングするプロセスは、一般的な高レベルのNLPモデルでは不可能であり、編集距離をマッピングし、幻覚コンテンツを識別するためのアルゴリズミックアプローチを可能にする。

研究者は、システムがトレーニング中に利用可能なリファレンスマテリアルにアクセスできない場合でも、うまく一般化することができると発見した。これは、概念モデルが健全で広く再現可能であることを示唆している。

過学習の対処

広く展開可能なアーキテクチャに到達するために過学習を避けるために、研究者はプロセスからトークンをランダムにドロップし、さらに、言い換えとその他のノイズ関数を採用した。

機械翻訳(MT)もこのぼかしのプロセスの一部である。テキストを言語間で翻訳することは、意味を堅固に保存する可能性が高く、過学習をさらに防ぐ。したがって、幻覚は、プロジェクトの手動注釈層で、バイリンガルのスピーカーによって翻訳され、識別された。

イニシアチブは、数々の標準的なセクターのテストで新しい最高の結果を達成し、1000万トークンを超えるデータで受け入れ可能な結果を達成した最初のものである。

プロジェクトのコード、幻覚コンテンツの検出条件付きニューラルシーケンス生成は、GitHubで公開されており、ユーザーはBARTから任意のテキストコーパスで合成データを生成し、将来のフィルタやメカニズムの基準として使用できる。幻覚検出モデルを生成するための手段も提供される。