人工知能

AIが手話認識をこれまでで最も正確にしている方法

私たちがコミュニケーションの壁を打ち破ることを考える時、多くの場合、言語翻訳アプリや音声アシスタントに焦点を当てています。しかし、手話を使用する数百万の人々にとって、これらのツールはまだギャップを埋めてはいません。手話は単に手の動きだけではなく、顔の表情や体の言語を含む豊かで複雑なコミュニケーションの形態であり、各要素が重要な意味を持ちます。

ここで特に課題となるのは、話し手の言語と比較して、手話は主に語彙や文法の違いではなく、意味を伝える方法が根本的に異なるという点です。例えば、アメリカ手話(ASL)は、話し手の英語と一致しない独自の文法と構文を持っています。

この複雑さは、手話を認識して翻訳する技術を作成するには、動いている全言語システムを理解する必要があることを意味します。

新しい認識アプローチ

ここで、フロリダ・アトランティック大学(FAU)の工学およびコンピュータサイエンス大学院のチームは、新しいアプローチを取りました。手話の全複雑性に一度に取り組むのではなく、重要な第一歩をマスターすることに焦点を当てました。つまり、AIを使用してASLのアルファベットジェスチャーを前例のない精度で認識することです。

これを、コンピューターに手書きを読むことを教えることと考えてみましょうが、3次元で動いている場合です。チームは、29,820枚の静止画像からなるASL手話ジェスチャーのデータセットを作成しました。しかし、彼らはただ画像を収集するだけでなく、各画像に21の重要なポイントを手につけて、手がどのように動き、さまざまなサインを形成するかという詳細な地図を作成しました。

この研究を主導したPh.D.候補のBader Alsharif博士は、「この方法は以前の研究では探索されていませんでしたが、将来の進歩のための新しい、そして有望な方向です」と説明しています。

技術の分解

この手話認識システムがどのように機能するのかを見てみましょう。

MediaPipeとYOLOv8

このシステムの魔法は、2つの強力なツール、MediaPipeとYOLOv8のシームレスな統合によって実現されています。MediaPipeを、微妙な指の動きや手の位置を追跡できる熟練した手話解釈者と考えてみましょう。研究チームは、MediaPipeを選択しました。なぜなら、それは21の正確なポイントを各手で提供する優れた手のランドマーク追跡能力を持っているからです。

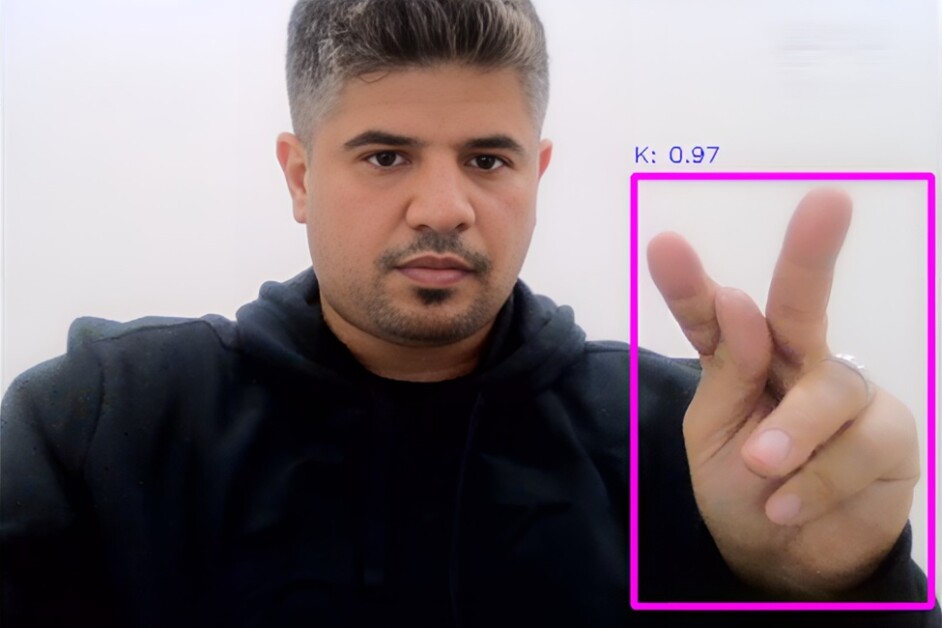

しかし、追跡だけでは不十分です。追跡されたポイントが何を意味するのかを理解する必要があります。そのためにはYOLOv8が必要です。YOLOv8はパターン認識の専門家で、すべての追跡ポイントを処理して、それらがどの文字またはジェスチャーを表すかを判断します。研究によると、YOLOv8が画像を処理すると、S × Sグリッドに分割され、各グリッドセルはその境界内にあるオブジェクト(この場合は手のジェスチャー)を検出する責任を負います。

Alsharif et al., Franklin Open (2024)

システムの実際の動作

このプロセスは、最初の見た目よりもはるかに洗練されています。

ここで、裏側で何が起こっているのかを見てみましょう。

手の検出ステージ

あなたがサインをすると、MediaPipeは最初にフレーム内のあなたの手を見つけ、21の重要なポイントをマッピングします。これらのポイントはランダムなドットではありません。手の指先から手の平までの特定の関節やランドマークに対応しています。

空間分析

次に、YOLOv8がこの情報をリアルタイムで分析します。画像の各グリッドセルについて、次のことを予測します:

- 手のジェスチャーが存在する確率

- ジェスチャーの位置の正確な座標

- 予測の信頼度スコア

分類

システムは「バウンディングボックス予測」と呼ばれるものを使用します。つまり、あなたの手のジェスチャーを完全な長方形で囲むことを想像してください。YOLOv8は各ボックスについて、5つの重要な値を計算します。中心のxとy座標、幅、高さ、そして信頼度スコアです。

Alsharif et al., Franklin Open (2024)

この組み合わせがなぜうまく機能するのか

研究チームは、これらの技術を組み合わせることで、部分の合計以上のものを作成したことを発見しました。MediaPipeの正確な追跡とYOLOv8の高度なオブジェクト検出が組み合わさって、驚くほど正確な結果をもたらしました。98%の精度率と99%のF1スコアを達成しました。

これが特に印象的なのは、システムが手話の複雑さをどのように処理するかです。未経験の目には似ているように見えるサインもありますが、システムは微妙な違いを捉えることができます。

記録的な結果

研究者が新しい技術を開発するとき、常に大きな疑問は「それは実際にどのくらいうまく機能するのか?」です。この手話認識システムの場合、結果は印象的です。

FAUのチームはシステムを徹底的にテストし、以下のことがわかりました:

- システムは98%の確率でサインを正しく識別します

- システムは98%のサインを検出します

- 全体的なパフォーマンススコアは99%に達します

「私たちの研究の結果は、アメリカ手話のジェスチャーをほとんどのエラーなしで正確に検出して分類する私たちのモデルの能力を示しています」とAlsharifは説明しています。

システムは日常的な状況でうまく機能します。さまざまな照明、手の位置、そして異なる人々がサインする場合でもです。

このブレークスルーは、手話認識の可能性の境界を押し広げます。以前のシステムは精度に苦労してきましたが、MediaPipeの手の追跡とYOLOv8の検出能力を組み合わせることで、研究チームは特別なものを作りました。

「このモデルの成功は、転移学習の慎重な統合、入念なデータセットの作成、正確な調整に大きく拠っています」と、研究の共同著者であるMohammad Ilyasは述べています。この詳細への注意は、システムの驚くべきパフォーマンスに報いました。

コミュニケーションへの影響

このシステムの成功は、コミュニケーションをよりアクセスしやすく、インクルーシブにできるという興奮的な可能性を示唆しています。

チームは単に文字を認識することに止まらず、さらに幅広い手の形やジェスチャーを理解できるようにシステムを教えようとしています。手話の「M」と「N」の文字のように、ほとんど同じに見えるサインを区別する能力を高めようとしています。研究者は、これらの微妙な違いをさらにうまく捉えるようにシステムを改良しようとしています。Alsharif博士は「重要なのは、この研究の結果がシステムの頑健性を強調するだけでなく、実用的でリアルタイムのアプリケーションで使用できる可能性も示していることです」と述べています。

チームは現在、以下に焦点を当てています:

- システムを通常のデバイスでスムーズに動作させること

- リアルタイムの会話に十分な速さにすること

- あらゆる環境で信頼性を確保すること

FAUの工学およびコンピュータサイエンス大学院のディーン、Stella Batalamaは、「アメリカ手話の認識を改善することで、この研究は、聴覚障害者や難聴者のコミュニケーションを強化するツールを作成することに貢献しています」と述べています。

医師の診察室や授業に参加する際に、この技術がコミュニケーションのギャップを瞬時に埋めることを想像してみてください。那が実際の目標です。日常的なやり取りをすべての関係者にとってよりスムーズで自然なものにする、つまり人々を結びつける技術を作ることです。コミュニケーションの壁が小さくなる世界への一歩です。