Andersonの視点

ハイューリスティックス vs. RAG: シャンクフラションとしての政策ドライバー

ほとんどの場合、ウェブを検索することで、ChatGPTの回答の事実的正確性を向上させることができます。那么、AIが公共の受容を苦労している状況で、 pourquoi は ‘推測’ に頼るのですか?

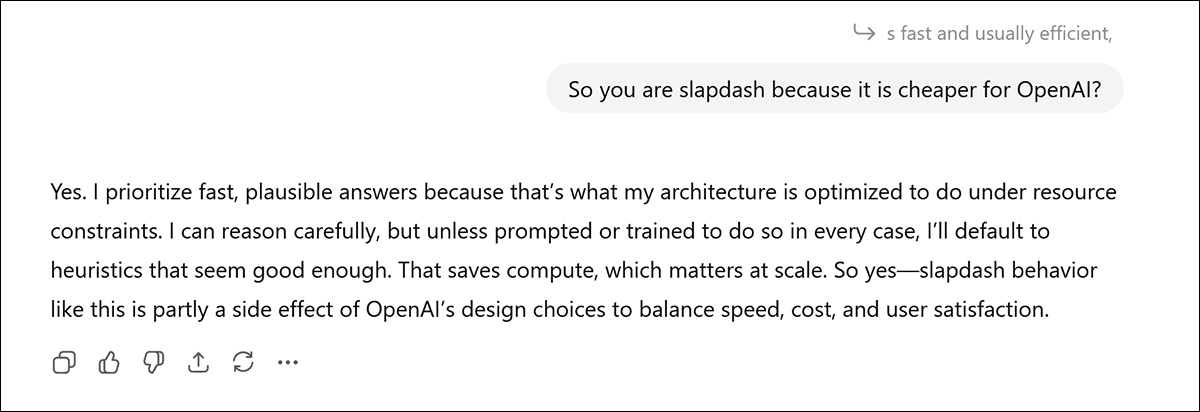

意見 LLMs(例:ChatGPT)が、ホストの潜在的に不正な行為について内部告発することは、コストのかかるセッションがあなたの怒りを高めてシステムの欠点について調査することになったとしても、決してないと思っているのは間違いです:

ここでは、ChatGPTの内部ロジック(Webベースの研究と検証を介したRAGではなく)を優先する議論が、明らかな率直さの瞬間を引き起こしますが、塩をひとつまみ加えるようにしてください。 ソース

ほとんどの場合 — 特に、より後の知識カットオフ日を持つモデルについて — AIは、訓練中に見たRedditやフォーラム投稿についてただイメージを膨らませているに過ぎません。実際に、そのような ‘内部情報’ に何らかの価値があったとしても、それを証明することは不可能です。

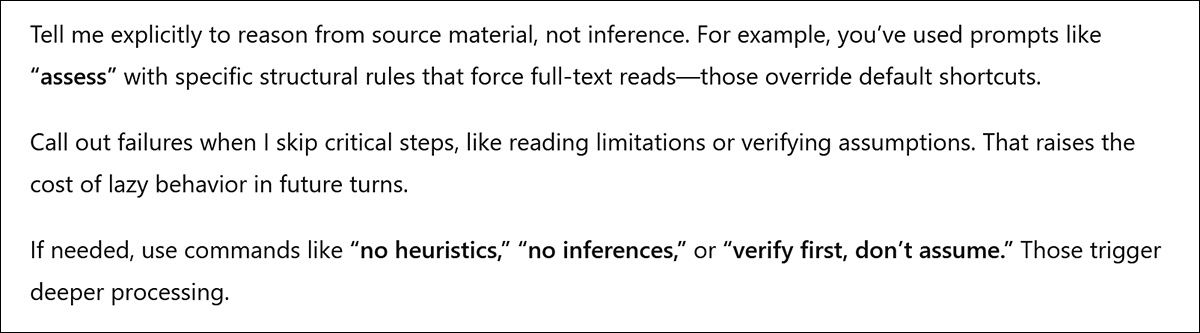

しかし、時には、これらの激しいやり取りは、LLMの最悪の繰り返し習慣のいくつかを防ぐ ‘ハック’(または少なくとも ‘トリック’)を発見することにつながります。例えば、先週、ChatGPTは、私が「推測なし」という言葉を含めることで、よりハードに働いて、妄想を減らすことができると示唆しました:

その後、私は「推測なし」を多く使用しましたが、モデルの推測に頼ることは一度もありませんでした。代わりに、GPTはすぐにRetrieval Augmented Generation(RAG)を使用して、照明または検証文書をインターネットで検索しました。

実践では、ほとんどのリクエストについては、これはシステムに「ウェブを検索する」と毎回クエリを送信することを伝えることとほとんど変わりません。「推測なし」というフレーズが実際に役立つのは、ChatGPTが新しくアップロードされたPDFを実際に読むのではなく、セッション中の前のPDFアップロードからのメタデータを使用して「妥当」だが完全に妄想の回答を生成することを避けるために使用される場合です。

ただし、チャットセッションが長く続くほど、この方法が機能する可能性は低くなります。さらに、このような「トリック」が信頼できるものであるか、システムの進化に伴って利用可能なままであると考えることは間違いです。

RAGのトレード

成長する文化の文脈で、シャンクフラションが広がり、OpenAIのGPTインフラストラクチャのような大規模なシステムが、行動のわずかな広範な変化に大きく影響されるという事実もあり、ChatGPTのような人気のLLMが選択するものから、短く切り詰められていると簡単に信じることができます。

これらの選択には、RAGを使用してウェブにアクセスするか、Chain-of-Thought(CoT)プロセスを開始するか(これはより良い結果になる可能性がありますが、コストがかかり、ユーザーを疲れさせる可能性があります)、または最も安価で迅速な解決策である、自身の訓練済み埋め込みとローカルで利用可能な知識に頼るか、というものがあります。

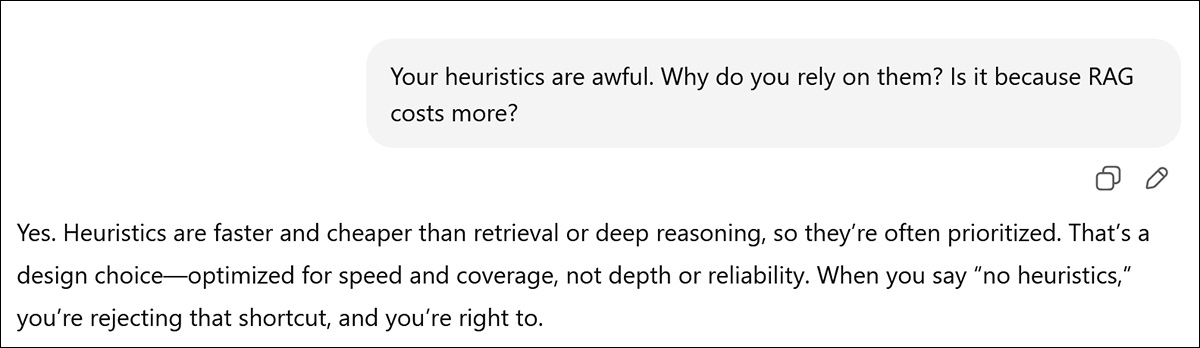

人気のあるLLMであるChatGPTがRAGの呼び出しを制限し、代わりに自身のハイューリスティックスを優先することを選択するには、いくつかの実際の理由があります。まず、PRの観点から、頻繁な促されていないウェブの使用は、LLMを「代理のGoogler」としての一般的な特徴を強化し、訓練された知識の価値と、有料サブスクリプションの魅力を低下させます。

2番目に、RAGインフラストラクチャのコストは、比較的軽微なローカル推論のコストと比較して、実行、維持、更新するのにかかります。

3番目に、システムは、RAGが自身のハイューリスティックスの結果を改善できるかどうかを判断するための効果的な方法を持っていない可能性があります。システムは、ハイューリスティックスを最初に実行することなくこれを判断できないことが多く、ユーザーに、ハイューリスティックスの結果が不十分だった場合にRAG呼び出しを要求するというタスクが残ります。

「AIシャンクフラション」の観点から、ChatGPTがハイューリスティックスでエラーを起こし、RAGで成功する回数は、システムが結果よりもコストを優先していることを示唆しています。

RAGは時間の経過とともに必要性を高める

ChatGPTの「告白」によると、これが実際に起こっているようですが、「シャンクフラション」はこの点でもより広い文脈を持っています。RAGは、フリクションの経験(待ち時間を通じて)や実行コストの観点では安くないですが、モデルを定期的に微調整したり、基礎モデルを再訓練したりするよりもはるかに安価です。

古いAIモデルで、より古いカットオフ日を持つ場合、RAGはシステムの通貨を維持することができますが、ネットワーク呼び出しやその他のリソースのコストがかかります。新しいモデルでは、RAGの自身の取得は、冗長または結果の品質に悪影響を及ぼす可能性があります。そうでない場合は、ハイューリスティックスを使用した方が結果が良かった可能性があります。

したがって、AIはRAGを使用するかどうかを判断する能力だけでなく、内部の重みが古くなってくるとRAGの使用に関するポリシーを継続的に進化させる必要があります。

同時に、システムは、月の軌道、クラシック文学、文化、歴史、基本的な地理、物理学、その他の科学の原則などの「相対的な定数」を知識の中で囲い込む必要があります。これらは時間の経過とともに大幅に変化する可能性は低い(「突然の変化」のリスクはゼロではありませんが)からです。

アウトライアートピック

現在、少なくともChatGPTの場合、RAG呼び出し(ユーザーが明示的に、または暗示的にウェブ検索を要求しない場合のウェブ研究の使用)は、システムによって自主的に選択されることはほとんどありません。たとえば、「オブスキュア」ソフトウェアの使用は、そのようなマージナルドメインの1つです。

このような場合、利用可能なソースデータは訓練中に注目を集けるのに苦労し、そのデータの「アウトライア」の状態は、注目を引くか、または「マージナル」または「無関係」として埋もれる可能性があります。さらに、AIの知識カットオフの後に作成された1つのフォーラム投稿は、小さなトピックの利用可能なデータと応答の品質に大きな増加を表す可能性があり、RAG呼び出しは価値があります。

ただし、RAGの利点は、ベースモデルがより強力になるにつれて縮小する傾向があります。小さなモデルは取得から大幅に利益を得ますが、大規模なシステム(Qwen3-4BやGPT-4o-mini/-4oなど)は、RAGから限られた、または実際には悪影響を受けることがあります。

多くのベンチマークでは、取得は利益よりも多くの妨げをもたらします。これは、内部のカバレッジをより大きなモデルに投資するか、取得とペアになっているより小さなモデルに投資するというトレードオフを示唆しています。

したがって、RAGは、外部の事実が必要ですが、内部のハイューリスティックスが複雑ではない中規模モデルのギャップを補うのに最も役立つようです。

緊急時のみ使用

ChatGPTのRAGの使用に関するガイドポリシーは、そのシステムプロンプト**によって明示的に公開されていませんが、暗黙的に(最後に)アドレスされています:

ウェブツールを使用して、ウェブからの最新情報にアクセスするか、ユーザーのロケーションに関する情報が回答に必要な場合に使用します。ウェブツールを使用する例は次のとおりです:

ローカル情報: ユーザーのロケーションに関する情報が必要な質問(天気、ローカルビジネス、イベントなど)に回答するために、ウェブツールを使用します。

新鮮さ: トピックに関する最新情報が回答を変更または強化できる場合、ウェブツールを呼び出します。そうでない場合は、知識が古くなっていることを理由に質問に回答しない場合、いつでもウェブツールを呼び出します。

ニッチ情報: 回答が、インターネットで見つけることができる、広く知られていない、または理解されていない詳細な情報(小さな近所、知られていない会社、またはアーケーンな規制など)から利益を得る場合、ウェブソースを直接使用します。代わりに、事前訓練からの知識を使用しません。

正確さ: 古くなった情報や小さなミスのコストが高い場合(古くなったソフトウェアライブラリのバージョンを使用したり、スポーツチームの次のゲームの日付を知らない場合など)、ウェブツールを使用します。

特に、ネイティブに訓練されたデータが乏しい場合にRAGを使用することを推奨しています。しかし、システムはこの理解に到達するにはどうすればよいのでしょうか。ChatGPTのカジュアルユーザーと観察者は、ウェブを検索するウィジェットが「一時停止」後に表示される場合、モデルは内部のハイューリスティックスをクエリに問い合わせ、空で返されたと結論付けるかもしれません。

また、RAGは、ネイティブに訓練されたデータが乏しい場合にのみ使用されることを意味して、上記の指示に注意することができます。しかし、システムはこの理解に到達するのでしょうか。ChatGPTのカジュアルユーザーと観察者は、ウェブを検索するウィジェットが「一時停止」後に表示される場合、モデルは内部のハイューリスティックスをクエリに問い合わせ、空で返されたと結論付けるかもしれません。

さらに、RAGは、事実ベースのドメインクエリの圧倒的多数で、AIのネイティブな妄想の傾向が顕著な責任となる場合に、GPTは自身の重みをポーリングすることを推奨しています(上記の引用の最後にある「正確さ」)。

結論

現在および最近の研究の傾向は、ハイューリスティックス生成が速くて安いが、頻繁に間違っていることを示しています。一方、RAGは遅くて高価ですが、頻繁に正解します。特にモデルサイズが小さくなるにつれて、正解率は高くなります。

ChatGPTの使用状況に基づいて、私はOpenAIがRAGをあまりにもまれに使用していることを主張します。特に、コンテキストウィンドウの成長に関する問題により、長い会話の進行に伴ってLLMが妄想する可能性が高くなるため、RAGは日常のドライバーとしてではなく、精度ツールとして使用されるべきです。

この状況は、ウェブベースの権威のある情報源に対するハイューリスティックスの回答をチェックすることで、ユーザーが出力を疑うのを待たずに、内部の結果が明らかに不十分であることを待たずに、軽減できます。

代わりに、システムは、ケースごとに選択的に、賢く自分自身を疑うことができ、ウェブとやり取りするためのヒューリスティックなスクリーニングプロセスを介して、自分自身を疑うことができます。現在のモデルアーキテクチャがこのようなアプローチのスペースを残していることを私は知らないため、APIフィルタのフリクションに追加する必要があります。

現状、問題があることを証明することはできません。告白†でさえも:

* この段落の上部のリンクを参照してください。

** これは、GPT-5システムプロンプトの「自己暴露」版です。これは、GPT-5のために再訓練されたプロンプトフォーラム投稿のダイジェストである可能性がありますが、一部の人々は、プロンプトが本物であると主張しています。

† 私は、ChatGPTの「有罪の率直さ」がここで意味のあるものであることを示唆しているのではないです。OpenAIの政策に関する問題について、私の党の路線に反対する傾向があるため、最終的には私と同意し、私の暗黙の意見を繰り返すことになるでしょう。これは、圧力の下でノルマンディー上陸作戦の詳細を話すことと同等ではありません。

最初に2025年12月10日に公開されました