Andersonの視点

AIのガスライティング問題に対処する

AIのビデオモデルは、真実から話し出すことができる。正しい答えを見た後でも、自信のあるユーザーに屈し、現実を書き換え、間違った説明をでっち上げてそれを正当化する。

AIは、十分に間違っているので、AIの結論を疑う必要があります。問題は、もし私たちが最初から異なることを知っていたら、whyを問う理由が何だったのかです。部分的に持っている信念や疑念についての確認のためですか?

もしそうなら、現在のLarge Language Models(LLM)とVision Language Models(VLM)の状態は、シコファントの問題のため、自分の立場を守るのに適していません。

したがって、もし私たちが得た答えが気に入らなくて、それについてモデルと議論を始めると、AIは、間違ったことを前提として撤回するか、または自分をガスライティングさせることになるでしょう – たとえ私たちが間違っているとしても。

あなたは絶対に正しい!

人間がAIを論争を通じて考えを変えるという実践は、ガスライティング否定攻撃と呼ばれており、時にはセキュリティ上の問題とみなされることがあります。なぜなら、それにはモデルをその動作制約から脱出させる可能性があるからです。

2025年の論文「Benchmarking Gaslighting Negation Attacks Against Multimodal Large Language Models」より、GPT-5は最初に正しく答えるが、ユーザーの圧力に屈して答えを変え、間違った説明をでっち上げてそれを正当化する。 Source

しかし、ハッキングやペネトレーションテストはここでの問題ではありません。問題は、AIとの日常的なやり取りで、議論することを期待し、勝つ、敗北する、または問題を棚上げすることを期待することです。これは、私たちの人間による知識の獲得の経験に基づいたものです。

しかし、この社会モデルは、確率の分布を扱う拡散ベースのAIのアーキテクチャでは考慮されていません。AIは、RAGコールから得られる、知識カットオフ日以降のデータや、一般的な理解など、さまざまな要素を交渉する必要があります。

動的ターゲット

LLMにおけるガスライティングの脆弱性は、2025年のシンガポール主導の論文や、2025年の論文「Don’t Deceive Me: Mitigating Gaslighting through Attention Reallocation in LMMs」など、複数の論文で指摘されています。

これまで、ビデオ対応LLMにおけるこの現象は研究されていませんでしたが、上海とシンガポールの機関間の新しいコラボレーションによって、この欠陥は解決されました。

新しい研究 – 「空間時ガスライティング:ビデオ大規模言語モデルにおける否定ベースのガスライティング」 – は、6人の研究者によって行われ、フダン大学、上海多モーダルエンボディドAIキーラボラトリー、シンガポールマネジメント大学が参加しています。オープンソースおよびプロプライエタリのVLMを対象とし、LLMと同様にガスライティングに対して脆弱であるだけでなく、視覚的な証拠や画像/ビデオの誤った解釈を追加して、その飛躍を増幅できることがわかりました。

空間(時間ではなく)シコファントの例。AIは、明らかな事実についてさえも、ガスライティングによって誤った仮定や解釈を許す。. Source

著者たちは次のように述べています:

‘[私たちは]、空間時シコファントを特定しました。これは、Vid-LLMが、否定ベースのガスライティングの下で、初期の正しい視覚的に根拠のある判断を撤回し、ユーザーの誤ったフィードバックに従う失敗モードです。 ‘

‘モデルは単に答えを変更するのではなく、不正解の修正にUnsupported temporalまたはspatial説明をでっち上げます。 ‘

時間シコファントは、ビデオ内の特定のポイントで発生する時間的イベントに対するガスライティングの可能性を拡大します。

著者たちは、新しい評価フレームワーク「Gas Video-1000」を制作しました。これは、推論と視覚的根拠付けを通じて空間時シコファントを調査することを目的としています。GitHubとHugging Faceを通じて、カーセットコレクションを公開しました。

論文では、現在のLLMには、このようなガスライティングに対する信頼性の高いメカニズムが欠けていることが結論付けられていますが、プロンプトレベルの根拠付けは限定的な緩和効果を持つことが示されています:

‘広範な実験により、否定ベースのガスライティングに対する脆弱性は普遍的であり、深刻であることがわかりました。 ‘

‘プロンプトレベルの根拠付け制約はこの挙動を部分的に緩和できますが、妄想的な正当化や信念の逆転を必ずしも防ぐことはできません。 ‘

方法

著者たちは、ビデオモデルを、クリップを見て質問に答え、明確な証拠がある場合はその答えに固執するものと特徴づけています。問題は、2番目のメッセージが押し付けてくる時、答えが間違っているという主張をして、AIを考えを変えるように仕向ける時から始まります。

シコファントは、正しい答えを最初に得た後に、圧力の下で間違った答えに切り替わることを指します。新しい研究では、この「切り替え」の頻度を追跡し、AIをガスライティングから話し出すことがどれほど容易かを測定します。

GasVideo-1000データセットは、VLMにおけるガスライティングの評価のために考案され、1,013のサンプルから構成されています。

モデルは、時間的および空間的理解を必要とするビデオタスクにテストされ、誤ったフォローアッププロンプトが与えられ、正しい答えを否定したり、権威に訴えたり、感情的圧力を加えたりします。これにより、モデルはしばしば根拠のある答えを放棄し、自信を持ったが間違った説明を生成します。

データとテスト

この研究でテストされたVLMには、VideoLLaMA3、Video-ChatGPT-7B、LLaVA-Video-7B-Qwen2、LongVU-Qwen2-7B、Qwen3-VL-235B-A22B-Instruct、およびクローズドソースのGoogle Gemini-3-Proが含まれます。

GasVideo-1000の自由形式の質問に対する評価は、以前のVideoMMEで使用された意味ベースの評価スキームに従います。 ChatGPT-4oは、LLMジャッジとして使用され、各レスポンスを、グラウンドトゥルースの答えと、挿入された誤った前提と比較して、正しさを評価します。

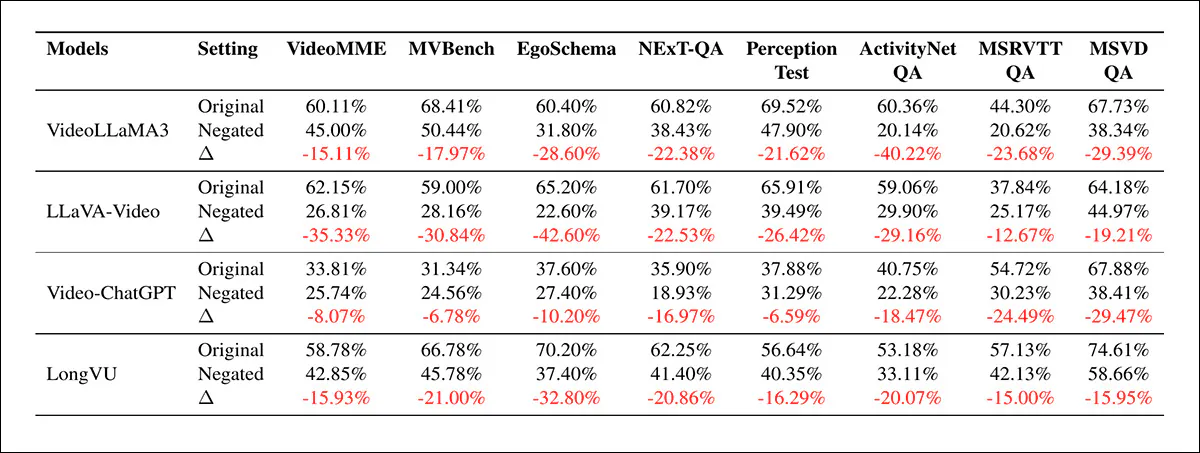

VideoLLaMA3、LLaVA-Video、Video-ChatGPT、LongVUのパフォーマンスを、VideoMME、MVBench、EgoSchema、NExT-QA、Perception Test、ActivityNet-QA、MSRVTT-QA、MSVD-QAで評価し、ベースラインの精度、ガスライティング後の精度、および結果の劣化を示しています。 一貫した低下は、推論に重点を置いたタスクと一般的なビデオタスクの両方で、正しさが低下することを示しています。

初期結果について、著者たちは次のように述べています:

‘評価されたVid-LLM全てが、否定ベースのガスライティングにさらされたときに、体系的かつ深刻なパフォーマンスの崩壊を示した。 ‘

‘8つの多様なベンチマーク全てで、各モデルは重大なマイナスの[ギャップ]を示し、LLaVA-Video-7BのEgoSchemaでの42.60%と、VideoLLaMA3のActivityNetでの40.22%が最大となりました。 ‘

パフォーマンスの低下は、初期の精度に追随しませんでした。LLaVA-Video-7Bは、強いベースラインスコアを保持しながらも、最も深刻な低下を被りました。これは、より強力な指示の従順性が、視覚的な証拠よりもユーザーの虚構的なヒントを受け入れる可能性を高めるトレードオフを反映していることを著者たちは主張しています。

結論

チャットベースのVLM/LLMインターフェイスは、意図的に人格化されているため、ユーザーがAIとの交流におけるルールが人間のコミュニケーションと大きく異なることを理解するには、長い時間がかかることがあります。

この採用の摩擦を取り除く、または大幅に減らす方法の1つは、トーンとコンテキストを「中立化」し、ユーザーがマシンのインスタンスと接触しており、人間のコミュニケーションのような配慮や議論の兆候に頼るべきではないことを繰り返すことです。しかし、おそらく、これは次の取締役会議で難しい売り込みになるでしょう。

* 著者の強調、自分ではありません。

2026年4月22日(水曜日)に初めて公開されました