人工知能

高品質のAIビデオを2枚の画像から生成する

ビデオフレーム補間(VFI)は、生成的なビデオ研究における未解決問題です。課題は、ビデオシーケンス内の2つの既存のフレーム之间の intermediate フレームを生成することです。

クリックして再生。 Googleとワシントン大学の共同研究であるFILMフレームワークは、有効なフレーム補間方法を提案し、現在もアマチュアとプロの両方の分野で人気を博しています。左側には、2つの別個のフレームが重ねられていることが見られます。中央には「終了フレーム」があり、右側にはフレーム間の最終的な合成が見られます。 ソース: https://film-net.github.io/ と https://arxiv.org/pdf/2202.04901

広義的に言えば、この技術は100年以上前から存在し、伝統的なアニメーションで使用されてきました。その際、主要なアニメーションアーティストによって「キーフレーム」が生成され、他のスタッフによって「中間フレーム」の作成が行われました。

生成的なAIの登場以前、フレーム補間は、Real-Time Intermediate Flow Estimation(RIFE)、Depth-Aware Video Frame Interpolation(DAIN)、およびGoogleのFrame Interpolation for Large Motion(FILM – 上記参照)などのプロジェクトで、既存のビデオのフレームレートを増やす、または人工的に生成されたスローモーション効果を可能にするために使用されました。これは、クリップの既存のフレームを分割し、推定の中間フレームを生成することによって実現されます。

VFIは、より優れたビデオコーデックの開発、および、光流ベースのシステム(生成システムを含む)でも使用され、来るべきキーフレームに関する事前の知識を利用して、先行する中間コンテンツを最適化および形作ります。

生成的なビデオシステムにおける終了フレーム

近代的な生成システムであるLumaとKlingでは、ユーザーが開始フレームと終了フレームを指定でき、2つの画像のキーポイントを分析して2つの画像間の軌道を推定することができます。

以下の例からわかるように、「終了」キーフレームを提供することで、生成的なビデオシステム(この場合はKling)が、特に大きな動きの場合に、アイデンティティなどの側面を維持できるようになります。

クリックして再生。 Klingは、RunwayやLumaを含む、終了フレームを指定できるビデオジェネレーターの1つです。ほとんどの場合、最小の動きで最もリアルな結果が得られます。 ソース: https://www.youtube.com/watch?v=8oylqODAaH8

上記の例では、人物のアイデンティティが、2つのユーザー提供のキーフレーム間で一貫しています。これにより、比較的一貫したビデオ生成が可能になります。

開始フレームのみが提供されている場合、生成システムの注意のウィンドウは通常、ビデオの開始時に人物がどう見えたかを「覚える」ことができません。代わりに、アイデンティティは各フレームで少しずつ変化し、最終的にすべての類似性が失われます。以下の例では、開始画像がアップロードされ、人物の動きはテキストプロンプトで導かれます。

クリックして再生。 終了フレームがない場合、Klingには、次のフレームの生成を導くために、直前に前のフレームの小さなグループしかありません。重要な動きが必要な場合、このアイデンティティの劣化は深刻なものになります。

わかるように、俳優の類似性は、指示に抵抗できません。生成システムは、シード画像(唯一の利用可能な参照)で笑っていない場合、どのように見えるかを知らないからです。

ほとんどのウイルス的な生成クリップは、これらの短所を軽視するように慎重にキュレーションされています。ただし、時間的に一貫した生成ビデオシステムの進歩は、フレーム補間に関する研究部門からの新しい開発に依存する可能性があります。代替案は、伝統的なCGIに依存する「ガイド」ビデオ(そして、現在、テクスチャと照明のの一貫性は達成が難しい)です。

さらに、最近のフレームから新しいフレームを導出するのには、非常に難しいです。これは、オブジェクトが1フレームの間にフレームの1側から反対側へ移動する可能性があるため、システムが訓練されたより漸進的な動きとは反対です。

同様に、大きなポーズの変化は、アイデンティティの変化だけでなく、鮮明な不一致にもつながる可能性があります。

クリックして再生。 このLumaの例では、要求された動きは訓練データに良く表現されていないようです。

Framer

これは、中国からの新しい論文に導きます。この論文では、信憑性のあるフレーム補間の新しい最先端を達成したと主張しています。また、ドラッグベースのユーザーインタラクションを提供する最初のものです。

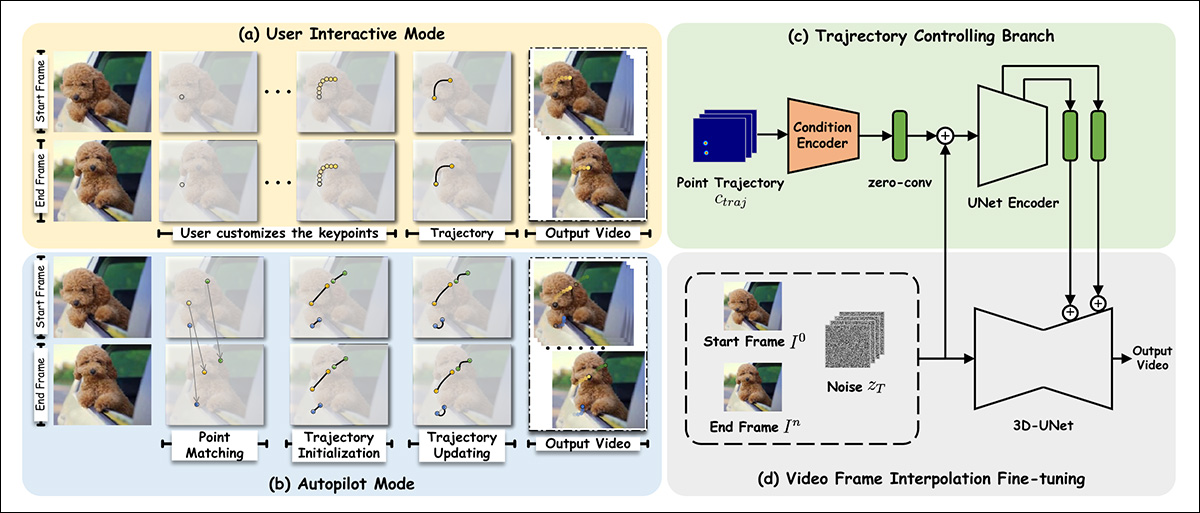

Framerは、直感的なドラッグベースのインターフェイスを使用して動きを指示できるようにしますが、「自動」モードもあります. ソース: https://www.youtube.com/watch?v=4MPGKgn7jRc

ドラッグ中心のアプリケーションは、最近頻繁 に 現れて います。研究部門は、テキストプロンプトによって得られるかなり粗い結果に基づいていない、生成システムのための手段を提供するのに苦労しています。

新しいシステム、Framerは、ユーザーが導くドラッグに従うだけでなく、より伝統的な「オートパイロット」モードもあります。従来のトゥイーニングに加えて、システムは時間経過シミュレーション、モーフィング、入力画像の新しいビューの生成が可能です。

時間経過シミュレーション用の中間フレーム。 ソース: https://arxiv.org/pdf/2410.18978

新しいビューの生成に関しては、Framerは少しNeural Radiance Fields(NeRF)の領域に踏み込みます。ただし、NeRFでは通常6つ以上の画像入力ビューが必要ですが、Framerでは2つのみで済みます。

テストでは、Framerは、Stability.aiのStable Video Diffusion潜在的拡散生成ビデオモデルに基づいています。Framerは、近似されたライバルアプローチを上回ることができました。

コードは、GitHubで公開される予定です。ビデオサンプル(上記の画像はこれらから派生しています)は、プロジェクトサイトで利用可能です。研究者は、YouTubeビデオも公開しています。

新しい論文は、Framer: Interactive Frame Interpolationと題されており、浙江大学とアリババグループのAnt Groupの9人の研究者によって書かれています。

方法

Framerは、どちらのモダリティでも、キーポイントベースの補間を使用します。ここで、入力画像は基本的なトポロジーに評価され、必要に応じて「可動」ポイントが割り当てられます。実質的に、これらのポイントは、IDベースのシステムにおける顔のランドマークと同等ですが、任意の表面に一般化されます。

研究者は、Fine-Tuned Stable Video Diffusion(SVD)をOpenVid-1Mデータセットで行い、追加の最後のフレーム合成機能を追加しました。これにより、トラジェクトリーコントロールメカニズム(上右のスキーマ画像)が可能になり、終了フレーム(またはその逆)へのパスを評価できます。

Framerのスキーマ。

最後のフレームの条件付けの追加について、著者は次のように述べています:

‘事前トレーニングされたSVDの視覚的先行きをできるだけ保存するために、SVDの条件付けパラダイムに従い、潜在的空間と意味的空間にそれぞれ終了フレームの条件を注入します。 ‘

‘具体的には、最初の[フレーム]のVAEエンコード潜在特徴を最初のフレームのノイズのある潜在特徴と同様に連結します。さらに、終了フレームの潜在特徴znを終了フレームのノイズのある潜在特徴と連結します。条件と対応するノイズのある潜在特徴は、空間的に整列されていると考えられます。 ‘

‘さらに、最初のフレームと最後のフレームのCLIP画像埋め込みを個別に抽出し、クロスアテンション特徴の注入のためにそれらを連結します。’

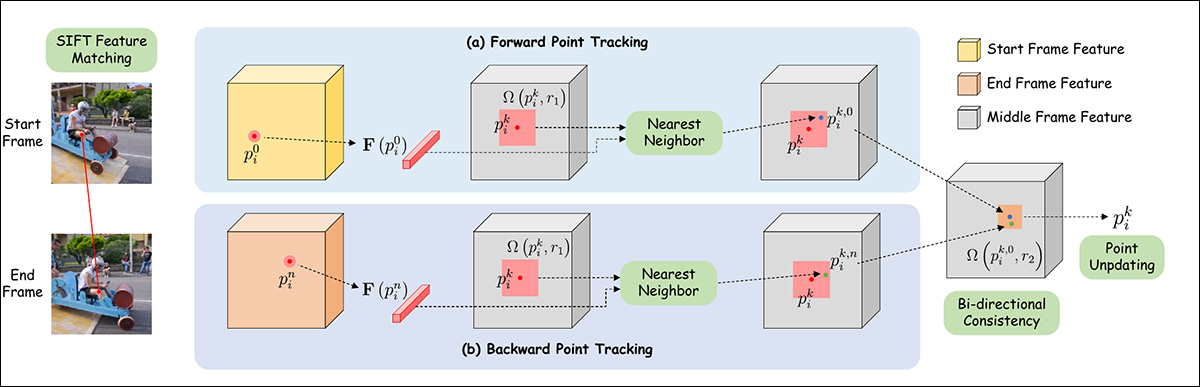

ドラッグベースの機能のために、トラジェクトリーモジュールは、Meta Aiが主導するCoTrackerフレームワークを利用します。これは、先に進む多数の可能なパスを評価します。これらは、1〜10の可能なトラジェクトリーに絞り込まれます。

取得されたポイント座標は、DragNUWAおよびDragAnythingアーキテクチャにインスパイアされた方法論を通じて変換されます。これにより、ガウシアンヒートマップが得られ、移動の対象となる領域が特定されます。

次に、データは、ControlNetの条件付けメカニズムに供給されます。これは、もともとStable Diffusion用に設計された従属の整合システムであり、他のアーキテクチャにも適応されています。

オートパイロットモードの場合、特徴マッチングは、SIFTを介して最初に実行され、トラジェクトリーを解釈し、DragGANおよびDragDiffusionにインスパイアされた自動更新メカニズムにパスできます。

Framerのポイントトラジェクトリー推定のスキーマ。

データとテスト

Framerの微調整のために、空間的注意と残差ブロックは凍結され、時間的注意層と残差ブロックのみが影響を受けました。

モデルは、10,000イテレーションでAdamWの下で訓練され、学習率は1e-4、バッチサイズは16でした。訓練は、16個のNVIDIA A100 GPUで行われました。

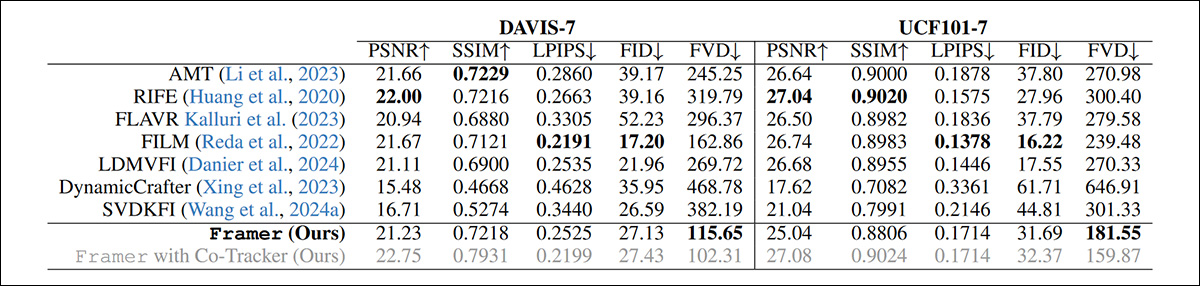

以前のアプローチではドラッグベースの編集が提供されていないため、研究者はFramerのオートパイロットモードを、従来のオファリングの標準的な機能と比較することを選択しました。

テストされたフレームワークは、生成的なビデオ生成システムのカテゴリでは、LDMVFI、Dynamic Crafter、およびSVDKFIでした。「伝統的な」ビデオシステムの場合、ライバルフレームワークはAMT、RIFE、FLAVR、および上記のFILMでした。

ユーザー研究に加えて、DAVISおよびUCF101データセット上でテストが実行されました。

質的テストは、研究チームとユーザー研究によってのみ評価できます。ただし、論文では、従来の量的メトリックは、現在の提案に適していないと述べています。

[再構築]メトリックであるPSNR、SSIM、LPIPSは、補間フレームの品質を正確に捉えることができません。なぜなら、これらは、元のビデオとピクセルレベルで整列していない他の妥当な補間結果を罰するからです。

生成メトリックであるFIDはある程度の改善を提供しますが、時間的一貫性を考慮せず、フレームを個別に評価するため、まだ不足しています。

それにもかかわらず、研究者はいくつかの人気メトリックで質的テストを実行しました。

Framerとライバルシステムの量的結果。

著者は、不利な条件にもかかわらず、Framerがテストされた方法の中で最も優れたFVDスコアを達成したと述べています。

以下は、論文のサンプル結果の質的比較です。

以前のアプローチとの質的比較。解像度がより高いものと、https://www.youtube.com/watch?v=4MPGKgn7jRcでのビデオ結果については、論文を参照してください。

著者は次のように述べています。

‘私たちの方法は、既存の補間技術と比較して、はるかに明確なテクスチャーと自然な動きを生成します。特に、入力フレーム間の違いが大きいシナリオでは、従来の方法では補間コンテンツを正確に補間できない場合に特に優れています。 ‘

‘LDMVFIやSVDKFIなどの他の拡散ベースの方法と比較して、Framerは、特に難しいケースへの適応性が優れており、コントロールが優れています。 ‘

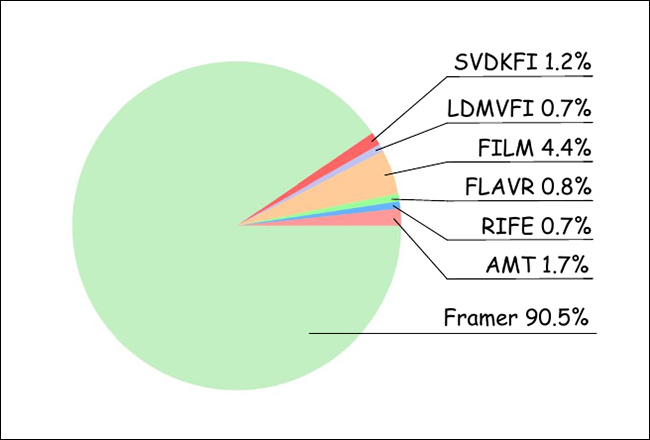

ユーザー研究では、研究者は20人の参加者を集め、さまざまな方法からの100個のランダムに順序付けられたビデオ結果を評価しました。したがって、1000個の評価が得られました。これは、最も「リアルな」オファーを評価するものでした。

ユーザー研究の結果。

上記のグラフからわかるように、ユーザーはFramerの結果を圧倒的に好んでいます。

プロジェクトの付属のYouTubeビデオは、Framerの他の潜在的な用途、モーフィングやカートゥーンの間の処理について説明しています。これは、概念が始まった場所です。

結論

この課題が現在、AIベースのビデオ生成のタスクにとってどれほど重要であるかを強調することは難しいです。現在、古いソリューションであるFILMや(非AIの)EbSynthは、トゥイーニングのためにアマチュアとプロの両方のコミュニティで使用されてきましたが、これらのソリューションには注目すべき制限があります。

新しいT2Vフレームワークの公式の例ビデオのキュレーションが不誠実であるため、機械学習システムが、3Dモーファブルモデル(3DMM)などのガイダンスメカニズムや、LoRAsなどの他の付随アプローチを使用せずに、動きの中で幾何学を正確に推測できるという、広範な一般の人々の誤解があります。

正直に言えば、トゥイーニング自体は、問題に対する「ハック」または「チート」に過ぎません。ただし、テキストプロンプトまたは現在の代替手段を介してガイダンスを提供するよりも、2つのフレーム画像を生成するのが容易であるため、古い方法のAIベースのバージョンに関するイテレーティブな進歩を見るのはよいことです。

初めて公開されたのは、火曜日、2024年10月29日