人工知能

EAGLE: 大規模言語モデルの多モーダル設計空間の探索にエンコーダーの混合を用いる

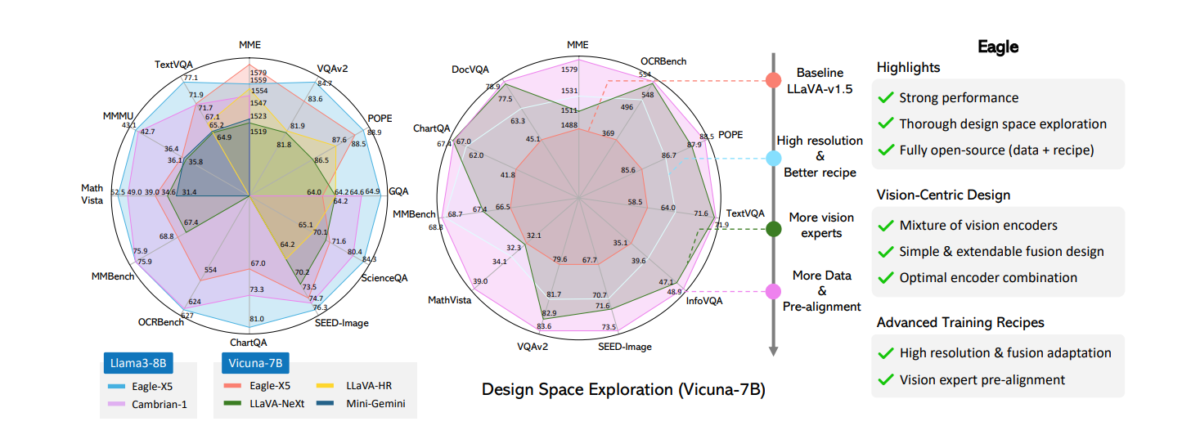

複雑な視覚情報を正確に解釈する能力は、多モーダル大規模言語モデル(MLLMs)の重要な焦点となっている。最近の研究では、視覚認識の向上は、光学文字認識や文書分析などの解像度依存タスクの性能を向上させ、ホールユーションを減らすことが示されている。最近のMLLMsは、視覚エンコーダーの混合を使用してこれを実現している。にもかかわらず、視覚エンコーダーの選択や複数の視覚エキスパートの統合などの重要な側面に対する体系的な比較や詳細な削減研究は不足している。この記事では、視覚エンコーダーと解像度の混合を使用したMLLMsの設計空間の包括的な探索、Eagleフレームワークを提供する。Eagleは、複数の視覚エンコーダーと解像度を使用した多モーダル大規模言語モデルの設計空間を探索することを目的としている。結果は、さまざまな既存の戦略に共通する根本的な原則を明らかにし、効率的で効果的な設計アプローチにつながる。Eagleは、複数の視覚エンコーダーからの視覚トークンを単純に結合するだけで、より複雑な混合アーキテクチャーや戦略と同等の効果があることを発見した。さらに、Eagleは、視覚エンコーダーと言語トークンの間のギャップを埋めるために、Pre-Alignmentを導入し、モデルの凝集性を向上させる。結果として得られるMLLMsファミリ、Eagleは、主要なMLLMベンチマークで他のトップレベルのオープンソースモデルを上回る。

Eagleの研究は、多モーダル大規模言語モデルの一般的なアーキテクチャ設計に関連している。以前にも述べたような代表的なオープンソース研究のラインに加えて、他の著名なMLLMsファミリには、MiniGPT-4、Lynx、Otter、QwenVL、CogVLM、VILA、GPT-4V、Gemini、Llama 3.1などがある。視覚信号が言語モデルに統合される方法によって、MLLMsは「クロスモーダル注意」モデルと「プレフィックスチューニング」モデルに大別できる。前者は、クロスモーダル注意を使用してLLMsの異なるレイヤーに視覚情報を注入する。一方、後者は、視覚トークンを言語トークンシーケンスの一部として扱い、テキスト埋め込みに直接追加する。Eagleのモデルは、LLaVAスタイルの多モーダルアーキテクチャに従うことにより、プレフィックスチューニングファミリに属する。

Eagleの研究は、MLLMsの視覚エンコーダー設計の改善に焦点を当てた研究に密接に関連している。初期の研究では、CLIPやEVA-CLIPなどの視覚言語整列タスクで事前トレーニングされた視覚エンコーダーを採用していた。より強力な視覚エンコーダーであるSigLIPやInternVLが提案され、より良い設計、より大きなモデルサイズ、より効果的なトレーニングレシピにより、視覚言語タスクの性能を向上させるために使用されている。モデルは低解像度の画像で事前トレーニングされることが多く、細かい詳細をエンコードする能力が不足しているため、高解像度への適応が頻繁に実行される。高解像度への適応に加えて、LLaVA-NeXT、LLaVA-UHD、Monkey、InternLM-XComposer、InternVLなどのモデルは、画像を低解像度のパッチに分割して個別に処理するタイルまたは適応タイルを使用して、高解像度入力を処理する。視覚エキスパートを追加することで、高解像度に対応できるようになるが、このアプローチはタイル技術と若干異なるが、両者は互換性があり、組み合わせることができる。

EAGLE: 多モーダルLLMsの設計空間の探索にエンコーダーの混合を用いる

大規模言語モデルの成功により、視覚認識能力を実現することが重要となっている。多モーダル大規模言語モデルの核となるのは、画像を視覚トークンに変換する視覚エンコーダーと、言語埋め込みを結合する典型的な設計である。CLIPは、視覚表現が画像テキストペアで事前トレーニングされたため、視覚エンコーダーとしてよく選択される。アーキテクチャ、トレーニングレシピ、視覚トークンが言語モデルに注入される方法によって、Flamingo、BLIP、PaLI、PaLM-E、LLaVAなどの著名なMLLMsファミリがある。Eagleの研究は、複数の視覚エンコーダーを使用して認識を改善するモデルと密接に関連している。

例えば、MousiやBraveなどのモデルは、チャネルまたはトークン方向に沿って視覚トークンを結合する。RADIOは、複数の教師を使用した蒸留方法を導入して、単一のモデルに異なる視覚エンコーダーの能力を統一する。MoAI、IVE、Prismerは、OCR、検出、深度推定などの視覚エキスパートの出力を使用して、MLLMsが回答を生成するための追加情報を提供する。MoVAは、画像と指示に基づいて最適な視覚モデルを割り当てるルーティングネットワークを設計する。

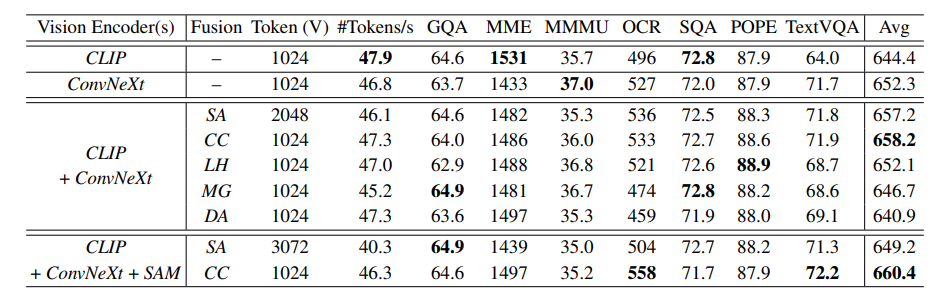

最近の研究では、より強力な視覚エンコーダー設計が、MLLMsのホールユーションを減らし、解像度依存タスクの性能を向上させるために重要であることを示している。視覚エンコーダーの能力を向上させるために、事前トレーニングデータとパラメータをスケールアップしたり、画像を低解像度のパッチに分割したりするアプローチが取られることが多い。しかし、これらのアプローチは、大きなトレーニングリソースを必要とすることが多い。効率的で強力な戦略は、異なるタスクと入力解像度で事前トレーニングされた視覚エンコーダーを混合することである。CLIPエンコーダーと高解像度エンコーダーを融合したり、異なるエンコーダーからの特徴を順番に追加したり、より複雑な融合とルーティング戦略を採用して、異なるエンコーダーの利点を最大化する。視覚エキスパートの混合アプローチは有効であることが証明されているが、詳細な研究と厳格な削減が不足しているため、Eagleはこの分野を再検討する。重要な質問が残っている:どの視覚エンコーダーを選択するか、どのように融合するか、複数のエンコーダーを使用する場合のトレーニング戦略をどのように調整するか。

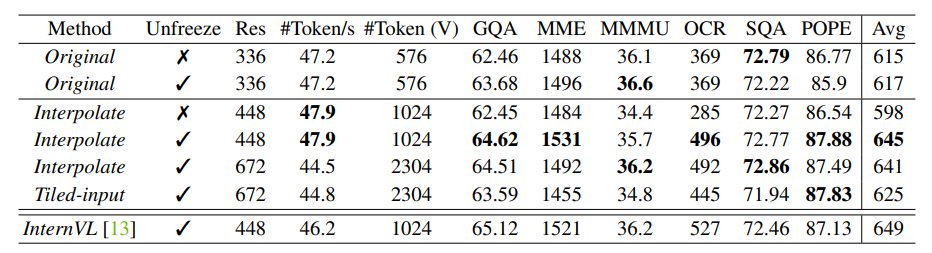

これらの質問に答えるために、Eagleは、視覚エンコーダーの混合設計空間を体系的に調査する。設計空間の探索には、以下のステップが含まれる:1)さまざまな視覚エンコーダーをベンチマークし、高解像度への適応を探索する;2)視覚エンコーダー融合戦略を「リンゴとリンゴ」の比較で実行する;3)複数の視覚エンコーダーの最適な組み合わせを逐次的に特定する;4)視覚エキスパートの事前整列とデータ混合を改善する。探索ステップは、以下の図に示されている。

Eagleの研究は、視覚言語整列、自己教師あり学習、検出、セグメンテーション、OCRなどのタスクで事前トレーニングされた視覚エンコーダーの性能をカバーする。ラウンドロビンアプローチを使用して、Eagleは基本的なCLIPエンコーダーから始めて、各ラウンドで最も改善が見られたエキスパートを追加する。

Eagleの研究は、既存の視覚エンコーダー融合戦略が、設計の変化にもかかわらず、以下のように大別できることを観察する:

- シーケンス追加:異なるバックボーンからの視覚トークンを直接追加する。

- チャネル結合:視覚トークンをチャネル次元に沿って結合する。

- LLaVA-HR:高解像度特徴を低解像度視覚エンコーダーに注入する混合解像度アダプターを使用する。

- Mini-Gemini:CLIPトークンを低解像度クエリとして使用し、共所在ローカルウィンドウ内で別の高解像度視覚エンコーダーにクロスアテンションする。

- デフォルメアテンション:ミニジェミニの上に導入された新しいベースラインで、バニラウィンドウアテンションをデフォルメアテンションに置き換える。

LLaVAの元の事前トレーニング戦略のように、複数の視覚エキスパートを同時に整列するプロジェクターをトレーニングするのではなく、Eagleは個々の視覚エキスパートを、より小さな言語モデル(実践ではVicuna-7B)で、次のトークン予測の監督下で、個別に整列する。以下の図に示されているように、事前整列を使用すると、トレーニングプロセスは3つのステップで構成される:1)各事前トレーニングされた視覚エキスパートを、固められた言語モデルで、SFTデータでトレーニングする;2)最初のステップからのすべての視覚エキスパートを組み合わせて、画像テキストペアデータでプロジェクターのみをトレーニングする;3)SFTデータで全モデルをトレーニングする。

Eagle: 実験と結果

Eagleは、以下の原則を確立する:(1)最適化されたトレーニングレシピを使用して、複数の視覚エキスパートを統合する;(2)複数の視覚エキスパートをチャネル結合を使用して組み合わせる;(3)視覚エキスパートを個別に事前整列する。Eagleは、さらにEagleモデルの利点を示すために、追加のトレーニングデータを組み込み、Eagleをさまざまなタスクで現在の最先端のMLLMsと比較する。Eagleは、Vicuna-v1.5-7B、Llama3-8B、Vicuna-v1.5-13Bを言語モデルとして使用する。視覚エンコーダーについては、セクション2.6の結果に基づいて、Eagle-X4(CLIP、ConvNeXt、Pix2Struct、EVA-02の4つの視覚エンコーダーを含む)とEagle-X5(追加のSAM視覚エンコーダーを含む)を使用する。

視覚質問回答タスク

Eagleは、GQA、VQAv2、VizWizの3つの視覚質問回答ベンチマークでモデルシリーズを比較する。以下の表に示されているように、Eagle-X5はGQAとVQAv2で最先端の性能を達成し、追加の視覚エキスパートを統合する利点を強調する。

OCRとチャート理解タスク

EagleのOCR、文書、チャート理解能力を評価するために、OCRBench、TextVQA、ChartQAでベンチマークする。Eagleは、TextVQAで競合他社を大幅に上回り、高解像度アーキテクチャと異なる視覚エンコーダーの統合により利益を得ている。特に、Eagleは、画像の分割タイルを必要とせずに、最大1024トークンをサポートするシンプルな設計を維持する。

以下の図は、OCRと文書理解の例を示す。高解像度適応と複数の視覚エンコーダーの統合により、Eagleは画像内の小さなテキストを識別し、ユーザーの指示に基づいて情報を正確に抽出できる。

他の視覚タスクで事前トレーニングされた視覚エキスパートを導入する利点をよりよく理解するために、以下の図は、ConvNeXtとCLIPの視覚エンコーダーのみを使用するモデルの結果を、Eagle-X5の結果と比較する。全視覚エンコーダーを使用すると、モデルは間違いを修正し、視覚言語整列で事前トレーニングされた高解像度視覚エンコーダーを装備している場合でも、Eagleの能力がさらに強化されることを示す。

多モーダルベンチマーク評価

Eagleは、さまざまなタスクでMLLMsの能力を示すために、MME、MMBench、SEED、MathVista、MMMU、ScienceQA、POPEの7つのベンチマークで評価される。特に、MME、MMBench、SEEDは、推論、認識、知識、OCRを含むさまざまな実世界タスクの全体的な性能を評価する。MMMUは、大学レベルの知識を必要とするさまざまなドメインからの課題的な問題に焦点を当てる。POPEは、MLLMsの視覚ホールユーションを評価する。評価に使用されるメトリックは、これらのベンチマークのデフォルト設定に従う。Eagleは、MMEの認識スコア、MMBenchのen_devスプリット、SEEDの画像スプリット、MathVistaのテストミニスプリット、MMMUのvalスプリット、POPEのF1スコア、ScienceQAの画像スコアを報告し、他のモデルからのスコアと一致することを保証する。

最終的な考察

この記事では、視覚エンコーダーを統合する多モーダル大規模言語モデルの設計空間の包括的な分析であるEagleについて説明した。以前の研究が新しい融合パラダイムを設計することに焦点を当てていたのに対し、Eagleは、体系的な設計選択が重要であり、有用なテクニックのシリーズを発見する。Eagleは、個々の視覚エンコーダーのトレーニングレシピを最適化し、拡張可能で効率的な融合方法を特定し、視覚エンコーダーを段階的に組み合わせる。結果は、基本的な設計空間の考慮が重要であることを強調する。