人工知能

MINT-1T: オープンソースのマルチモーダルデータを10倍に拡大

大規模なフロンティアのマルチモーダルモデル(LMMs)のトレーニングには、画像とテキストのインターリーブされたシーケンスを含む大規模なデータセットが必要です。オープンソースのLMMsは急速に進化していますが、まだオープンソースのマルチモーダルインターリーブされたデータセットが不足しています。これらのデータセットの重要性は、異なるモダリティーでのコンテンツの理解と生成が可能な高度なAIシステムを作成する基盤を形成しているため、強調することができません。十分なインターリーブされたデータセットがなければ、より高度でカプセル化されたLMMsの開発の可能性は大きく制限されます。これらのデータセットにより、モデルはさまざまな入力から学習できるため、さまざまなアプリケーションでより汎用性と効果が高くなります。また、オープンソースコミュニティはイノベーションとコラボレーションを推進するために共有リソースに依存しているため、これらのデータセットの不足は課題となります。

オープンソースのLMMsは近年大きな進歩を遂げてきましたが、その成長は大規模なインターリーブされたデータセットの限られた可用性によって妨げられています。この障害を克服するには、LMMsの開発と精製を支援できるより包括的なデータセットをキュレーション、注釈付け、公開するための集中した努力が必要です。また、これらのデータセットの作成と配布には、データのプライバシーと使用権に関する法的および倫理的な考慮事項を含むいくつかの技術的およびロジスティックなハードルを克服する必要があります。データの収集は、LMMsが展開されるさまざまなコンテキストを代表するために広範でなければなりません。注釈付けには、モデルがより効果的に学習できるように、画像とテキストのインターリーブされたシーケンスが適切に整列されるように注意深い考慮が必要です。また、データセットがオープンソースであることを保証するには、データのプライバシーと使用権に関する法的および倫理的な考慮事項に対処する必要があります。高品質のマルチモーダルインターリーブされた大規模データセットの可用性を拡大することは、AIの研究と開発の将来にとって不可欠です。現在の不足を解決することで、AIコミュニティはより大きなイノベーションとコラボレーションを促進し、複雑な現実世界の問題に対処できるより強力で汎用性の高いLMMsの作成につながります。

この点について、MINT-1Tは、現在までで最大で最も多様なオープンソースのマルチモーダルインターリーブされたデータセットです。MINT-1T: 既存のオープンソースデータセットよりも10倍大きな規模、1兆のテキストトークンと34億の画像を含みます。MINT-1Tデータセットは、PDFファイルやArXiv論文などの新たな情報源も導入しています。マルチモーダルインターリーブされたデータセットは簡単にスケールしないため、MINT-1Tデータセットがデータキュレーションのプロセスを共有することは重要です。そうすることで、他のユーザーもこれらの情報に富んだバリアントについての実験を行うことができます。MINT-1Tデータセットは、その方法が有効であることを実証しています。MINT-1TでトレーニングされたLMモデルは、以前の最先端のオープンソースデータセットであるOBELICSと競合する(ある程度)パフォーマンスを発揮します。

MINT-1T: 1兆トークンのマルチモーダルデータセット

大規模なオープンソースの事前トレーニングデータセットは、データエンジニアリングと透明でオープンソースのモデルをトレーニングするための研究コミュニティにとって重要でした。テキストドメインでは、C4やThe Pileなどの初期の研究は、最初のオープンソースの大規模言語モデルであるGPT-J、GPT-Neoなどのトレーニングを可能にする上で重要な役割を果たしました。これらの基礎的な努力は、データフィルタリング方法やスケーリングの改善にも道を開きました。同様に、画像とテキストの空間では、大規模なオープンソースデータセットは、Data filtering networksやT-MARSなどのより良いデータキュレーション方法の革新を促進しました。フロンティアラボから、画像とテキストのインターリーブされたシーケンスを含む大規模なマルチモーダルデータセットを必要とする大規模なマルチモーダルモデル(LMMs)のトレーニングへの移行が見られます。フロンティアモデルの能力が急速に進化するにつれて、クローズドソースモデルとオープンソースモデルの間でマルチモーダルトレーニングデータのギャップが拡大しています。現在のオープンソースマルチモーダルインターリーブされたデータセットは、テキストのみのデータセットよりも小さく、多様性に欠けています。主にHTMLドキュメントから取得されており、データの幅と多様性が制限されています。この制限は、強健なオープンソースLMMsの開発を妨げ、オープンソースモデルとクローズドソースモデルの能力の格差を生み出しています。

このギャップを解決するために、MINT-1Tは、現在までで最大で最も多様なオープンソースのマルチモーダルインターリーブされたデータセットとして作成されました。MINT-1Tには、1兆のテキストトークンと34億の画像が含まれており、HTML、PDF、ArXivなどのさまざまな情報源から取得されています。MINT-1Tの前に、同じ分野で最大のオープンソースデータセットであったOBELICSには、1150億のテキストトークンと3.53億の画像が含まれており、すべてHTMLから取得されていました。

MINT-1Tの貢献は以下のとおりです:

- データエンジニアリング: マルチモーダルインターリーブされたデータをスケールすることは、テキストのみまたは画像とテキストのペアのデータセットを構築するよりも、エンジニアリングの課題の方が大きいです。ドキュメントのサイズを処理し、画像とテキストの元の順序を維持することが重要です。

- 多様性: MINT-1Tは、マルチモーダルインターリーブされた空間で、CommonCrawl PDFやArXivなどの情報源から大規模なマルチモーダルドキュメントを収集する最初のデータセットです。

- モデル実験: 実験結果は、MINT-1TでトレーニングされたLMMsが、OBELICSでトレーニングされたモデルと競合する(ある程度)パフォーマンスを発揮し、スケールを10倍に拡大することを示しています。

MINT-1T: データセットの構築

MINT-1Tは、PDFやArXiv論文などのインターリーブされたドキュメントを利用する大規模なオープンソースデータセットをキュレーションします。このセクションでは、MINT-1Tのマルチモーダルドキュメントのソーシング方法、低品質コンテンツのフィルタリング、データのデドゥプリケーション、NSFWまたは不適切なコンテンツの除去について説明します。最終的なデータセットには、9220億(B)HTMLトークン、1060億PDFトークン、90億ArXivトークンが含まれています。

マルチモーダルドキュメントの大量取得

HTMLパイプライン

MINT-1Tは、CommonCrawl WARCファイルからインターリーブされたマルチモーダルドキュメントを抽出するために、OBELICSの方法に従います。各WARCエントリのDOMツリーをパースします。OBELICSは、2020年2月から2023年2月までのCommonCrawlダンプからのみドキュメントを処理しましたが、MINT-1Tはドキュメントプールを拡大して、2017年5月から2024年4月(2018年10月から2024年4月までのフルダンプと以前の年の部分ダンプ)までのHTMLドキュメントを含めました。OBELICSと同様に、画像が含まれないドキュメント、30を超える画像が含まれるドキュメント、または不適切なサブ文字列(ロゴ、アイコン、ポルノ、xxxなど)を含む画像のURLを持つドキュメントは除外されます。

PDFパイプライン

MINT-1Tは、2023年2月から2024年4月までのCommonCrawl WATファイルからPDFドキュメントを取得します。最初に、すべてのPDFリンクがこれらのダンプから抽出されます。MINT-1Tは、PyMuPDFを使用してPDFをダウンロードして読み取り、50MBを超えるPDF(おそらく大きな画像が含まれている)と50ページを超えるPDFを破棄します。テキストが含まれないページは除外され、残りのページに読み取り順序が確立されます。読み取り順序は、ページ上のすべてのテキストブロックのバウンディングボックスを見つけて、ブロックを列に基づいてクラスタリングし、上から下への順序で並べ替えることで決定されます。画像は、同じページ上のテキストブロックに近い位置に基づいてシーケンスに統合されます。

ArXivパイプライン

MINT-1Tは、TexSoupを使用してLaTeXソースコードからArXivのインターリーブされたドキュメントを構築し、図のタグを見つけて、画像と論文のテキストをインターリーブします。マルチファイルの論文の場合、MINT-1TはメインのTeXファイルを特定し、そのファイルの内容で入力タグを置き換えます。LaTeXコードは、インポート、ビブリオグラフィ、テーブル、引用タグを削除することでクリーンアップされます。ArXivは既に高度にキュレーションされた情報源であるため、追加のフィルタリングとデドゥプリケーションは実行されません。

テキスト品質フィルタリング

MINT-1Tは、モデルベースのヒューリスティックを使用せずに、RefinedWeb、Dolma、FineWebの慣行に従います。Fasttextの言語識別モデル(信頼性しきい値0.65)を使用して、非英語のドキュメントを除外します。NSFWサブ文字列を含むURLを持つドキュメントも除外して、ポルノグラフィックまたは不適切なコンテンツを除外します。RefinedWebのテキストフィルタリング方法が適用され、特に重複したn-グラムが多すぎるドキュメントや、MassiveTextのルールに基づいて低品質と判断されたドキュメントが除外されます。

画像フィルタリング

PDFとHTMLファイルのキュレーション後、MINT-1TはHTMLデータセット内のすべての画像URLをダウンロードしようとします。非取得可能なリンクは破棄され、有効な画像リンクが含まれないドキュメントは除外されます。150ピクセル未満の画像は除外され、20,000ピクセルを超える画像も除外されます。HTMLドキュメントの場合、2を超えるアスペクト比を持つ画像は除外されます。PDFの場合、3に調整して科学的な図や表を保存します。

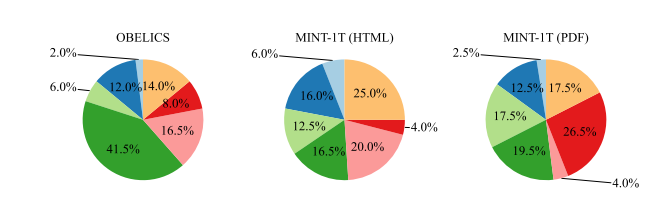

上記の図は、MINT-1TがHTMLソース以外にPDFとArXivドキュメントからのデータを含むことを示しています。

セーフティフィルタリング

- NSFW画像フィルタリング: MINT-1Tは、データセット内のすべての画像にNSFW画像検出器を適用します。ドキュメントに1つのNSFW画像が含まれている場合、ドキュメント全体が破棄されます。

- 個人情報の除去: 個人データの漏洩のリスクを軽減するために、テキストデータ内のメールアドレスとIPアドレスは匿名化されます。メールアドレスは「[email protected]」のようなテンプレートに置き換えられ、IPアドレスはランダムに生成された非機能的なIPアドレスに置き換えられます。

デドゥプリケーション

MINT-1Tは、各CommonCrawlスナップショット内で段落とドキュメントのテキストのデドゥプリケーションを実行し、アイコンやロゴなどの繰り返し、情報のない画像を除去します。すべてのデドゥプリケーションステップは、各データソースごとに個別に実行されます。

段落とドキュメントのデドゥプリケーション

Dolmaの方法に従って、MINT-1Tは、テキストのデドゥプリケーションに効率的なブルームフィルタを使用し、誤認率を0.01に設定し、各ドキュメントからの13グラムの段落(ダブルニューラインデリミタで示される)をデドゥプリケートします。ドキュメントの段落の80%以上が重複している場合、ドキュメント全体が破棄されます。

共通のボイラープレートテキストの除去

段落のデドゥプリケーションの後、MINT-1Tは、CCNetの慣行に従って、HTMLドキュメント内の短い共通のボイラープレート文を除去します。各CommonCrawlスナップショットの2%で、正確な段落のデドゥプリケーションを実行し、主に共通のボイラープレートテキストを除去します。

上記の図は、MINT-1Tのフィルタリングプロセスを示し、HTML、PDF、ArXiv論文のデータパイプラインを通じてトークンが除去される方法を示しています。

画像のデドゥプリケーション

各CommonCrawlスナップショット内で、MINT-1TはSHA256ハッシュに基づいて繰り返し発生する画像を除去します。厳密なデドゥプリケーションではなく、スナップショット内で10回以上発生する画像のみが除去され、Multimodal-C4の慣行に従います。OBELICSと同様に、ドキュメント内の繰り返し画像は除去され、最初の発生のみが保持されます。

インフラストラクチャ

データ処理全体を通じて、MINT-1Tは、平均して190プロセッサと90プロセッサのノードのミックスから2350のCPUコアにアクセスしました。合計で約420万CPU時間がこのデータセットの構築に使用されました。

MINT-1TとOBELICSのドキュメント構成の比較

インターリーブされたデータセットの構成を評価するために、2つの重要な特性が調査されます。ドキュメントあたりのテキストトークンの分布とドキュメントあたりの画像の数です。この分析のために、OBELICSとMINT-1Tの各データソースから50000のドキュメントがランダムにサンプリングされました。GPT-2のトークナイザが使用されて、テキストトークンの数が計算されました。外れ値は、テキストトークンと画像の数の1.5四分位間距離の外側にあるドキュメントを除外することで除去されました。以下の図のように、MINT-1TのHTMLサブセットは、OBELICSで見られるトークンの分布と密接に一致しています。ただし、PDFとArXivから得られるドキュメントは、平均してHTMLドキュメントよりも長くなります。これは、さまざまな情報源からデータを取得する利点を強調しています。図5は、すべてのドキュメントを通じて画像の密度を示し、PDFとArXivのドキュメントがHTMLドキュメントよりも多くの画像を含み、ArXivのサンプルが最も画像密度が高いことを示しています。

異なるデータソースがドキュメントの多様性をどのように改善するか

マルチモーダルドキュメントのプールをHTMLを超えて拡大することの重要な動機は、ドメインのカバレッジの改善です。カバレッジの多様性と深さを量化するために、OBELICSデータセット、MINT-1TのHTMLサブセット、MINT-1TのPDFサブセット(ArXivを除く)から100000のドキュメントをサンプリングして、200のトピックを持つLatent Dirichlet Allocation(LDA)モデルをトレーニングしました。GPT-4を使用して、MMMUDomainに基づいてワードのセットを分類し、主なドメイン(ヘルス&メディシン、サイエンス、ビジネス、ヒューマニティ、ヒストリーなど)を特定しました。分析は、ドメインの分布における明確な傾向を示しています。

- OBELICS: このデータセットは、「ヒューマニティと社会科学」に強い集中を示しています。これは、ウィキペディアの記事に似たドキュメントをフィルタリングするデータ構築プロセスに起因する可能性があり、一般的な知識とヒューマニティに重点を置いたコンテンツへの分布を変更する可能性があります。

- MINT-1TのHTMLサブセット: 一方、MINT-1TのHTMLサブセットは、特定のドメインに強い偏りを示しません。より広範でバランスの取れたドメインの表現を示唆しています。

- MINT-1TのPDFサブセット: MINT-1TのPDFドキュメントには、「科学と技術」のドキュメントの割合が高いことがわかります。これは、科学的なコミュニケーションにおいて、詳細な研究論文や技術報告を共有するためにPDFが好まれる形式であるため、PDFドキュメントの性質に起因する可能性があります。

MINT-1T: 結果と実験

すべての実験では、MINT-1Tは50%の画像テキストキャプションバッチと50%のマルチモーダルインターリーブバッチでモデルをトレーニングします。各インターリーブドキュメントから最大2048のマルチモーダルトークンがサンプリングされ、各画像テキストサンプルから340トークンがサンプリングされます。Flamingoと同様に、隣接する画像テキストシーケンスの終了を示すために「終了」トークンが追加されます。トレーニング中、単一の画像インターリーブドキュメントの50%はランダムにドロップされて、マルチ画像ドキュメントをアップサンプリングします。画像テキストデータセットは、内部でキュレーションされたキャプションデータセットのミックスです。モデルのマルチモーダルインターリーブシーケンスについての推論能力は、インコンテキストラーニング能力とマルチ画像推論パフォーマンスを通じて評価されます。

上記の図は、MMMUDomainにおける各ドメインのドキュメントの割合を示しています。

インコンテキストラーニング: モデルは、4ショットと8ショットのインコンテキストラーニングパフォーマンスを、さまざまなキャプションベンチマーク(COCO(Karpathyテスト)とTextCaps(バリデーション))と視覚的な質問回答データセット(VQAv2(バリデーション)、OK-VQA(バリデーション)、TextVQA(バリデーション)、VizWiz(バリデーション))で評価します。デモンストレーションは、トレーニングセットからランダムにサンプリングされます。スコアは、ランダム化されたプロンプトに基づいて複数の評価実行の平均値をとって、選択したプロンプトへの感度を考慮します。各タスクに最適なパフォーマンスを出すプロンプトを選択するために、異なるプロンプトがアブレーションされます。

マルチ画像推論: モデルは、MMMUDomain(シングル画像とマルチ画像の質問を含む)とMantis-Eval(マルチ画像質問のみ)でマルチ画像推論能力を評価します。

HTMLドキュメントでのトレーニング

最初に、MINT-1TのHTML部分は、OBELICSと比較されます。OBELICSは、同じくHTMLドキュメントからキュレーションされた以前のリーディングインターリーブデータセットです。MINT-1TとOBELICSのHTML部分で2つのモデルをトレーニングし、10Bのマルチモーダルトークンでトレーニングします。そのインコンテキストラーニングパフォーマンスを評価します。以下の表は、4ショットと8ショットのパフォーマンスを共通のベンチマークで示しています。MINT-1Tでトレーニングされたモデルは、VQAタスクでOBELICSを上回りますが、キャプションベンチマークでは劣るパフォーマンスを示しています。平均して、OBELICSはMINT-1T(HTML)よりもわずかに優れています。

PDFとArXivドキュメントの追加

その後、MINT-1Tのすべてのデータソース(HTML、PDF、ArXiv)でトレーニングが行われます。インターリーブドキュメントは、50%がHTMLから、45%がPDFから、5%がArXivからサンプリングされます。モデルは10Bのマルチモーダルトークンでトレーニングされます。上記の表に示すように、MINT-1Tの完全なデータミックスでトレーニングされたモデルは、OBELICSとMINT-1T(HTML)を上回り、ほとんどのインコンテキストラーニングベンチマークで優れたパフォーマンスを示しています。より複雑なマルチモーダル推論ベンチマークでは、MINT-1TモデルはMMMUDomainでOBELICSを上回りますが、Mantis-Evalでは劣るパフォーマンスを示しています。

微細な傾向

インコンテキストラーニングパフォーマンスはデモンストレーション数とどのようにスケールするか

インコンテキストラーニングパフォーマンスは、1から8のデモンストレーション数で評価されます。各ショット数ごとに1つのトライアルが実行され、各評価ベンチマークでランダム化されたプロンプトに基づいてスコアが平均化されます。以下の図に示すように、MINT-1Tでトレーニングされたモデルは、すべてのショット数でMINT-1T(HTML)とOBELICSを上回ります。MINT-1T(HTML)モデルはOBELICSよりもわずかに劣るパフォーマンスを示しています。

キャプションと視覚的な質問回答タスクのパフォーマンス

以下の図は、キャプションと視覚的な質問回答ベンチマークでの平均インコンテキストラーニングパフォーマンスを示しています。OBELICSは4ショットのキャプションベンチマークでMINT-1Tのすべてのバリアントを上回り、8ショットのキャプションベンチマークではMINT-1Tよりもわずかに劣るパフォーマンスを示しています。ただし、MINT-1TはVQAベンチマークでOBELICSとMINT-1T(HTML)を上回ります。MINT-1T(HTML)もVQAタスクでOBELICSを上回ります。

ドメインごとのパフォーマンス

MINT-1Tにさまざまなドメインを含めることで、モデルの汎用性が向上することを目的としています。先ほどの図は、MMMUDomainでの各ドメインのパフォーマンスを分解しています。ビジネスドメインを除いて、MINT-1TはOBELICSとMINT-1T(HTML)を上回ります。サイエンスとテクノロジードメインでのパフォーマンスの向上は、ArXivとPDFドキュメントでのこれらのドメインの普遍性に起因するものです。

最終的な考察

この記事では、現在までで最大で最も多様なオープンソースのマルチモーダルインターリーブされたデータセットであるMINT-1Tについて説明しました。MINT-1T: 既存のオープンソースデータセットよりも10倍大きな規模、1兆のテキストトークンと34億の画像を含みます。MINT-1Tデータセットは、PDFファイルやArXiv論文などの新たな情報源も導入しています。マルチモーダルインターリーブされたデータセットは簡単にスケールしないため、MINT-1Tデータセットがデータキュレーションのプロセスを共有することは重要です。そうすることで、他のユーザーもこれらの情報に富んだバリアントについての実験を行うことができます。MINT-1Tデータセットは、その方法が有効であることを実証しています。MINT-1TでトレーニングされたLMモデルは、以前の最先端のオープンソースデータセットであるOBELICSと競合する(ある程度)パフォーマンスを発揮します。