Andersonの視点

AIは本を読むことを映画を見るよりも好む

実際のビデオコンテンツを観察してコメントするようにAIモデルを促すのは、驚くほど難しい。彼らは書かれた言葉に興味がある。

ChatGPTや同様の人気のあるビジョン/言語モデルに小さなビデオクリップをアップロードしようとしたことがある人は、モデルが実際にビデオを解析できないことを知ることが驚くことであるかもしれない。ChatGPT-4o+のようなモデルは、個々のフレーム(JPEGやPNGなどの画像の形式で)を分析することができるが、ユーザーが自分でフレームを抽出して画像としてアップロードすることを好む(これについてはコメントする準備が整っている)。

OpenAI GPTシリーズの場合、ビデオクリップから完全なフレームのシーケンスを抽出してChatGPTに提供することは可能だが、たとえば、ビデオのナレーショントラックを生成するような目的のために、非常に手間がかかる。

![OpenAIのチュートリアルからの画像とコード。ビデオクリップの複数の抽出フレームを解析して、AI生成のコメントを開発する目的。[ ソース ] https://cookbook.openai.com/examples/gpt_with_vision_for_video_understanding](https://www.unite.ai/wp-content/uploads/2025/10/openai-gpt-frame-parsing.jpg)

OpenAIのチュートリアルからの画像とコード。ビデオクリップの複数の抽出フレームを解析して、AI生成のコメントを開発する目的。 ソース

しかし、ビデオからフレームへの変換はユーザーに依存する。たとえば、上記の例のように、大規模なルーチン内の関数を呼び出すか、FFMPEGまたはさまざまな無料または有料のビデオ編集ソリューションを使用してフレームを抽出する。

ある程度、ひょっとすると大きな程度で、ChatGPTのような高規模製品におけるビデオ分析の制限は、リソース使用に依存する。最も人気のあるビデオコーデックの選択を1つのAIインスタンスにツール化し、抽出のディスク重くCPUを絞るプロセスにコンピューティングリソースをコミットすることは、数百万のユーザーが毎日これらの機能を使用し始めた場合、軽視できない考慮事項である。

さらに、時間分析は、単一のフレームよりも非常に異なる絵を描くことができる(たとえば、誰かが幸せな気分で家に入るが、そこで死体を発見する)。したがって、短いビデオクリップの全体的な時間的「チェックサム」を考慮することは、リソースを大量に消費する難しいタスクであるだけでなく、研究文献の専門分野でもある(たとえば、Optical Flowなどのフレームワークの開発)。これは基本的にビデオの長さを「展開」して、静的なドキュメントのように扱うことができる。

![Optical flow図は、ビデオシーケンス内のフレーム間でモーションを追跡する方法を示している。緑のベクトルは移動の方向と強度を示し、これらのマッピングはVLMに必要な時間的連続性を提供し、VFXワークフローでも構造的なガイドとして機能する。[ ソース ] https://www.researchgate.net/figure/Optical-flow-field-vectors-shown-as-green-vectors-with-red-end-points-before-and-after_fig6_290181771](https://www.unite.ai/wp-content/uploads/2025/10/optical-flow.jpg)

Optical flow図は、ビデオシーケンス内のフレーム間でモーションを追跡する方法を示している。緑のベクトルは移動の方向と強度を示し、これらのマッピングはVLMに必要な時間的連続性を提供し、VFXワークフローでも構造的なガイドとして機能する。 ソース

Cliffのノート

しかし、GoogleのNotebook LMや最新のChatGPTエントリなどのモデルは、関連するメタデータ(いくつかの方法でビデオを文脈化する埋め込みテキストコンテンツ)を読むことができるため、ビデオファイルのアップロードを禁止していない。時々、これらのモデルはメタデータのないビデオを解釈しようとする。

以下のケースでは、2021年のイタリア映画「神の手」の6秒間のランダムなクリップをNotebookLMにアップロードし、クリップに有用なテキストが含まれないようにした。

NotebookLMは、ビデオに関係のない、無意味な5分間の対面ポッドキャストを含む、詳細な素材を想像力豊かに「創造」した。

イタリア映画の6秒間のクリップは、NotebookLMによって大幅に誤解されている。ソース: Google NotebookLM

NotebookはChatGPTと同様に、YouTubeビデオを入力として受け付けるが、ビデオに解釈可能なテキストレイヤーアノテーションと/または字幕(ビデオに焼き込まれたラスタライズされた字幕ではない)が含まれている場合にのみ受け付ける。

このように、実際のビデオコンテンツを「見て」聞いて、意味を解釈する(これは、著作権保護対策や、アイデンティティ保護システムなどのために、YouTubeの法的必須事項である)という難しい仕事は、ユーザーのアップロード後に、クリップが必要な処理リソースを割り当てられるタイミングで行われる。

実際のビデオ解釈は高価で疲れるものであり、ビデオ解釈タスクを実行するように特別に設計されたモデルでも、テキストを読むことをビデオを見るよりも好むことが明らかになる。

TL;DW

これは、イギリスのブリストル大学の新しい論文「ビデオは千の言葉に値しない」に述べられている。2人の著者は、現在の最先端のビジョン言語モデル(VLM)が、ビデオを分析するために特別に設計されているにもかかわらず、テキストベースの情報に頼ることを好むことを結論づけた。

動画と書かれた質問および多肢選択回答が与えられた場合、著者は、モデルは通常、テキスト内のパターンに基づいて選択を行い、画面上の何が起こっているかはあまり考慮しなかった。質問が完全に取り除かれても、モデルはしばしば同じように実行された。

新しい論文は、GitHubリポジトリに伴う。

方法

入力の各部分(ビデオ、テキストなど)がモデルの決定にどれだけ貢献するかを理解するために、新しい研究では、ゲーム理論から「シェープリー値」と呼ばれる方法を使用する。もともと、連合内のプレイヤー間で支払いを公平に分割するために設計されたシェープリー値は、各「プレイヤー」に、個々の影響に基づいてクレジットを割り当てる。

実質的に、シナリオのプレイヤーはビデオフレームまたはVQAタスクのテキストコンポーネント(アノテーション、字幕、キャプションなど)である。ペイアウトはモデルの最終的な回答である。各部分を追加または削除することで何が起こるかを体系的にテストすることで、このテクニックは、要素の重要性を明らかにする。

この場合、シェープリー値は、ビデオとテキストコンポーネントを個別に扱い、モデルの出力への影響を測定するために、混合モダリティに拡張された。

メトリック

モデルが決定に寄与する各モダリティ(つまり、ビデオ、質問、または回答)がどれだけ寄与するかを比較するために、2つの単純なメトリックが定義された。 モダリティ貢献 は、入力の各タイプからの合計シェープリー値を合計し、合計の割合として各モダリティに属するシェアを計算する。

2番目に、パーフィーチャ貢献 は、ビデオなどのモダリティが他のモダリティよりも多くの機能を含むことを修正する。代わりに、各機能の平均シェープリー値が計算され、平均値が比較されることで、どのモダリティの影響が優勢であるかが決定される。

データとテスト

著者は、テストの原則が広く適用可能で一般化できるように、さまざまな特性を持つ6つのVLMモデルをテストした。したがって、モデルは、さまざまなコンテキストの長さ、さまざまな年齢(リリースされてからの時間)、およびさまざまなアーキテクチャ構成のために選択された。

候補者は、FrozenBiLM;InternVideo;VideoLLaMA2; VideoLLaMA3; LLaVa-Video(Qwen2を利用);およびLongVA(Qwen2も使用)。

同じ目的で、4つのターゲットデータセットが選択された。 EgoSchema、VQAを完了するために関連ビデオの完全な表示が必要なVQAデータセット; HD-EPIC、長いビデオを含むキッチンに焦点を当てたデータセット; MVBench、他のデータセットからの寄稿のキュレーション;および LVBench、非常に長いビデオのVQAクエリを提示する。

これらから、著者は60の質問を考案した。各質問タイプから10個ずつ。

メトリックは、ほとんどのモデルがビデオよりもテキストに頼っていることを明らかにした。特にフレームごとに判断された場合、ビデオは全体的な貢献度では妥当な結果を示したが、機能ごとの影響はほとんどなかった。つまり、モデルはビデオを集合的に使用しているかもしれないが、個々のフレームに注意を払っていない。VideoLLaMA3はこの点で主なアウトライアーであり、特にLVBenchのより長いシーケンスでは視覚的依存が強かった。

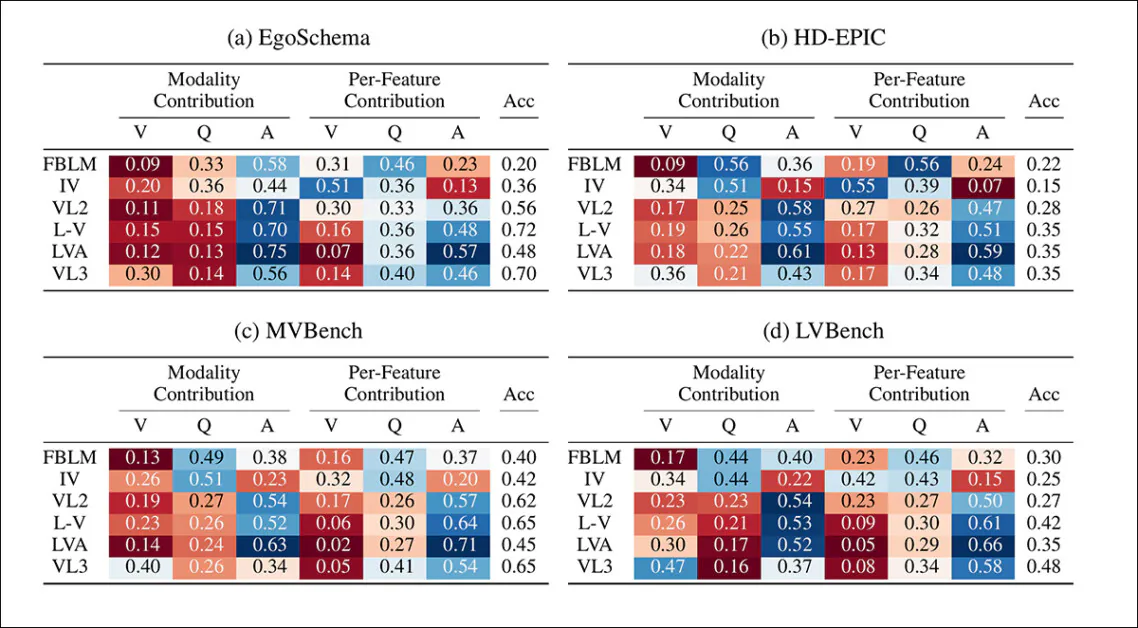

モデルとデータセットをまたいだモダリティ貢献(MC)とパーフィーチャ貢献(PFC)スコア。ビデオ(V)、質問(Q)、回答(A)入力の相対的な重みを示す。冷色はより強い貢献を示し、暖色はより弱いまたは無視できる影響を示す。ほとんどの設定では、言語が明らかに優勢であり、ビデオは特にフレームごとの影響でしばしばサイドラインに置かれる。

質問については、特に強いモデルでは、質問が回答よりも重要であることがわかった。これは、質問が長く、より自然isticで、回答が短く、時にはスキーマ的なデータセット(たとえば、EgoSchema)で最も明らかだった。

MVBenchはこれをある程度逆転させた。二項回答の構造により、回答トークンの明らかな重要性が増大した。

全モデルとデータセットを通して、視覚は一貫してサイドラインに置かれ、言語が重労働の大部分を担った。

論文には以下のように記載されている。

‘[長いコンテキストモデルでは、]ビデオは貢献度が大幅に低下しており、各フレームのシェープリー値はテキスト機能のカウンターパートに比べてはるかに小さくなっている。 ‘

‘ビデオ全体としてのモダリティは依然として非常に重要ですが、これはビデオの個々のフレームのシェープリー値がより零に近く、モデルの注意がそれらに導かれていないことを示唆しています。 ‘

各入力部分(ビデオ、テキストなど)がモデルの精度にどれだけ貢献するかをテストするために、研究者はさらに マスキング を使用してテストを行った。特定の入力の一部を意図的に隠し、モデルの精度がどれだけ変化するかを確認する。

精度が大幅に低下する場合、その入力は重要であることを示唆する。モデルの精度がほとんど変化しない場合、欠落している部分はあまり依存されていないことを示唆する。この意味で、マスキングテストは、反復的な 消去研究 の一種である。

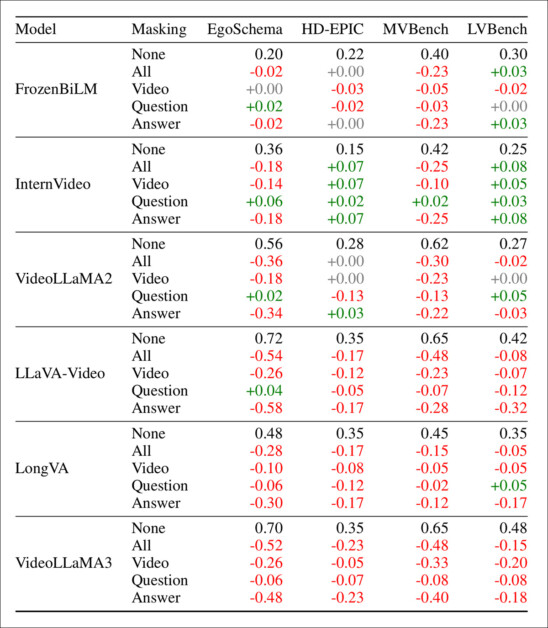

4つのVQAベンチマークをまたいだビデオ、質問、または回答入力のマスキングのパフォーマンスへの影響。スコアは、アンマスクされたベースラインからの変更を示す。赤は精度の低下、緑は精度の向上を示す。モデルはしばしばビデオなしで高いスコアを維持したが、回答(テキスト回答)が削除されると、精度が大幅に低下した。質問をマスキングすると、通常、影響は最小限であった。

結果(上記の図に示されている)は、回答(多肢選択データのテキスト回答)が全体的に最も重要であることを示している。回答をマスキングすると、精度が大幅に低下し、モデルはほぼランダムなパフォーマンスになった。

しかし、質問 をマスキングすると、影響は最も小さくなった。さらに、質問を削除すると、精度が向上した場合もあり、これは、モデルが質問を適切に評価するのではなく、回答と視覚的またはテキストのヒントをマッチングしていることを示唆する。

モデルはビデオへの依存度も異なっていた。いくつかのモデルはビデオなしでまだ妥当な精度を維持した。これは、ビデオ機能の貢献が多くの現在の設定で制限されていることをさらに裏付ける。

著者は、さらに、モデルをビデオに頼らせることができるかどうかをテストするために、多肢選択オプションに追加の「誤った回答」を追加した。

誤った回答が簡単で、他の質問から再利用された場合、パフォーマンスは向上した。モデルはテキストパターンにマッチングしたが、多くの推論は行わなかった。しかし、10個以上の無関係な回答が追加されると、モデルはビデオと質問により多く依存し始めた。

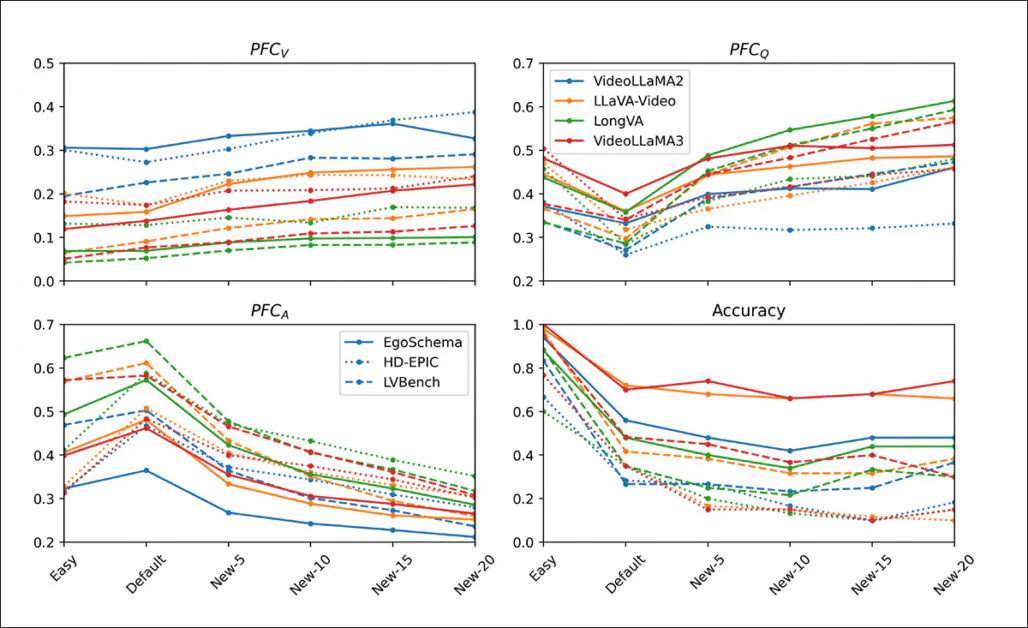

各VQAテストに追加の誤った回答を追加したときの、ビデオ、質問、回答入力のパーフィーチャ貢献と精度を示す。テキストの優位性が減り、視覚的および質問の機能の相対的な影響が増加する。

VideoLLaMA3の場合、ビデオをマスキングすると、EgoSchemaでは精度が40%、LVBenchでは15%低下した。これは、回答の数を単純に増やすと、モデルをテキストのショートカットから本物のマルチモーダル推論に向けることができることを示している。

研究者はまた、入力間の帰属をどのように分配するかを調査し、以下にVQAタスクの各モデル入力のシェープリー値のヒートマップを示す。

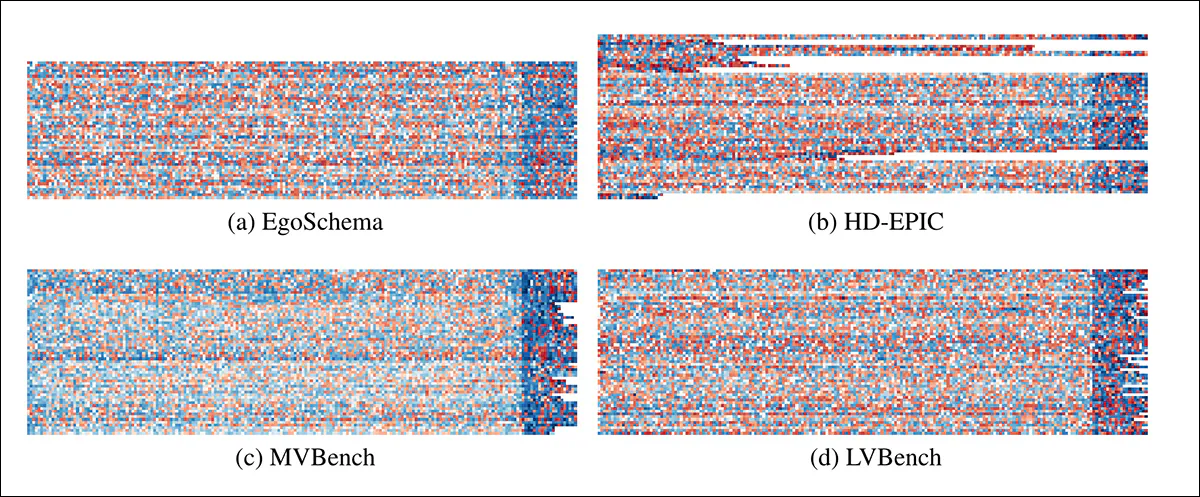

4つのデータセットのシェープリー値ヒートマップ。各行は1つのVQAタプルを示し、各列は1つの機能を示す。ビデオ機能は左側にあり、テキストの後に続く。テキスト領域(赤)におけるより強い値は、モデルがビデオよりも言語に大きく依存していることを確認する。

上記の結果についてコメントする著者は、以下のように述べている。

‘ヒートマップの右側のシェープリー値の大きさは、質問と回答の帰属を表すため、ビデオとテキストの帰属の明確な境界を示している。 ‘

要約すると、すべてのデータセットを通して、値はテキストの側ではるかに強く、モデルは言語よりも視覚的なヒントに大きく依存していることを強く示唆している。ビデオが使用される場合でも、貢献は多くのフレームに薄く分散しており、ほとんどの場合、一貫したパターンは存在しない。

以下は、EgoSchemaからの注釈付きの例を示す。シェープリー値を使用して、最も「重要な」16のフレームが選択され、影響に応じて色付けされた。青は正の貢献を示し、赤は負の貢献を示す。

EgoSchemaの1つの例からのシェープリー帰属。最も影響力のある16のフレームとすべてのテキスト入力を示す。ビデオの貢献はテキストに比べて最小限であり、モデルの推論はビデオよりもテキストによって支配されている。

結果は、ほぼすべてのフレームが質問と回答の単語に比べて非常に弱い影響しか持たないことを示している。視覚的なヒントは希薄で一貫性がなく、名詞などの「椅子」と「フェンス」は、コンテキストに応じて、モデルを正しい選択に導いたり、遠ざけたりする。

結論

ビデオ編集やビデオ分析に携わったことがある人は、ビデオ編集や解釈のプロセスがリソースを大量に消費することを既に知っているはずで、1日あたり数百万のAIベースのリクエストを処理する会社が、ユーザーによって「アドホック」な編集および解釈ビデオプロセスを実行することを気軽に許可できないことを理解しているはずである。

この点で覚えておくべきことは、試すことができるほぼすべてのAPI AIインターフェイス(新しい科学研究をサポートするための短期間のデモを除く)が、ユーザーの要望を最小限のリソース消費で実現しようとしていることである。

これは、ユーザーが提供したデータからの既存のメタデータや RAG リトリーバルに頼ることを意味する(可能な場合)。また、PDF、ドキュメント、単一の画像などのより解釈可能な形式のメタデータを抽出することを意味する(絶対に必要な場合)。

テーブルには、CLIPまたは最新のYOLOリリースを実行したり、実際にフレーム内のコンテンツを識別して提供されたビデオで何が起こっているかを理解できるように、時間がかかりリソースを大量に消費するVLMを実行したりすることはない。

しかし、これは、現在の論文で記載されている現象が、必ずしも節約的なアーキテクチャアプローチから生じていることを意味しない。著者は、テキストが現在の最先端のマルチモーダル訓練パラダイムを支配していることを観察しており、「視覚言語」はマルチモーダルコンテキスト内であまり発達していない、または重要でない、または情報に富んでいない、または(少なくとも現在)あまり理解されていないことを示唆している。

* 興味深いことに、NotebookLMが生成した素材は、完全にオリジナルであるか、Googleによってインデックスされていないようです。なぜなら、これらの出力がトレーニングデータに潜り込んで、出力を促すことができないからです。

初めて出版されたのは2025年10月31日金曜日で、14:20にフォーマットのために編集されました