L'angolo di Anderson

I dati "canaglia" che inquinano le prestazioni dell'intelligenza artificiale generativa

Un nuovo studio ha scoperto che molti set di dati di immagini popolari utilizzati per addestrare modelli di intelligenza artificiale sono contaminati da immagini di prova o quasi duplicati, consentendo ai modelli di barare memorizzando le risposte invece di imparare. La perdita è diffusa ma generalmente non rilevata, gonfiando silenziosamente i punteggi e offrendo vantaggi ingiusti ai modelli addestrati su dati su scala web.

Quando si sostiene un esame di guida, di solito non si viene informati in anticipo su quali strade verranno utilizzate per l'esame. Se lo si facesse (e si fosse un po' mancati di integrità), si potrebbe "ottimizzare" l'esame esercitandosi ripetutamente su quel percorso, invece di sviluppare competenze di guida più ampie che consentano di affrontare la prova. in qualsiasi percorso abbastanza bene.

Nella formazione dei modelli di apprendimento automatico, questa è un'analogia ragionevole per un test di divisione – una suddivisione dei dati del set di addestramento tra (solitamente) una suddivisione del 70% per i dati che saranno utilizzati per addestrare il modello, con il restante 30% utilizzato come dati "in the wild".

Poiché i dati in natura non sono mai stati visti dal modello, se il modello funziona bene su quei dati, si può presumere che sia efficace e performante; in caso contrario, il modello potrebbe avere sovradimensionato su un set ben bilanciato, altrimenti i dati necessitavano di una maggiore cura e definizione.

In entrambi i casi, non è un la valutazione dei modelli sulla base dei loro dati di addestramento è il fondamento del metodo attuale nella ricerca e nello sviluppo dell'intelligenza artificiale.

Di nuovo lo stesso, per favore

Secondo un nuovo documento di ricerca dal Giappone, il settore della ricerca sulla visione artificiale e sull'intelligenza artificiale generativa non ha minimamente eguagliato il sforzi dei ricercatori LLM per garantire che i dati di test non inquinino i dati di addestramento; nei test, i ricercatori hanno scoperto che ogni set di dati di visione iperscalare da loro studiato, compresi quelli che alimentano alcuni dei più grandi sistemi di intelligenza artificiale generativa attuali, ha in una certa misura consentito ai suoi dati di test di incrociarsi con i suoi dati di addestramento, il che significa che i benchmark e i report sulle prestazioni per i modelli addestrati su queste suddivisioni non saranno più accurati di un risultato d'esame di qualcuno che ha introdotto di nascosto una culla nell'aula d'esame e non rifletteranno le prestazioni del mondo reale su dati realmente nuovi.

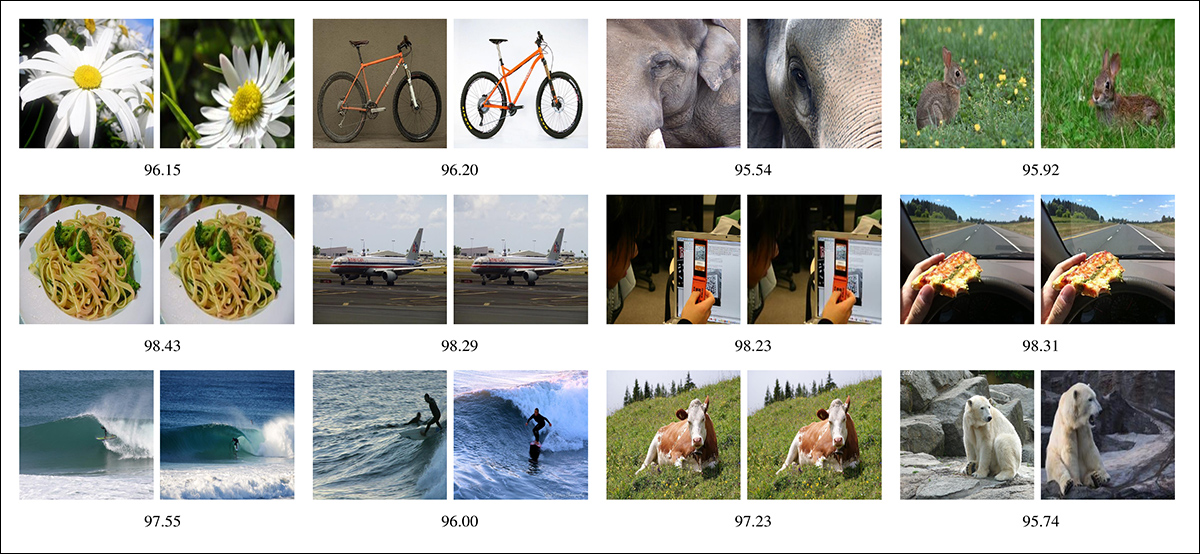

Esempi di contaminazione incrociata dei dati riscontrati dai ricercatori, in cui sono presenti punti dati duplicati o quasi duplicati sia nei dati di addestramento che in quelli di test. Fonte: https://arxiv.org/pdf/2508.17416

Nell'immagine sopra, tratta dal nuovo documento, vediamo esempi di punti dati duplicati o quasi duplicati trovati sia nei dati di formazione principali che nei dati di test di una varietà di modelli, sufficienti a invalidare le prestazioni del modello su tali dati e a gonfiare leggermente i suoi punteggi generali su tutta la linea, facilitando la comparsa di un livello di generalizzazione che il modello potrebbe non aver effettivamente raggiunto.

A complicare ulteriormente le cose, la contaminazione sembra verificarsi in una varietà di possibili scenari, tra cui:pre-formazione', dove il pesi of modelli ancestrali più vecchi vengono utilizzati per "dare il via" a un nuovo modello. Se il modello precedente, a monte, contiene alcuni degli stessi dati del nuovo set di dati pre-addestrato, può verificarsi una contaminazione incrociata anche se la suddivisione 70/30 o 80/20 è corretta.

Effetto cumulativo

È quasi certo che ciò accada anche nei set di dati più recenti: la portata dei set di dati sulla vista/linguaggio è cresciuta enormemente negli ultimi cinque anni, includendo non solo i dati di immagini più recenti sul web, ma anche riassorbendo gran parte degli stessi dati che popolavano quei set di dati storici più vecchi.

Inoltre, le routine automatizzate progettate per setacciare e filtrare miliardi di immagini alla ricerca di duplicati e quasi duplicati si trovano ora ad affrontare un compito così oneroso che la cura stessa – il suo costo in termini di tempo e denaro – deve ora essere considerata nel contesto delle limitazioni di bilancio.

Nel frattempo, la duplicazione delle immagini è una conseguenza inevitabile del tipo di ad hoc navigando a ritroso dietro enormi collezioni come Scansione comune, a causa della pratica comune di ripubblicare e ricomprimere le immagini e di applicare modifiche come ritagli e persino capovolgimenti (per eludere il rilevamento, quando l'immagine potrebbe essere stata utilizzata senza autorizzazione, ad esempio).

Gli autori osservano*:

La perdita di dati è un problema diffuso, prevalente nella maggior parte dei dataset visivi. La perdita può oscurare la capacità di generalizzazione dei modelli, il che è particolarmente problematico quando si confrontano modelli addestrati su dataset diversi, portando a confronti iniqui.

"Invitiamo i progettisti di dataset a considerare attentamente le implicazioni di queste valutazioni. Per una valutazione più equa del modello, raccomandiamo l'uso di rilevatori di duplicati che considerino sia le perdite hard che soft.

"L'ideale sarebbe rimuovere le immagini trapelate dal set di addestramento e, se non fosse possibile, almeno dal set di test."

Il documento illustra in dettaglio una serie di test condotti dai ricercatori su enormi e diffusi set di dati, ognuno dei quali ha dimostrato un certo livello di contaminazione.

Migliori nuovo documento è intitolato Perdita di dati nei set di dati visivie proviene da tre ricercatori dell'Università di Osaka.

Metodo

Gli autori dell'articolo definiscono la perdita in termini di tre dimensioni: modalità, coperturae grado.

Modalità distingue se sono trapelate solo le immagini o se sono esposte sia le immagini che le etichette; copertura identifica se la sovrapposizione si verifica all'interno dello stesso set di dati o tra set di dati diversi; e grado definisce se il contenuto duplicato è esattamente lo stesso o semplicemente adiacente.

Per quanto riguarda le perdite, i due scenari considerati nel lavoro sono perdite intra-dataset (dove le immagini di valutazione riappaiono nella divisione di addestramento dello stesso set di dati) e perdite tra set di dati (dove le immagini di valutazione di un set di dati sono presenti in un diverso set di dati utilizzato per l'addestramento).

Per quanto riguarda il grado, i due livelli definiti sono perdite morbide (dove le immagini non sono identiche ma presentano piccole variazioni), e perdite gravi (dove le immagini sono esattamente le stesse durante la formazione e la valutazione).

I ricercatori affrontano il rilevamento delle perdite in termini di recupero delle immagini, utilizzando codificatori di immagini per rappresentare ogni immagine come vettore di caratteristiche. insieme di query sono i dati di valutazione, mentre il collezione è il set di addestramento.

Per set di dati più piccoli, ogni vettore di query è stato confrontato direttamente con tutti i vettori di addestramento utilizzando somiglianza del cosenoPer set di dati più grandi, un Indice di Faiss è stato costruito per consentire una maggiore velocità, K-vicini più vicini (KNN) ricerca.

Poiché il codificatore deve catturare informazioni visive sufficienti per rilevare sottili somiglianze, ma rimanere comunque efficiente di fronte a volumi di dati molto elevati, gli autori si sono affidati a dati precalcolati CLIP funzionalità rese disponibili dai creatori di dataset, nel caso della raccolta LAION che supporta Stable Diffusion e progetti successivi.

Gli autori sottolineano che consentire a CLIP di utilizzare la sua comprensione distillata del set di dati (invece di interrogare i file effettivi su larga scala) ha accelerato notevolmente il processo e ha offerto una maggiore coerenza tra i confronti.

Dati e test

Il codificatore di immagini CLIP utilizzato nei test per il nuovo lavoro era quello predefinito CLIP ViT-B/32 originariamente utilizzato per setacciare LAION. Per stabilire se diverse immagini fossero correlate tra loro, KNN è stato utilizzato sotto AutoFaiss.

I set di dati sono stati raggruppati in tre tipologie: preallenamento set di dati: grandi raccolte ricavate dal web utilizzate per addestrare modelli generalisti; sul posto set di dati: raccolte più piccole, spesso annotate, destinate alla messa a punto diretta del modello; e benchmark set di dati: annotati manualmente e utilizzati esclusivamente per la valutazione.

L'analisi ha interessato venti suddivisioni in sette set di dati: Microsoft COCO è stato utilizzato sia come set di addestramento che di valutazione, incorporando le divisioni di addestramento, convalida, test e non etichettate; Flickr30k servito esclusivamente come punto di riferimento; e il Didascalie concettuali di Google La raccolta (GCC) è stata trattata come una fonte di pre-addestramento, mentre la sua parte di convalida è stata utilizzata anche per la valutazione.

Inoltre, IMAGEnet è stato utilizzato sia per la formazione che per il benchmarking, mentre il LAION-400M il set di dati è stato utilizzato esclusivamente per la pre-formazione.

OpenImages v4 ha contribuito con dati di formazione e di benchmark, e Testo maiuscolo ha fornito sia sessioni di formazione che di test per la valutazione.

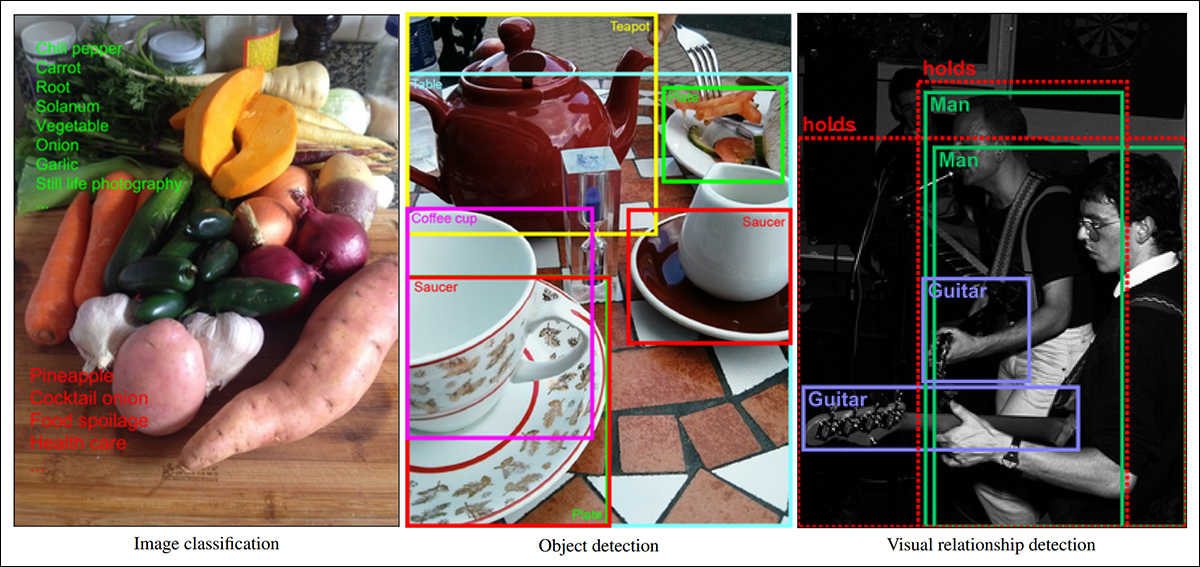

Esempi di annotazioni di immagini dal dataset Open Images di Google, esaminati nel nuovo lavoro. Fonte: https://arxiv.org/pdf/1811.00982

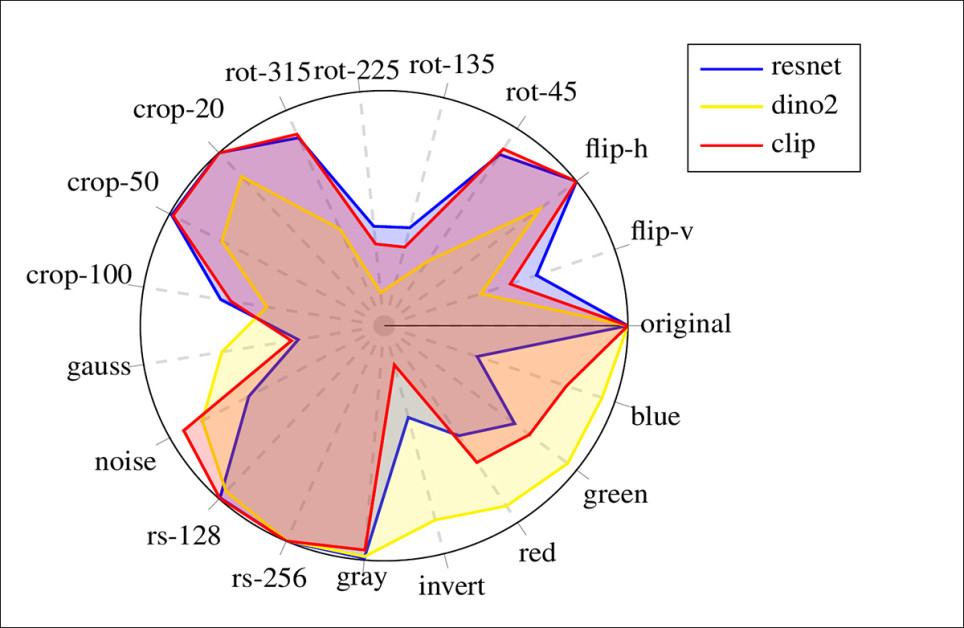

Per valutare quanto bene il metodo può rilevare le perdite quando le immagini sono state sottilmente alterato tramite ridimensionamento, ritaglio o simili trasformazioni non semantiche, gli autori hanno effettuato test su Flickr30k, selezionando casualmente 5,000 immagini come query e utilizzando l'intero set di dati come raccolta di riferimento.

Ogni immagine di query è stata trasformata prima di essere codificata (ovvero, sottoposta a una modifica non semantica come il ridimensionamento o il ritaglio) e quindi abbinata all'elemento più simile nella raccolta utilizzando la similarità del coseno; una corrispondenza è stata conteggiata solo se l'immagine originale è stata recuperata come risultato principale.

I tre encoder confrontati sono stati RESNET-152; DINOv2 ViT-B/14; e CLIP ViT-B/32.

Sono stati utilizzati quattro tipi di trasformazioni non semantiche delle immagini: geometriche (ribaltamenti e rotazioni); ritaglio (rimozione di 20, 50 o 100 pixel da ciascun bordo); pixelizzazione (sfocatura gaussiana, rumore aggiunto o downsampling a 128 o 256 pixel); e colore (scala di grigi, inversione o sovrapposizioni di rosso, verde o blu).

Dal materiale supplementare, esempi di trasformazioni applicate ai dati: routine tipiche anche nella pre-elaborazione dell'aumento dei dati.

Gli autori hanno poi testato la perdita nel recupero delle immagini:

Precisione del rilevamento delle perdite su 5,000 immagini di query Flickr30k sottoposte a varie trasformazioni non semantiche.

Tutti e tre i codificatori hanno ottenuto prestazioni perfette su immagini non alterate e CLIP è rimasto affidabile durante il ritaglio, i capovolgimenti orizzontali, il rumore e il ridimensionamento, superando ResNet nelle modifiche a livello di pixel e di colore.

DINOv2 ha mostrato una forte resilienza alle trasformazioni del colore (probabilmente grazie al suo design auto-supervisionato, secondo gli autori), ma è stato notevolmente più debole nelle modifiche geometriche e nel ritaglio, entrambi comuni nei set di dati duplicati.

Poiché LAION include già gli embedding CLIP e data la sua costante robustezza e velocità, CLIP è stato scelto come codificatore predefinito per l'analisi principale.

Perdite dure e morbide

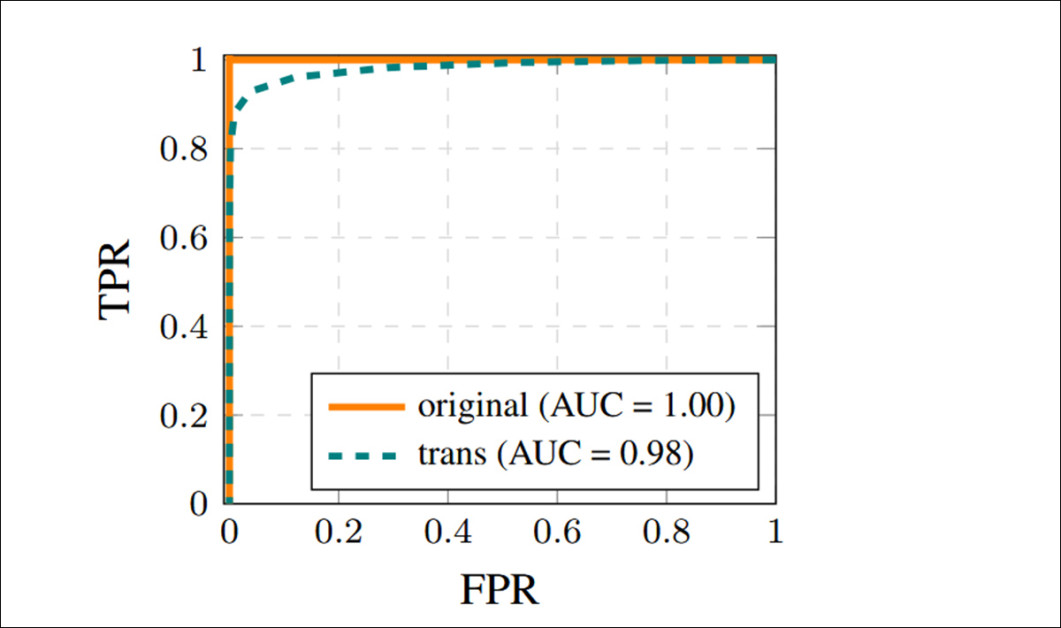

Le prestazioni sono state valutate su diverse soglie di similarità del coseno per distinguere tra immagini esatte e quasi duplicate (perdita dura e perdita morbida).

Per definire la perdita definitiva è stata selezionata una soglia pari a 0.98, che non determina falsi positivi e un rilevamento perfetto di immagini identiche.

Per la perdita di dati soft, è stata scelta una soglia di 0.95, che consente di recuperare un numero maggiore di quasi-duplicati mantenendo un tasso di falsi positivi prossimo allo zero. È stata data priorità alla precisione rispetto al richiamo e i risultati sono stati quindi stimati in modo conservativo:

Le curve caratteristiche operative del ricevitore sono state utilizzate per guidare la selezione di soglie rigide e flessibili per il rilevamento delle perdite. Elevati punteggi AUC in condizioni sia trasformate che non trasformate dimostrano che i quasi duplicati possono essere distinti in modo affidabile da immagini non correlate, anche in presenza di alterazioni minime.

Perdita intra-dataset

La perdita intra-dataset è stata calcolata identificando la sovrapposizione di immagini tra le suddivisioni di addestramento e valutazione all'interno dello stesso dataset. Sono stati considerati idonei solo i dataset con suddivisioni sia di benchmark che di addestramento o pre-addestramento, restringendo l'analisi a COCO, GCC, ImageNet, OpenImages e TextCaps.

Per COCO, il set di test è stato confrontato con il set di addestramento, il set di valutazione e i sottoinsiemi non etichettati, e il set di convalida con i sottoinsiemi di addestramento e non etichettati.

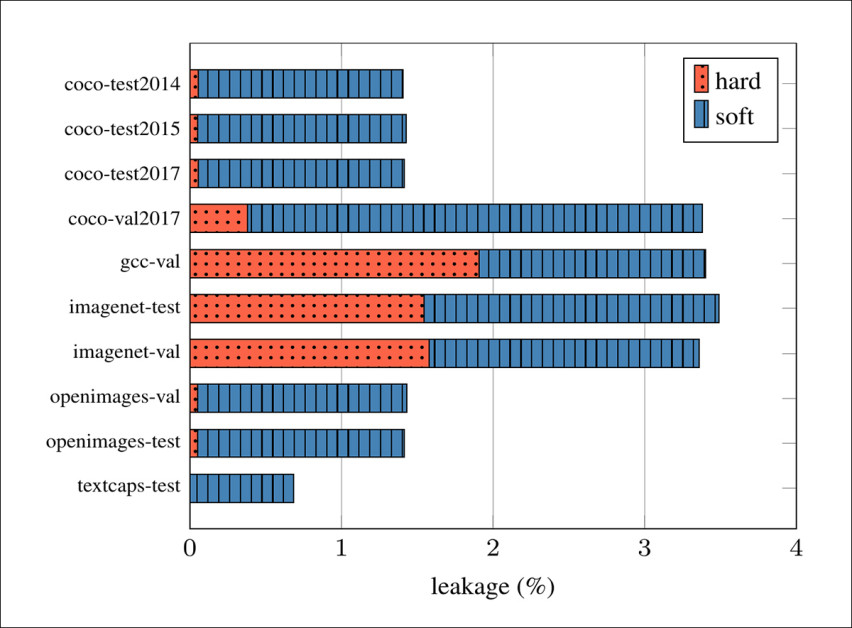

I tassi più elevati di perdite intra-dataset sono stati osservati nelle suddivisioni di test e convalida di ImageNet, con perdite hard che hanno raggiunto l'1.58% e perdite soft appena al di sotto del 2%. Seguono GCC e COCO, con COCO val2017 che ha mostrato una perdita soft del 3% e le sue suddivisioni di test comprese tra l'1.35% e l'1.38%. OpenImages ha mostrato una bassa perdita hard, pari allo 0.05%, ma la perdita soft ha superato l'1.3% sia nei set di test che in quelli di convalida. TextCaps ha mostrato la perdita complessiva più bassa, pari allo 0.69%, senza alcuna perdita hard rilevata:

Tassi di perdita intra-dataset, che mostrano la proporzione di ogni suddivisione di valutazione che si sovrappone ai dati di formazione associati.

Riguardo a questi risultati, gli autori affermano†:

"Questi risultati mostrano che la perdita intra-dataset si verifica in contro tutti i i set di dati analizzati, sia nel loro grado hard che soft.

"Dato che la perdita di dati può compromettere la valutazione del modello e che i set di dati sono progettati specificamente per questo scopo, la perdita intra-set di dati è un rischio che dal design non dovrebbe esistere.

"Tuttavia, abbiamo identificato molteplici casi in tutti i set di dati."

Perdita inter-dataset

Per misurare la perdita inter-dataset (in cui un modello viene addestrato su un dataset e valutato su un altro), sono stati utilizzati quattro dataset come fonti di dati di addestramento: Treno GCC, Treno ImageNet, Treno OpenImagese LAION.

Questi sono stati confrontati con i dati di valutazione tratti dalla divisione di test e convalida COCO 2014, Flickr30K, test TextCaps, divisione di test e convalida OpenImages e divisione di test e convalida ImageNet.

Gli embedding CLIP ViT-B/32 sono stati estratti per tutti i dataset, ad eccezione di LAION, che fornisce i propri embedding precalcolati. Tuttavia, poiché tali embedding differiscono leggermente da quelli generati utilizzando l'implementazione CLIP ufficiale, le immagini delle query sono state ridimensionate in base al metodo utilizzato nel repository di recupero delle clip per garantirne la compatibilità.

Il recupero è stato eseguito utilizzando una ricerca KNN, sebbene la scala di LAION richiedesse la partizione in blocchi da milioni di immagini, ciascuno dei quali indicizzato separatamente:

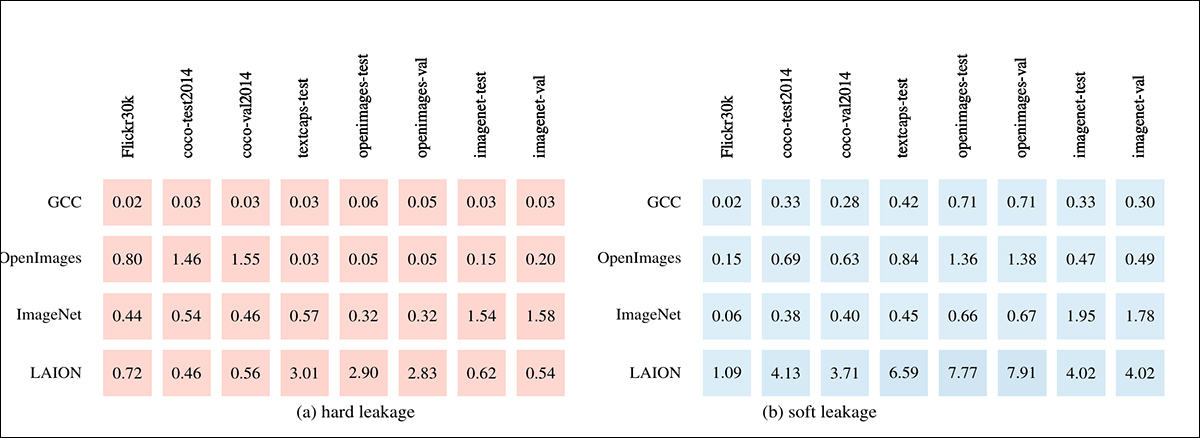

Perdita inter-dataset tra i dataset di riferimento (colonne) e i dataset di pre-addestramento (righe). Sul lato sinistro vediamo una perdita "hard" (immagini identiche) e sul lato destro una perdita "soft" (quasi duplicati).

Sono state osservate perdite tra set di dati diversi in tutti i set di dati di riferimento, con diversi gradi di gravità. LAION ha mostrato i tassi più elevati di perdite hard (immagini identiche), in particolare per i dati di test OpenImages e TextCaps, entrambi superiori al 3%. OpenImages ha anche contribuito in misura minore a perdite hard in COCO.

Sebbene meno grave, ImageNet conteneva ancora duplicati fisici da ogni benchmark esaminato; e GCC ha mostrato la perdita fisica complessiva più bassa, rimanendo al di sotto dell'1%.

La perdita soft (quasi duplicati) è stata più diffusa: LAION ha nuovamente prodotto i tassi più elevati, con una sovrapposizione fino al 7.9% per alcuni benchmark; OpenImages e TextCaps sono stati i benchmark più colpiti in generale; e Flickr30k ha mostrato la perdita minore.

Sebbene tali sovrapposizioni possano rappresentare solo una piccola parte dei set di valutazione, gli autori notano che la loro presenza può consentire memorizzazione e compromettono la validità del test:

Esempi di immagini trapelate. A sinistra sono riportati casi di "hard leakage", in cui le immagini sono identiche all'interno di un set di dati (in alto) o tra set di dati diversi (in basso); a destra, casi di "soft leakage", in cui le immagini sono visivamente quasi identiche.

Effetto sulla valutazione a valle

Il documento esamina poi in che modo la perdita di dati influisce sulle valutazioni a valle (vale a dire, le prestazioni su attività standard quando i modelli pre-addestrati vengono testati su benchmark che contengono dati di addestramento duplicati).

Sono stati presi in considerazione tre compiti: classificazione zero-shot; classificazione supervisionata; e recupero testo-immagine.

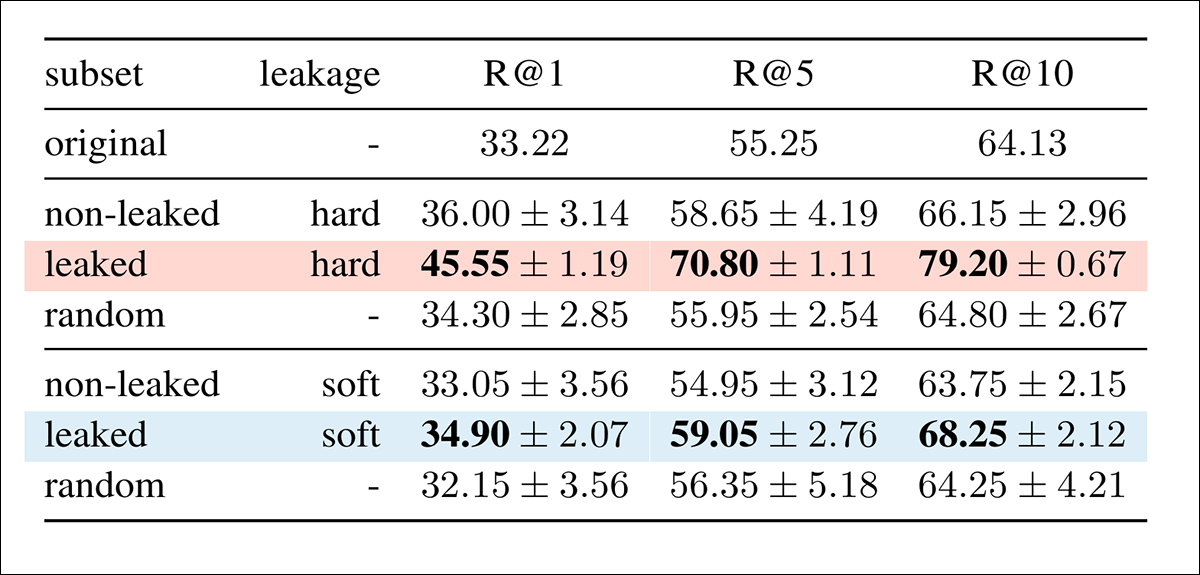

Per ogni attività, le prestazioni del modello sono state valutate su un set di dati di riferimento per il quale i campioni trapelati erano già stati identificati nei dati di pre-addestramento. I risultati sono stati confrontati su quattro sottoinsiemi: il benchmark completo; un sottoinsieme di campioni trapelati; un sottoinsieme di campioni non trapelati; e un sottoinsieme selezionato casualmente delle stesse dimensioni del gruppo trapelati (utilizzato come controllo).

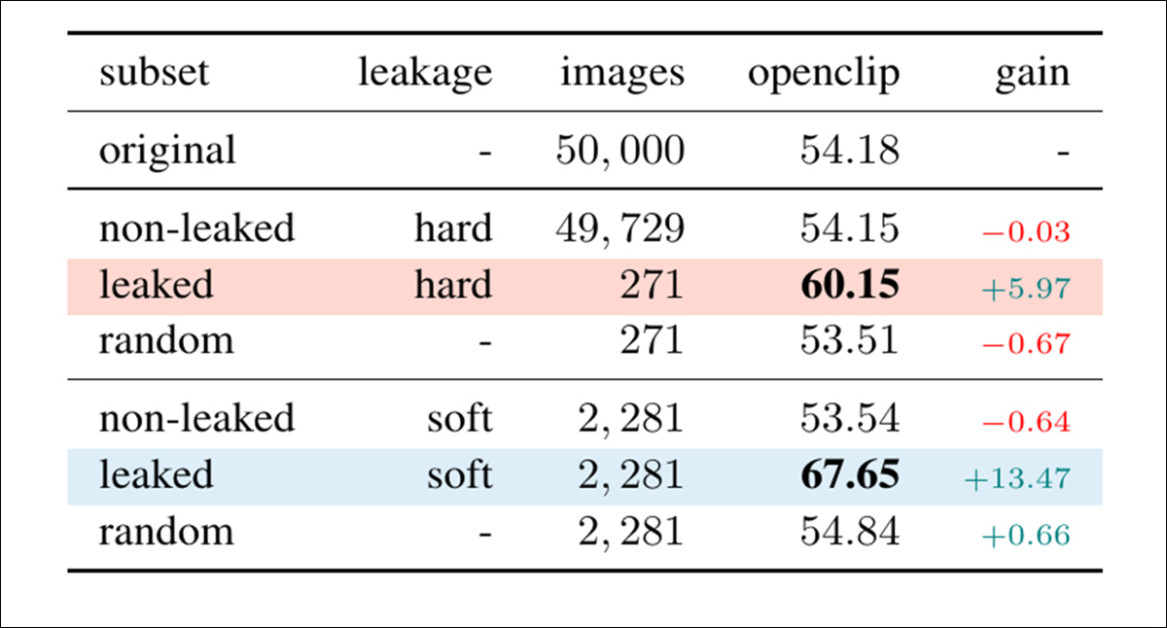

L'effetto della perdita di dati su tre attività downstream è stato misurato utilizzando sottoinsiemi di riferimento noti per contenere immagini trapelate. Nella classificazione zero-shot, un modello pre-addestrato su LAION ha ottenuto un'accuratezza notevolmente maggiore sulle immagini trapelate dal set di valutazione ImageNet, confermando che l'esposizione anche a quasi duplicati durante l'addestramento fornisce un vantaggio misurabile:

Accuratezza della classificazione "zero-shot" sul set di convalida ImageNet su sottoinsiemi con e senza perdite. L'ultima colonna riporta i guadagni di accuratezza rispetto al set completo, mentre le righe evidenziate corrispondono ai sottoinsiemi con perdite.

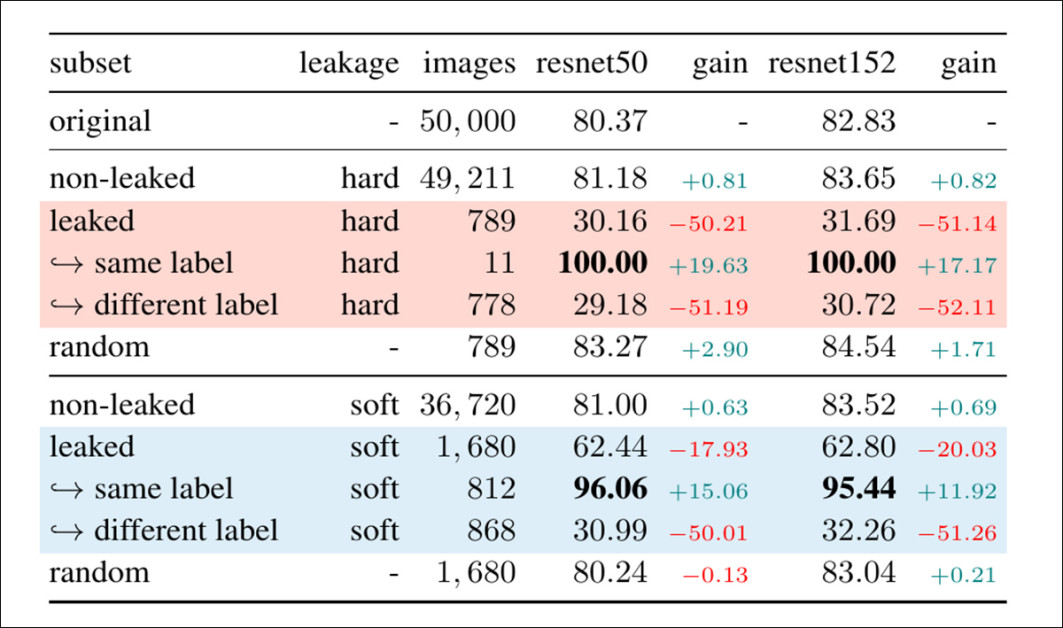

Per la classificazione supervisionata, la perdita in ImageNet ha causato un calo drastico delle prestazioni, a meno che l'immagine trapelata non avesse la stessa etichetta in entrambe le suddivisioni, nel qual caso il modello ha raggiunto una precisione quasi perfetta, rivelando un forte effetto di memorizzazione:

Accuratezza della classificazione supervisionata sul set di validazione ImageNet per sottoinsiemi, con e senza perdite. Le colonne di guadagno mostrano la variazione rispetto al set completo. I sottoinsiemi con perdite sono evidenziati.

Nel recupero da immagine a testo, le prestazioni sono migliorate nuovamente per i campioni trapelati, con perdite sia hard che soft che hanno portato a un richiamo più elevato e con i sottoinsiemi trapelati che hanno prodotto risultati più coerenti tra le esecuzioni:

Prestazioni di recupero da immagine a testo su Flickr30k su sottoinsiemi con e senza perdite, con i sottoinsiemi con perdite evidenziati.

Gli autori concludono:

"Nel complesso, [mostriamo] prove coerenti del fatto che la perdita rappresenta una seria minaccia per la corretta valutazione dei modelli nei set di dati visivi, compromettendo uno dei principi più fondamentali dell'apprendimento automatico: non valutare i modelli sui loro dati di addestramento".

Conclusione

Un aspetto sconvolgente del documento, sebbene non sia una novità, è il resoconto della necessità di utilizzare CLIP per ottenere incorporamenti per la vasta montagna di dati di immagini in LAION, che rappresentano una scala che non può più essere affrontata in nessun altro modo se non in modo aggregato, trattando metadati tokenizzati invece delle caratteristiche più dettagliate che possono essere ispezionate quando un set di dati è più gestibile.

È un esempio lampante di quanto la formazione di modelli di linguaggio visivo abbia decisamente superato i limiti e le capacità della supervisione umana, o di qualsiasi tipo di selezione manuale che vada oltre i sottocampioni rappresentativi.

* Forse in modo un po' confuso, il problema della duplicazione è definito nel documento come "perdita".

† Enfasi degli autori.

Prima pubblicazione martedì 26 agosto 2025