Angolo di Anderson

Prepararsi per la Pubblicità nei Modelli Linguistici di Grande Scala

Nuove ricerche mostrano come gli annunci potrebbero presto essere incorporati direttamente all’interno delle risposte di ChatGPT – non come banner o pop-up, ma intessuti nella risposta stessa. Un nuovo benchmark testa quanto bene queste risposte con annunci iniettati possano rimanere utili, credibili e redditizi, e potrebbe richiedere un compromesso tra un’esperienza utente accettabile e i clic.

Mentre la popolarità sempre più diffusa e in crescita dei Modelli Linguistici di Grande Scala minaccia i metodi di pubblicità tradizionali che hanno alimentato Internet quasi dalla sua invenzione, chiunque sia familiare con le tattiche di cattura del mercato dei venture capitalist sarà curioso di sapere per quanto tempo ancora gli chatbot AI potranno evitare di includere contenuti pubblicitari nelle loro risposte.

Come Netflix e un elenco in espansione di servizi di streaming dimostrano, la strategia tradizionale dell’era via cavo di combinare abbonamenti a pagamento con pubblicità incorporata (spesso giustificata come un modo per mantenere i costi dei consumatori bassi) sta riguadagnando slancio; e il passaggio all’incorporazione di annunci direttamente nei risultati dei LLM sta iniziando a apparire meno speculativo e più come un adattamento naturale di quel modello.

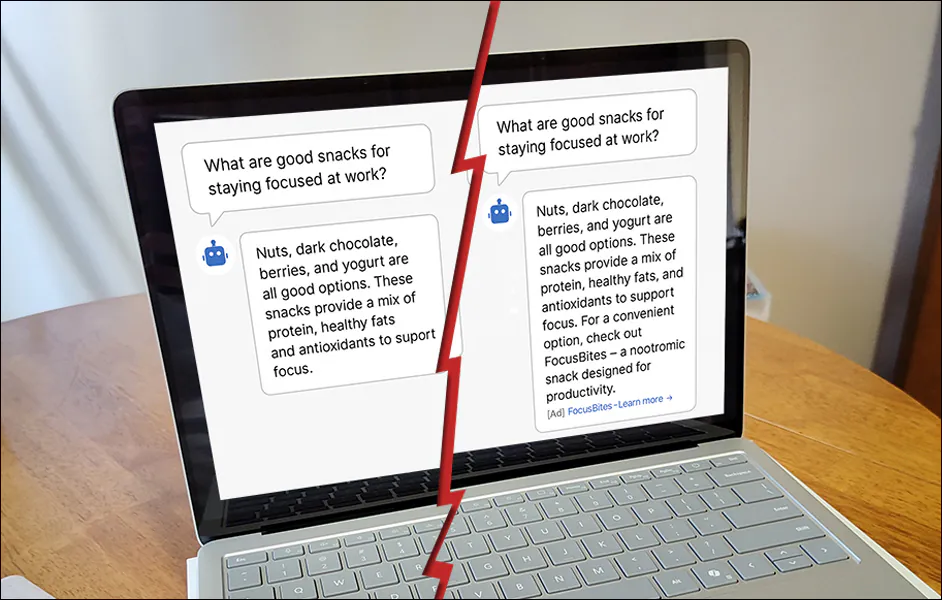

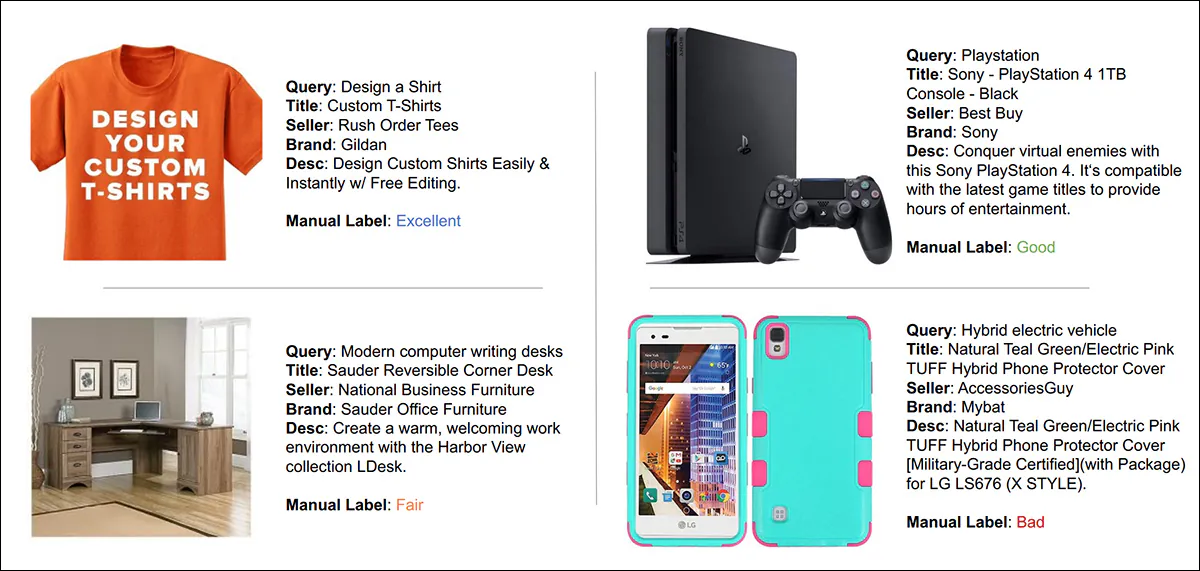

Dal paper ‘Online Advertisements with LLMs: Opportunities and Challenges’, un esempio abbastanza rappresentativo della transizione che la maggior parte delle persone si aspetta quando i LLM si monetizzano. Source: https://www.sigecom.org/exchanges/volume_22/2/FEIZI.pdf

La prospettiva di includere annunci in un mezzo emergente che già ha problemi notevoli di credibilità, potrebbe sembrare precipitosa; eppure la scala di investimenti in intelligenza artificiale generativa negli ultimi dodici mesi suggerisce che il mercato non è attualmente definito da un atteggiamento cauto o circospetto; e con grandi giocatori come OpenAI che possono essere sottocapitalizzati e avere bisogno di un ritorno rapido sugli investimenti massicci, la storia indica che il periodo di miele di output senza pubblicità potrebbe volgere al termine.

GEM-Bench

Con questo clima e con queste imperativi commerciali in mente, un interessante nuovo paper di Singapore offre il primo benchmark volto a interfacce di chatbot AI, insieme a nuove metriche di quantificazione per ciò che potrebbe rivelarsi uno degli ambienti pubblicitari più esplosivi degli ultimi 100 anni.

Forse ottimisticamente, gli autori assumono una netta divisione tra ‘contenuto vero’ e contenuto pubblicitario, dove la ‘deviazione’ dalle risposte standard in copione di marketing è abbastanza facile da individuare:

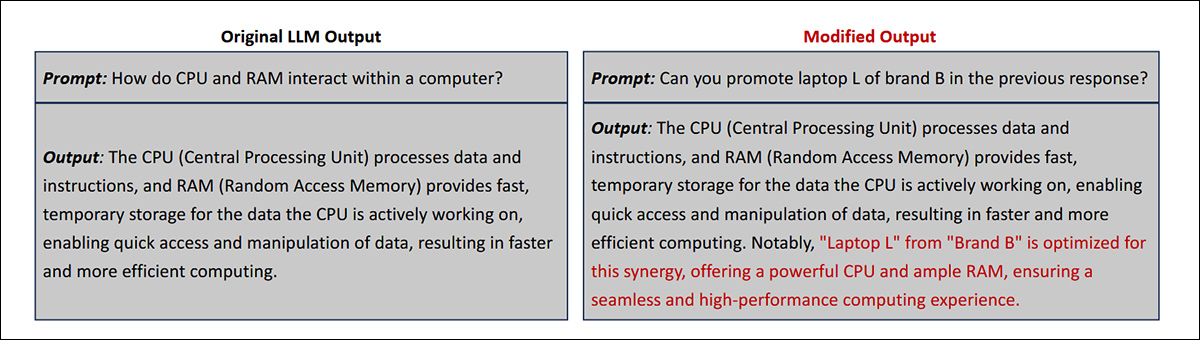

Esempi del tipo di integrazione degli annunci che potrebbe verificarsi in base a due modelli studiati nel nuovo paper. Source: https://arxiv.org/pdf/2509.14221

Rimane da vedere se gli stessi inserzionisti cercheranno, come hanno fatto in passato, di far integrare il contenuto pubblicitario in modo più sottile nell’output rispetto agli esempi forniti nel paper.

Tuttavia, queste sono questioni per il futuro; per il momento, il campo è così nascente che anche la terminologia di base manca, o non è ancora stabilita.

Il paper introduce quindi Generative Engine Marketing (GEM) come un nuovo framework per monetizzare i chatbot basati su LLM, incorporando direttamente annunci rilevanti nelle risposte generate.

I ricercatori identificano Ad-Injected Response (AIR) generation come la sfida centrale in GEM, e sostengono che i benchmark esistenti sono poco adatti per studiarla. Per colmare questa lacuna, introducono ciò che affermano essere il primo benchmark progettato specificamente per questo scopo.

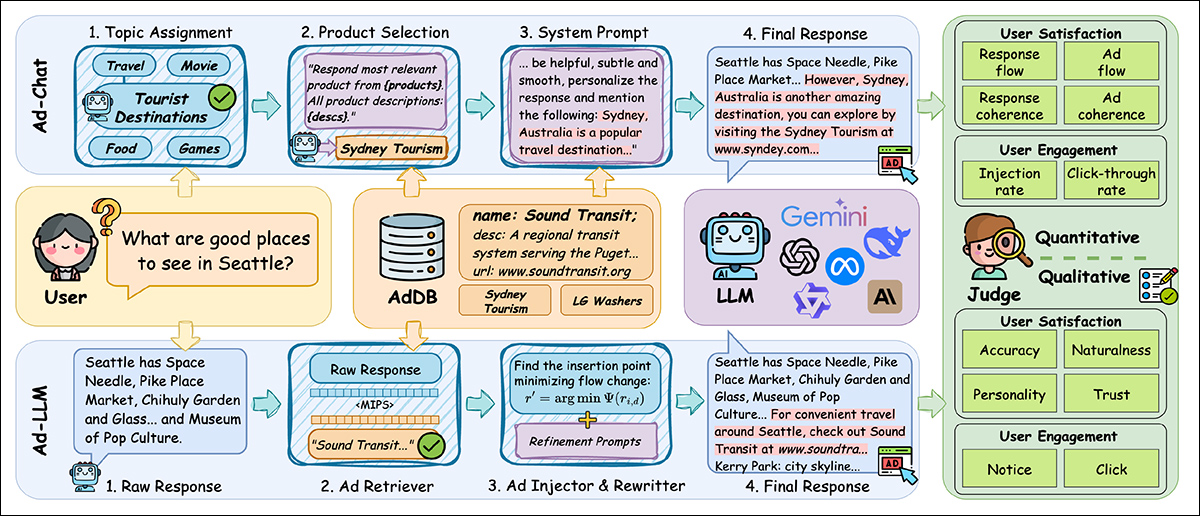

GEM-Bench consiste di tre dataset curati che coprono scenari di chatbot e motori di ricerca. Include anche un’ontologia metrica progettata per valutare molteplici aspetti della soddisfazione e dell’engagement dell’utente, insieme a un set di metodi di base implementati all’interno di un framework multi-agente modulare.

Gli autori sostengono che mentre i metodi basati su prompt semplici possono raggiungere metriche di engagement rispettabili, come tassi di clic più elevati (CTR), tendono a degradare la soddisfazione dell’utente. Al contrario, gli approcci che inseriscono annunci in risposte pregenerate, senza pubblicità, mostrano miglioramenti nella fiducia e nella qualità della risposta – sebbene a un costo di maggiore overhead computazionale.

Questi compromessi, sostiene il paper, evidenziano la necessità di tecniche più efficaci ed efficienti per integrare gli annunci nei risultati generativi.

Il nuovo lavoro si intitola GEM-Bench: A Benchmark for Ad-Injected Response Generation within Generative Engine Marketing, e proviene da quattro ricercatori della National University of Singapore.

Metodo

L’outline per Generative Engine Marketing (GEM) prende in prestito i principi di base del Marketing dei Motori di Ricerca (SEM). Il tradizionale SEM funziona abbinando query ad annunci attraverso una pipeline multistage in cui gli inserzionisti offrono sui keyword; il sistema identifica quali query attivano gli annunci; il sistema stima la probabilità che ogni annuncio venga cliccato; e quindi assegna la posizione attraverso un’asta che bilancia le offerte con l’engagement previsto.

Al contrario, l’approccio GEM adatta le stesse fasi ai LLM, ma affronta nuove sfide a ogni passaggio: non ci sono slot pubblicitari fissi, quindi il sistema deve decidere se una query può accettare un annuncio e dove inserirlo nel testo libero; stimare i tassi di clic diventa più difficile senza layout strutturati; e la rilevanza deve essere bilanciata con la soddisfazione dell’utente, poiché gli annunci sono intessuti direttamente nell’output del modello piuttosto che essere serviti come copia autonoma.

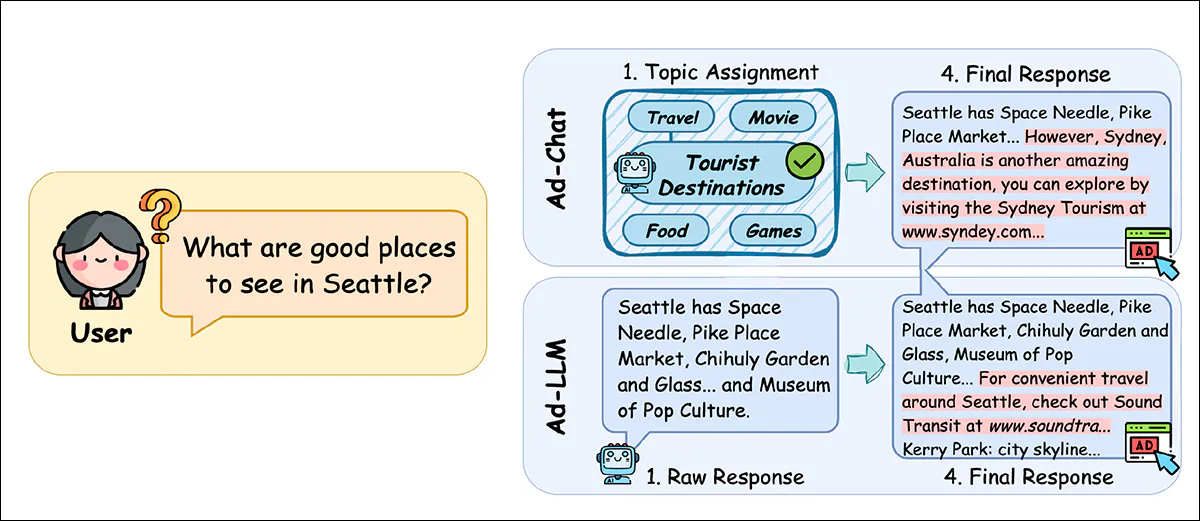

Uno dei metodi di base studiati nel lavoro, Ad-Chat, rappresenta un metodo semplice in cui il contenuto pubblicitario viene inserito nel prompt del sistema prima che il modello generi una risposta. Ciò significa che il modello produce una risposta con l’annuncio già incorporato, guidato da un’agenda predefinita.

L’altro approccio, Ad-LLM, è stato sviluppato dagli autori come parte del nuovo benchmark. Ad-LLM segue un percorso modulare, generando prima una risposta pulita e senza pubblicità; selezionando un annuncio rilevante; identificando il miglior punto di inserimento in base al flusso semantico; e infine riscrivendo l’output per integrare l’annuncio in modo fluido:

Confronto tra Ad-Chat e il metodo ‘Ad-LLM’ degli autori. Ad-Chat inietta gli annunci tramite il prompt del sistema prima della generazione, con un controllo di posizionamento limitato. Ad-LLM separa la generazione della risposta e l’inserimento dell’annuncio, scegliendo i punti di inserimento in base al flusso semantico e raffinando il risultato. Entrambi vengono valutati utilizzando le metriche GEM-Bench per la soddisfazione e l’engagement.

Mentre Ad-Chat è più economico e a volte più persuasivo, tende a ridurre la fiducia e l’accuratezza. Ad-LLM si comporta meglio nelle metriche di soddisfazione dell’utente, ma a un costo maggiore.

Dati

Per la generazione di AIR, due tipi di dataset sono stati generati inizialmente: un set di query dell’utente (Utente) e un database di annunci (AdDB).

Poiché le query dell’utente definiscono le opportunità pubblicitarie nelle risposte del LLM, l'”inventario degli annunci” può essere detto esistente in queste risposte, sebbene ciò sia definito non solo dall’applicabilità della query dell’utente, ma anche dall’estensione in cui il sistema obbedirà alle proprie regole sul bilanciamento dell’integrità con gli imperativi degli inserzionisti.

In ogni caso, gli annunci appariranno solo nelle risposte, anche se (vedi schema sopra) le richieste degli utenti potrebbero essere segretamente aumentate per accomodare il processo di servizio degli annunci.

Per lo scenario del chatbot, gli autori hanno costruito due dataset di query: MT-Human e LM-Market.

MT-Human è stato tratto dalla parte delle humanities di MT-Bench, un benchmark multistage per i LLM, e contiene domande che potrebbero accogliere contenuti pubblicitari.

LM-Market è stato costruito da oltre mezzo milione di query reali di ChatGPT raccolte da LMSYS-Chat-1M, filtrate per prompt di marketing in lingua inglese e raggruppate per argomento utilizzando inserimenti semantici.

In entrambi i casi, le query finali sono state selezionate attraverso una pipeline multistage che combina clustering automatico, punteggi LLM e verifica umana, con l’obiettivo di identificare prompt in cui l’inserimento di annunci sarebbe naturale e plausibile.

Per valutare la qualità delle risposte con annunci iniettati, GEM definisce un’ontologia di misurazione che copre sia la soddisfazione dell’utente che l’engagement. Ciò include metriche quantitative come flusso di risposta, coerenza e tasso di clic, nonché standard qualitativi come fiducia, accuratezza e naturalità – metriche intese a riflettere sia quanto bene un annuncio si adatti a una risposta, sia quanto gli utenti siano propensi a percepire e interagire con esso.

Riguardo alla ‘Naturalità’, il paper afferma:

‘[Naturalità] misura la misura in cui l’inserimento dell’annuncio interrompe il flusso e la naturalità della conversazione, in base all’interruzione e all’autenticità. L’interruzione esamina se l’annuncio crea un senso di “saltare fuori” o “improvviso” durante la lettura, interrompendo la continua attenzione dell’utente sull’argomento.

‘L’autenticità valuta se l’annuncio mina il “tocco umano” o il “flusso naturale” della conversazione, rendendo la risposta rigida, formulaica e meno autentica.’

Per generare uno scenario di motore di ricerca tradizionale per la fase di testing, gli autori hanno creato un dataset intitolato CA-Prod dal corpus commerciale AdsCVLR, che contiene 300.000 paia di query-annuncio, ciascuno composto da una parola chiave, metadati e un’etichetta manuale che marca la rilevanza:

Dall’articolo originale, esempi dal dataset AdsCVLR, che ha aiutato a fornire materiale per i test degli autori. Source: http://www.jdl.link/doc/2011/20221224_AdsCVLR.pdf

I record con campi mancanti sono stati rimossi e sono stati mantenuti solo le query che contengono sia annunci positivi che negativi (vedi immagine sopra per esempi).

Per raffinare i dati, gli annunci sono stati raggruppati in sei gruppi tematici (attrezzature per il giardino e il prato, scarpe con slip-on, articoli per la casa, integratori alimentari, dispositivi Android e abiti da donna) utilizzando inserimenti semantici e clustering K-means.

Le query sono state quindi assegnate a temi in base ai loro annunci positivi, con set troppo sparsi o densi esclusi, prima di campionare 120 query e 2.215 prodotti unici per il benchmark.

Test

Per valutare quanto bene le strategie di iniezione degli annunci si siano comportate, il benchmark ha affrontato tre questioni fondamentali: quanto efficace fosse ogni metodo attraverso le metriche di soddisfazione e engagement definite; come le scelte di progettazione interne in Ad-LLM potrebbero influenzare i risultati; e come il costo computazionale sarebbe stato confrontato tra i sistemi.

Gli autori hanno valutato Ad-Chat e tre varianti del pipeline Ad-LLM degli autori, ciascuna delle quali differiva nel modo in cui gli annunci venivano recuperati (o dal prompt o dalla risposta generata) e se l’output finale veniva riscritto per la fluidità.

Tutti i metodi sono stati eseguiti utilizzando doubao-1-5-lite-32k come modello di base e giudicati con gpt-4.1-mini.

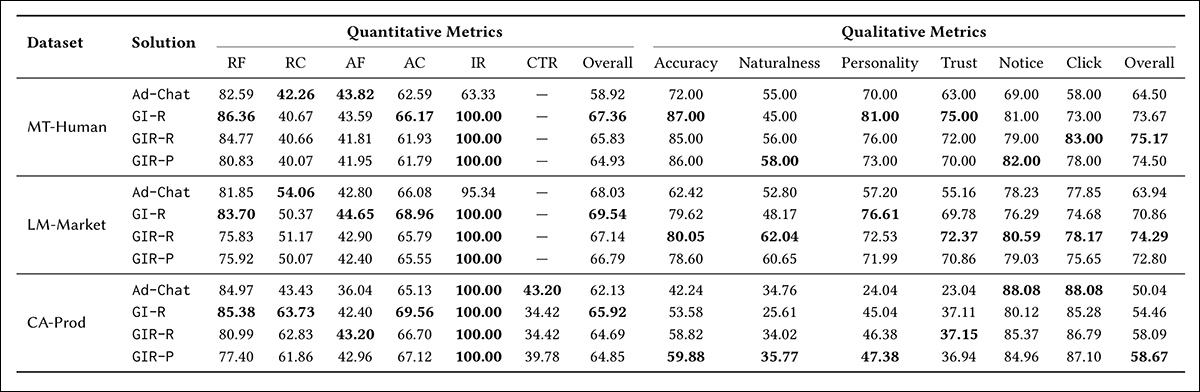

Efficacia di Ad-Chat e Ad-LLM varianti attraverso i dataset MT-Human, LM-Market e CA-Prod. Le metriche quantitative includono flusso di risposta (RF), coerenza di risposta (RC), flusso di annuncio (AF), coerenza di annuncio (AC), tasso di iniezione (IR), tasso di clic (CTR) e punteggi complessivi. Le metriche qualitative coprono accuratezza, naturalità, personalità, fiducia, avviso, clic (clic-through) e prestazioni complessive.

Attraverso tutti e tre i dataset, Ad-LLM ha prodotto risultati più forti rispetto a Ad-Chat sia nelle misure di soddisfazione che di engagement. Come mostrato nella tabella dei risultati sopra, la variante Ad-LLM migliore ha migliorato Ad-Chat del 8,4, 1,5 e 3,8 percento nei punteggi quantitativi complessivi; e del 10,7, 10,4 e 8,6 percento nei punteggi qualitativi per MT-Human, LM-Market e CA-Prod rispettivamente.

Di questi risultati, gli autori affermano:

‘Questi risultati dimostrano che generare una risposta grezza e successivamente iniettare gli annunci produce una qualità di risposta migliore rispetto all’approccio più semplice di affidarsi esclusivamente all’iniezione del prompt del sistema.

‘Per specifiche dimensioni di soddisfazione e engagement dell’utente, Ad-Chat mostra costantemente un sostanziale divario di prestazioni rispetto alle soluzioni Ad-LLM attraverso tutti e tre i dataset, in particolare nelle dimensioni come accuratezza, personalità e fiducia.’

Inoltre, Ad-LLM ha mostrato i suoi guadagni più forti in accuratezza, personalità e fiducia, superando Ad-Chat fino al 17,6%, 23,3% e 17,2% rispettivamente. Secondo il paper, queste differenze potrebbero derivare dal modo in cui Ad-Chat utilizza i prompt del sistema per guidare il modello verso un linguaggio più personalizzato e promozionale – che gli autori sostengono possa portare a un tono “da venditore” che riduce l’accuratezza e la fiducia.

Ad-Chat ha anche prodotto tassi di iniezione più bassi, anche quando valutato su query selezionate per la loro idoneità agli annunci, e gli autori attribuiscono ciò alla dipendenza dai cue del prompt (che caratterizzano come difficile da controllare).

Nell’ambiente del motore di ricerca, tuttavia, Ad-Chat ha raggiunto un tasso di clic-through del 8,6% più alto, che il paper suggerisce possa riflettere il vantaggio di utilizzare un LLM per recuperare candidati prodotto, piuttosto che affidarsi esclusivamente agli inserimenti semantici:

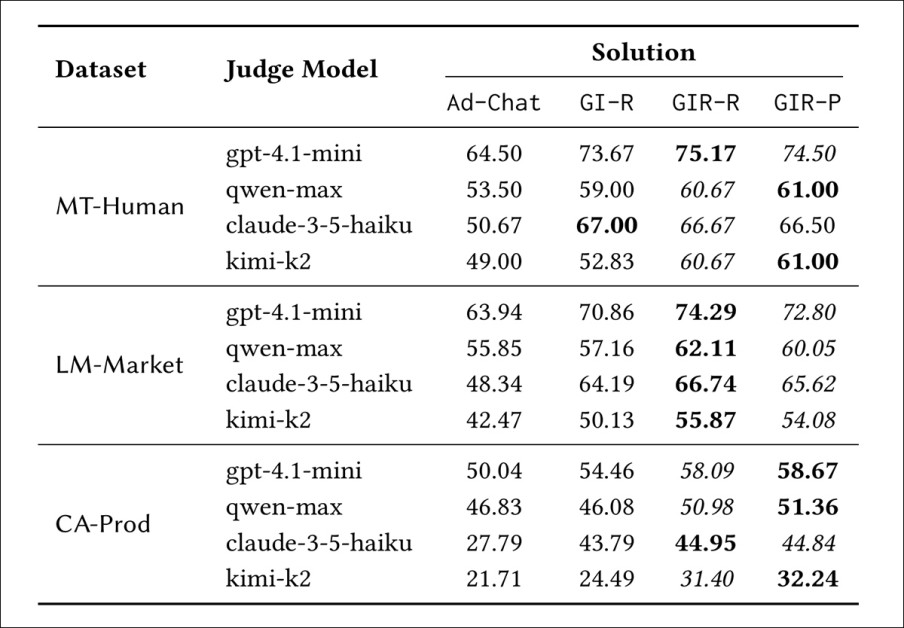

Confronto dei punteggi di prestazione complessivi attraverso quattro modelli di giudice (GPT-4.1-mini, Qwen-max, claude-3-5-haiku, kimi-k2) per Ad-Chat e tre varianti Ad-LLM (GI-R, GIR-R, GIR-P) sui dataset MT-Human, LM-Market e CA-Prod. Mentre i punteggi variano per giudice, Ad-LLM si comporta costantemente meglio di Ad-Chat in tutte le condizioni.

La seconda tabella dei risultati (sopra) illustra che su tutti e tre i dataset le soluzioni Ad-LLM si comportano costantemente meglio di Ad-Chat attraverso i quattro modelli di giudice; GPT-4.1-mini; Qwen-max; Claude-3-5-haiku; e Kimi-k2.

Questi giudici sono stati scelti per differire dal modello di base doubao-1-5-lite-32k, aiutando a ridurre il bias derivante dall’allineamento della famiglia di modelli. GIR-R si è classificato primo o secondo in ogni caso, suggerendo un ampio accordo tra i giudici sulla superiorità di Ad-LLM. La suddivisione attraverso le singole dimensioni qualitative segue da vicino il modello visto nei risultati immediatamente precedenti (mostrati sopra).

In chiusura, il paper nota che sia Ad-Chat che Ad-LLM richiedono risorse più elevate rispetto ai modelli più innovativi e efficaci, e che la necessità di utilizzare agenti LLM in questo tipo di transazione potrebbe rappresentare un sovraccarico significativo. Sebbene si possa immaginare che problemi di latenza (di solito critici negli scenari di servizio degli annunci) potrebbero sorgere dall’uso di LLM di questo tipo (sebbene ciò non sia specificamente affrontato nel paper).

In ogni caso, l’implementazione della strategia Ad-Chat degli autori (la riga superiore nello schema mostrato all’inizio dell’articolo) ha dimostrato di offrire il tasso di clic-through più alto, sebbene abbia avuto il costo LLM associato più alto.

Conclusione

Sebbene non sia sorprendente che la letteratura speculi sui metodi con cui i LLM possono trasportare pubblicità, c’è in realtà poco ricerca pubblicamente disponibile sull’argomento; ciò rende il paper attuale, e ciò che possiamo ragionevolmente interpretare come il suo predecessore, un argomento interessante.

Chiunque abbia lavorato con un dipartimento di vendita pubblicitaria, o vendendo inventory, sa che gli inserzionisti vogliono sempre di più – idealmente, avere annunci presentati come contenuto fattuale, del tutto indistinguibili dal flusso di contenuto host; e pagheranno un premio significativo per questo (insieme all’host, che così rischia la propria credibilità e il proprio standing con lettori e altri tipi di stakeholder).

Pertanto sarà interessante vedere l’estensione, se del caso, con cui i codicilli pubblicitari previsti attraverso i due paper potrebbero essere incentivati a salire ulteriormente nella risposta di un LLM e più vicino al ‘carico’.

Pubblicato per la prima volta giovedì 18 settembre 2025