Angolo di Anderson

Prova Virtuale di Nuovi Abiti Attraverso l’AI

Un modello di intelligenza artificiale può ora trasformare una singola foto e immagini di abbigliamento in un video in movimento di una persona che indossa nuovi outfit, evitando i glitch comuni nei sistemi a due fasi più vecchi.

La categoria ‘prova virtuale’ (VTON) nella ricerca di visione computerizzata è tra le più finanziate e prolifiche nella letteratura – principalmente perché, come si può desumere dalle frequenti collaborazioni industria/accademia pubblicate ogni anno, questo obiettivo riceve un finanziamento significativo da parte dell’industria della moda ben finanziata:

Dal paper ‘Image-Based Virtual Try-On: A Survey’, esempi di tipi di rappresentazione della persona e alcune delle fasi di filtraggio e raffinamento che anche le immagini base devono attraversare per una prova virtuale (VTON). Fonte

Esistono molte varianti dell’obiettivo, come ad esempio estrarre abiti dalle immagini di persone, e adattare la figura più piena quando necessario. Alcuni sistemi basati su immagini sono stati implementati commercialmente, su piattaforme come veesual.ai, wanna.fashion e fashn.ai.

Per quanto riguarda i video, l’app sperimentale Doppl di Google Labs ha sperimentato questa funzionalità, lanciata l’estate scorsa:

Premere per riprodurre se il video non si riproduce automaticamente. Estratti dal progetto di prova virtuale video abbandonato di Google Doppl. Fonte

Tuttavia, Doppl si chiude ad aprile 2026 dopo una accoglienza tiepida, con gli utenti ora indirizzati al servizio di prova virtuale solo per immagini della società †:

Programma di prova virtuale solo per immagini di Google, dove gli utenti vengono indirizzati dalla piattaforma Doppl abbandonata della società. Fonte

Sebbene ci siano alcune piattaforme che offrono prova virtuale con video, nessuna di esse sembra essere affiliata a un outlet reale; e sono tutte prodotti ‘bleeding edge’, marginali (e spesso ‘discutibili’) che offrono token.

Mentre ci sono alcune incursioni interessanti dal settore della ricerca, sono tradizionalmente architetture complesse che sono difficili da implementare per bassa latenza e alta qualità:

Premere per riprodurre se il video non si riproduce automaticamente. Dal progetto Fashion-VDM del 2024, un esempio di trasferimento di abiti ‘headless’. Fonte

La verità è che il compito di conformare gli abiti a una persona reale, senza distorcere né gli abiti né la persona, mantenendo allo stesso tempo un qualche tipo di moto dimostrativo utile (che accuratamente mostra la parte posteriore del prodotto quando la persona si gira), è una sfida formidabile per lo stato attuale dell’arte.

Vanast

È una sfida che un nuovo paper della Corea sta cercando di affrontare, utilizzando una soluzione completamente integrata per l’analisi degli abiti + persona + movimento:

Premere per riprodurre se il video non si riproduce automaticamente. Esempi dal sito dei materiali supplementari del progetto Vanast. Fonte

Il nuovo sistema, intitolato Vanast, sfrutta un set di dati personalizzato che presenta l’integrazione e l’orchestrazione di tutti e tre i fattori necessari per raggiungere l’obiettivo: gli abiti; la persona; e il movimento:

Premere per riprodurre. Altri esempi dal sito del progetto Vanast.

Il sistema sfrutta framework diversi come Flux, Qwen e ChatGPT, per generare un set di dati ‘triplet’ in grado di informare un’architettura end-to-end:

Dal nuovo paper, esempi dei punti di dati del set di dati utilizzati per la generazione e l’addestramento. Fonte –

Il nuovo paper è intitolato Vanast: Prova Virtuale con Animazione di Immagini Umane tramite Supervisione di Triplet Sintetico, e proviene da quattro ricercatori dell’Università Nazionale di Seoul. C’è anche un sito del progetto con molti video.

Metodo

L’obiettivo dichiarato degli autori in questo lavoro è quello di fondere i tre aspetti sopra menzionati in un’unica fase – non solo perché il processo sarebbe discreto, ma anche perché dà ai vari aspetti più opportunità di intrecciarsi e interagire durante l’addestramento, con l’obiettivo di una generazione più coesa:

Vanast combina una singola foto di una persona, immagini di abbigliamento separate e un video di riferimento per il movimento per generare una sequenza in movimento in cui la stessa persona indossa il nuovo outfit, con la guida della posa che assicura un movimento coerente mentre l’identità e i dettagli dell’abito vengono preservati tra i frame.

Per raggiungere questo obiettivo, il sistema prende immagini degli articoli di abbigliamento di destinazione; una foto della persona che indossa abiti diversi; un video di riferimento per il movimento che definisce come la persona dovrebbe muoversi; e un prompt di testo che descrive l’azione e l’ambientazione; e produce una sequenza video completa in cui la stessa persona appare indossare il nuovo outfit, mentre segue il movimento impostato, con ogni frame mantenuto coerente nel tempo.

Invece di separare il vestirsi e l’animazione in fasi diverse – che è stato l’approccio nella maggior parte dei lavori precedenti simili – Vanast gestisce abiti, identità e movimento insieme in un unico processo, consentendo a questi elementi di interagire durante la generazione e riducendo i tipi di mismatch e instabilità evidenziati nei metodi precedenti.

Set di dati

L’addestramento per il progetto si basa su esempi accoppiati di un’immagine di una persona, gli articoli di abbigliamento corrispondenti e un video della persona che si muove indossando quegli abiti, con il movimento estratto utilizzando un’architettura precedente, per fornire una guida della posa stabile tra i frame.

In assenza di un set di dati pubblicamente disponibile che soddisfi i requisiti del progetto, i dati sono stati raccolti da piattaforme di shopping online (non specificate), fornendo una cache di video con abbigliamento diverso. Tuttavia, il compito ha richiesto video della stessa persona che indossa più outfit, che è una rarità nei dati selvaggi, e che ha richiesto la creazione di dati sintetici.

Il processo a tre fasi ha comportato la selezione di frame candidati adatti dai video raccolti, gestiti tramite il modello di linguaggio e visione Qwen2.5-VL (VLM), con un’adeguata ritagliazione e valutazione della idoneità (ad esempio, nessuna occlusione, soggetto nella posizione corretta, ecc.); e la creazione di maschere di inpainting adeguate per isolare le aree interessate – che (in linea con il lavoro precedente PERSE) è gestito dal modello di diffusione SDXL ormai consolidato.

Panoramica della pipeline Vanast, dove un’immagine di una persona, immagini di abbigliamento di destinazione e un video di guida del movimento vengono codificati e elaborati in un modello di diffusione video unificato. Il sistema genera un’animazione che preserva l’identità, segue la sequenza della posa e applica gli abiti di destinazione, mentre la generazione di triplet sintetici supporta l’addestramento, e un design a doppio modulo separa l’animazione dal trasferimento dell’abito, per mantenere la coerenza.

Nella terza fase, Qwen svolge nuovamente il suo dovere per classificare le immagini per genere, e il framework di diffusione di immagini Flux viene utilizzato per creare alterazioni degli abiti in un’immagine (poiché Flux è in grado di combinare più elementi di input). I prompt di testo per l’inpainting sono stati curati da ChatGPT (versione non specificata).

Per aumentare ulteriormente la diversità della posa e dello sfondo, è stata introdotta una pipeline per costruire triplet di addestramento da video in situ, utilizzando il set di dati HumanVid. Lo stesso processo è stato utilizzato per generare l’immagine dell’identità preservata.

Poiché non esiste un’immagine di abito autonoma in questi video, le immagini degli abiti sono state sintetizzate direttamente dal filmato. I frame sono stati campionati da ogni video, e Qwen è stato utilizzato per valutarli per visibilità frontale, prima di selezionare il candidato più adatto, in base alla visibilità del corpo intero, chiarezza dell’immagine, minima occlusione, qualità dell’illuminazione e composizione generale.

Una regione di abbigliamento superiore è stata quindi estratta utilizzando SegFormer, e lo sfondo è stato rimosso per isolare l’abito.

Per evitare bias posizionale, la regione dell’abito è stata spostata casualmente all’interno della sua casella delimitante, e Qwen è stato utilizzato nuovamente per filtrare le segmentazioni non affidabili. Questo processo ha prodotto immagini di abiti sintetici accoppiate con movimento e identità, consentendo la costruzione di triplet su larga scala a partire da dati video non strutturati, migliorando allo stesso tempo la robustezza in condizioni del mondo reale variate.

Architettura

È stata introdotta un’architettura a doppio modulo per affrontare la lenta convergenza e il debole equilibrio di controllo osservati in quei metodi precedenti che avevano cercato di fondere tutte le condizioni. L’approccio ha sfruttato il trasformatore di diffusione video-testo da Wan, e ha anche attinto al progetto VACE (vedi sotto).

Il modello è stato diviso in un Modulo di Animazione Umana (HAM), che gestisce il movimento e l’identità dagli input umani e di posa; e un Modulo di Trasferimento dell’Abito (GTM), che gestisce gli abiti dalle immagini degli abiti. Entrambi condividono l’accesso al backbone, mentre integrano le funzionalità in modo distribuito e a cascata, per migliorare la condizionamento.

L’addestramento è stato eseguito congelando il backbone e ottimizzando solo i parametri di HAM e GTM, con i loro contributi bilanciati durante l’integrazione delle funzionalità. Gli input del set di dati triplet sintetico sono stati convertiti in rappresentazioni latenti utilizzando il variational autoencoder (VAE) di WAN.

Il contesto del movimento è stato costruito combinando le informazioni umane e di posa nel tempo, mentre le funzionalità dell’abito sono state elaborate separatamente e allineate attraverso la proiezione in token embeddings.

Il modello è stato esteso anche per supportare interpolazione dell’abito. Qui, le rappresentazioni di due abiti sono state combinate per generare transizioni lisce, consentendo una fusione coerente e coerente tra gli articoli di abbigliamento, senza ulteriore ottimizzazione.

Dati e Test

Il modello è stato addestrato su 9.135 video, con lunghezze variabili da tre a dieci secondi, provenienti dai siti di shopping sopra menzionati; il set di dati generato dagli autori; e il set di dati HumanVid.

Da questi, due set di dati di valutazione sono stati stabiliti: il set di dati ‘Internet’, che presenta video e immagini di prodotti da centri commerciali; e la divisione di test ufficiale del set di dati ViViD di Alibaba.

Poiché i dati ViViD mancano di volti (vedi il video precedente, per un esempio di ciò, che è molto comune nella letteratura di prova virtuale), questi sono stati aggiunti tramite outpainting Flux.

Le metriche utilizzate sono state L1 loss; Peak Signal-to-Noise Ratio (PSNR); Structural Similarity Index (SSIM); Learned Perceptual Image Patch Similarity (LPIPS); Fréchet Inception Distance (FID); e Fréchet Video Distance†† (FVD)

I sistemi testati per il trasferimento dell’abito sono stati OOTDiffusion; CatVTON; OmniTry; e Any2AnyTryon. I modelli di generazione di immagini da soggetto testati sono stati VisualCloze; MOSAIC; e UNO di ByteDance.

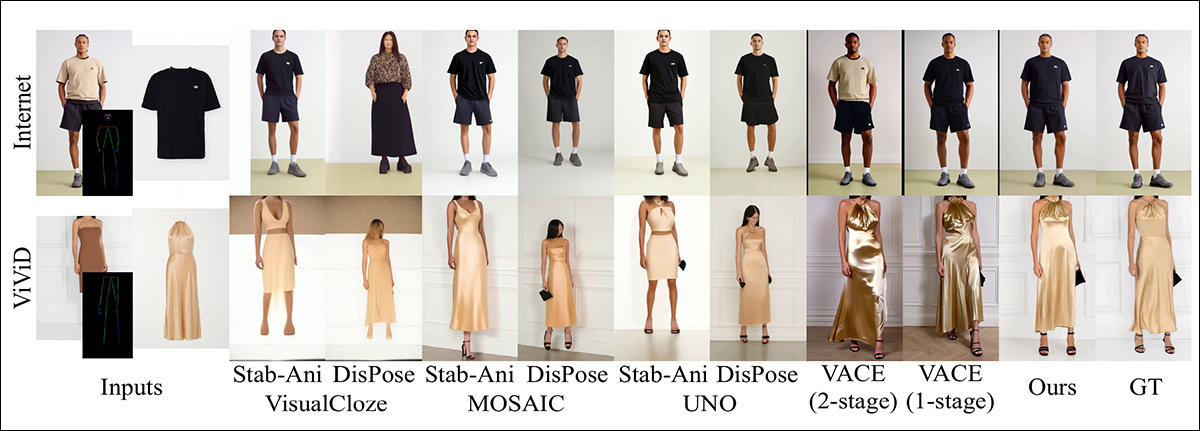

Per la seconda fase di test, in cui sono stati testati combinazioni di modelli di prova virtuale basati su immagini e animazione, il nuovo lavoro è stato in grado di raggiungere il punteggio più alto:

Confronto quantitativo con combinazioni di modelli di prova virtuale basati su immagini e animazione sui set di dati Internet e ViViD. Il metodo proposto ha raggiunto la migliore prestazione complessiva tra le metriche, con SSIM che rimane paragonabile al miglior baseline. I valori in grassetto indicano il punteggio più alto.

Gli autori aggiungono:

‘[Il nostro] modello raggiunge la migliore prestazione in tutte le metriche quando confrontato con combinazioni di modelli di generazione di immagini da soggetto e modelli di animazione.

‘I risultati qualitativi [mostrati di seguito] confermano ulteriormente che il nostro approccio produce il trasferimento dell’abito e la seguimento della posa più precisi, mentre preserva l’identità in modo più fedele di tutti i baseline basati su immagini da soggetto.’

Test qualitativi utilizzando baseline create combinando modelli VTON con modelli di animazione.

Conclusione

Sebbene il progetto Vanast raggiunga una soluzione end-to-end discreta, la mancanza di dettagli nel paper riguardo alle richieste di risorse di addestramento e inferenza indica che ciò potrebbe non essere la soluzione più agile o veloce. In realtà, la sfida stessa è estremamente difficile da raggiungere anche in un sistema non ottimizzato – e quanto più in un deployment commerciale che avrebbe bisogno di bassa latenza e redditività a scala..?

La prova virtuale è uno degli obiettivi ‘moonshot’ dell’IA dove lo stato attuale dell’arte, come diffuso attraverso vari titoli e risultati selezionati, nasconde la difficoltà reale del compito, che forse sarà eventualmente risolto da tecnologie successive e più leggere rispetto ai Transformer.

† Disponibile negli Stati Uniti, bloccato geograficamente in molte altre regioni, se non in tutte.

†† Gli autori si riferiscono a ‘VFID’, ma collegano solo al paper ViViD, che non giustifica il riferimento, per quanto mi è possibile con il tempo limitato per rintracciarlo. Ho assunto che intendessero effettivamente Fréchet Video Distance (FVD) e fossero a corto di tempo. Per favore, contattatemi per eventuali modifiche, se necessario.

Pubblicato per la prima volta mercoledì 8 aprile 2026