Angolo di Anderson

L’AI può indovinare l’anno di una foto dai volti delle persone

Una nuova ricerca mostra che l’AI può utilizzare i volti delle persone per stimare l’anno in cui una foto è stata scattata, combinando le stime dell’età con gli anni di nascita noti per superare i metodi basati sulla scena attuali.

Indovinare la data di una foto un tempo era molto più facile di quanto non lo sia ora, perché le mode dei capelli e degli abiti evolvevano a un ritmo vertiginoso. Per motivi molto discussi, questo cambiamento di stile visivo si è fermato circa trent’anni fa, il che significa che non è più così facile guardare un taglio di capelli o degli articoli di abbigliamento e indovinare l’anno da questo tipo di indizio visivo.

Per un certo periodo, è stato possibile datare immagini e film in base alla risoluzione dei colori e alle caratteristiche del grano del film. Non era necessario essere un esperto forense; se si guardavano abbastanza film vecchi, gli indizi culturali (come la musica, le auto, la moda, gli argomenti, ecc.) sarebbero eventualmente diventati associati, dallo spettatore, con stili di film:

Un’illustrazione del modo in cui i miglioramenti del film hanno gradualmente ampliato la gamma di toni della pelle e degli stili di illuminazione nel tempo, passando da impostazioni piatte e frontali a look più naturalistici e vari. Fonte (il mio articolo)

Un ulteriore ‘ancora’ per datare una fotografia era se era in bianco e nero – un’economia che è diventata ridondante dopo la popolarizzazione della fotografia digitale all’inizio di questo secolo

Una serie di sistemi commerciali e sperimentali, come il PhotoDater incluso nella sottoscrizione di MyHeritage PhotoDater tentano di datare le foto utilizzando questi e diversi altri criteri.

![Un esempio di stima dell'età di una foto dal servizio di sottoscrizione PhotoDater di MyHeritage. Fonte [ https://www.youtube.com/watch?v=2oVyLI6tBcY ]](https://www.unite.ai/wp-content/uploads/2025/11/photodater.jpg)

Un esempio di stima dell’età di una foto, dal servizio di sottoscrizione PhotoDater di MyHeritage. Fonte

Assenti altri segni rivelatori, come smartphone o altre tecnologie specifiche di un’epoca, il miglior modo per determinare l’età di una foto scattata negli ultimi 15-25 anni è se si conosce la persona (ad esempio, un personaggio famoso o forse un conoscente) e si può stimare la sua età, il che produce un anno approssimativo.

Età facciale come riferimento

Nel campo della visione computerizzata, e in diversi altri campi (ad esempio, forensi, elaborazione archivistica, giornalismo, architettura dei set di dati, ecc.) la capacità di determinare l’età di una foto è un obiettivo ambito, poiché molte delle collezioni digitali e analogiche più interessanti mancano di annotazioni e metadati appropriati, o addirittura hanno metadati errati a causa di ipotesi precedenti (errate).

Pertanto, sarebbe utile se un sistema AI potesse esaminare le foto allo stesso modo in cui facciamo noi quando ripercorriamo le nostre collezioni storiche e commentiamo ‘Oh sì, quello era quando…’. La domanda è, cosa potrebbe essere l’ancora, assente i soliti indizi necessari?

Un nuovo articolo di ricerca della Repubblica Ceca offre un primo punto di partenza per questo approccio, sfruttando i sistemi di riconoscimento dell’età basati sull’AI, in concerto con i sistemi di riconoscimento facciale collegati a un database comune di identità (in questo caso, una raccolta di tipo IMDB che presenta performer e registi cechi):

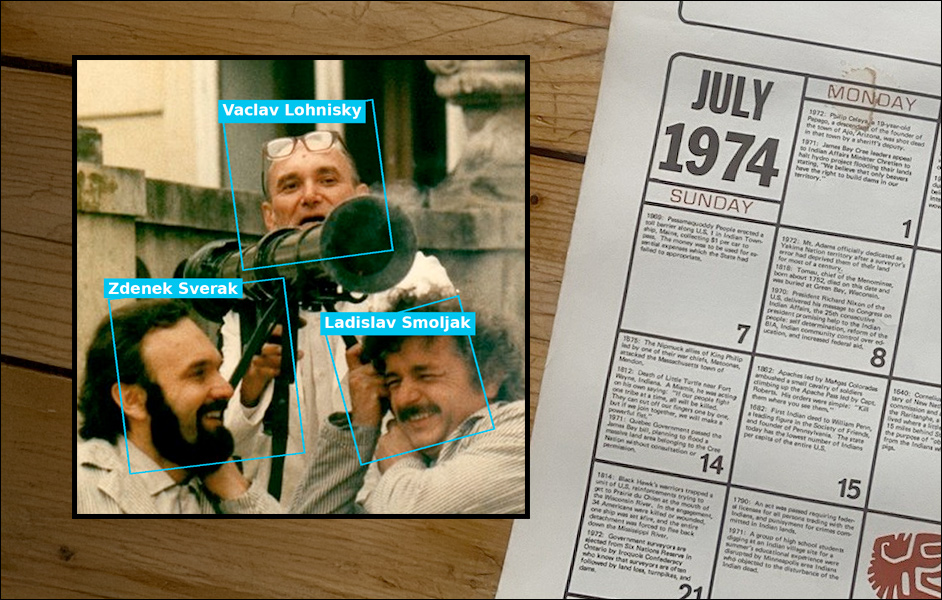

Un fotogramma da ‘Joachim, Mettilo nella macchina’ (1974), utilizzato per illustrare il processo di datazione. Il modello rileva individui noti nella foto, stima la loro età utilizzando un estimatore dell’età facciale (colonna destra), e sottrae quel valore dall’anno di nascita di ciascuna persona per generare una distribuzione di probabilità sulle possibili date della foto. I grafici mostrano la probabilità di ogni stima di età, con linee tratteggiate che segnano l’età vera di ogni persona al momento della foto. Fonte

Il sistema funziona rilevando individui noti in una foto, stimando la loro età facciale utilizzando un modello pre-addestrato, e sottraendo questa stima dal loro anno di nascita documentato per generare date probabili per la foto. Quando sono presenti più volti, le stime di data vengono aggregate per produrre una previsione finale.

Il metodo è stato testato su immagini curate dal Czecho-Slovak Movie Database (CSFD), con l’approccio risultante, che gli autori affermano, offrendo costantemente maggiore accuratezza rispetto ai modelli basati sulla scena (modelli statici che si basano su elementi di sfondo o contesto visivo piuttosto che sui volti) addestrati sui same dati.

Lo schema per questo metodo richiede un database centrale che contenga conoscenze di un ampio gruppo di individui; ma qualsiasi raccolta simile che presenti date di nascita confermate e eventi centrali con date confermate potrebbe produrre un risultato simile.

L’articolo afferma:

‘Unicamente, il nostro set di dati fornisce annotazioni per più individui all’interno di una singola immagine, consentendo lo studio dell’aggregazione di informazioni multi-volto. Proponiamo un framework probabilistico che combina formalmente le prove visive dei moderni modelli di riconoscimento facciale e stima dell’età, e priori temporali basati sulla carriera per inferire l’anno di acquisizione della foto.

‘I nostri esperimenti dimostrano che l’aggregazione delle prove da più volti migliora costantemente le prestazioni e l’approccio supera notevolmente le linee guida basate sulla scena, in particolare per immagini che contengono diversi individui identificabili.’

Il nuovo articolo è intitolato Datazione delle foto mediante aggregazione dell’età facciale, e proviene da due ricercatori dell’Università Tecnica Ceca di Praga, con la promessa di una successiva pubblicazione del codice e dei dati.

Metodo

Per stimare quando una foto è stata scattata, il nuovo sistema dell’autore esamina ogni volto rilevato e tenta di indovinare chi potrebbe essere, utilizzando il suddetto database di persone note. Poiché una persona può apparire solo una volta in una foto, il sistema controlla tutte le combinazioni di identità possibili e utilizza i loro anni di nascita noti per stimare quanti anni sembra avere ogni persona.

Dopo di ciò, lavora a ritroso per stimare l’anno più probabile che farebbe coincidere quelle età:

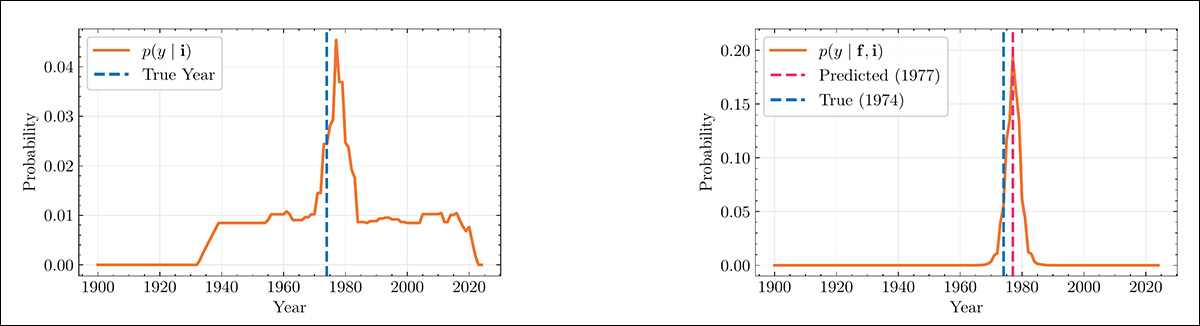

Sinistra: il sistema costruisce una timeline che mostra quando gli individui riconosciuti sono stati più attivi, in base alle loro carriere note. Destra: ciò viene combinato con le stime dell’età facciale per produrre una stima finale di quando l’immagine è stata scattata.

Per gestire le molte combinazioni di identità possibili, il sistema presume che i volti siano indipendenti, e che l’aspetto di ciascuno dipenda solo dalla sua identità e dalla data della foto.

Per stimare quando una foto è stata scattata, il sistema prima stima l’età di ciascun volto rilevato utilizzando il modello cvut-002 di NIST, che si basa su un’architettura ViT-B/16, e addestrato su un set di dati privato (che, gli autori affermano, si classifica altamente nel database di valutazione della tecnologia di analisi del viso di NIST (FATE) database).

Una volta nota l’anno di nascita di una persona, il modello converte la stima dell’età in un anno di foto probabile aggiungendo l’età all’anno di nascita, producendo una distribuzione di probabilità sugli anni di cattura possibili. Per valutare quanto bene un volto rilevato corrisponda a un’identità nota, il sistema confronta i suoi inserimenti nello spazio ArcFace:

![ArcFace, l'architettura centrale che contribuisce al modello InsightFace attualmente popolare, è stato lanciato nel 2015, destinato a diventare un progetto influente nella valutazione e valutazione facciale. [Fonte ] https://arxiv.org/pdf/1801.07698](https://www.unite.ai/wp-content/uploads/2025/11/arcface.jpg)

ArcFace, l’architettura centrale che contribuisce al modello InsightFace attualmente popolare, è stato lanciato nel 2015, destinato a diventare un progetto influente nella valutazione e valutazione facciale. Fonte

Ogni identità è rappresentata da un inserimento medio costruito dai suoi ritratti di riferimento. La somiglianza tra un volto di test e un’identità viene quindi misurata utilizzando una distribuzione di Von Mises Fisher, che modella quanto strettamente i ritratti dell’identità si raggruppano attorno a quel inserimento medio. Un parametro di nitidezza condiviso controlla quanto il sistema è fiducioso in quei cluster, e viene stimato utilizzando una strategia di lasciare uno fuori sui ritratti dell’identità.

Il modello definisce cinque tipi di priori per stimare quando una persona riconosciuta potrebbe apparire in una foto: uniforme; decennale; film; immagine; e un prior di combinazione convessa che combina le opzioni più forti e più deboli, per testare la sensibilità alla forza del priore (ad esempio, la resilienza dei priori sotto stress).

Per gestire i volti che non possono essere identificati con fiducia, il modello include un’identità di fallback ‘sconosciuta’ con distribuzioni non informative, che presentano una probabilità del volto piatta nello spazio di inserimento, e un priore temporale piatto in tutti gli anni. Ciò consente di ignorare i volti incerti senza distorcere la stima di data finale:

Come le prestazioni sono influenzate quando alcuni volti in un’immagine non possono essere identificati. Ogni quadrato mostra l’errore di datazione medio per diversi numeri di identità note e sconosciute, con la dimensione del quadrato che riflette quanto è comune quella combinazione nel set di dati. L’errore aumenta con più sconosciuti, ma diminuisce costantemente man mano che vengono aggiunte più identità note.

Dati e test

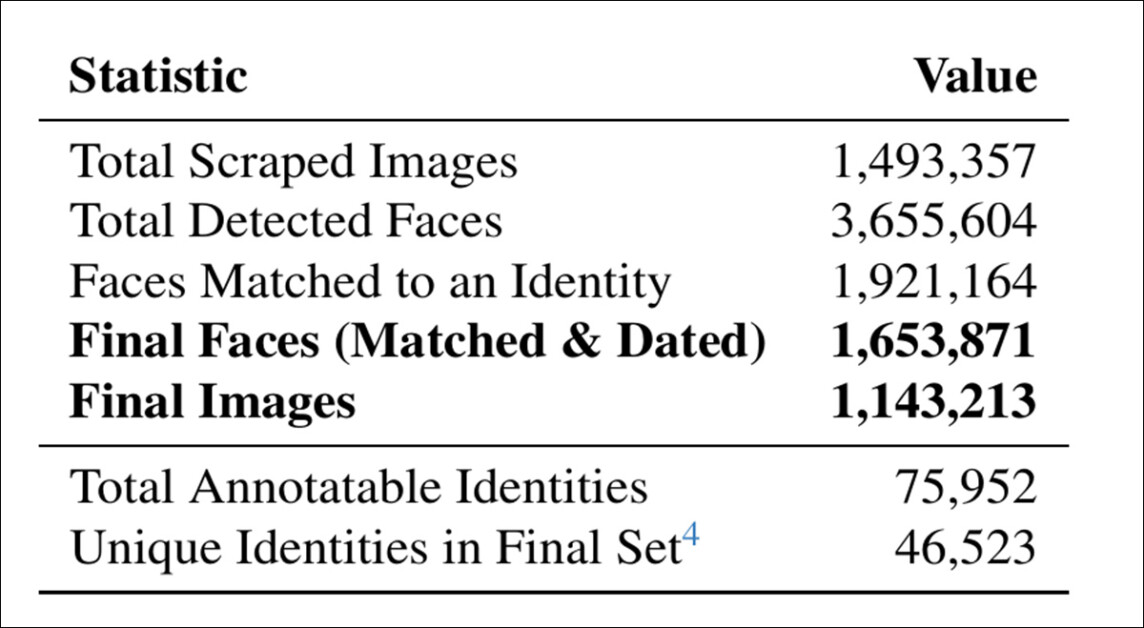

Gli autori hanno utilizzato il suddetto set di dati CSFD per fornire dati per una nuova raccolta che hanno intitolato CSFD-1.6M. Il set di dati è stato costruito da scene con diverse persone, con ogni volto etichettato con identità e anno. Questa struttura era necessaria per insegnare al modello come i volti si relazionano tra loro nel contesto; i set di dati con un solo volto come IMDB-WIKI non supportano questo, poiché etichettano solo una persona per immagine.

Gli anni di uscita dei film dal Czecho-Slovak Movie Database sono stati utilizzati per stimare quando ogni foto è stata scattata, con ogni persona nell’immagine abbinata a un profilo pubblico con l’anno di nascita e un ritratto.

Successivamente, ogni volto nell’immagine è stato abbinato a una delle identità note, inizialmente utilizzando ArcFace per creare inserimenti del volto, e calcolando un inserimento medio per ogni identità.

Dopo di ciò, l’algoritmo ungherese è stato utilizzato per assegnare i volti alle identità confrontando la somiglianza degli inserimenti, con aggiustamenti apportati quando il numero di volti rilevati tramite il framework SCRFD-10GE non corrispondeva al numero di individui noti.

Statistiche del set di dati CSFD-1.6M, che dettagliano le immagini estratte, i volti rilevati, le corrispondenze di identità, i campioni annotati finali e il pool di identità disponibile.

Le corrispondenze sono state rifiutate se la somiglianza era troppo bassa o se la stima dell’età differiva troppo dall’età nota, con una maggiore tolleranza consentita per i soggetti più anziani, e i volti non sono stati filtrati per qualità o dimensione.

Gli autori notano la superiorità del loro set di dati curato rispetto a quello del set di dati più simile, IMDB-WIKI:

‘Il nostro set di dati non è solo sostanzialmente più grande, ma, criticamente, consiste in scene con più persone richieste dal nostro modello. Mentre nessun set di dati web-scraped è privo di rumore di etichetta, la nostra pipeline di annotazione sfrutta i collegamenti espliciti tra immagini e profili di identità forniti dal database, mirando ad assegnazioni di identità di alta qualità.’

Il loro valutazione ha confrontato diverse versioni del sistema di datazione, per capire da dove provenivano i suoi guadagni. Un modello ha assunto la conoscenza perfetta di chi era nell’immagine, fornendo un limite superiore per le prestazioni rimuovendo ogni incertezza nel riconoscimento dell’identità, con la versione completa del modello che stima poi le identità e le date congiuntamente, ponderando diverse configurazioni di identità possibili prima di arrivare a una stima di anno finale.

Una variante più semplice ha selezionato la singola configurazione di identità più probabile senza marginalizzare le alternative, che si è rivelata quasi altrettanto efficace nella pratica.

Al contrario, la linea di base più semplice ha assegnato ogni volto in modo indipendente e ha combinato le stime di età basate sull’anno risultanti, senza considerare se le identità collettive avessero senso.

Per testare quanto il metodo beneficiasse dell’utilizzo dei volti, un modello separato è stato addestrato per stimare la data direttamente dall’intera scena. Questo modello basato sulla scena costituisce l’approccio alternativo attualmente utilizzato nella stima della data dell’immagine, poiché può apprendere modelli visivi specifici di un’epoca in tutta l’immagine, piuttosto che affidarsi all’identità o all’età.

Metriche e dati

L’errore assoluto medio (MAE) tra l’anno previsto e il valore di verità noto è stato il metrica centrale per gli esperimenti.

I dati sono stati divisi in cinque parti, con cura per assicurarsi che tutte le immagini dello stesso film fossero mantenute all’interno di una sola partizione. Tre di queste parti sono state utilizzate per l’addestramento, una per la convalida e una per il test. Questa rotazione a cinque parti è stata applicata per prevenire sovrapprendimento.

Poiché i modelli basati sui volti non sono stati addestrati su questo set di dati, non è stato necessario alcun splitting, e invece sono stati valutati direttamente sul set di dati CSFD-1.6M completo.

Il modello Scene è stato addestrato per 200 epoche sotto l’ottimizzatore Adam, con le immagini ridimensionate in una copia di 384×384.

Risultati

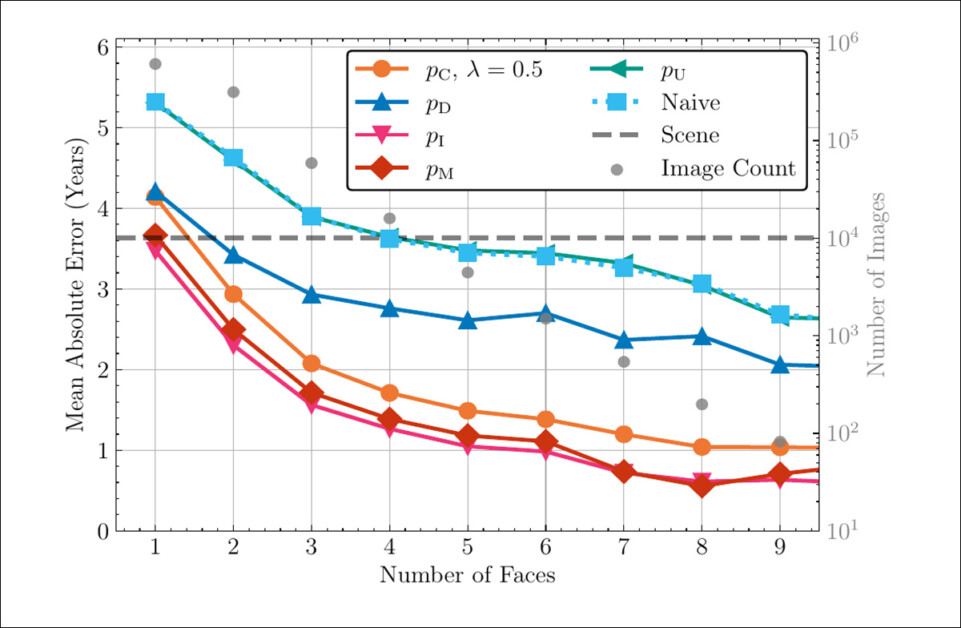

La sezione dei risultati dell’articolo è divisa in modo insolito in una serie di indicatori di prestazione, senza un singolo test eccezionale o centrale. Tuttavia, presenteremo una selezione dei risultati più pertinenti qui.

Il risultato più importante non è un singolo numero, ma un modello: i modelli di aggregazione facciale (in particolare le varianti Full e Top-1) superano costantemente la linea di base Scene quando due o più identità note sono presenti – anche se il modello Scene è stato addestrato direttamente sul set di dati, supportando l’affermazione centrale che il datazione dell’identità collegata ai volti fornisce un segnale più robusto rispetto all’interpretazione olistica della scena.

Per valutare l’effetto dei priori temporali, gli autori hanno confrontato diverse configurazioni del loro modello Full. Le prestazioni più forti sono state ottenute utilizzando il prior del decennio, che ha superato notevolmente sia il modello Naive (che non utilizza alcun priore temporale) che il prior uniforme (che presume alcuna preferenza su gli anni):

Le prestazioni calano bruscamente per tutti i metodi man mano che aumenta il numero di volti, ma i modelli che utilizzano priori temporali realistici come il prior del decennio sono influenzati molto meno. La linea di base Naive e Scene rimane piatta o peggiora con gruppi più grandi, mentre il modello Full guidato da priori informativi mantiene un errore basso. I priori basati sull’oracolo, che si basano sulle statistiche del set di test, definiscono il limite inferiore per le prestazioni raggiungibili.

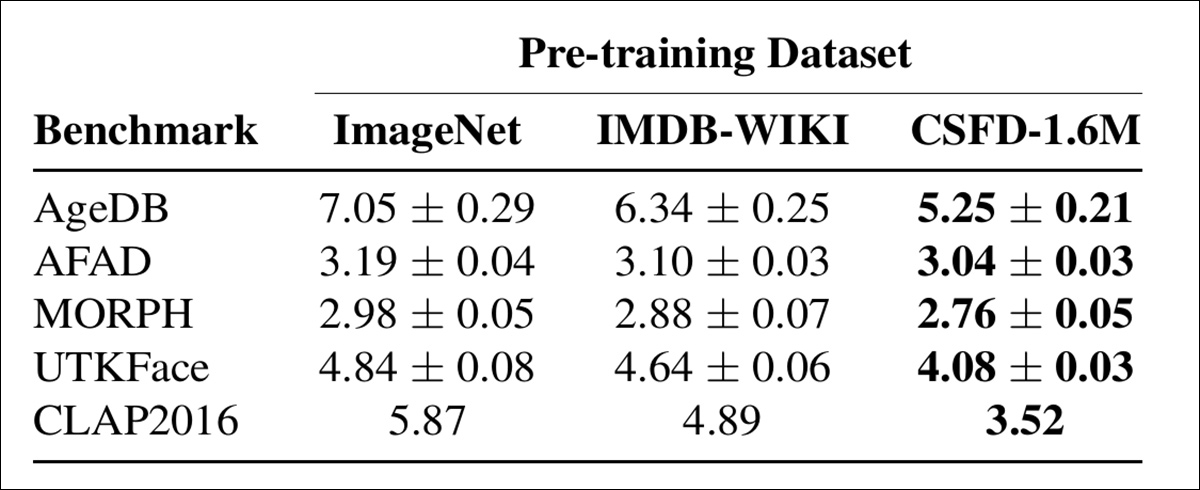

Per dimostrare il valore di CSFD-1.6M oltre la datazione delle foto, il set di dati è stato anche testato come risorsa di pre-addestramento per il compito più ampio della stima dell’età facciale. Seguendo un protocollo di valutazione standard, i modelli ResNet101 sono stati pre-addestrati su CSFD-1.6M e confrontati con i modelli pre-addestrati su IMDB-WIKI e ImageNet. Questi modelli sono stati quindi addestrati e valutati su cinque benchmark popolari: AgeDB; AFAD, MORPH; UTKFace; e CLAP2016:

Errore assoluto medio (più/minus deviazione standard) su cinque benchmark di stima dell’età, confrontando modelli pre-addestrati su ImageNet, IMDB-WIKI e CSFD-1.6M. I valori più bassi indicano prestazioni migliori. CSFD-1.6M produce i risultati più forti su tutti i benchmark.

Su tutti e cinque i set di dati, il pre-addestramento su CSFD-1.6M ha portato a tassi di errore più bassi, superando gli altri due ambienti di pre-addestramento con un margine significativo – un divario di prestazioni che si è rivelato più forte su AFAD e CLAP2016, ma è rimasto costante in generale.

Ci riferiamo al lettore per il resto della sezione dei risultati piuttosto frammentata nel paper di origine, che tratta anche ampiamente di studi di ablazione.

Conclusione

Sebbene il nuovo articolo diventi rapidamente denso e inaccessibile per il lettore casuale, l’argomento trattato è tra i più interessanti e rilevanti nella letteratura sulla visione computerizzata – non solo perché si sovrappone piuttosto abilmente all’antropologia e agli studi culturali, dove le costanti sono difficili da definire.

* Proprio come l’evoluzione musicale ha rallentato il suo tasso di cambiamento.

Pubblicato per la prima volta lunedì 10 novembre 2025