Intelligenza artificiale

Una prospettiva personale sulle tendenze della letteratura di Computer Vision nel 2024

Ho seguito costantemente la scena della ricerca su computer vision (CV) e sintesi di immagini su Arxiv e altrove per circa cinque anni, quindi le tendenze diventano evidenti nel tempo e si spostano in nuove direzioni ogni anno.

Pertanto, mentre il 2024 si avvicina alla fine, ho pensato che fosse opportuno dare uno sguardo ad alcune nuove o evolventi caratteristiche nelle submission di Arxiv nella sezione Computer Vision e Pattern Recognition section. Queste osservazioni, sebbene informate da centinaia di ore di studio sulla scena, sono strettamente anecdoti.

<strong-La crescita continua dell'Asia orientale

Verso la fine del 2023, avevo notato che la maggior parte della letteratura nella categoria “sintesi vocale” proveniva dalla Cina e da altre regioni dell’Asia orientale. Alla fine del 2024, devo osservare (anecdoticamente) che ciò si applica ora anche alla scena della ricerca sulla sintesi di immagini e video.

Ciò non significa che la Cina e i paesi adiacenti stiano necessariamente producendo sempre il miglior lavoro (in realtà, c’è alcuna evidenza contraria); né tiene conto della alta probabilità che in Cina (come in Occidente) alcuni dei sistemi più interessanti e potenti in via di sviluppo siano proprietari e esclusi dalla letteratura di ricerca.

Ma suggerisce che l’Asia orientale sta battendo l’Occidente per volume, in questo senso. Quanto valga ciò dipende dall’estensione in cui si crede nella fattibilità della persistenza alla maniera di Edison, che di solito si dimostra inefficace di fronte a ostacoli intractabili.

Ci sono molti ostacoli del genere nell’intelligenza artificiale generativa, e non è facile sapere quali possano essere risolti affrontando le architetture esistenti e quali richiederanno di essere ripensate da zero.

Sebbene i ricercatori dell’Asia orientale sembrino produrre un numero maggiore di articoli di computer vision, ho notato un aumento della frequenza di progetti “Frankenstein” – iniziative che costituiscono una fusione di lavori precedenti, aggiungendo una novità architettonica limitata (o forse solo un tipo diverso di dati).

Quest’anno, un numero molto maggiore di contributi dell’Asia orientale (in gran parte collaborazioni cinesi o coinvolgenti la Cina) sembravano essere guidati da quote piuttosto che dal merito, aumentando notevolmente il rapporto segnale/rumore in un campo già sovraiscritto.

Allo stesso tempo, un numero maggiore di articoli dell’Asia orientale ha anche attirato la mia attenzione e ammirazione nel 2024. Quindi, se questo è tutto un gioco di numeri, non sta fallendo – ma neanche è a buon mercato.

Aumento del volume delle submission

Il volume di articoli, provenienti da tutti i paesi di origine, è evidentemente aumentato nel 2024.

Il giorno di pubblicazione più popolare cambia nel corso dell’anno; attualmente è il martedì, quando il numero di submission alla sezione Computer Vision e Pattern Recognition è spesso intorno a 300-350 in un solo giorno, nei periodi di “picco” (maggio-agosto e ottobre-dicembre, ovvero la stagione delle conferenze e la stagione della “scadenza della quota annuale”, rispettivamente).

Oltre alla mia esperienza personale, Arxiv stesso riporta un numero record di submission nel mese di ottobre del 2024, con 6000 nuove submission totali, e la sezione Computer Vision la seconda più inviata dopo Machine Learning.

Tuttavia, poiché la sezione Machine Learning su Arxiv viene spesso utilizzata come categoria “aggiuntiva” o aggregata, ciò suggerisce che Computer Vision e Pattern Recognition siano in realtà la categoria più inviata di Arxiv.

Le statistiche di Arxiv stesse ritraggono chiaramente la scienza dei computer come il leader assoluto nelle submission:

La scienza dei computer (CS) domina le statistiche di submission su Arxiv negli ultimi cinque anni. Fonte: https://info.arxiv.org/about/reports/submission_category_by_year.html

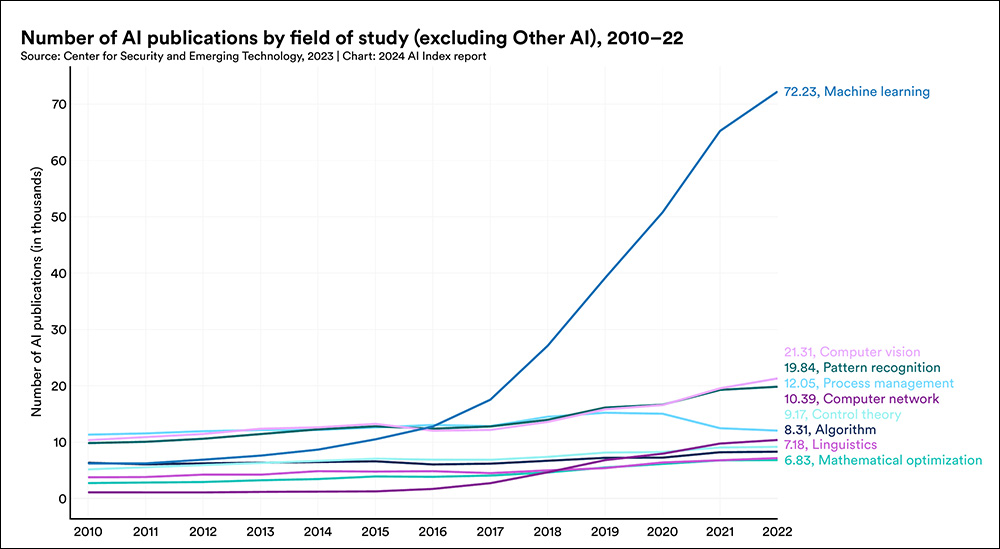

L’indice AI di Stanford del 2024, sebbene non possa ancora riportare le statistiche più recenti, enfatizza anche la notevole ascesa delle submission di articoli accademici su apprendimento automatico negli ultimi anni:

Con cifre non disponibili per il 2024, il rapporto di Stanford mostra comunque in modo drammatico l’aumento del volume di submission per gli articoli sull’apprendimento automatico. Fonte: https://aiindex.stanford.edu/wp-content/uploads/2024/04/HAI_AI-Index-Report-2024_Chapter1.pdf

Diffusione > Framework di mesh si moltiplicano

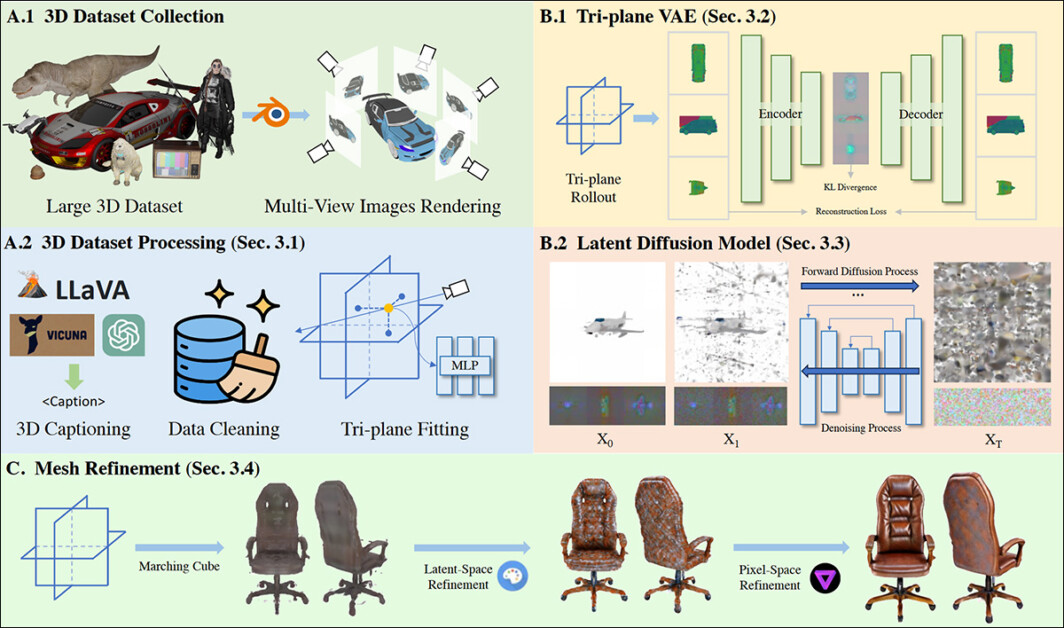

Un’altra tendenza chiara che è emersa per me è stata una grande impennata di articoli che trattano di sfruttare i modelli di diffusione latente (LDM) come generatori di modelli CGI basati su mesh.

Progetti di questo tipo includono InstantMesh3D di Tencent, 3Dtopia, Diffusion2, V3D, MVEdit e GIMDiffusion, tra molti altri offerti.

Generazione e raffinamento di mesh tramite un processo basato sulla diffusione in 3Dtopia. Fonte: https://arxiv.org/pdf/2403.02234

Questo filone di ricerca emergente potrebbe essere considerato come un’accettazione tacita dell’intractabilità continua dei sistemi generativi come i modelli di diffusione, che solo due anni fa erano considerati come un potenziale sostituto per tutti i sistemi che i modelli di diffusione > mesh stanno ora cercando di popolare; relegando la diffusione al ruolo di uno strumento in tecnologie e flussi di lavoro che risalgono a trenta o più anni.

Stability.ai, originatori del modello open source Stable Diffusion, hanno appena rilasciato Stable Zero123, che può, tra le altre cose, utilizzare un’interpretazione dei campi di radiosità neurali (NeRF) di un’immagine generata da AI come ponte per creare un modello CGI basato su mesh esplicito che può essere utilizzato in arene CGI come Unity, in videogiochi, realtà aumentata e in altre piattaforme che richiedono coordinate 3D esplicite, anziché le coordinate implicite (nascoste) di funzioni continue.

Fare clic per riprodurre. Le immagini generate in Stable Diffusion possono essere convertite in mesh CGI razionali. Qui vediamo il risultato di un flusso di lavoro immagine > CGI utilizzando Stable Zero 123. Fonte: https://www.youtube.com/watch?v=RxsssDD48Xc

Semantica 3D

Lo spazio dell’intelligenza artificiale generativa fa una distinzione tra sistemi di visione e generazione 2D e 3D. Ad esempio, framework di landmarking facciale, sebbene rappresentino oggetti 3D (volti) in tutti i casi, non tutti necessariamente calcolano coordinate 3D indirizzabili.

Il popolare sistema FANAlign, ampiamente utilizzato nelle architetture di deepfake del 2017 (tra le altre), può accogliere entrambi questi approcci:

Sopra, i landmark 2D vengono generati in base ai soli lineamenti e caratteristiche del viso riconosciuti. Sotto, vengono razionalizzati nello spazio 3D X / Y / Z. Fonte: https://github.com/1adrianb/face-alignment

Quindi, proprio come ‘deepfake’ è diventato un termine ambiguo e dirottato, ‘3D’ è diventato un termine confuso nella ricerca di computer vision.

Per i consumatori, ha tipicamente significato media abilitate allo stereo (come film per i quali lo spettatore deve indossare occhiali speciali); per i pratici di effetti visivi e modellisti, fornisce la distinzione tra arte 2D (come schizzi concettuali) e modelli basati su mesh che possono essere manipolati in un programma ‘3D’ come Maya o Cinema4D.

Ma nella computer vision, significa semplicemente che esiste un sistema di coordinate cartesiane da qualche parte nello spazio latente del modello – non che possa necessariamente essere indirizzato o manipolato direttamente da un utente; almeno, non senza sistemi interpretativi CGI di terze parti come 3DMM o FLAME.

Pertanto, la nozione di diffusione > 3D è inesatta; non solo può qualsiasi tipo di immagine (compresa una foto reale) essere utilizzato come input per produrre un modello CGI generativo, ma il termine meno ambiguo ‘mesh’ è più appropriato.

Tuttavia, per aggravare l’ambiguità, la diffusione è necessaria per interpretare la foto di origine in una mesh, nella maggior parte dei progetti emergenti. Quindi, una descrizione migliore potrebbe essere immagine > mesh, mentre immagine > diffusione > mesh è una descrizione ancora più precisa.

Ma questo è un discorso difficile da fare in una riunione del consiglio di amministrazione o in un comunicato stampa progettato per coinvolgere gli investitori.

Evidenza di stallo architettonico

Anche rispetto al 2023, la raccolta di articoli degli ultimi 12 mesi mostra un aumento della disperazione intorno all’eliminazione dei limiti pratici difficili sulla generazione basata sulla diffusione.

L’ostacolo chiave rimane la generazione di video narrativamente e temporalmente coerenti e il mantenimento di un aspetto coerente dei personaggi e degli oggetti – non solo tra diversi clip video, ma anche all’interno della breve durata di un singolo video generato.

L’ultima innovazione epocale nella sintesi basata sulla diffusione è stata l’avvento di LoRA nel 2022. Sebbene sistemi più recenti come Flux abbiano migliorato alcuni dei problemi outlier, come l’incapacità precedente di Stable Diffusion di riprodurre contenuti di testo all’interno di un’immagine generata, e la qualità generale dell’immagine sia migliorata, la maggior parte degli articoli che ho esaminato nel 2024 erano essenzialmente solo spostare il cibo nel piatto.

Questi stalli si sono verificati in precedenza, con le reti generative avversarie (GAN) e con i campi di radiosità neurali (NeRF), entrambi dei quali non hanno mantenuto il loro potenziale iniziale apparente – e entrambi sono stati sempre più utilizzati in sistemi più convenzionali (come l’uso di NeRF in Stable Zero 123, vedi sopra). Ciò sembra accadere anche con i modelli di diffusione.

Ricerca su Gaussian Splatting si sposta

Sembra che alla fine del 2023 il metodo di rasterizzazione 3D Gaussian Splatting (3DGS), che ha debuttato come tecnica di imaging medico nei primi anni ’90, stesse per superare improvvisamente i sistemi basati su autoencoder nelle sfide di sintesi di immagini umane (come la simulazione e la ricreazione facciale, nonché il trasferimento di identità).

Il paper ASH del 2023 ha promesso umani 3DGS full-body, mentre Gaussian Avatars ha offerto un dettaglio notevolmente migliorato (rispetto ai metodi autoencoder e altri metodi concorrenti), insieme a una rappresentazione impressionante di ri-attuazione.

Tuttavia, quest’anno è stato relativamente povero di momenti di rottura del genere per la sintesi umana 3DGS; la maggior parte degli articoli che hanno affrontato il problema erano o derivati dai lavori sopra menzionati o non sono riusciti a superare le loro capacità.

Invece, l’attenzione si è concentrata sul miglioramento della fattibilità architettonica fondamentale del 3DGS, portando a una serie di articoli che offrono ambienti esterni 3DGS migliorati. Particolare attenzione è stata rivolta alle approcci 3DGS di Localizzazione e mappatura simultanee (SLAM) in progetti come Gaussian Splatting SLAM, Splat-SLAM, Gaussian-SLAM, DROID-Splat, tra molti altri.

Quei progetti che hanno cercato di continuare o estendere la sintesi umana basata su 3DGS includevano MIGS, GEM, EVA, OccFusion, FAGhead, HumanSplat, GGHead, HGM e Topo4D. Sebbene ce ne siano altri oltre a questi, nessuno di questi ha eguagliato l’impatto iniziale degli articoli emersi alla fine del 2023.

L’era di Weinstein dei campioni di test è in declino

La ricerca proveniente dal sud-est asiatico in generale (e dalla Cina in particolare) spesso presenta esempi di test che sono problematici da ripubblicare in un articolo di revisione, poiché presentano materiale che è un po’ ‘piccante’.

Se ciò sia dovuto al fatto che gli scienziati della ricerca in quella parte del mondo stanno cercando di attirare l’attenzione per la loro produzione è oggetto di dibattito; ma negli ultimi 18 mesi, un numero crescente di articoli sulla intelligenza artificiale generativa (sintesi di immagini e / o video) hanno fatto affidamento sull’uso di donne e ragazze giovani e seminude come esempi di progetto. Esempi borderline NSFW di ciò includono UniAnimate, ControlNext e persino articoli molto ‘asciutti’ come Evaluating Motion Consistency by Fréchet Video Motion Distance (FVMD).

Ciò segue le tendenze generali dei subreddit e di altre comunità che si sono radunate intorno ai modelli di diffusione latente (LDM), dove la regola 34 rimane molto in evidenza.

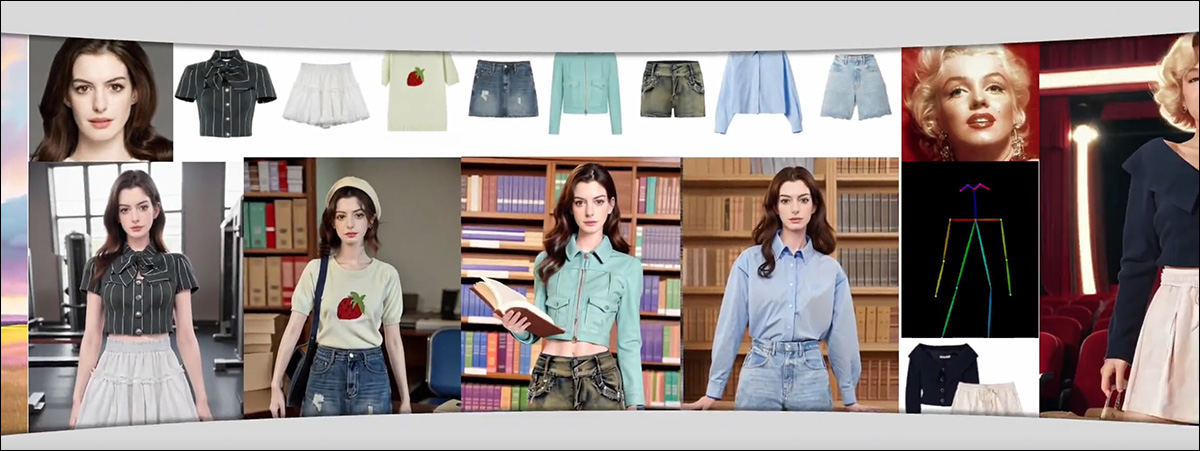

Confronto di celebrità

Questo tipo di esempio inappropriato si sovrappone al crescente riconoscimento che i processi AI non dovrebbero sfruttare arbitrariamente le somiglianze delle celebrità – in particolare negli studi che utilizzano esempi che presentano celebrità attraenti, spesso femminili, e le pongono in contesti discutibili.

Un esempio è AnyDressing, che, oltre a presentare personaggi femminili giovani e di stile anime, utilizza anche liberamente le identità di celebrità classiche come Marilyn Monroe e attuali come Ann Hathaway (che ha condannato questo tipo di utilizzo in modo molto vocale).

L’uso arbitrario di celebrità classiche e attuali è ancora abbastanza comune negli articoli del sud-est asiatico, sebbene questa pratica sia leggermente in declino. Fonte: https://crayon-shinchan.github.io/AnyDressing/

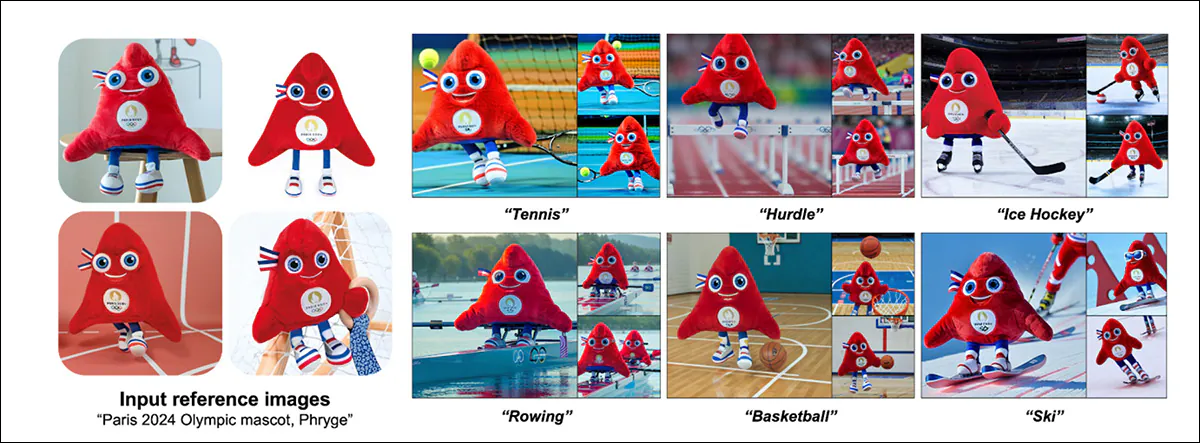

Negli articoli occidentali, questa particolare pratica è stata notevolmente in declino nel corso del 2024, guidata dalle maggiori uscite di FAANG e altri importanti organismi di ricerca come OpenAI. Criticamente consapevoli del potenziale per future azioni legali, questi importanti attori aziendali sembrano sempre più riluttanti a rappresentare anche personaggi fittizi fotorealistici.

Sebbene i sistemi che stanno creando (come Imagen e Veo2) siano chiaramente in grado di tale output, gli esempi di progetti di intelligenza artificiale generativa occidentali tendono a orientarsi verso immagini e video ‘carini’, ‘disneyani’ e estremamente ‘sicuri’.

Nonostante la capacità di Imagen di creare output fotorealistico, i campioni promossi da Google Research sono tipicamente fantascientifici, ‘per famiglie’ – gli esseri umani fotorealistici sono accuratamente evitati o esempi minimi forniti. Fonte: https://imagen.research.google/

Lavaggio del viso

Nella letteratura CV occidentale, questo approccio disonesto è particolarmente in evidenza per i sistemi di personalizzazione – metodi che sono in grado di creare somiglianze coerenti di una persona specifica in più esempi (ad esempio come LoRA e il vecchio DreamBooth).

Esempi includono l’incorporamento visivo ortogonale, LoRA-Composer, InstructBooth di Google, e molti altri.

InstructBooth di Google alza il fattore di dolcezza a 11, sebbene la storia suggerisca che gli utenti siano più interessati a creare esseri umani fotorealistici che personaggi pelosi o soffici. Fonte: https://sites.google.com/view/instructbooth

Tuttavia, l’aumento degli esempi ‘carini’ è visibile anche in altre aree di ricerca sulla computer vision e sulla sintesi, in progetti come Comp4D, V3D, DesignEdit, UniEdit, FaceChain (che ammette un’attitudine più realistica alle aspettative degli utenti nella sua pagina GitHub), e DPG-T2I, tra molti altri.

La facilità con cui tali sistemi (come LoRAs) possono essere creati da utenti domestici con hardware relativamente modesto ha portato a un’esplosione di modelli di celebrità scaricabili gratuitamente nel dominio civit.ai e nella comunità. Un tale utilizzo illecito rimane possibile attraverso l’apertura di architetture come Stable Diffusion e Flux.

Sebbene sia spesso possibile aggirare le funzionalità di sicurezza dei sistemi di immagine e video generativi per produrre materiale vietato dalle condizioni d’uso di una piattaforma, il divario tra le capacità limitate dei migliori sistemi (come RunwayML e Sora) e le capacità illimitate dei sistemi solo performanti (come Stable Video Diffusion, CogVideo e distribuzioni locali di Hunyuan), non sta realmente chiudendosi, come molti credono.

Invece, questi sistemi proprietari e open source, rispettivamente, minacciano di diventare altrettanto inutili: i sistemi T2V iperscala e costosi potrebbero diventare eccessivamente vincolati a causa della paura di azioni legali, mentre la mancanza di infrastrutture di licenza e la mancanza di controllo dei dati set negli open source potrebbero bloccarli completamente dal mercato man mano che si attuano regolamentazioni più stringenti.

Pubblicato per la prima volta martedì, 24 dicembre 2024