Intelligenza artificiale

La Definizione Elusiva di ‘Deepfake’

Uno studio nuovo e convincente della Germania critica la definizione del termine ‘deepfake’ nell’EU AI Act come eccessivamente vaga, in particolare nel contesto della manipolazione di immagini digitali. Gli autori sostengono che l’enfasi dell’Atto sull’accentramento del contenuto che assomiglia a persone o eventi reali – e tuttavia potenzialmente apparire falso – manca di chiarezza.

Sottolineano anche che le eccezioni dell’Atto per la ‘normale modifica’ (ad esempio, presunte modifiche minori AI-aided alle immagini) non tengono conto sia dell’influenza pervasiva dell’AI nelle applicazioni consumer che della natura soggettiva delle convenzioni artistiche che precedono l’avvento dell’AI.

La legislazione imprecisa su queste questioni dà origine a due rischi chiave: un ‘effetto di raffreddamento’, in cui la legge ampia portata interpretativa soffoca l’innovazione e l’adozione di nuovi sistemi; e un ‘effetto di disprezzo della legge’, in cui la legge è disprezzata come eccessiva o irrilevante.

In entrambi i casi, le leggi vaghe spostano efficacemente la responsabilità di stabilire definizioni legali pratiche su future sentenze giudiziarie – un approccio cauto e avverso al rischio alla legislazione.

Le tecnologie di manipolazione di immagini basate su AI rimangono notevolmente più avanti della capacità della legislazione di affrontarle, sembra. Ad esempio, un esempio notevole dell’elasticità crescente del concetto di post-elaborazione ‘automatica’ AI-driven, la carta osserva, è la funzione ‘Scene Optimizer’ nei recenti apparecchi fotografici Samsung, che può sostituire immagini dell’utente scattate della luna (un soggetto impegnativo) con un’immagine ‘raffinata’ AI-driven:

Top left, an example from the new paper of a real user-taken image of the moon, to the left of a Samsung-enhanced version automatically created with Scene Optimizer; Right, Samsung’s official illustration of the process behind this; lower left, examples from the Reddit user u/ibreakphotos, showing (left) a deliberately blurred image of the moon and (right), Samsung’s re-imagining of this image – even though the source photo was a picture of a monitor, and not the real moon. Sources (clockwise from top-left): https://arxiv.org/pdf/2412.09961; https://www.samsung.com/uk/support/mobile-devices/how-galaxy-cameras-combine-super-resolution-technologies-with-ai-to-produce-high-quality-images-of-the-moon/; https:/reddit.com/r/Android/comments/11nzrb0/samsung_space_zoom_moon_shots_are_fake_and_here/

Nella parte inferiore sinistra dell’immagine sopra, vediamo due immagini della luna. Quella a sinistra è una foto scattata da un utente Reddit. Qui, l’immagine è stata intenzionalmente sfocata e ridimensionata dall’utente.

A destra vediamo una foto della stessa immagine degradata scattata con una fotocamera Samsung con post-elaborazione AI-driven abilitata. La fotocamera ha automaticamente ‘migliorato’ l’oggetto ‘luna’ riconosciuto, anche se non era la luna reale.

La carta critica più profondamente la funzione Best Take incorporata negli smartphone recenti di Google – una funzionalità controversa AI che modifica insieme le ‘migliori’ parti di una foto di gruppo, scansionando multipli secondi di una sequenza fotografica in modo che i sorrisi siano avanti o indietro nel tempo come necessario – e nessuno è mostrato a metà di un battere di ciglia.

La carta sostiene che questo tipo di processo composito ha il potenziale di rappresentare male gli eventi:

‘[In] un tipico ambiente di foto di gruppo, uno spettatore medio probabilmente considererebbe ancora la foto risultante come autentica. Il sorriso che è inserito esisteva all’interno di pochi secondi dalla foto rimanente scattata.

‘D’altra parte, il tempo di dieci secondi della funzionalità di miglior scelta è sufficiente per un cambiamento di umore. Una persona potrebbe aver smesso di sorridere mentre il resto del gruppo ride di una barzelletta a sue spese.

‘Di conseguenza, supponiamo che una tale foto di gruppo possa costituire un deep fake.’

Il nuovo studio è intitolato Che cosa costituisce un Deep Fake? La linea sfumata tra elaborazione legittima e manipolazione sotto l’EU AI Act, e proviene da due ricercatori del Computational Law Lab all’Università di Tübingen e dell’Università di Saarland.

Vecchi Trucchi

La manipolazione del tempo nella fotografia è molto più antica dell’AI a livello consumer. Gli autori del nuovo studio notano l’esistenza di tecniche molto più vecchie che possono essere argomentate come ‘non autentiche’, come la concatenazione di più immagini sequenziali in una foto ad alta gamma dinamica (HDR) o una ‘foto cucita’ panoramica.

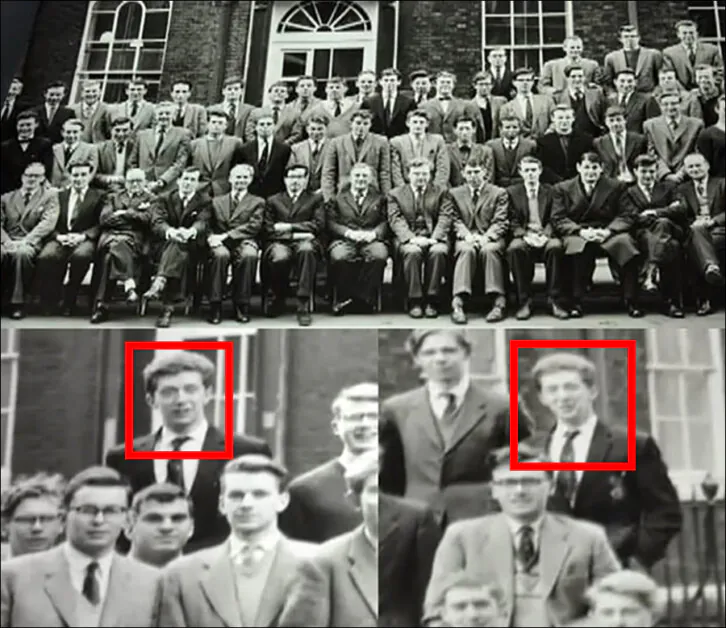

In effetti, alcune delle più vecchie e più divertenti falsificazioni fotografiche sono state tradizionalmente create da studenti delle scuole che correvano da un’estremità all’altra di un gruppo scolastico, prima della traiettoria delle fotocamere panoramiche che erano una volta utilizzate per la fotografia scolastica e sportiva – consentendo allo studente di apparire due volte nella stessa immagine:

La tentazione di ingannare le fotocamere panoramiche durante le foto di gruppo era troppo grande per molti studenti, che erano disposti a rischiare una cattiva seduta nell’ufficio del preside per ‘clonarsi’ nelle foto scolastiche. Source: https://petapixel.com/2012/12/13/double-exposure-a-clever-photo-prank-from-half-a-century-ago/

A meno che non si scatti una foto in modalità RAW, che basically dumpa il sensore dell’obiettivo della fotocamera in un file molto grande senza alcun tipo di interpretazione, è probabile che le vostre foto digitali non siano completamente autentiche. I sistemi di fotocamera applicano regolarmente algoritmi di ‘miglioramento’ come la nitidezza dell’immagine e la bilancia dei bianchi, per default – e lo hanno fatto fin dalle origini della fotografia digitale a livello consumer.

Gli autori del nuovo studio sostengono che anche questi tipi più vecchi di aumento della foto digitale non rappresentano ‘realtà’, poiché tali metodi sono progettati per rendere le foto più piacevoli, non più ‘reali’.

Lo studio suggerisce che l’EU AI Act, anche con successive modifiche come recitals 123–27, colloca tutte le immagini fotografiche all’interno di un quadro evidenziario non adatto al contesto in cui le foto sono prodotte oggi, rispetto alla (nominale) natura oggettiva delle immagini delle telecamere di sicurezza o della fotografia forense. La maggior parte delle immagini affrontate dall’AI Act è più probabile che origini in contesti in cui i produttori e le piattaforme online attivamente promuovono l’interpretazione creativa della foto, compreso l’uso dell’AI.

I ricercatori suggeriscono che le foto ‘non sono mai state una rappresentazione oggettiva della realtà’. Considerazioni come la posizione della fotocamera, la profondità di campo scelta e le scelte di illuminazione contribuiscono a rendere una fotografia profondamente soggettiva.

La carta osserva che i compiti di ‘pulizia’ di routine – come la rimozione della polvere del sensore o delle linee elettriche indesiderate da un’altra scena ben composta – erano solo semi-automatizzati prima dell’avvento dell’AI: gli utenti dovevano selezionare manualmente un’area o avviare un processo per ottenere il risultato desiderato.

Oggi, queste operazioni sono spesso attivate da prompt di testo dell’utente, più notevolmente in strumenti come Photoshop. A livello consumer, tali funzionalità sono sempre più automatizzate senza input dell’utente – un risultato che sembra essere considerato dai produttori e dalle piattaforme come ‘ovviamente desiderabile’.

Il Significato Diluito di ‘Deepfake’

Una sfida centrale per la legislazione intorno all’immaginario alterato e generato dall’AI è l’ambiguità del termine ‘deepfake’, che ha avuto il suo significato notevolmente esteso negli ultimi due anni.

Originariamente i termini si applicavano solo all’output video da sistemi basati su autoencoder come DeepFaceLab e FaceSwap, entrambi derivati da codice anonimo pubblicato su Reddit alla fine del 2017.

Dal 2022, l’avvento di Modelli di Diffusione Latente (LDM) come Stable Diffusion e Flux, nonché sistemi di testo-video come Sora, avrebbe anche consentito lo scambio di identità e la personalizzazione, a risoluzione migliorata, versatilità e fedeltà. Ora era possibile creare modelli di diffusione che potevano rappresentare celebrità e politici. Dal momento che il termine ‘deepfake’ era già un tesoro che attirava i titoli per i produttori di media, è stato esteso per coprire questi sistemi.

In seguito, sia nei media che nella letteratura di ricerca, il termine è venuto anche a includere impersonificazione basata su testo. A questo punto, il significato originale di ‘deepfake’ era ormai perso, mentre il suo significato esteso era costantemente in evoluzione e sempre più diluito.

Ma poiché la parola era così incendiaria e galvanizzante, e ora era un potente punto di riferimento politico e mediatico, si è rivelato impossibile abbandonarla. Ha attirato lettori sui siti web, finanziamenti per i ricercatori e l’attenzione dei politici. Questa ambiguità lessicale è il principale focus della nuova ricerca.

Come osservano gli autori, l’articolo 3(60) dell’EU AI Act delinea quattro condizioni che definiscono un ‘deepfake’.

1: Vera Luna

Innanzitutto, il contenuto deve essere generato o manipolato, cioè creato da zero utilizzando l’AI (generazione) o alterato da dati esistenti (manipolazione). La carta sottolinea la difficoltà di distinguere tra risultati di editing di immagini ‘accettabili’ e deepfake manipolativi, considerando che le foto digitali non sono, in ogni caso, vere rappresentazioni della realtà.

La carta sostiene che una luna generata da Samsung è argomentabilmente autentica, poiché la luna è improbabile che cambi aspetto, e poiché il contenuto generato dall’AI, addestrato su immagini lunari reali, è quindi probabile che sia accurato.

Tuttavia, gli autori sostengono anche che poiché il sistema Samsung è stato mostrato per generare un’immagine ‘migliorata’ della luna in un caso in cui l’immagine originale non era la luna stessa, ciò sarebbe considerato un ‘deepfake’.

Sarebbe impraticabile stilare un elenco completo di casi di utilizzo diversi intorno a questa funzionalità ad hoc. Pertanto, l’onere della definizione sembra passare, ancora una volta, ai tribunali.

2: TextFakes

In secondo luogo, il contenuto deve essere in forma di immagine, audio o video. Il contenuto del testo, sebbene soggetto ad altre obbligazioni di trasparenza, non è considerato un deepfake ai sensi dell’AI Act. Ciò non è trattato in dettaglio nel nuovo studio, sebbene possa avere un impatto notevole sull’efficacia dei visivi deepfake (vedi sotto).

3: Problemi del Mondo Reale

In terzo luogo, il contenuto deve assomigliare a persone, oggetti, luoghi, entità o eventi esistenti. Questa condizione stabilisce una connessione con il mondo reale, significando che le immagini completamente fabbricate, anche se fotorealistiche, non qualificherebbero come deepfake. Recital 134 dell’EU AI Act sottolinea l’aspetto ‘somiglianza’ aggiungendo la parola ‘apprezzabilmente’ (un apparente rinvio a successive sentenze giudiziarie).

Gli autori, citando lavori precedenti, considerano se un viso generato dall’AI debba appartenere a una persona reale o se debba solo essere sufficientemente simile a una persona reale per soddisfare questa definizione.

Ad esempio, come si può determinare se una sequenza di immagini fotorealistiche che rappresentano il politico Donald Trump ha l’intento di impersonificazione, se le immagini (o i testi allegati) non menzionano specificamente lui? Riconoscimento facciale? Indagini sugli utenti? Una definizione di ‘senso comune’ di un giudice?

Ritornando al problema dei ‘TextFakes’ (vedi sopra), le parole costituiscono spesso una parte significativa dell’atto di un visivo deepfake. Ad esempio, è possibile prendere un’immagine (non alterata) o un video di ‘persona a’ e dire, in una didascalia o in un post sui social media, che l’immagine è di ‘persona b’ (supponendo che le due persone abbiano una somiglianza).

In un tale caso, nessun AI è necessario, e il risultato può essere sorprendentemente efficace – ma costituisce anche un ‘deepfake’?

4: Ritocca, Rimodella

Infine, il contenuto deve apparire autentico o veritiero a una persona. Questa condizione sottolinea la percezione degli spettatori umani. Il contenuto che è riconosciuto come rappresentante una persona o un oggetto reale solo da un algoritmo non sarebbe considerato un deepfake.

Di tutte le condizioni in 3(60), questa è la più ovvia che si riferisce al giudizio successivo di un tribunale, poiché non consente alcuna interpretazione tramite mezzi tecnici o meccanizzati.

Ci sono chiaramente alcune difficoltà intrinseche nel raggiungere un consenso su una tale stipulazione soggettiva. Gli autori osservano, ad esempio, che persone diverse e diversi tipi di persone (come bambini e adulti) possono essere variamente disposti a credere in un particolare deepfake.

Gli autori notano inoltre che le avanzate capacità AI di strumenti come Photoshop sfidano le definizioni tradizionali di ‘deepfake’. Mentre questi sistemi possono includere salvaguardie di base contro contenuti controversi o proibiti, espandono drasticamente il concetto di ‘ritocco’. Gli utenti possono ora aggiungere o rimuovere oggetti in modo molto convincente e fotorealistico, raggiungendo un livello professionale di autenticità che ridefinisce i confini della manipolazione delle immagini.

Gli autori affermano:

‘Sosteniamo che la definizione attuale di deep fake nell’AI Act e le corrispondenti obbligazioni non sono sufficientemente specificate per affrontare le sfide poste dai deep fake. Analizzando il ciclo di vita di una foto digitale dal sensore della fotocamera alle funzionalità di editing digitale, troviamo che:

‘(1.) I deep fake sono mal definiti nell’EU AI Act. La definizione lascia troppo spazio per ciò che è un deep fake.

‘(2.) Non è chiaro come le funzionalità di editing come la funzione “best take” di Google possano essere considerate un’eccezione alle obbligazioni di trasparenza.

‘(3.) L’eccezione per le immagini sostanzialmente modificate solleva domande su cosa costituisca una modifica sostanziale del contenuto e se tale modifica debba essere percepibile da una persona naturale.’

Prendere Eccezione

L’EU AI Act contiene eccezioni che, gli autori sostengono, possono essere molto permissive. Articolo 50(2), affermano, offre un’eccezione nei casi in cui la maggior parte di un’immagine originale non è alterata. Gli autori notano:

‘Cosa può essere considerato contenuto nel senso dell’articolo 50(2) nei casi di audio, immagini e video digitali? Ad esempio, nel caso delle immagini, dobbiamo considerare lo spazio dei pixel o lo spazio visibile percepibile dagli esseri umani? Le manipolazioni sostanziali nello spazio dei pixel potrebbero non cambiare la percezione umana, e d’altra parte, piccole perturbazioni nello spazio dei pixel possono cambiare drasticamente la percezione.’

I ricercatori forniscono l’esempio di aggiungere una pistola alla foto di una persona che sta puntando verso qualcuno. Aggiungendo la pistola, si sta cambiando al massimo il 5% dell’immagine; tuttavia, il significato semantico della parte cambiata è notevole. Pertanto, sembra che questa eccezione non tenga conto di alcuna comprensione ‘di buon senso’ dell’effetto che un piccolo dettaglio può avere sul significato generale di un’immagine.

La sezione 50(2) consente anche eccezioni per una ‘funzionalità di editing standard’. Poiché l’Atto non definisce cosa significhi ‘editing standard’, anche funzionalità di post-elaborazione estreme come la funzione Best Take di Google sembrerebbero essere protette da questa eccezione, osservano gli autori.

Conclusione

L’intenzione dichiarata del nuovo lavoro è di incoraggiare gli studi interdisciplinari sulla regolamentazione dei deepfake e di agire come punto di partenza per nuovi dialoghi tra scienziati informatici e studiosi di diritto.

Tuttavia, la carta stessa soccombe alla tautologia in diversi punti: utilizza frequentemente il termine ‘deepfake’ come se il suo significato fosse evidente, mentre critica l’EU AI Act per non aver definito cosa costituisca effettivamente un deepfake.

Pubblicato per la prima volta lunedì, 16 dicembre 2024