Leader di pensiero

Una Guida Pratica per Output di LLM Difendibili

C’è un’ipotesi silenziosa che attraversa la maggior parte dei deploy di GenAI aziendali: se l’output sembra giusto, allora è giusto. In ambienti a basso rischio, questo è un accorgimento ragionevole. In settori regolamentati, come la sanità, la finanza, i farmaceutici e il controllo della qualità, è un problema in attesa di emergere.

Il momento in cui un output di LLM influenza una decisione clinica, un record finanziario o un documento di conformità, la scorrevolezza smette di essere un proxy per l’affidabilità. E quando un auditor, un regolatore o un team legale chiede quali dati sono stati utilizzati, quali regole sono state applicate e chi li ha approvati, “il modello lo ha detto” non è una risposta che qualcuno possa approvare.

Questo è il divario di responsabilità che la maggior parte dei team GenAI non sta progettando. Ecco come chiuderlo.

Perché “Sembra Giusto” è lo Standard Sbagliato

La valutazione tradizionale dell’AI si concentra sull’accuratezza, sulla latenza e sul costo. Questi sono importanti. Ma gli ambienti regolamentati introducono un quarto asse che gli altri non possono sostituire: la tracciabilità.

Il EU AI Act, ora in vigore, richiede che i sistemi di intelligenza artificiale ad alto rischio mantengano la documentazione tecnica, i log di tracciabilità e le prove di supervisione umana durante tutto il loro ciclo di vita. La prima bozza di linee guida dell’FDA sull’AI nello sviluppo di farmaci e biologici segnala la stessa direzione per le scienze della vita. Questi framework non valutano la scorrevolezza. Richiedono sistemi che possano essere ricostruiti, ispezionati e difesi.

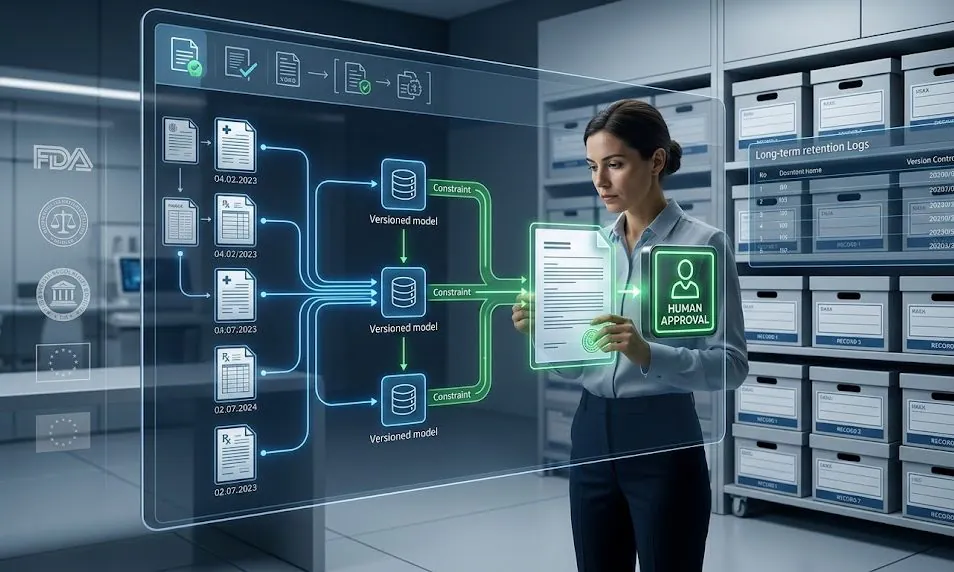

Un output di LLM difendibile è quello che può essere rintracciato attraverso una catena di prove verificabile: quali dati ha utilizzato, quali vincoli lo hanno plasmato, chi lo ha revisionato e cosa è stato conservato per l’ispezione futura. Senza quella catena, anche un output corretto è indefendibile.

Questo ridefinisce cosa significhi “pronto per la produzione” per l’AI negli ambienti governati.

I Quattro Pilastri di GenAI Pronto per l’Audit

La costruzione di sistemi di LLM difendibili si riduce a quattro requisiti di ingegneria. Non sono principi astratti – sono decisioni infrastrutturali che determinano se il tuo sistema possa sopravvivere allo scrutinio.

1. Provenienza: Controlla Dove il Modello Ottiene le Sue Informazioni

Il modo di fallimento più comune nell’AI aziendale è anche il meno visibile: i modelli che attingono a conoscenze generali o a fonti di dati poco definite. Quando non c’è un confine di conoscenza controllato, gli output non possono essere rintracciati a una fonte verificabile e la ricostruzione diventa impossibile.

Un rimedio pratico è stabilire un confine di conoscenza approvato: documenti e set di dati versionati di cui il sistema è esplicitamente autorizzato a utilizzare. Ogni risposta dovrebbe portare un pacchetto di prove minimo: un identificatore di fonte con versione e data di efficacia, un log di recupero che mostra cosa è stato richiesto e selezionato, e citazioni in linea. Una regola operativa utile: no citazione, no affermazione.

Ciò converte il sistema da una generazione basata sulla memoria a un ragionamento basato sulle prove. La distinzione diventa critica quando qualcuno deve ricostruire un output specifico settimane o mesi dopo la sua generazione.

2. Vincoli: Sostituisci l’Improvvisazione con un Comportamento Controllato

I LLM sono costruiti per essere convincenti. Senza vincoli, ottimizzano per la plausibilità, e la plausibilità in un contesto regolamentato è dove vive il rischio.

I vincoli sono il meccanismo che trasforma un generatore di testo probabilistico in un componente di esecuzione limitato. Nella pratica, ciò significa:

- Generazione vincolata alla fonte: ogni affermazione richiede una fonte approvata e versionata. Nessuna fonte significa nessuna risposta — solo rifiuto o escalation.

- Schemi di output strutturati: le risposte seguono formati definiti che le macchine e gli auditor possono validare, non solo leggere.

- Applicazione del confine di fiducia: il contenuto recuperato è trattato come input, affrontando direttamente i rischi di iniezione di prompt che possono compromettere sia la sicurezza che la tracciabilità.

- Accesso con privilegi minimi: il modello interagisce solo con i dati e gli strumenti di cui ha realmente bisogno, mantenendo pulite le tracce di audit.

I vincoli non sono una casella di controllo per la conformità. Sono la decisione architettonica che determina se il tuo sistema possa essere auditato affatto.

3. Revisione: Rendi la Supervisione Umana uno Strato di Controllo Formale

Nell’AI regolamentata, la revisione umana non può essere ad hoc. Deve essere stratificata per il rischio (output ad alto rischio attiva una convalida più severa) e basata su eventi, attivandosi quando la fiducia del modello è bassa, le fonti sono assenti o vengono rilevati degli anomali.

Il EU AI Act richiede esplicitamente che gli esseri umani possano interpretare, annullare e fermare le decisioni guidate dall’AI nei casi di utilizzo ad alto rischio. Soddisfare questo requisito significa che i record di revisione devono catturare chi ha approvato un output, in quali condizioni e con quale livello di scrutinio. “Qualcuno l’ha controllato” non è un controllo. Un record di revisione documentato e con timestamp è.

Ciò eleva la revisione dalla QA manuale a uno strato di governance formale, che è esattamente come i regolatori stanno iniziando a trattarlo.

4. Conservazione: Rendi la Responsabilità Durevole

Senza log, non c’è traccia di audit. Senza una traccia di audit, la responsabilità è teorica.

Allo stesso tempo, conservare tutto crea rischi propri, particolarmente dove i dati di salute o finanziari sensibili sono soggetti a requisiti di minimizzazione ai sensi di framework come GDPR o HIPAA.

L’approccio pratico è un modello a più livelli. Conservare sempre i metadati del modello e della versione, gli identificatori di fonte, le decisioni di politica e i timestamp. Conservare il contenuto dell’interazione (prompt, output e tracce complete) in modo selettivo, in base alla classificazione del rischio, con opportuni controlli di accesso e redazione. L’obiettivo è abilitare la ricostruzione di qualsiasi output senza raccogliere eccessivamente dati che creano esposizione a valle.

Come Ciò Si Presenta nella Pratica

Considerate come ciò si applica nelle scienze della vita, dove CFR 21 Part 11 richiede che i record elettronici siano attribuibili, leggibili, contemporanei, originali e accurati. Un LLM che genera documentazione regolamentare deve soddisfare tutti e cinque i criteri – non solo produrre testo leggibile.

In questo contesto, i quattro pilastri non sono miglioramenti opzionali. Sono la barra minima per un sistema conforme. La provenienza assicura che l’output sia attribuibile e originale. I vincoli assicurano che rimanga all’interno di confini definiti. La revisione assicura che sia contemporanea con la supervisione umana. La conservazione assicura che sia leggibile e ispezionabile.

La stessa logica si applica nei servizi finanziari, dove MiFID II richiede record delle decisioni e della razionale alla base, e nella sanità, dove i sistemi di supporto alle decisioni cliniche affrontano un’attenzione crescente sull’esplicabilità e sul pregiudizio.

Il Cambiamento Più Ampio

Il GenAI sta passando dall’esperimentazione all’infrastruttura operativa. Questa transizione innalza lo standard per ciò che i sistemi accettabili sembrano.

Un output utile non è più sufficiente. Le organizzazioni hanno bisogno di output che possano essere spiegati, rintracciati e difesi sotto scrutinio, perché l’AI sta facendo cose che portano conseguenze reali.

I team che progettano la difendibilità fin dall’inizio saranno in grado di scalare l’AI in modo sicuro e mantenere la fiducia regolamentare. Quelli che non lo fanno affronteranno alla fine lo stesso momento: un’audit, una domanda semplice su un output specifico e nulla da mostrare.

Costruire un’AI pronta per l’audit non significa rallentare. Significa costruire qualcosa che possa durare.