Intelligenza artificiale

Perché i Sistemi di Video Generativi non Possono Creare Film Completati?

L’avvento e il progresso del video generativo AI ha spinto molti osservatori occasionali a predire che l’apprendimento automatico dimostrerà la morte dell’industria cinematografica come la conosciamo – invece, singoli creatori saranno in grado di creare blockbuster in stile Hollywood a casa, sia su sistemi GPU locali che su sistemi basati su cloud.

È possibile? Anche se è possibile, è imminente, come molti credono?

Che gli individui saranno eventualmente in grado di creare film, nella forma che li conosciamo, con personaggi coerenti, continuità narrativa e fotorealismo totale, è abbastanza possibile – e forse addirittura inevitabile.

Tuttavia, ci sono diverse ragioni fondamentali per cui questo non è probabile che si verifichi con sistemi di video basati su Modelli di Diffusione Latente.

Questo ultimo fatto è importante perché, al momento, questa categoria include ogni sistema di testo-per-video (T2) e immagine-per-video (I2V) disponibile, tra cui Minimax, Kling, Sora, Imagen, Luma, Amazon Video Generator, Runway ML, Kaiber (e, per quanto possiamo discernere, la funzionalità video pendente di Adobe Firefly); tra molti altri.

Qui, stiamo considerando la prospettiva di vere auteur produzioni full-length gen-AI, create da individui, con personaggi coerenti, cinematografia e effetti visivi almeno pari allo stato attuale dell’arte a Hollywood.

Vediamo alcuni dei più grandi ostacoli pratici alle sfide coinvolte.

1: Non Puoi Ottenere un’Immagine di Seguito Accurata

L’incoerenza narrativa è il più grande di questi ostacoli. Il fatto è che nessun sistema di generazione video attualmente disponibile può creare un’immagine di seguito veramente accurata*.

Ciò è dovuto al fatto che il modello di diffusione di denoising al cuore di questi sistemi si basa su rumore casuale, e questo principio fondamentale non è adatto a reinterpretare esattamente lo stesso contenuto due volte (ad esempio, da angoli diversi, o sviluppando l’immagine precedente in un’immagine di seguito che mantiene la coerenza con l’immagine precedente).

Quando vengono utilizzati prompt di testo, da soli o insieme a immagini ‘seed’ caricate (input multimodale), i token derivati dal prompt eliciteranno contenuti semanticamente appropriati dallo spazio latente addestrato del modello.

Tuttavia, ulteriormente ostacolato dal fattore ‘rumore casuale’, non lo farà mai nella stessa modalità due volte.

Ciò significa che le identità delle persone nel video tenderanno a spostarsi, e gli oggetti e gli ambienti non corrisponderanno all’immagine iniziale.

Questo è il motivo per cui i clip virali che ritraggono visuali straordinarie e un output di livello Hollywood tendono a essere singole immagini o una ‘montagna di mostra’ delle capacità del sistema, dove ogni immagine presenta personaggi e ambienti diversi.

Estratti da una montagna generativa AI di Marco van Hylckama Vlieg – fonte: https://www.linkedin.com/posts/marcovhv_thanks-to-generative-ai-we-are-all-filmmakers-activity-7240024800906076160-nEXZ/

L’implicazione in queste raccolte di generazioni video ad hoc (che possono essere disoneste nel caso di sistemi commerciali) è che il sistema sottostante può creare narrazioni continue e coerenti.

L’analogia sfruttata qui è un trailer di un film, che presenta solo un minuto o due di immagini dal film, ma dà al pubblico un motivo per credere che l’intero film esista.

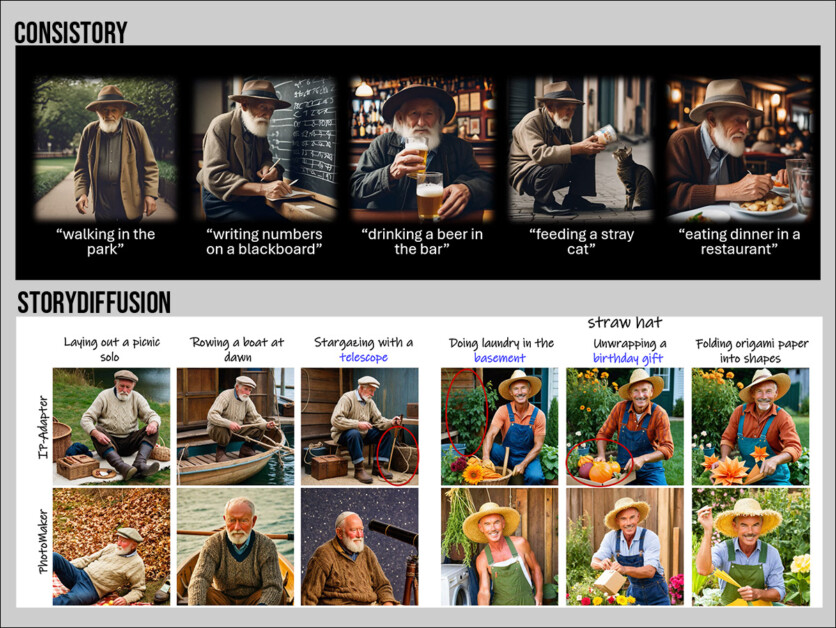

Gli unici sistemi che attualmente offrono coerenza narrativa in un modello di diffusione sono quelli che producono immagini fisse. Questi includono NVIDIA’s ConsiStory, e diversi progetti nella letteratura scientifica, come TheaterGen, DreamStory, e StoryDiffusion.

Due esempi di ‘statica’ coerenza narrativa, da modelli recenti:: Fonti: https://research.nvidia.com/labs/par/consistory/ e https://arxiv.org/pdf/2405.01434

In teoria, si potrebbe utilizzare una versione migliore di tali sistemi (nessuno dei sopra menzionati è veramente coerente) per creare una serie di immagini di seguito, che potrebbero essere unite in una sequenza.

Allo stato attuale dell’arte, questo approccio non produce immagini di seguito plausibili; e, in ogni caso, abbiamo già deviato dal sogno auteur aggiungendo uno strato di complessità.

Possiamo, inoltre, utilizzare Low Rank Adaptation (LoRA) modelli, addestrati specificamente su personaggi, cose o ambienti, per mantenere una migliore coerenza tra le immagini.

Tuttavia, se un personaggio desidera apparire in un nuovo costume, un intero nuovo LoRA dovrà generalmente essere addestrato che incorpori il personaggio vestito in quel modo (sebbene sottocategorie come ‘vestito rosso’ possano essere addestrate in singoli LoRA, insieme a immagini adeguate, non sono sempre facili da lavorare).

Ciò aggiunge una notevole complessità, anche a una scena di apertura in un film, dove una persona esce dal letto, si mette un accappatoio, sbadiglia, guarda fuori dalla finestra della camera da letto e va in bagno per lavarsi i denti.

Una tale scena, che contiene circa 4-8 immagini, può essere girata in una sola mattina con procedure di filmazione convenzionali; allo stato attuale dell’arte in generative AI, rappresenta potenzialmente settimane di lavoro, più LoRA addestrati (o altri sistemi ausiliari) e una notevole quantità di post-produzione

In alternativa, può essere utilizzato video-per-video, dove immagini o CGI ordinarie vengono trasformate attraverso prompt di testo in interpretazioni alternative. Runway offre un tale sistema, ad esempio.

CGI (a sinistra) da Blender, interpretato in un esperimento di video-per-video aiutato da testo di Runway da Mathieu Visnjevec – Fonte: https://www.linkedin.com/posts/genz-tunisia_digitalcreation-liveportrait-aianimation-activity-7240776811737972736-uxiB/?