Angolo di Anderson

Aggiungere dialogo a video reali con l’AI

Un nuovo framework di intelligenza artificiale può riscrivere, rimuovere o aggiungere le parole di una persona in un video senza rigirare, in un sistema end-to-end unico.

Tre anni fa, internet sarebbe stato sconvolto da uno qualsiasi dei 20-30 framework di video-altering dell’AI pubblicati su portali accademici ogni settimana; come è, questa popolare linea di ricerca è ora diventata così prolifico da costituire quasi un altro ramo di ‘AI Slop’, e copro molto meno di tali rilasci di quanto avrei fatto due o tre anni fa.

Tuttavia, una delle attuali uscite in questa linea ha attirato la mia attenzione: un sistema integrato che può intervenire in clip video reali e interpore nuovo discorso nel video esistente (piuttosto che creare un intero clip generativo da un volto o cornice, che è molto più comune).

Nell’esempio seguente, che ho modificato insieme da una moltitudine di video di esempio disponibili sul sito web del progetto project website, vediamo prima la clip di origine reale, e poi, sotto, il discorso AI impostato nel mezzo della clip, compresa la sintesi vocale e il sync labiale:

Click to play. Local editing with stitching – one several modalities offered by FacEDiT. Please refer to source website for better resolution. Source – https://facedit.github.io/

Questo approccio è uno dei tre sviluppati per il nuovo metodo, questo intitolato ‘local editing with stitching’, e quello che più interessa gli autori (oltre a me). Essenzialmente, la clip è estesa utilizzando uno dei frame centrali come punto di partenza per la nuova interpretazione AI, e il suo successivo (reale) frame come obiettivo che la clip generativa inserita dovrebbe cercare di corrispondere. Nelle clip viste sopra, questi ‘seed’ e ‘target’ frame sono rappresentati dal video più alto che si ferma mentre il video modificato sotto fornisce riempimento generativo.

Gli autori inquadrano questo approccio di sintesi facciale e vocale come il primo metodo completamente integrato end-to-end per edit di video AI di questo tipo, osservando il potenziale di un framework completamente sviluppato come questo per la produzione di TV e film:

‘I filmmaker e i produttori di media spesso devono rivedere parti specifiche di video registrati – forse una parola è stata pronunciata male o la sceneggiatura è cambiata dopo le riprese. Ad esempio, nella scena iconica di Titanic (1997) dove Rose dice, “I’ll never let go, Jack,” il regista potrebbe decidere in seguito che dovrebbe essere “I’ll never forget you, Jack”.

‘Tradizionalmente, tali modifiche richiedono di rigirare l’intera scena, il che è costoso e richiede molto tempo. La sintesi del viso che parla offre un’alternativa pratica modificando automaticamente il movimento facciale per corrispondere al discorso rivisto, eliminando la necessità di riprese.

Sebbene le interposizioni AI di questo tipo possano affrontare cultural o resistenza dell’industria, possono anche costituire un nuovo tipo di funzionalità nei sistemi VFX guidati dall’uomo e nelle suite di strumenti. In ogni caso, per il momento, le sfide sono strettamente tecniche.

Oltre a estendere una clip attraverso ulteriore dialogo AI generato, il nuovo sistema può anche alterare il discorso esistente:

Click to play. Un esempio di modifica del discorso esistente piuttosto che interporre ulteriore discorso. Please refer to source website for better resolution.

Stato dell’arte

Non ci sono attualmente sistemi end-to-end che offrono questa tipo di capacità di sintesi; sebbene un numero crescente di piattaforme di intelligenza artificiale generativa come la serie Veo di Google, possano generare audio, e diverse altre strutture possano creare deepfaked audio, attualmente si deve creare una pipeline piuttosto coinvolta di diverse architetture e trucchi per interferire con il footage reale nel modo in cui il nuovo sistema – intitolato FacEDiT – può realizzare.

Il sistema utilizza Diffusion Transformers (DiT) in combinazione con Flow Matching per creare movimenti facciali condizionati sui movimenti e sul contenuto audio del discorso. Il sistema sfrutta i pacchetti esistenti popolari che trattano la ricostruzione facciale, compreso LivePortrait (di recente preso in carico da Kling).

In aggiunta a questo metodo, dato che il loro approccio è il primo a integrare queste sfide in una singola soluzione, gli autori hanno creato un nuovo benchmark chiamato FacEDiTBench, insieme a diverse metriche di valutazione completamente nuove adatte a questo compito specifico.

Il nuovo lavoro è intitolato FacEDiT: Unified Talking Face Editing and Generation via Facial Motion Infilling, e proviene da quattro ricercatori attraverso la Pohang University of Science and Technology (POSTECH), il Korea Advanced Institute of Science & Technology (KAIST) e The University of Texas at Austin.

Metodo

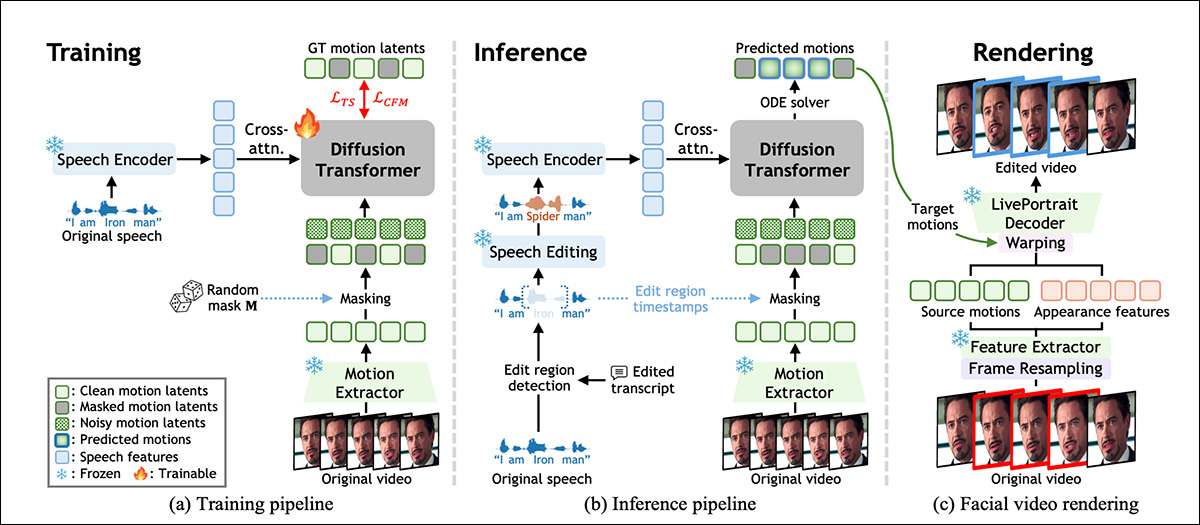

FacEDiT è stato addestrato per ricostruire il movimento facciale imparando a riempire le parti mancanti della performance originale di un attore, in base al movimento circostante e al discorso audio. Come mostrato nello schema seguente, questo processo consente al modello di agire come un riempitivo durante l’addestramento, prevedendo movimenti facciali che corrispondono alla voce mentre rimangono coerenti con il video originale:

Overview of the FacEDiT system, showing how facial motion is learned through self‑supervised infilling during training, guided by edited speech at inference, and finally rendered back into video by reusing the appearance of the original footage, while replacing only the targeted motion. Source

Al momento dell’inferenza, la stessa architettura supporta due diverse uscite a seconda di quanto del video è mascherato: modifiche parziali, dove solo una frase è alterata e il resto lasciato intatto; o generazione di intere frasi, dove nuovo movimento è sintetizzato interamente da scratch.

Il modello è stato addestrato tramite flow matching, che tratta le modifiche video come una sorta di percorso tra due versioni di movimento facciale.

Invece di imparare a indovinare come dovrebbe apparire un viso modificato partendo da zero, il flow matching impara a muoversi gradualmente e senza problemi tra un segnaposto rumoroso e il movimento corretto. Per facilitare questo, il sistema rappresenta il movimento facciale come un insieme compatto di numeri estratti da ogni frame utilizzando una versione del sopracitato sistema LivePortrait (vedi schema sopra).

Questi vettori di movimento sono progettati per descrivere espressioni e pose della testa senza intrecciare l’identità, in modo che i cambiamenti del discorso possano essere localizzati senza influenzare l’aspetto generale della persona.

Addestramento di FacEDiT

Per addestrare FacEDiT, ogni clip video è stato suddiviso in una serie di istantanee di movimento facciale, e ogni frame è stato accoppiato con il corrispondente pezzo di audio. Parti casuali dei dati di movimento sono state quindi nascoste, e il modello è stato chiesto di indovinare quali movimenti mancanti dovrebbero apparire, utilizzando sia il discorso che il movimento non mascherato circostante come contesto.

Poiché le parti mascherate e le loro posizioni variano da un esempio di addestramento all’altro, il modello impara gradualmente a gestire sia piccole modifiche interne, sia lacune più lunghe, per la generazione di intere frasi, in base a quanto informazioni riceve.

Il sistema Diffusion Transformer impara a recuperare il movimento mascherato raffinando gli input rumorosi nel tempo. Invece di alimentare il discorso e il movimento nel modello tutto in una volta, l’audio è stato inserito in ogni blocco di elaborazione attraverso cross-attention, aiutando il sistema a corrispondere i movimenti labiali più precisamente al discorso audio.

Per preservare la realismo attraverso le modifiche, l’attenzione è stata distorta verso i frame vicini piuttosto che l’intera timeline, costringendo il modello a concentrarsi sulla continuità locale, e prevenendo sfarfallii o salti di movimento ai bordi delle aree modificate. Le embeddings posizionali (che dicono al modello dove ogni frame appare nella sequenza) aiutano ulteriormente il modello a mantenere il flusso temporale naturale e il contesto.

Durante l’addestramento, il sistema impara a prevedere il movimento facciale mancante ricostruendo span mascherati in base al discorso e al movimento non mascherato circostante. Al momento dell’inferenza, questa stessa impostazione viene riutilizzata, ma con le maschere ora guidate dalle modifiche nel discorso.

Quando una parola o una frase viene inserita, rimossa o modificata, il sistema localizza la regione interessata, la maschera e rigenera il movimento che corrisponde al nuovo audio. La generazione di intere frasi è trattata come un caso speciale, dove l’intera regione è mascherata e sintetizzata da scratch.

Dati e test

La struttura del sistema comprende 22 layer per il Diffusion Transformer, ognuno con 16 attention heads e dimensioni feedforward di 1024 e 2024px. Le caratteristiche di movimento e aspetto sono state estratte utilizzando componenti frozen di LivePortrait, e il discorso è stato codificato tramite WavLM e modificato utilizzando VoiceCraft.

Un layer di proiezione dedicato mappa le caratteristiche del discorso di 786 dimensioni nello spazio latente del DiT, con solo il DiT e i moduli di proiezione addestrati da zero.

L’addestramento è stato eseguito con l’ottimizzatore AdamW a una velocità di apprendimento target di 1e‑4, per un milione di passi, su due A6000 GPU (ognuna con 48GB di VRAM), a una dimensione del batch totale di otto.

FacEDiTBench

Il dataset FacEDiTBench contiene 250 esempi, ognuno con un clip video dell’originale e del discorso modificato, e le trascrizioni per entrambi. I video provengono da tre fonti, con 100 clip da HDTF, 100 da Hallo3, e 50 da CelebV-Dub. Ognuno è stato controllato manualmente per confermare che sia l’audio che il video fossero abbastanza chiari per la valutazione.

GPT‑4o è stato utilizzato per rivedere ogni trascrizione per creare modifiche grammaticalmente valide. Queste trascrizioni riviste, insieme al discorso originale, sono state passate a VoiceCraft per produrre nuovo audio; e a ogni fase, sia la trascrizione che il discorso generato sono stati esaminati manualmente per la qualità.

Ogni campione è stato etichettato con il tipo di modifica, il momento del cambiamento e la lunghezza della span modificata, e le modifiche sono state classificate come inserimenti, cancellazioni o sostituzioni. Il numero di parole cambiate è variato da brevi modifiche di 1 a 3 parole, modifiche medie di 4 a 6 parole e modifiche più lunghe di 7 a 10 parole.

Tre metriche personalizzate sono state definite per valutare la qualità della modifica. Continuità fotometrica, per misurare quanto bene la luce e il colore di un segmento modificato si integrino con il video circostante, confrontando le differenze a livello di pixel ai bordi; continuità del movimento, per valutare la coerenza del movimento facciale, misurando i cambiamenti del flusso ottico attraverso i frame modificati e non modificati; e conservazione dell’identità, per stimare se l’aspetto del soggetto rimane coerente dopo la modifica, confrontando le embedding facciali dalle sequenze originali e generate utilizzando il modello di riconoscimento facciale ArcFace.

Test

Il modello di test è stato addestrato su materiale proveniente dai tre dataset sopracitati, per un totale di circa 200 ore di contenuto video, compresi vlog e film, nonché video YouTube ad alta risoluzione.

Per valutare la modifica del viso che parla, è stato utilizzato FacEDiTBench, in aggiunta alla parte di test di HDTF, che è diventata uno standard di riferimento per questo insieme di attività.

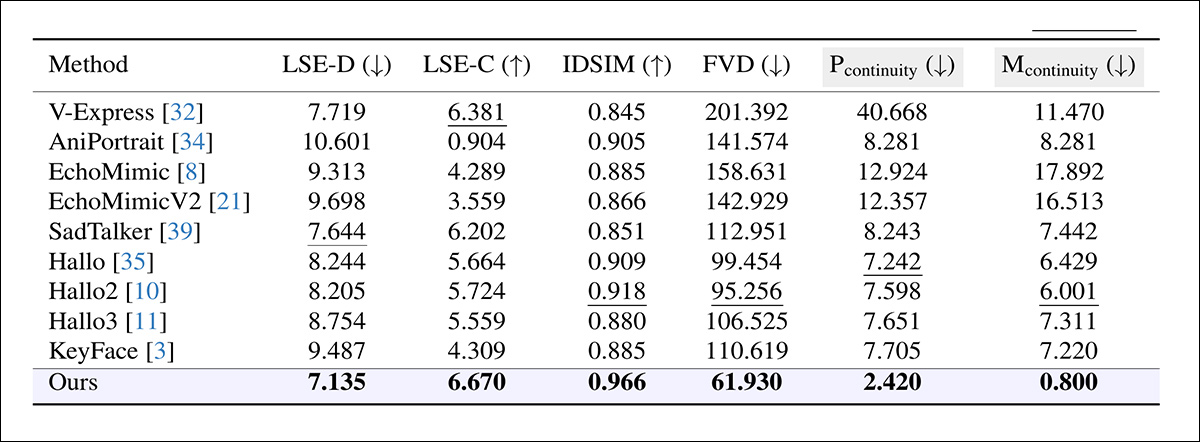

Poiché non c’erano sistemi direttamente confrontabili in grado di incorporare questo tipo di funzionalità end-to-end, gli autori hanno scelto una varietà di framework che riproducevano almeno alcune delle funzionalità target, e che potevano operare come baseline; in particolare, KeyFace; EchoMimic; EchoMimicV2; Hallo; Hallo2; Hallo3; V-Express; AniPortrait; e SadTalker.

Diverse metriche stabilite sono state utilizzate anche per valutare la qualità della generazione e della modifica, con l’accuratezza del sync labiale valutata tramite SyncNet, segnalando sia l’errore assoluto tra i movimenti labiali e l’audio (LSE-D) che un punteggio di confidenza (LSE-C); Fréchet Video Distance (FVD) quantificando quanto realistico appariva il video nel complesso; e Learned Perceptual Similarity Metrics (LPIPS), misurando la similarità percettiva tra i frame generati e originali.

Per la modifica, tutte le metriche tranne LPIPS sono state applicate solo al segmento modificato; per la generazione, l’intero video è stato valutato, con l’esclusione della continuità dei bordi.

Ogni modello è stato costretto a sintetizzare un segmento di video corrispondente, che è stato quindi inserito nel clip originale (i ricercatori notano che questo metodo ha spesso introdotto discontinuità visibili, dove la sezione modificata si incontrava con il footage circostante). Un secondo approccio è stato testato, in cui l’intero video è stato rigenerato dal modificato audio – ma questo ha inevitabilmente sovrascritto le aree non modificate, e non è riuscito a preservare la performance originale:

Comparison of editing performance across systems originally designed for talking face generation, with FacEDiT outperforming all baselines across every metric, achieving lower lip-sync error (LSE-D), higher synchronization confidence (LSE-C), stronger identity preservation (IDSIM), greater perceptual realism (FVD), and smoother transitions across edit boundaries (Pcontinuity, Mcontinuity). Gray-shaded columns highlight the key criteria for assessing boundary quality; bold and underlined values indicate the best and second-best results, respectively

Riguardo a questi risultati, gli autori commentano:

‘[Il nostro] modello supera significativamente i metodi esistenti nel compito di modifica. Raggiunge una forte continuità dei bordi e una forte conservazione dell’identità, dimostrando la sua capacità di mantenere la coerenza temporale e visiva durante la modifica. Inoltre, la sua superiore accuratezza del sync labiale e il basso FVD riflettono il realismo del video sintetizzato.’

Click to play. Results, assembled by this author from the published videos at the supporting project site. Please refer to source website for better resolution.

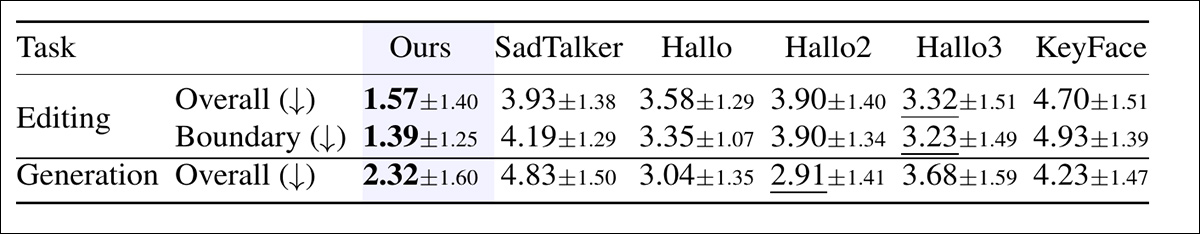

Inoltre, è stato condotto uno studio umano per valutare la qualità percepita sia della modifica che della generazione.

Per ogni confronto, i partecipanti hanno visualizzato sei video e li hanno classificati in base alla qualità complessiva, considerando l’accuratezza del sync labiale, la naturalità e il realismo del movimento della testa. Nelle prove di modifica, i partecipanti hanno anche valutato la levigatezza delle transizioni tra i segmenti modificati e non modificati:

Average ranks assigned by human evaluators, where lower means better. In both editing and generation, participants judged how natural and well-synced each video looked. For editing, they also rated how smooth the transition was between edited and unedited speech.Bold and underlined numbers indicate the top two scores.

Nello studio, FacEDiT è stato costantemente classificato come il migliore da un margine chiaro, sia per la qualità della modifica che per la levigatezza della transizione, ricevendo anche punteggi alti nell’impostazione della generazione, suggerendo che i suoi vantaggi misurati si traducono in output percepiti.

A causa della mancanza di spazio, ci riferiamo al lettore al documento originale per ulteriori dettagli degli studi di ablazione e altri test che sono stati eseguiti e segnalati nel nuovo lavoro. In verità, le offerte di ricerca prototipali di questo tipo lottano per generare sezioni di test significative, poiché l’offerta stessa è inevitabilmente una potenziale baseline per lavori successivi.

Conclusione

Anche per l’inferenza, sistemi come questo possono richiedere risorse di calcolo significative al momento dell’inferenza, rendendo difficile per gli utenti a valle – qui, presumibilmente, negozi di effetti visivi – mantenere il lavoro in loco. Pertanto, gli approcci che possono essere adattati a risorse realistiche locali saranno sempre preferiti dai fornitori, che sono obbligati per legge a proteggere i footage dei clienti e il generale IP.

Ciò non significa criticare la nuova offerta, che potrebbe funzionare perfettamente sotto pesi quantizzati o altre ottimizzazioni, e che è la prima offerta del suo genere ad attirarmi di nuovo su questa linea di ricerca da molto tempo.

Prima pubblicazione mercoledì, 17 dicembre 202. Modificato 20.10 EET, stesso giorno, per aggiungere spazio nella prima sezione del corpo.