Intelligenza artificiale

OpenAI’s GPT-4o: Il modello di intelligenza artificiale multimodale che trasforma l’interazione uomo-macchina

OpenAI ha rilasciato il suo modello di linguaggio più avanzato fino ad ora – GPT-4o, noto anche come il modello “Omni“. Questo sistema di intelligenza artificiale rivoluzionario rappresenta un grande passo avanti, con capacità che sfumano la linea tra intelligenza umana e artificiale.

Al cuore di GPT-4o si trova la sua natura multimodale nativa, che gli consente di elaborare e generare contenuti in modo fluido attraverso testo, audio, immagini e video. Questa integrazione di più modalità in un unico modello è una novità assoluta, promettendo di ridisegnare il modo in cui interagiamo con gli assistenti di intelligenza artificiale.

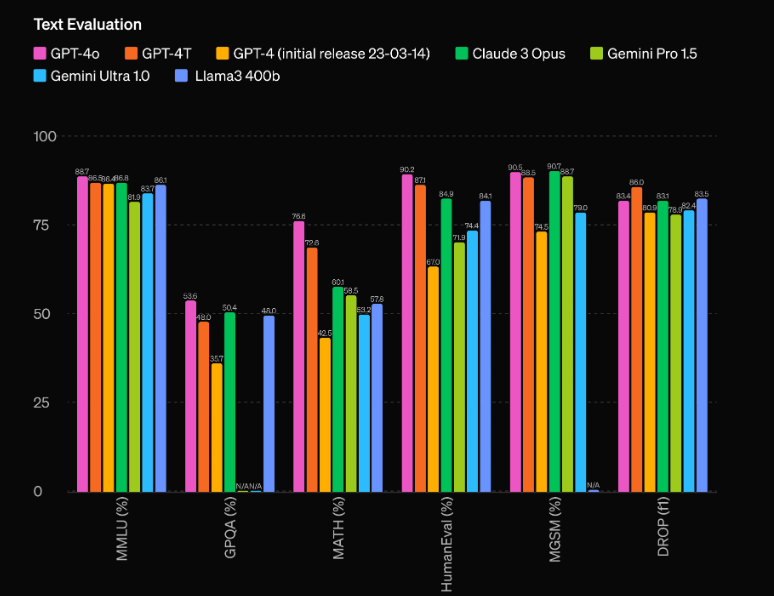

Ma GPT-4o è molto più di un semplice sistema multimodale. Vanta un miglioramento delle prestazioni impressionante rispetto al suo predecessore, GPT-4, e supera i modelli concorrenti come Gemini 1.5 Pro, Claude 3 e Llama 3-70B. Scopriamo più in dettaglio cosa rende questo modello di intelligenza artificiale veramente innovativo.

Prestazioni e efficienza senza precedenti

Uno degli aspetti più impressionanti di GPT-4o è la sua capacità di prestazioni senza precedenti. Secondo le valutazioni di OpenAI, il modello ha un vantaggio di 60 punti Elo rispetto al precedente miglior performer, GPT-4 Turbo. Questo vantaggio significativo colloca GPT-4o in una categoria a sé, superando anche i modelli di intelligenza artificiale più avanzati attualmente disponibili.

Ma le prestazioni grezze non sono l’unico ambito in cui GPT-4o eccelle. Il modello vanta anche un’efficienza impressionante, operando al doppio della velocità di GPT-4 Turbo e costando solo la metà per essere eseguito. Questa combinazione di prestazioni superiori e costo-efficienza rende GPT-4o una proposta estremamente attraente per gli sviluppatori e le aziende che cercano di integrare funzionalità di intelligenza artificiale all’avanguardia nelle loro applicazioni.

Capacità multimodali: fondendo testo, audio e visione

Forse l’aspetto più innovativo di GPT-4o è la sua natura multimodale nativa, che gli consente di elaborare e generare contenuti in modo fluido attraverso più modalità, tra cui testo, audio e visione. Questa integrazione di più modalità in un unico modello è una novità assoluta e promette di rivoluzionare il modo in cui interagiamo con gli assistenti di intelligenza artificiale.

Con GPT-4o, gli utenti possono impegnarsi in conversazioni naturali e in tempo reale utilizzando la voce, con il modello che riconosce e risponde immediatamente agli input audio. Ma le capacità non si fermano qui – GPT-4o può anche interpretare e generare contenuti visivi, aprendo un mondo di possibilità per applicazioni che vanno dall’analisi e generazione di immagini alla comprensione e creazione di video.

Una delle dimostrazioni più impressionanti delle capacità multimodali di GPT-4o è la sua capacità di analizzare una scena o un’immagine in tempo reale, descrivendo e interpretando con precisione gli elementi visivi che percepisce. Questa funzione ha profonde implicazioni per applicazioni come le tecnologie assistive per i non vedenti, nonché in campi come la sicurezza, la sorveglianza e l’automazione.

Ma le capacità multimodali di GPT-4o vanno oltre la semplice comprensione e generazione di contenuti attraverso diverse modalità. Il modello può anche fondere queste modalità in modo fluido, creando esperienze veramente immersive e coinvolgenti. Ad esempio, durante la demo live di OpenAI, GPT-4o è stato in grado di generare una canzone in base a condizioni di input, fondendo la sua comprensione del linguaggio, della teoria musicale e della generazione audio in un output coeso e impressionante.

Utilizzo di GPT0 con Python

import openai

# Sostituisci con la tua chiave API di OpenAI

OPENAI_API_KEY = "your_openai_api_key_here";

# Funzione per estrarre il contenuto della risposta

def get_response_content(response_dict, exclude_tokens=None):

if exclude_tokens is None:

exclude_tokens = []

if response_dict and response_dict.get("choices") and len(response_dict["choices"]) > 0:

content = response_dict["choices"][0]["message"]["content"].strip()

if content:

for token in exclude_tokens:

content = content.replace(token, '')

return content

raise ValueError(f"Impossibile risolvere la risposta: {response_dict}")

# Funzione asincrona per inviare una richiesta all'API di chat di OpenAI

async def send_openai_chat_request(prompt, model_name, temperature=0.0):

openai.api_key = OPENAI_API_KEY

message = {"role": "user", "content": prompt}

response = await openai.ChatCompletion.acreate(

model=model_name,

messages=[message],

temperature=temperature,

)

return get_response_content(response)

# Esempio di utilizzo

async def main():

prompt = "Ciao!"

model_name = "gpt-4o-2024-05-13"

response = await send_openai_chat_request(prompt, model_name)

print(response)

if __name__ == "__main__":

import asyncio

asyncio.run(main())

Ho:

- Importato il modulo openai direttamente invece di utilizzare una classe personalizzata.

- Rinominato la funzione openai_chat_resolve in get_response_content e apportato alcune modifiche minori alla sua implementazione.

- Sostituito la classe AsyncOpenAI con la funzione openai.ChatCompletion.acreate, che è il metodo asincrono ufficiale fornito dalla libreria Python di OpenAI.

- Aggiunto un esempio di funzione main che dimostra come utilizzare la funzione send_openai_chat_request.

Si prega di notare che è necessario sostituire “your_openai_api_key_here” con la tua chiave API di OpenAI effettiva affinché il codice funzioni correttamente.