Anderson का एंगल

वास्तविक वीडियो में संवाद जोड़ना एआई के साथ

एक नया एआई फ्रेमवर्क वीडियो को रीशूट किए बिना वीडियो में किसी व्यक्ति के शब्दों को पुनः लिखने, हटाने या जोड़ने में सक्षम है, एक एकल अंत-से-अंत प्रणाली में।

तीन साल पहले, इंटरनेट किसी भी एक 20-30 एआई वीडियो-अल्टरिंग फ्रेमवर्क से चकित होता जो अकादमिक पोर्टलों पर साप्ताहिक प्रकाशित होते हैं; जैसा कि यह लोकप्रिय शोध की धारा अब इतनी प्रचुर हो गई है कि यह लगभग ‘एआई स्लोप’ की एक अन्य शाखा का गठन करती है, और मैं इस तरह के रिलीज को दो या तीन साल पहले की तुलना में बहुत कम कवर करता हूं।

हालांकि, इस पंक्ति में एक वर्तमान रिलीज मेरी नजर में आया: एक एकीकृत प्रणाली जो वास्तविक वीडियो क्लिप में हस्तक्षेप कर सकती है और मौजूदा वीडियो में नए संवाद को अंतरप्रेषित कर सकती है (एक पूरे उत्पादक क्लिप बनाने के बजाय एक चेहरे या फ्रेम से, जो बहुत अधिक सामान्य है)।

नीचे दिए गए उदाहरणों में, जिन्हें मैंने रिलीज की परियोजना वेबसाइट पर उपलब्ध कई नमूना वीडियो से संपादित किया है, हम पहले वास्तविक स्रोत क्लिप देखते हैं, और फिर, उसके नीचे, मध्य में क्लिप में आरोपित एआई स्पीच, वॉयस सिंथेसिस और होठ सिंक्रोनाइजेशन के साथ:

प्ले करने के लिए क्लिक करें। स्थानीय संपादन के साथ सिलाई – कई मॉडलिटी में से एक जो FacEDiT द्वारा पेश की जाती है। बेहतर रिज़ॉल्यूशन के लिए स्रोत वेबसाइट पर जाएं। स्रोत – https://facedit.github.io/

यह दृष्टिकोण तीन विकसित तरीकों में से एक है जो नए तरीके के लिए विकसित किया गया है, इसे ‘स्थानीय संपादन के साथ सिलाई’ कहा जाता है, और जो लेखकों (साथ ही मुझे) को सबसे अधिक रुचिकर लगता है। मूल रूप से, क्लिप को मध्य फ्रेम का उपयोग करके एक शुरुआती बिंदु के रूप में एक नए एआई व्याख्या के लिए विस्तारित किया जाता है, और इसके बाद (वास्तविक) फ्रेम को एक लक्ष्य के रूप में जो उत्पादक डाले गए क्लिप को मिलाना चाहिए। उपरोक्त क्लिप में, इन ‘बीज’ और ‘लक्ष्य’ फ्रेम को ऊपरी वीडियो को रोकते हुए और संशोधित वीडियो नीचे को जनरेटिव इनफिल प्रदान करते हुए दर्शाया गया है।

लेखक इस चेहरे और वोकल सिंथेसिस दृष्टिकोण को इस तरह के एआई वीडियो संपादन के लिए पहली पूरी तरह से एकीकृत अंत-से-अंत विधि के रूप में फ्रेम करते हैं, टीवी और फिल्म निर्माण के लिए एक पूरी तरह से विकसित फ्रेमवर्क की संभावना का अवलोकन करते हैं:

‘फिल्म निर्माता और मीडिया उत्पादक अक्सर रिकॉर्ड की गई वीडियो के विशिष्ट भागों को संशोधित करने की आवश्यकता होती है – शायद एक शब्द गलत बोला गया था या स्क्रिप्ट शूटिंग के बाद बदल दी गई थी। उदाहरण के लिए, Titanic (1997) के प्रतिष्ठित दृश्य में जहां रोज़ कहती है, “मैं कभी भी जैक को नहीं छोड़ूंगी,” निर्देशक बाद में quyết ले सकता है कि यह “मैं जैक को कभी नहीं भूलूंगी” होना चाहिए।

‘पारंपरिक रूप से, ऐसे परिवर्तन पूरे दृश्य को फिर से शूट करने की आवश्यकता होती है, जो महंगा और समय लेने वाला है। बोलते हुए चेहरे की सिंथेसिस एक व्यावहारिक विकल्प प्रदान करती है जो स्वचालित रूप से संशोधित भाषण के अनुसार चेहरे की गति को बदल देती है, पुनः शूटिंग की आवश्यकता को समाप्त करती है।’

हालांकि इस तरह के एआई अंतरप्रेषण सांस्कृतिक या उद्योग प्रतिरोध का सामना कर सकते हैं, वे मानव-नेतृत्व वाले वीएफएक्स प्रणालियों और टूल सुइट्स में एक नए प्रकार की कार्यक्षमता का गठन कर सकते हैं। किसी भी मामले में, वर्तमान में, चुनौतियां सख्ती से तकनीकी हैं।

इसके अलावा एक क्लिप में अतिरिक्त एआई-जनरेटेड संवाद का विस्तार करने के अलावा, नई प्रणाली मौजूदा भाषण को भी बदल सकती है:

प्ले करने के लिए क्लिक करें। मौजूदा संवाद को बदलने के बजाय अतिरिक्त संवाद डालने का एक उदाहरण। बेहतर रिज़ॉल्यूशन के लिए स्रोत वेबसाइट पर जाएं।

वर्तमान स्थिति

वर्तमान में इस तरह की सिंथेसिस क्षमता प्रदान करने वाली कोई अंत-से-अंत प्रणाली नहीं है; हालांकि कई जनरेटिव एआई प्लेटफ़ॉर्म जैसे कि गूगल के वियो श्रृंखला, ऑडियो उत्पन्न कर सकते हैं, और विभिन्न अन्य फ्रेमवर्क डीपफ़ेक ऑडियो बना सकते हैं, वर्तमान में आपको वास्तविक फुटेज के साथ इस तरह के हस्तक्षेप को प्राप्त करने के लिए विभिन्न संरचनाओं और चालों का एक जटिल पाइपलाइन बनाने की आवश्यकता है। नई प्रणाली – फेसईडीआईटी – जो इसे प्राप्त कर सकती है।

प्रणाली डिफ्यूजन ट्रांसफॉर्मर (DiT) का उपयोग फ्लो मैचिंग के संयोजन में करती है ताकि चेहरे की गति को आसपास की (संदर्भ) गति और भाषण ऑडियो सामग्री पर सशर्त किया जा सके। प्रणाली मौजूदा लोकप्रिय पैकेजों का लाभ उठाती है जो चेहरे के पुनर्निर्माण से संबंधित हैं, जिनमें लाइवपोर्ट्रेट (हाल ही में क्लिंग द्वारा अधिग्रहित) शामिल हैं।

इसके अलावा इस पद्धति के लिए, यह देखते हुए कि उनका दृष्टिकोण इस तरह की चुनौतियों को एक एकल समाधान में एकीकृत करने वाला पहला है, लेखकों ने एक नए बेंचमार्क को फेसईडीटीबेंच नाम दिया है, साथ ही इस बहुत विशिष्ट कार्य के लिए उपयुक्त कई पूरी तरह से नए मूल्यांकन मेट्रिक्स बनाए हैं।

नया काम फेसईडीटी: यूनिफाइड टॉकिंग फेस एडिटिंग एंड जेनरेशन वाया फेशियल मोशन इनफिलिंग नामक है, और कोरिया के पोहांग यूनिवर्सिटी ऑफ साइंस एंड टेक्नोलॉजी (पोस्टेक), कोरिया एडवांस्ड इंस्टीट्यूट ऑफ साइंस एंड टेक्नोलॉजी (कैस्ट), और टेक्सास विश्वविद्यालय में चार शोधकर्ताओं से आता है। ऑस्टिन।

विधि

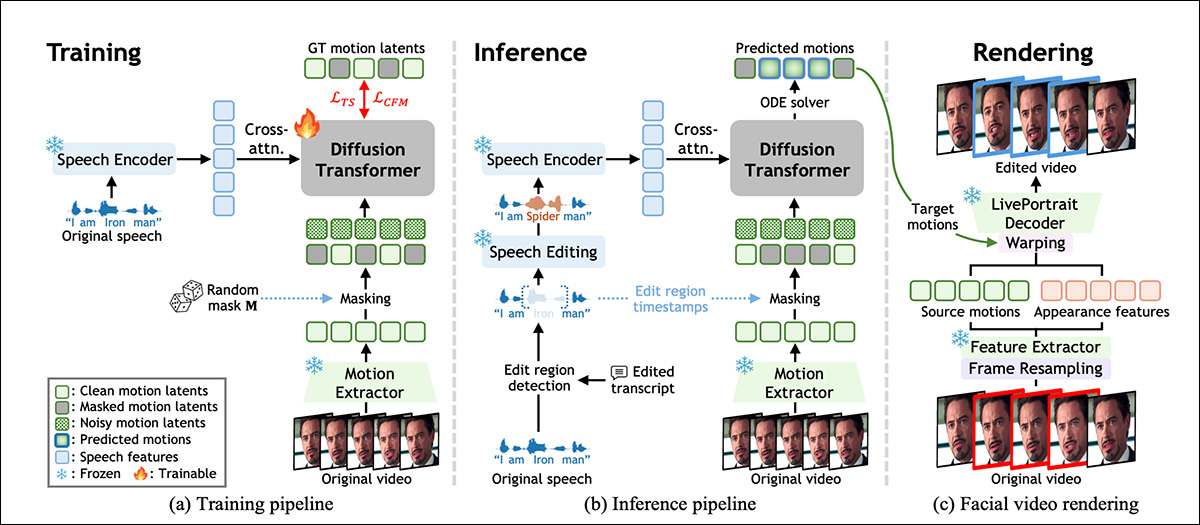

फेसईडीटी को एक अभिनेता के मूल प्रदर्शन के हिस्सों को भरने के लिए चेहरे की गति को पुनर्निर्माण करने के लिए प्रशिक्षित किया जाता है, जो आसपास की गति और भाषण ऑडियो पर आधारित होता है। जैसा कि नीचे दी गई योजना में दिखाया गया है, यह प्रक्रिया मॉडल को प्रशिक्षण के दौरान एक गैप-फिलर के रूप में कार्य करने की अनुमति देती है, जो आवाज के साथ मेल खाने वाली चेहरे की गति का अनुमान लगाती है, जबकि मूल वीडियो के साथ संगत रहती है:

फेसईडीटी प्रणाली का अवलोकन, जो दिखाता है कि चेहरे की गति को स्व-पर्यवेक्षित इनफिलिंग के माध्यम से प्रशिक्षण के दौरान कैसे सीखा जाता है, संशोधित भाषण द्वारा निर्देशित, और अंत में मूल फुटेज की उपस्थिति को पुनः प्राप्त करके वीडियो में वापस रेंडर किया जाता है, जबकि केवल लक्षित गति को बदला जाता है। स्रोत

अनुमान समय पर, समान वास्तुकला दो अलग-अलग आउटपुट का समर्थन करती है, जो इस बात पर निर्भर करती है कि वीडियो का कितना हिस्सा मास्क किया गया है: आंशिक संपादन, जहां केवल एक वाक्य बदला जाता है और बाकी को छुआ नहीं जाता है; या पूरे वाक्य का जन्म, जहां नए मोशन को पूरी तरह से स्क्रैच से संश्लेषित किया जाता है।

मॉडल को फ्लो मैचिंग के माध्यम से प्रशिक्षित किया जाता है, जो वीडियो संपादन को दो चेहरे की गति संस्करणों के बीच एक प्रकार के मार्ग के रूप में मानता है।

इसके बजाय एक संपादित चेहरे की तरह दिखने का अनुमान लगाने के लिए सीखने के, फ्लो मैचिंग धीरे-धीरे और चिकनी तरह से एक शोर प्लेसहोल्डर और सही मोशन के बीच जाने के लिए सीखती है। इसे सुविधाजनक बनाने के लिए, प्रणाली चेहरे की गति को प्रत्येक फ्रेम से निकाले गए संख्याओं के एक कॉम्पैक्ट सेट के रूप में प्रस्तुत करती है, जो उपरोक्त योजना में उल्लिखित लाइवपोर्ट्रेट प्रणाली के एक संस्करण का उपयोग करती है।

इन मोशन वेक्टर को अभिव्यक्तियों और सिर की मुद्रा का वर्णन करने के लिए डिज़ाइन किया गया है, ताकि पहचान को जोड़ा न जा सके, ताकि भाषण परिवर्तन पहचान को प्रभावित किए बिना स्थानीयकृत किया जा सके।

फेसईडीटी प्रशिक्षण

फेसईडीटी को प्रशिक्षित करने के लिए, प्रत्येक वीडियो क्लिप को चेहरे की गति के स्नैपशॉट की एक श्रृंखला में तोड़ दिया गया, और प्रत्येक फ्रेम को संबंधित ऑडियो के टुकड़े के साथ जोड़ा गया। यादृच्छिक भागों को मोशन डेटा को छुपाया गया, और मॉडल को दिए गए संदर्भ और आसपास के अनमास्क्ड मोशन के लिए संदर्भ में गायब मोशन का अनुमान लगाने के लिए कहा गया।

चूंकि प्रशिक्षण उदाहरण से उदाहरण तक मास्क किए गए स्पैन और उनकी स्थिति भिन्न होती है, मॉडल धीरे-धीरे छोटे आंतरिक संपादन और पूर्ण-क्रम संश्लेषण के लिए लंबे अंतराल, दोनों को संभालना सीखता है, जितना जानकारी यह दी जाती है।

प्रणाली के उल्लिखित डिफ्यूजन ट्रांसफॉर्मर शोर इनपुट को समय के साथ परिष्कृत करके मास्क की गई मोशन को पुनर्प्राप्त करने के लिए सीखता है। ऑडियो को एक बार में पूरे प्रोसेसिंग ब्लॉक में नहीं डाला जाता है, बल्कि प्रत्येक प्रोसेसिंग ब्लॉक में क्रॉस-ध्यान के माध्यम से थ्रेड किया जाता है, जो प्रणाली को ऑडियो भाषण के साथ होठ की गति को अधिक सटीक रूप से मिलाने में मदद करता है।

वास्तविकता को संपादन के माध्यम से बनाए रखने के लिए, ध्यान पड़ोसी फ्रेमों की तुलना में पूरे टाइमलाइन की तुलना में अधिक झुका हुआ है; स्थितिज्ञान एम्बेडिंग (जो मॉडल को बताती है कि प्रत्येक फ्रेम अनुक्रम में कहां दिखाई देती है) मॉडल को प्राकृतिक समयिक प्रवाह और संदर्भ को बनाए रखने में मदद करती है।

प्रशिक्षण के दौरान, प्रणाली मास्क किए गए स्पैन को संशोधित भाषण और आसपास की अनमास्क्ड मोशन के संदर्भ में भरने के लिए सीखती है। अनुमान समय पर, यही सेटअप पुनः उपयोग किया जाता है, लेकिन अब मास्क संपादन में भाषण में परिवर्तनों द्वारा निर्देशित किया जाता है।

जब एक शब्द या वाक्य डाला जाता है, हटा दिया जाता है, या बदल दिया जाता है, तो प्रणाली प्रभावित क्षेत्र का पता लगाती है, इसे मास्क करती है, और मेल खाने वाली मोशन को पुनः उत्पन्न करती है। पूर्ण-क्रम संश्लेषण को एक विशेष मामले के रूप में माना जाता है, जहां पूरा क्षेत्र मास्क किया जाता है और स्क्रैच से संश्लेषित किया जाता है।

डेटा और परीक्षण

प्रणाली की रीढ़ 22 परतों के लिए डिफ्यूजन ट्रांसफॉर्मर है, प्रत्येक में 16 ध्यान सिर और फीडफॉरवर्ड आयाम 1024 और 2024px हैं। मोशन और उपस्थिति विशेषताओं को जमे हुए लाइवपोर्ट्रेट घटकों का उपयोग करके निकाला जाता है, और भाषण को वावेलएम के माध्यम से एनकोड किया जाता है और वॉइसक्राफ्ट का उपयोग करके संशोधित किया जाता है।

एक समर्पित प्रोजेक्शन परत 786-आयामी भाषण विशेषताओं को डीआईटी के लेटेंट स्पेस में मैप करती है, केवल डीआईटी और प्रोजेक्शन मॉड्यूल को स्क्रैच से प्रशिक्षित किया जाता है।

प्रशिक्षण एडमडब्ल्यू ऑप्टिमाइज़र के तहत किया गया था, जिसका लक्ष्य लर्निंग दर 1e-4 थी, एक मिलियन कदम के लिए, दो ए 6000 जीपीयू (प्रत्येक में 48 जीबी वीआरएएम) पर, कुल बैच आकार आठ पर।

फेसईडीटीबेंच

फेसईडीटीबेंच डेटासेट में 250 उदाहरण हैं, प्रत्येक में मूल और संशोधित भाषण के साथ एक वीडियो क्लिप है, और दोनों के लिए प्रतिलिपि हैं। वीडियो तीन स्रोतों से आते हैं, जिनमें से 100 क्लिप एचडीटीएफ से, 100 हैलो 3 से, और 50 सेलेबीवी-डब से हैं। प्रत्येक की जांच मैन्युअल रूप से की गई थी ताकि यह पुष्टि की जा सके कि दोनों ऑडियो और वीडियो मूल्यांकन के लिए पर्याप्त रूप से स्पष्ट थे।

जीपीटी-4ओ का उपयोग प्रत्येक प्रतिलिपि को संशोधित करने के लिए किया गया था, ताकि व्याकरणिक रूप से वैध संपादन बनाया जा सके। ये संशोधित प्रतिलिपि, साथ ही मूल भाषण, वॉइसक्राफ्ट को नए ऑडियो का उत्पादन करने के लिए पारित किए गए थे; और प्रत्येक चरण में, दोनों प्रतिलिपि और उत्पन्न भाषण की गुणवत्ता के लिए मैन्युअल रूप से समीक्षा की गई थी।

प्रत्येक नमूने को संपादन के प्रकार, परिवर्तन का समय, और संशोधित स्पैन की लंबाई के साथ लेबल किया गया था, और संपादन को इन्सर्शन, डिलीशन, या सब्स्टीट्यूशन के रूप में वर्गीकृत किया गया था। परिवर्तित शब्दों की संख्या 1 से 3 शब्दों के लघु संपादन, 4 से 6 शब्दों के मध्यम संपादन, और 7 से 10 शब्दों के लंबे संपादन से भिन्न थी।

तीन कस्टम मेट्रिक्स को संपादन गुणवत्ता का मूल्यांकन करने के लिए परिभाषित किया गया था। फोटोमेट्रिक निरंतरता, संपादित खंड के साथ आसपास के वीडियो के प्रकाश और रंग के मिश्रण को मापने के लिए, सीमाओं पर पिक्सेल-स्तर के अंतरों की तुलना करके; मोशन निरंतरता, संपादित और असंपादित फ्रेमों के माध्यम से ऑप्टिकल फ्लो परिवर्तनों को मापने के लिए चेहरे की गति की निरंतरता का मूल्यांकन करने के लिए; और पहचान संरक्षण, अनुमान लगाने के लिए कि संपादन के बाद विषय की उपस्थिति बनी रहती है या नहीं, मूल और उत्पन्न अनुक्रमों से चेहरे की एम्बेडिंग की तुलना आर्कफेस चेहरे की पहचान मॉडल का उपयोग करके की जाती है।

परीक्षण

परीक्षण मॉडल को तीन ऊपर उल्लिखित डेटासेट से सामग्री पर प्रशिक्षित किया गया था, जिसमें लगभग 200 घंटे की वीडियो सामग्री शामिल थी, जिसमें व्लॉग और फिल्में शामिल थीं, साथ ही उच्च-रिज़ॉल्यूशन वाले यूट्यूब वीडियो भी शामिल थैं।

बोलते हुए चेहरे के संपादन का मूल्यांकन करने के लिए, फेसईडीटीबेंच का उपयोग किया गया था, साथ ही एचडीटीएफ परीक्षण विभाजन, जो इस सूट के कार्यों के लिए एक बेंचमार्किंग मानक बन गया है।

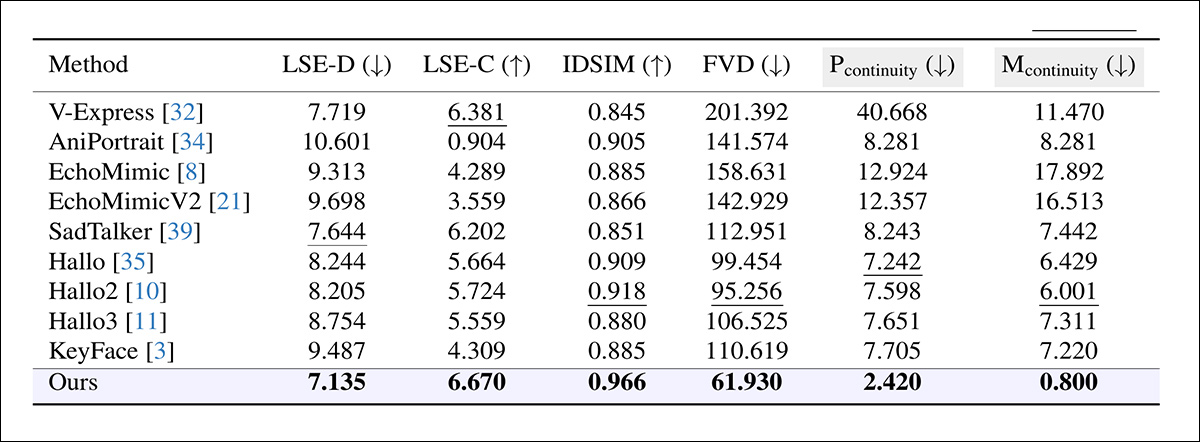

चूंकि इस तरह की अंत-से-अंत कार्यक्षमता को समाहित करने में सक्षम कोई सीधे तुलनीय प्रणाली नहीं थी, लेखकों ने विभिन्न फ्रेमवर्क का चयन किया जो कम से कम कुछ लक्ष्य कार्यक्षमता को पुनः उत्पन्न कर सकते थे, और जो बेसलाइन के रूप में कार्य कर सकते थे; विशेष रूप से, कीफेस; इकोमिमिक; इकोमिमिकवी 2; हैलो; हैलो 2; हैलो 3; वी-एक्सप्रेस; अनिपोर्ट्रेट; और सैडटॉकर।

कई स्थापित मेट्रिक्स का भी उपयोग संश्लेषण और संपादन गुणवत्ता का मूल्यांकन करने के लिए किया गया था, जिसमें लिप-सिंक सटीकता सिंकनेट के माध्यम से मूल्यांकन की गई, जिसमें लिप्स की गति और ऑडियो के बीच абсолют त्रुटि (एलएसई-डी) और एक आत्मविश्वास स्कोर (एलएसई-सी) दोनों की रिपोर्ट की गई; फ्रेचेट वीडियो दूरी (एफवीडी), जो वीडियो के वास्तविक दिखने का मूल्यांकन करती है; और सीखे गए संवेदी समानता मेट्रिक्स (एलपीआईपीएस), जो उत्पन्न और मूल फ्रेमों के बीच संवेदी समानता को मापता है।

संपादन के लिए, एलपीआईपीएस को छोड़कर सभी मेट्रिक्स को केवल संशोधित सेगमेंट पर लागू किया गया था; संश्लेषण के लिए, पूरा वीडियो मूल्यांकन किया गया था, सीमा निरंतरता को छोड़कर।

प्रत्येक मॉडल को एक मेल खाने वाला वीडियो सेगमेंट संश्लेषित करने के लिए कहा गया था, जिसे बाद में मूल क्लिप में जोड़ दिया गया था (शोधकर्ताओं का उल्लेख है कि यह विधि अक्सर संपादित खंड और आसपास के फुटेज के बीच दृश्यमान विच्छिन्नता का परिचय देती है)। एक दूसरा दृष्टिकोण भी परीक्षण किया गया था, जिसमें पूरा वीडियो संशोधित ऑडियो से स्क्रैच से पुनः उत्पन्न किया गया था – लेकिन यह अनिवार्य रूप से असंपादित क्षेत्रों को ओवरराइट करता था और मूल प्रदर्शन को संरक्षित नहीं करता था:

विभिन्न प्रणालियों के माध्यम से संपादन प्रदर्शन की तुलना, जो मूल रूप से बोलते हुए चेहरे के संश्लेषण के लिए डिज़ाइन की गई थी, फेसईडीटी सभी मेट्रिक्स पर बेसलाइन से बेहतर प्रदर्शन करती है, लिप-सिंक त्रुटि (एलएसई-डी) में कमी, सिंक्रोनाइजेशन की सटीकता (एलएसई-सी) में वृद्धि, पहचान संरक्षण (आईडीएसआईएम) में मजबूती, वास्तविकता (एफवीडी) में वृद्धि, और संपादन सीमाओं पर चिकनी संक्रमण (पी निरंतरता, एम निरंतरता) में सुधार। ग्रे रंग के कॉलम सीमा गुणवत्ता का मूल्यांकन करने के लिए मुख्य मानदंडों को हाइलाइट करते हैं; बोल्ड और अंडरलाइन मान सबसे अच्छे और दूसरे सर्वश्रेष्ठ परिणामों को इंगित करते हैं, क्रमशः।

इन परिणामों के संबंध में, लेखक टिप्पणी करते हैं:

‘[हमारा] मॉडल मौजूदा तरीकों की तुलना में संपादन कार्य पर काफी बेहतर प्रदर्शन करता है। यह मजबूत सीमा निरंतरता और उच्च पहचान संरक्षण प्राप्त करता है, जो संपादन के दौरान समयिक और दृश्य संगति बनाए रखने की इसकी क्षमता को प्रदर्शित करता है। इसके अलावा, इसकी उत्कृष्ट लिप-सिंक सटीकता और कम एफवीडी वास्तविक वीडियो की वास्तविकता को प्रतिबिंबित करती है।’

प्ले करने के लिए क्लिक करें। परिणाम, इस लेखक द्वारा प्रकाशित परियोजना साइट पर से एकत्रित किए गए। बेहतर रिज़ॉल्यूशन के लिए स्रोत वेबसाइट पर जाएं।

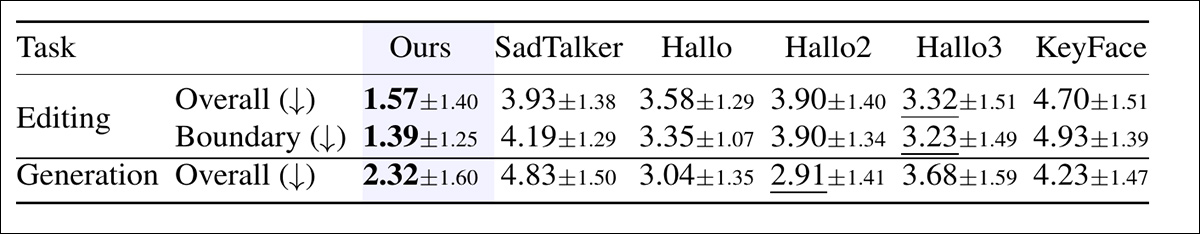

इसके अलावा, संपादन और संश्लेषण दोनों पर धारण की गई गुणवत्ता का मूल्यांकन करने के लिए एक मानव अध्ययन किया गया था।

प्रत्येक तुलना के लिए, प्रतिभागियों ने छह वीडियो देखे और उन्हें समग्र गुणवत्ता के अनुसार रैंक किया, लिप-सिंक सटीकता, प्राकृतिकता और सिर की गति की वास्तविकता पर विचार करते हुए। संपादन परीक्षणों में, प्रतिभागियों ने संपादित और असंपादित खंडों के बीच संक्रमण की चिकनाई का भी मूल्यांकन किया:

मानव मूल्यांककों द्वारा सौंपे गए औसत रैंक, जहां कम बेहतर है। संपादन और संश्लेषण दोनों में, प्रतिभागियों ने यह आंका कि प्रत्येक वीडियो कितना प्राकृतिक और सिंक्रोनाइज़ दिखता है। संपादन के लिए, उन्होंने संपादित और असंपादित भाषण के बीच संक्रमण की चिकनाई का मूल्यांकन किया।बोल्ड और अंडरलाइन संख्या शीर्ष दो स्कोर को इंगित करती हैं।

अध्ययन में, फेसईडीटी को संपादन गुणवत्ता और संक्रमण की चिकनाई दोनों के लिए एक स्पष्ट बढ़त के साथ लगातार सबसे ऊपर रैंक दी गई, साथ ही साथ संश्लेषण सेटिंग में भी मजबूत स्कोर प्राप्त किए, जो दर्शाता है कि इसके मापे गए लाभ मानव धारणा में अनुवाद करते हैं।

अवकाश की कमी के कारण, हम पाठक को विस्तृत विवरण के लिए मूल पत्र को संदर्भित करते हैं, और अतिरिक्त परीक्षण जो नए कार्य में चलाए गए और रिपोर्ट किए गए। वास्तव में, इस तरह के प्रोटोटाइप अनुसंधान प्रस्ताव आमतौर पर परीक्षण परिणाम अनुभाग का उत्पादन करने में संघर्ष करते हैं, क्योंकि मूल प्रस्ताव स्वयं एक संभावित बेसलाइन है जो बाद के कार्य के लिए हो सकता है।

निष्कर्ष

यहां तक कि अनुमान के लिए, ऐसी प्रणालियों को अनुमान समय पर महत्वपूर्ण कंप्यूटिंग संसाधनों की आवश्यकता हो सकती है, जो डाउनस्ट्रीम उपयोगकर्ताओं – यहां, स्पष्ट रूप से वीएफएक्स दुकानों के लिए – को काम को स्थानीय रूप से रखना मुश्किल बना देती है। इसलिए, वास्तविक स्थानीय संसाधनों के अनुकूल होने वाले दृष्टिकोण हमेशा प्रदाताओं द्वारा पसंद किए जाएंगे, जो ग्राहकों के फुटेज और सामान्य आईपी की रक्षा के लिए कानूनी रूप से बाध्य हैं।

यह नए प्रस्ताव की आलोचना नहीं है, जो संभावित रूप से क्वांटाइज़ड वजन या अन्य अनुकूलन के तहत संचालित हो सकता है, और जो अपनी तरह का पहला प्रस्ताव है जो मुझे काफी समय से इस शोध की धारा में वापस लाया है।

बुधवार, 17 दिसंबर, 202 को पहली बार प्रकाशित। 20.10 ईईटी, उसी दिन, पहले शरीर पैरा में अतिरिक्त स्थान के लिए संपादित किया गया।