Anderson का एंगल

वीडियो से वस्तुओं और लोगों को एआई के साथ मिटाना

नहीं, बच्चा तस्वीर में नहीं रहता है, अगर एआई कुछ करने में सक्षम है।

वीडियो और छवियों से लोगों और वस्तुओं को हटाना वीएफएक्स-केंद्रित एआई साहित्य में एक लोकप्रिय उप-धारा है, जिसमें इस चुनौती का सामना करने वाले डेटासेट और फ्रेमवर्क की बढ़ती संख्या है। इनमें से最新, चीन के फुदान विश्वविद्यालय के बड़े डेटा संस्थान से, EffectErase है, एक ‘प्रभाव जागरूक’ वीडियो वस्तु हटाने वाला सिस्टम है, जिसका दावा लेखकों द्वारा किया जाता है कि परीक्षणों में राज्य की कला में काफी सुधार हुआ है:

[वीडियो चौड़ाई=”836″ ऊंचाई=”484″ mp4=”https://www.unite.ai/wp-content/uploads/2026/03/EffectErase-Composite-examples_AE_encoded.mp4″ लूप=”true” ऑटोप्ले=”true” प्रीलोड=”auto”][/वीडियो]

परियोजना वेबसाइट से सामग्री से असेंबल किया गया, EffectErase विधि के उदाहरण (कृपया ध्यान दें कि जबकि हम एक लिंक प्रदान करते हैं, स्रोत साइट में बहुत सारे हाई-रेज और गैर-ऑप्टिमाइज्ड ऑटोप्ले वीडियो हैं जो आपके वेब ब्राउज़र की स्थिरता को प्रभावित कर सकते हैं। साथी यूट्यूब वीडियो एक आसान और पूर्ण संदर्भ है, और इस लेख के अंत में एम्बेडेड है। स्रोत

नई कार्य में लगभग 350 मूल वास्तविक दुनिया और संश्लेषित दृश्यों (सार्वजनिक भंडार* का उपयोग करके) के साथ एक अर्ध-नovel डेटासेट का निर्माण/संरक्षण शामिल था, जो विशेष उपकरण के साथ कब्जा कर लिया गया था या स्रोत और पुनः उद्देश्य में लाया गया था जो खुले स्रोत ब्लेंडर 3डी फ्रेमवर्क के आसपास निर्मित कार्य प्रवाह में।

हाइब्रिड वीडियो ऑब्जेक्ट रिमूवल (वीओआर) डेटासेट EffectErase अनुप्रयोग के लिए आधार बनाता है, जो Wan2.1 वीडियो-जनरेशन सिस्टम पर बनाया गया है। सिस्टम दो नए संबंधित बेंचमार्क भी परिभाषित करता है: वीओआर Eval और वीओआर वाइल्ड – क्रमशः, नमूनों के लिए और बिना ग्राउंड ट्रुथ के।

(हालांकि पेपर में एक सहयोगी परियोजना साइट है, यह कई हाई-रेज वीडियो से अधिक भारित है, और लोड करना मुश्किल है; इसलिए, यदि आप परियोजना साइट का उपयोग करना मुश्किल पाते हैं, तो कृपया मैंने जो अंश संकलित किए हैं उन्हें देखें, जो ऊपर एम्बेडेड वीडियो में हैं।)

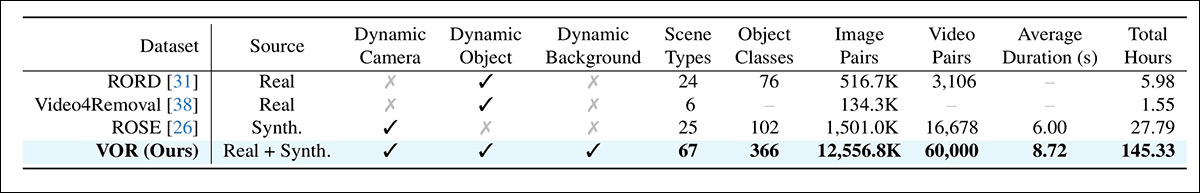

तुलनात्मक पिछले डेटासेट के साथ नए प्रस्ताव के संबंध में मात्राओं की तुलना। स्रोत

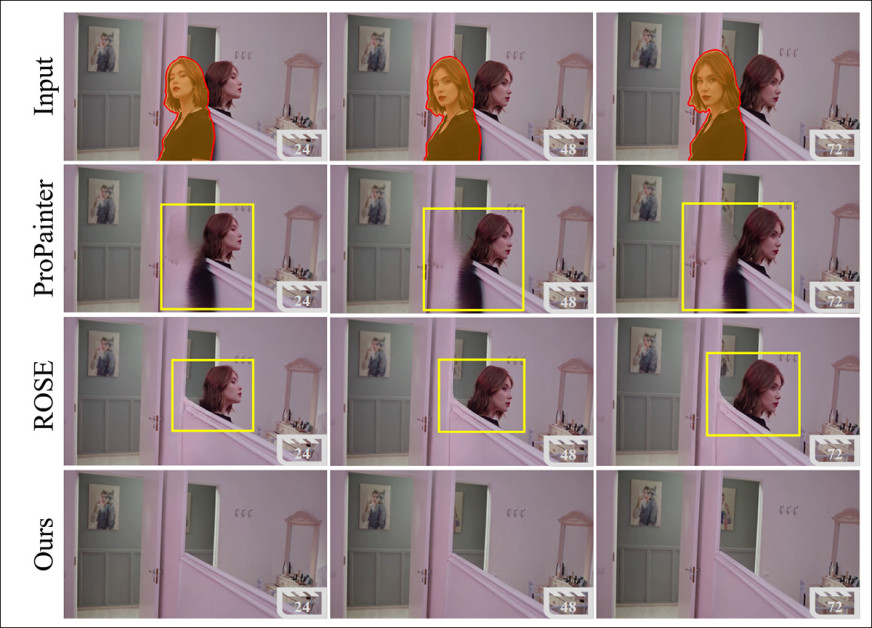

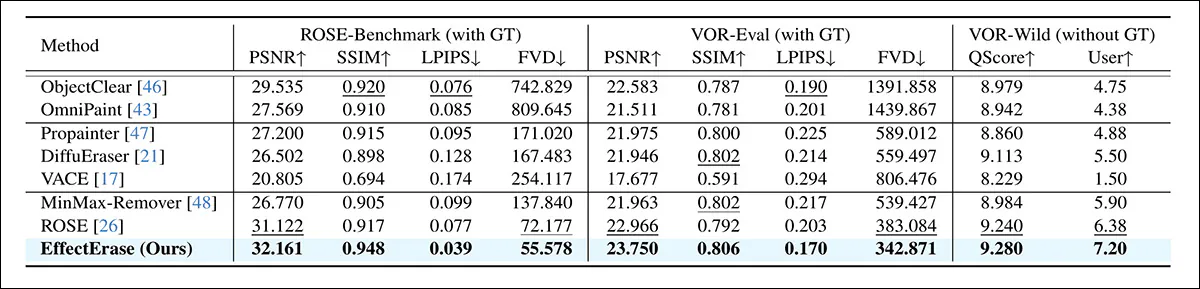

शोधकर्ता दावा करते हैं कि उनका दृष्टिकोण दोनों में राज्य की कला का प्रदर्शन करता है – मात्रात्मक मीट्रिक और मानव अध्ययन के माध्यम से निर्णय लिए गए गुणात्मक परिणाम:

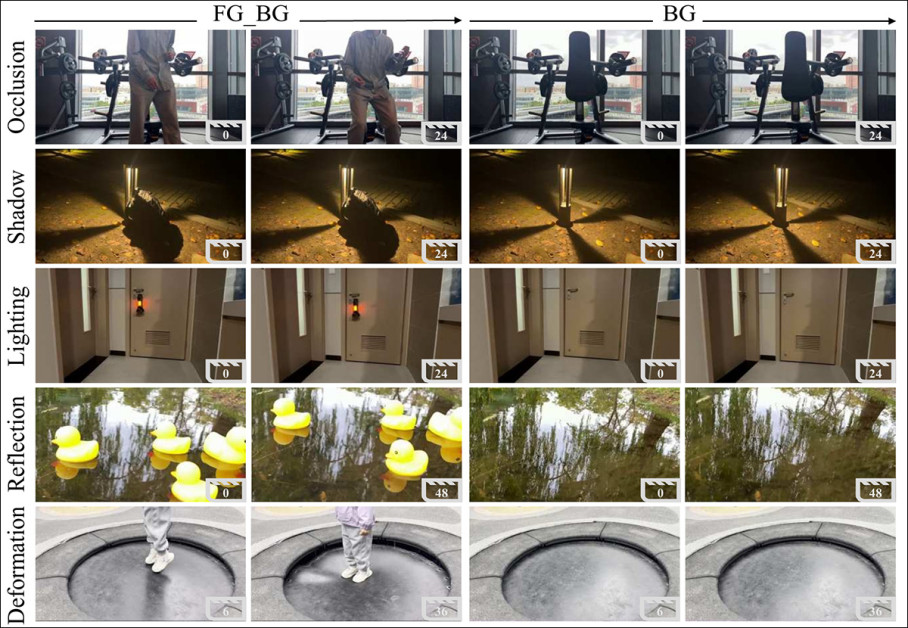

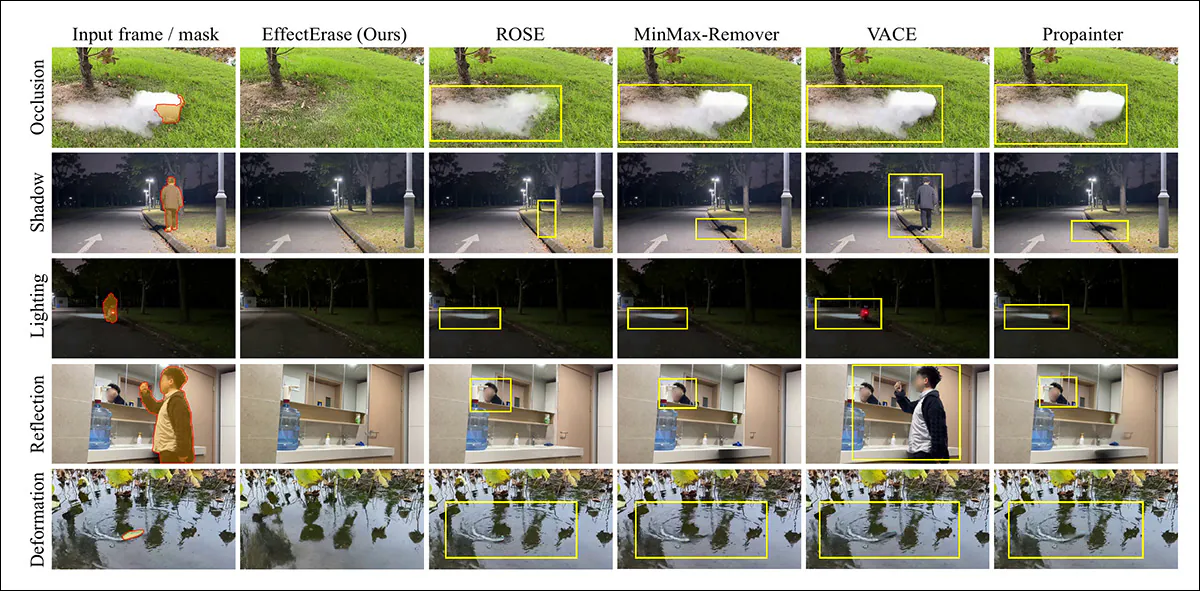

वे ध्यान देते हैं कि पिछले कार्यों ने वस्तु के सहायक प्रभावों को हटाने में हमेशा सफल नहीं हुए हैं, जैसे कि छाया और प्रतिबिंब, और उनके डेटासेट को सावधानी से बनाया गया है ताकि इस कमी को सुधारा जा सके:

पिछले दृष्टिकोणों के विफल होने के उदाहरण, जो वस्तु के लिए हटाने की मांग के अलावा माध्यमिक संकेतों पर ध्यान केंद्रित नहीं करते हैं, जैसे कि प्रतिबिंब और छाया।

नई कागज़ EffectErase: ज्वाइंट वीडियो ऑब्जेक्ट रिमूवल और इंसर्शन फॉर हाई-क्वालिटी इफेक्ट इरेज़िंग शीर्षक से है, और फुदान विश्वविद्यालय के कंप्यूटर साइंस और आर्टिफिशियल इंटेलिजेंस कॉलेज के चार शोधकर्ताओं से है。

विधि

हाइब्रिड वीओआर डेटासेट को वीडियो ऑब्जेक्ट रिमूवल के प्रयास के सभी निहितार्थों को कवर करने के लिए पर्याप्त दृश्यों की श्रृंखला को शामिल करने के लिए डिज़ाइन किया गया था:

वीओआर डेटासेट के जोड़े फ्रेम दिखाते हैं कि वस्तु हटाने को दृश्य विषय से परे उसके प्रेरित प्रभावों तक कैसे विस्तारित किया जाना चाहिए, जिसमें ऑक्लूजन, छाया, प्रकाश में परिवर्तन, प्रतिबिंब और भौतिक विकृति के उदाहरण दिखाए गए हैं, प्रत्येक को इनपुट (वस्तु उपस्थित) के रूप में प्रस्तुत किया गया है साथ ही साथ संबंधित साफ़ पृष्ठभूमि हटाने के बाद। इस लेख के अंत में एम्बेडेड वीडियो में और उदाहरण देखें।

पांच प्रतिनिधि प्रकार के ‘हस्तक्षेप’ को संबोधित किया जाना चाहिए, जो लेखकों द्वारा परिभाषित किए गए हैं ऑक्लूजन, जिसमें विभिन्न प्रकार के ग्लास और धुएं के ऑक्लूजन शामिल हैं; छाया; प्रकाश (जैसे कि जब एक वस्तु को हटाने से प्रकाश का मार्ग बनता है या बदल जाता है); प्रतिबिंब; और विकृति (जैसे कि एक उपयोगकर्ता का एक कुशन पर छाप, जो व्यक्ति के हटाने के बाद जीवित नहीं रहना चाहिए)।

<img class=" wp-image-394160" src="https://www.unite.ai/wp-content/uploads/2026/03/figure-4.jpg" alt="वीओआर के लिए डेटासेट निर्माण पाइपलाइन, जो ब्लेंडर-जेनरेटेड सिंथेटिक दृश्यों को वास्तविक दुनिया के कैप्चर के साथ जोड़ती है, जहां सिंथेटिक डेटा क्यूरेटेड 3डी परिवेशों, वस्तुओं और कैमरा ट्रेजेक्टरी से बनाया जाता है, और विभिन्न दृश्यों में रिकॉर्ड की गई वास्तविक फुटेज को केन बर्न्स मोशन के साथ बढ़ाया जाता है। एसएएम2 सेगमेंटेशन और मैनुअल रिफाइनमेंट तब संबंधित मास्क के साथ संरेखित फोरग्राउंड और बैकग्राउंड वीडियो ट्रिपलेट्स का उत्पादन करते हैं।

वास्तविक दुनिया के मूल डेटा के लिए, शोधकर्ताओं ने विभिन्न पर्यावरणों, दिन के समय और मौसम की स्थितियों में ‘साथ’ और ‘बिना’ दृश्यों को रिकॉर्ड करने के लिए निर्धारित कैमरों का उपयोग किया।

सिंथेटिक डेटा के लिए, कई दृष्टिकोणों को रेंडर किया गया, और मल्टी-ऑब्जेक्ट दृश्य बनाए गए, जिनमें जानबूझकर जटिल और चुनौतीपूर्ण प्रकार के कैमरा मूवमेंट शामिल थे, जैसा कि वास्तविक दुनिया के फुटेज में हो सकता है; और शोधकर्ता观察 करते हैं कि यह दृष्टिकोण रिमूव ऑब्जेक्ट्स विद साइड इफेक्ट्स इन वीडियोज (आरओएसई) डेटासेट के लिए उपयोग किए जाने वाले के比 अधिक परिष्कृत और प्रयास से भरा हुआ है।

गति विविधता को बढ़ाने के लिए, केन बर्न्स प्रभाव को कैमरा-कैप्चर्ड जोड़ों पर लागू किया गया था, जिसमें नियंत्रित पैन, ज़ूम और हल्के हाथ से गति जोड़ी गई थी, चौदह पूर्वनिर्धारित नियमों के तहत, प्रति जोड़े पांच मोशन पैटर्न का नमूना लिया गया था, जबकि मूल फ्रेम के भीतर फसल रखी गई थी।

स्केल और विविधता को और बढ़ाया गया सिंथेटिक वस्तुओं को कई कैमरा सेटअप के साथ जोड़कर, मास्क को मैनुअल पॉइंट प्रॉम्प्ट्स को कुंजी फ्रेम पर रखकर, सेगमेंटेशन को सेगमेंट एनीथिंग 2 (एसएएम2) के साथ प्रोपेगेट करके, परिणामों को साफ़ करके और रिफाइन करके, और प्रशिक्षण के लिए मान्य फोरग्राउंड, बैकग्राउंड और मास्क ट्रिपलेट्स को असेंबल करके बनाया गया था।

अंतिम संग्रह 60,000 जोड़े वीडियो के माध्यम से 145 घंटे का वीडियो चलाता है, जो 366 वस्तु वर्गों में 443 दृश्यों में वास्तविक और सिंथेटिक दोनों को शामिल करता है।

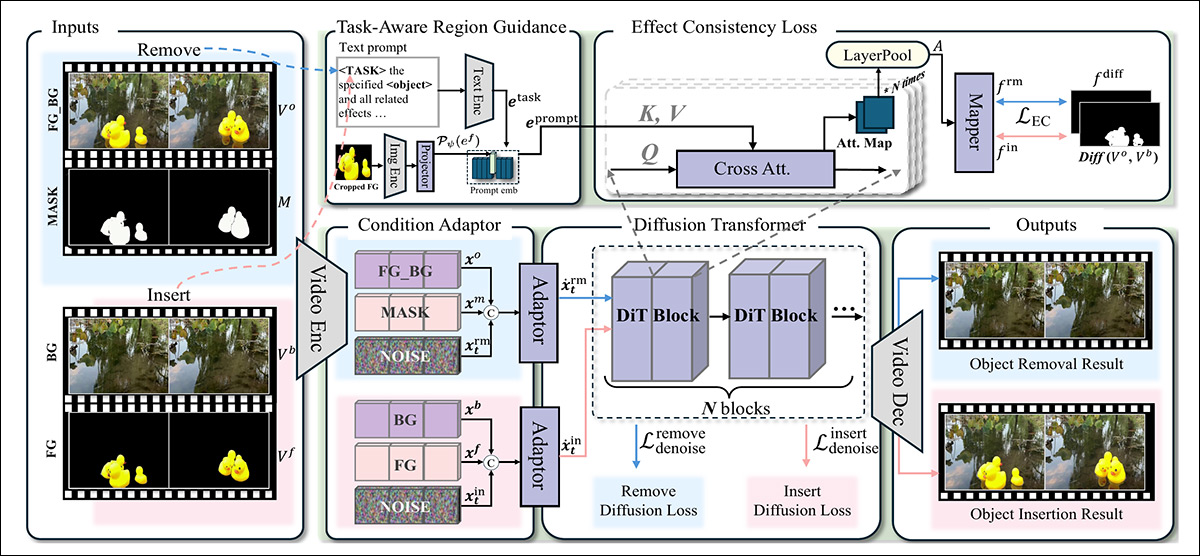

EffectErase नेटवर्क सामग्री को एक वेरिएशनल ऑटो-एनकोडर (वीएई) के माध्यम से ग्रहण करता है, जिसमें लेटेंट शोर को वान2.1 द्वारा संभाला जाता है। इस बैकबोन पर, EffectErase रिमूवल-इंसर्शन ज्वाइंट लर्निंग संचालित करता है, जो दोनों कार्यों को एक ही क्षेत्र पर एक साथ प्रशिक्षित करता है; टास्क-एवेयर रीजन गाइडेंस (टीएआरजी), जो वस्तु और कार्य टोकन के साथ क्रॉस-एटेंशन का उपयोग करके वस्तुओं और उनके प्रभावों के बीच स्थानिक-समय संबंधों को मॉडल करता है और कार्य स्विचिंग की अनुमति देता है; और इफेक्ट कंसिस्टेंसी लॉस, जो हटाने और सम्मिलन कार्यों के बीच प्रभाव क्षेत्रों को संरेखित करता है:

EffectErase फ्रेमवर्क के लिए स्कीमा। प्रशिक्षण के दौरान, जोड़े वीडियो को एक साझा लेटेंट स्पेस में एनकोड किया जाता है, शोर के साथ जोड़ा जाता है, और टास्क-एवेयर क्रॉस एटेंशन द्वारा निर्देशित एक डिफ्यूजन ट्रांसफॉर्मर द्वारा संसाधित किया जाता है, जबकि एक प्रभाव स्थिरता हानि हटाने और सम्मिलन क्षेत्रों को संरेखित करती है ताकि दोनों कार्य एक ही क्षेत्र पर ध्यान केंद्रित करें।

स्वयं हटाने और सम्मिलन प्रक्रियाएं एक साझा डिफ्यूजन बैकबोन का उपयोग करके एक साथ प्रशिक्षित की जाती हैं, ताकि मॉडल एक ही प्रभावित क्षेत्रों और संरचनात्मक संकेतों पर ध्यान केंद्रित करना सीखे।

वीडियो, पृष्ठभूमि केवल वीडियो, और मास्क, को पहले एक लेटेंट स्पेस में एनकोड किया जाता है; फिर डिफ्यूजन प्रशिक्षण के लिए शोर जोड़ा जाता है, और मॉडल शोर के तहत स्वच्छ प्रतिनिधित्व को पुनर्प्राप्त करने के लिए सीखता है। एक हल्का एडाप्टर तब शोर सुविधाओं को हटाने या सम्मिलन की स्थिति के साथ जोड़ता है, जिससे दोनों कार्य सुपरविजन साझा कर सकते हैं, जबकि अभी भी नियंत्रित रहते हैं।

टास्क-एवेयर रीजन गाइडेंस एक कार्य-विशिष्ट संकेत बनाता है जो भाषा टोकन को अग्रभूमि वस्तु से विज़ुअल सुविधाओं के साथ जोड़ता है, सीएलआईपी का उपयोग करके, एक जेनेरिक ऑब्जेक्ट टोकन को वास्तविक छवि सामग्री से प्राप्त एक एम्बेडिंग से बदल देता है। यह संयुक्त प्रतिनिधित्व पृष्ठभूमि में क्रॉस-एटेंशन के माध्यम से इंजेक्ट किया जाता है, जिससे मॉडल को वस्तु और उसके दृश्य प्रभावों के बीच स्थानिक-समय संबंधों को ट्रैक करने की अनुमति मिलती है, साथ ही कार्य स्विचिंग को भी सक्षम बनाता है।

इफेक्ट कंसिस्टेंसी लॉस हटाने और सम्मिलन प्रक्रियाओं को एक ही परिवर्तित क्षेत्रों पर ध्यान केंद्रित करने के लिए मजबूर करता है, क्योंकि दोनों कार्य एक ही वस्तु और उसके दृश्य प्रभावों से संबंधित हैं। प्रत्येक शाखा से ध्यान मानचित्रों को तब एक सoft क्षेत्र मानचित्रों में जोड़ा जाता है, और वस्तु और पृष्ठभूमि वीडियो से गणना किए गए एक अंतर मानचित्र के साथ संरेखित किया जाता है, ताकि छाया और प्रकाश जैसे सूक्ष्म परिवर्तन संरक्षित हो सकें। यह अतिरिक्त हानि सम्मिलन को हटाने के लिए मार्गदर्शन करने में मदद करती है और दोनों कार्यों को संगत बनाए रखती है।

डेटा और परीक्षण

शोधकर्ताओं ने अपने दृष्टिकोण का परीक्षण विभिन्न पेंटिंग, वीडियो पेंटिंग, और वस्तु हटाने की विधियों के खिलाफ किया: OmniPaint; ObjectClear; VACE; DiffuEraser; ProPainter; ROSE; और MiniMax-Remover.

वान2.1 को LoRA का उपयोग करके 832x480px के रिज़ॉल्यूशन पर वीओआर डेटासेट के साथ फ़ाइन-ट्यून किया गया था। 81 समान फ्रेम (वान के लिए प्रभावी सीमा, जिसके बाद त्रुटियां होने लगती हैं) को यादृच्छिक रूप से प्रशिक्षण के लिए नमूना लिया गया था, जो 129,000 पुनरावृत्तियों के लिए आठ एच100 जीपीयू पर हुआ, प्रत्येक में 80GB का वीआरएएम। बैच आकार 8 पर सेट किया गया था, और सीखने की दर 1×10 के रूप में निर्धारित की गई थी। 2, और LoRA रैंक 256 पर सेट किया गया था।

ROSE-Benchmark सिंथेटिक संग्रह एकमात्र बाहरी डेटासेट था जिसका परीक्षण किया गया था; अन्य दो वीओआर-इवल थे, वीओआर डेटासेट परीक्षण विभाजन; और वीओआर-वाइल्ड, एक परीक्षण सेट जिसमें 195 वास्तविक वीडियो शामिल थे जो इंटरनेट से स्क्रैप किए गए थे, जिनमें ‘डायनामिक ऑब्जेक्ट’ थे।

मेट्रिक्स का उपयोग किया गया था पीक सिग्नल-टू-नॉइज़ रेशियो (पीएसएनआर); स्ट्रक्चरल सिमिलैरिटी इंडेक्स (एसएसआईएम); लर्न्ड परसेप्टुअल इमेज पैच सिमिलैरिटी (एलपीआईपीएस); और फ्रेचेट वीडियो दूरी (एफवीडी). वीओआर-वाइल्ड से 195 उत्पन्न वीडियो का एक उपयोगकर्ता अध्ययन भी माना गया था, जिसमें 20 स्वयंसेवकों से औसत दर्जे की रेटिंग ली गई थी।

इसके अलावा, लेखकों ने क्यूस्कोर को एक मीट्रिक के रूप में तैयार किया, जो क्वेन-वीएल मल्टीमॉडल मॉडल का लाभ उठाता है, वस्तु-हटाने वाले वीडियो आउटपुट की गुणवत्ता का मूल्यांकन करने के लिए, अवशेष कलाकृतियों या पर्यावरणीय हटाने की कमी के संदर्भ में, जैसे कि छाया और प्रकाश प्रभाव:

आरओएसई और वीओआर बेंचमार्क पर मात्रात्मक तुलना, जिसमें सर्वश्रेष्ठ और दूसरा सर्वश्रेष्ठ परिणाम क्रमशः बोल्ड और अंडरलाइन में दिखाए गए हैं।

इन परिणामों के संबंध में, लेखकों ने टिप्पणी की:

‘[वर्तमान] छवि पेंटिंग विधियां व्यक्तिगत फ्रेम पर 2डी मॉडल का उपयोग करके काम करती हैं और इसलिए वीडियो में समयिक स्थिरता बनाए रखने में विफल रहती हैं।

हाल के वीडियो पेंटिंग [विधियां] वस्तु के साइड इफेक्ट्स को स्पष्ट रूप से मॉडल नहीं करती हैं, जिसके परिणामस्वरूप अप्राकृतिक हटाने के परिणाम होते हैं। मौजूदा वीडियो वस्तु हटाने [विधियां] वस्तु और उसके साइड इफेक्ट्स के बीच स्थानिक-समय संबंध मॉडलिंग की कमी है, और परिणामस्वरूप अक्सर कलाकृतियां और हटाई गई वस्तुओं के अवशेष उत्पन्न करती हैं।

‘कुल मिलाकर, EffectErase सभी डेटासेट और मूल्यांकन मीट्रिक्स में राज्य की कला का प्रदर्शन करता है। यह वीडियो गुणवत्ता मीट्रिक एफवीडी पर सर्वश्रेष्ठ स्कोर प्राप्त करता है, जो उत्पन्न वीडियो की समयिक चिकनाई और स्थिरता को प्रदर्शित करता है।

‘हमारी विधि क्यूस्कोर और उपयोगकर्ता प्रतिक्रिया रेटिंग में भी उच्चतम स्कोर प्राप्त करती है, जो वस्तु-हटाने वाले परिणामों की दृश्य रूप से आकर्षक प्रकृति को और प्रदर्शित करती है।’

गुणात्मक मूल्यांकन के लिए, स्थिर परिणाम कागज़ में प्रस्तुत किए गए हैं (नीचे दिखाया गया है), साथ ही चलते परिणाम परियोजना साइट और साथी यूट्यूब वीडियो प्रस्तुति में उपलब्ध हैं:

वीओआर-इवल पर ऑक्लूजन, छाया, प्रकाश, प्रतिबिंब और विकृति मामलों पर गुणात्मक तुलना। पेंटिंग विधियां मास्क के बाहर प्रभावों को हटाने में संघर्ष करती हैं, जबकि हटाने वाले मॉडल अक्सर दृश्य कलाकृतियां छोड़ देते हैं। EffectErase दोनों लक्ष्य वस्तुओं और उनके संबंधित प्रभावों को अधिक स्वच्छता से हटा देता है। कृपया स्रोत पत्र के लिए बेहतर रिज़ॉल्यूशन के लिए देखें, और परियोजना साइट के लिए वीडियो उदाहरणों के लिए।

हम पाठकों को विभिन्न संबंधित उदाहरणों के लिए परियोजना साइट के साथ-साथ इस लेख के अंत में एम्बेडेड आधिकारिक यूट्यूब वीडियो का भी संदर्भ देते हैं:

[वीडियो चौड़ाई=”1204″ ऊंचाई=”172″ mp4=”https://www.unite.ai/wp-content/uploads/2026/03/comp_vor_remove_WILD_ENV001_00024_stack_encoded.mp4″ लूप=”true”][/वीडियो]

प्ले करने के लिए क्लिक करें। EffectErase की परियोजना साइट से एक नमूना तुलना। कृपया बेहतर रिज़ॉल्यूशन (उपरोक्त सावधानियों के साथ) और आगे के उदाहरणों के लिए साइट पर जाएं।

लेखकों का टिप्पणी है:

‘वीडियो पेंटिंग [विधियां] अक्सर मास्क्ड क्षेत्रों में कलाकृतियां उत्पन्न करती हैं और वस्तु द्वारा उत्पन्न साइड इफेक्ट्स को पूरी तरह से हटाने में विफल रहती हैं। पिछले वस्तु हटाने वाले दृष्टिकोण, जैसे कि [आरओएसई] और [मिनिमैक्स-रिमूवर], लक्ष्य वस्तुओं को हटाने में अच्छा प्रदर्शन करते हैं लेकिन साइड इफेक्ट्स के साथ अभी भी संघर्ष करते हैं, विशेष रूप से ऑक्लूजन, छाया, प्रकाश, प्रतिबिंब और विकृति दृश्यों में।

‘इसके विपरीत, EffectErase दोनों लक्ष्य वस्तुओं और उनके संबंधित प्रभावों को प्रभावी ढंग से हटा देता है, जिसके परिणामस्वरूप स्वच्छ, सुसंगत और उच्च गुणवत्ता वाले परिणाम होते हैं। ‘

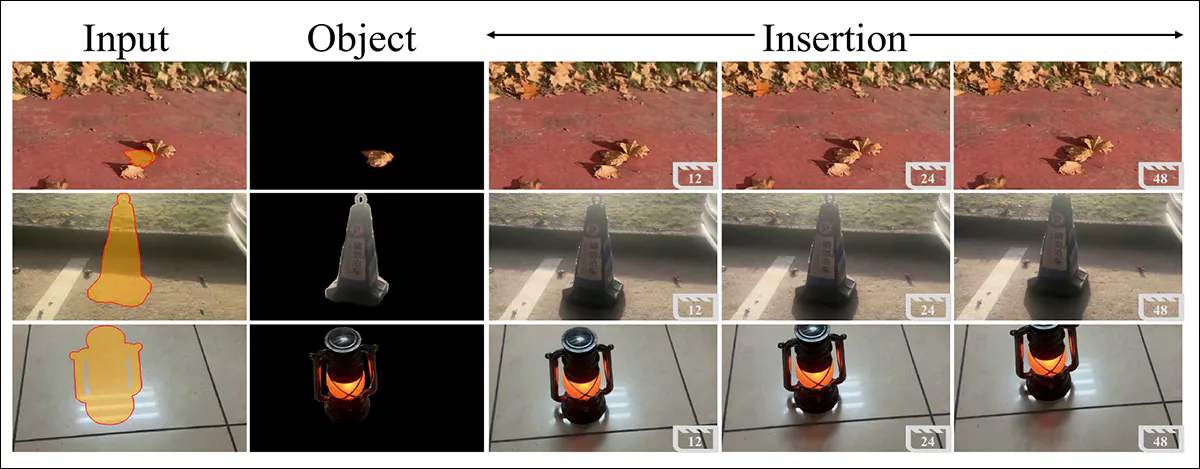

अंत में, शोधकर्ता यह देखते हैं कि उनकी विधि हटाने के बजाय सम्मिलन कार्यों की ओर भी अनुकूलित की जा सकती है, बिना किसी अतिरिक्त प्रशिक्षण की आवश्यकता के:

वीडियो वस्तु सम्मिलन परिणाम। EffectErase वस्तुओं को सम्मिलित करता है, पृष्ठभूमि सामग्री को संरक्षित करता है और फ्रेम भर में संगत वस्तु-प्रेरित प्रभाव जैसे छाया और प्रतिबिंब उत्पन्न करता है।

सम्मिलन कार्य के लिए वीडियो परिणाम (समय-विशिष्ट) यूट्यूब वीडियो उदाहरणों में देखे जा सकते हैं (साथ ही इस लेख के अंत में समय-स्टैम्प के बिना एम्बेडेड)।

निष्कर्ष

साहित्य में समान परियोजनाओं पर एक नज़र यह बताती है कि कई लोग अभी भी आशा कर रहे हैं कि सामान्य-उद्देश्य वीएफएक्स मॉडल अंततः इस प्रकार की कार्यक्षमता को एक सामान्य ‘टूलकिट’ मॉडल में शामिल करेंगे जो विभिन्न प्रभावों के लिए डिज़ाइन किया गया है, न कि केवल इस विशिष्ट कार्य के लिए।

हालांकि, ‘जैक ऑफ ऑल ट्रेड्स’ सिद्धांत पर, यह मानना उचित लगता है कि समर्पित प्रणाली जैसे EffectErase आगे भी सामान्य दृष्टिकोणों पर एक बढ़त बनाए रखेंगे; इस सावधानी के साथ कि अंतर अंततः इतना संकुचित हो जाएगा कि अतिरिक्त प्रयास के लायक नहीं होगा।

* एक आशा है कि बढ़ती चिंताओं के साथ आईपी-प्रोवेनांस मुद्दे के बारे में, सभी ऐसे स्रोतों का उल्लेख किया जाएगा; लेकिन यदि नई कार्य से उपलब्ध सामग्री 3डी मॉडल के स्रोत को सूचीबद्ध करती है, तो मुझे यह संदर्भ नहीं मिल पाया।

† प्रदान किया गया संदर्भ एक सामान्य व्याख्यात्मक पाठ है जो 2013 से है, जिसमें विशिष्ट वीएई का विवरण नहीं दिया गया है।

†† पेपर से लिया गया, यह एक सेमेंटिक रूप से अस्पष्ट विवरण है, क्योंकि फ़ाइन-ट्यूनिंग और LoRA अलग-अलग प्रक्रियाएं हैं जिनकी बहुत अलग मांगें हैं।

पहली बार शनिवार, 21 मार्च, 2026 को प्रकाशित