Anderson का एंगल

एआई वीडियो ने बिल्ली सेल्फी को परफेक्ट कर दिया

एआई वीडियो जनरेटर अक्सर परिणाम देते हैं जो करीब होते हैं, लेकिन सिगर के मामले में आपके टेक्स्ट-प्रॉम्प्ट की आवश्यकताओं को पूरा करने में असफल रहते हैं। लेकिन एक नई उच्च-स्तरीय मरम्मत सभी अंतर बनाती है。

जनरेटिव वीडियो सिस्टम अक्सर वास्तव में रचनात्मक या जंगली वीडियो बनाने में कठिनाइयों का सामना करते हैं और अक्सर उपयोगकर्ता के टेक्स्ट-प्रॉम्प्ट की अपेक्षाओं पर खरे नहीं उतरते हैं।

इसका एक कारण जुड़ाव है – यह तथ्य कि दृष्टि/भाषा मॉडल को अपने स्रोत डेटा पर प्रशिक्षण की अवधि पर समझौता करना होगा। बहुत कम प्रशिक्षण, और अवधारणाएं लचीली हैं, लेकिन पूरी तरह से गठित नहीं हैं – बहुत अधिक, और अवधारणाएं सटीक हैं, लेकिन अब पर्याप्त लचीली नहीं हैं ताकि उन्हें नए संयोजनों में शामिल किया जा सके।

आप वीडियो को नीचे दिए गए एम्बेडेड वीडियो से समझ सकते हैं। बाएं हाथ पर वह तरह का आधा-अधूरा समझौता है जो कई एआई सिस्टम वीडियो में देते हैं जो एक मांग वाले प्रॉम्प्ट (प्रॉम्प्ट वीडियो के शीर्ष पर चार उदाहरणों में है) के जवाब में जो कुछ ऐसा मांगता है जो वास्तविक प्रशिक्षण उदाहरण से बहुत कल्पनाशील है। दाएं हाथ पर, एक एआई आउटपुट है जो प्रॉम्प्ट का बेहतर पालन करता है:

[वीडियो चौड़ाई=”1280″ ऊंचाई=”500″ mp4=”https://www.unite.ai/wp-content/uploads/2025/12/factorized-video-000001.mp4″ लूप=”सच”][/वीडियो]

प्ले करने के लिए क्लिक करें (कोई ऑडियो नहीं)। दाएं, हम ‘फैक्टराइज्ड’ वान 2.2 को प्रॉम्प्ट पर वास्तव में डिलीवर करते हुए देखते हैं, ‘वैनिला’ वान 2.2 की तुलना में जो बाएं हाथ पर है। कृपया बेहतर रिज़ॉल्यूशन और अधिक उदाहरणों के लिए स्रोत वीडियो फ़ाइलों को देखें, हालांकि यहाँ देखे गए क्यूरेटेड संस्करण परियोजना साइट पर मौजूद नहीं हैं और इस लेख के लिए इकट्ठे किए गए हैं। स्रोत

खैर, हालांकि हमें ताली बजाने वाले बतख के मानव हाथों को माफ करना होगा (!), यह स्पष्ट है कि दाएं हाथ पर उदाहरण मूल टेक्स्ट-प्रॉम्प्ट का पालन करते हैं जो बाएं हाथ पर होने वाले लोगों की तुलना में बहुत बेहतर है।

दिलचस्प बात यह है कि दोनों वास्तुकला मूल रूप से एक ही वास्तुकला हैं – लोकप्रिय और बहुत क्षमता वाले वान 2.2, एक चीनी रिलीज़ जिसने इस साल ओपन सोर्स और शौकिया समुदायों में महत्वपूर्ण जमीन हासिल की है।

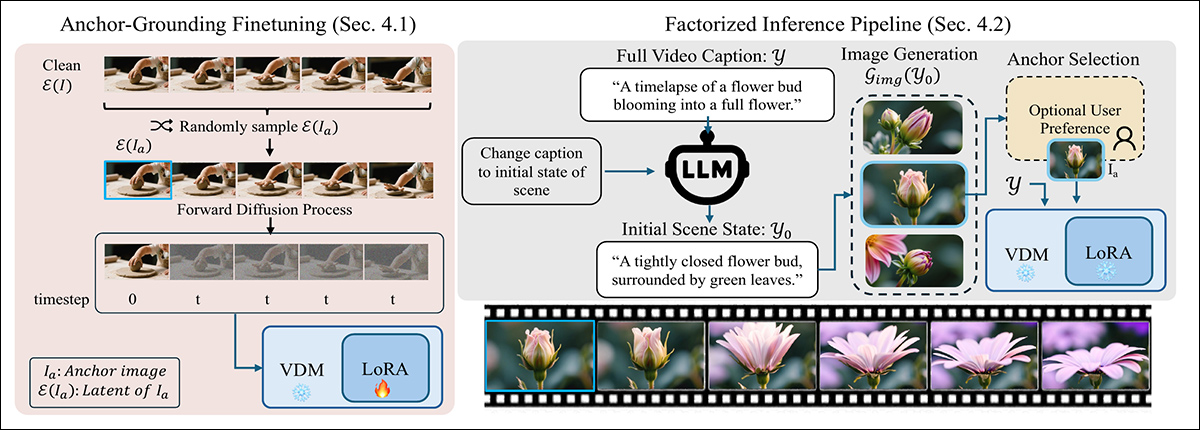

अंतर यह है कि दूसरा जनरेटिव पाइपलाइन फैक्टराइज्ड है, जिसका अर्थ है कि एक बड़े भाषा मॉडल (एलएलएम) का उपयोग पहले (बीज) फ्रेम को फिर से व्याख्या करने के लिए किया गया है, ताकि यह उपयोगकर्ता की मांग को पूरा करने में बहुत आसान हो जाए।

यह ‘विज़ुअल एंकरिंग’ एक छवि को इंजेक्ट करने के लिए शामिल है जो इस एलएलएम-एन्हांस्ड प्रॉम्प्ट से बनाई गई है, जेनरेटिव पाइपलाइन में एक ‘स्टार्ट फ्रेम’ के रूप में, और एक लोरा व्याख्यात्मक मॉडल का उपयोग करके ‘इंट्रूडर’ फ्रेम को वीडियो निर्माण प्रक्रिया में एकीकृत करने में मदद करने के लिए।

परिणाम, प्रॉम्प्ट विश्वासयोग्यता के संदर्भ में, काफी उल्लेखनीय हैं, विशेष रूप से एक समाधान के लिए जो काफी सुंदर प्रतीत होता है:

[वीडियो चौड़ाई=”1280″ ऊंचाई=”500″ mp4=”https://www.unite.ai/wp-content/uploads/2025/12/factorized-video-000002.mp4″ लूप=”सच”][/वीडियो]

प्ले करने के लिए क्लिक करें (कोई ऑडियो नहीं)। ‘फैक्टराइज्ड’ वीडियो जेनरेशन के और उदाहरण वास्तव में स्क्रिप्ट का पालन करते हैं। कृपया बेहतर रिज़ॉल्यूशन और अधिक उदाहरणों के लिए स्रोत वीडियो फ़ाइलों को देखें, हालांकि यहाँ देखे गए क्यूरेटेड संस्करण परियोजना साइट पर मौजूद नहीं हैं और इस लेख के लिए इकट्ठे किए गए हैं।

यह समाधान नई पेपर के रूप में आता है फैक्टराइज्ड वीडियो जेनरेशन: डीकंपोज़िंग सीन कंस्ट्रक्शन और टेम्पोरल सिंथेसिस इन टेक्स्ट-टू-वीडियो डिफ्यूजन मॉडल, और इसकी वीडियो से भरी साथी परियोजना वेबसाइट।

जबकि कई वर्तमान सिस्टम प्रॉम्प्ट सटीकता को बढ़ाने के लिए भाषा मॉडल का उपयोग करके अस्पष्ट या कम विशिष्ट पाठ को पुनः लिखने का प्रयास करते हैं, नई कार्य यह तर्क देती है कि यह रणनीति अभी भी विफल हो जाती है जब मॉडल का आंतरिक दृश्य प्रतिनिधित्व दोषपूर्ण होता है।

यहाँ तक कि एक विस्तृत पुनः लिखित प्रॉम्प्ट के साथ, टेक्स्ट-टू-वीडियो मॉडल अक्सर मुख्य तत्वों को गलत तरीके से संयोजित करते हैं या असंगत प्रारंभिक राज्यों को उत्पन्न करते हैं जो एनिमेशन के तर्क को तोड़ते हैं। जब तक पहला फ्रेम प्रॉम्प्ट का वर्णन नहीं करता है, परिणामी वीडियो पुनर्प्राप्त नहीं हो सकता है, चाहे गति मॉडल कितना भी अच्छा क्यों न हो।

पेपर स्टेट्स*:

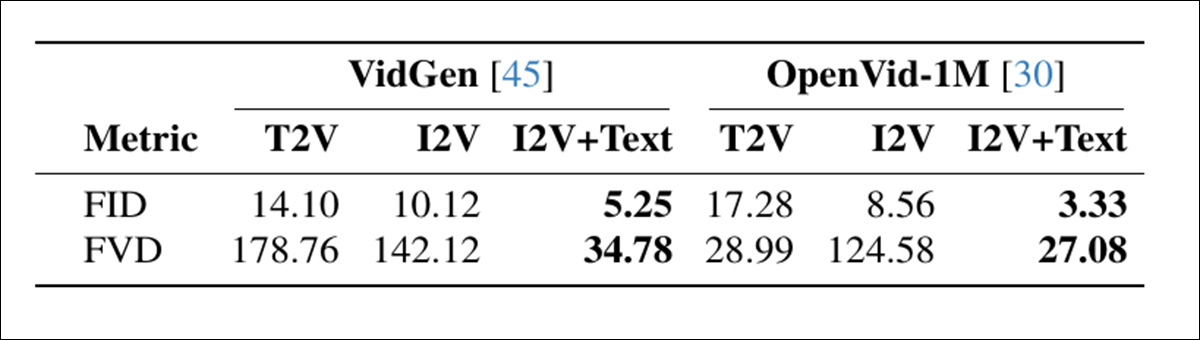

‘[टेक्स्ट-टू-वीडियो] मॉडल अक्सर वितरित रूप से स्थानांतरित फ्रेम उत्पन्न करते हैं फिर भी [मूल्यांकन स्कोर] की तुलना में समान हासिल करते हैं I2V मॉडल, यह दर्शाता है कि उनका मोशन मॉडलिंग अभी भी काफी प्राकृतिक है जब दृश्य विश्वासयोग्यता अपेक्षाकृत कम होती है।

‘[इमेज-टू-वीडियो] मॉडल पूरक व्यवहार प्रदर्शित करते हैं, मजबूत [मूल्यांकन स्कोर] सटीक प्रारंभिक दृश्यों से और कमजोर समयिक संगति, जबकि I2V+पाठ दोनों पहलुओं को संतुलित करता है।

‘यह विपरीत सुझाव देता है कि वर्तमान टी2वी मॉडल में एक संरचनात्मक असंगति: दृश्य आधार और समयिक सिंथेसिस विभिन्न प्रेरक पूर्वाग्रहों से लाभान्वित होते हैं, फिर भी मौजूदा वास्तुकला एक ही मॉडल के भीतर दोनों को एक साथ सीखने का प्रयास करती हैं। ‘

एक नैदानिक तुलना उत्पन्न मोड दिखाया कि मॉडल जिनमें स्पष्ट दृश्य एंकरिंग नहीं थी, उन्होंने गति पर अच्छा स्कोर किया, लेकिन अक्सर दृश्य लेआउट पर समझौता किया, जबकि छवि-सशर्त दृष्टिकोण ने विपरीत पैटर्न दिखाया:

[कैप्शन आईडी=”अटैचमेंट_229731″ अलाइन=”अलाइननोन” चौड़ाई=”670″]

इन निष्कर्षों से पता चलता है कि वर्तमान मॉडल दृश्य लेआउट और एनिमेशन दोनों को एक साथ सीखने का प्रयास करते हैं, भले ही दोनों कार्यों के लिए अलग-अलग प्रकार के प्रेरक पूर्वाग्रह की आवश्यकता होती है, और उन्हें अलग से संभालना बेहतर होता है।

शायद सबसे बड़ी दिलचस्पी यह है कि यह ‘ट्रिक’ स्थानीय रूप से वान 2.1 और 2.2 जैसे मॉडल के स्थापित संस्करणों पर लागू किया जा सकता है, और इसी तरह के वीडियो डिफ्यूजन मॉडल जैसे हुन्युआन वीडियो। अनुभवजन्य रूप से, क्लिंग और रनवे जैसे व्यावसायिक जनरेटिव पोर्टल की तुलना में शौकिया आउटपुट की गुणवत्ता की तुलना करना, अधिकांश प्रमुख एपीआई प्रदाता वान जैसे ओपन सोर्स ऑफरिंग्स को लोरा के साथ बेहतर बना रहे हैं, और – ऐसा लगता है – इस तरह के नए पेपर में देखे गए हैक के साथ। इसलिए यह विशेष दृष्टिकोण फॉसएस प्रतिभागियों के लिए एक पकड़ बना सकता है।

इस विधि के लिए परीक्षणों से पता चलता है कि यह सरल और मॉड्यूलर दृष्टिकोण टी2वी-कॉम्पबेंच बेंचमार्क पर एक नया राज्य-ऑफ-द-आर्ट प्रदान करता है, जो सभी परीक्षण किए गए मॉडलों में काफी सुधार करता है। लेखक नोट करते हैं कि जबकि उनकी प्रणाली विश्वासयोग्यता में क्रांति लाती है, यह पहचान ड्रिफ्ट को संबोधित नहीं करती है, जो वर्तमान में जनरेटिव एआई अनुसंधान का अभिशाप है।

नई पेपर स्विट्जरलैंड में इकोले पॉलिटेक्निक फेडरल डी लॉसन (ईपीएफएल) के चार शोधकर्ताओं से आती है।

विधि और डेटा

नई तकनीक का केंद्रीय प्रस्ताव यह है कि टेक्स्ट-टू-वीडियो (टी2वी) डिफ्यूजन मॉडल को शुरू करने वाले फ्रेम से ‘एंकर’ किया जाना चाहिए जो वास्तव में वांछित टेक्स्ट-प्रॉम्प्ट को फिट करता है।

मॉडल को शुरू करने वाले फ्रेम का सम्मान करने के लिए, नई विधि मानक डिफ्यूजन प्रक्रिया को बाधित करती है एक साफ लेटेंट को एंकर छवि से टाइमस्टेप शून्य पर इंजेक्ट करके, जो एक सामान्य शोर इनपुट को बदल देता है। यह अनजान इनपुट मॉडल को पहले से ही भ्रमित करता है, लेकिन न्यूनतम लोरा फाइनट्यूनिंग के साथ, यह एक निश्चित दृश्य एंकर के रूप में इंजेक्ट की गई फ्रेम का इलाज करना सीखता है, न कि शोर ट्रेजेक्टोरी का हिस्सा।

विधि का परीक्षण वान 2.2-14बी, वान 2.1-1बी, और कोगवीडियो 1.5-5बी के लिए लोरा बनाकर किया गया था। लोरा प्रशिक्षण 5000 यादृच्छिक रूप से नमूनाकृत क्लिप पर अल्ट्रावीडियो संग्रह से किया गया था।

प्रशिक्षण 6000 चरणों तक चला, और वान-1बी और कोगवीडियो-5बी के लिए 48 जीपीयू घंटे की आवश्यकता थी, और वान-14बी के लिए 96 जीपीयू घंटे। लेखक नोट करते हैं कि वान-5बी मूल रूप से टेक्स्ट-ओनली और टेक्स्ट-इमेज कंडीशनिंग (जो इस मामले में पुराने फ्रेमवर्क पर थोपी जा रही है) का समर्थन करता है, और इसलिए किसी भी फाइनट्यूनिंग की आवश्यकता नहीं थी।

परीक्षण

विधि के लिए चलाए गए प्रयोगों में, प्रत्येक टेक्स्ट-प्रॉम्प्ट को पहले क्वेन 2.5-7बी-इन्सट्रक्ट का उपयोग करके परिष्कृत किया गया था, जिसने परिणाम का उपयोग एक विस्तृत ‘सीड इमेज’ कैप्शन तैयार करने के लिए किया जिसमें पूरे दृश्य का वर्णन किया गया था। यह क्वेनइमेज में पारित किया गया था, जिसे ‘मैजिक फ्रेम’ को डिफ्यूजन प्रक्रिया में इंटरपोज़ करने का काम सौंपा गया था।

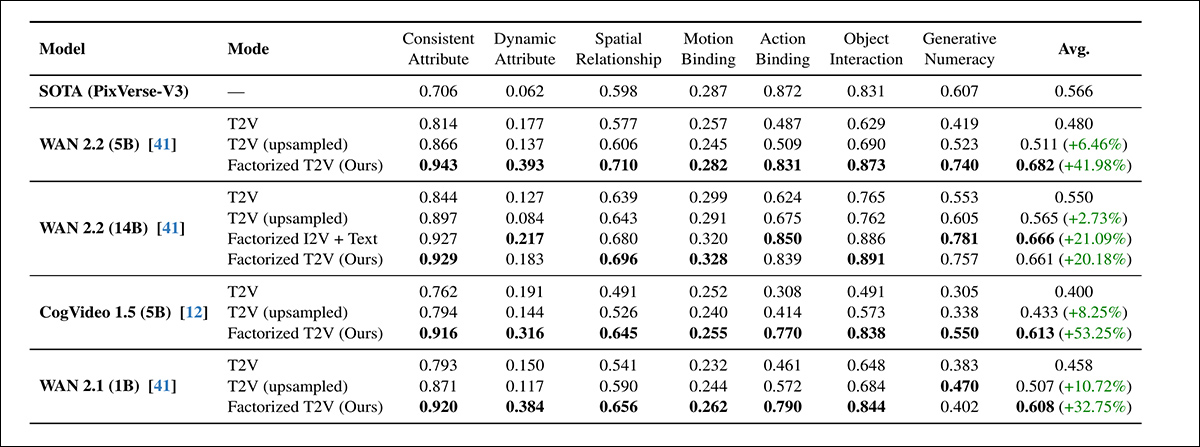

बेंचमार्क जो प्रणाली का मूल्यांकन करने के लिए उपयोग किए गए थे उनमें उल्लेखित टी2वी-कॉम्पबेंच शामिल था, जो संरचनात्मक समझ का परीक्षण करने के लिए स्कोरिंग द्वारा वस्तुओं, विशेषताओं और क्रियाओं को एक सुसंगत दृश्य में संरक्षित करने की क्षमता का मूल्यांकन करता है; और वीबेंच 2.0, जो व्यापक तर्क और 18 मीट्रिक में निरंतरता का मूल्यांकन करता है, जो रचनात्मकता, सामान्य ज्ञान तर्क, नियंत्रण, मानव विश्वासयोग्यता, और भौतिकी में समूहीकृत हैं:

[कैप्शन आईडी=”अटैचमेंट_229733″ अलाइन=”अलाइननोन” चौड़ाई=”961″]

लेखक नोट करते हैं*:

‘[अलग-अलग] मॉडलों में, एंकर इमेज जोड़ने से लगातार रचनात्मक प्रदर्शन में सुधार होता है। सभी छोटे फैक्टराइज्ड मॉडल (कोगवीडियो 5बी, वान 5बी और वान 1बी) वान 14बी टी2वी मॉडल से बेहतर प्रदर्शन करते हैं।

‘हमारा फैक्टराइज्ड वान 5बी व्यावसायिक पिक्सवर्स-वी3 बेसलाइन को भी बेहतर प्रदर्शन करता है, जो बेंचमार्क पर सबसे अच्छा रिपोर्ट किया गया मॉडल है। यह दर्शाता है कि दृश्य आधारीकरण दृश्य और क्रिया समझ में काफी सुधार कर सकता है, यहां तक कि छोटे क्षमता वाले मॉडलों में भी।

‘प्रत्येक मॉडल परिवार के भीतर, फैक्टराइज्ड संस्करण मूल मॉडल से बेहतर प्रदर्शन करता है। उल्लेखनीय रूप से, हमारा हल्का एंकर-ग्राउंडेड लोरा वान 14बी पर अपने प्रीट्रेन्ड आई2वी 14बी वेरिएंट (0.661 बनाम 0.666) के साथ तुलनीय प्रदर्शन तक पहुंचता है, बिना किसी पूर्ण पुनः प्रशिक्षण के। ‘

इसके बाद वीबेंच 2.0 राउंड आया:

[कैप्शन आईडी=”अटैचमेंट_229734″ अलाइन=”अलाइननोन” चौड़ाई=”994″]

सभी वास्तुकला में, फैक्टराइज्ड दृष्टिकोण ने मानव विश्वासयोग्यता को छोड़कर वीबेंच की प्रत्येक श्रेणी में स्कोर में वृद्धि की। वान 5बी ने वान 14बी से बेहतर प्रदर्शन किया, जो पहले के टी2वी-कॉम्पबेंच परिणामों को मजबूत करता है जो दृश्य आधारीकरण दृश्य निर्माण से अधिक योगदान देता है।

वीबेंच पर लाभ वास्तव में टी2वी-कॉम्पबेंच पर देखे गए लाभों की तुलना में छोटे थे, और लेखक इसे वीबेंच के सख्त द्विआधारी स्कोरिंग शासन के लिए जिम्मेदार ठहराते हैं।

गुणात्मक परीक्षण के लिए, पेपर स्थिर छवियों को प्रदान करता है, लेकिन हम पाठक को इस लेख में निहित संयुक्त वीडियो के लिए संदर्भित करते हैं, जो एक स्पष्ट विचार के लिए है, जिसमें यह चेतावनी है कि स्रोत वीडियो अधिक विविध और अधिक रिज़ॉल्यूशन और विविधता के साथ हैं। गुणात्मक परिणामों के संबंध में, पेपर कहता है:

‘एंकर्ड वीडियो में लगातार अधिक सटीक दृश्य संरचना, मजबूत वस्तु-विशेषता बंधन, और स्पष्ट समयिक प्रगति होती है। ‘

फैक्टराइज्ड विधि तब भी स्थिर रही जब डिफ्यूजन चरणों की संख्या 50 से 15 तक कम कर दी गई, जिसमें टी2वी-कॉम्पबेंच पर लगभग कोई प्रदर्शन हानि नहीं हुई। इसके विपरीत, टेक्स्ट-ओनली और अपसैम्पल्ड बेसलाइन दोनों ने समान परिस्थितियों में तेजी से खराब प्रदर्शन किया।

हालांकि चरणों को कम करने से सैद्धांतिक रूप से तीन गुना गति मिल सकती है, पूरी जेनरेशन पाइपलाइन केवल 2.1x तेज हो गई, जो एंकर-इमेज जेनरेशन से निश्चित लागत के कारण थी। फिर भी, परिणामों से पता चलता है कि एंकरिंग न केवल नमूना गुणवत्ता में सुधार करता है, बल्कि डिफ्यूजन प्रक्रिया को भी स्थिर करता है, जो तेजी से और अधिक कुशल जेनरेशन का समर्थन करता है जिसमें सटीकता में कोई नुकसान नहीं होता है।

परियोजना वेबसाइट अपसैम्पल्ड बनाम नए तरीके के जेनरेशन के उदाहरण प्रदान करती है, जिनमें से हम यहाँ कुछ (कम रिज़ॉल्यूशन) संपादित उदाहरण प्रदान करते हैं:

[वीडियो चौड़ाई=”1280″ ऊंचाई=”500″ mp4=”https://www.unite.ai/wp-content/uploads/2025/12/factorized-video-000003-COMPARISONS-TEXT.mp4″ लूप=”सच”][/वीडियो]

प्ले करने के लिए क्लिक करें (कोई ऑडियो नहीं)। अपसैम्पल्ड शुरुआती स्रोत बनाम लेखकों के फैक्टराइज्ड दृष्टिकोण।

लेखक निष्कर्ष निकालते हैं:

‘हमारे परिणाम सुझाव देते हैं कि सुधारित आधार, क्षमता में वृद्धि के साथ-साथ, समान रूप से महत्वपूर्ण हो सकता है। हाल के टी2वी डिफ्यूजन में प्रगति में मॉडल के आकार और प्रशिक्षण डेटा में वृद्धि पर बहुत अधिक निर्भर रही है, फिर भी बड़े मॉडल अक्सर एक सुसंगत प्रारंभिक दृश्य का अनुमान लगाने में विफल रहते हैं टेक्स्ट से अकेले।

‘यह छवि डिफ्यूजन से अलग है, जहां स्केलिंग अपेक्षाकृत सीधी है; वीडियो मॉडल में, प्रत्येक वास्तुकला सुधार को एक अतिरिक्त समयिक आयाम पर काम करना होगा, जिससे स्केलिंग काफी अधिक संसाधन गहन हो जाती है।

‘हमारे निष्कर्ष बताते हैं कि सुधारित आधार क्षमता के साथ पूरक हो सकता है दृश्य की स्थापना को संबोधित करके: गति सिंथेसिस शुरू होने से पहले सही दृश्य स्थापित करना।

‘वीडियो जेनरेशन को दृश्य संरचना और समयिक मॉडलिंग में फैक्टराइज़ करके, हम कुछ सामान्य विफलता मोड को कम करते हैं जो बड़े मॉडल की आवश्यकता के बिना है। हम इसे एक पूरक डिज़ाइन सिद्धांत के रूप में देखते हैं जो भविष्य की वास्तुकला को अधिक विश्वसनीय और संरचित वीडियो सिंथेसिस की ओर मार्गदर्शन कर सकता है। ‘

निष्कर्ष

हालांकि जुड़ाव की समस्याएं बहुत वास्तविक हैं, और उन्हें समर्पित समाधानों की आवश्यकता हो सकती है (जैसे प्रशिक्षण से पहले क्यूरेशन और वितरण मूल्यांकन में सुधार), यह देखना एक आंख खोलने वाला अनुभव रहा है कि फैक्टराइजेशन ने कई जिद्दी और ‘अटके हुए’ अवधारणा प्रॉम्प्ट-ऑर्केस्ट्रेशन को बहुत अधिक सटीक प्रस्तुतियों में ‘अनग्लू’ किया है – केवल एक मध्यम परत लोरा कंडीशनिंग के साथ, और एक उल्लेखनीय रूप से सुधारित शुरुआत/बीज छवि के हस्तक्षेप के साथ।

स्थानीय शौकिया अंतर्दृष्टि और व्यावसायिक समाधानों के बीच संसाधनों का अंतर उतना बड़ा नहीं हो सकता है, यह देखते हुए कि लगभग सभी प्रदाता अपने महत्वपूर्ण जीपीयू संसाधन निर्गम को उपभोक्ताओं के लिए तर्कसंगत बनाने की कोशिश कर रहे हैं।

अनुभवजन्य रूप से, वर्तमान फसल के अधिकांश जनरेटिव वीडियो प्रदाता प्रतीत होते हैं कि वे ब्रांडेड और सामान्य रूप से ‘सूप्ड-अप’ चीनी फॉसएस मॉडल का उपयोग कर रहे हैं। मुख्य ‘मोआत’ इनमें से किसी भी मध्यवर्ती प्रणाली को प्रतीत होता है कि उन्होंने लोरा का उपयोग करने का प्रयास किया है, या – अधिक खर्च और थोड़े अधिक पुरस्कार के साथ – वास्तव में मॉडल वजन को पूरी तरह से फाइनट्यून किया है।

इनसाइट्स इस तरह के दृष्टिकोण को और करीब ला सकते हैं, विशेष रूप से एक रिलीज़ दृश्य में जहां चीनी लोग जन एआई को लोकतांत्रिक बनाने के लिए निर्धारित हैं (निश्चित रूप से अल्ट्रूइस्टिक या आदर्शवादी कारणों के लिए नहीं), जबकि पश्चिमी व्यावसायिक हित शायद पसंद करेंगे कि बढ़ते मॉडल के आकार और नियमन अंततः किसी भी अच्छे मॉडल को एपीआई और कई स्तरों के सामग्री फिल्टर के पीछे घेर लें।

* लेखकों का जोर, मेरा नहीं।

† पेपर यह निर्दिष्ट नहीं करता है कि कौन सा जीपीयू चुना गया था, या कितने जीपीयू का उपयोग किया गया था।

†† हालांकि लोरा मार्ग अधिक संभावना है, दोनों आर्थिक आसानी के लिए और क्योंकि पूर्ण वजन, क्वांटाइज्ड वजन के विपरीत, हमेशा उपलब्ध नहीं होते हैं।

पहली बार शुक्रवार, 19 दिसंबर, 2025 को प्रकाशित