Inteligencia artificial

Síntesis de Imágenes Humanas a partir de Ondas de Radio Reflejadas

Los investigadores de China han desarrollado un método para sintetizar imágenes casi fotorealistas de personas sin cámaras, utilizando ondas de radio y Redes Adversarias Generativas (GANs). El sistema que han ideado se entrena con imágenes reales tomadas en buena luz, pero es capaz de capturar ‘fotografías’ relativamente auténticas de humanos incluso cuando las condiciones son oscuras – y incluso a través de obstáculos importantes que ocultarían a las personas de las cámaras convencionales.

Las imágenes dependen de ‘mapas de calor’ de dos antenas de radio, una que capta datos desde el techo hacia abajo, y otra que registra perturbaciones de ondas de radio desde una posición ‘en pie’.

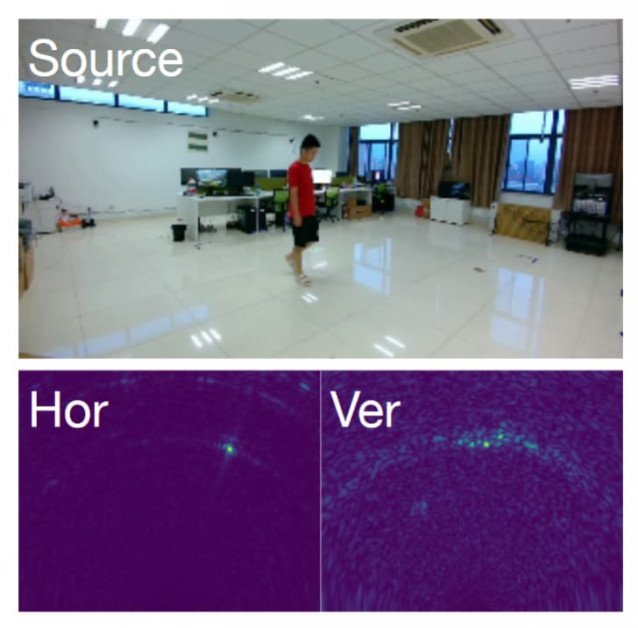

Las fotos resultantes de los experimentos de prueba de concepto de los investigadores tienen un aspecto ‘faceless’, ‘J-Horror’:

RFGAN se entrena en imágenes de personas reales en entornos controlados y en mapas de calor de ondas de radio que registran la actividad humana. Después de aprender características de los datos, RFGAN puede generar instantáneas basadas en nuevos datos de RF. La imagen resultante es una aproximación, basada en la resolución limitada de las señales de RF de baja frecuencia disponibles. Este proceso funciona incluso en entornos oscurecidos y a través de una variedad de obstáculos potenciales. Fuente: https://arxiv.org/pdf/2112.03727.pdf

Para entrenar la GAN, denominada RFGAN, los investigadores utilizaron datos coincidentes de una cámara RGB estándar y de los mapas de calor de ondas de radio concatenados correspondientes que se produjeron en el momento exacto de la captura. Las imágenes de personas sintetizadas en el nuevo proyecto tienden a estar desenfocadas de manera similar a la fotografía Daguerreotype temprana, porque la resolución de las ondas de radio utilizadas es muy baja, con una resolución de profundidad de 7,5 cm y una resolución angular de aproximadamente 1,3 grados.

Arriba, la imagen alimentada a la red GAN – abajo, los dos mapas de calor, horizontal y vertical, que caracterizan a la persona en la habitación, y que se sintetizan ellos mismos dentro de la arquitectura en una representación 3D de los datos perturbados.

El nuevo artículo, titulado RFGAN: Síntesis de Humanos Basada en RF, proviene de seis investigadores de la Universidad de Ciencia y Tecnología Electrónica de China.

Datos y Arquitectura

Debido a la falta de cualquier conjunto de datos o proyectos anteriores que compartieran este alcance, y el hecho de que las señales de RF no se han utilizado antes en un marco de síntesis de imágenes GAN, los investigadores tuvieron que desarrollar metodologías novedosas.

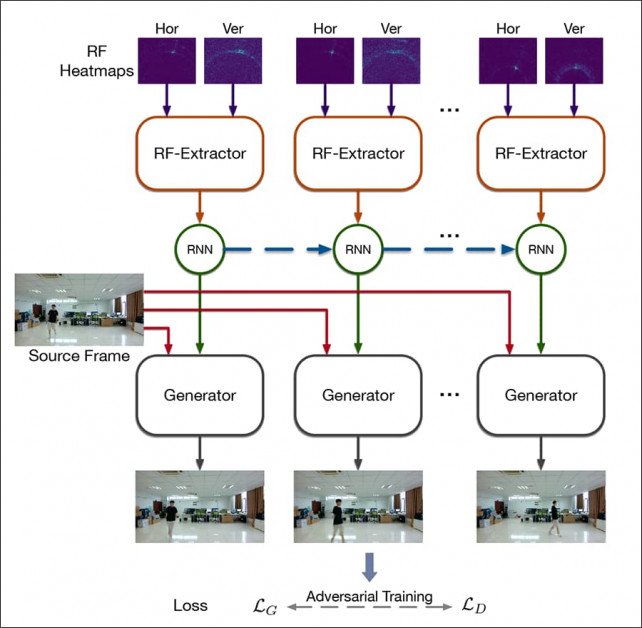

La arquitectura central de RFGAN.

Se utilizó la normalización adaptativa para interpretar las imágenes de mapa de calor gemelas durante el entrenamiento, para que correspondan espacialmente con los datos de imagen capturados.

Los dispositivos de captura de RF fueron radares de ondas milimétricas (mmWave) configurados como dos matrices de antenas, horizontal y vertical. Se utilizaron ondas continuas moduladas en frecuencia (FMCW) y antenas lineales para la transmisión y recepción.

El Generador recibe un marco de origen como capa de entrada, con la representación de RF fusionada (mapa de calor) que orquesta la red a través de la normalización en el nivel de las capas convolucionales.

Datos

Los datos se recopilaron a partir de reflejos de señales de RF de la antena mmWave a un mero 20hz, con video humano capturado simultáneamente a un muy bajo 10fps. Se capturaron nueve escenas en interiores, utilizando seis voluntarios, cada uno de los cuales llevaba ropa diferente para varias sesiones de recopilación de datos.

El resultado fue dos conjuntos de datos distintos, RF-Activity y RF-Walk, el primero que contiene 68,860 imágenes de personas en diversas posiciones (como agacharse y caminar), junto con 137,760 marcos de mapa de calor correspondientes; y el segundo que contiene 67,860 marcos de caminata humana aleatoria, junto con 135,720 pares de mapas de calor asociados.

Los datos, según la convención, se dividieron de manera desigual entre entrenamiento y prueba, con 55,225 marcos de imagen y 110,450 pares de mapas de calor utilizados para el entrenamiento, y el resto se mantuvo para la prueba. Los marcos de captura de RGB se redujeron a 320×180, y los mapas de calor se redujeron a 201×160.

El modelo se entrenó con Adam a una tasa de aprendizaje constante de 0,0002 para el generador y el discriminador, en una época de 80 y un tamaño de lote (muy escaso) de 2. El entrenamiento se llevó a cabo a través de PyTorch en una GPU de nivel de consumo solo GTX-1080, cuyos 8gb de VRAM generalmente se considerarían bastante modestos para tal tarea (explicando el bajo tamaño del lote).

Aunque los investigadores adaptaron algunas métricas convencionales para probar la realidad de la salida (detalladas en el artículo), y realizaron las pruebas de abstinencia habituales, no hubo trabajo previo equivalente con el que medir el rendimiento de RFGAN.

Interés Abierto en Señales Secretas

RFGAN no es el primer proyecto en intentar utilizar frecuencias de radio para construir una imagen volumétrica de lo que sucede en una habitación. En 2019, investigadores de MIT CSAIL desarrollaron una arquitectura llamada RF-Avatar, capaz de reconstruir humanos 3D basados en señales de frecuencia de radio en el rango Wi-Fi, en condiciones de occlusión severas.

En el proyecto de MIT CSAIL de 2019, se utilizaron ondas de radio para eliminar occlusiones, incluso incluyendo paredes y ropa, para recrear sujetos capturados en un flujo de trabajo de CGI más tradicional. Fuente: https://people.csail.mit.edu/mingmin/papers/rf-avatar.pdf

Los investigadores del nuevo artículo también reconocen el trabajo previo relacionado con el mapeo de entornos con ondas de radio (ninguno de ellos intentando recrear humanos fotorealistas), que buscaba estimar la velocidad humana; ver a través de paredes con Wi-Fi; evaluar poses humanas; y incluso reconocer gestos humanos, entre otros objetivos.

Transferibilidad y Aplicabilidad Más Amplia

Los investigadores luego se propusieron ver si su descubrimiento estaba sobreajustado al entorno de captura inicial y a las circunstancias de entrenamiento, aunque el artículo ofrece pocos detalles sobre esta fase del experimento. Afirmaron:

‘Para implementar nuestro modelo en una nueva escena, no necesitamos volver a entrenar todo el modelo desde el principio. Podemos ajustar el RFGAN preentrenado utilizando muy pocos datos (alrededor de 40s de datos) para obtener resultados similares.’

‘Las funciones de pérdida y los hiperparámetros son los mismos que en la etapa de entrenamiento. A partir de los resultados cuantitativos, encontramos que el modelo RFGAN preentrenado puede generar marcos de actividad humana deseables en la nueva escena después de ajustar con solo un poco de datos, lo que significa que nuestro modelo propuesto tiene el potencial de ser ampliamente utilizado.’

Basado en los detalles del artículo sobre esta aplicación seminal de una nueva técnica, no está claro si la red que los investigadores han creado está ‘entrenada’ exclusivamente para los sujetos originales, o si los mapas de calor de RF pueden deducir detalles como el color de la ropa, ya que esto parece estar entre los dos diferentes tipos de frecuencias involucradas en los métodos de captura óptica y de radio.

De cualquier manera, RFGAN es una forma novedosa de utilizar los poderes imitativos y representativos de las Redes Adversarias Generativas para crear una nueva y fascinante forma de vigilancia – una que podría operar potencialmente en la oscuridad y a través de paredes, de una manera incluso más impresionante que los esfuerzos recientes para ver alrededor de esquinas con luz reflejada.

8 de diciembre de 2021 (día de la primera publicación), 8:04 pm GMT+2 – se eliminó la palabra repetida. – MA