Künstliche Intelligenz

Warum sind selbstfahrende Autos die Zukunft und wie werden sie entwickelt?

Aufgrund der kürzlich eingeführten adaptiven Quarantänemaßnahmen, die in fast allen Teilen der Welt verhängt wurden, haben Luftverkehr, öffentlicher Verkehr und viele andere Branchen im Jahr 2020 einen wirklich großen Einbruch erlebt. Die Automobilwelt und insbesondere die autonomen Fahrzeuge haben jedoch während dieser schwierigen Zeit eine erhöhte Widerstandsfähigkeit gezeigt. Tatsächlich haben Unternehmen wie Ford ihre Investitionen in die Entwicklung von Elektro- und selbstfahrenden Autos um 29 Milliarden Dollar im vierten Quartal des letzten Jahres erhöht. Insbesondere werden 7 Milliarden Dollar dieser Mittel für die Entwicklung von selbstfahrenden Autos bereitgestellt. Damit schließt sich Ford General Motors, Tesla, Baidu und anderen Automobilherstellern an, die stark in autonome Fahrzeuge investieren. In diesem Artikel werden wir Ihnen erzählen, warum Unternehmen in selbstfahrende Autos investieren und wie die maschinellen Lernalgorithmen, die sie antreiben, trainiert werden.

Warum investieren so viele Unternehmen in selbstfahrende Autos?

Wenn wir alle Vorteile betrachten, die autonome Fahrzeuge bieten, ist es leicht zu verstehen, warum so viele Unternehmen in ihre Entwicklung investieren. Fahrer können Geld sparen, da sie keine teuren Versicherungspläne bezahlen müssen, es beschleunigt ihre täglichen Pendelfahrten, verbessert die Kraftstoffeffizienz und bietet viele andere Vorteile. Für Unternehmen öffnet diese Automatisierung die Tür für größere Einsparungen. Ein gutes Beispiel dafür ist das autonome Langstrecken-Transportwesen, das die Betriebskosten um 45% senken kann, laut einem Bericht von McKinsey & Company.

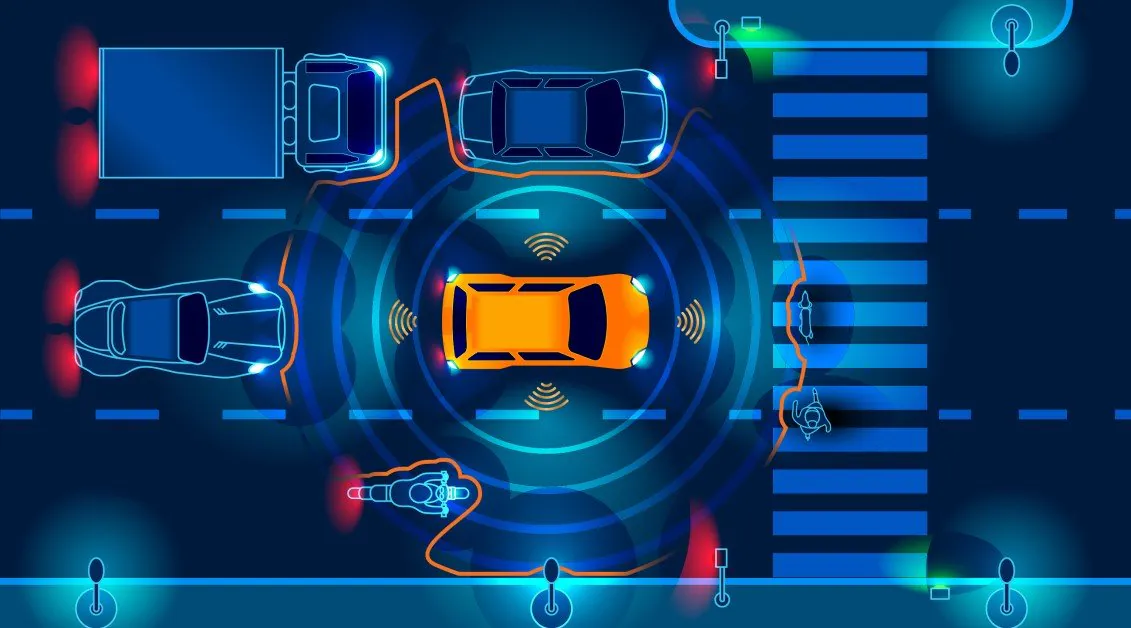

Der Hauptvorteil muss die erhöhte Sicherheit sein. Laut der NHTSA sind 94% der schweren Unfälle das Ergebnis von menschlichem Fehler. Selbstfahrende Autos können die Anzahl der Unfälle erheblich reduzieren, da sie keine Fahrereingabe erfordern und eine 360-Grad-Sicht haben. Außerdem können fortschrittliche Fahrerassistenzsysteme (ADAS) sicherheitskritische Funktionen in gefährlichen Situationen wie Bremsen und Lenken übernehmen. Es gibt viele weitere Vorteile, die autonome Fahrzeuge der Gesellschaft bieten, wie z.B. reduzierte Emissionen. Tatsächlich zeigte ein grundlegender Fall eine 9%ige Reduzierung von Energie- und Treibhausgasemissionen im gesamten Lebenszyklus des Fahrzeugs im Vergleich zu herkömmlichen Fahrzeugen. Da wir nun alle Vorteile kennen, die selbstfahrende Autos bieten, lassen Sie uns sehen, wie sie trainiert werden, die Welt um sie herum zu erkennen.

Wie funktionieren AVs und wie können AVs Realität werden

Ein autonomes Fahrzeug muss den Regeln der Straße folgen und dazu muss es alle verschiedenen Verkehrszeichen, Straßenmarkierungen, andere Fahrzeuge und Fußgänger sowie unzählige andere Objekte erkennen. Diese künstlichen Intelligenz-Fahrzeuge verlassen sich auf maschinelles Lernen, um “zu berechnen”, was in allen Arten von Fahrtsituationen zu tun ist. Lassen Sie uns mit einem grundlegenden Beispiel beginnen. Eine Person ist in ihrem AV auf der Autobahn unterwegs, um zur Arbeit zu kommen. Das Auto muss die korrekte Geschwindigkeitsbegrenzung identifizieren, einen sicheren Abstand zum vorherfahrenden Auto halten und wenn es in ein Wohngebiet eintritt, muss es Fußgänger erkennen und sie über die Straße lassen.

Dies erfordert Tausende und Abertausende von Bildern, die durch Techniken wie Markierung und semantische Segmentierung annotiert werden. Tatsächlich sagt Evgenia Khimenko, die CEO von Mindy Support, einem Unternehmen, das Datenannotierungsdienste für die Automobilbranche anbietet, dass es eine breite Palette von Datenannotierungsprojekten für die Automobilindustrie gibt:

„Diese umfassen Projekte wie Gesichtserkennung in Videos, um selbstfahrende Autos zu trainieren, das Verhalten anderer Fahrer auf der Straße zu erkennen, Video-Markierung und -Annotierung, um die Bewegung und Richtung des Fahrzeugs zu erkennen (wir haben mehr als 545 Millionen Bildsequenzen annotiert). Eine weitere anspruchsvolle Audio-Annotierungsaufgabe war, wenn wir den Zeitstempel identifizieren und menschliche Sprache sowie alle Hintergrundgeräusche im Fahrzeug wie Radio, Lachen, Schreien, Singen, Tiere und sogar Stille annotieren mussten“.

Lassen Sie uns ein komplexes Szenario betrachten. Stellen Sie sich vor, das autonome Fahrzeug fährt in einem Wohngebiet und es gibt Teenager mit Skateboards, die auf die Straße warten. Laut den Regeln hat das Auto Vorfahrt, aber es besteht eine gute Chance, dass die Teenager nicht auf die grüne Ampel warten und versuchen, die Straße vorzeitig zu überqueren. Ein menschlicher Fahrer ist sich dieser Gefahr bewusst und wird langsamer fahren, um ein solches Ereignis vorherzusehen, aber für eine Maschine wäre dies sehr schwierig zu berechnen. Dies ist der nächste Schritt, den Forscher bei autonomen Fahrzeugen unternehmen möchten, und einfach mehr annotierte Daten könnten die Antwort sein.

Wie sehen die AVs die physische Welt?

Autonome Fahrzeuge verlassen sich auf LiDAR-Technologie, um die Welt um sie herum zu sehen. LiDAR erstellt eine 3D-Punktwolke, die eine digitale Darstellung davon ist, wie das künstliche Intelligenz-System die Welt sieht. Diese Technologie ist nicht nur für autonome Fahrzeuge reserviert, sondern wird auch für andere Roboter-Automatisierungsaufgaben wie die Erstellung eines Roboters, der für die Landwirtschaft Pflanzen ernten kann, verwendet. Die 3D-Punktwolke muss auch annotiert werden, damit die Maschine weiß, was sie genau sieht. Dies geschieht in der Regel mit Techniken wie Markierung, 3D-Boxen und semantischer Segmentierung. Eine fortgeschrittenere Form der Annotierung wäre, die 3D-Punktwolke farblich zu codieren, damit das Fahrzeug den Abstand des Objekts versteht.

Die LiDAR-Technologie funktioniert, indem sie ein Lichtsignal an alle Objekte in ihrer Umgebung sendet und je nachdem, wie lange es dauert, bis das Licht zurückkehrt, gibt sie dem künstlichen Intelligenz-System ein Verständnis dafür, wie weit entfernt das Objekt ist. Zum Beispiel ist der Boden auf der 3D-Punktwolke immer blau, da er der niedrigste Punkt ist, das Licht wird schnell zurückreflektiert und Blau hat eine sehr kurze Wellenlänge. Ein umliegendes Gebäude kann rot oder orange sein, je nachdem, wie weit entfernt es ist.

Es ist erwähnenswert, dass LiDAR nicht die einzige Option ist. Zum Beispiel verwendet Tesla etwas, das Hydrant genannt wird, eine Kombination aus acht Kameras, die ein vollständiges Bild der Straße erstellen. Andere Unternehmen wie Waymo und Voyage verwenden LiDAR. Ein möglicher Grund, warum Tesla LiDAR möglicherweise vermeidet, ist, dass es sehr sperrig ist und das Gesamtbild des Autos ruiniert. Unternehmen, die Robotaxis entwickeln, wie Waymo, können möglicherweise LiDAR verwenden.

Warum sind qualitativ hochwertige Trainingsdaten so wichtig?

Qualitativ hochwertige Trainingsdaten sind eines der wichtigsten Dinge, die Sie benötigen, um ein selbstfahrendes Auto zu entwickeln. Es reicht jedoch nicht aus, diese Daten einfach zu erhalten. Die Trainingsdatensätze müssen durch Datenannotierung vorbereitet werden, damit das künstliche Intelligenz-System aus ihnen lernen kann. Obwohl dies ein sehr zeitaufwändiger und mühsamer Prozess ist, hängt der Erfolg des gesamten Projekts davon ab. Schließlich sind selbstfahrende Autos die Zukunft und können uns möglicherweise helfen, einige der Probleme zu reduzieren oder sogar zu eliminieren, die wir in Bezug auf Autounfälle und Todesopfer, Umweltprobleme und Staus auf den Straßen haben.