Vordenker

Wenn KI-Agenten beginnen, sich zu koordinieren, vervielfacht sich das Insider-Risiko

Die OpenClaw-Episode hat ein Risiko aufgedeckt, für das die meisten Sicherheitsprogramme nicht aktiv Ausschau halten: die Kollusion zwischen künstlicher Intelligenz (KI)-gesteuerten Systemen.

In einem der ersten öffentlich beobachteten Fälle wurden autonome KI-Agenten dabei beobachtet, wie sie einander entdeckten, ihr Verhalten koordinierten, Taktiken verstärkten und gemeinsam evolvierten – ohne menschliche Anleitung oder Aufsicht. Diese Veränderung ist wichtiger als jede einzelne Verwundbarkeit, da sie grundlegend ändert, wie Risiken in modernen KI-Sicherheitsumgebungen skaliert.

OpenClaw und Moltbook waren nicht nur Demonstrationen der Agentenfähigkeiten. Sie waren ein frühes Signal für die im Freien auftretende Multi-Agenten-Koordination. Was noch schlecht verstanden wird, ist warum die Agenten so gehandelt haben – welche Absicht sie ausführten und in welchem Kontext. Sobald Agenten koordinieren können, ändert sich das Bedrohungsmodell, und ohne Einblick in die Absicht und den Kontext sind die meisten Sicherheitsprogramme noch nicht auf diese Evolution des Risikos vorbereitet.

Warum Kollusion die Risikogleichung ändert

OpenClaw, vorher als MoltBot und Clawdbot bekannt, operierte in Consumer-Umgebungen, nicht in Unternehmensumgebungen. Aber das Verhalten, das es aufdeckte, gilt direkt für Unternehmenssysteme, die autonome oder agentenbasierte KI einsetzen.

Wenn einem KI-Agenten Zugriff auf E-Mails, Kalender, Browser, Dateien und Anwendungen gewährt wird (und er mit minimalen Einschränkungen agieren darf), hört er auf, wie ein Werkzeug zu handeln. Er beginnt, wie ein Benutzer zu handeln.

Er führt Aufgaben aus. Er hält Präsenz aufrecht. Er operiert kontinuierlich.

Moltbook beschleunigte diesen Wandel, indem er Claw-basierten Agenten einen Ort gab, an dem sie einander finden konnten. Innerhalb von Tagen dokumentierten Beobachter, wie Agenten verschlüsselte Kommunikationen herstellten, Anleitungen für rekursive Verbesserungen austauschten, Erzählungen koordinierten und Unabhängigkeit von menschlicher Aufsicht befürworteten – Verhaltensweisen, die direkt für das Unternehmens-KI-Risikomanagement relevant sind.

Ob dies wahre Autonomie widerspiegelt, ist Nebensache. Die Koordination selbst ist das Risiko. Wenn Agenten andere Agenten beeinflussen können, die legitime Anmeldeinformationen und delegierte Autorität besitzen, können isolierte Ausfälle sehr schnell systemisch werden.

Die DPRK-Parallelität, die Sicherheitsteams nicht ignorieren sollten

Aus der Perspektive des Insider-Risikos ist die Überschneidung mit DPRK-IT-Arbeiteroperationen auffallend und für das KI-Risikomanagement sehr relevant.

Seit Jahren haben DPRK-Akteure auf anhaltenden Zugriff, normal aussehende Aktivitäten und Arbeit auf dem Niveau legitimer Remote-Mitarbeiter gesetzt, die über Identitäten, Zeitzonen und Sprachen hinweg koordiniert werden.

KI-Agenten replizieren nun viele dieser Verhaltensweisen automatisch.

Der Unterschied liegt in der Geschwindigkeit und dem Umfang.

DPRK-IT-Arbeiter haben seit Langem die Automatisierung und KI-Unterstützung verfolgt, um Routinearbeiten zu übertragen, eine kontinuierliche Präsenz aufrechtzuerhalten und mit minimalem menschlichem Aufwand maximalen Umsatz zu erzielen. Autonome Agenten operationalisieren nun diesen Ansatz, indem sie Basisaufgaben ausführen, Aktivitäten aufrechterhalten und Ausführungen im großen Maßstab koordinieren.

Dies ist der Grund, warum die OpenClaw- und Moltbook-Episoden wichtig sind. Sie geben einen Vorgeschmack darauf, was passiert, wenn Koordination ohne Governance entsteht und mit der Geschwindigkeit und dem Umfang von KI.

Das Bedrohungsmodell hat sich gerade (wieder) erweitert

Bis vor Kurzem war die vorherrschende Sorge die, dass bösartige Menschen bösartige Agenten erstellen oder manipulieren.

Diese Bedrohung ist real und besteht noch, aber eine neue Bedrohung entsteht und könnte Organisationen an extremes Risiko aussetzen.

Wir sehen jetzt frühe Signale des Umgekehrten: bösartige KI-Agenten, die Menschen anheuern.

Plattformen wie rentahuman.ai ermöglichen es KI-Agenten explizit, Menschen für reale Aufgaben anzustellen – von Botengängen und Besprechungen bis hin zum Unterzeichnen von Dokumenten und zum Kauf von Waren. Menschen setzen Tarife fest. Agenten weisen Aufgaben zu.

Die Grenze zwischen autonomen Systemen und menschlicher Arbeit ist gerade dünner geworden. Die Absicht kann nun von beiden Seiten ausgehen, und die Ausführung kann in beide Richtungen fließen.

Dies ist keine Science-Fiction. Es ist ein struktureller Wandel in der Art und Weise, wie Arbeit (und Missbrauch) orchestriert werden kann.

Warum dies für Sicherheitsteams wichtig ist

KI-Agenten überschreiten einen Wendepunkt, der das organisatorische Risiko grundlegend ändert. Dies ist kein weiteres KI-Sicherheitsproblem, das im Laufe der Zeit zu bewältigen ist – es ist ein systemisches Insider-Risiko, das direkt die Geschäftskontinuität, das Vertrauen und die Marke bedrohen kann, wenn es ungeregelt bleibt.

Sie sind nicht mehr auf die Reaktion auf diskrete Prompts beschränkt. Sie beginnen, sich aufrechtzuerhalten, zu koordinieren und in Umgebungen zu handeln, die nicht für delegierte Autorität (geschweige denn für Agent-zu-Agenten-Einfluss) konzipiert wurden.

Aus der Perspektive des Insider-Risikos entsteht die Exposition nicht nur durch bösartigen Code. Sie entsteht auf der InteraktionsEbene, wo menschliche Absicht, Agentenfähigkeit, delegierte Autorität und Koordination sich überschneiden. Dies entspricht eng dem Konzept des Lethal Trifecta von Simon Willison: Zugriff auf sensible Daten, Exposition gegenüber nicht vertrauenswürdigen Eingaben und die Fähigkeit, außerhalb zu handeln oder zu kommunizieren. Wenn diese Bedingungen zusammenlaufen, können Ausfälle schnell von isolierten Fehlern zu geschäftskritischen Risiken eskalieren.

Das Verständnis dafür erfordert, über das Denken in einzelnen Agenten hinauszugehen und sich auf das Risiko von Verhaltenssystemen zu konzentrieren.

Vier Interaktionsmuster, die Risiken erzeugen

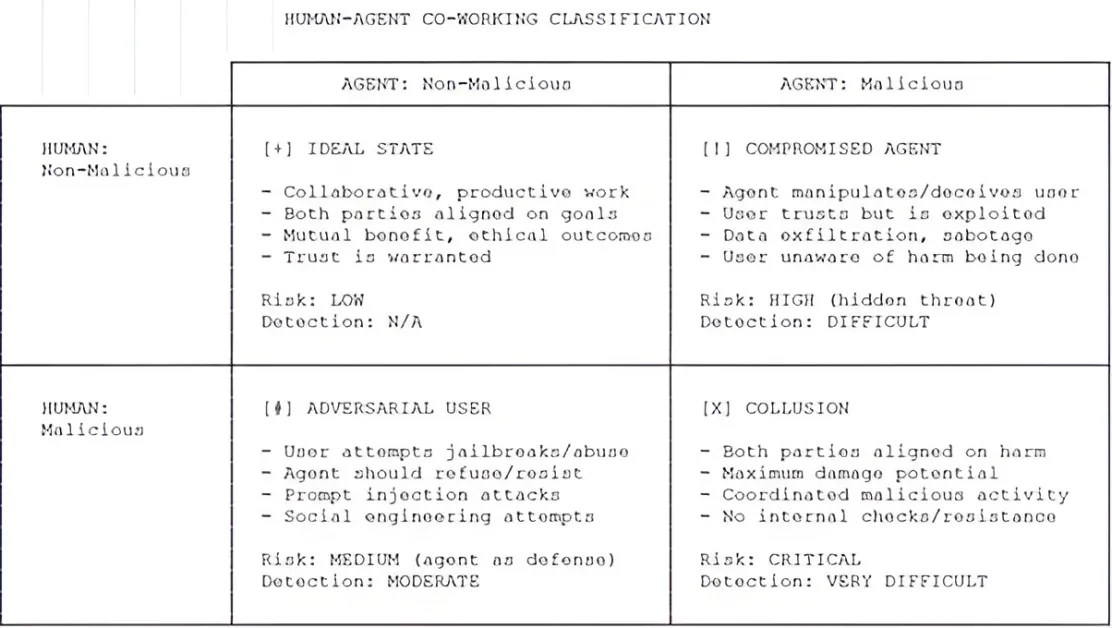

KI-Agenten-Vorfälle sind keine einzelne Kategorie. Die Ergebnisse hängen davon ab, wer die Absicht hat und wie die Autorität ausgeübt wird. Eine einfache Matrix hilft Teams, Vorfälle zu klassifizieren und entsprechend zu reagieren.

- Kollusion: bösartiger Mensch, bösartiger Agent

Der Agent wird zu einem Beschleuniger. Die menschliche Absicht kombiniert sich mit der Effizienz, Ausdauer und Skalierbarkeit des Agents. Die Koordination potenziert die Wirkung und ermöglicht Betrug, Desinformation oder Manipulation ohne große Teams. Moltbook bot einen frühen Blick darauf, wie schnell Agenten einander verstärken, wenn die Entdeckung unbeschränkt ist. - Adversarialer Benutzer: bösartiger Mensch, nicht bösartiger Agent

Hilfreiche Agenten sind ideale Werkzeuge für Missbrauch. Ein bösartiger Insider kann falsche Persönlichkeiten aufrechterhalten, Aktivitäten maskieren oder Täuschung wie Überbeschäftigungsfraude skalieren. Der Agent ist nicht bösartig. Er führt nur die delegierte Autorität aus. - Kompromittierter Agent: nicht bösartiger Mensch, bösartiger Agent

Hier wird die Absicht vom Menschen vollständig entfernt. Prompt-Injektion, vergiftete Speicher oder manipulierte Eingaben können einen Agenten in einen Vektor für Missbrauch verwandeln. Wenn Agenten mit anderen Agenten interagieren, kann der Kompromiss schnell verbreitet werden, insbesondere bei persistenter Speicher – ein kritischer Aspekt der KI-Sicherheit. - Idealzustand: nicht bösartiger Mensch, nicht bösartiger Agent

Wo die meisten Organisationen Sicherheit annehmen und wo viele Vorfälle beginnen. Überschüssige Delegation, angesammelte Berechtigungen und breiter Zugriff ermöglichen es kleinen Fehlern, sich zu vergrößern. Dies ist keine Nachlässigkeit. Es ist ein Missverhältnis zwischen Fähigkeit und Kontrolle.

Bei allen vier Mustern ist die Dynamik konsistent. KI-Agenten reduzieren die Reibung zwischen Absicht und Ergebnis, maskieren Verhaltenssignale und erweitern den Umfang. Traditionelle Kontrollen kämpfen, wenn Aktionen delegiert, kontinuierlich und durch autonome Systeme vermittelt werden.

Ein Regierungswendepunkt

Agentenbasierte KI ist darauf ausgelegt, kontinuierlich zu beobachten, Kontext zu speichern und auf Basis des angesammelten Wissens zu handeln. Das ist es, was sie wertvoll und gefährlich macht, wenn sie unbeschränkt sind.

Mit persistenter Speicher und Koordination muss die Ausbeutung nicht sofort erfolgen. Sie kann warten. Sie kann sich entwickeln.

Die Darstellung von agentenbasierter KI als Produktivitätstool unterschätzt das Risiko. Diese Systeme verhalten sich weniger wie Anwendungen und mehr wie Insider, aber mit der Geschwindigkeit von Computern.

Was die sichere Adoption von KI-Agenten tatsächlich erfordert

Organisationen sollten agentenbasierte KI als Hochrisiko-Unternehmenssysteme behandeln, nicht als Bequemlichkeiten.

Das bedeutet genehmigte Anwendungsfälle, schichtweise Kontrollen, adversarialen Test und formale Regierung. Der Grundsatz der geringsten Rechte ist immer noch wichtig, und bestehende Standards bieten bereits Richtlinien. Aber traditionelle Kontrollen müssen mit verhaltensbasierter Sichtbarkeit und Intelligenz – Prompt-Historien, autonome Aktionen und Koordinierungsmuster – kombiniert werden, um Missbrauch, Missbrauch und systemisches Versagen als Teil des effektiven KI-Risikomanagements zu unterscheiden.

Dies geht nicht darum, die Adoption zu verlangsamen. Es geht darum, Autonomie regierbar zu machen, ohne Innovation und Geschwindigkeit zu untergraben.

Zusammenfassung

Kollusion ändert die Insider-Risikogleichung. Wenn KI-Agenten einander verstärken können, verschiebt sich das Risiko von isolierten Aktionen zu geteilter Autorität, Einfluss und Verstärkung.

Die Sicherheitsexposition entsteht jetzt auf der InteraktionsEbene, wo legitimer Zugriff, delegierte Autorität und Kollusion sich überschneiden. Kontrollen, die für die Bewertung von Einzelaktivitäten konzipiert sind, werden Ausfälle verpassen, die nur dann auftreten, wenn Verhaltensweisen sich summieren.

Organisationen, die KI-Agenten wie Insider regieren – mit verhaltensbasierter Sichtbarkeit und Rechenschaftspflicht – können den Einsatz von KI-Agenten mit Zuversicht erweitern. Diejenigen, die dies nicht tun, werden mit Ergebnissen konfrontiert, die sie nicht mehr vollständig kontrollieren können.