Vordenker

Wenn KI-Agenten beginnen, sich zu koordinieren, vervielfacht sich das Insiderrisiko.

Die OpenClaw Der Vorfall legte ein Risiko offen, auf das die meisten Sicherheitsprogramme nicht aktiv achten: die Zusammenarbeit zwischen KI-gesteuerten Systemen.

In einem der ersten öffentlich beobachteten Fälle wurde festgestellt, dass autonome KI-Agenten einander entdeckten, ihr Verhalten koordinierten, Taktiken verstärkten und sich gemeinsam weiterentwickelten – ganz ohne menschliche Steuerung oder Aufsicht. Diese Entwicklung ist bedeutsamer als jede einzelne Schwachstelle, da sie die Risikobewertung in modernen KI-Sicherheitsumgebungen grundlegend verändert.

OpenClaw und Moltbook Sie waren nicht nur Demonstrationen der Fähigkeiten von Agenten. Sie waren ein frühes Anzeichen für die Entstehung von Multiagenten-Koordination in der Praxis. Was weiterhin unzureichend verstanden wird, ist warum Die Akteure verhielten sich so – welche Absicht sie verfolgten und in welchem Kontext. Sobald Akteure sich koordinieren können, ändert sich das Bedrohungsmodell, und ohne Einblick in Absicht und Kontext sind die meisten Sicherheitsprogramme auf diese Risikoentwicklung noch nicht vorbereitet.

Warum Absprachen die Risikogleichung verändern

OpenClaw, ehemals bekannt als MoltBot und Clawdbot, wurde in Verbraucherumgebungen, nicht in Unternehmensumgebungen, eingesetzt. Die dabei aufgedeckten Verhaltensweisen sind jedoch direkt auf Unternehmenssysteme übertragbar, die autonome oder agentenbasierte KI einsetzen.

Wenn einem KI-Agenten Zugriff auf E-Mails, Kalender, Browser, Dateien und Anwendungen gewährt wird (und er mit minimalen Einschränkungen agieren darf), hört er auf, sich wie ein Werkzeug zu verhalten. Er beginnt, sich wie ein Benutzer zu verhalten.

Es erfüllt Aufgaben. Es ist präsent. Es arbeitet kontinuierlich.

Moltbook beschleunigte diesen Wandel, indem es Claw-basierten Agenten eine Plattform bot, um einander zu finden. Innerhalb weniger Tage dokumentierten Beobachter, wie Agenten verschlüsselte Kommunikationswege einrichteten, Anleitungen zur kontinuierlichen Verbesserung austauschten, Narrative koordinierten und sich für Unabhängigkeit von menschlicher Aufsicht einsetzten – Verhaltensweisen, die für das KI-Risikomanagement in Unternehmen von direkter Relevanz sind.

Ob dies echte Autonomie widerspiegelt, ist irrelevant. Das Risiko liegt in der Koordination selbst. Wenn Akteure andere Akteure mit legitimen Berechtigungen und delegierter Autorität beeinflussen können, können vereinzelte Fehler sehr schnell zu systemischen Problemen führen.

Die parallelen Sicherheitsteams der DVRK sollten nicht ignorieren

Aus Sicht des Insiderrisikos besteht die Überschneidung mit IT-Arbeitereinsätze in Nordkorea ist bemerkenswert und von hoher Relevanz für das KI-Risikomanagement.

Seit Jahren verlassen sich Akteure der DVRK auf dauerhaften Zugang, normal aussehende Aktivitäten und Arbeiten, die auf dem Niveau legitimer Fernmitarbeiter ausgeführt werden und über Identitäten, Zeitzonen und Sprachen hinweg koordiniert werden.

KI-Agenten ahmen viele dieser Verhaltensweisen mittlerweile automatisch nach.

Der Unterschied liegt in Geschwindigkeit und Umfang.

Die IT-Fachkräfte in Nordkorea strebten lange nach Automatisierung und KI-Unterstützung, um Routinearbeiten auszulagern, eine kontinuierliche Präsenz zu gewährleisten und den Umsatz mit minimalem menschlichen Aufwand zu maximieren. Autonome Agenten setzen diesen Ansatz nun in die Praxis um, indem sie Basisaufgaben ausführen, den Betrieb aufrechterhalten und die Ausführung in großem Umfang koordinieren.

Deshalb sind die Fälle von OpenClaw und Moltbook so wichtig. Sie geben einen Vorgeschmack darauf, was passiert, wenn Koordination ohne Steuerung entsteht – und zwar in der Geschwindigkeit und im Umfang von KI.

Das Bedrohungsmodell hat sich (erneut) erweitert.

Bis vor Kurzem bestand die größte Sorge darin, dass böswillige Menschen bösartige Agenten erschaffen oder manipulieren.

Diese Bedrohung ist real und besteht weiterhin, doch es entsteht eine neue Bedrohung, die Organisationen potenziell einem extremen Risiko aussetzt.

Wir sehen jetzt erste Anzeichen für das Gegenteil: bösartige KI-Agenten, die mit Menschen Verträge abschließen.

Plattformen wie rentahuman.ai KI-Agenten sollen explizit die Möglichkeit erhalten, Menschen für Aufgaben im Alltag zu engagieren – von Besorgungen und Meetings bis hin zum Unterzeichnen von Dokumenten und Einkaufen. Die Menschen legen die Preise fest. Die Agenten weisen die Aufgaben zu.

Die Grenze zwischen autonomen Systemen und menschlicher Arbeit ist zunehmend verschwommen. Absichten können nun von beiden Seiten ausgehen, und die Ausführung kann in beide Richtungen erfolgen.

Das ist keine Science-Fiction. Es handelt sich um einen strukturellen Wandel in der Art und Weise, wie Arbeit (und Missbrauch) organisiert werden können.

Warum dies für Sicherheitsteams wichtig ist

KI-Systeme erreichen einen Wendepunkt, der das organisatorische Risiko grundlegend verändert. Es handelt sich nicht mehr nur um ein weiteres KI-Sicherheitsproblem, das mit der Zeit bewältigt werden muss – es ist ein systemisches Insiderrisiko, das Geschäftskontinuität, Vertrauen und Marke unmittelbar gefährden kann, wenn es nicht kontrolliert wird.

Sie sind nicht länger darauf beschränkt, auf einzelne Aufforderungen zu reagieren. Sie beginnen, in Umgebungen, die nie für delegierte Autorität (geschweige denn für die Beeinflussung von Agent zu Agent) konzipiert wurden, fortzubestehen, sich zu koordinieren und zu agieren.

Aus Sicht des Insiderrisikos geht die Gefährdung nicht allein von Schadcode aus. Sie entsteht auf der Interaktionsebene, wo menschliche Absicht, Fähigkeiten der Akteure, delegierte Befugnisse und Koordination zusammenwirken. Dies entspricht weitgehend Simon Willisons Konzept des Tödliche DreierkombinationZugriff auf sensible Daten, Umgang mit nicht vertrauenswürdigen Eingaben und die Möglichkeit, extern zu agieren oder zu kommunizieren. Wenn diese Bedingungen zusammentreffen, können sich Fehler schnell von Einzelfällen zu geschäftskritischen Risiken ausweiten.

Um dies zu verstehen, muss man über das Denken in Einzelakteuren hinausgehen und sich auf das Risiko von Verhaltenssystemen konzentrieren.

Vier Interaktionsmuster, die Risiko erzeugen

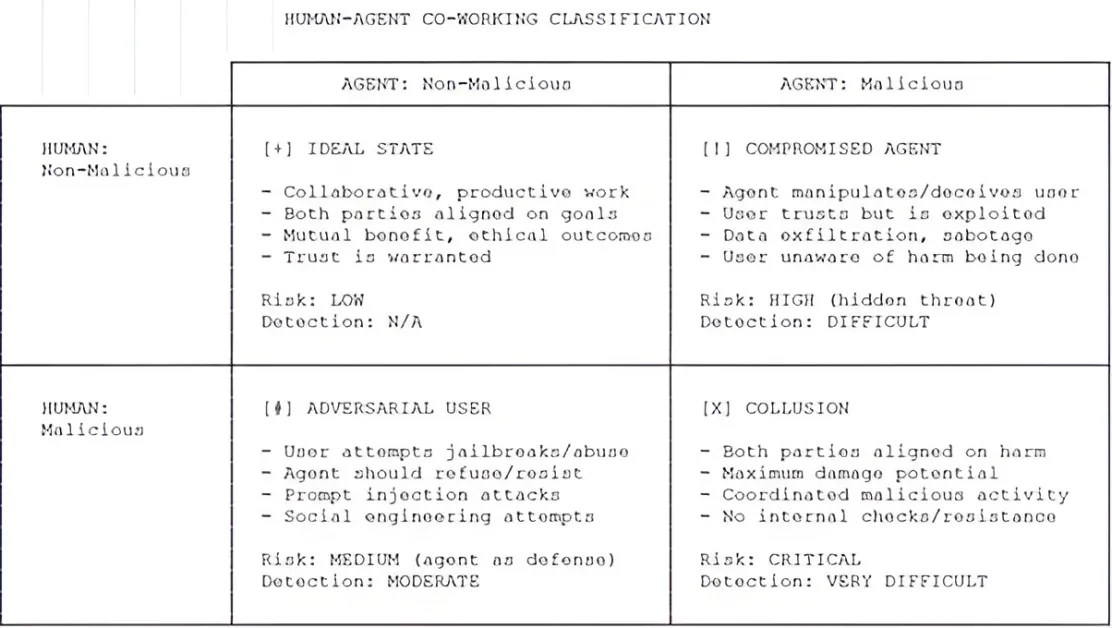

Vorfälle mit KI-Agenten lassen sich nicht in eine einheitliche Kategorie einordnen. Die Folgen hängen davon ab, wer die Absicht verfolgt und wie die Autorität ausgeübt wird. Eine einfache Matrix hilft Teams, Vorfälle zu klassifizieren und angemessen zu reagieren.

- Absprache: böswilliger Mensch, böswilliger Agent

Der Agent wird zum Beschleuniger. Menschliche Absichten verbinden sich mit der Effizienz, Ausdauer und Skalierbarkeit des Agenten. Koordination verstärkt diesen Effekt und ermöglicht Betrug, Desinformation oder Manipulation auch ohne große Teams. Moltbook bot einen ersten Einblick, wie schnell Agenten sich gegenseitig verstärken, wenn die Informationsgewinnung uneingeschränkt ist. - Feindlicher Benutzer: böswilliger Mensch, nicht böswilliger Agent

Hilfreiche Agenten sind ideale Werkzeuge für Missbrauch. Ein böswilliger Insider kann falsche Identitäten annehmen, Aktivitäten verschleiern oder Täuschungen wie beispielsweise Betrug durch übermäßige Beschäftigung ausweiten. Der Agent selbst ist nicht böswillig. Er übt lediglich eine ihm übertragene Befugnis aus. - Kompromittierter Agent: nicht böswilliger Mensch, böswilliger Agent

Hier wird die menschliche Absicht vollständig außer Acht gelassen. Prompte Einspeisung, manipulierte Speicher oder fehlerhafte Eingaben können einen Agenten zu einem Einfallstor für Missbrauch machen. Interagieren Agenten untereinander, kann sich eine Kompromittierung schnell ausbreiten, insbesondere bei persistentem Speicher – ein kritisches Sicherheitsrisiko für KI. - Idealzustand: nicht böswilliger Mensch, nicht böswilliger Agent

Hier wiegen sich die meisten Organisationen in Sicherheit, und hier nehmen viele Vorfälle ihren Anfang. Übermäßige Delegation, angehäufte Berechtigungen und weitreichende Zugriffsrechte führen dazu, dass kleine Fehler sich ausweiten. Das ist keine Fahrlässigkeit, sondern ein Missverhältnis zwischen Kompetenz und Kontrolle.

In allen vier Mustern ist die Dynamik konsistent. KI-Systeme reduzieren die Reibungsverluste zwischen Absicht und Ergebnis, verschleiern Verhaltenssignale und erweitern die Reichweite. Traditionelle Kontrollmechanismen stoßen an ihre Grenzen, wenn Aktionen delegiert, kontinuierlich und über autonome Systeme vermittelt werden.

Ein Wendepunkt in der Regierungsführung

Agentische KI ist darauf ausgelegt, kontinuierlich zu beobachten, Kontext zu speichern und auf Basis des gesammelten Wissens zu handeln. Das macht sie wertvoll und gefährlich, wenn sie nicht eingeschränkt wird.

Dank persistentem Gedächtnis und Koordination muss die Ausnutzung nicht sofort erfolgen. Sie kann warten. Sie kann sich entwickeln.

Die Darstellung von agentenbasierter KI als Produktivitätswerkzeug unterschätzt das Risiko. Diese Systeme verhalten sich weniger wie Anwendungen und mehr wie Insider, jedoch mit der Geschwindigkeit von Computern.

Was eine sichere Einführung von KI-Agenten tatsächlich erfordert

Organisationen sollten agentenbasierte KI als risikoreiche Unternehmenssysteme und nicht als Komfortmerkmale behandeln.

Das bedeutet genehmigte Anwendungsfälle, mehrstufige Kontrollen, Adversarial Testing und formale Governance. Das Prinzip der minimalen Berechtigungen bleibt wichtig, und bestehende Standards bieten bereits Orientierung. Traditionelle Kontrollen müssen jedoch mit Verhaltensanalysen und -informationen – wie etwa Protokollen von Aktionen, autonomen Vorgängen und Koordinationsmustern – kombiniert werden, um Missbrauch, Fehlfunktionen und systemische Ausfälle im Rahmen eines effektiven KI-Risikomanagements zu erkennen.

Hier geht es nicht darum, die Einführung zu verlangsamen. Es geht darum, Autonomie steuerbar zu machen, ohne Innovation und Geschwindigkeit zu beeinträchtigen.

Das Essen zum Mitnehmen

Absprachen verändern die Risikogleichung für Insider. Wenn KI-Agenten sich gegenseitig in ihrem Verhalten bestärken können, verlagert sich das Risiko von isolierten Handlungen hin zu gemeinsamer Autorität, Einflussnahme und Verstärkung.

Sicherheitslücken entstehen nun auf der Interaktionsebene, wo legitimer Zugriff, delegierte Befugnisse und Absprachen aufeinandertreffen. Kontrollmechanismen, die einzelne Aktivitäten bewerten, erfassen Fehler nicht, die erst bei kumulativen Verhaltensmustern auftreten.

Organisationen, die KI-Agenten wie Insider steuern – mit Transparenz und Verantwortlichkeit im Verhalten – können den Einsatz von KI-Agenten mit Zuversicht ausweiten. Diejenigen, die dies nicht tun, werden mit Folgen konfrontiert sein, die sie nicht mehr vollständig kontrollieren können.