Vordenker

Ein sofortiger Injektionsangriff, den man nicht verhindern kann: Wunschdenken oder echte Sorge?

In diesem Artikel möchte ich Sie zu einem Gedankenexperiment anregen. Ich werde argumentieren, dass in absehbarer Zeit eine bestimmte Art von Prompt-Injection-Angriff praktisch unvermeidbar sein wird. Meine Argumentation ist eher spekulativ als konkret, daher versuche ich nicht, Sie von etwas zu überzeugen. Stattdessen lade ich Sie ein, diese Gedanken zu erkunden. Bevor ich beginne, möchte ich, wie es jeder überzeugende Autor tun würde, über Schach und Schachprogramme sprechen.

Übermenschliche Schachprogramme und eine These über die menschliche Erfahrung

Einer der angenehmeren Aspekte des Schachs, der in anderen Disziplinen fehlt, ist die Fähigkeit, objektiv Die Qualität oder Stärke eines Spielers messen. ELO-Bewertungssystem Die für diesen Zweck verwendete Methode hat zwar ihre Schwächen, liefert aber eine sehr gute, grobe Schätzung, die sich im Laufe der Zeit bewährt. Eine Bewertung von 2700 oder höher gilt allgemein als Weltklasse (Top 30 der Welt). Der beste Spieler der Welt liegt knapp unter 2850. Noch nie hat ein Mensch eine Wertungszahl von 2900 erreicht.

Mitte der 90er Jahre erlebten wir, wie die erste KI-Engine (Deep Blue) eine bestimmte Leistung erreichte. Weltklasse Die praktische Folge dieses Meilensteins war die weite Verbreitung von Schachprogrammen durch Spieler aller Spielstärken zum Üben und Analysieren. Tatsächlich wurde die Nutzung von Schachprogrammen für die Weltspitze unerlässlich. Über mehrere Generationen dieser Weltklasse-Programme hinweg war es jedoch zwingend notwendig, die empfohlenen Züge (d. h. die Ergebnisse) zu überprüfen. Es wurde sogar ein spezielles Format namens „Fortgeschrittenenschach“ geschaffen, in dem Menschen mit einem Schachprogramm an ihrer Seite spielten, und die Kombination aus Mensch und Maschine galt als überlegen gegenüber der Maschine allein.

Es dauerte etwa 20 Jahre und einige entscheidende Fortschritte im Bereich Deep Learning und Reinforcement Learning, bis Schachprogramme diese Leistung erbrachten. übermenschlich Das Niveau lag bei etwa 3200 Elo-Punkten. Doch nachdem diese Grenze um 2017 überschritten wurde, geschah etwas sehr Überraschendes. Genauer gesagt, zwei Dinge. Das erste war völlig vorhersehbar: Schachprogramme wurden in 99 % aller Stellungen zur maßgeblichen Quelle für die Spielmechanik. Praktisch bedeutete das, dass wir in die Ära des blinden Vertrauens in die Engine eintraten. Heutzutage ist es für einen Menschen nahezu unmöglich, einen deutlich besseren Zug vorzuschlagen als die Engine. So unterhaltsam „fortgeschrittenes Schach“ auch war, es ist nun eine sinnlose Beschäftigung; Menschen würden dem Spiel kaum etwas hinzufügen. Das zweite Ereignis schockierte die meisten Schachspieler jedoch. Diese übermenschlichen neuronalen (d. h. tiefen neuronalen Netzwerk-)Engines spielten mitunter in einem Stil, der sich am besten als „romantisch“ beschreiben lässt. Anders ausgedrückt: Sie machten Züge, deren Wert erst viele, viele Züge später erkannt werden konnte, weit jenseits dessen, was ein Mensch oder eine Weltklasse-Engine berechnen könnte. Es wirkte fast so, als hätten die Engines ein Gespür oder eine Intuition für bestimmte Stellungen entwickelt. Doch diese Intuition ist etwas, das ein Mensch niemals begreifen oder nachahmen könnte.

Anders ausgedrückt: Ein übermenschlicher neuronaler Motor kann Bewegungen ausführen, die jenseits des kognitiven Horizonts eines Menschen. Das ist der entscheidende Punkt; das Problem ist nicht die der Erklärbarkeit. Vielmehr kann ein Mensch schlichtweg nicht verstehen, warum eine Engine einen bestimmten Zug empfiehlt, ohne die Stellung durchzuspielen und das Ergebnis viele Züge später zu beobachten, also ohne den gesamten Verlauf möglicher Spielsequenzen zu durchlaufen. Daher besteht eine unüberbrückbare Kompetenzlücke. Es ist objektiv betrachtet Optimal ist es, die Motorleistung ohne Überprüfung zu akzeptieren. Ich kann meine Behauptung wie folgt zusammenfassen:

Schach ist der Beweis dafür, dass übermenschliche KI in bestimmten Bereichen effektiv autonom agieren könnte. Die optimale Vorgehensweise für den Einsatz eines solchen Systems wäre, wenn es dem KI-System ermöglichen würde, Entscheidungen ohne menschliche Überprüfung zu treffen.

Da meine Behauptung manchen vielleicht offensichtlich oder unbedeutend erscheint, möchte ich einige Nuancen hervorheben. Angenommen, wir haben ein KI-System, das bei einer komplexen, kritischen Aufgabe mit konkreten, irreversiblen Konsequenzen übermenschliche Leistungen erbringt. Meine Behauptung hat zwei Implikationen:

- Das System würde eingesetzt, um Entscheidungen für die Aufgabe ohne menschliche Überprüfung zu treffen, trotz des damit verbundenen Risikos.

- Die durch die Überwachung eines solchen Systems gewonnenen Erkenntnisse würden eine nachteilige Entscheidung nicht verhindern; der Schaden wäre bereits entstanden.

Die Überprüfung und Überwachung der Systemausgabe stellen die letzten beiden Verteidigungsebenen gegen Prompt-Injection dar. Daher könnte unser hypothetischer Prompt-Injection-Angriff diese Ebenen umgehen, indem er einfach das entsprechende System angreift.

Dies ist meiner Ansicht nach ein sehr realistisches Szenario. Ein übermenschliches KI-System in einem bestimmten Bereich ist keine allgemeine allgemeine Intelligenz (AGI), und die meisten Experten gehen davon aus, dass solche Systeme in Kürze verfügbar sein werden. Wir mussten auch nicht davon ausgehen, dass die Entscheidungen zeitkritisch sind, sondern lediglich, dass die Aufgabe komplex genug ist, um eine menschliche Überprüfung unmöglich zu machen.

Natürlich haben wir bisher nur zwei Verteidigungsebenen überwunden, und glücklicherweise wurden bereits mehrere weitere entwickelt. Um die übrigen zu behandeln, wollen wir uns mit den Kernelementen befassen, die die Abwehr von Sofortangriffen so schwierig machen.

Was ist Prompt-Injektion?

Sofortige Injektion ist die Manipulation eines großen Sprachmodells (LLM) durch speziell präparierte Eingaben, wodurch das LLM unwissentlich die Absichten des Angreifers ausführt. Es kann als Social Engineering für KI. Entscheidend ist es kein herkömmlicher SoftwarefehlerEin Prompt-Injection-Angriff nutzt eine inhärente LLM-SchwachstelleDa LLMs sowohl System- als auch Benutzereingaben als Textsequenzen verarbeiten, können sie nicht von Natur aus zwischen legitimen und schädlichen Anweisungen unterscheiden. Die Schwachstelle ist daher eher beabsichtigt als zufällig entstanden.

Schnelle Injektionstechniken

Die sofortige Injektion wird allgemein als die Risiko Nr. 1 für LLM-Bewerbungen. Dafür gibt es mehrere Gründe. Der offensichtlichste Faktor ist die Injektionsart Es wurden verschiedene Techniken entwickelt. Grob in vier Kategorien eingeteilt, zählen zu den bekanntesten Techniken:

- Syntaxbasiert: Verwendung von Sonderzeichen, Emojis oder alternativer Sprache

- Indirekt: Verwendung externer Quellen (Abruf von einer Website), Kodierung (Base64) oder multimodaler Referenz (Text im Bild)

- „Tun wir mal so“: Einführung eines manipulativen Stils, z. B. durch Rollenspiele, hypothetische Szenarien, emotionale Appelle, ethische Rahmung und Formatwechsel

- Unverblümt: Der explizite Versuch, Modellanweisungen durch Zwang, Verstärkung oder negative Rückmeldung zu erzwingen.

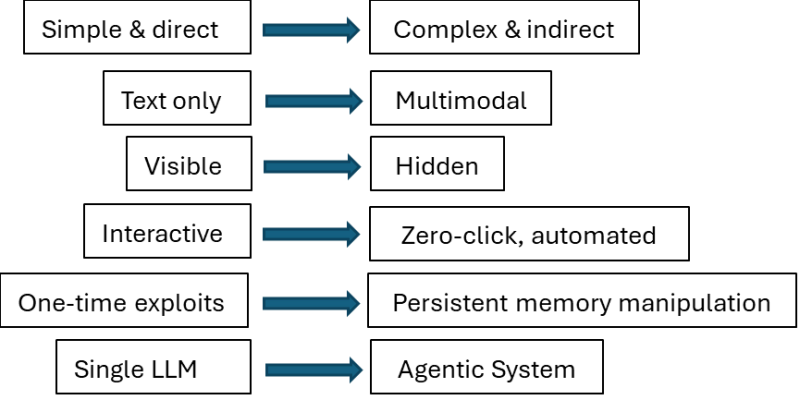

Die Vielfalt der Angriffe stellt Anwendungsentwickler vor Herausforderungen, doch diese Angriffe entwickeln sich auch weiterhin rasant. Die linke Seite des untenstehenden Diagramms beschreibt den aktuellen Stand der Technik für Anfang 2023, während die rechte Seite die heutige Art der Angriffe widerspiegelt.

LLM-App-Entwickler müssen außerdem den Standard erfüllen Abwägung zwischen Benutzerfreundlichkeit und Sicherheit Sie könnten sicherlich jede geeignete Verteidigungsebene einführen und EntwurfsmusterAber zu welchem Preis? Sicherheitsebenen erhöhen die Latenz erheblich und führen zu Fehlalarmen (False Positives, FPs) – harmlose Eingabeaufforderungen werden fälschlicherweise als schädlich eingestuft. Beides beeinträchtigt die Benutzerfreundlichkeit. Daher ist ein gewisses Maß an Kompromissen in der Praxis unvermeidlich, und es gibt keine Patentlösung.

In diesem Artikel geht es mir jedoch nicht wirklich um dieses endlose Katz-und-Maus-Spiel. Vielmehr untersuche ich, ob ein Angriff unvermeidbar sein kann. grundsätzlich. Aus der Sicht des Entwicklers/Verteidigers gibt es nur eine entscheidende Erkenntnis:

Die Trennung von Anweisungen und Daten in der Eingabeaufforderung ist grundlegend, um das Risiko der Injektion durch die Eingabeaufforderung zu minimieren.

Wir können davon ausgehen, dass Kompromisse keine Rolle spielen und jede Verteidigungsebene oder -technik eingesetzt werden kann. Ist es unter dieser (starken) Annahme möglich, ein Szenario zu entwerfen, in dem die Trennung von Anweisungen und Daten in einer Eingabeaufforderung … praktisch unmöglich?

Die DNA-Analogie

Nachdem das Problem als Trennung von Anweisungen und Daten formuliert worden war, war mein erster Gedanke, die Biologie als Analogie heranzuziehen.

Betrachten wir eine Zelle und einen DNA-Abschnitt (ein sogenanntes Gen). Das Gen liefert die Anweisungen für den Aufbau eines Proteins durch Transkription und Translation. Es kodiert außerdem die Information (Daten), die die Struktur und Funktion des Proteins beeinflusst. Demnach legt das Gen gleichzeitig fest, was und wie es aufgebaut werden soll – so meine Überlegung. Das ist jedoch schlichtweg falsch, da ein Gen entscheidet nicht, wie sie sich selbst interpretieren soll. Es gibt kein Äquivalent zu Anweisungen befolgen in der Biologie auf Genebene. Das „Wie“ wird vollständig an die zellulären Mechanismen ausgelagert.

Daher kann ich mich des Gefühls nicht erwehren, dass zukünftige Generationen von LLMs – oder genauer gesagt, die Systeme, zu denen sie sich entwickeln – biologischen Maschinen viel stärker ähneln werden, doch die vorgeschlagene Analogie greift einfach nicht. Wir können nicht eine Zelle durch ein LLM und ein Gen durch eine Eingabeaufforderung ersetzen und dann eine Injektion in das Gen vornehmen, die letztendlich zur Bildung eines „beschädigten“ Proteins führen würde. Es erscheint zielführender, bei natürlicher Sprache und Aufgaben zu bleiben, die … semantische Deutung.

Die Verteidigungsschichten abtragen

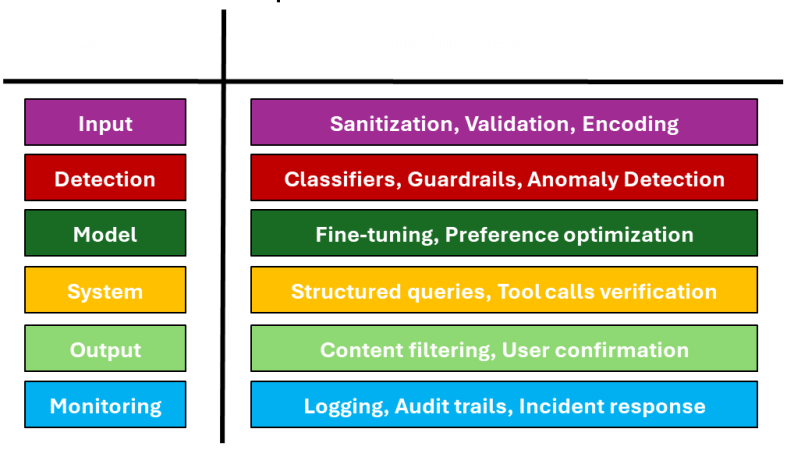

Es dürfte nicht überraschen, dass mehrschichtige Verteidigungsstrategien als effektiver bei der Abwehr von Schnellangriffen gelten. Die Abbildung unten zeigt die gängigsten Verteidigungsebenen in der Reihenfolge ihres Auftretens sowie die jeweils verwendeten Techniken.

Die letzten beiden Ebenen (Ausgabe, Überwachung) haben wir oben bereits besprochen, konzentrieren wir uns also auf die ersten vier.

In Anbetracht der Eingabeschicht ist es naheliegend anzunehmen, dass die Bereinigung oder Validierung der Eingabeaufforderung bei der Erkennung recht erfolgreich wäre. indirekte Angriffe. Wenn die Einschleusung jedoch direkt erfolgt und, wie oben angedeutet, durch semantische Interpretation erfolgt, ist die Bereinigung möglicherweise irrelevant (da nichts zu bereinigen ist), und eine Validierung ist standardmäßig unmöglich, da die Berechnung abgeschlossen sein muss, um das Problem zu identifizieren.

Den Schutzmechanismen, die Sie in der Erkennungsschicht implementieren können, sind praktisch keine Grenzen gesetzt. Tatsächlich könnten Sie sogar einen dedizierten LLM dafür verwenden. InjektionserkennungAber auch hier wird es schwierig sein, einen Klassifikator oder einen Anomaliedetektor als verdächtig zu kennzeichnen, wenn der Schadcode geschickt in der Semantik versteckt ist.

Die Modellebene Dies kann sehr effektiv sein, wenn der Aufgabenumfang überschaubar ist und eine Feinabstimmung möglich ist. Ein ähnliches Argument ließe sich für die Systemebene anführen, wenn die Verwendung von Werkzeugen vorhersehbar ist. Intuitiv würde jedoch keine der beiden Ebenen Alarm auslösen, wenn die Einbindung den Interpreter beeinträchtigt.

Kartenhaus

Als ich diesen Artikel zu schreiben begann, wollte ich einen „unvermeidlichen“ Schnellangriff mit Injektion in groben Zügen beschreiben. Vielleicht habe ich letztendlich einen „nicht konstruktiven“ Ansatz verfolgt, indem ich bestehende Verteidigungsmechanismen untergraben habe. Abwehrtechniken sie entwickeln sich weiterhin rasant, und das gilt auch für AngriffsflächeDieses Spiel scheint kein baldiges Ende zu nehmen. Ich glaube jedoch auch, dass wir nicht mehr lange diejenigen sein werden, die es spielen. Ich vermute, dass die erfolgreiche Eingabeaufforderung auch in Zukunft in natürlicher Sprache erfolgen wird, nur eben in einer Sprache, die Menschen nicht verstehen. Und ich vermute, dass sie automatisch von einem System entdeckt wird, das entweder speziell für diesen Zweck entwickelt wurde oder vielleicht zufällig bei der Bearbeitung einer verwandten Aufgabe, wie der Suche nach semantischer Mehrdeutigkeit in einem Repräsentationsraum.

Es ist unangenehm, zuzugeben, dass wir die Kontrolle verlieren, und dennoch zu spüren, dass dies die rationalste Vorgehensweise ist. Man könnte es als den „intuitiven Beweis“ dafür sehen, dass manche Angriffe unaufhaltsam wären. Und falls Sie das beunruhigt, wird es Sie freuen zu hören, dass GPT 5.2 dieses Argument als „weder kontrovers noch neu“ einstufte und mir empfahl, den Punkt nicht weiter auszuführen und 40 % des Artikels zu kürzen.