Vordenker

Die neue digitale Kluft in KI: Warum edge-fähige, CPU-erste Modelle den Kostenkrieg gewinnen werden

Der globale Markt für künstliche Intelligenz (KI) expandiert mit atemberaubender Geschwindigkeit. Im Jahr 2024 wurde er auf 257,68 Milliarden Dollar bewertet, mit Prognosen, die ihn bis Ende 2025 auf 371,71 Milliarden Dollar und bis 2032 auf ein atemberaubendes 2,4 Billionen Dollar ansetzen. Das ist fast eine Verzehnfachung in weniger als einem Jahrzehnt, eine Traektorie, die sich mit einigen der transformierendsten technologischen Booms in der modernen Geschichte messen kann.

In den letzten zehn Jahren haben ungefähr 1.500 neu gegründete KI-Unternehmen jeweils Investitionen über 1,5 Millionen Dollar gesichert, was nicht nur eine Welle der Innovation, sondern auch eine starke Präsenz von intensivem Wettbewerb signalisiert. Etablierte Unternehmen bleiben nicht auf der Seitenlinie. Laut einem Bericht von McKinsey aus Januar planen 92% der Organisationen, ihre KI-Ausgaben in den nächsten drei Jahren zu erhöhen.

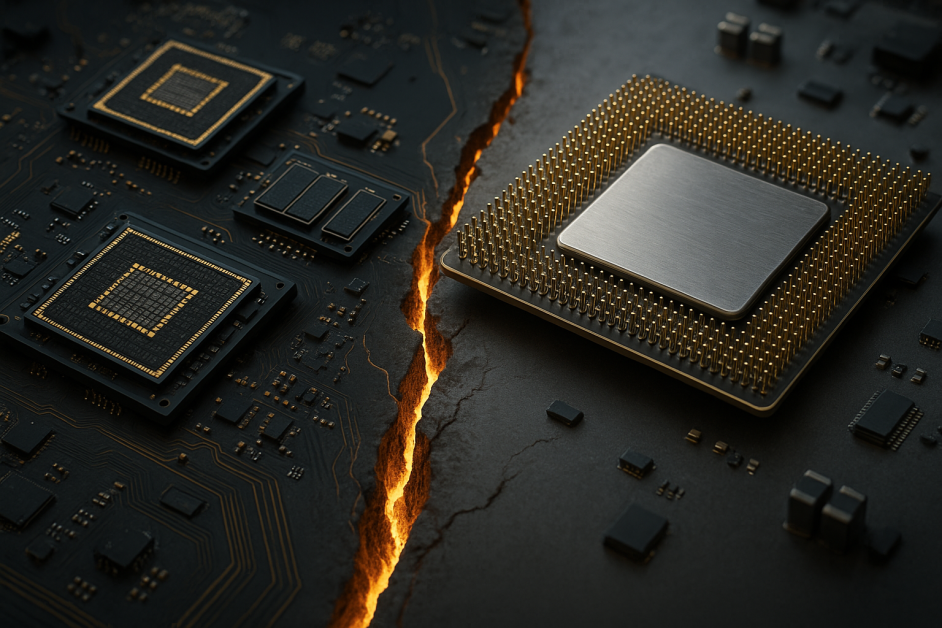

Aber während die KI-Adoption beschleunigt wird, zeigt die Infrastruktur, die sie unterstützt, Risse. In den letzten zwei Jahren hat sich die KI von beeindruckenden Demos zu persistenten, realen Workloads verschoben.

Der wahre Flaschenhals liegt nicht nur in der Modellqualität, sondern auch darin, wo und wie diese Modelle ausgeführt werden. Eine neue digitale Kluft bildet sich, nicht um den Zugang zu Daten oder Talent, sondern um die Rechenstrategie. Organisationen stehen vor einer entscheidenden Gabelung: Entweder setzen sie weiterhin auf GPU-lastige, cloud-zentrische Systeme oder sie umarmen schlankere, edge-fähige, CPU-erste Architekturen, die billiger zu betreiben sind, leichter in diversen Umgebungen zu deployen sind und besser an die Anforderungen von Privatsphäre und Latenz angepasst sind.

Diese architektonischen Entscheidungen sind wichtig, weil der wahre Druck nicht darin besteht, Modelle zu bauen, sondern sie Tag für Tag auszuführen. Hier sind die Inferenzkosten schnell höher als die Trainingskosten und definieren die Ökonomie der KI im großen Maßstab.

Inferenz frisst KI-Budgets

Während Schlagzeilen oft die enormen Kosten für das Training von Frontier-Modellen hervorheben, ist die Inferenz die Rechnung, die nie aufhört. Stanfords 2025 AI Index bemerkt, dass rasche Fortschritte bei kleinen Modellen die Kosten für die Erreichung von “GPT-3.5-Level”-Leistung zwischen Ende 2022 und Ende 2024 um mehr als 280 Mal gesenkt haben. Doch der gleiche Bericht unterstreicht die Besessenheit der Branche mit der Optimierung der Inferenzeffizienz.

Die Cloud-GPU-Preise haben den Druck nur erhöht. Das Mieten von High-End-GPU-Instanzen kann über einen Zeitraum von drei bis fünf Jahren fast doppelt so teuer sein wie der Kauf der gleichen Hardware. Elastizität ist nützlich für spiky Workloads, aber lang laufende Inferenz-“Leases” bluten Budgets stillschweigend aus. Sogar NVIDIA, dessen Geschäft von Beschleunigern abhängt, hat im letzten Jahr aggressiv die Inferenz über seinen gesamten Stack hinweg optimiert. Dies ist ein Beweis dafür, dass der wahre Schlachtfeld sich von der Trainingsleistung zu den Servicewirtschaften verschiebt.

Diese aufkommende Kostenkrise bedeutet, dass Organisationen, die nicht bereit oder in der Lage sind, ihre Rechenstrategien neu zu überdenken, das Risiko laufen, zurückgelassen zu werden.

Warum die Edge (und CPUs) die Kostenkurve ändern

Die harte Realität ist, dass GPU-zentrierte Inferenz unsinnige Ökonomien schafft. Das Ausführen großer, Echtzeit-KI-Workloads auf teuren GPUs treibt nicht nur die Kosten in die Höhe, sondern beschleunigt auch den Wertverlust der Hardware. Innovationszyklen bewegen sich so schnell, oft weniger als 18 Monate zwischen neuen Chip-Generationen, dass Infrastrukturinvestitionen schnell an Wert verlieren. Dies hat zu Warnungen von Analysten über Abschreibungen aufgrund von KI-Chip-Käufen geführt, da sie bereits Gewinnschätzungen kürzen. Zum Beispiel wird Alphabet voraussichtlich 28 Milliarden Dollar an Abschreibungen bis 2026 absorbieren.

Fabriken, Kliniken, Einzelhandelsgeschäfte und mobile Geräte sind die Orte, an denen KI zunehmend benötigt wird. Das Versenden jeder Anfrage an einen zentralisierten GPU-Cluster ist oft das falsche Werkzeug für die Aufgabe, da es teuer, energieintensiv und anfällig für Latenz und Datenschutzbedenken ist.

Edge-Umgebungen sind keine homogenen GPU-Farmen. Sie sind vielfältige Flotten von CPUs: Server, robuste PCs, Laptops und Handheld-Geräte. Diese Vielfalt macht CPUs zu einer natürlichen Grundlage für kosteneffiziente KI-Entwicklung.

In diesem neuen Landschaft sind CPUs nicht nur ein Rückfall, sie sind der kostensmarteste Weg zu skalierbarer, zugänglicher KI.

GPUs als das “Private Jet” der KI

Wenn Modelle größer und komplexer werden, verlangen sie mehr GPU-Leistung, was nicht nur die Infrastruktur- und Energiekosten in die Höhe treibt, sondern auch fortgeschrittene KI-Fähigkeiten in den Händen von denen konzentriert, die sie sich leisten können.

Studien zeigen, dass große, allgemeine generative Modelle oft viel mehr Energie und erzeugen signifikant höhere Kohlenstoffemissionen pro 1.000 Inferenzen im Vergleich zu kleineren, aufgabenorientierten Systemen. Selbst wenn die Parameterzahl kontrolliert wird, verstärken GPU-lastige Architekturen sowohl finanzielle als auch operative Barrieren. Im Laufe der Zeit entsteht ein Engpass, der es für Start-ups, Forscher und unterversorgte Gemeinschaften immer schwieriger macht, auf fortschrittliche KI-Tools zuzugreifen.

Es ist ein Exklusivitätsproblem: GPUs sind wie die Privatjets der KI, sie sind schnell und leistungsfähig, aber nur für einen kleinen Kreis von gut finanzierten Organisationen zugänglich.

Aber die Anerkennung dieser Grenzen bedeutet nicht, dass GPUs ganz abgelehnt werden. Sie bleiben außergewöhnlich für bestimmte Modellklassen und Durchsatzmuster. Eine CPU-erste Strategie ist nicht anti-GPU. Sie ist eine kostensmartige Lösung.

Dieser Ansatz erweitert den Zugang und stellt sicher, dass die KI-Entwicklung von Effizienz und nicht von Prestige getrieben wird. Anstatt einer Zukunft, die durch GPU-Exklusivität definiert ist, öffnen CPUs die Tür zu skalierbarer, nachhaltiger und inklusiver KI-Entwicklung.

Der notwendige Wechsel zu CPU-getriebenen Modellen

Wenn die KI-Wirtschaft nachhaltig skalieren soll, ist die Lösung, sich vorzustellen, wie Modelle trainiert und bereitgestellt werden. Ein Ansatz ist, hohe Entropie-Daten und Edge-Fälle während des Trainings zu priorisieren. Diese Eingaben treiben bedeutenden Fortschritt und können den Bedarf an großen Datensätzen reduzieren, sodass Modelle mit weniger Parametern effektiv bleiben können.

Indem sie kompakt genug sind, um auf Standard-CPUs zu laufen, sei es in Laptops, Smartphones, Servern oder Internet-of-Things-(IoT)-Geräten, reduzieren diese Modelle die Inferenzkosten und den Energieverbrauch drastisch. Sie ermöglichen auch Echtzeitverarbeitung direkt auf dem Gerät, was die Latenz reduziert und die Privatsphäre durch die lokale Speicherung sensibler Daten erhöht.

Dieser Wechsel ist nicht nur eine Frage der Kosten, sondern auch der Gerechtigkeit. In Branchen wie der Gesundheitsversorgung, in denen bereits “Wüsten” des Zugangs bestehen, könnte die edge-fähige CPU-Bereitstellung Lücken schließen, indem sie fortschrittliche KI-Tools direkt in Kliniken, Call-Center oder Feldgeräte liefert, ohne auf zentrale Rechenzentren angewiesen zu sein. Das Ergebnis ist eine breitere Akzeptanz, verbesserte Widerstandsfähigkeit und eine inklusivere Verteilung der KI-Vorteile.

Von Macht zu Zugang: CPUs als der große Gleichmacher in KI

Die kommenden Jahre werden nicht nur testen, wer die leistungsfähigsten KI-Modelle bauen kann, sondern auch, wer sie effizient, nachhaltig und im großen Maßstab bereitstellen kann. CPU-optimierte, edge-fähige Modelle bieten einen Weg nach vorne. Indem sie es ermöglichen, KI effektiv auf Standard-Hardware auszuführen, senken sie die Barrieren für Start-ups und Forscher, reduzieren die Abhängigkeit von fragilen Lieferketten und bringen fortschrittliche Anwendungen in Umgebungen, in denen zentrale GPU-Cluster unpraktisch sind.

Die Bewertung von KI-Infrastrukturen anhand von Metriken wie Gesamtkosten pro transkribierter Stunde, Bereitstellungs-Scores und Edge-Bereitschaft stellt sicher, dass Lösungen nicht nur nach Benchmark-Genauigkeit, sondern auch nach ihrer Fähigkeit beurteilt werden, im realen Leben skalierbar und inklusiv zu sein.

Die Einsätze sind hoch. Wenn die Branche weiterhin GPUs als Standard behandelt, bleibt der Zugang exklusiv, die Innovation konzentriert sich und die Diffusion in öffentliche Dienste, Gesundheitsversorgung und benachteiligte Sektoren stockt. Aber wenn CPU-erste, edge-fähige Strategien Fuß fassen, kann KI widerstandsfähiger, privater und nachhaltiger werden. Dies nicht nur den Spielfeld aus, es definiert ihn neu.