Künstliche Intelligenz

Das Black-Box-Problem in LLMs: Herausforderungen und aufkommende Lösungen

Machine Learning, ein Teilbereich von KI, umfasst drei Komponenten: Algorithmen, Trainingsdaten und das resultierende Modell. Ein Algorithmus, im Wesentlichen ein Satz von Verfahren, lernt, Muster aus einer großen Menge von Beispielen (Trainingsdaten) zu erkennen. Die Krönung dieses Trainings ist ein Machine-Learning-Modell. Zum Beispiel würde ein Algorithmus, der mit Bildern von Hunden trainiert wurde, zu einem Modell führen, das in der Lage ist, Hunde in Bildern zu identifizieren.

Black Box in Machine Learning

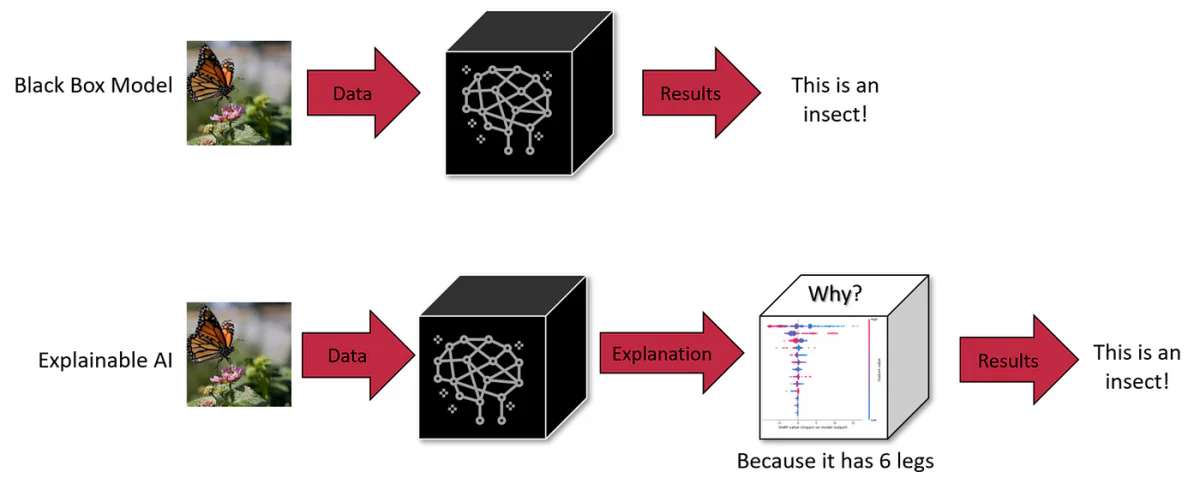

In Machine Learning kann jede der drei Komponenten – Algorithmus, Trainingsdaten oder Modell – eine Black Box sein. Während Algorithmen oft öffentlich bekannt sind, können Entwickler entscheiden, das Modell oder die Trainingsdaten geheim zu halten, um geistiges Eigentum zu schützen. Diese Undurchsichtigkeit macht es schwierig, den Entscheidungsprozess der KI zu verstehen.

KI-Black-Boxen sind Systeme, deren interne Funktionsweise für Benutzer undurchsichtig oder unsichtbar bleibt. Benutzer können Daten eingeben und Ausgaben erhalten, aber die Logik oder der Code, der die Ausgabe erzeugt, bleibt verborgen. Dies ist eine häufige Eigenschaft in vielen KI-Systemen, einschließlich fortschrittlicher generativer Modelle wie ChatGPT und DALL-E 3.

LLMs wie GPT-4 stellen eine erhebliche Herausforderung dar: ihre interne Funktionsweise ist größtenteils undurchsichtig, was sie zu “Black Boxen” macht. Eine solche Undurchsichtigkeit ist nicht nur ein technisches Rätsel; sie wirft reale Sicherheits- und ethische Bedenken auf. Wenn wir beispielsweise nicht verstehen können, wie diese Systeme zu Schlussfolgerungen gelangen, können wir ihnen in kritischen Bereichen wie medizinischen Diagnosen oder finanziellen Bewertungen vertrauen?

Erkundung der Techniken von LIME und SHAP

Interpretierbarkeit in Machine Learning (ML) und Deep Learning (DL)-Modellen hilft uns, in die undurchsichtigen inneren Funktionsweisen dieser fortschrittlichen Modelle zu blicken. Local Interpretable Model-agnostic Explanations (LIME) und SHapley Additive exPlanations (SHAP) sind zwei solche gängigen Interpretierbarkeitstechniken.

LIME, zum Beispiel, zerlegt die Komplexität, indem es einfachere, lokale Surrogatmodelle erstellt, die das Verhalten des ursprünglichen Modells um eine bestimmte Eingabe approximieren. Durch diese Methode hilft LIME dabei, zu verstehen, wie einzelne Merkmale die Vorhersagen komplexer Modelle beeinflussen, und bietet im Wesentlichen eine “lokale” Erklärung dafür, warum ein Modell eine bestimmte Entscheidung getroffen hat. Es ist besonders nützlich für nicht-technische Benutzer, da es den komplizierten Entscheidungsprozess von Modellen in verständlichere Begriffe übersetzt.

SHAP hingegen schöpft aus der Spieltheorie, insbesondere dem Konzept der Shapley-Werte. Es weist jedem Merkmal einen “Wichtigkeits”-Wert zu, der angibt, wie viel jedes Merkmal zur Differenz zwischen der tatsächlichen Vorhersage und der Basisvorhersage (der durchschnittlichen Vorhersage über alle Eingaben) beiträgt. SHAPs Stärke liegt in seiner Konsistenz und seiner Fähigkeit, eine globale Perspektive zu bieten – es erklärt nicht nur einzelne Vorhersagen, sondern bietet auch Einblicke in das Modell als Ganzes. Dies ist besonders wertvoll in Deep-Learning-Modellen, wo die vernetzten Schichten und zahlreichen Parameter oft den Vorhersageprozess wie eine Reise durch ein Labyrinth erscheinen lassen. SHAP entmystifiziert dies, indem es den Beitrag jedes Merkmals quantifiziert und so eine klarere Karte der Entscheidungsbahnen des Modells bietet.

SHAP (Source)

Sowohl LIME als auch SHAP sind zu wesentlichen Werkzeugen im Bereich von KI und ML geworden, um den kritischen Bedarf an Transparenz und Vertrauenswürdigkeit zu decken. Da wir KI immer tiefer in verschiedene Sektoren integrieren, wird die Fähigkeit, diese Modelle zu interpretieren und zu verstehen, nicht nur zu einer technischen Notwendigkeit, sondern zu einer grundlegenden Anforderung für ethische und verantwortungsvolle KI-Entwicklung. Diese Techniken stellen bedeutende Schritte bei der Entschlüsselung der Komplexität von ML- und DL-Modellen dar, indem sie diese von unverständlichen “Black Boxen” in verständliche Systeme verwandeln, deren Entscheidungen und Verhaltensweisen verstanden, vertraut und effektiv genutzt werden können.

Die Größe und Komplexität von LLMs

Die Größe dieser Modelle trägt zu ihrer Komplexität bei. Nehmen wir zum Beispiel GPT-3 mit seinen 175 Milliarden Parametern und neueren Modellen mit Billionen. Jeder Parameter interagiert auf komplexe Weise innerhalb des neuronalen Netzes und trägt zu emergenten Fähigkeiten bei, die nicht vorhersehbar sind, wenn man einzelne Komponenten betrachtet. Diese Größe und Komplexität machen es fast unmöglich, ihre interne Logik vollständig zu verstehen, was ein Hindernis bei der Diagnose von Voreingenommenheiten oder unerwünschten Verhaltensweisen in diesen Modellen darstellt.

Der Kompromiss: Größe vs. Interpretierbarkeit

Die Verringerung der Größe von LLMs könnte die Interpretierbarkeit verbessern, aber auf Kosten ihrer fortschrittlichen Fähigkeiten. Die Größe ist es, die solche Verhaltensweisen ermöglicht, die kleinere Modelle nicht erreichen können. Dies stellt einen inhärenten Kompromiss zwischen Größe, Fähigkeit und Interpretierbarkeit dar.

Die Auswirkungen des LLM-Black-Box-Problems

1. Fehlerhafte Entscheidungsfindung

Die Undurchsichtigkeit im Entscheidungsprozess von LLMs wie GPT-3 oder BERT kann zu unentdeckten Voreingenommenheiten und Fehlern führen. In Bereichen wie Gesundheitswesen oder Strafjustiz, wo Entscheidungen weitreichende Konsequenzen haben, ist die Unfähigkeit, LLMs auf ethische und logische Korrektheit zu überprüfen, ein großes Anliegen. Zum Beispiel kann ein medizinisches Diagnose-LLM, das auf veralteten oder voreingenommenen Daten basiert, schädliche Empfehlungen abgeben. Ebenso können LLMs in Einstellungsprozessen ungewollt Geschlechtervoreingenommenheit aufrechterhalten. Die Black-Box-Natur verbirgt also nicht nur Mängel, sondern kann diese potenziell auch verstärken, was einen proaktiven Ansatz zur Verbesserung der Transparenz erfordert.

2. Begrenzte Anpassungsfähigkeit in verschiedenen Kontexten

Der Mangel an Einblicken in die interne Funktionsweise von LLMs beschränkt ihre Anpassungsfähigkeit. Zum Beispiel kann ein Einstellungs-LLM ineffizient sein, wenn es darum geht, Kandidaten für eine Rolle zu bewerten, die praktische Fähigkeiten über akademische Qualifikationen stellt, aufgrund seiner Unfähigkeit, seine Bewertungskriterien anzupassen. Ebenso kann ein medizinisches LLM bei der Diagnose seltener Krankheiten aufgrund von Datenungleichgewichten zu kämpfen haben. Diese Inflexibilität unterstreicht die Notwendigkeit von Transparenz, um LLMs für spezifische Aufgaben und Kontexte neu zu kalibrieren.

3. Voreingenommenheit und Wissenslücken

Die Verarbeitung von großen Trainingsdaten durch LLMs unterliegt den Einschränkungen, die durch ihre Algorithmen und Modellarchitekturen auferlegt werden. Zum Beispiel kann ein medizinisches LLM demografische Voreingenommenheit zeigen, wenn es auf unbalancierten Datensätzen trainiert wird. Auch kann die Kompetenz eines LLMs in Nischen-Themen irreführend sein und zu überzeugten, falschen Ausgaben führen. Die Bekämpfung dieser Voreingenommenheiten und Wissenslücken erfordert mehr als nur zusätzliche Daten; es erfordert eine Untersuchung der Modellverarbeitungsmechanik.

4. Rechtliche und ethische Verantwortlichkeit

Die undurchsichtige Natur von LLMs schafft eine rechtliche Grauzone hinsichtlich der Haftung für Schäden, die durch ihre Entscheidungen verursacht werden. Wenn ein LLM in einem medizinischen Umfeld fehlerhafte Ratschläge gibt, die zu Patientenschäden führen, wird die Feststellung der Verantwortlichkeit aufgrund der Undurchsichtigkeit des Modells schwierig. Diese rechtliche Unsicherheit birgt Risiken für Einheiten, die LLMs in sensiblen Bereichen einsetzen, und unterstreicht die Notwendigkeit klarer Governance und Transparenz.

5. Vertrauensprobleme in sensiblen Anwendungen

Für LLMs, die in kritischen Bereichen wie Gesundheitswesen und Finanzen eingesetzt werden, untergräbt die mangelnde Transparenz ihre Vertrauenswürdigkeit. Benutzer und Regulierungsbehörden müssen sicherstellen, dass diese Modelle keine Voreingenommenheiten aufweisen oder Entscheidungen aufgrund unfairen Kriteriums treffen. Die Überprüfung der Abwesenheit von Voreingenommenheit in LLMs erfordert ein Verständnis ihrer Entscheidungsprozesse, was die Bedeutung von Erklärbarkeit für ethische Einsetzung unterstreicht.

6. Risiken mit personenbezogenen Daten

LLMs erfordern umfangreiche Trainingsdaten, die sensible personenbezogene Informationen enthalten können. Die Black-Box-Natur dieser Modelle wirft Bedenken hinsichtlich der Verarbeitung und Nutzung dieser Daten auf. Zum Beispiel wirft ein medizinisches LLM, das auf Patientenakten trainiert wird, Fragen zur Datenprivatsphäre und -nutzung auf. Die Gewährleistung, dass personenbezogene Daten nicht missbraucht oder ausgenutzt werden, erfordert transparente Datenverarbeitungsprozesse innerhalb dieser Modelle.

Aufkommende Lösungen für Interpretierbarkeit

Um diese Herausforderungen anzugehen, werden neue Techniken entwickelt. Dazu gehören kontrafaktische (CF) Approximationsmethoden. Die erste Methode beinhaltet, ein LLM dazu zu bringen, ein bestimmtes Textkonzept zu ändern, während andere Konzepte konstant bleiben. Dieser Ansatz ist zwar effektiv, aber ressourcenintensiv bei der Inferenz.

Die zweite Methode beinhaltet die Erstellung eines dedizierten Embedding-Raums, der während des Trainings von einem LLM geleitet wird. Dieser Raum ist mit einem kausalen Graphen ausgerichtet und hilft dabei, Übereinstimmungen zu identifizieren, die CFs approximieren. Diese Methode erfordert weniger Ressourcen bei der Testzeit und hat sich als effektiv erwiesen, um Modellvorhersagen zu erklären, sogar in LLMs mit Billionen von Parametern.

Diese Ansätze unterstreichen die Bedeutung kausaler Erklärungen in NLP-Systemen, um Sicherheit und Vertrauen zu gewährleisten. Kontrafaktische Approximationen bieten eine Möglichkeit, sich vorzustellen, wie ein gegebener Text sich ändern würde, wenn ein bestimmtes Konzept in seinem Generierungsprozess anders wäre, und helfen so bei der praktischen kausalen Wirkungsschätzung von Hochkonzepten auf NLP-Modelle.

Tiefere Betrachtung: Erklärungsmethoden und Kausalität in LLMs

Sondier- und Merkmalswichtigkeitstools

Sondieren ist eine Technik, die verwendet wird, um zu entschlüsseln, was interne Repräsentationen in Modellen kodieren. Es kann entweder überwacht oder unüberwacht sein und zielt darauf ab, zu bestimmen, ob bestimmte Konzepte an bestimmten Stellen in einem Netzwerk kodiert sind. Obwohl es in gewissem Maße effektiv ist, fallen Sonden in der Bereitstellung kausaler Erklärungen kurz, wie von Geiger et al. (2021) hervorgehoben.

Merkmalswichtigkeitstools, eine andere Form von Erklärungsmethoden, konzentrieren sich oft auf Eingabemerkmale, obwohl einige gradientbasierte Methoden sich auf versteckte Zustände erstrecken. Ein Beispiel ist die Methode der integrierten Gradienten, die eine kausale Interpretation durch die Erforschung von Basis-(kontrafaktischen, CF)-Eingaben bietet. Trotz ihrer Nützlichkeit haben diese Methoden Schwierigkeiten, ihre Analysen mit realen Konzepten jenseits einfacher Eingabeeigenschaften zu verknüpfen.

Interventionsbasierte Methoden

Interventionsbasierte Methoden beinhalten die Modifizierung von Eingaben oder internen Repräsentationen, um die Auswirkungen auf das Modellverhalten zu studieren. Diese Methoden können kontrafaktische Zustände erstellen, um kausale Effekte zu schätzen, aber sie erzeugen oft unplausible Eingaben oder Netzwerkzustände, es sei denn, sie werden sorgfältig kontrolliert. Das Causal Proxy Model (CPM), inspiriert vom S-Learner-Konzept, ist ein neuer Ansatz in diesem Bereich, der das Verhalten des zu erklärenden Modells unter kontrafaktischen Eingaben nachahmt. Allerdings ist die Notwendigkeit eines separaten Explainers für jedes Modell eine wesentliche Einschränkung.

Approximierung von Kontrafaktoren

Kontrafaktoren werden in der Maschinellen Lerntheorie häufig für Datenvergrößerung verwendet und beinhalten Störungen verschiedener Faktoren oder Etiketten. Diese können durch manuelle Bearbeitung, heuristische Schlüsselwortersetzung oder automatisierte Textumstellung generiert werden. Während manuelle Bearbeitung genau ist, ist sie auch ressourcenintensiv. Schlüsselwortbasierte Methoden haben ihre Einschränkungen, und generative Ansätze bieten eine Balance zwischen Flüssigkeit und Abdeckung.

Getreue Erklärungen

Getreue Erklärungen beziehen sich auf die genaue Darstellung der zugrunde liegenden Argumentation des Modells. Es gibt keine allgemein anerkannte Definition von Getreue, was zu ihrer Charakterisierung durch verschiedene Metriken wie Sensibilität, Konsistenz, Merkmalswichtigkeitsübereinstimmung, Robustheit und Simulierbarkeit führt. Die meisten dieser Methoden konzentrieren sich auf merkmalsbasierte Erklärungen und verwechseln oft Korrelation mit Kausalität. Unsere Arbeit zielt darauf ab, Erklärungen auf hoher Konzepte Ebene bereitzustellen, indem sie auf die Kausalitätsliteratur zurückgreift, um ein intuitives Kriterium vorzuschlagen: Order-Getreue.

Wir haben uns mit den inhärenten Komplexitäten von LLMs auseinandergesetzt, ihre “Black-Box”-Natur und die erheblichen Herausforderungen, die sie mit sich bringen. Von den Risiken fehlerhafter Entscheidungsfindung in sensiblen Bereichen wie Gesundheitswesen und Finanzen bis hin zu den ethischen Dilemmata im Zusammenhang mit Voreingenommenheit und Fairness hat die Notwendigkeit von Transparenz in LLMs noch nie so deutlich werden müssen.

Die Zukunft von LLMs und ihre Integration in unser tägliches Leben und kritische Entscheidungsprozesse hängt von unserer Fähigkeit ab, diese Modelle nicht nur leistungsfähiger, sondern auch verständlicher und rechenschaftspflichtiger zu machen. Die Verfolgung von Erklärbarkeit und Interpretierbarkeit ist nicht nur ein technisches Unterfangen, sondern ein grundlegender Aspekt des Aufbaus von Vertrauen in KI-Systeme. Da LLMs immer mehr in die Gesellschaft integriert werden, wird die Nachfrage nach Transparenz nicht nur von KI-Praktikern, sondern von jedem Benutzer, der mit diesen Systemen interagiert, wachsen.