Cybersicherheit

Schutz von Twitter-basierten Botnet-Command- und -Control-Servern mit neuronalen Netzen

Forscher aus China haben die “Black-Box”-Eigenschaft von neuronalen Netzen genutzt, um eine neue Methode zu entwickeln, mit der bösartige Botnets über Twitter mit ihren Command- und Control- (C&C-) Servern kommunizieren können, ohne dass Sicherheitsforscher dies aufdecken können, und es könnte schwierig machen, ihre Operationen abzuschalten.

Der aktualisierte Artikel, der am 2. August veröffentlicht wurde, trägt den Titel DeepC2: AI-gesteuertes verdecktes Botnet-Command und Control auf OSNs.

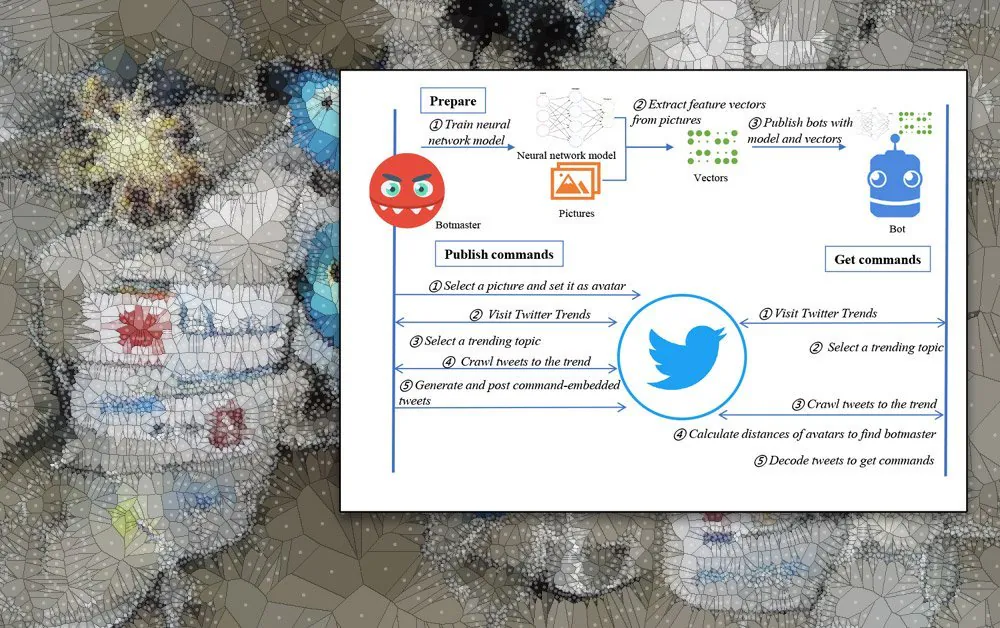

Die vorgeschlagene Methode, die erfolgreich in einem Test über Twitter getestet wurde, trainiert ein neuronales Netzwerk, um das Twitter-Konto zu identifizieren, das von einer C&C-Entität kontrolliert wird, basierend auf seinem Twitter-Benutzerbild. Sobald das Befehlskonto von dem neuronalen Netzwerk “authentifiziert” wurde, können die versteckten Befehle in seinen scheinbar harmlosen Tweets von der Armee der Computer ausgeführt werden, die mit dem Botnet infiziert wurden.

Quelle: https://arxiv.org/abs/2009.07707

Ein Botnet ist eine Gruppe von Computern, die so kompromittiert wurden, dass sie von zentralen Akteuren für verschiedene Arten von Crowdsourced-Cyber-Angriffen eingesetzt werden können, einschließlich DDoS-Einbrüchen, Kryptowährungs-Mining und Spam-Kampagnen.

Der Kampf um C&C-Anonymität

Jeder kompromittierte Computer im Botnet “Orchester” benötigt eine zentrale Richtung von den Urhebern der Malware und muss daher auf irgendeine Weise mit einem C&C-Server kommunizieren. Dies hat traditionell jedoch bedeutet, dass Sicherheitsforscher die individuelle Botnet-Infektion rückwärts entwickeln und die URL/s der C&C-Server aufdecken konnten, die normalerweise im Code hardcodiert waren.

Sobald die bösartige C&C-Domäne bekannt war, konnte sie auf Netzwerkebene blockiert und ihre Ursprünge im Rahmen von rechtlichen Schritten untersucht werden.

In den letzten Jahren hat sich der Trend für C&C-Server von dedizierten http-Domänen-Adressen weg zu populären Webdiensten wie Gmail, Twitter, Online-Clipboard-Diensten und verschiedenen Online-Sozialnetzwerken (OSNs) entwickelt.

2015 wurde bekannt, dass die Malware-Backdoor Hammertoss Twitter, GitHub und Cloud-Speicherdienste für diese Zwecke nutzte; 2018, dass das Remote-Administration-Tool (RAT) HeroRat die Telegram-Messaging-Protokoll für dieselben Zwecke nutzte; und dass 2020 die ComRAT-Malware der Turla-Gruppe zu Gmail als Kommunikationsframework migriert war.

Diese Ansätze erfordern jedoch immer noch einige Art von Identifikationsinformationen, die im infizierenden Softwarecode hardcodiert sind, was es Sicherheitsinitiativen ermöglicht, diese Kanäle zu schließen, normalerweise die abhängigen Botnets zu deaktivieren.

Geheime Identifikatoren

Die DeepC2-Methode, die von den chinesischen Forschern vorgeschlagen wird, macht es praktisch unmöglich, die C&C-Identifikationsinformationen rückwärts zu entwickeln, da der Code nur ein undurchsichtiges neuronales Netzwerk-Algorithmus preisgibt, der nicht leicht in seiner hoch optimierten (d. h. effektiv “kompilierten”) Form neu implementiert werden kann.

Unter DeepC2 sucht der Bot nach einem bestimmten Benutzerbild (in Trendthemen, damit der Bot nicht alle Twitter-Konten durchsuchen muss), dessen hochrangige Merkmale im neuronalen Netzwerk codiert sind. Die Autoren der Malware wählen im Voraus geeignete Bildbilder für die Kampagne aus und trainieren das neuronale Netzwerk auf diese. Die abgeleiteten Merkmalsvektoren und das neuronale Netzwerk selbst werden als Teil der bösartigen Payload verteilt.

Wenn der C&C-Server einen neuen Befehl veröffentlicht, wählt die lenkende Hand dahinter einige Trendthemen auf Twitter (oder welches soziale Netzwerk auch immer ausgenutzt wird) und generiert scheinbar gewöhnliche soziale Medien-Beiträge, die eingebettete Befehle enthalten. Die Aktualität des Trends bringt die Beiträge zu einer auffindbaren Prominenz, so dass die Bots leicht auf neue Befehle zugreifen können, indem sie das soziale Netzwerk durchsuchen.

Workflow von DeepC2.

Um die Entdeckung zu verhindern, wird jedes Twitter-Bild und das zugehörige Konto nur einmal als C&C-Mechanismus unter DeepC2 verwendet, und das System wechselt nach diesem Ereignis zu einem frischen, vorher festgelegten C&C-OSN-Handle. Zusätzlich löschen die Bots die verwendeten Vektorinformationen, die ihnen halfen, C&C-Avatare zu identifizieren, nach einmaliger Verwendung (einmaliger Befehlsübertragung), um eine Wiedergabe durch forensische Sicherheitsmethoden weiter zu behindern.

Verwischung von C&C-Befehlen

Als weitere Hilfe zur Verwischung enthält DeepC2 eine Methode, um die Entdeckung von expliziten Befehlen in Twitter-Nachrichten zu verhindern, indem Hash-Kollisionen und erweiterte Datenvergrößerung (EDA) verwendet werden, letztere basierend auf Arbeit aus dem Protago Labs Research im Jahr 2019, in Zusammenarbeit mit Dartmouth College und Georgetown University.

Eine Hash-Kollision tritt auf, wenn zwei verschiedene Datenstücke denselben Prüfwert haben, d. h. wenn jedes unterschiedliche Datenstück mathematisch äquivalent in seinem Profil ist – ein seltenes Szenario, das ausgenutzt werden kann, um Befehlsbezeichner aus scheinbar harmlosen Textinhalten zu erstellen.

Die Bots suchen nach diesen vorher programmierten Hashes in den sozialen Medien-Ausgaben von Konten, die sie als C&C-Server identifiziert haben, basierend auf den erkannten Avatar-Bildern. Da die von dem C&C-Befehlsgeber generierten Tweets einige kontextuelle Relevanz für den Ziel-Themenstrom haben, sind sie schwer als Anomalien zu identifizieren, was die Absicht der Beiträge verdeckt.

Obwohl die augmentierten Textdaten möglicherweise nicht grammatisch korrekt sind, verdecken die grammatischen Inkonsistenzen der Beiträge auf Twitter (und anderen sozialen Medien) effektiv diese ‘Fehler’ in der Verständlichkeit.

IP-Adressen werden von dem Botmaster an die Bots übermittelt, indem die URL in zwei separate Hashes mit Hash-Kollision aufgeteilt wird, die von den Remote-Bots identifiziert und zu einer verständlichen IP-Adresse zusammengefügt werden.

Die Forscher verwendeten sieben virtuelle private Server, um geo-diverse Standorte zu simulieren. Ziel-Avatare wurden aus 40 Fotos abgeleitet, die mit Mobiltelefonen aufgenommen wurden und die dann während des Trainings in Vektoren umgewandelt wurden. Die Bots wurden anschließend mit dem trainierten Modell und den Vektor-Daten positioniert.

Alle Befehle in dem Experiment wurden erfolgreich von den virtuellen Bot-Netzwerken empfangen und analysiert, wenn auch mit einiger Redundanz der Nachrichtenverbreitung, da das System nicht vollständig sicherstellen kann, dass jede Instanz einer Nachricht von einem bestimmten Tweet empfangen wird.

In Bezug auf Gegenmaßnahmen weisen die Forscher darauf hin, dass die automatisierte Häufigkeit, mit der “Sklaven”-Bots Twitter nach C&C-Nachrichten durchsuchen, und die Art und Weise, wie der C&C-Server durch eine Reihe von Beiträgen iteriert, möglicherweise ein identifizierbares Signaturen darstellen könnten, das von neuen Arten von Schutzframeworks angegangen werden könnte.

Darüber hinaus könnten OSNs die sehr spezifischen visuellen Unterschiede, die in einem Array von C&C-Avatar-Bildern gebacken sind, berechnen und Methoden entwickeln, um basierend auf diesen Kriterien Warnungen auszulösen.