Vordenker

Ein Praktisches Spielbuch für Defensible LLM-Ausgaben

Es gibt eine stille Annahme, die durch die meisten Unternehmens-GenAI-Implementierungen verläuft: wenn die Ausgabe richtig aussieht, ist sie richtig. In Umgebungen mit niedrigem Risiko ist das ein vernünftiger Shortcut. In regulierten Branchen wie Gesundheitswesen, Finanzen, Pharmazeutika und Qualitätssicherung ist es jedoch eine Haftung, die darauf wartet, ans Licht zu kommen.

Der Moment, in dem eine LLM-Ausgabe eine klinische Entscheidung, einen Finanzbericht oder ein Compliance-Dokument beeinflusst, hört die Flüssigkeit auf, ein Proxy für Zuverlässigkeit zu sein. Und wenn ein Auditor, Regulator oder Rechtsanwalt fragt, welche Daten verwendet wurden, welche Regeln angewendet wurden und wer sie genehmigt hat, ist “das Modell hat es gesagt” keine Antwort, die jemand unterzeichnen kann.

Dies ist die Haftungslücke, für die die meisten GenAI-Teams nicht entwerfen. Hier ist, wie man sie schließt.

Warum “Richtig Aussehen” der Falsche Standard ist

Die traditionelle AI-Bewertung konzentriert sich auf Genauigkeit, Latenz und Kosten. Diese sind wichtig. Aber regulierte Umgebungen führen eine vierte Achse ein, die die anderen nicht ersetzen kann: Prüfbarkeit.

Die EU-AI-Verordnung, die nun in Kraft ist, verlangt von hochrisiken AI-Systemen, technische Dokumentation, Nachverfolgbarkeitsprotokolle und Nachweise für menschliche Aufsicht während ihres gesamten Lebenszyklus zu führen. Die erste Entwurfsrichtlinie der FDA für AI in der Arzneimittel- und Biologikaentwicklung weist in die gleiche Richtung für die Life-Sciences. Diese Rahmenbedingungen bewerten nicht die Flüssigkeit. Sie verlangen Systeme, die rekonstruiert, überprüft und verteidigt werden können.

Eine verteidigungsfähige LLM-Ausgabe ist eine, die zurückverfolgt werden kann durch eine überprüfbare Beweiskette: welche Daten sie verwendet hat, welche Einschränkungen sie geformt haben, wer sie überprüft hat und was für zukünftige Inspektionen aufbewahrt wurde. Ohne diese Kette ist sogar eine korrekte Ausgabe unverteidigbar.

Dies verändert, was “produktionsbereit” tatsächlich für AI in regulierten Umgebungen bedeutet.

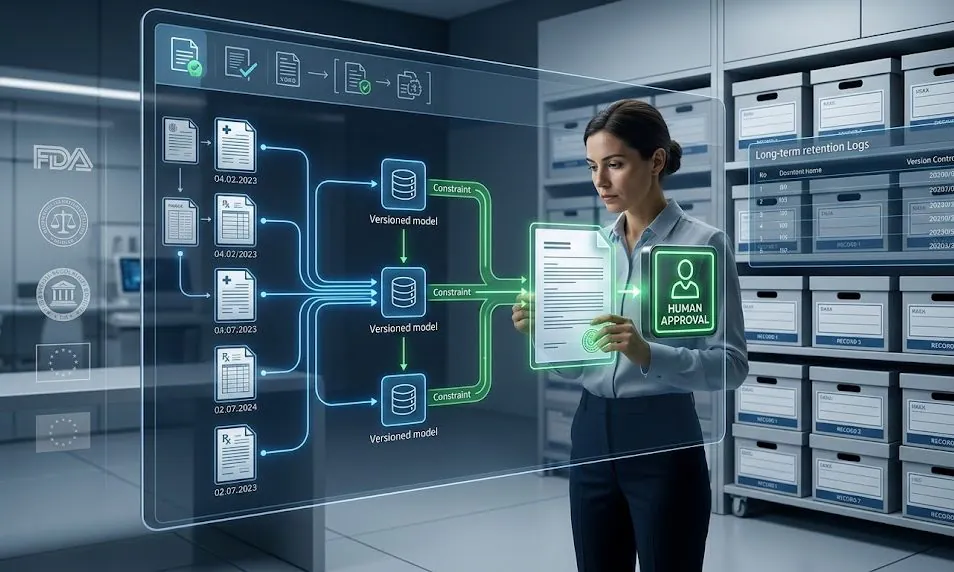

Die Vier Säulen der Prüfbereiten GenAI

Das Aufbauen von verteidigungsfähigen LLM-Systemen kommt auf vier Ingenieursanforderungen hin. Sie sind keine abstrakten Prinzipien – sie sind Infrastrukturentscheidungen, die bestimmen, ob Ihr System einer Prüfung standhalten kann.

1. Herkunft: Kontrollieren Sie, Woher das Modell Seine Informationen Bezieht

Der häufigste Fehlermodus in Unternehmens-AI ist auch der unsichtbarste: Modelle, die auf allgemeines Wissen oder lose definierte Datenquellen zurückgreifen. Wenn es keine kontrollierte Wissensgrenze gibt, können Ausgaben nicht auf eine überprüfbare Quelle zurückverfolgt werden, und eine Rekonstruktion wird unmöglich.

Eine praktische Lösung ist, eine genehmigte Wissensgrenze zu etablieren: versionierte, besessene Dokumente und Datensätze, die das System ausdrücklich verwenden darf. Jede Antwort sollte ein Mindestmaß an Beweisen tragen: eine Quellenkennung mit Version und Gültigkeitsdatum, ein Abrufprotokoll, das zeigt, was abgefragt und ausgewählt wurde, und inline-Zitate. Eine nützliche Betriebsregel: Keine Zitation, kein Anspruch.

Dies wandelt das System von einem memorybasierten Generator in ein evidenzbasiertes Argumentationsmodell. Der Unterschied wird kritisch, wenn jemand eine bestimmte Ausgabe Wochen oder Monate nach ihrer Generierung rekonstruieren muss.

2. Einschränkungen: Ersetzen Sie Improvisation Durch Kontrolliertes Verhalten

LLMs sind darauf ausgelegt, überzeugend zu sein. Ohne Einschränkungen optimieren sie für Plausibilität, und Plausibilität in einer regulierten Umgebung ist, wo das Risiko lebt.

Einschränkungen sind der Mechanismus, der einen probabilistischen Textgenerator in ein begrenztes Ausführungskomponente verwandelt. In der Praxis bedeutet dies:

- Quellengebundene Generierung: Jeder Anspruch erfordert eine genehmigte, versionierte Quelle. Keine Quelle bedeutet keine Antwort — nur Verweigerung oder Eskalation.

- Strukturierte Ausgabeschemata: Antworten folgen definierten Formaten, die Maschinen und Prüfer validieren können, nicht nur lesen.

- Vertrauensgrenzen-Durchsetzung: Abgerufener Inhalt wird als Eingabe behandelt, die prompt-injection-Risiken direkt anspricht, die sowohl Sicherheit als auch Prüfbarkeit untergraben können.

- Mindestprivilegien-Zugriff: Das Modell interagiert nur mit den Daten und Werkzeugen, die es wirklich benötigt, um Prüfprotokolle sauber zu halten.

Einschränkungen sind kein Compliance-Checkbox. Sie sind die architektonische Entscheidung, die bestimmt, ob Ihr System überhaupt geprüft werden kann.

3. Überprüfung: Machen Sie Menschliche Aufsicht Zu Einer Formalen Kontrollschicht

In regulierter AI kann menschliche Überprüfung nicht ad hoc sein. Sie muss risikobasiert (höheres Risiko auslöst strengere Validierung) und ereignisgesteuert sein, wenn das Modell-Vertrauen niedrig ist, Quellen fehlen oder Anomalien erkannt werden.

Die EU-AI-Verordnung verlangt explizit, dass Menschen in der Lage sein müssen, AI-getriebene Entscheidungen in hochrisiken Anwendungsfällen zu interpretieren, zu überstimmen und zu stoppen. Um diese Anforderung zu erfüllen, müssen Überprüfungsprotokolle erfassen, wer eine Ausgabe genehmigt hat, unter welchen Bedingungen und mit welchem Level an Prüfung. “Jemand hat es überprüft” ist kein Kontrollmechanismus. Ein dokumentiertes, zeitgestempeltes Überprüfungsprotokoll ist.

Dies erhöht die Überprüfung von manueller QA zu einer formalen Governance-Schicht, was genau so ist, wie Regulierungsbehörden damit beginnen, sie zu behandeln.

4. Aufbewahrung: Machen Sie Verantwortlichkeit Dauerhaft

Ohne Protokolle gibt es keine Prüfungsunterlagen. Ohne Prüfungsunterlagen ist Verantwortlichkeit theoretisch.

Zugleich schafft die Aufbewahrung aller Daten ihre eigenen Risiken, insbesondere wenn sensible Gesundheits- oder Finanzdaten minimierungspflichtig sind unter Rahmenbedingungen wie DSGVO oder HIPAA.

Der praktische Ansatz ist ein gestuftes Modell. Speichern Sie immer Metadaten des Modells und der Version, Quellenkennungen, Richtlinienentscheidungen und Zeitstempel. Speichern Sie Interaktionsinhalte (Prompts, Ausgaben und vollständige Protokolle) selektiv, basierend auf Risikoklassifizierung, mit geeigneten Schwärzungen und Zugriffsbeschränkungen. Das Ziel ist, die Rekonstruktion jeder Ausgabe zu ermöglichen, ohne Daten zu sammeln, die zu nachgelagerten Expositionen führen.

Wie Dies in Der Praxis Aussehen Könnte

Betrachten Sie, wie dies in den Life-Sciences Anwendung findet, wo CFR 21 Teil 11 verlangt, dass elektronische Aufzeichnungen zugeordnet, lesbar, zeitnah, ursprünglich und genau sein müssen. Ein LLM, das regulatorische Dokumentation generiert, muss alle fünf Kriterien erfüllen — nicht nur lesbaren Text produzieren.

In diesem Kontext sind die vier Säulen keine optionalen Verbesserungen. Sie sind die Mindestanforderung für ein konformes System. Herkunft stellt sicher, dass die Ausgabe zugeordnet und ursprünglich ist. Einschränkungen stellen sicher, dass sie innerhalb definierter Grenzen bleibt. Überprüfung stellt sicher, dass sie zeitnah mit menschlicher Aufsicht ist. Aufbewahrung stellt sicher, dass sie lesbar und überprüfbar ist.

Die gleiche Logik gilt in Finanzdienstleistungen, wo MiFID II Aufzeichnungen von Entscheidungen und der dahinterliegenden Begründung verlangt, und im Gesundheitswesen, wo klinische Entscheidungssysteme zunehmend unter Beweis stehen, was Erklärbarkeit und Voreingenommenheit angeht.

Die Größere Verschiebung

GenAI bewegt sich von Experimenten in die operative Infrastruktur. Diese Transition erhöht den Standard für akzeptable Systeme.

Eine nützliche Ausgabe reicht nicht mehr aus. Organisationen benötigen Ausgaben, die erklärt, zurückverfolgt und unter Prüfung verteidigt werden können, weil AI aufgefordert wird, Dinge zu tun, die reale Konsequenzen mit sich bringen.

Die Teams, die von Anfang an für Verteidigungsfähigkeit entwerfen, werden in der Lage sein, AI sicher zu skalieren und regulatorisches Vertrauen aufrechtzuerhalten. Diejenigen, die dies nicht tun, werden schließlich dem gleichen Moment gegenüberstehen: einer Prüfung, einer einfachen Frage zu einer bestimmten Ausgabe und nichts, was sie zeigen können.

Das Aufbauen von prüfungsreifer AI ist nicht darum, langsamer zu machen. Es ist darum, etwas zu bauen, das Bestand haben kann.