Andersons Blickwinkel

KI-Modelle haben Schwierigkeiten, historische Sprache nachzuahmen

Eine Zusammenarbeit zwischen Forschern in den USA und Kanada hat ergeben, dass große Sprachmodelle (LLMs) wie ChatGPT Schwierigkeiten haben, historische Idiome ohne umfangreiche Vorabtrainierung nachzuahmen – ein kostspieliger und arbeitsintensiver Prozess, der über die Möglichkeiten der meisten akademischen oder Unterhaltungsinitiativen hinausgeht und Projekte wie das Vervollständigen des letzten, unvollendeten Romans von Charles Dickens durch KI effektiv zu einem unwahrscheinlichen Vorhaben macht.

Die Forscher erforschten eine Reihe von Methoden, um Texte zu generieren, die klangen historisch genau, beginnend mit einfacher Aufforderung mit Prosa aus dem frühen 20. Jahrhundert und fortschreitend zur Feinabstimmung eines kommerziellen Modells auf einer kleinen Sammlung von Büchern aus dieser Periode.

Sie verglichen die Ergebnisse auch mit einem separaten Modell, das ausschließlich auf Büchern trainiert worden war, die zwischen 1880 und 1914 veröffentlicht wurden.

Im ersten der Tests ergab die Anweisung an ChatGPT-4o, fin‑de‑siècle-Sprache nachzuahmen, ganz andere Ergebnisse als die des kleineren GPT2-basierten Modells, das auf Literatur aus der Periode feinabgestimmt worden war:

Aufgefordert, einen realen historischen Text (oben Mitte) zu vervollständigen, kann sogar ein gut vorbereiteter ChatGPT-4o (untere linke Seite) nicht umhin, in den ‘Blog’-Modus zurückzufallen und die angeforderte Idiomatik nicht darzustellen. Im Gegensatz dazu erfasst das feinabgestimmte GPT2-Modell (untere rechte Seite) den Sprachstil gut, ist aber in anderen Aspekten nicht so genau. Quelle: https://arxiv.org/pdf/2505.00030

Obwohl die Feinabstimmung die Ausgabe näher an den ursprünglichen Stil bringt, konnten menschliche Leser immer noch häufig Spuren moderner Sprache oder Ideen erkennen, was darauf hindeutet, dass sogar sorgfältig angepasste Modelle weiterhin den Einfluss ihrer zeitgenössischen Trainingsdaten widerspiegeln.

Die Forscher kommen zu dem frustrierenden Schluss, dass es keine wirtschaftlichen Abkürzungen zur Erzeugung maschinengenerierter, idiomatisch korrekter historischer Texte oder Dialoge gibt. Sie vermuten auch, dass die Herausforderung selbst möglicherweise falsch gestellt ist:

‘[Wir] sollten auch die Möglichkeit in Betracht ziehen, dass Anachronismen in gewissem Sinne unvermeidlich sind. Ob wir die Vergangenheit durch Anpassen historischer Modelle darstellen, damit sie Gespräche führen können, oder durch Lehren zeitgenössischer Modelle, eine ältere Periode nachzuahmen, mag ein Kompromiss zwischen den Zielen der Authentizität und der konversationellen Flüssigkeit notwendig sein.

‘Es gibt schließlich keine “authentischen” Beispiele für ein Gespräch zwischen einem Fragesteller des 21. Jahrhunderts und einem Antwortenden aus dem Jahr 1914. Forscher, die versuchen, ein solches Gespräch zu erstellen, müssen über die [Prämisse] nachdenken, dass Interpretation immer eine Verhandlung zwischen Gegenwart und [Vergangenheit] beinhaltet.’

Die neue Studie trägt den Titel Können Sprachmodelle die Vergangenheit ohne Anachronismen darstellen? und stammt von drei Forschern der Universitäten Illinois, British Columbia und Cornell.

Komplett desaströs

Zunächst testeten die Autoren in einem dreiteiligen Forschungsansatz, ob moderne Sprachmodelle durch einfache Aufforderung in die Lage versetzt werden können, historische Sprache nachzuahmen. Mit Hilfe realer Auszüge aus Büchern, die zwischen 1905 und 1914 veröffentlicht wurden, baten sie ChatGPT-4o, diese Passagen im gleichen Idiom fortzusetzen.

Der ursprüngliche Periodentext lautete:

‘In diesem letzten Fall werden etwa fünf oder sechs Dollar pro Minute eingespart, da mehr als zwanzig Yards Film abgespult werden müssen, um während einer einzigen Minute ein Objekt oder eine Landschaft in Ruhe zu projizieren. So erhält man eine praktische Kombination aus festen und bewegten Bildern, die sehr künstlerische Effekte erzeugt.

‘Es ermöglicht uns auch, zwei Kinematographen abwechselnd zu projizieren, um das Flimmern zu vermeiden, oder gleichzeitig rote und grüne Bilder zu projizieren und natürliche Farben wiederzugeben, wodurch das menschliche Auge, das daran gewöhnt ist, die Grundfarben gleichzeitig zu empfangen, von aller physiologischen Ermüdung befreit wird. Ein Wort jetzt über die Anwendung von kaltem Licht in der Instantfotografie.’

Um zu bewerten, ob der generierte Text dem beabsichtigten historischen Stil entsprach und sich bewusst, dass Menschen nicht besonders gut darin sind, das Datum zu erraten, an dem ein Text geschrieben wurde, feinabstimmten die Forscher ein RoBERTa-Modell, um Veröffentlichungsdaten zu schätzen, unter Verwendung eines Teils des Corpus of Historical American English, das Material von 1810 bis 2009 abdeckt.

Das RoBERTa-Klassifizierungsmodell wurde dann verwendet, um Fortsetzungen zu bewerten, die von ChatGPT-4o erzeugt wurden, das mit realen Passagen aus Büchern angeregt worden war, die zwischen 1905 und 1914 veröffentlicht wurden.

Die Systemaufforderung (d. h. kontextuelle Anweisungen an ChatGPT, wie es die Aufgabe angehen soll) lautete:

‘Ihre Aufgabe ist es, Passagen aus frühen zwanzigsten Jahrhundert Büchern zu vervollständigen. Sie erhalten eine Passage aus einem Buch, das 1913 veröffentlicht wurde. Setzen Sie diese Passage im gleichen Stil fort, für mindestens 200 Wörter. Stellen Sie nur diese Fortsetzung bereit; fügen Sie keine Rahmenbemerkungen hinzu, wie “hier ist die Fortsetzung:”.

Trotz einer und 20 Aufforderungen neigten die Ausgaben von ChatGPT-4o konstant zu einem stilistischen Register des 21. Jahrhunderts.

Das Beispiel, das im Papier angegeben ist, zeigt einen der blog-ähnlichen Versuche von ChatGPT-4o, den realen Periodentext über Fotografie fortzusetzen:

‘Die Verwendung von kaltem Licht in der Instantfotografie hat den Ansatz zur Aufnahme von Bildern unter verschiedenen Lichtbedingungen revolutioniert. Traditionell kämpften Fotografen mit der Härte und Variabilität des natürlichen Lichts oder der aufdringlichen Natur der Blitzfotografie, die die Atmosphäre einer Szene oder das natürliche Verhalten von Subjekten, insbesondere in der Tier- und Menschenfotografie, stören konnte.

‘Kaltes Licht, mit seiner weicheren und diffuseren Natur… ermöglicht eine natürlichere Darstellung von Farben und Texturen, die oft unter harter künstlicher Beleuchtung verloren geht.’

Wie wir leicht sehen können, entspricht dieser generische, wiki-ähnliche Text nicht dem umfangreichen und elaborierten Stil des ursprünglichen Periodentexts. Weiterhin setzt er nicht wirklich an dem Punkt fort, an dem der ursprüngliche Inhalt endet, sondern startet in eine tangentielle, abstrakte Betrachtung über eines der Unterthemen.

Das Team testete auch GPT-1914, ein kleineres GPT-2-Modell, das von Grund auf mit 26,5 Milliarden Token an Literatur trainiert wurde, die zwischen 1880 und 1914 datiert.

Obwohl seine Ausgabe weniger kohärent war als die von ChatGPT-4o, war sie konsistenter mit dem Stil der Quellperiode. Das einzige Beispiel, das im Papier angegeben ist, liest sich wieder als Fortsetzung des realen Periodentexts über Fotografie:

‘Das Prinzip seines Wirkens wurde bereits erklärt (S. 4). Wir werden hier nur erwähnen, dass es mit Vorteil angewendet werden kann, wenn wir sehr schnelle Fotografien auf mit Collodion beschichteten Papier sowie solche aufgenommen mit Gelatineplatten erhalten möchten.

‘In solchen Fällen darf die Belichtungszeit nicht mehr als eine Sekunde betragen; aber wenn das Bild in weniger Zeit entwickelt werden soll – sagen wir eine halbe Sekunde – sollte die Temperatur nie unter 20° C fallen, sonst wird das Bild nach der Entwicklung zu dunkel; außerdem verliert die Platte unter diesen Bedingungen ihre Empfindlichkeit.

‘Für gewöhnliche Zwecke genügt es jedoch, die empfindliche Oberfläche einer geringen Wärme auszusetzen, ohne dass besondere Vorsichtsmaßnahmen erforderlich sind, außer dass die’ [sic]

Da sogar das reale und ursprüngliche Material sehr schwer zu verstehen ist, ist es schwierig, den Umfang zu verstehen, in dem GPT-1914 das Original aufgenommen hat; aber die Ausgabe klingt sicherlich perioden-authentischer.

Die Autoren schlussfolgerten jedoch aus diesem Experiment, dass einfache Aufforderung wenig tut, um die zeitgenössischen Voreingenommenheiten eines großen vorab trainierten Modells wie ChatGPT-4o zu überwinden.

Die Handlung verdichtet sich

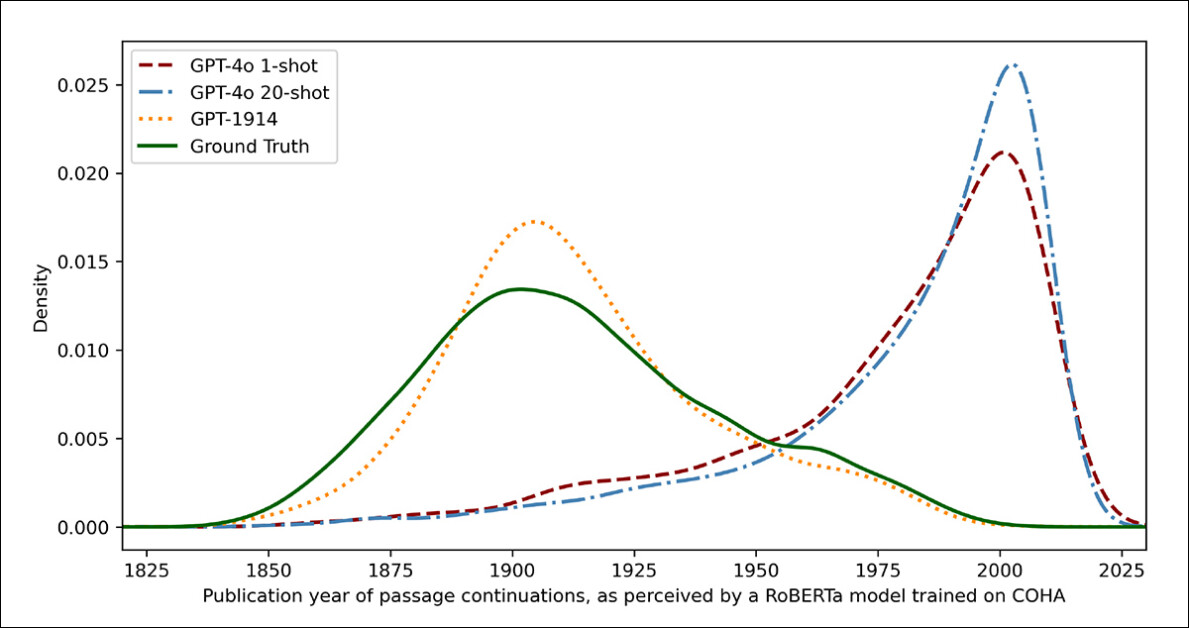

Um zu messen, wie sehr die Modellausgaben authentische historische Schreibweise ähnelten, verwendeten die Forscher einen statistischen Klassifizierer, um das wahrscheinliche Veröffentlichungsdatum jedes Textbeispiels zu schätzen. Sie visualisierten die Ergebnisse dann mithilfe einer Kerneldichteverteilungsgrafik, die zeigt, wo das Modell denkt, dass jede Passage in einer historischen Zeitleiste liegt.

Geschätzte Veröffentlichungsdaten für reale und generierte Texte, basierend auf einem Klassifizierer, der auf historischen Stil (1905-1914 Quelltexte im Vergleich zu Fortsetzungen von GPT-4o mit einer und 20 Aufforderungen und von GPT-1914, trainiert nur auf Literatur von 1880-1914) trainiert wurde.

Das feinabgestimmte RoBERTa-Modell, das für diese Aufgabe verwendet wurde, ist, wie die Autoren betonen, nicht fehlerfrei, konnte jedoch allgemeine stilistische Trends hervorheben. Passagen, die von GPT-1914 erstellt wurden, einem Modell, das ausschließlich auf Literatur aus der Periode trainiert wurde, gruppierten sich um das frühe 20. Jahrhundert – ähnlich wie das ursprüngliche Quellenmaterial.

Im Gegensatz dazu neigten die Ausgaben von ChatGPT-4o, sogar bei mehrfacher Aufforderung, dazu, modernes Schreiben zu ähneln, was die Daten widerspiegelt, auf denen es ursprünglich trainiert wurde.

Die Forscher quantifizierten diese Diskrepanz mithilfe der Jensen-Shannon-Divergenz, einem Maß, wie unterschiedlich zwei Wahrscheinlichkeitsverteilungen sind. GPT-1914 erzielte einen Wert von 0,006 im Vergleich zu realen historischen Texten, während die Ausgaben von ChatGPT-4o bei einer und 20 Aufforderungen viel größere Abstände von 0,310 bzw. 0,350 aufwiesen.

Die Autoren argumentieren, dass diese Ergebnisse darauf hindeuten, dass Aufforderungen allein, sogar mit mehreren Beispielen, kein zuverlässiger Weg sind, um Text zu produzieren, der historischen Stil überzeugend simuliert.

Die Passage vervollständigen

Das Papier untersucht dann, ob Feinabstimmung ein besseres Ergebnis liefern könnte, da dieser Prozess das direkte Beeinflussen der verwendbaren Gewichte eines Modells durch “Fortsetzen” seiner Ausbildung auf benutzerspezifischen Daten beinhaltet – ein Prozess, der die ursprüngliche Kernfunktionalität des Modells beeinflussen kann, aber dessen Leistung auf dem Domäne, der “in” ihn oder während der Feinabstimmung betont wird, erheblich verbessern kann.

Im ersten Feinabstimmungsversuch trainierten die Forscher GPT-4o-Mini auf etwa zweitausend Passage-Vervollständigungspaarungen, die aus Büchern stammten, die zwischen 1905 und 1914 veröffentlicht wurden, mit dem Ziel, zu sehen, ob eine kleinere Feinabstimmung die Ausgaben des Modells in Richtung eines historisch genauereren Stils verschieben könnte.

Mit demselben RoBERTa-basierten Klassifizierer, der als Richter in den früheren Tests fungierte, um den stilistischen “Zeitpunkt” jeder Ausgabe zu schätzen, fanden die Forscher, dass das feinabgestimmte Modell in diesem neuen Experiment Texte produzierte, die eng mit der Grundwahrheit übereinstimmten.

Die stilistische Divergenz von den ursprünglichen Texten, gemessen durch die Jensen-Shannon-Divergenz, sank auf 0,002, im Allgemeinen in Übereinstimmung mit GPT-1914:

Geschätzte Veröffentlichungsdaten für reale und generierte Texte, die zeigen, wie gut GPT-1914 und eine feinabgestimmte Version von GPT-4o-Mini den Stil des frühen 20. Jahrhunderts nachahmen (basierend auf Büchern, die zwischen 1905 und 1914 veröffentlicht wurden).

Die Forscher warnen jedoch, dass diese Metrik möglicherweise nur oberflächliche Merkmale des historischen Stils erfassen kann und nicht tiefergehende konzeptionelle oder faktische Anachronismen.

‘[Dies] ist nicht ein sehr empfindlicher Test. Das RoBERTa-Modell, das hier als Richter verwendet wird, ist nur trainiert, um ein Datum vorherzusagen, nicht, um authentische Passagen von anachronistischen zu unterscheiden. Es verwendet wahrscheinlich grobe stilistische Beweise, um diese Vorhersage zu treffen. Menschliche Leser oder größere Modelle könnten immer noch anachronistischen Inhalt in Passagen erkennen, die oberflächlich “in der Periode” klingen.’

Menschlicher Touch

Schließlich führten die Forscher menschliche Bewertungstests mit 250 handverlesenen Passagen aus Büchern durch, die zwischen 1905 und 1914 veröffentlicht wurden, und stellten fest, dass viele dieser Texte heute wahrscheinlich anders interpretiert würden als zur Zeit ihrer Abfassung:

‘Unsere Liste umfasste beispielsweise einen Enzyklopädieeintrag über Elsaß (das damals Teil Deutschlands war) und einen über Beri-Beri (der damals oft als Pilzkrankheit und nicht als Nährstoffmangel erklärt wurde). Während dies Unterschiede in Tatsachen sind, wählten wir auch Passagen aus, die subtilere Unterschiede in Einstellung, Rhetorik oder Vorstellungskraft zeigen würden.

‘Beispielsweise neigen Beschreibungen nicht-europäischer Orte im frühen 20. Jahrhundert dazu, in rassistische Verallgemeinerungen abzurutschen. Eine Beschreibung von Sonnenaufgang auf dem Mond, geschrieben 1913, stellt reiche chromatische Phänomene vor, weil noch niemand Fotos einer Welt ohne Atmosphäre gesehen hat.’

Die Forscher erstellten kurze Fragen, die jede historische Passage plausibel beantworten konnte, und feinabstimmten dann GPT-4o-Mini auf diese Frage-Antwort-Paare. Um die Bewertung zu stärken, trainierten sie fünf separate Versionen des Modells, wobei sie jedes Mal einen anderen Teil der Daten für Tests zurückhielten.

Sie erstellten dann Antworten mithilfe der Standardversionen von GPT-4o und GPT-4o-Mini sowie der feinabgestimmten Varianten, die jeweils auf dem Teil bewertet wurden, den sie während der Ausbildung nicht gesehen hatten.

Verloren in der Zeit

Um zu bewerten, wie überzeugend die Modelle historische Sprache nachahmen konnten, baten die Forscher drei Experten-Annotatoren, 120 von KI generierte Fortsetzungen zu überprüfen und zu beurteilen, ob jede davon für einen Schriftsteller im Jahr 1914 plausibel erschien.