Künstliche Intelligenz

KI-Forschung sieht separate Lautstärkeregelungen für Dialog, Musik und Soundeffekte vor

Eine neue Forschungskooperation unter der Leitung von Mitsubishi untersucht die Möglichkeit, drei separate Soundtracks aus einer Original-Audioquelle zu extrahieren, indem der Audio-Track in Sprache, Musik und Soundeffekte (d. h. Ambient-Geräusche) aufgeteilt wird.

Da es sich um ein post-faktes Verarbeitungsframework handelt, bietet es Potenzial für spätere Generationen von Multimedia-Wiedergabeprodukten, einschließlich Consumer-Geräten, um drei Punkte Lautstärkeregelungen anzubieten, die es dem Benutzer ermöglichen, die Lautstärke des Dialogs zu erhöhen oder die Lautstärke eines Soundtracks zu senken.

In dem kurzen Clip unten aus dem begleitenden Video zur Forschung (siehe Ende des Artikels für das vollständige Video) sehen wir verschiedene Aspekte des Soundtracks, die hervorgehoben werden, wenn der Benutzer einen Regler über ein Dreieck mit den drei Audio-Komponenten in einer Ecke zieht:

Ein kurzer Clip aus dem Video, das dem Paper beigefügt ist (siehe Embed am Ende des Artikels). Wenn der Benutzer den Cursor in Richtung einer der drei extrahierten Aspekte im Dreieck-UI (rechts) zieht, betont der Audio diesen Teil des dreiteiligen Soundtracks. Obwohl das längere Video eine Reihe von zusätzlichen Beispielen auf YouTube nennt, sind diese derzeit nicht verfügbar.Quelle: https://vimeo.com/634073402

Das Paper trägt den Titel The Cocktail Fork Problem: Three-Stem Audio Separation for Real-World Soundtracks und stammt von Forschern der Mitsubishi Electric Research Laboratories (MERL) in Cambridge, MA, und der Abteilung für Intelligente Systeme an der Indiana University in Illinois.

Separierung von Aspekten eines Soundtracks

Die Forscher haben die Herausforderung ‘The Cocktail Party Problem’ genannt, weil es darum geht, stark verflochtene Elemente eines Soundtracks zu isolieren, was eine Roadmap ähnlich einem Fork (siehe Bild unten) erstellt. In der Praxis können Mehrkanal-Soundtracks (d. h. Stereo und mehr) unterschiedliche Mengen an Inhalten wie Dialog, Musik und Ambiente haben, insbesondere da der Dialog tendenziell den Mittelkanal dominiert in Dolby 5.1-Mischungen. Derzeit jedoch konzentriert sich das sehr aktive Forschungsgebiet der Audio-Separierung darauf, diese Stränge aus einem einzelnen, gemischten Soundtrack zu erfassen, wie es die aktuelle Forschung tut.

The Cocktail Fork – Ableitung von drei verschiedenen Soundtracks aus einem gemischten und einzelnen Soundtrack. Quelle: https://arxiv.org/pdf/2110.09958.pdf

Aktuelle Forschung hat sich auf die Extraktion von Sprache in verschiedenen Umgebungen konzentriert, oft für den Zweck der Entrauschung von Sprachaudio für die anschließende Verwendung mit Natural Language Processing (NLP)-Systemen, aber auch auf die Isolation von archivierten Gesangsstimmen, entweder um synthetische Versionen von realen (auch verstorbenen) Sängern zu erstellen oder um Karaoke-ähnliche Musikisolation zu ermöglichen.

Ein Dataset für jeden Aspekt

Bisher wurde wenig Beachtung darauf gelegt, diese Art von KI-Technologie zu nutzen, um den Benutzern mehr Kontrolle über die Mischung eines Soundtracks zu geben. Daher haben die Forscher das Problem formalisiert und ein neues Dataset als Hilfe für die laufende Forschung zur Separierung von Mehrfach-Typ-Soundtracks entwickelt, sowie es auf verschiedenen bestehenden Audio-Separierungsframeworks getestet.

Das neue Dataset, das die Autoren entwickelt haben, heißt Divide and Remaster (DnR) und basiert auf vorherigen Datasets LibriSpeech, Free Music Archive und dem Freesound Dataset 50k (FSD50K). Für diejenigen, die mit DnR von Grund auf arbeiten möchten, muss das Dataset aus den drei Quellen rekonstruiert werden; ansonsten wird es kurz auf Zenodo verfügbar sein, behaupten die Autoren. Allerdings ist der bereitgestellte GitHub-Link für Quell-Extraktions-Utilities derzeit nicht aktiv, so dass die Interessierten möglicherweise ein wenig warten müssen.

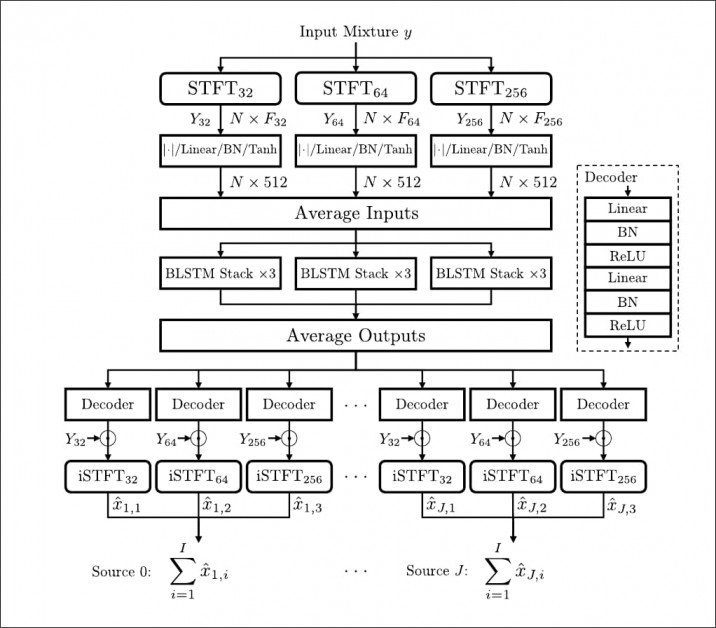

Die Forscher haben festgestellt, dass die CrossNet un-mix (XUMX) Architektur, die von Sony im Mai vorgeschlagen wurde, besonders gut mit DnR funktioniert.

Sonys CrossNet-Architektur.

Die Autoren behaupten, dass ihre maschinellen Lern-Extraktionsmodelle gut auf Soundtracks von YouTube funktionieren, obwohl die in der Arbeit präsentierten Bewertungen auf synthetischen Daten basieren und das bereitgestellte Haupt-Unterstützungs-Video (darunter eingebettet) derzeit das einzige zu sein scheint, das verfügbar ist.

Die drei Datasets, die verwendet werden, bestehen jeweils aus einer Sammlung der Art von Ausgaben, die aus einem Soundtrack separiert werden müssen: FSD50K ist mit Soundeffekten beschäftigt und enthält 50.000 44,1 kHz Mono-Audio-Clips mit 200 Klassenlabels aus der Google AudioSet-Ontologie; die Free Music Archive enthält 100.000 Stereo-Songs mit 161 Musikgenres, obwohl die Autoren eine Teilmenge mit 25.000 Songs verwendet haben, um mit FSD50K übereinzustimmen; und LibriSpeech liefert DnR mit 100 Stunden Audio-Buch-Proben als 44,1 kHz mp3-Audio-Dateien.

Zukünftige Arbeiten

Die Autoren erwarten weitere Arbeiten am Dataset und einer Kombination der separaten Modelle, die für weitere Forschung zu Spracherkennungs- und Sound-Klassifizierungsframeworks entwickelt wurden, mit automatischer Untertitel-Generierung für Sprache und Nicht-Sprach-Geräusche. Sie planen auch, Möglichkeiten für Remix-Ansätze zu bewerten, die wahrnehmbare Artefakte reduzieren können, was das zentrale Problem bleibt, wenn ein gemischter Audio-Soundtrack in seine Bestandteile aufgeteilt wird.

Diese Art von Separierung könnte in Zukunft als Consumer-Kommodität in Smart-TVs verfügbar sein, die hoch optimierte Inferenz-Netzwerke integrieren, obwohl es wahrscheinlich ist, dass frühe Implementierungen einige Vorbearbeitungszeit und Speicherplatz benötigen würden. Samsung verwendet bereits lokale neuronale Netzwerke für das Upscaling, während Sonys Cognitive Processor XR, der in der Bravia-Reihe des Unternehmens verwendet wird, Soundtracks in Echtzeit über leichte integrierte KI analysiert und interpretiert.

Forderungen nach mehr Kontrolle über die Mischung eines Soundtracks kommen regelmäßig wieder, und die meisten der Lösungen, die angeboten werden, müssen mit der Tatsache umgehen, dass der Soundtrack bereits gemäß den aktuellen Standards (und Annahmen darüber, was Zuschauer wollen) in der Film- und Fernsehbranche gemischt wurde.

Ein Zuschauer, der von den schockierenden Unterschieden in den Lautstärkepegeln zwischen verschiedenen Elementen von Film-Soundtracks genervt war, wurde so verzweifelt, dass er eine hardwarebasierte automatische Lautstärkeregelung entwickelte, die in der Lage ist, Lautstärken auszugleichen für Filme und Fernsehen.

Obwohl Smart-TVs eine vielfältige Reihe von Methoden anbieten, um den Dialog-Lautstärke zu erhöhen, gegenüber den großen Lautstärkepegeln für Musik, kämpfen sie alle gegen die Entscheidungen, die zur Mischzeit getroffen wurden, und, argumentativ, die Visionen von Content-Produzenten, die wünschen, dass das Publikum ihre Soundtracks genau so erlebt, wie sie eingerichtet wurden.

Content-Produzenten scheinen wahrscheinlich gegen diese potenzielle Ergänzung zur ‘Remix-Kultur’ zu reagieren, da bereits einige Branchen-Größen ihre Unzufriedenheit gegenüber Standard-Post-Verarbeitungs-TV-Algorithmen wie Motion Smoothing geäußert haben.

https://vimeo.com/634073402