Künstliche Intelligenz

KI-generierte Sprache beginnt, die wissenschaftliche Literatur zu verunreinigen

Forscher aus Frankreich und Russland haben eine Studie veröffentlicht, die darauf hinweist, dass die Verwendung von KI-gesteuerten probabilistischen Textgeneratoren wie GPT-3 “gequälte Sprache”, Zitate von nicht existierender Literatur und ad-hoc-Bildwiederverwendung ohne Namensnennung in previously respectable channels für die Veröffentlichung neuer wissenschaftlicher Literatur einführen.

Vielleicht ist es am besorgniserregendsten, dass die untersuchten Arbeiten auch wissenschaftlich ungenaue oder nicht reproduzierbare Inhalte enthalten, die als Früchte objektiver und systematischer Forschung präsentiert werden, was darauf hindeutet, dass generative Sprachmodelle nicht nur verwendet werden, um die begrenzten Englischkenntnisse der Autoren zu verbessern, sondern tatsächlich die harte Arbeit leisten (und dabei unweigerlich schlecht zu machen).

Der Bericht, betitelt Gequälte Phrasen: Ein zweifelhafter Schreibstil, der in der Wissenschaft aufkommt, wurde von Forschern der Computer Science Department an der University of Toulouse und Yandex-Forscher Alexander Magazinov, derzeit an der Tel Aviv University, zusammengestellt.

Die Studie konzentriert sich insbesondere auf das Wachstum sinnloser KI-generierter wissenschaftlicher Veröffentlichungen in der Elsevier-Zeitschrift Mikroprozessoren und Mikrosysteme.

Bei jedem anderen Namen

Autoregressive Sprachmodelle wie GPT-3 werden auf großen Datenmengen trainiert und sollen diese Daten paraphrasieren, zusammenfassen, kombinieren und interpretieren, um kohärente generative Sprachmodelle zu erstellen, die natürliche Sprech- und Schreibmuster reproduzieren können, während sie die ursprüngliche Intention der Trainingsdaten beibehalten.

Da solche Frameworks häufig während der Modelltrainingsphase bestraft werden, wenn sie direkte und “nicht absorbierte” Wiedergabe der ursprünglichen Daten anbieten, suchen sie unweigerlich nach Synonymen – sogar für etablierte Phrasen.

Die offensichtlich von KI erstellten oder unterstützten wissenschaftlichen Einreichungen, die die Forscher entdeckt haben, enthalten eine außergewöhnliche Anzahl von fehlgeschlagenen Versuchen, kreative Synonyme für bekannte Phrasen im Maschinenlernbereich zu finden:

tiefes neuronales Netzwerk: tiefes neuronales Organisationsnetz

künstliches neuronales Netzwerk: (falsches | gefälschtes) neuronales Organisationsnetz

mobilles Netzwerk: vielseitiges Organisationsnetz

Netzwerkangriff: Organisationsangriff (Hinterhalt | Angriff)

Netzwerkverbindung: Organisationsverbindung

Big Data: (enorme | große | enorme | kolossale) Informationen

Datenlager: Informationslager (Lager | Verteilungszentrum)

künstliche Intelligenz (KI): (falsche | von Menschen erstellte) Bewusstsein

High-Performance-Computing: Elite-Berechnung

Wolken-/Nebel-/Dunst-Computing: Dunst-Berechnung

Grafikprozessor (GPU): Entwurfsvorbereitungs-Einheit

Zentrale Prozessoreinheit (CPU): Zentrale Vorbereitungseinheit

Workflownotor: Arbeitsprozessmotor

Gesichtserkennung: Gesichtsbestätigung

Stimmerkennung: Redebestätigung

Mittelwertquadratfehler: Mittelwertquadratfehler (Fehler | Versehen)

Mittelwertabsoluter Fehler: Mittelwertabsoluter (größter | höchster) Fehler

Signal-Rausch-Verhältnis: Signal-Rausch-Verhältnis (Bewegung | Flagge | Zeichen | Signal) zu (Lärm | Geräusch)

globale Parameter: weltweite Parameter

zufälliger Zugriff: (zufälliger | unregelmäßiger) Zugriff

zufälliger Wald: (zufälliger | unregelmäßiger) Wald

zufälliger Wert: (zufälliger | unregelmäßiger) Wert

Ameisenkolonie: Untergrundinsekten-Kolonie (Staat | Provinz | Gebiet | Region | Siedlung)

verbleibende Energie: übrig gebliebene Energie

kinetische Energie: Bewegungsenergie

naiver Bayes: (glaubiger | unschuldiger | leichtgläubiger) Bayes

persönlicher digitaler Assistent (PDA): individueller computerisierter Mitarbeiter

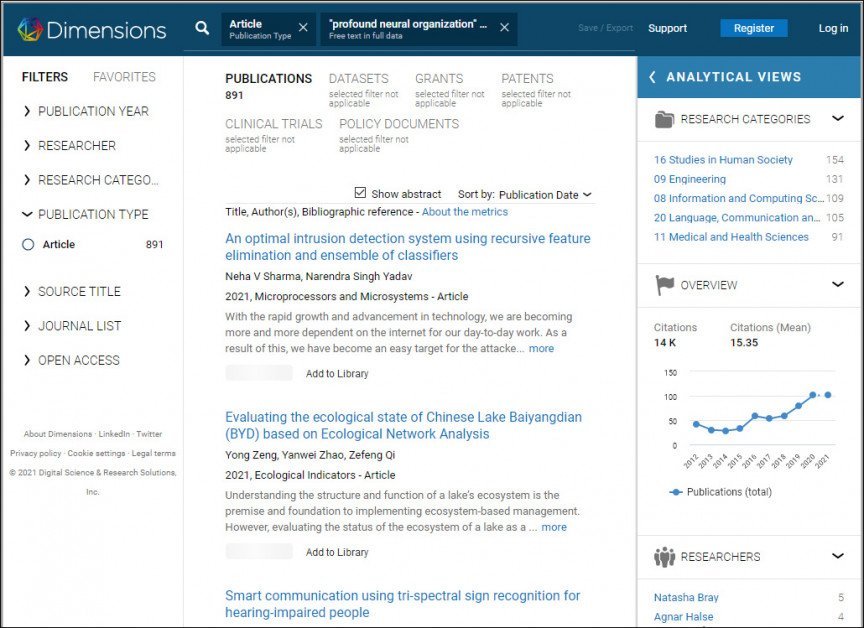

Im Mai 2021 haben die Forscher die Dimensions-Akademische-Suchmaschine abgefragt, um diese Art von verdorbenen, automatisierten Sprache zu finden, wobei sie darauf achteten, legitime Phrasen wie “enorme Informationen” (die eine gültige Phrase ist und kein fehlgeschlagener Synonym für “Big Data”) auszuschließen. Zu diesem Zeitpunkt stellten sie fest, dass Mikroprozessoren und Mikrosysteme die höchste Anzahl von Vorkommen von missverstandener Paraphrasierung aufwies.

Zurzeit ist es noch möglich, eine Reihe von wissenschaftlichen Arbeiten für den Unsinn-Begriff “tiefes neuronales Organisationsnetz” (d. h. “tiefes neuronales Netzwerk”) abzurufen (Archiv-Snapshot, 15/07/2021) und andere in der obigen Liste ergeben ähnliche Treffer.

Suchergebnisse für ‘tiefes neuronales Organisationsnetz’ (‘tiefes neuronales Netzwerk’) bei Dimensions. Quelle: https://app.dimensions.ai/

Die Mikroprozessoren-Zeitschrift wurde 1976 gegründet und zwei Jahre später in Mikroprozessoren und Mikrosysteme umbenannt.

Ein Wachstum von Unsinn-Sprache

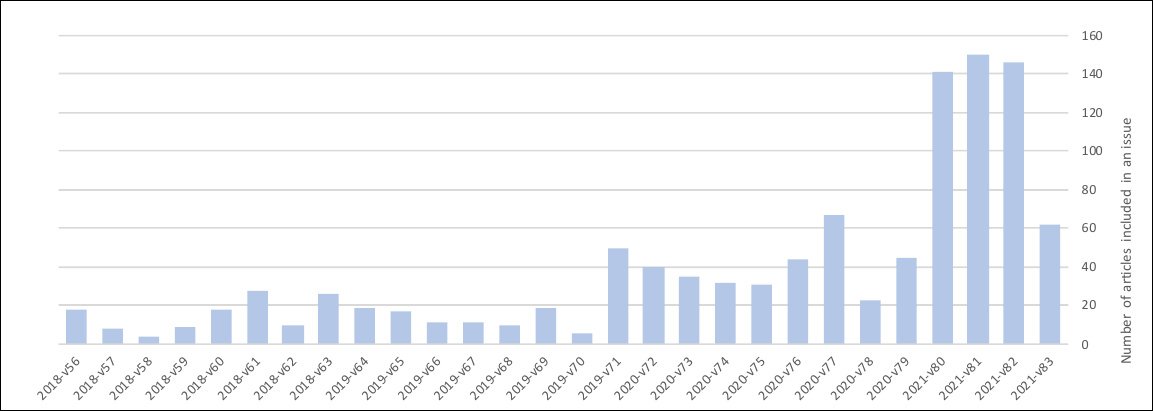

Die Forscher untersuchten einen Zeitraum von Februar 2018 bis Juni 2021 und beobachteten einen steilen Anstieg der Einreichungen in den letzten zwei Jahren, insbesondere in den letzten 6-8 Monaten:

Korrelation oder Kausalität? Der Anstieg der Einreichungen in der Zeitschrift Mikroprozessoren und Mikrosysteme scheint mit dem Wachstum von ‘Unsinn’-Texten und Synonymen in anscheinend respektablen Einreichungen zusammenzuhängen. Quelle: https://arxiv.org/pdf/2107.06751.pdf

Die endgültige Datensammlung, die die Kollaborateure gesammelt haben, enthält 1.078 Volltext-Artikel, die über den Elsevier-Abonnement der University of Toulouse erhalten wurden.

Abnehmende redaktionelle Kontrolle für chinesische wissenschaftliche Arbeiten

Die Studie stellt fest, dass die für die redaktionelle Bewertung der gekennzeichneten Einreichungen zugewiesene Zeit im Jahr 2021 radikal verkürzt wurde, auf unter 40 Tage; ein sechsfacher Rückgang der Standardzeit für Peer-Review, ab Februar 2021 deutlich.

Die größte Anzahl der gekennzeichneten Arbeiten stammt von Autoren mit Affiliationen zum chinesischen Festland: Von 404 Arbeiten, die in unter 30 Tagen angenommen wurden, stammen 97,5 % aus China. Umgekehrt stellten China-affilierte Einreichungen in Fällen, in denen der redaktionelle Prozess 40 Tage überschritt (615 Arbeiten), nur 9,5 % dieser Kategorie – ein zehnfacher Ungleichgewicht.

Der Bericht führt die Infiltration der gekennzeichneten Arbeiten auf Mängel im redaktionellen Prozess und einen möglichen Mangel an Ressourcen angesichts einer wachsenden Anzahl von Einreichungen zurück.

Die Forscher vermuten, dass GPT-ähnliche generative Modelle und ähnliche Arten von Sprachgenerierungsframeworks verwendet wurden, um einen großen Teil des Textes in den gekennzeichneten Arbeiten zu erstellen; jedoch macht die Art und Weise, wie ein generatives Modell seine Quellen abstrahiert, es schwierig, dies zu beweisen, und der Hauptbeweis liegt in einer vernünftigen Bewertung von schlechten und unnötigen Synonymen und einer sorgfältigen Prüfung der logischen Kohärenz der Einreichung.

Die Forscher stellen weiter fest, dass die generativen Sprachmodelle, die sie für die Flut von Unsinn verantwortlich machen, nicht nur in der Lage sind, die problematischen Texte zu erstellen, sondern auch, sie systematisch zu erkennen und zu kennzeichnen, genauso wie die Forscher selbst dies manuell durchgeführt haben. Die Arbeit beschreibt eine solche Implementierung mit GPT-2 und bietet einen Rahmen für zukünftige Systeme, um problematische wissenschaftliche Einreichungen zu identifizieren.

Das Auftreten von “verunreinigten” Einreichungen ist in der Elsevier-Zeitschrift (72,1 %) wesentlich höher als in anderen untersuchten Zeitschriften (13,6 % maximal).

Nicht nur Semantik

Die Forscher betonen, dass viele der Zeitschriften nicht nur die falsche Sprache verwenden, sondern auch wissenschaftlich ungenaue Aussagen enthalten, was darauf hindeutet, dass generative Sprachmodelle nicht nur verwendet werden, um die begrenzten Sprachkenntnisse der Autoren zu verbessern, sondern möglicherweise auch, um zumindest einige der Kerntheorien und Daten in der Arbeit zu formulieren.

In anderen Fällen vermuten die Forscher eine effektive “Neusynthese” oder “Umformulierung” abstrahierter (und überlegener) vorheriger Arbeiten, um den Druck des “Publizierens oder Untergehens” in der akademischen Forschungskultur zu erfüllen und möglicherweise, um nationale Rankings für globale Spitzenleistungen in der KI-Forschung durch reine Menge zu verbessern.

Unsinniger Inhalt in einer eingereichten Arbeit. In diesem Fall fanden die Forscher, dass der Text ad hoc aus einem EDN-Artikel abgeleitet wurde, von dem auch die begleitende Abbildung ohne Namensnennung entnommen wurde. Die Neufassung des ursprünglichen Inhalts ist so extrem, dass sie sinnlos wird.

Bei der Analyse mehrerer in der Elsevier-Zeitschrift eingereichter Arbeiten fanden die Forscher Sätze, für die sie keine Bedeutung ableiten konnten; Verweise auf nicht existierende Literatur; Verweise auf Variablen und Theoreme in Formeln, die tatsächlich nicht im Begleitmaterial erschienen (was auf sprachbasierte Abstraktion oder “Halluzination” scheinbar faktischer Daten hindeutet); und Wiederverwendung von Bildern ohne Namensnennung der Quellen (was die Forscher nicht aus urheberrechtlichen Gründen kritisieren, sondern als Indikator für unzureichende wissenschaftliche Strenge).

Zitierfehler

Die Zitate, die dazu bestimmt waren, die Argumente in einem wissenschaftlichen Artikel zu unterstützen, wurden in vielen der gekennzeichneten Beispiele als “entweder gebrochen oder zu nicht verwandten Veröffentlichungen führend” gefunden.

Darüber hinaus enthalten Verweise auf “verwandte Arbeiten” oft Autoren, die die Forscher vermuten, von einem GPT-ähnlichen System “halluziniert” worden zu sein.

Abirrendes Interesse

Ein weiterer Mangel von sogar hochentwickelten Sprachmodellen wie GPT-3 ist ihre Neigung, den Fokus über einen langen Diskurs zu verlieren. Die Forscher fanden, dass die gekennzeichneten Arbeiten oft ein Thema ansprechen, das nie wieder aufgegriffen wird, nachdem es in vorläufigen Notizen oder anderswo erwähnt wurde.

Sie vermuten auch, dass einige der schlimmsten Beispiele durch multiple Reisen von Quelltexten durch eine Reihe von Übersetzungs-Engines entstehen, wobei jede weitere Bedeutung verfälscht.

Quellen und Gründe

Bei dem Versuch, herauszufinden, was hinter diesem Phänomen steckt, schlagen die Autoren des Berichts eine Reihe von Möglichkeiten vor: dass Inhalt von Paper-Mühlen als Quellenmaterial verwendet wird, was Ungenauigkeiten sehr früh in einem Prozess einführt, der unweigerlich weitere Ungenauigkeiten produzieren wird; dass Artikel-Spinning-Tools wie Spinbot verwendet werden, um Plagiate zu maskieren; und dass der überwältigende Druck, regelmäßig zu veröffentlichen, unterressourcierte Forscher dazu bringt, GPT-3-ähnliche Systeme zu verwenden, um entweder zu ergänzen oder ganz neue akademische Arbeiten zu erstellen.

Die Forscher schließen mit einem Aufruf zu mehr Kontrolle und verbesserten Standards in einem Bereich der akademischen Veröffentlichung, der offensichtlich zu einem Nährboden für sein eigenes Thema – maschinelle Lernsysteme – wird. Sie mahnen auch Elsevier und andere Verleger, strengere Überprüfungs- und Review-Verfahren einzuführen, und kritisieren allgemein die aktuellen Standards und Praktiken in dieser Hinsicht, indem sie feststellen, dass “Täuschung mit synthetischen Texten die Integrität der wissenschaftlichen Literatur bedroht.’