Gehirn-Computer-Schnittstelle

Durchbruch bei KI-Entwicklung verbessert Brain-Computer-Interfaces durch Decodierung komplexer Hirnsignale

Forscher an der Chiba University in Japan haben ein neues künstliches Intelligenz-Framework entwickelt, das in der Lage ist, komplexe Hirnaktivität mit wesentlich verbesserter Genauigkeit zu decodieren, was einen wichtigen Schritt in Richtung zuverlässigerer Brain-Computer-Interfaces (BCIs) darstellt. Der Durchbruch könnte dazu beitragen, die Entwicklung von Assistenztechnologien zu beschleunigen, die es Menschen mit neurologischen Erkrankungen ermöglichen, Geräte wie Prothesen, Rollstühle und Rehabilitation-Roboter mit ihren Gedanken zu steuern.

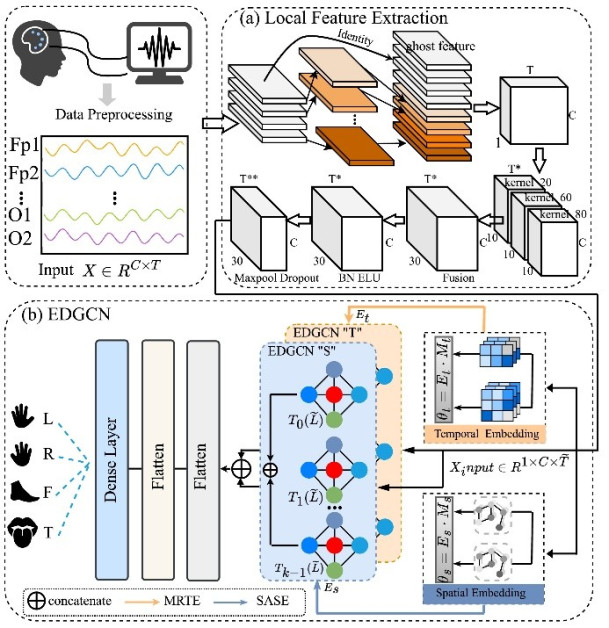

Die Forschung, die von dem Doktoranden Chaowen Shen und Professor Akio Namiki an der Graduate School of Engineering der Chiba University geleitet wird, stellt ein neues Deep-Learning-Architektur-Modell vor, das als Embedding-Driven Graph Convolutional Network (EDGCN) bekannt ist. Das System ist darauf ausgelegt, die komplexen elektrischen Signale zu interpretieren, die im Gehirn generiert werden, wenn eine Person sich vorstellt, ihre Gliedmaßen zu bewegen – ein Prozess, der als motorische Vorstellung bekannt ist.

Brain-Computer-Interfaces und motorische Vorstellung

Brain-Computer-Interfaces zielen darauf ab, einen Kommunikationskanal zwischen dem menschlichen Gehirn und externen Maschinen zu schaffen. Anstatt auf Muskelbewegungen zu vertrauen, interpretieren BCIs neurale Signale und wandeln sie in Befehle für digitale Systeme oder physische Geräte um.

Ein Ansatz, der in der BCI-Forschung weit verbreitet ist, ist die motorische Vorstellung-Elektroenzephalographie (MI-EEG). In diesen Systemen stellen die Benutzer sich Bewegungen vor – wie zum Beispiel das Heben einer Hand, das Greifen eines Objekts oder das Gehen. Obwohl keine physische Bewegung stattfindet, generiert das Gehirn charakteristische Muster elektrischer Aktivität, die mit der vorgestellten Bewegung verbunden sind.

Diese Signale können mit Hilfe der Elektroenzephalographie (EEG) aufgezeichnet werden, einer nicht-invasiven Technik, die die Hirnaktivität durch Elektroden auf dem Schädel aufzeichnet. EEG liefert multikanalige Zeitreihendaten, die die neurale Aktivität in verschiedenen Regionen des Gehirns darstellen.

Die genaue Decodierung dieser Signale ermöglicht es Computern, neurale Aktivität in ausführbare Befehle umzuwandeln. In der Praxis könnte dies es Menschen mit Lähmungen oder schweren motorischen Beeinträchtigungen ermöglichen, Assistenztechnologien einfach durch Vorstellen von Bewegungen zu steuern.

Allerdings bleibt die zuverlässige Decodierung von MI-EEG-Signalen eine der größten Herausforderungen in der Neurotechnologie.

Warum Hirnsignale schwer zu decodieren sind

Das primäre Hindernis in der Entwicklung von Brain-Computer-Interfaces liegt in der inhärenten Komplexität von EEG-Signalen.

Motorische Vorstellungssignale zeigen eine hohe räumlich-zeitliche Variabilität, was bedeutet, dass sie sich sowohl über verschiedene Gehirnregionen als auch über die Zeit hinweg ändern. Sie unterscheiden sich auch stark zwischen Individuen und sogar innerhalb desselben Menschen von einer Sitzung zur anderen.

Traditionelle Machine-Learning-Modelle haben oft Schwierigkeiten mit diesen Variationen. Viele bestehende Systeme verlassen sich auf vordefinierte Graph-Strukturen oder feste Parameter, die davon ausgehen, dass Hirnsignale konsistent sind. In Wirklichkeit sind neurale Signale jedoch viel dynamischer und heterogener.

Frühere Methoden verwendeten oft Techniken wie die gemeinsame räumliche Musteranalyse oder herkömmliche konvolutionale neuronale Netze, um Merkmale aus EEG-Signalen zu extrahieren. Obwohl diese Ansätze einige Muster in der neuronalen Aktivität identifizieren können, erfassen sie oft nicht die tieferen Interaktionen zwischen Gehirnregionen oder die sich entwickelnden Muster im Laufe der Zeit.

Als Ergebnis benötigen viele BCI-Systeme umfangreiche Kalibrierung und Schulung, bevor sie effektiv für einzelne Benutzer funktionieren können.

Ein neuer Ansatz: Embedding-Driven Graph Convolutional Networks

Das Forschungsteam der Chiba University hat diese Herausforderungen angegangen, indem es ein neues Deep-Learning-Framework entwickelt hat, das besser in der Lage ist, die Komplexität der Hirnaktivität zu erfassen.

Ihre Lösung – Embedding-Driven Graph Convolutional Network (EDGCN) – kombiniert mehrere fortschrittliche Techniken, um die räumliche und zeitliche Struktur von EEG-Signalen gleichzeitig zu modellieren.

Im Kern des Frameworks befindet sich ein embedding-basiertes Fusionsmechanismus, der es dem System ermöglicht, dynamisch Parameter zu generieren, die für die Decodierung von Hirnsignalen verwendet werden. Anstatt auf feste Architekturen zu vertrauen, passt sich EDGCN an die interne Darstellung an, um bessere Variationen zwischen Subjekten und über die Zeit hinweg zu erfassen.

Die Architektur integriert mehrere spezialisierte Komponenten:

Multi-Resolution Temporal Embedding (MRTE)

Dieses Modul analysiert EEG-Signale auf verschiedenen Zeitskalen. Da neurale Signale schnell evolvieren, kann wichtige Information auf verschiedenen zeitlichen Auflösungen auftreten. MRTE extrahiert Merkmale aus multi-resolution power spectral patterns, was es dem System ermöglicht, bedeutungsvolle neurale Aktivität zu identifizieren, die sonst möglicherweise übersehen würde.

Structure-Aware Spatial Embedding (SASE)

Hirnsignale sind nicht isoliert; verschiedene Gehirnregionen interagieren kontinuierlich. Der SASE-Mechanismus modelliert diese Interaktionen, indem er sowohl lokale als auch globale Konnektivitätsstrukturen unter den EEG-Elektroden berücksichtigt. Dies ermöglicht es dem AI-System, das Gehirn als Netzwerk und nicht als unabhängige Signal-Kanäle darzustellen.

Heterogeneity-Aware Parameter Generation

Einer der innovativsten Aspekte des EDGCN-Frameworks ist seine Fähigkeit, dynamisch Graph-Convolution-Parameter aus einem embedding-basierten Parameter-Repository zu generieren. Dies ermöglicht es dem Modell, sich an die einzigartigen Merkmale der Hirnsignale jedes Subjekts anzupassen.

Um dies zu unterstützen, verwendeten die Forscher Chebyshev-Graph-Convolution, eine Technik, die effizient Beziehungen innerhalb komplexer Netze modelliert.

Orthogonality-Constrained Kernels

Um die Robustheit weiter zu verbessern, führt das Modell Orthogonalitäts-Beschränkungen in seinen Convolution-Kernels ein. Dies fördert die Vielfalt der gelernten Merkmale und reduziert Redundanz, was dem System hilft, reichere Darstellungen von EEG-Signalen zu extrahieren.

Zusammen ermöglichen diese Komponenten es EDGCN, sowohl lokale Muster der neuronalen Aktivität als auch großräumige Interaktionen zwischen Gehirnregionen zu erfassen, was zu einer genaueren Decodierung von motorischen Vorstellungssignalen führt.

Leistungsresultate

Die Forscher testeten EDGCN mit weit verbreiteten Benchmark-Datensätzen des BCI-Wettbewerbs IV, die Standard-Evaluierungsdatensätze im Bereich der Brain-Computer-Interface-Forschung sind.

Das Modell erreichte:

- 90,14% Klassifikationsgenauigkeit auf dem BCIC-IV-2b-Datensatz

- 86,50% Klassifikationsgenauigkeit auf dem BCIC-IV-2a-Datensatz

Diese Ergebnisse übertreffen mehrere bestehende State-of-the-Art-Decodiermethoden und demonstrieren eine starke Generalisierung über verschiedene Subjekte.

Wichtig ist, dass das System auch eine verbesserte Anpassungsfähigkeit zeigte, wenn es auf Cross-Subject-Szenarien angewendet wurde, was eine wichtige Anforderung für die praktische BCI-Implementierung darstellt. Viele bestehende Modelle funktionieren gut für einen einzigen trainierten Benutzer, aber versagen, wenn sie auf neue Individuen angewendet werden. Die embedding-basierte Architektur von EDGCN hilft, diese Einschränkung zu überwinden, indem sie individuelle Variationen besser modelliert.

Implikationen für Rehabilitation und Assistenztechnologie

Die Fähigkeit, Hirnsignale genauer zu decodieren, könnte weitreichende Implikationen für Assistenztechnologien haben.

Motorische Vorstellung-basierte BCIs werden bereits für Anwendungen wie:

- Gedanken-gesteuerte Rollstühle

- Neuronale Prothesen

- Roboter-Rehabilitationsgeräte

- Kommunikationssysteme für Patienten mit Lähmungen

erforscht.

Eine verbesserte Decodiergenauigkeit könnte diese Technologien wesentlich zuverlässiger und benutzerfreundlicher machen.

Forscher glauben, dass Systeme wie EDGCN Patienten mit Erkrankungen wie:

- Schlaganfall

- Rückenmarksverletzungen

- Amyotrophe Lateralsklerose (ALS)

- Andere neuromuskuläre Erkrankungen

helfen könnten.

Mit einer zuverlässigeren Signalinterpretation könnten Patienten möglicherweise Neurorehabilitationsgeräte durch einfache vorgestellte Bewegungen steuern, was eine natürlichere Interaktion mit Assistenzsystemen ermöglichen würde.

Laut Professor Namiki ist die Decodierung von motorischen Vorstellungssignalen nicht nur eine technische Herausforderung, sondern auch eine Gelegenheit, besser zu verstehen, wie das Gehirn Bewegungen und neuronale Konnektivität organisiert.

Auf dem Weg zu Consumer-Grade Brain-Computer-Interfaces

Trotz jahrzehntelanger Forschung bleiben die meisten Brain-Computer-Interface-Systeme auf Labors oder spezielle klinische Umgebungen beschränkt. Zuverlässigkeit, Anpassungsfähigkeit und Benutzerfreundlichkeit bleiben wesentliche Barrieren für eine breitere Akzeptanz.

Fortschritte wie EDGCN könnten dazu beitragen, BCIs näher an die Consumer-Grade-Neurotechnologie heranzubringen.

Indem das System die Fähigkeit verbessert, heterogene Hirnsignale zu handhaben, reduziert das Modell die Notwendigkeit für umfangreiche Kalibrierung und Experten-Einstellungen. Dies ist ein wichtiger Schritt auf dem Weg zu benutzerfreundlichen BCI-Systemen.

Zukünftige Forschung wird sich wahrscheinlich auf die Integration solcher AI-Modelle in portable EEG-Systeme und tragbare Geräte konzentrieren. In Kombination mit Verbesserungen in der Sensortechnologie und Rechenleistung könnten diese Systeme zugänglichere und skalierbarere Brain-Machine-Interfaces ermöglichen.

Ein Schritt in Richtung tieferer Mensch-Maschine-Integration

Die Entwicklung von EDGCN spiegelt einen breiteren Trend in der künstlichen Intelligenz und Neuroissenschaft wider: die zunehmende Verwendung von graph-basierten neuronalen Netzen zur Modellierung biologischer Systeme.

Da das Gehirn selbst als komplexes Netzwerk von miteinander verbundenen Regionen operiert, bieten graph-basierte neuronale Netze eine natürliche Möglichkeit, seine Struktur und Dynamik darzustellen. Wenn diese AI-Modelle fortschrittlicher werden, könnten sie tiefere Einblicke in die neurale Aktivität und Kognition ermöglichen.

Letztendlich könnte die verbesserte Decodierung von Hirnsignalen den Weg für eine neue Generation von Technologien ebnen, die es Menschen ermöglichen, mit Maschinen nahtloser als je zuvor zu interagieren.

Wenn der Fortschritt in seinem aktuellen Tempo anhält, könnten Brain-Computer-Interfaces bald von experimentellen Forschungstools zu alltäglichen Assistenztechnologien übergehen, die es Millionen von Menschen weltweit ermöglichen, ihre Unabhängigkeit und Mobilität wiederzuerlangen.