Brain-Machine-Schnittstelle

KI-Durchbruch verbessert Gehirn-Computer-Schnittstellen durch Dekodierung komplexer Gehirnsignale

Forscher bei Chiba Universität In Japan wurde ein neues Framework für künstliche Intelligenz entwickelt, das komplexe Hirnaktivitäten mit deutlich verbesserter Genauigkeit entschlüsseln kann. Dies stellt einen wichtigen Schritt hin zu zuverlässigeren Ergebnissen dar. Gehirn-Computer-Schnittstellen (BCIs)Dieser Durchbruch könnte dazu beitragen, die Entwicklung von Assistenztechnologien zu beschleunigen, die es Menschen mit neurologischen Erkrankungen ermöglichen, Geräte wie Prothesen, Rollstühle und Rehabilitationsroboter mit ihren Gedanken zu steuern.

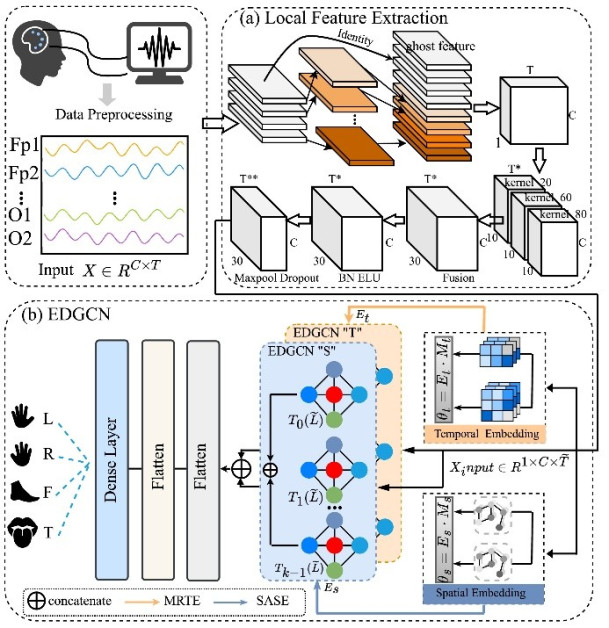

Die Forschungsprojekte, unter der Leitung von Doktorand Chaowen Shen und Professor Akio Namiki an der Graduate School of Engineering der Chiba-Universität, stellt eine neuartige Deep-Learning-Architektur vor, die als bekannt ist Embedding-Driven Graph Convolutional Network (EDGCN)Das System ist darauf ausgelegt, die komplexen elektrischen Signale zu interpretieren, die im Gehirn entstehen, wenn sich eine Person vorstellt, ihre Gliedmaßen zu bewegen – ein Prozess, der als motorische Vorstellung bekannt ist.

Gehirn-Computer-Schnittstellen und motorische Vorstellungskraft

Gehirn-Computer-Schnittstellen (BCIs) zielen darauf ab, einen effektiven Kommunikationskanal zwischen dem menschlichen Gehirn und externen Maschinen herzustellen. Anstatt auf Muskelbewegungen angewiesen zu sein, interpretieren BCIs neuronale Signale und wandeln sie in Befehle für digitale Systeme oder physische Geräte um.

Einer der am häufigsten untersuchten Ansätze in der BCI-Forschung umfasst Motorische Vorstellungs-Elektroenzephalographie (MI-EEG). In diesen Systemen stellen sich die Nutzer Bewegungen vor – wie das Heben einer Hand, das Greifen nach einem Gegenstand oder das Gehen. Obwohl keine physische Bewegung stattfindet, erzeugt das Gehirn charakteristische Muster elektrischer Aktivität, die mit der vorgestellten Bewegung verbunden sind.

Diese Signale können erfasst werden mit Elektroenzephalographie (EEG)Das Elektroenzephalogramm (EEG) ist eine nicht-invasive Technik, die die Hirnaktivität mithilfe von auf der Kopfhaut angebrachten Elektroden aufzeichnet. Es liefert mehrkanalige Zeitreihendaten, die die neuronale Aktivität in verschiedenen Hirnregionen darstellen.

Durch die präzise Dekodierung dieser Signale können Computer neuronale Aktivität in konkrete Befehle umsetzen. In der Praxis könnte dies Menschen mit Lähmungen oder schweren motorischen Einschränkungen ermöglichen, Assistenztechnologien allein durch die Vorstellung von Bewegungen zu steuern.

Die zuverlässige Dekodierung von MI-EEG-Signalen stellt jedoch nach wie vor eine der größten Herausforderungen in der Neurotechnologie dar.

Warum Gehirnsignale schwer zu entschlüsseln sind

Das Haupthindernis bei der Entwicklung von Gehirn-Computer-Schnittstellen liegt in der inhärenten Komplexität von EEG-Signalen.

Motorische Vorstellungssignale weisen eine hohe räumlich-zeitliche Variabilität auf, d. h. sie variieren sowohl zwischen verschiedenen Hirnregionen als auch im Zeitverlauf. Sie unterscheiden sich zudem erheblich zwischen Individuen und sogar bei derselben Person von einer Sitzung zur nächsten.

Herkömmliche Modelle des maschinellen Lernens haben oft Schwierigkeiten mit diesen Variationen. Viele bestehende Systeme basieren auf vordefinierten Graphstrukturen oder festen Parametern, die davon ausgehen, dass sich Hirnsignale in konsistenten Mustern verhalten. In Wirklichkeit sind neuronale Signale jedoch weitaus dynamischer und heterogener.

Frühere Methoden nutzten häufig Techniken wie die Analyse gemeinsamer räumlicher Muster oder konventionelle Faltungsneuronale Netze, um Merkmale aus EEG-Signalen zu extrahieren. Obwohl diese Ansätze einige Muster in der neuronalen Aktivität identifizieren können, erfassen sie häufig keine tieferliegenden Interaktionen zwischen Hirnregionen oder sich im Laufe der Zeit verändernde Muster.

Daher benötigen viele BCI-Systeme eine umfangreiche Kalibrierung und Schulung, bevor sie für einzelne Benutzer effektiv funktionieren können.

Ein neuer Ansatz: Embedding-basierte Graph Convolutional Networks

Das Forschungsteam der Universität Chiba begegnete diesen Herausforderungen mit der Entwicklung eines neuen Deep-Learning-Frameworks, das die Komplexität der Gehirnaktivität besser erfassen soll.

Ihre Lösung – Embedding-Driven Graph Convolutional Network (EDGCN) – kombiniert mehrere fortgeschrittene Techniken, um die räumliche und zeitliche Struktur von EEG-Signalen gleichzeitig zu modellieren.

Kern des Frameworks ist ein einbettungsbasierter Fusionsmechanismus, der es dem System ermöglicht, Parameter zur Dekodierung von Hirnsignalen dynamisch zu generieren. Anstatt auf feste Architekturen zurückzugreifen, passt EDGCN seine interne Repräsentation an, um Variationen zwischen Probanden und im Zeitverlauf besser zu erfassen.

Die Architektur integriert mehrere spezialisierte Komponenten:

Multi-Resolution Temporal Embedding (MRTE)

Dieses Modul analysiert EEG-Signale auf verschiedenen Zeitskalen. Da sich neuronale Signale schnell entwickeln, können wichtige Informationen in unterschiedlichen zeitlichen Auflösungen auftreten. MRTE extrahiert Merkmale aus Leistungsspektralmuster mit mehreren AuflösungenDadurch kann das System aussagekräftige neuronale Aktivitäten erkennen, die sonst möglicherweise übersehen würden.

Strukturbewusste räumliche Einbettung (SASE)

Hirnsignale sind nicht isoliert; verschiedene Hirnregionen interagieren kontinuierlich. Der SASE-Mechanismus modelliert diese Interaktionen, indem er sowohl lokale als auch globale Verbindungsstrukturen zwischen den EEG-Elektroden einbezieht. Dadurch kann die KI das Gehirn als Netzwerk und nicht als Ansammlung unabhängiger Signalkanäle darstellen.

Heterogenitätsbewusste Parametergenerierung

Eine der innovativsten Eigenschaften des EDGCN-Frameworks ist seine Fähigkeit, Graph-Faltungsparameter dynamisch aus einem einbettungsbasierten Parameterpool zu generieren. Dadurch kann sich das Modell an die individuellen Merkmale der Hirnsignale jedes Probanden anpassen.

Zur Unterstützung dieses Prozesses verwendeten die Forscher Chebyshev-Graph-Faltung, eine Technik, die Beziehungen innerhalb komplexer Netzwerke effizient modelliert.

Orthogonalitätsbeschränkte Kernel

Um die Robustheit weiter zu verbessern, führt das Modell Orthogonalitätsbedingungen in seine Faltungskerne ein. Dies fördert die Vielfalt der gelernten Merkmale und reduziert Redundanz, wodurch das System reichhaltigere Repräsentationen aus EEG-Signalen extrahieren kann.

Zusammen ermöglichen diese Komponenten dem EDGCN, sowohl lokale neuronale Aktivitätsmuster als auch großflächige Interaktionen zwischen Hirnregionen zu erfassen, was zu einer genaueren Dekodierung von motorischen Vorstellungssignalen führt.

Leistungsergebnisse

Die Forscher testeten EDGCN anhand weit verbreiteter Benchmark-Datensätze aus dem BCI-Wettbewerb IV, die Standard-Evaluierungsdatensätze im Bereich der Gehirn-Computer-Schnittstellenforschung darstellen.

Das Modell erreichte Folgendes:

- 90.14 % Klassifizierungsgenauigkeit auf dem BCIC-IV-2b-Datensatz

- 86.50 % Klassifizierungsgenauigkeit auf dem BCIC-IV-2a-Datensatz

Diese Ergebnisse übertreffen mehrere bestehende, hochmoderne Dekodierungsmethoden und demonstrieren eine starke Generalisierbarkeit über verschiedene Fachgebiete hinweg.

Wichtig ist, dass das System auch bei der Anwendung auf verschiedene Probanden eine verbesserte Anpassungsfähigkeit aufwies – eine zentrale Voraussetzung für den praktischen Einsatz von Gehirn-Computer-Schnittstellen. Viele bestehende Modelle funktionieren zwar gut für einen einzelnen trainierten Nutzer, versagen jedoch bei der Anwendung auf neue Personen. Die einbettungsbasierte Architektur von EDGCN trägt dazu bei, diese Einschränkung durch eine bessere Modellierung individueller Unterschiede zu überwinden.

Auswirkungen auf Rehabilitation und Assistenztechnologie

Die Fähigkeit, Hirnsignale genauer zu entschlüsseln, könnte tiefgreifende Auswirkungen auf Assistenztechnologien haben.

Motorische Vorstellungs-basierte Gehirn-Computer-Schnittstellen werden bereits für Anwendungen wie die folgenden erforscht:

- Gedankengesteuerte Rollstühle

- Neuronale Prothetik

- Robotergestützte Rehabilitationsgeräte

- Kommunikationssysteme für Patienten mit Lähmungen

Eine verbesserte Dekodierungsgenauigkeit könnte diese Technologien deutlich zuverlässiger und benutzerfreundlicher machen.

Forscher glauben, dass Systeme wie EDGCN Patienten mit Erkrankungen wie den folgenden helfen können:

- Schlaganfall

- Rückenmarksverletzungen

- Amyotrophe Lateralsklerose (ALS)

- Andere neuromuskuläre Erkrankungen

Durch eine zuverlässigere Signalinterpretation könnten Patienten neurorehabilitative Geräte potenziell durch einfache, vorgestellte Bewegungen steuern und so eine natürlichere Interaktion mit Assistenzsystemen ermöglichen.

Laut Professor Namiki ist die Dekodierung von motorischen Vorstellungssignalen nicht nur eine technologische Herausforderung, sondern auch eine Chance, besser zu verstehen, wie das Gehirn Bewegung und neuronale Verbindungen organisiert.

Hin zu Gehirn-Computer-Schnittstellen für Endverbraucher

Trotz jahrzehntelanger Forschung sind die meisten Gehirn-Computer-Schnittstellensysteme weiterhin auf Labore oder spezialisierte klinische Einrichtungen beschränkt. Zuverlässigkeit, Anpassungsfähigkeit und Benutzerfreundlichkeit stellen nach wie vor erhebliche Hürden für eine breitere Anwendung dar.

Fortschritte wie EDGCN könnten dazu beitragen, dass BCIs näher an die Neurotechnologie für Endverbraucher heranrücken.

Durch die verbesserte Fähigkeit des Systems, heterogene Hirnsignale zu verarbeiten, reduziert das Modell den Bedarf an aufwendiger Kalibrierung und Expertenanpassung. Dies ist ein entscheidender Schritt, um BCI-Systeme auch außerhalb von Forschungsumgebungen einsetzbar zu machen.

Zukünftige Forschung wird sich voraussichtlich auf die Integration solcher KI-Modelle in tragbare EEG-Systeme und Wearables konzentrieren. In Kombination mit Verbesserungen in der Sensortechnologie und der Rechenleistung könnten diese Systeme zugänglichere und skalierbarere Gehirn-Maschine-Schnittstellen ermöglichen.

Ein Schritt hin zu einer tieferen Mensch-Maschine-Integration

Die Entwicklung von EDGCN spiegelt einen breiteren Trend in der künstlichen Intelligenz und den Neurowissenschaften wider: die zunehmende Verwendung von graphenbasierten neuronalen Netzen zur Modellierung biologischer Systeme.

Da das Gehirn selbst als komplexes Netzwerk miteinander verbundener Regionen funktioniert, bieten Graph-Neuronale Netze eine natürliche Möglichkeit, seine Struktur und Dynamik darzustellen. Mit zunehmender Komplexität dieser KI-Modelle könnten sie tiefere Einblicke in neuronale Aktivität und Kognition ermöglichen.

Letztendlich könnte eine verbesserte Dekodierung von Gehirnsignalen den Weg für eine neue Generation von Technologien ebnen, die es Menschen ermöglichen, nahtloser als je zuvor mit Maschinen zu interagieren.

Wenn die Fortschritte im aktuellen Tempo anhalten, könnten Gehirn-Computer-Schnittstellen schon bald von experimentellen Forschungsinstrumenten zu alltäglichen Assistenztechnologien werden, die in der Lage sind, Millionen von Menschen weltweit ihre Unabhängigkeit und Mobilität zurückzugeben.