Andersons Blickwinkel

Energiesparende KI-Überwachung mit 1970er-Jahre-Flair

Neue Forschungsergebnisse zeigen, dass die meisten KI-Systeme für Videobearbeitung überhaupt keine Farbe benötigen, sondern diese nur in entscheidenden Momenten aktivieren und so den Datenverbrauch um über 90 % reduzieren, ohne dass die Genauigkeit wesentlich beeinträchtigt wird.

Fernübertragungskameras und andere kabellose, batteriebetriebene Videogeräte erfordern präzise optimierte Überwachungskonfigurationen, da sie auf instabile Stromquellen – wie etwa Solarenergie – angewiesen sein können oder ein regelmäßiges Aufladen oder andere Formen menschlicher Eingriffe erfordern, und zwar in Situationen, in denen idealerweise niemand anwesend sein sollte.

Parallel zu dieser Forschungsrichtung wächst das Interesse an mit Kameras ausgestatteten Wearables. ist auch gewachsen (obwohl solche Geräte bereits durch Leistungs- und Rechenleistungsgrenzen stark eingeschränkt waren), weil Rand AI verspricht nun, sie deutlich nützlicher zu machen.

Neben diesen Überlegungen spricht der langfristige Anreiz, die Kosten für Edge-KI und -Überwachung zu senken (insbesondere in Fällen, in denen solche Einsparungen nicht an den Kunden weitergegeben werden müssen), für Innovationen bei Energiesparansätzen für Edge-Anwendungsfälle.

Sound Off

Auf dem Gebiet der Streaming-Video-ErkennungRessourcenarme Edge-Monitoring-Geräte müssen so wenig Energie wie möglich verbrauchen und gleichzeitig genügend Energie aufwenden, um nach "interessanten" Ereignissen zu suchen – ab diesem Zeitpunkt lohnt es sich, mehr Ressourcen einzusetzen.

Im Prinzip handelt es sich um einen ähnlichen Anwendungsfall wie bei bewegungsgesteuerten Leuchten, die nur dann Licht spenden, wenn Sensoren mit geringem Energieverbrauch feststellen, dass sich jemand in der Nähe befindet, der es zu schätzen weiß.

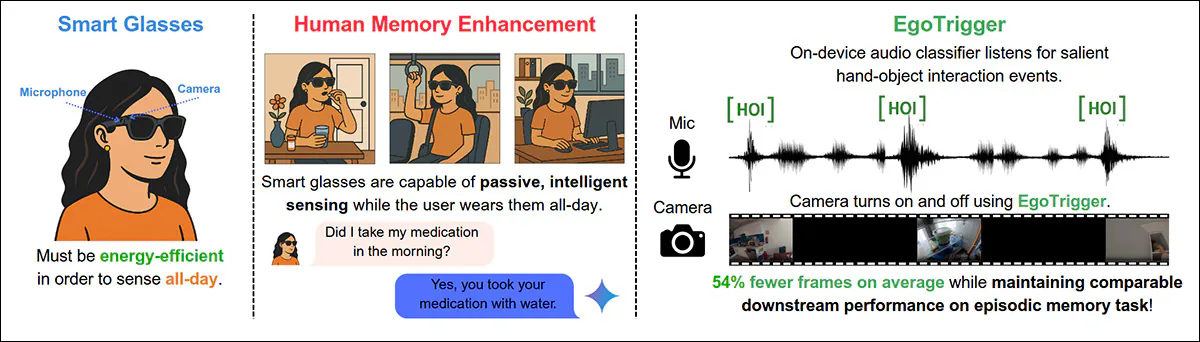

Da Audioüberwachung und -komprimierung deutlich weniger ressourcenintensiv sind als Video, wurden in den letzten Jahren verschiedene Ansätze verfolgt, um mithilfe von akustischen Hinweisen die Aufmerksamkeit in ressourcenbeschränkten Systemen zu lenken; Frameworks wie beispielsweise Hören Sie sich Look an und Egotrigger:

Im Egotrigger-System wird durch audiogesteuerte Auslösung gezielt die Bildaufnahme anhand von Hand-Objekt-Interaktionshinweisen aktiviert. Dadurch werden redundante Frames reduziert, während die Leistung des episodischen Speichers in ressourcenbeschränkten Smart-Glasses-Systemen erhalten bleibt. Quelle

Offensichtlich ist Audio nicht das ideale Medium, um visuelle Ereignisse aufzuspüren, da viele wesentliche Ereignisse kein zugehöriges akustisches Signal haben oder außerhalb der Reichweite der Randmikrofone stattfinden können.

Light Sleeper

Eine neue Studie legt nahe, dass ein Videostream, der mit KI zusammenarbeitet, um die Ressourcen bei einem überwachten Ereignis umgehend zu erhöhen, möglicherweise besser geeignet wäre. Die untenstehende Simulation* veranschaulicht das Konzept: Die Überwachung erfolgt mit niedriger Auflösung auf dem minimal erforderlichen Signalpegel. Objekterkennung Frameworks, die funktionieren, und um dem System mitzuteilen, dass es die Auflösung aufgrund des Auslösens eines Ereignisses erhöhen soll:

Eine Simulation des gewünschten Verhaltens: Streaming und Analyse arbeiten standardmäßig mit minimalem Ressourcenverbrauch; gerade so viel, dass ein höherer Ressourcenverbrauch ausgelöst wird, sobald im Graustufen-Stream interessante oder gesuchte Ereignisse erkannt werden. Der Schwarz-Weiß-Überwachungsstil mag etwas altmodisch wirken, könnte aber ein Vorbote zukünftiger Entwicklungen sein. Dieses Video wurde vom Autor ausschließlich zu Illustrationszwecken im Zusammenhang mit den Kernideen der neuen Veröffentlichung erstellt. Quelle:

Die neue Arbeit, eine akademische Zusammenarbeit zwischen verschiedenen britischen Institutionen und Huawei, schlägt ein trainingsfreies, KI-gestütztes System vor. Immer Graustufen, Farbe auf Anfrage Schema für die Randüberwachung – ausgelegt für den Betrieb bei niedrigen Temperaturen Zeichen Nutzung, wenn keine wichtigen Ereignisse stattfinden, und Erhöhung des Verbrauchs nur für die Dauer des Ereignisses.

Bei Benchmarks zum Verständnis von Streaming-Videos wurde das neue System mit dem Namen Farbauslöser, erreichte eine Leistung von 91.6 % der Vollfarb-Referenzleistung bei Verwendung von nur 8.1 % der RGB-Frames dieser Standards:

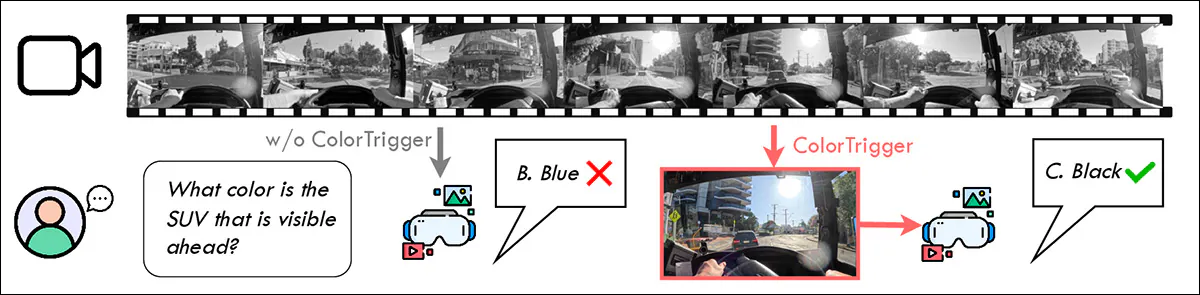

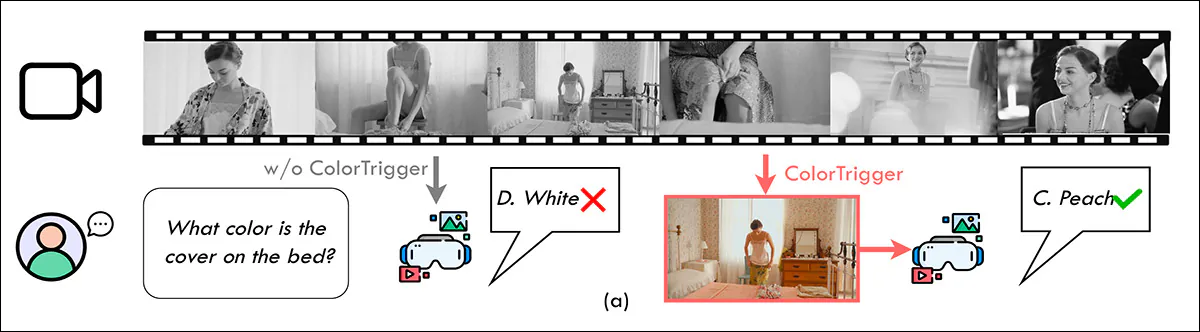

Wenn das Modell nur Graustufenvideos sieht, verwechselt es wichtige Details und gibt falsche Antworten; aber die Aktivierung der Farbe zum richtigen Zeitpunkt klärt das Bild und behebt Fehler, die durch Aufgaben ausgelöst werden, die von der Farbe abhängen. Quelle

Die neues Papier ist betitelt Farbe, wenn es darauf ankommt: Graustufenbasierte Online-Auslösung für die permanente Videostreaming-ErkennungDie Studie stammt von acht Forschern der Queen Mary University of London, der Durham University, des Imperial College London und des Huawei Noah's Ark Lab. Sie enthält außerdem eine zugehörige Projektseite.

Methodik

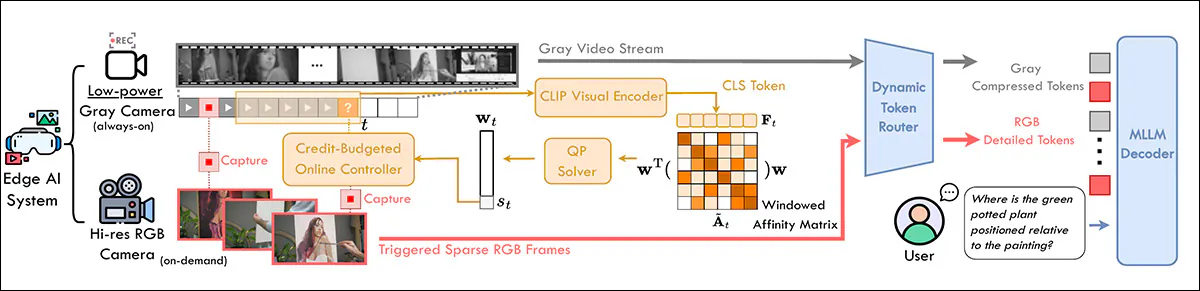

Um die zeitliche Struktur im neuen System zu erhalten, führt ColorTrigger eine kontinuierliche Graustufenüberwachung mit geringer Bandbreite durch. Ein kausaler Online-Trigger analysiert ein Schiebefenster (d. h. ein flexibler Plus-Minus-Bereich von Frames um einen bestimmten Zeitpunkt, wie z. B. die Erfassung eines Ereignisauslösers) des niedrig auflösenden Datenstroms:

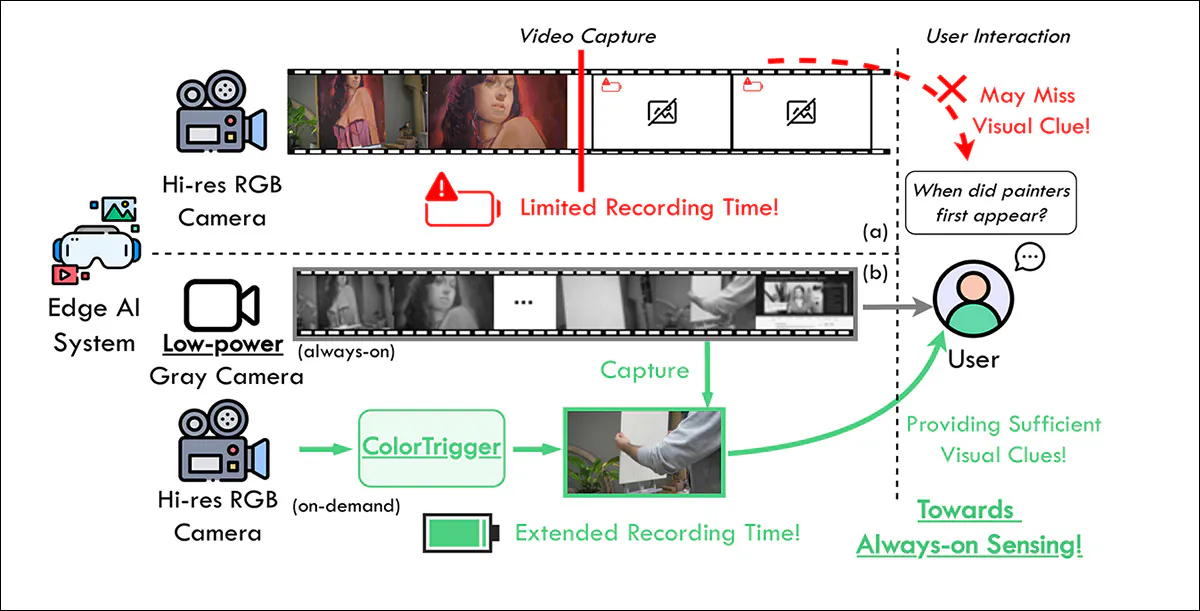

Die kontinuierliche RGB-Aufnahme in hoher Auflösung verbraucht schnell viel Strom, sodass die Aufnahme frühzeitig beendet wird und wichtige Momente verpasst werden können. ColorTrigger hingegen hält permanent einen stromsparenden Graustufenstream aufrecht und aktiviert die RGB-Kamera nur bei Bedarf – so wird die Aufnahmezeit verlängert, während gleichzeitig die visuellen Details erfasst werden, die für spätere Anfragen benötigt werden. Quelle

Solange sich das System im „passiven“ Modus befindet (d. h., es hat noch kein Auslöseereignis identifiziert), weist sein dynamischer Token-Router einem asymmetrischen Decoder begrenzte Kapazität zu, wobei er stets nach Redundanz und nach Ereignissen sucht, die auf Neuheit hinweisen. In diesem Fall priorisiert der Token-Fluss die Kapazität gegenüber der Komprimierung:

Schema für ColorTrigger. Das System überwacht eine gleitende Fensteranalyse der letzten Frames, um Redundanz und Änderungen zu erkennen und hochauflösende RGB-Aufnahmen nur bei Bedarf und im Rahmen eines kreditbasierten Budgets auszulösen. Ein dynamischer Token-Router weist Graustufen-Eingaben weniger und ausgewählten RGB-Frames mehr Token zu, um die zeitliche Reihenfolge für die nachfolgende Verarbeitung im Multimodal Large Language Model (MLLM) zu erhalten.

Das System muss für jedes Einzelbild entscheiden, ob der aktuelle Moment neue Informationen enthält, die den Aufwand der Farberfassung rechtfertigen. Die kurze Historie der Graustufenbilder im gleitenden Fenster ermöglicht es ColorTrigger, das aktuelle Bild mit der vorherigen Historie zu vergleichen. unmittelbar Vergangenheit. Jedes Bild wird in ein kompaktes Format umgewandelt. MerkmalsdarstellungDiese Merkmale werden miteinander verglichen, um zu messen, wie ähnlich oder unterschiedlich ihre jeweiligen Wirtsrahmen sind.

Dieser Vergleichsprozess ist in einer Struktur organisiert, die Folgendes zusammenfasst: wie viel Die einzelnen Bilder überlappen sich und erfassen so, ob sich die Szene wiederholt oder verändert. Ein einfacher Optimierungsschritt weist jedem Bild im Fenster eine Wichtigkeitsbewertung zu, wobei Neuheit bevorzugt wird.

Farbbalance

Um übermäßigen Farbeinsatz zu vermeiden, begrenzt ein einfaches „Guthabensystem“ die Häufigkeit der Farbdarstellung. Die Guthaben sammeln sich schrittweise an und werden bei Bedarf verbraucht. So sind zwar kurze Nutzungsspitzen möglich, die Gesamtnutzung bleibt aber kontrolliert. Ein Frame wird nur dann in Farbe dargestellt, wenn er informativ ist und genügend Guthaben vorhanden ist.

Der dynamische Token-Router steuert, wie viele Details jedes Einzelbild enthält, anstatt jedes Bild in voller Qualität zu verarbeiten. Wird nichts Wichtiges erkannt, bleibt das Graustufenbild niedrig aufgelöst und wird in einen kleinen, komprimierten Token-Satz umgewandelt. Wird ein wichtiges Ereignis erkannt, schaltet das System auf Farbe um und verarbeitet das Bild in höherer Auflösung, wodurch eine reichhaltigere und detailliertere Darstellung entsteht.

Beide Bildtypen durchlaufen dasselbe Modell, wobei Graustufenbilder weniger streng verarbeitet werden, während ausgewählte Farbbilder mehr Aufmerksamkeit erhalten. Die Ergebnisse werden anschließend in ihrer ursprünglichen Reihenfolge kombiniert und als kontinuierlicher Datenstrom an das Modell gesendet.

Da die meisten Rahmen schlank bleiben und nur wenige aufgerüstet werden, spart das System viel Rechenleistung und erfasst dennoch die wichtigsten Details, wenn es darauf ankommt:

Aus dem Artikel stammt ein weiteres Beispiel, bei dem das System vorübergehend mehr Ressourcen benötigt, um eine Farbe unterscheiden zu können.

Daten und Tests

Um das System zu testen, verglichen die Forscher es mit dem StreamingBench und OVO-Bench Video-Benchmarks, wobei die Verarbeitung von vermieden wird Zukunft Inhalte (die bei Offline-Tests eine potenzielle Gefahr darstellen).

Die eingefroren Das verwendete multimodale große Sprachmodell (MLLM) war InternVL3.5-8B-Instruct, mit dem implementierten kausalen Auslöser über CLIP ViT-B/16.

Der Graustufenstrom war auf den Luminanzkanal beschränkt. CIELAB Farbraum, gemäß vorherige Arbeit, wobei die resultierenden Graustufenbilder vor der Bearbeitung auf 224x224px skaliert wurden. Patchifizierung (die Aufteilung eines Bildes in kleine Blöcke fester Größe, sodass jeder Block vom Modell als separate Einheit verarbeitet werden kann).

Die RGB-Frames hingegen wiesen eine höhere Bitrate auf und wurden mit 448x448px verarbeitet, wodurch 256 Tokens entstanden, im Gegensatz zu den 64 Tokens, die für die Graustufen-Frames erzeugt wurden.

Zur Entscheidungsfindung im System wurden gängige Optimierungswerkzeuge verwendet: CVXPY (eine Python-Bibliothek zum Aufstellen von Optimierungsproblemen) und OSQP-Solver (ein schneller Algorithmus, der berechnet, wann eine Farbe ausgelöst werden soll).

Das Video wurde mit 1 Bild pro Sekunde verarbeitet, wobei die Anzahl der Bilder pro Clip auf 128 begrenzt war, um den Rechenaufwand gering zu halten.

Getestete proprietäre Systeme waren Gemini 1.5 Pro; GPT-4oeschriebenen Art und Weise; und Claude 3.5 SonettGetestete Open-Source-Video-MLLMs waren LLaVA-OneVision-7B; Video-LLaMA2-7Beschriebenen Art und Weise; und Qwen2.5-VL-7B.

Die getesteten Streaming-MLLMs waren Flash-VStream-7B; VideoLLM-online-8B; Dispinder-7Beschriebenen Art und Weise; und TimeChat-Online-7B.

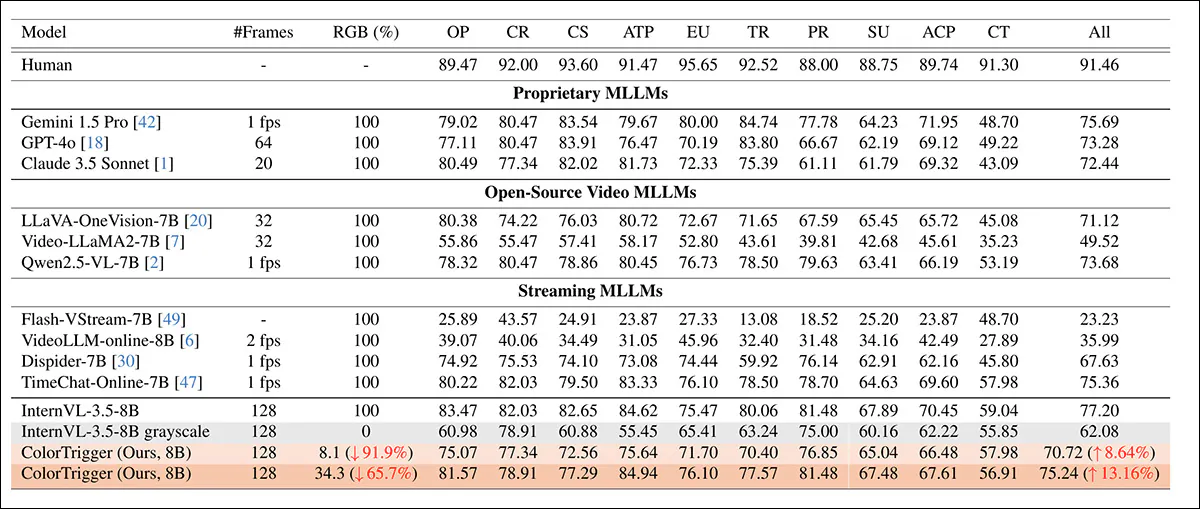

InternVL-3.5-8B und Qwen3-VL-8B wurden in verschiedenen Konfigurationen getestet, die in der ersten Ergebnistabelle unten detailliert aufgeführt sind, bezogen auf StreamingBench:

Die Leistung von StreamingBench bei Echtzeit-Aufgaben zur visuellen Verarbeitung wurde verglichen. Dabei wurden proprietäre, Open-Source- und Streaming-MLLMs unter verschiedenen Farbbudgets analysiert. RGB (%) gibt den Anteil der nach dem Triggern erhaltenen Farbbilder an, wobei 100 für Vollfarbe und 0 für reine Graustufeneingabe steht. ColorTrigger wurde in zwei Betriebspunkten evaluiert (8.1 % bzw. 34.3 % Farbbilder) und zeigte eine verbesserte Gesamtgenauigkeit gegenüber der Graustufen-Baseline InternVL-3.5-8B bei gleichzeitig deutlich reduziertem Farbverbrauch im Vergleich zur Vollfarbeinstellung.

Hier kommentieren die Autoren:

'ColorTrigger erzielt wettbewerbsfähige Ergebnisse bei der Echtzeit-Visualisierungsaufgabe von StreamingBench.

„Unser Modell mit 34.3 % RGB-Frames erzielt 75.24 Punkte und übertrifft damit das kürzlich online erschienene Modell Dispider-7B und liegt nahe an TimeChat-Online-7B. Gleichzeitig ist es vergleichbar mit proprietären Modellen wie Gemini 1.5 Pro (75.69) und übertrifft GPT-4o (73.28) und Claude 3.5 Sonnet (72.44).“

InternVL-3.5-8B erzielte mit Vollfarbdarstellung 77.20 Punkte, während ColorTrigger mit 65.7 % weniger RGB-Frames 75.24 Punkte erreichte – und selbst mit nur 8.1 % Farbframes erzielte es 70.72 Punkte, übertraf damit den Graustufen-Baseline-Wert von 62.08 um 8.64 % und blieb im Vergleich zu anderen Streaming-Modellen konkurrenzfähig.

Als Nächstes wurde OVO-Bench getestet:

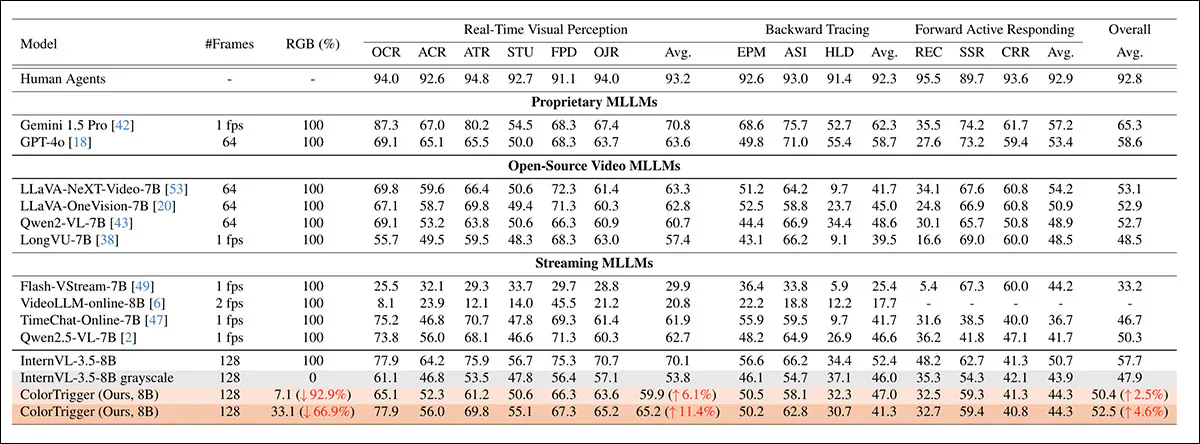

Die Leistung auf OVO-Bench wurde in drei Kategorien verglichen: Echtzeit-Visualisierung, Rückwärtsverfolgung und Vorwärtsreaktion. Dabei wurden proprietäre, Open-Source- und Streaming-MLLMs mit unterschiedlichen Farbbudgets verglichen. RGB (%) gibt den Anteil der nach dem Triggern erhaltenen Farbbilder an, wobei 100 für Vollfarbe und 0 für reine Graustufeneingabe steht. ColorTrigger wurde in zwei Betriebspunkten evaluiert (7.1 % bzw. 33.1 % Farbbilder erhalten) und zeigte eine verbesserte Gesamtgenauigkeit gegenüber der Graustufen-Baseline InternVL-3.5-8B bei gleichzeitig deutlich reduziertem Farbverbrauch im Vergleich zur Vollfarbeinstellung.

Zu diesen Ergebnissen geben die Autoren an:

Unser Modell mit 33.1 % RGB-Frames erzielt eine Gesamtpunktzahl von 52.5 und übertrifft damit fast alle existierenden Open-Source-Online-MLLMs. Im Vergleich zum Basismodell InternVL-3.5-8B mit vollständigem RGB-Eingang (57.7) erreicht ColorTrigger 52.5 Punkte bei einer Reduzierung der RGB-Frame-Nutzung um 66.9 %, was lediglich einem Leistungsabfall von 5.2 Punkten entspricht.

„Diese geringfügige Verschlechterung geht mit erheblichen Effizienzgewinnen einher und beweist damit die Effektivität unserer adaptiven Routing-Strategie.“

Die Echtzeit-Visualisierung erreichte einen Wert von 65.2 – ein Zuwachs von 11.4 Punkten gegenüber dem Graustufen-Basiswert von 53.8. Selbst bei einer Beschränkung auf nur 7.1 % RGB-Bilder (eine Reduzierung um 92.9 %) erzielte ColorTrigger einen Gesamtwert von 50.4 und verbesserte sich damit um 2.5 Punkte gegenüber der Graustufeneinstellung.

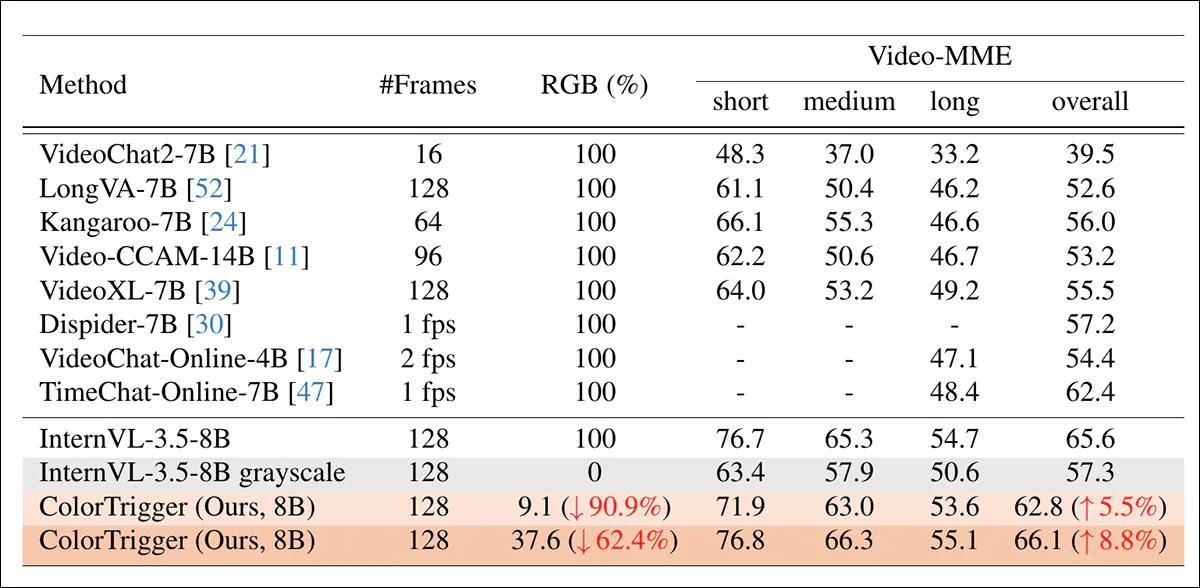

Abschließend führten die Forscher einen Test mit einer Offline-Videoaufgabe durch (einer analytischen Aufgabe, die nicht darauf ausgelegt war, Latenz oder andere „Live“-Umgebungsbedingungen zu testen). Video-MME Benchmark für das Verständnis von längeren Videos:

Leistungsvergleich der getesteten Systeme anhand des Video-MME-Benchmarks.

In diesem Test erzielte das Modell eine Gesamtpunktzahl von 66.1 bei Verwendung von 37.6 % RGB-Frames und übertraf damit die Vollfarb-Basispunktzahl InternVL-3.5-8B von 65.6, obwohl 62.4 % weniger Farbframes verwendet wurden.

Die Autoren kommentieren:

„Dies beweist, dass unser adaptiver Triggermechanismus nicht nur den Rechenaufwand reduziert, sondern die Leistung sogar verbessern kann, indem er die RGB-Kapazität auf semantisch kritische Momente konzentriert.“

„ColorTrigger übertrifft insbesondere alle bestehenden Online-MLLMs, darunter TimeChat-Online-7B mit 62.4 und Dispider-7B mit 57.2, was die Effektivität der Kombination von kontinuierlichem Graustufenkontext mit selektiver RGB-Erfassung für das Verständnis von Langzeitvideos bestätigt.“

Fazit

Ich freue mich immer über Innovationen dieser Art, nicht zuletzt wegen der hohen Anforderungen an KI und ständig wachsender Bedarf Die (elektrische) Energieversorgung sorgt seit langer Zeit für düstere Schlagzeilen, und es ist gut zu sehen, dass es Forschung gibt, die sich zumindest indirekt mit diesem Thema auseinandersetzt.

Es ist auf eine gewisse Zynik beruhigend zu wissen, dass die bei solchen Vorhaben erzielten Energieeinsparungen wirtschaftlich motiviert sind, da diese weniger von kurzfristigen politischen Entscheidungen beeinflusst werden als die zwar edleren, aber angreifbareren Sorgen um Energieeinsparung und Klimawandel. Glücklicherweise wird aus unterschiedlichen Gründen dasselbe Ziel erreicht.

* Diese Version wurde von mir erstellt, um die Kernaussage des Artikels für den Leser zusammenzufassen.

Erstveröffentlichung Donnerstag, 26. März 2026