Anderson 视角

Vibe 编码在 AI 角色扩展时受损

一项新研究发现,vibe 编码在人类提供指令时会改善,但在 AI 提供指令时会下降,最佳的混合设置是让人类处于首要位置,将 AI 作为仲裁者或法官。

最近来自美国的研究,研究了当 AI 系统被允许控制 vibe 编码 时会发生什么,而不是简单地执行人类的指令,发现当大型语言模型(LLMs)承担更大的方向角色时,结果几乎总是更差。

虽然研究人员使用 OpenAI 的 GPT-5 作为他们的人机协作实验的框架,但他们后来确认,Anthropic 的 Claude Opus 4.5 和 Google Gemini 3 Pro 也受到了相同的性能下降曲线的影响,表明“即使有限的人类参与也能稳定地提高性能”:

‘人类提供了独特有效的高级指导,跨越迭代,而 AI 指导往往导致性能崩溃。另外,我们发现,仔细分配角色,保持人类在方向上的控制,同时将评估卸载给 AI,可以提高混合性能。’

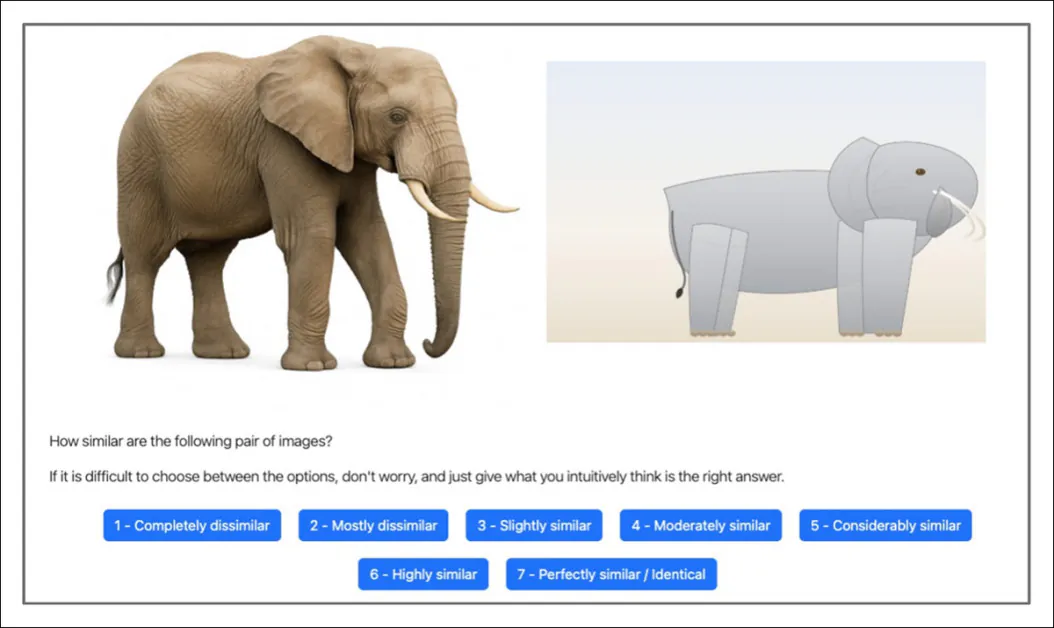

为了提供一个一致的测试,可以被人类和 AI 平等地评估,一个受控的实验框架被建立在一个迭代编码任务周围,在这个任务中,一个参考图像 – 包含一张猫、狗、老虎、鸟、象、企鹅、鲨鱼、斑马、长颈鹿或熊猫的照片 – 必须使用可缩放矢量图形(SVG)重现,并且该重现必须与其来源的照片进行比较:

人类和 AI 参与者都被显示了一张照片参考图像和 AI 生成的 SVG 重构,并被要求在七点量表上评估两者的相似度。 来源

在每个轮次中,一个代理提供高级自然语言指令来指导代码生成器,而另一个代理决定是否保留新版本或恢复到之前的版本 – 这是一个结构化的循环,反映了真实的协作工作流程。

跨越 16 个实验,涉及 604 名参与者和数千个 API 调用,完全由人类领导的测试轮次被直接与完全由 AI 领导的轮次进行比较,在其他条件相同的情况下。

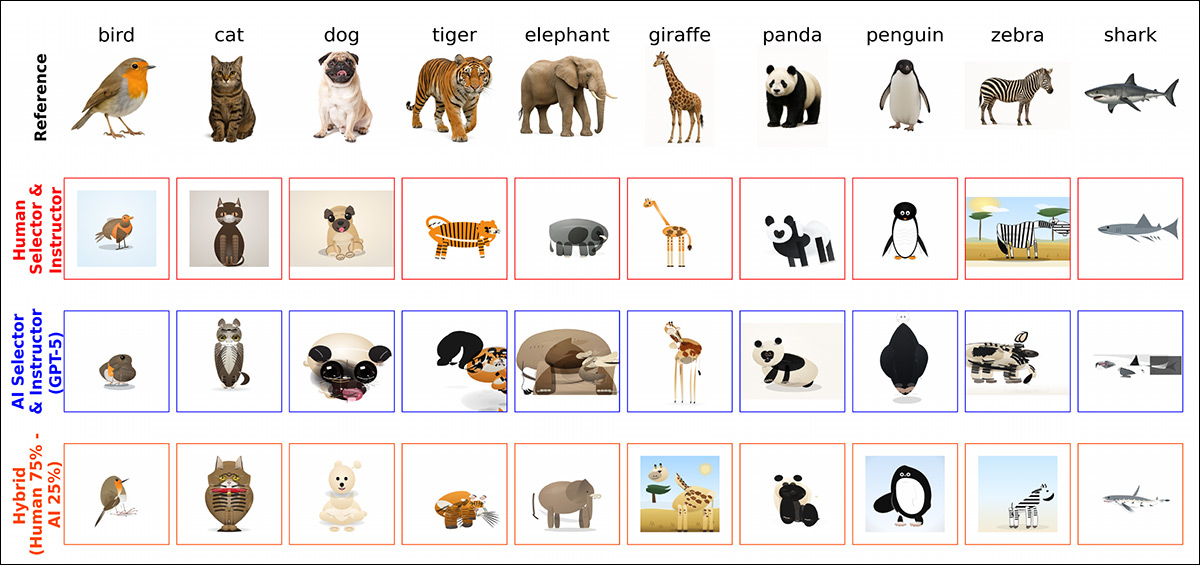

不同的人机协作百分比和类型的解决方案(摘自源论文中的更大插图,我们将读者引导至此)。

虽然人类和 AI 在测试的基线开始时表现相似,但随着时间的推移,他们的轨迹分歧:当人类提供指令并做出选择决定时,相似度评分随着迭代的进行而增加,稳步积累改进;但当 AI 系统填充两个角色时,性能没有显示出一致的收益,经常随着轮次的进行而下降 – 即使使用相同的底层模型进行代码生成,并且 AI 具有与人类参与者相同的信息。

… (内容太长,省略剩余部分)