人工智能

StyleTTS 2:具有大型语音语言模型的人类级文本转语音合成

由于自然和合成语音合成方法的增加,人工智能行业在过去几年中取得的一项重大成就是有效地合成文本转语音框架,具有潜在的应用于包括有声书、虚拟助手、语音导航等各个行业,并且一些最先进的模型在广泛的语音相关任务中实现了人类级的性能和效率。然而,尽管它们具有强大的性能,但在表达和多样化语音、需要大量训练数据来优化零样本文本转语音框架以及对OOD或分布外文本的鲁棒性方面仍然存在改进的空间,这促使开发人员致力于创建一个更强大和易用的文本转语音框架。

在本文中,我们将讨论StyleTTS-2,一种基于StyleTTS框架的强大和创新的文本转语音框架,旨在实现最先进的文本转语音系统。StyleTTS2框架将语音风格建模为潜在随机变量,并使用概率扩散模型来采样这些语音风格或随机变量,从而允许StyleTTS2框架在不使用参考音频输入的情况下有效地合成真实的语音。由于这种方法,StyleTTS2框架能够比当前最先进的文本转语音框架实现更好的结果和更高的效率,同时也能够利用扩散模型框架提供的多样化语音合成。我们将更详细地讨论StyleTTS2框架,并介绍其架构和方法,同时也将查看框架实现的结果。让我们开始吧。

StyleTTS2用于文本转语音合成:介绍

StyleTTS2是一种创新性的文本转语音合成模型,它是基于StyleTTS的,StyleTTS是一个基于风格的文本转语音生成模型。StyleTTS2框架将语音风格建模为潜在随机变量,并使用概率扩散模型来采样这些语音风格或随机变量,从而允许StyleTTS2框架在不使用参考音频输入的情况下有效地合成真实的语音。将风格建模为潜在随机变量是StyleTTS2框架与其前身StyleTTS框架的区别之处,StyleTTS2框架旨在为输入文本生成最合适的语音风格,而无需参考音频输入,并能够实现有效的潜在扩散,同时利用扩散模型提供的多样化语音合成能力。另外,StyleTTS2框架还采用预训练的大型SLM(语音语言模型)作为判别器,如WavLM框架,并将其与自己的新型微分持续时间建模方法相结合,以端到端的方式训练框架,最后生成具有增强的自然性的语音。由于其采用的方法,StyleTTS2框架在语音生成任务中超越了当前最先进的框架,并且是零样本设置中预训练大规模语音模型的最有效框架之一,用于说话人适应任务。

继续讨论,为了实现人类级别的文本转语音合成,StyleTTS2框架结合了现有工作的成果,包括用于语音合成的扩散模型和大型语音语言模型。扩散模型通常用于语音合成任务,因为它们具有细粒度的语音控制和多样化的语音采样能力。然而,扩散模型不如基于GAN的非迭代框架那么高效,主要原因是需要迭代地对潜在表示、波形和梅尔谱图进行采样,以达到目标语音的持续时间。

另一方面,最近关于大型语音语言模型的工作表明,它们能够提高文本转语音生成任务的质量,并且能够很好地适应说话人。大型语音语言模型通常将文本输入转换为从预训练语音语言框架中派生的量化或连续表示,以用于语音重构任务。然而,这些语音语言模型的特征并不是直接针对语音合成进行优化的。相比之下,StyleTTS2框架利用大型SLM框架的知识,使用对抗训练来合成语音语言模型的特征,而无需使用潜在空间映射,因此,直接学习语音合成优化的潜在空间。

StyleTTS2:架构和方法

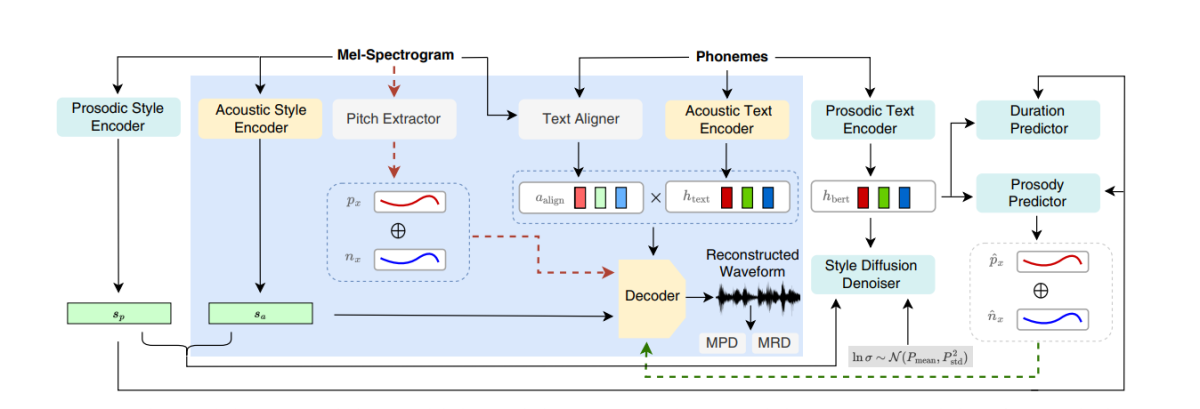

在其核心,StyleTTS2是建立在其前身StyleTTS框架之上的,StyleTTS是一个非自回归的文本转语音框架,它使用风格编码器从参考音频中派生出风格向量,从而允许表达和自然的语音生成。StyleTTS框架中使用的风格向量直接集成到编码器、持续时间和预测器中,使用AdaIN(自适应实例归一化),从而允许StyleTTS模型生成具有不同语调、持续时间和情感的语音输出。StyleTTS框架由8个模型组成,分为三个类别

- 声学模型或语音生成系统,包括风格编码器、文本编码器和语音解码器。

- 文本转语音预测系统,使用语调和持续时间预测器。

- 实用系统,包括文本对齐器、音高提取器和判别器,用于训练目的。

由于其方法,StyleTTS框架在可控和多样化的语音合成方面实现了最先进的性能。然而,这种性能也有一些缺点,如样本质量的降低、表达能力的限制和对实时语音应用的依赖。

StyleTTS2模型在StyleTTS框架的基础上实现了更好的表达和多样化的文本转语音任务,具有改进的分布外性能和高人类级别的质量。StyleTTS2框架使用端到端的训练过程来优化不同组件,使用对抗训练和直接波形合成的方式。与StyleTTS框架不同,StyleTTS2框架将语音风格建模为潜在变量,并通过扩散模型采样,从而在不使用参考音频的情况下生成多样化的语音样本。让我们更详细地了解这些组件。

端到端训练用于干扰

在StyleTTS2框架中,使用端到端的训练方法来优化各种文本转语音组件,用于干扰,而无需依赖固定组件。StyleTTS2框架通过修改解码器来实现这一点,直接从风格向量、音调和能量曲线以及对齐表示中生成波形。然后,框架删除解码器的最后一个投影层,并用波形解码器替换。StyleTTS2框架使用两个编码器:HifiGAN基于的解码器直接生成波形,以及iSTFT基于的解码器生成相位和幅度,这些相位和幅度被转换为波形,以实现更快的干扰和训练。

上图表示用于预训练和联合训练的声学模型。为了减少训练时间,模块首先在预训练阶段进行优化,然后在联合训练阶段优化所有组件,除了音调提取器。联合训练不优化音调提取器的原因是它用于提供音调曲线的真实值。

上图表示语音语言模型的对抗训练和干扰,使用预训练但未预调的WavLM框架。该过程与上述过程不同,因为它可以接受不同的输入文本,但会累积梯度来更新每个批次的参数。

风格扩散

StyleTTS2框架旨在通过一个潜在变量来建模语音作为条件分布,该变量遵循条件分布,被称为一般化语音风格,代表语音样本中超出任何语音内容范围的任何特征,包括词法应力、语调、语速,甚至是形式转换。

语音语言模型判别器

语音语言模型以其对语音和语音相关任务的广泛语义和声学方面的信息编码能力而闻名,SLM表示传统上能够模仿人类对生成语音质量的感知。StyleTTS2框架使用对抗训练方法来利用SLM编码器执行生成任务的能力,并采用12层WavLM框架作为判别器。这种方法允许框架实现对OOD或分布外文本的训练,从而提高性能。另外,为了防止过拟合问题,框架以相同的概率对OOD文本和分布内文本进行采样。

可微分持续时间建模

传统上,文本转语音框架使用持续时间预测器来生成语音持续时间,但这些持续时间预测器使用的上采样方法通常会阻止梯度流动在端到端训练过程中,NaturalSpeech框架采用基于注意力的上采样器来实现人类级别的文本转语音转换。然而,StyleTTS2框架发现这种方法在对抗训练中不稳定,因为StyleTTS2使用不同的对抗训练和不同的上采样方法来训练,而不会因为长度差异而导致额外的损失项。虽然使用软动态时间扭曲方法可以帮助缓解这种长度差异,但使用它不仅计算成本高,而且在处理对抗性目标或梅尔重构任务时,其稳定性也是一个问题。因此,为了实现人类级别的性能并稳定训练过程,StyleTTS2框架使用非参数上采样方法。高斯上采样是一种流行的非参数上采样方法,用于将预测的持续时间转换为语音帧,尽管它具有固定的高斯核长度的限制,这限制了其准确建模不同长度的对齐能力。

为了克服这一限制,StyleTTS2框架提出了一种新的非参数上采样方法,无需额外的训练,并能够处理不同长度的对齐。对于每个语音,StyleTTS2框架将对齐建模为一个随机变量,指示语音帧与其对齐的索引。

模型训练和评估

StyleTTS2框架在三个数据集上进行训练和实验:VCTK、LibriTTS和LJSpeech。StyleTTS2框架的单说话人组件使用LJSpeech数据集进行训练,包含大约13,000+个音频样本,分为12,500个训练样本、100个验证样本和500个测试样本,总运行时间约为24小时。StyleTTS2框架的多说话人组件在VCTK数据集上进行训练,包含超过44,000个音频片段,来自100多个不同口音的个别说话人,分为43,500个训练样本、100个验证样本和500个测试样本。最后,为了使框架具有零样本适应能力,框架在LibriTTS数据集上进行训练,包含大约250小时的音频,来自1,150多个个别说话人。为了评估其性能,模型使用两个指标:MOS-N(自然度的平均意见评分)和MOS-S(相似度的平均意见评分)。

结果

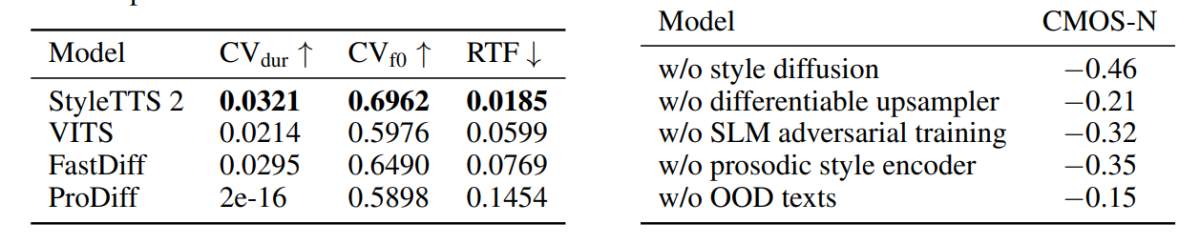

StyleTTS2框架的方法和方法论在其性能中得到了体现,因为该模型在NaturalSpeech数据集上超越了几种最先进的TTS框架,并为该数据集设定了新的标准。此外,StyleTTS2框架在VCTK数据集上超越了最先进的VITS框架,结果如以下图所示。

StyleTTS2模型还在LJSpeech数据集上超越了之前的模型,并且在OOD或分布外文本上没有显示出任何质量降低的迹象,如同之前的框架在同样的指标上所表现的那样。另外,在零样本设置中,StyleTTS2模型在自然度方面超越了现有的Vall-E框架,尽管它在相似度方面落后。但是,值得注意的是,StyleTTS2框架能够在仅训练245小时的音频样本的情况下实现竞争性的性能,而Vall-E框架则需要训练60,000多小时的音频样本,这证明了StyleTTS2是一种数据高效的替代方案,相比现有的大规模预训练方法,如Vall-E所使用的方法。

继续讨论,由于缺乏带有情感标签的音频文本数据,StyleTTS2框架使用GPT-4模型生成超过500个实例,跨越不同的情感,以可视化框架使用其扩散过程创建的风格向量。

在第一幅图中,情感风格以输入文本情感为响应,通过LJSpeech模型的风格向量来说明,展示了StyleTTS2框架合成具有不同情感的表达性语音的能力。第二幅图显示了五个个别说话人形成的明显集群,展示了来自单个音频文件的广泛多样性。最后一幅图展示了说话人1的情感集群的松散集群,揭示了尽管有一些重叠,但情感集群是突出的,这表明可以操纵说话人的情感基调,无论参考音频样本及其输入音调如何。尽管使用了基于扩散的方法,StyleTTS2框架仍然能够超越现有的最先进框架,包括VITS、ProDiff和FastDiff。

最后的想法

在本文中,我们讨论了StyleTTS2,一种新颖、强大和创新的文本转语音框架,建立在StyleTTS框架的基础上,旨在实现最先进的文本转语音系统。StyleTTS2框架将语音风格建模为潜在随机变量,并使用概率扩散模型来采样这些语音风格或随机变量,从而允许StyleTTS2框架在不使用参考音频输入的情况下有效地合成真实的语音。StyleTTS2框架使用风格扩散和SLM判别器来实现人类级别的文本转语音任务,并能够超越现有的最先进框架,在广泛的语音任务中实现最好的结果。