人工智能

光子芯片似乎能够显著提高人工智能处理速度

一组研究人员最近将光子处理器应用于人工智能应用,证明了光子处理器可以大大超过常规电子芯片的信息处理能力。

研究团队开发了一种新型芯片架构和方法,将数据存储和数据处理功能结合在一个设备中。这些芯片由相变材料(如DVD中使用的材料)制成。光子(光基)处理器用于生产一种可以以高速执行计算的计算机芯片,在最近发表在《Nature》杂志上的研究中,研究团队能够证明这些新型芯片能够由于其快速处理信息的并行能力而大大改进传统电子芯片。

矩阵-向量乘法

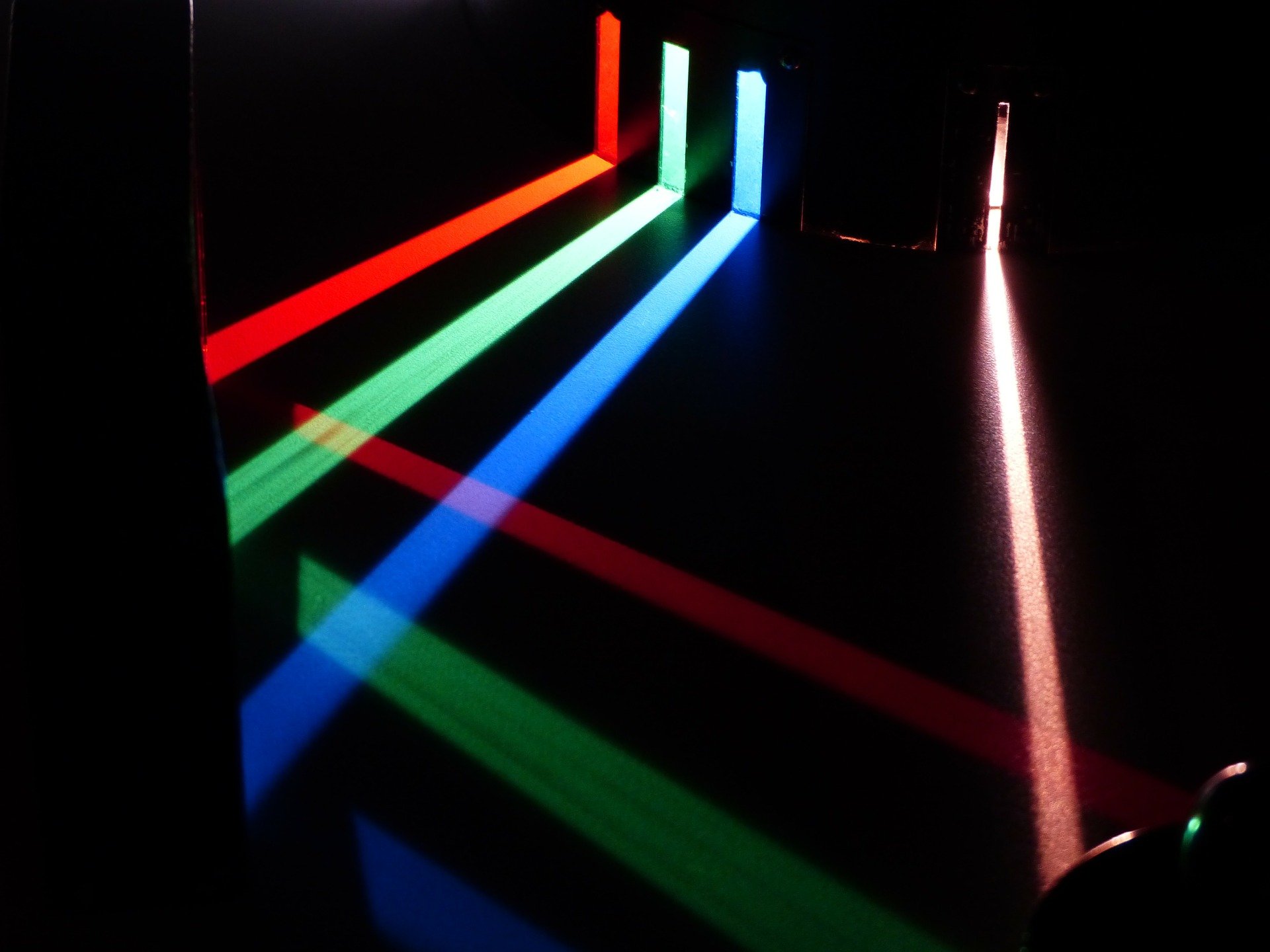

支撑许多最先进的人工智能应用的神经网络通过矩阵-向量乘法运作。研究团队创建了一个基于硬件的加速系统,能够并行执行这些乘法。光学芯片利用了不同光波长不相互干扰的事实,这意味着它们可以用于并行执行计算。研究团队依赖于由EPFL开发的“频率梳”,使用它作为光源为光子芯片提供各种波长。

EPFL的托比亚斯·基彭伯格教授(Professor Tobias Kippenberg)领导了频率梳的开发,基彭伯格是该研究的主要作者之一,另一位主要作者是来自明斯特大学的沃尔夫拉姆·珀尼斯(Wolfram Pernice)。根据珀尼斯的说法,基于光的处理器可以加速机器学习中计算密集型任务的执行速度,执行计算的速度甚至比专用硬件如张量处理单元(TPU)和最先进的GPU还要快。

神经网络训练

在设计和制造光子芯片后,研究人员通过测试它们来识别手写数字的神经网络。神经网络训练过程利用了芯片启用的波长多路复用,并且能够实现比以前达到的最高数据速率和计算密度。

正如明斯特大学的研究生和该研究的主要作者约翰内斯·费尔德曼(Johannes Feldmann)通过TechXplore解释的那样:

“输入数据与一个或多个滤波器之间的卷积运算——例如,在照片中突出显示边缘——可以很好地转移到我们的矩阵架构中。利用光进行信号传输使处理器能够通过波长多路复用执行并行数据处理,从而导致更高的计算密度和在一个时间步内执行许多矩阵乘法。”

该工作值得注意,因为它可以让神经网络在可能是典型训练时间的一小部分内在大型数据集上进行训练。随着大数据变得越来越大,受到物联网和智能设备日益普及的影响,数据科学家将需要新的方法来保持在大型数据集上训练网络所需的时间尽可能短。传统电子设备通常在低GHz范围内运行,而光调制速度可以达到50 GHz到100 GHz范围。

该研究可能对云计算、医学成像和自动驾驶等应用具有重要意义,这些应用都需要能够快速处理来自多个来源的大量数据。

该研究项目是国际研究团队之间的合作成果,团队成员来自匹兹堡大学、德国明斯特大学、英格兰的埃克塞特和牛津大学、IBM苏黎世以及瑞士的联邦理工学院(EPFL)。