人工智能

LoReFT: 语言模型的表示细化

参数高效的微调或PeFT方法旨在通过更新少量权重来适应大型语言模型。然而,现有的可解释性工作的大多数已经证明,表示编码了丰富的语义信息,这表明修改这些表示可能是一个更好、更强大的替代方法。预训练的大型模型通常被微调以用于新的域或任务,在微调过程中,单个基模型可以被适应于广泛的任务,即使只有少量的域内数据可供模型使用。然而,整个模型的微调过程是资源密集的和昂贵的,尤其是对于具有显著更高的大小和参数的语言模型。

参数高效的微调或PeFT方法提议通过仅更新少量的权重来解决整个模型微调的高成本,这个过程有助于减少训练时间和内存使用。更重要的是,参数高效的微调或PeFT方法在几个实际场景中已经展示了与微调相似的性能。适配器是一种常见的PeFT方法,学习一个可以添加到基模型的额外权重集上的编辑,最近的适配器如LoRA通过使用低秩近似而不是全权重矩阵来训练适配器,从而减少了可训练参数的数量。

由于以前的工作已经证明,编辑表示可能是一个更好的替代方法,因此在这篇文章中,我们将讨论表示微调或ReFT方法,它们在冻结模型上运行,并学习任务特定的表示干预。该文章旨在深入介绍ReFT或表示微调框架,并探索其机制、方法论、架构以及与最先进框架的比较。让我们开始吧。

ReFT: 语言模型的表示微调

为了将预训练语言模型适应新域和任务,当前框架经常微调这些预训练语言模型,因为微调过程允许单个基模型被适应于广泛的任务,即使只有少量的域内数据可供模型使用。虽然微调过程确实提高了整体性能,但它是一个昂贵的过程,尤其是对于具有显著更高的参数数量的语言模型。为了解决这个问题并减少相关成本,PeFT或参数高效微调框架仅更新少量的权重,这个过程不仅减少了训练时间,还减少了内存使用,从而实现了与全微调方法相似的性能,在实际场景中。

适配器是一种常见的PeFT方法,通过学习一个可以添加到基模型的额外权重集上的编辑来工作,最近的适配器如LoRA和QLoRA已经证明,可以在不影响性能的情况下在降低精度模型上训练全精度适配器。适配器通常比引入新模型组件的方法更高效、更有效。

当前最先进的参数高效微调框架的一个主要亮点是,它们修改权重而不是表示。然而,处理可解释性的框架已经证明,表示编码了丰富的语义信息,这表明表示编辑可能是一个更好的和更强大的方法。这个假设是表示编辑是一个更好的方法,是ReFT或表示微调框架的基础,该框架训练干预而不是适应模型权重,允许模型操纵少量的表示以在推理期间解决下游任务。ReFT或表示微调方法是权重基于PeFT或参数高效微调框架的替代品。ReFT方法从最近的模型中汲取灵感,这些模型使用大型模型可解释性,在表示上进行干预以找到忠实的因果机制,并在推理期间控制模型的行为,因此可以看作是表示编辑模型的一种泛化。基于此,LoReFT或低秩子空间ReFT是ReFT的一个强大和有效的实例,是ReFT的参数化,干预隐藏表示在低秩投影矩阵的线性空间中,并直接建立在DAS或分布式对齐搜索框架上。

继续,相比全微调,PeFT或参数高效微调框架仅训练模型的少量参数,并管理适应模型以解决下游任务。PeFT或参数高效微调框架可以分为三个主要类别:

- 适配器基于方法:适配器基于方法在预训练模型的冻结权重上训练额外的模块,如全连接层。系列适配器在多层感知器或MLP和LM或大型模型注意力层之间插入组件,而并行适配器在现有组件旁边添加模块。由于适配器添加新的组件,这些组件不能容易地折叠到现有的模型权重中,因此它们在推理期间带来额外的负担。

- LoRA:LoRA及其最近的变体在训练期间使用低秩矩阵近似加性权重,并且它们不需要在推理期间进行额外的开销,因为权重更新可以合并到模型中,这就是为什么它们被认为是当前最强的PeFT框架的原因。

- 提示基于方法:提示基于方法将随机初始化的软令牌添加到输入中,并在保持语言模型权重冻结的情况下训练其嵌入。这些方法的性能通常不令人满意,尤其是与其他PeFT方法相比,而且它们也带来显著的推理开销成本。

相比更新权重,ReFT框架学习干预以修改少量的表示。另外,最近的表示工程和激活控制工作已经证明,添加固定控制向量到残差流中可能会在不需要资源密集的微调的情况下实现对预训练大型模型生成的控制。其他框架已经证明,使用学习的缩放和平移操作编辑表示可能会尝试匹配但不超过LoRA适配器在广泛任务中的性能,使用更少的学习参数。这些框架在广泛任务中的成功已经证明,预训练语言模型引入的表示携带了丰富的语义,尽管这些模型的性能是次优的,导致PeFT继续作为最先进的方法,没有额外的推理负担。

ReFT:方法论和架构

为了保持风格保护过程的简单,ReFT框架假设一个基于变换器的大型模型作为其目标模型,该模型能够产生令牌序列的上下文化表示。对于具有n个输入令牌的给定序列,ReFT框架首先将这些输入令牌嵌入到表示列表中,接着m层计算表示列表作为前一个表示列表的函数。每个隐藏表示都是一个向量,语言模型使用最终的隐藏表示来产生预测。ReFT框架考虑掩码语言模型和自回归语言模型。现在,根据线性表示假设,在神经网络中,概念被编码在表示的线性子空间中。最近的模型已经在自然语言和其他输入分布上训练的神经网络模型中发现了这一说法的真实性。

另外,在可解释性研究中,因果抽象框架使用交换干预来建立神经网络组件在实现特定行为时的因果角色。交换干预的逻辑是,如果一个表示被固定为它在反事实输入下会是什么样子,并且这种干预一致地影响模型的输出,以一种方式证明了ReFT框架关于负责产生该表示的组件的说法,那么该组件在行为中起因果作用。虽然有几种方法,分布式交换干预是测试一个概念是否被编码在表示的线性子空间中的理想方法,如线性表示假设所claim的。另外,DAS方法已经被用于以前的语言模型中找到实体属性、情感、语言特征和数学推理的线性表示。然而,几个实验已经表明,DAS方法是高度表达的,并且它具有找到因果有效子空间的能力,即使变换语言模型被随机初始化,并且尚未学习任何任务特定的表示,从而导致了关于DAS是否有效和足够负责可解释性任务的辩论。

DAS提供的表达性表明,该方法可能是控制语言模型行为以及在可控生成和负责编辑方面的理想工具。因此,为了适应语言模型以解决下游任务,ReFT框架使用分布式交换干预操作来创建一种新的参数高效方法。另外,ReFT方法是一组干预,并且该框架强制执行,对于任何两个在同一层上运行的干预,干预位置必须是分离的,并且所有干预函数的参数保持独立。因此,ReFT是一个泛型框架,涵盖了在模型前向传递期间对隐藏表示的干预。

ReFT:实验和结果

为了评估其性能与现有的PEFT框架,ReFT框架在四个不同的自然语言处理基准上进行实验,涵盖了20多个数据集,主要目标是提供一个丰富的图景,展示LoReFT框架在不同场景中的性能。另外,当LoReFT框架在现实中实现时,开发人员需要决定学习多少个干预、输入位置和层来应用每个干预。为了完成此任务,ReFT框架调整四个超参数。

- 要干预的前缀位置的数量。

- 要干预的后缀位置的数量。

- 要干预的层的集合。

- 是否将干预参数在同一层的不同位置之间绑定。

通过这样做,ReFT框架简化了超参数搜索空间,并确保只有一个固定额外的推理成本,该成本不会随着提示的长度而增加。

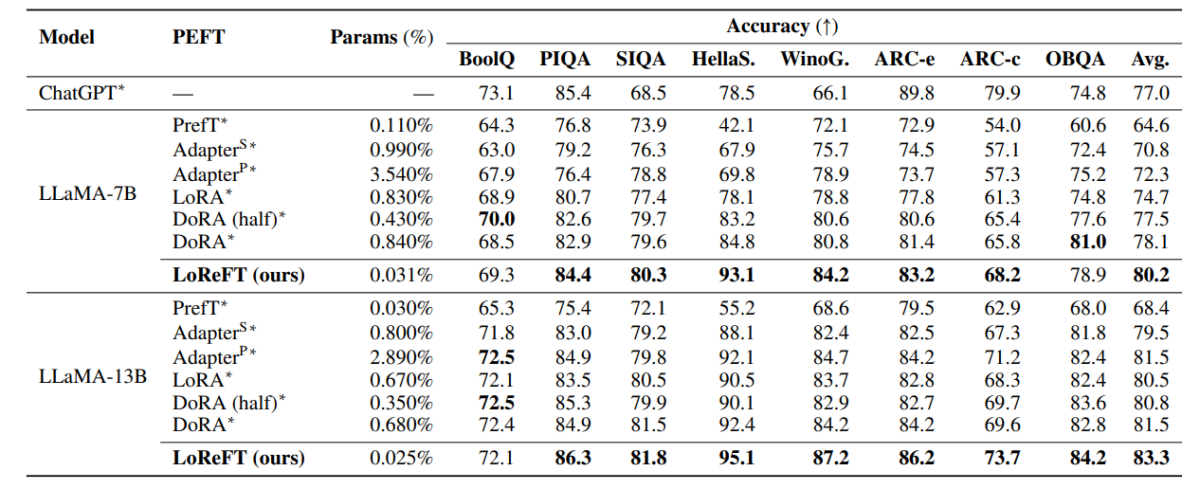

上表比较了LLaMA-7B和LLaMA-13B框架在8个常识推理数据集上的准确性与现有的PEFT模型。可以观察到,LoReFT模型在具有更少参数的情况下比现有的PEFT方法有更好的性能,报告了三个运行的平均性能,具有不同的参数种子用于LoReFT模型。param(%)是通过将可训练参数的数量除以基模型的总参数数量来计算的。

上表总结了LLaMA-7B和LLaMA-13B框架在4个不同算术推理数据集上的准确性比较与现有的PEFT模型,报告了三个运行的平均性能,具有不同的随机种子。可以观察到,尽管具有更少的参数,LoReFT框架比现有的PEFT框架有更好的性能。

上表总结了RoBERTa-base和RoBERTa-large框架在GLUE基准上的准确性比较与现有的PEFT模型,报告了五个运行的平均性能,具有不同的随机种子。可以观察到,尽管具有更少的参数,LoReFT框架比现有的PEFT框架有更好的性能。

最终想法

在这篇文章中,我们讨论了LoReFT,一种强大的替代现有的PEFT框架的方法,它在四个不同域的基准上实现了强大的性能,提供了高达50倍的效率,超过了以前的最先进的PEFT模型。预训练的大型模型通常被微调以用于新的域或任务,在微调过程中,单个基模型可以被适应于广泛的任务,即使只有少量的域内数据可供模型使用。然而,整个模型的微调过程是资源密集的和昂贵的,尤其是对于具有显著更高的大小和参数的语言模型。参数高效的微调或PeFT方法提议通过仅更新少量的权重来解决整个模型微调的高成本,这个过程有助于减少训练时间和内存使用。值得注意的是,LoReFT建立了新的最先进的性能,在常识推理、指令跟随和自然语言理解方面,超过了最强的PEFT。