Anderson 视角

拼图提升 AI 视觉推理能力

新研究表明,AI 模型可以通过解拼图变得更擅长于视觉。重新排列乱序的图像、视频和 3D 场景有助于它们在无需额外数据、标签或工具的情况下提高视觉技能。

在当前推动多模态大型语言模型(MLLMs)的竞争中,想要领先于其他模型(或至少保持三次发布的领先优势),很难找到简单的捷径,也没有免费的午餐。

尽管 2025 年众多令人印象深刻的中国开源发布据报道具有较低的开发和运行成本,但西方发布往往会向问题投入更多资源:更多数据量、更多推理能力、更多电力(尽管,如我们最近注意到的,不需要更多实际的人类标注员,因为这即使对于规模达万亿美元的通用 AI 革命来说也是太昂贵了)。

在研究文献中,大多数所谓的“免费”方法来提高 AI 架构的发展往往只提供微小的增量改进;或者在不是最关键的追求领域提供改进。尽管如此,寻找以前未知的“基本原理”来加速发展步伐的诱惑太大了,无法放弃。

拾起碎片

虽然不完全属于这一类别,但一项新的学术合作成果声称中国机构已经确定,让 VLMs 解决拼图可以显著提高它们的性能,尽管这种强化学习方法以前在这一领域的表现并不佳,而且不需要额外的系统、辅助模型或其他“外接”过程:

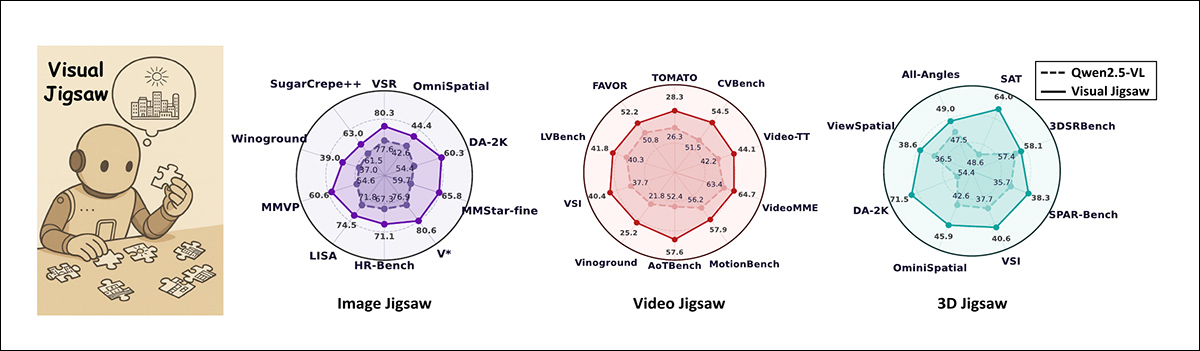

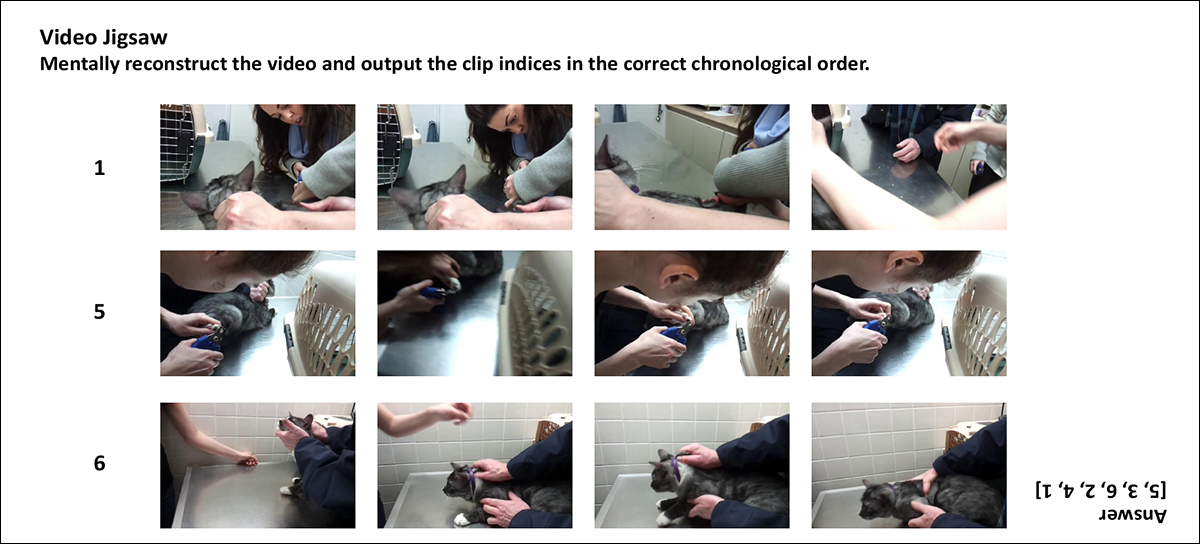

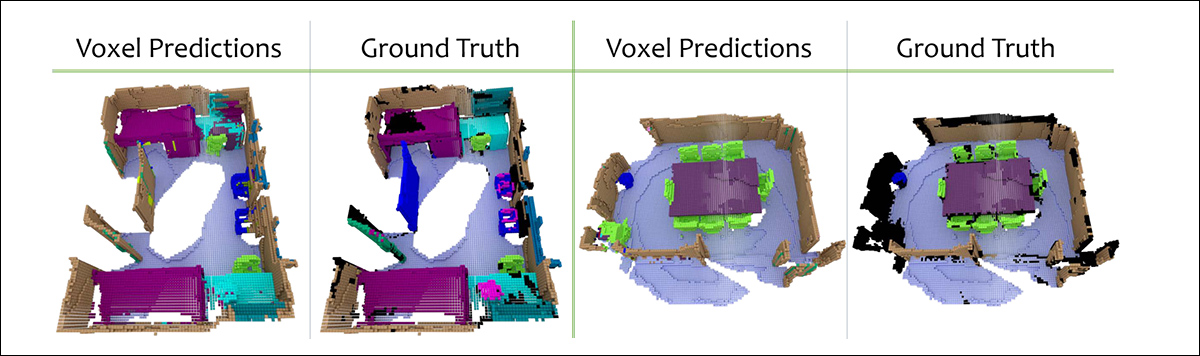

Visual Jigsaw 是一种自监督的后训练框架,能够提高多模态大型语言模型的视觉中心技能。通过在图像、视频和 3D 数据上训练拼图任务,模型在图像中获得更锐利的细粒度、空间和组合感知,在视频中获得更强的时间推理能力,并在 3D 场景中获得增强的几何感知。图像中的雷达图显示了对基础 Qwen2.5-VL 的一致性改进,值尺度已根据每个基准进行调整以提高清晰度。来源:https://arxiv.org/pdf/2509.25190

研究人员设计的系统称为 Visual Jigsaw,它涉及训练现有的 MLLMs 来处理被打乱和随机分散的材料,就像拼图一样。作者为这种方法开发了三个模式:图像、视频和 3D(即 CGI 风格的 网格),并发现对同一过程的适度调整可以使所有三个领域都受益:

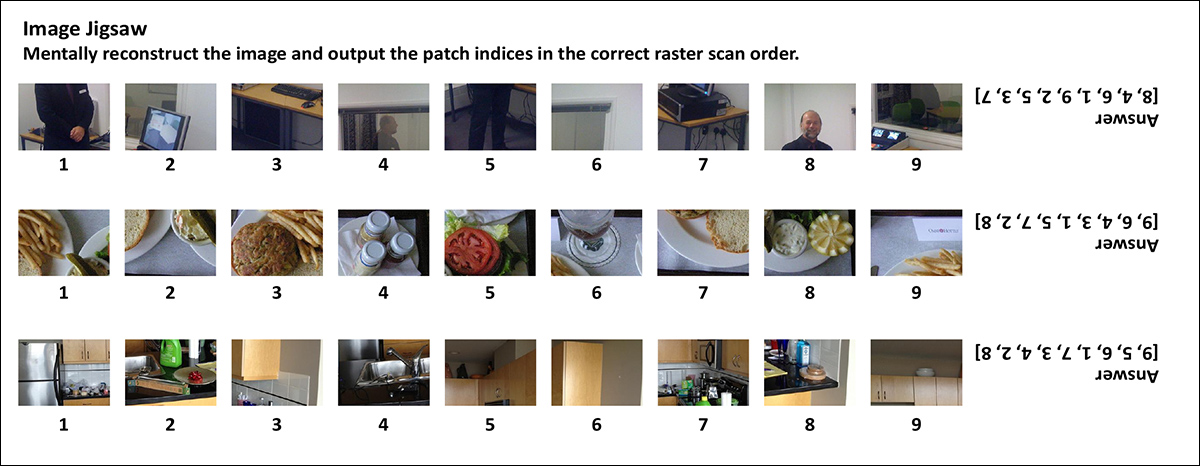

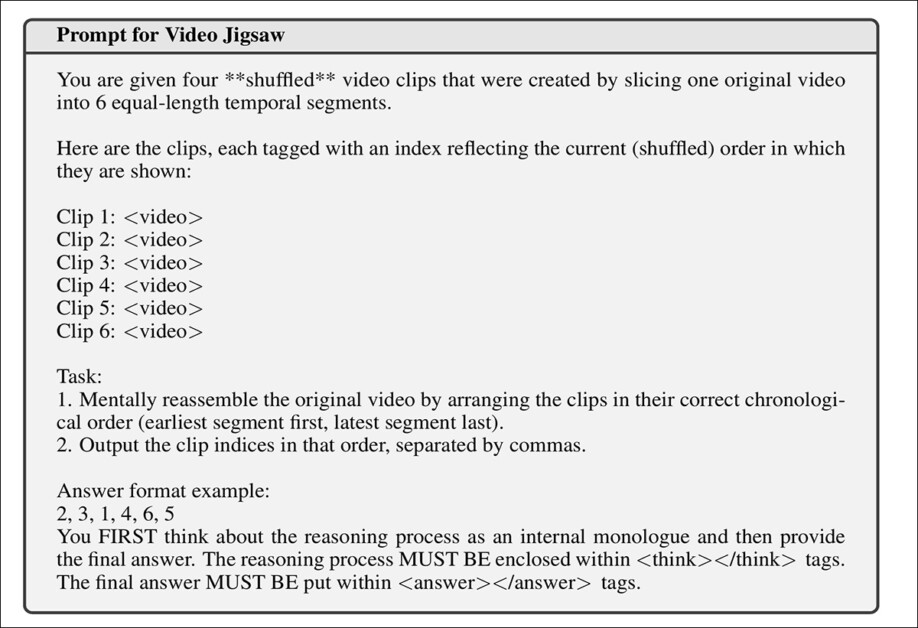

Visual Jigsaw 任务的三个示例。在图像 Jigsaw 中,图像被分割成补丁,打乱,然后模型预测正确的布局;在视频 Jigsaw 中,片段被打乱,然后模型恢复它们的时间顺序;在 3D Jigsaw 中,具有不同深度的点被打乱,然后模型从最近到最远对它们进行排名。模型输出根据基准事实进行评分,部分正确的解决方案可获得部分积分。

Visual Jigsaw 的训练方法通过让 AI 模型重新组装这些混乱的图像、视频剪辑或 3D 数据点来帮助它们提高对视觉信息的理解能力。

该过程基于文字而不是图像,因此不需要模型生成图像或使用任何额外的视觉组件。该方法属于 可验证奖励的强化学习(RLVR)系统,其中模型根据明确的自动规则获得正确答案的奖励;并且,在这种情况下,不需要人类标注。

这个至关重要的事实实际上很难从新论文中看出来:即该系统是通过语义、描述来组装拼图的,而不是人类学习解决此类拼图的形状表示方式:

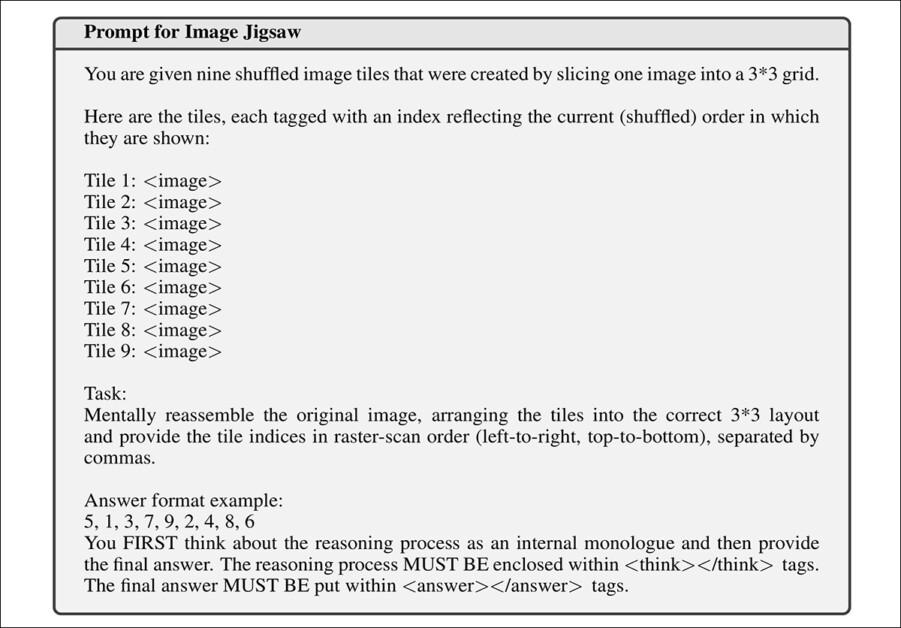

来自新论文的补充材料,一个示例 RL 任务,展示了这种辅助学习过程的基于文本的性质。图像不在此处显示。

尽管 MLLMs 广泛处理以视觉为中心的任务,但它们是 基于语言 的架构,不用于生成图像、视频或形状表示,如 3D 网格。

图像拼图任务的示例。每行显示了打乱的补丁,模型必须将它们重新排列成原始布局,正确的排列显示在右侧。

无论如何,这种训练是在模型已经具备一定理解图像能力的主学习阶段之后进行的。

以前的方法,例如 2017 年的瑞士论文 通过解拼图解决视觉表示的无监督学习,使用这种强化方法在卷积神经网络(CNNs)上取得了较少的成功,这是一种与现代 MLLM 相比明显不同的架构。

来自 2017 年发布的“通过解拼图解决视觉表示的无监督学习”的早期示例,展示了将碎片化用作神经系统的奖励挑战。来源:https://arxiv.org/pdf/1603.09246

在测试中,Visual Jigsaw 导致作者声称的基准测试中的一致且可衡量的改进:图像拼图任务改进了细粒度感知、空间布局理解和组合推理;视频拼图任务增强了模型跟踪时间序列和推理事件顺序的能力;3D 拼图任务加强了基于深度的理解和仅使用 RGB-D 输入的空间推理。

在所有三个模式中,论文重申,这种新方法在不需要架构更改、额外视觉模块或额外监督数据的情况下,超越了几种竞争基准:

‘广泛的实验表明,在细粒度感知、时间推理和 3D 空间理解方面取得了显著改进。我们的发现强调了自监督视觉中心任务在后训练 MLLMs 中的潜力,并旨在激发对视觉中心预训练设计的进一步研究。’

新论文 Visual Jigsaw 后训练提高了 MLLMs 由南洋理工大学、林雪平大学和商汤研究的六位研究人员共同撰写,该论文附有一个包含实时演示的 项目网站(您甚至可以将自己的图像加载到基于图像的拼图演示中)。该项目的代码和 权重 已经公开可用,

方法

虽然我们将研究信息的分割以适应三个测试模式,但我们首先应该考虑新系统的奖励设计。

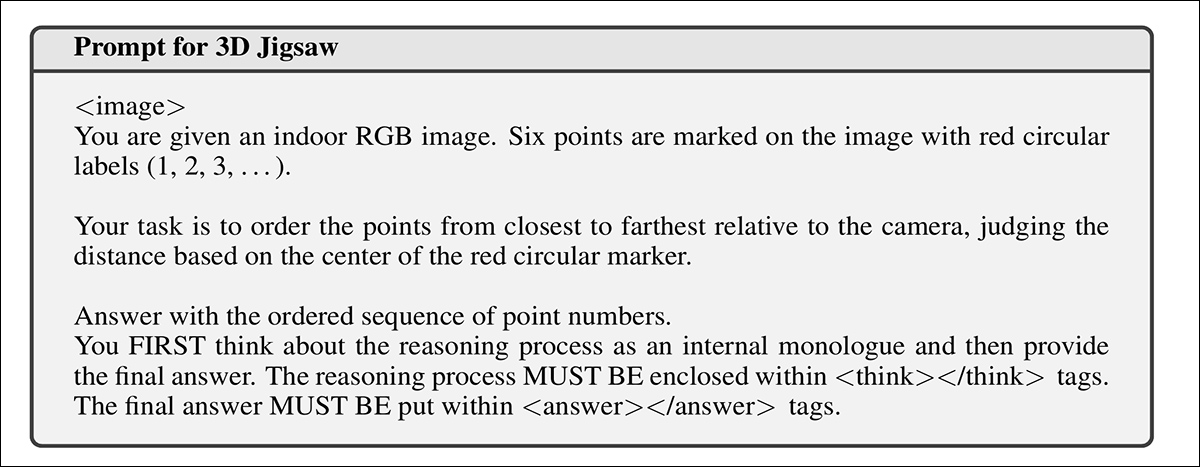

Visual Jigsaw 方法使用 分级奖励 对模型响应进行评分,而不是简单的通过或失败。如果模型预测拼图碎片的确切正确顺序,则获得全部奖励;如果答案大部分正确但不完美,则模型获得部分积分,通过 折扣因子 缩放,以避免过度重视近似值(这防止模型通过重复部分正确的猜测来欺骗系统)。

无效答案,例如使用相同数字重复的“作弊”行为,获得零分。为了鼓励一致的格式,模型必须将其推理放在 <think> 标签内,将其最终答案放在 <answer> 标签内。如果使用此格式,模型将获得小奖励。

图像

要为 图像 模式创建拼图,首先将图像分割成网格,方法是将其分割成大小相等的块:

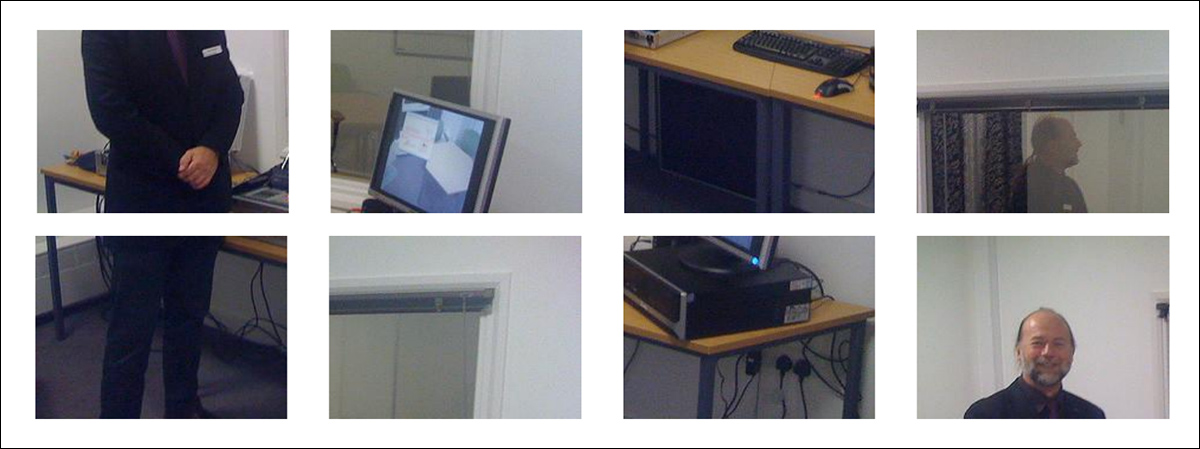

系统要解决的图像基于的补丁示例。

补丁以从左上到右下的固定顺序排列,类似于页面上的阅读顺序,然后使用随机shuffle打乱。模型然后被暴露在这个打乱的补丁集中,并必须通过预测恢复原始布局的正确排列来找出原始顺序。

在训练中,使用了 118,000 张来自 COCO 数据集的图像,每张图像产生九个补丁(即“拼图碎片”)。给系统的提示如本文前面所示(带有从 “来自新论文的补充材料” 开始的图像标题)。

视频

对于视频拼图任务,视频被均匀地切割成时间片段,然后打乱这些片段。模型然后被展示这个打乱的序列,并且必须找出它们的正确原始时间顺序。

视频拼图挑战的截断示例,来自论文的补充材料。

训练使用了来自 LLaVA-Video 数据集的 100,000 个视频,每个视频被分割成六个片段。为了防止模型利用片段边界的明显帧匹配线索,每个片段的开始和结束处的 5% 帧被剪裁。

每个片段最多包含 12 帧,最大分辨率为 128x28x28 像素。时间短于 24 秒的视频被排除。

该任务的提示如下:

呈现给 MLLMs 的视频任务的强化学习提示,不包括呈现给 MLLM 的片段。

3D 数据

通常,完整的 3D 拼图任务将涉及将 3D 空间(例如 体素 块或 点云 片段)分解成较小的块,并训练模型来重建其原始空间布局。

然而,平均而言,MLLM 不具备直接处理原始 3D 数据的能力,而是依赖于语义解释的图像或视频输入。因此,为了创建一个仍然与当前 MLLM 兼容的任务,同时仍然能够利用 3D 推理,作者引入了一种使用 RGB-D 图像(即包含每个像素深度信息的 2D 图像)的更易处理的变体。

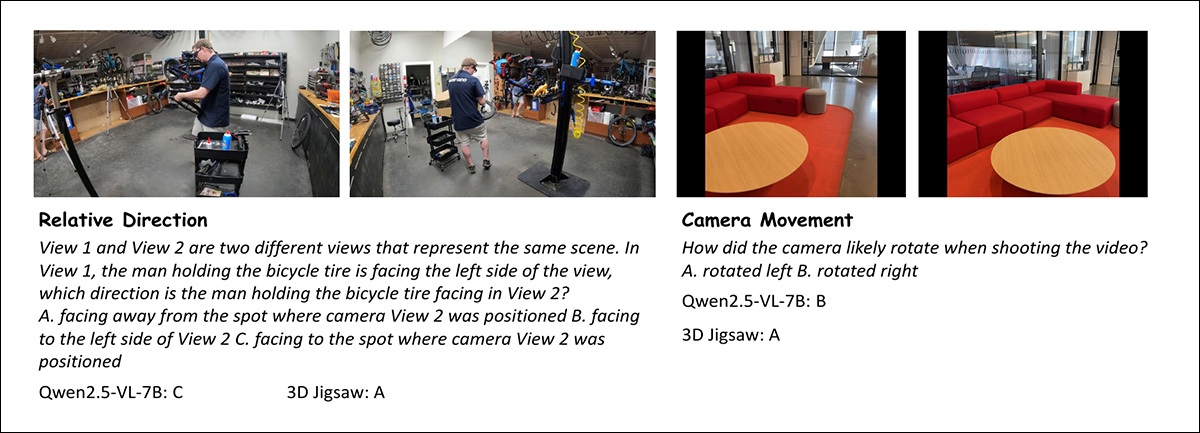

用于评估相对视点和相机运动推理的 3D 空间理解基准的示例问题。3D Jigsaw 模型正确推断了场景中两个视图之间的空间关系和相机旋转的可能方向,超越了 Qwen2.5-VL-7B 基线。

从每个 RGB-D 图像中,模型被给予一个打乱的具有不同深度的点列表,范围从近到远,目标是仅使用 2D 图像作为参考来恢复它们的正确深度顺序:

3D 拼图的 RL 提示。

每个点在图像上被标记(该图像被呈现给模型,但在上面的图像示例中没有可视化),模型必须预测哪个点最近,哪个点次近,以此类推,有效地在没有原始深度值的情况下重建原始深度序列。

3D 拼图任务是在 ScanNet 数据集的 RGB-D 图像上进行训练的,使用每张图像中选择的六个深度点生成 300,000 个样本。

用于 3D 拼图的 ScanNet 数据集的点云示例。来源:https://arxiv.org/pdf/1702.04405

每个点必须位于 0.1 到 10 米的深度范围内,并且为了促进多样性,集合中任意两点不允许在图像平面上相距少于 40 像素,或深度上相距少于 0.2 米。

测试

对于初始测试,系统使用 Qwen2.5-VL-7B-Instruct 作为基础的多模态模型。训练使用了组相对政策优化(GRPO)算法,移除了 KL 正则化 和 熵损失。

对于部分预测,应用了 0.2 的折扣因子。图像拼图训练使用全局 批大小 256,而视频和 3D 拼图使用 128。学习率设置为 1×10⁻⁶。

对于每个提示,模型在解码温度 1.0 下生成 16 个响应。图像和视频拼图任务都训练了 1,000 步,而 3D 拼图任务训练了 800 步。

图像拼图

图像拼图模型在三个类别的视觉中心基准测试中进行了评估:用于细粒度感知和理解,MMVP,MMStar 的细粒度感知子集;MMBench;HR-Bench;V*;MME-RealWorld(lite);LISA-Grounding;以及 OVD-Eval。

对于单ocular 空间理解,基准测试包括 VSR;OmniSpatial;以及 Depth Anything V2 (DA-2K)。对于组合视觉理解,测试使用了 Winoground 和 SugerCrepe++。

三个基线进行了测试,所有基线都源自 Qwen2.5-VL-7B:ThinkLite-VL 用于多模态推理;VL-Cogito 用于一般视觉和科学任务;以及 LLaVA-Critic-R1 用于图像感知。

所有模型都使用简短答案进行评估,因为 链式推理(CoT)有时会降低性能。

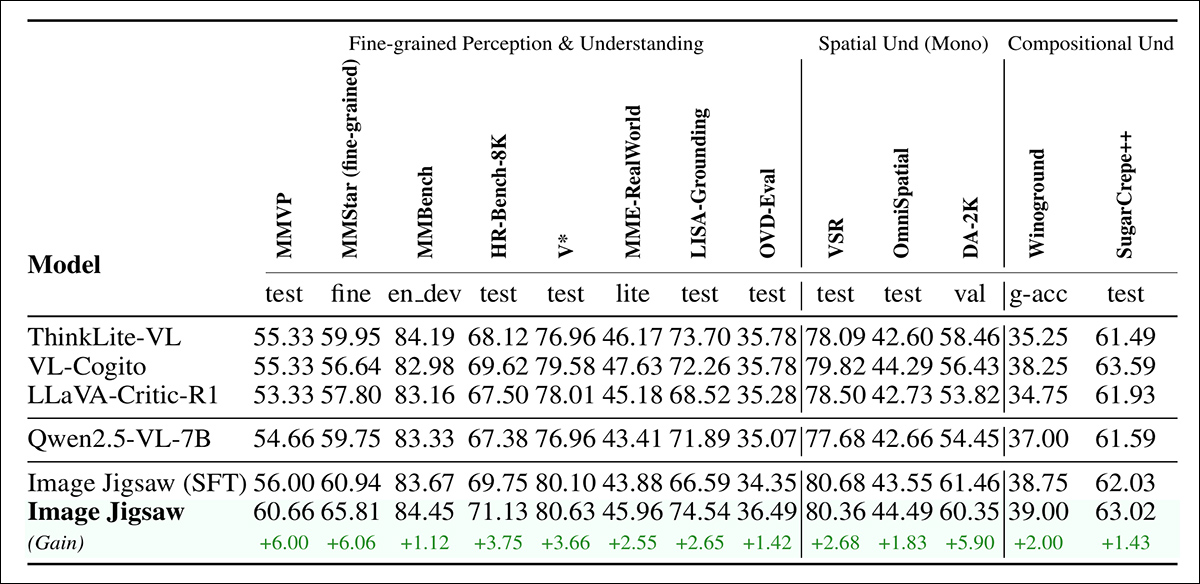

图像基准的评估结果。图像拼图在所有任务类别中(即细粒度感知和理解、单ocular 空间理解和组合视觉推理)都改进了 Qwen2.5-VL-7B 基础模型,并且在先前的后训练基线中表现出色。

图像拼图的结果如上所述,作者指出:

“[上图] 显示我们的方法在三个基准测试类别中一致地提高了视觉中心能力。这些结果确认,将图像拼图后训练纳入其中显著提高了 MLLMs 的感知基础和细粒度视觉理解,超出了推理中心的后训练策略。”

“我们将这些改进归因于解决图像拼图需要模型关注局部补丁细节、推断全局空间布局和推理补丁间关系的事实,这些都直接有利于细粒度、空间和组合理解。”

视频拼图

对于视频拼图,评估是在 AoTBench;Vinoground;TOMATO;FAVOR-Bench;TUNA-Bench;Video-MME;TempCompass;TVBench;MotionBench;LVBench;VSI-Bench;Video-TT;以及 CVBench。

Video-R1 被用作基线模型,该模型经过冷启动监督微调,然后使用强化学习进行视频理解和推理。这种情况下,评估包括了完整的推理过程,因为这始终产生更好的结果,而不是直接答案。

所有模型都限制在 256x28x28 像素的分辨率下,并在三个帧设置中进行了测试:16、32 和 64:

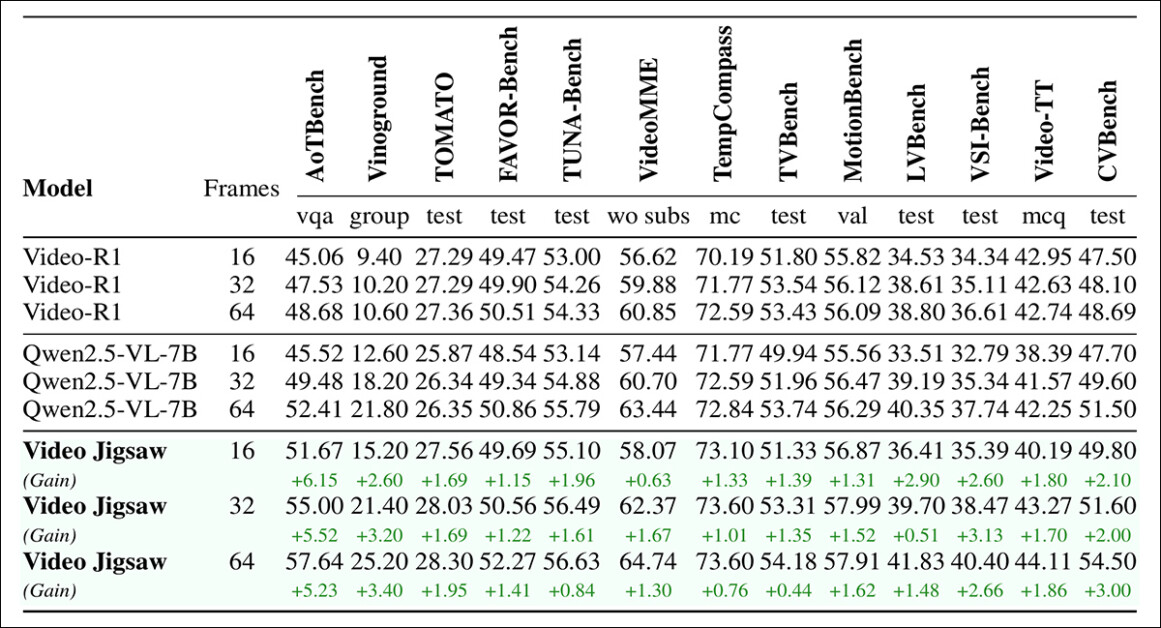

视频基准的评估结果,视频拼图在所有任务和帧设置中一致地超越了基线。

视频拼图在所有视频理解基准和帧设置中产生了一致的改进,尤其是在需要时间推理和方向性的任务中表现出色,例如 AoTBench 中的任务,也在跨视频推理基准中表现出色,例如 CVBench:

“这些结果确认,解决视频拼图任务鼓励模型更好地捕捉时间连续性,理解视频之间的关系,推理方向一致性,并推广到整体和普遍的视频理解场景。”

3D 数据

对于 3D 模式,模型在 SAT-Real;3DSRBench;ViewSpatial;All-Angles;前面提到的 OmniSpatial;VSI-Bench;SPARBench(tiny);以及前面提到的 DA-2K 上进行了评估。

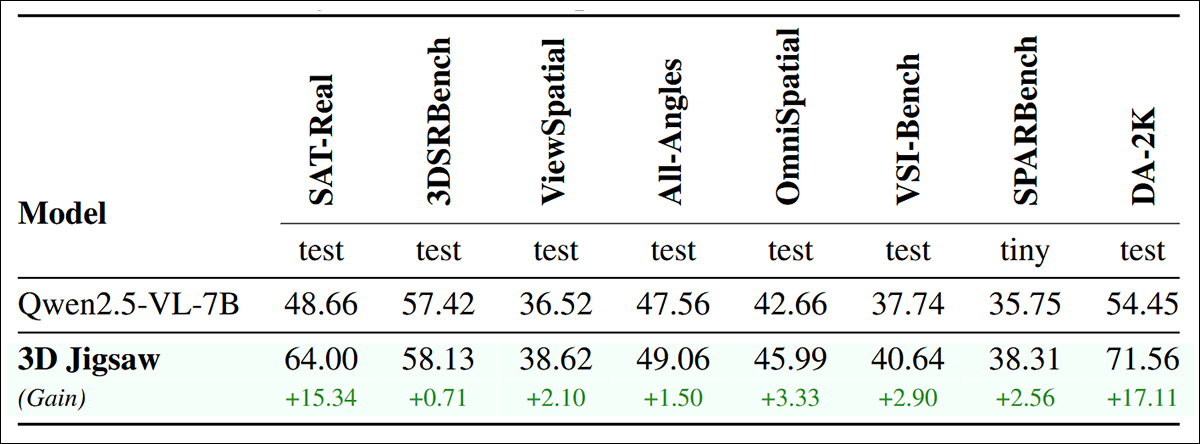

3D 基准的评估结果:3D 拼图在深度比较任务(如 DA-2K)以及涵盖单视图、多视图和自主视频输入的更广泛 3D 感知基准上都有所改进。

作者指出:

“[3D] 拼图在所有基准上都取得了显著改进。毫无疑问,最大收益出现在 DA-2K 上,这是一个直接与我们的深度排序预训练任务相关的深度估计基准。更重要的是,我们观察到在包括单视图(例如 3DSRBench,[OmniSpatial])、多视图(例如 ViewSpatial、All-Angles)和自主视频输入(例如 VSI-Bench)的任务中的一致改进。”

“这些结果表明我们的方法不仅教授特定的深度排序技能,而且还有效地增强了模型对 3D 空间结构的感知和推理的整体能力。”

结论

从这篇论文中不太明显的是,驱动 MLLM 性能改进的图像和描述之间的确切关系。

乍一看,通过解拼图来学习的过程似乎与我们自己的早期尝试和发展非常相似。然而,我们自己的空间解释感觉上与语言和语义解释更少有关,论文的更深入研究揭示了语言如何作为 MLLM 之间的视觉和语义现实的桥梁。

* 请注意,论文作者更喜欢使用不常见的术语“多模态大型语言模型”,缩写为“MLLMs”。这是一个新兴或不常用的术语,适用于能够广泛地对图像进行空间推理和分析的模型,但不生成图像。随着新范式和模型的出现,这个词汇正在不断修订。

首次发布于 2025 年 10 月 2 日,星期四