人工智能

GOTCHA– 一个用于实时深度伪造的CAPTCHA系统

纽约大学的新研究为我们可能很快需要进行深度伪造的“醉酒测试”提供了越来越多的证据,以便在开始敏感的视频通话(如工作相关的视频会议或其他可能吸引使用实时深度伪造流媒体软件的诈骗者)之前验证自己。

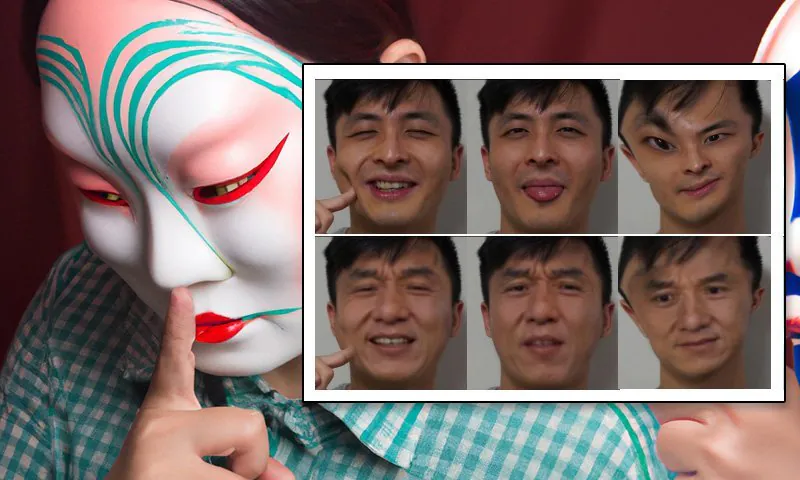

GOTCHA中应用于视频通话场景的某些主动和被动挑战。用户必须遵守并通过这些挑战,同时使用额外的’被动’方法(例如,尝试过载潜在的深度伪造系统),这些方法不受参与者的影响。 来源:http://export.arxiv.org/pdf/2210.06186

所提出的系统称为GOTCHA – 这是对过去10-15年中变得越来越多的web浏览障碍的致敬,即CAPTCHA系统,其中自动系统要求用户执行机器不擅长的任务,例如识别动物或解读混乱的文本(而且,讽刺的是,这些挑战经常将用户变成免费的AMT风格的外包注释员)。

本质上,GOTCHA扩展了2022年8月来自贝恩-古里安大学的DF-Captcha论文,该论文首次提出要求通话另一端的人跳过几个视觉语义圈,以证明他们的真实性。

2022年8月贝恩古里安大学的论文首次提出了一系列交互式测试,包括用手遮住脸或甚至按压皮肤 – 即使是训练有素的实时深度伪造系统也可能没有预料到或无法处理这些测试。 来源:https://arxiv.org/pdf/2208.08524.pdf

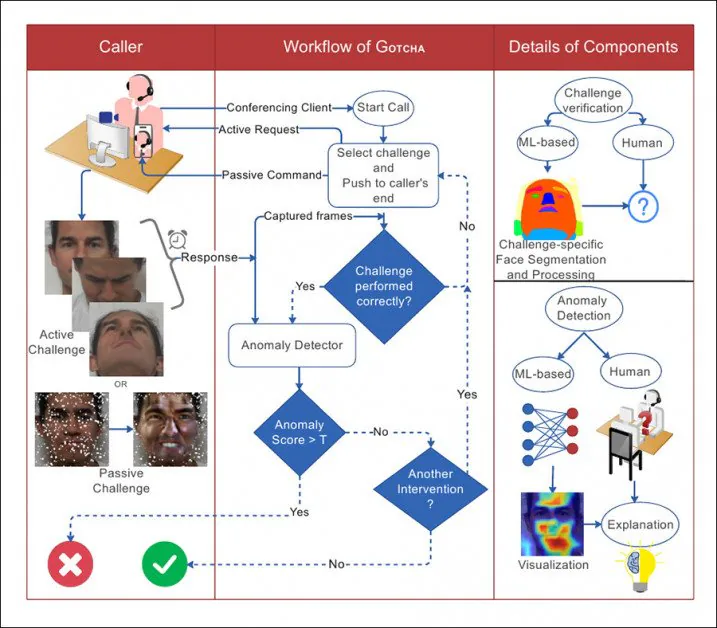

值得注意的是,GOTCHA在一系列提出的测试中添加了“被动”方法,包括自动将虚拟元素叠加在用户的脸上,以及“过载”源系统传输的帧。然而,只有用户响应任务可以在没有特殊权限访问用户本地系统的情况下进行评估 – 这可能需要以Skype和Zoom等流行系统的本地模块或插件的形式出现,或者以专有的软件的形式专门用于过滤掉假冒者。

来自论文的GOTCHA系统与呼叫者之间的交互图,虚线表示决策流程。

研究人员在一个包含47名参与者、每人进行13个挑战的新数据集上验证了该系统,数据集包含超过250万个视频帧。他们声称,该框架对欺诈用户的深度伪造内容质量产生了“一致且可测量”的降低,直到明显的伪造迹象在人类的肉眼中变得明显(尽管GOTCHA也包含一些更微妙的算法分析方法)。

新的论文题为Gotcha:实时深度伪造检测的挑战响应系统(系统的名称在正文中大写,但在出版物标题中不大写,尽管它不是首字母缩写)。

一系列挑战

大致按照贝恩-古里安论文的规定,实际面向用户的挑战被分为几种类型的任务。

对于遮挡,用户被要求遮住他们的脸,或者以不太可能被深度伪造模型训练的方式呈现他们的脸(通常是因为训练数据中缺乏“奇怪”的姿势 – 参见上面的第一幅图中的图像范围)。

除了用户可能按照指示自己执行的操作外,GOTCHA可以随机叠加面部剪裁、贴纸和增强现实滤镜,以“破坏”本地训练的深度伪造模型可能预期的面部流,导致其失败。如前所述,虽然这是一个“被动”的过程,但对于软件来说,这是一个侵入性的过程,需要直接干预端对端的流媒体。

接下来,用户可能被要求做出不寻常的面部表情,这些表情可能在任何训练数据集中都不存在或代表性不足,导致深度伪造输出的质量降低(参见上面的第一幅图中的“b”图像,第二列从左开始)。

作为这些测试的一部分,用户可能被要求朗读文本或进行对话,以挑战本地实时深度伪造系统,该系统可能没有训练足够的音素或其他类型的口腔数据,以至于无法在这种审查下重现准确的唇部运动。

最后(这似乎会挑战端对端的演技),在此类别中,用户可能被要求表达一个“微表情” – 一个短暂而非自主的面部表情,揭示了情绪。论文中说:'[它]通常持续0.5-4.0秒,很难伪造’。

虽然论文没有描述如何提取微表情,但逻辑表明,唯一的方法是通过测试例程中呈现给用户的某种内容来在用户中产生适当的情绪,可能是以某种方式呈现给他们的。

面部畸变、照明和意外访客

此外,按照8月份论文的建议,新工作提出要求端用户执行不寻常的面部畸变和操作,例如将手指按压到脸颊上,与脸部和/或头发互动,并执行其他动作,这些动作当前的实时深度伪造系统不太可能处理得好,因为这些是边缘动作 – 即使它们存在于训练数据集中,它们的重现也可能是低质量的,与其他“异常”数据一致。

一个微笑,但这个’抑郁的脸’并没有被本地实时深度伪造系统很好地翻译。

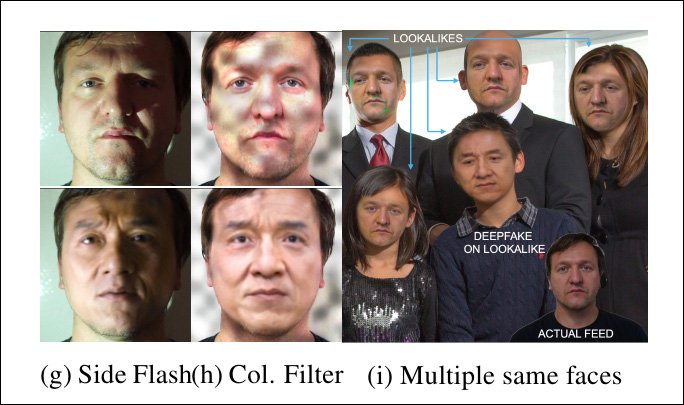

另一个挑战在于改变端用户所处的照明条件,因为可能深度伪造模型的训练是针对标准视频会议照明情况或甚至通话所处的确切照明条件进行的。

因此,用户可能被要求使用手机上的手电筒照亮他们的脸,或者以其他方式改变照明(值得注意的是,这是另一个实时深度伪造检测论文的核心主张,该论文于今年夏天发布)。

实时深度伪造系统受到意外照明的挑战 – 甚至受到多人在流媒体中的挑战,而它们只期望一个个体。

在系统能够插入本地用户流媒体(怀疑其中存在深度伪造中间人)的情况下,添加意外的模式(参见上面的中间列)可以损害深度伪造算法维持模拟的能力。

此外,虽然要求通讯者在验证过程中有额外的人帮助他们可能不合理,但系统可以插入额外的面部(上面的最右边的图像),并观察任何本地深度伪造系统是否犯错 – 或者甚至尝试深度伪造所有这些(自动编码深度伪造系统没有“身份识别”能力,可以在这种情况下保持对个体的关注)。

隐写术和过载

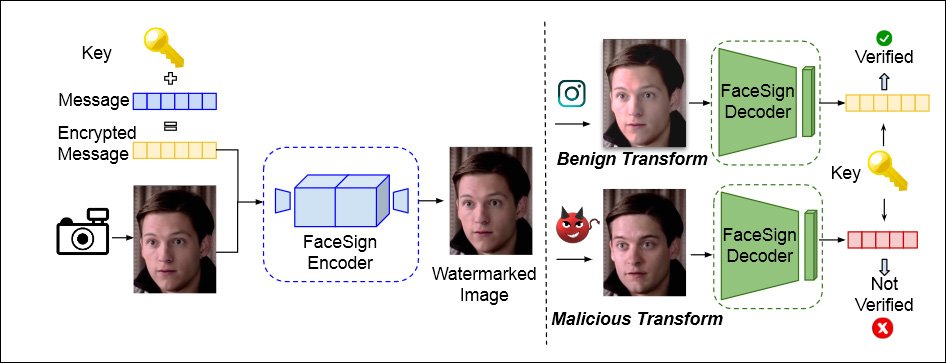

GOTCHA还融入了加州大学圣地亚哥分校今年四月首次提出的方法,该方法使用隐写术将消息加密到用户的本地视频流中。深度伪造例程将完全破坏此消息,从而导致身份验证失败。

来自加州大学圣地亚哥分校和圣地亚哥州立大学2022年4月的论文,描述了一种通过检查隐写信号是否在用户的视频流中保持完整来确定真实身份的方法 – 如果它没有保持完整,可能存在深度伪造欺骗。 来源:https://arxiv.org/pdf/2204.01960.pdf

此外,GOTCHA能够过载本地系统(假设有访问和权限),通过复制流媒体并向任何本地系统呈现“过多”的数据,旨在导致本地深度伪造系统复制失败。

系统包含进一步的测试(请参阅论文以获取详细信息),包括一个挑战,即要求智能手机通讯者将手机倒置,这将扭曲本地深度伪造系统:

同样,这种事情只会在有令人信服的使用案例的情况下起作用,即用户被迫授予本地流媒体访问权限,并且无法仅通过被动评估用户视频来实现(与交互式测试(如将手指按压到脸上)相反)。

实用性

论文简要讨论了此类测试可能会让最终用户感到厌烦,或者以某种方式不便于他们 – 例如,要求用户在测试中备有可能需要的物品,例如墨镜。

它还承认可能很难让有权势的通讯者遵守测试例程。关于与CEO的视频通话,作者表示:

‘可用性可能是关键,因此非正式或轻浮的挑战(例如面部畸变或表情)可能不合适。使用外部物理物品的挑战可能不理想。这里的上下文是适当修改的,GOTCHA根据上下文调整其挑战集。

数据和测试

GOTCHA被测试在四个本地实时深度伪造系统的菌株,包括两个非常流行的自动编码深度伪造创建器DeepFaceLab的变体(’DFL’,尽管论文中没有提到DeepFaceLive,它自2021年8月以来一直是DeepFaceLab的“实时”实现,并且似乎是潜在欺诈者的最可能的初始资源)。

四个系统是:在非著名人士上“轻度”训练的DFL,并配对一个名人;训练了200多万次迭代或步骤的DFL,我们可以期待一个更高性能的模型;潜在图像动画器(LIA);以及面部交换生成对抗网络(FSGAN)。

对于数据,研究人员捕获和策划了上述视频片段,包含47个用户执行13个主动挑战,每个用户输出大约5-6分钟的1080p视频,帧率为60fps。作者还表示,这些数据最终将公开发布。

异常检测可以由人类观察者或算法执行。对于后者,系统在FaceForensics数据集的600张脸上进行了训练。回归损失函数是强大的感知图像补丁相似性(LPIPS),而二元交叉熵用于训练分类器。 EigenCam用于可视化检测器的权重。

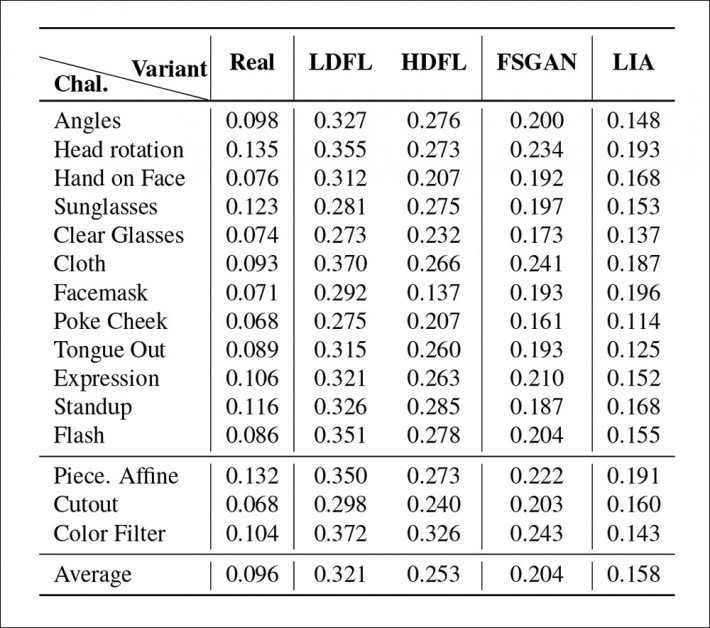

GOTCHA测试的主要结果。

研究人员发现,对于四个系统的全部测试,获得的异常(即,揭示深度伪造系统存在的伪影)数量和严重程度最低的是更高训练的DFL分布。训练较少的版本在重现复杂的唇部运动(占据了很小的帧部分,但却受到人类的高度关注)方面尤其困难,而FSGAN则处于两个DFL版本之间,LIA被证明完全不适合这项任务,研究人员认为LIA将在实际部署中失败。

首次发布于2022年10月17日。