人工智能

从仅两张图片生成更好的 AI 视频

视频帧插值(VFI)是生成性视频研究中的一个开放性问题。挑战是生成两个现有帧之间的中间帧序列。

点击播放。 FILM 框架是一个由 Google 和华盛顿大学合作的项目,提出了一种有效的帧插值方法,仍然在爱好者和专业领域中流行。左边,我们可以看到两个单独的和不同的帧叠加;中间,是“结束帧”;右边,是帧之间的最终合成。 来源:https://film-net.github.io/ 和 https://arxiv.org/pdf/2202.04901

广泛来说,这种技术可以追溯到一个世纪前,并且自那时起就被用于传统动画。在这种情况下,主要动画艺术家会生成主“关键帧”,而“中间帧”Tweening 的工作将由其他员工完成,这是一项更为琐碎的任务。

在生成性 AI 出现之前,帧插值被用于诸如 实时中间流估计(RIFE)、深度感知视频帧插值(DAIN)和 Google 的 大运动帧插值(FILM,见上文)等项目,以增加现有视频的帧率或实现人工生成的慢动作效果。这是通过分离视频片段的现有帧并生成估计的中间帧来实现的。

VFI 也用于开发更好的视频编解码器,以及更广泛的基于 光流 的系统(包括生成性系统),这些系统利用预先知道的关键帧来优化和塑造前面的插值内容。

生成性视频系统中的结束帧

现代生成性系统,如 Luma 和 Kling,允许用户指定开始和结束帧,并可以通过分析两张图像中的关键点并估计两张图像之间的轨迹来执行此任务。

如以下示例所示,提供一个“结束”关键帧可以更好地让生成性视频系统(在本例中为 Kling)保持身份等方面,即使结果不完美(特别是对于大运动)。

点击播放。 Kling 是一个越来越多的视频生成器,包括 Runway 和 Luma,它们允许用户指定一个结束帧。在大多数情况下,较小的运动将导致最真实和最不受缺陷的结果。 来源:https://www.youtube.com/watch?v=8oylqODAaH8

在上面的示例中,人物的身份在两个用户提供的关键帧之间保持一致,导致相对一致的视频生成。

如果只提供起始帧,生成系统的注意力窗口通常不够大,无法“记住”视频开始时人物的外貌。相反,身份可能会随着每一帧的变化而略微变化,直到所有相似之处都丢失。在下面的示例中,上传了一个起始图像,人物的运动由文本提示引导:

点击播放。 没有结束帧,Kling 只有一个小组最近的帧来指导下一帧的生成。在需要任何显著运动的情况下,身份的萎缩变得严重。

我们可以看到,演员的相似之处并没有抵抗指令,因为生成系统不知道他在微笑时的样子,而且种子图像(唯一的参考)中他没有微笑。

大多数病毒式生成性视频片段都经过精心策划,以淡化这些缺点。然而,时间上一致的生成性视频系统的进展可能取决于研究领域关于帧插值的新发展,因为唯一的替代方案是依赖传统的 CGI 作为“指导”视频(即使在这种情况下,纹理和照明的一致性也很难实现)。

此外,从最近的一组帧中推导出新帧的缓慢迭代性质使得实现大规模和大胆的运动非常困难。这是因为快速移动的物体可能会在一帧的时间内从一侧移动到另一侧,这与系统可能接受训练的更渐进的运动相反。

同样,姿势的显著和大胆变化可能不仅会导致身份转变,还会导致生动的不一致性:

点击播放。 在 Luma 的这个示例中,请求的运动似乎在训练数据中没有很好地表示。

Framer

这带我们来到了中国的一个有趣的最新论文,它声称在真实的帧插值方面取得了新的最先进的成果——并且是首个提供基于拖拽的用户交互的论文。

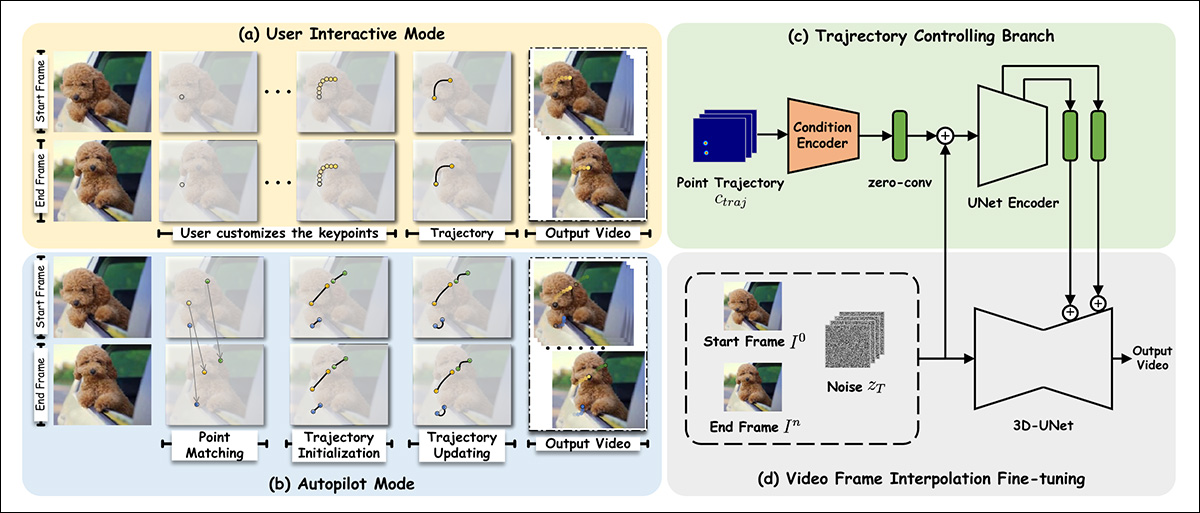

Framer 允许用户使用直观的基于拖拽的界面来指导运动,尽管它也具有“自动”模式. 来源:https://www.youtube.com/watch?v=4MPGKgn7jRc

基于拖拽的应用程序最近在文献中变得更加频繁 频繁 出现 在 这里,因为研究部门正在努力为生成系统提供不基于文本提示的粗糙结果的工具。

新系统,名为 Framer,不仅可以跟随用户引导的拖拽,还具有更传统的“自动驾驶”模式。除了传统的补间动画外,该系统还能够生成时间拉伸模拟,以及输入图像的变形和新视图。

插值帧,用于 Framer 的时间拉伸模拟。 来源:https://arxiv.org/pdf/2410.18978

关于新视图的生成,Framer 略微进入了神经辐射场(NeRF)的领域——尽管只需要两张图像,而 NeRF 通常需要六个或更多图像输入视图。

在测试中,Framer 建立在 Stability.ai 的 Stable Video Diffusion 潜在扩散生成视频模型之上,能够在用户研究中超越对手方法。

在编写本文时,代码即将在 GitHub 上发布。视频样本(上面的图像来自这些样本)可在项目网站上找到,研究人员还发布了一段 YouTube 视频。

新论文 的标题是 Framer:交互式帧插值,由浙江大学和阿里巴巴集团的蚂蚁集团的九名研究人员共同撰写。

方法

Framer 使用基于关键点的插值,或者说是其两种模式,其中输入图像被评估为基本拓扑,并在必要时分配“可移动”点。实际上,这些点相当于基于 ID 的系统中的面部标志,但可以推广到任何表面。

研究人员 微调 Stable Video Diffusion(SVD)在 OpenVid-1M 数据集上,并添加了一个额外的最后帧合成功能。这使得可以评估一条轨迹控制机制(上右图中的模式图),它可以评估一条路径到结束帧(或从结束帧开始)。

Framer 的模式图。

关于添加最后帧条件,作者指出:

“为了尽可能保留预训练的 SVD 的视觉先验,我们遵循 SVD 的条件范式,并分别在潜在空间和语义空间中注入结束帧条件。”

“具体来说,我们将第一帧的 VAE 编码潜在特征与第一帧的噪声潜在特征连接起来,就像在 SVD 中一样。另外,我们将最后一帧的潜在特征 zn 与最后一帧的噪声潜在特征连接起来,考虑到条件和对应的噪声潜在特征是空间对齐的。”

“此外,我们分别提取第一帧和最后一帧的 CLIP 图像嵌入,并将它们连接起来用于交叉注意力特征注入。”

对于基于拖拽的功能,轨迹模块利用 Meta Ai 领导的 CoTracker 框架,该框架评估大量可能的路径。这些路径被缩小到 1-10 个可能的轨迹。

获得的点坐标然后通过受 DragNUWA 和 DragAnything 架构启发的方法进行转换。这得到一个 高斯热图,它确定了运动的目标区域。

然后将数据输入到 ControlNet 的条件机制中,ControlNet 是一个最初为 Stable Diffusion 设计的辅助一致性系统,后来被改编用于其他架构。

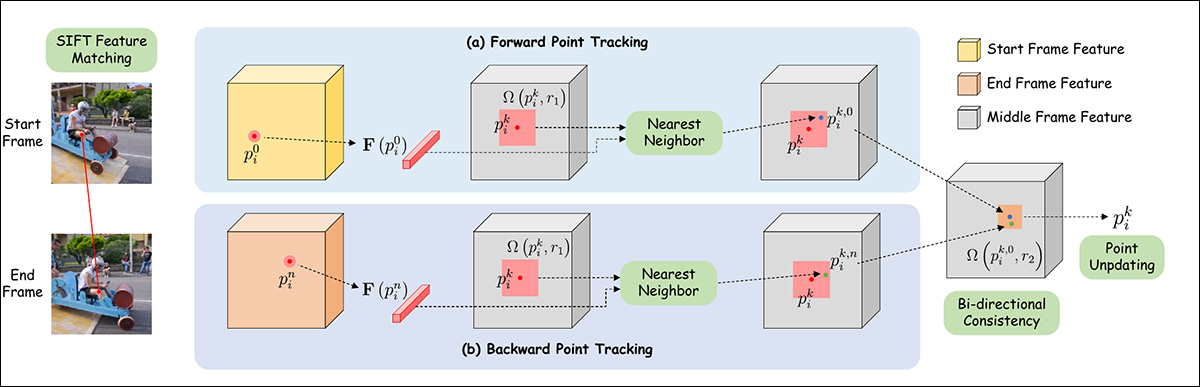

对于自动驾驶模式,特征匹配最初通过 SIFT 完成,它解释了一条轨迹,可以传递给一个受 DragGAN 和 DragDiffusion 启发的自动更新机制。

Framer 中的点轨迹估计模式图。

数据和测试

对于 Framer 的微调,空间注意力和残差块被 冻结,并且只影响了时间注意力层和残差块。

该模型在 AdamW 下训练了 10,000 次迭代,学习率为 1e-4,批大小为 16。训练过程发生在 16 个 NVIDIA A100 GPU 上。

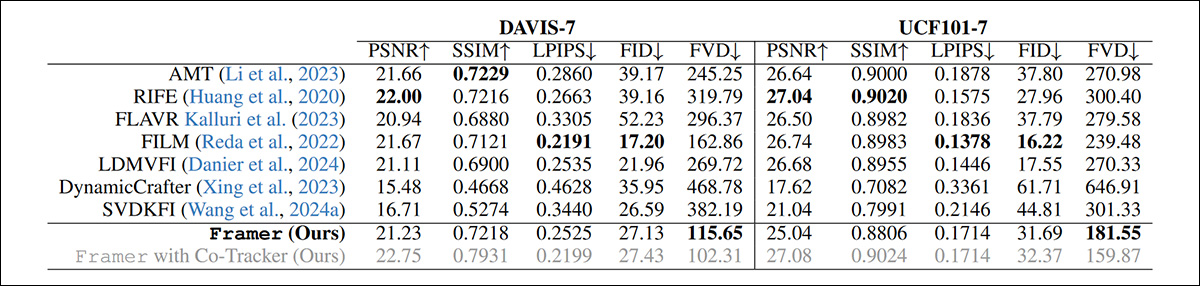

由于以前的方法不提供基于拖拽的编辑,研究人员选择比较 Framer 的自动驾驶模式与旧方法的标准功能。

测试的框架是当前基于扩散的视频生成系统,包括 LDMVFI;Dynamic Crafter;和 SVDKFI。对于“传统”视频系统,竞争框架是 AMT;RIFE;FLAVR;以及前面提到的 FILM。

除了用户研究外,还对 DAVIS 和 UCF101 数据集进行了测试。

定量测试只能通过研究团队的客观能力和用户研究来评估。然而,该论文指出,传统的 定量 指标对于这个命题来说基本上是不合适的:

“重建指标,如 PSNR、SSIM 和 LPIPS,无法准确捕捉插值帧的质量,因为它们惩罚其他可信的插值结果,这些结果与原始视频的像素不对齐。”

“虽然生成指标(如 FID)提供了一些改进,但它们仍然不够,因为它们不考虑时间一致性,并且独立评估帧。”

尽管如此,研究人员仍然使用几个流行的指标进行了定量测试:

Framer 与竞争系统的定量结果。

作者指出,尽管条件不利,但 Framer 仍然在测试方法中实现了最好的 FVD 分数。

以下是论文中与前几种方法进行定性比较的示例结果:

与前几种方法的定性比较。请参阅论文以获取更好的分辨率,以及 https://www.youtube.com/watch?v=4MPGKgn7jRc 的视频结果。

作者评论说:

“我们的方法产生的纹理更清晰,运动更自然,与现有的插值技术相比。它在输入帧之间差异很大的情况下表现特别好,而传统方法通常很难准确地插值内容。”

“与其他基于扩散的方法(如 LDMVFI 和 SVDKFI)相比,Framer 在具有挑战性的情况下表现出更好的适应性,并提供了更好的控制。”

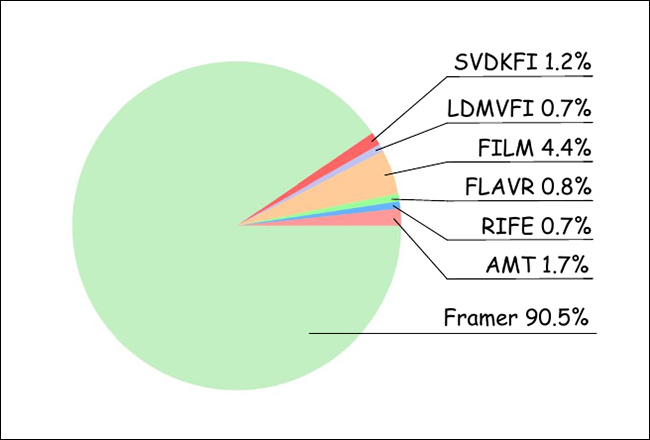

对于用户研究,研究人员召集了 20 名参与者,他们评估了 100 个随机排序的视频结果,来自各种方法。因此,获得了 1000 个评分,评估最“真实”的内容:

用户研究结果。

如上图所示,用户压倒性地偏爱 Framer 的结果。

该项目的配套 YouTube 视频 概述了一些 Framer 的其他潜在用途,包括变形和卡通补间动画——这是整个概念的起点。

结论

很难夸大这一挑战目前对 AI 基础视频生成任务的重要性。到目前为止,像 FILM 和(非 AI)EbSynth 这样的旧解决方案已经被爱好者和专业人士社区使用,用于补间动画;但这些解决方案都有显著的局限性。

由于新 T2V 框架的官方示例视频经过精心策划,公众对机器学习系统在没有 3D 可变形模型(3DMM)等指导机制的情况下能够准确推断运动中的几何形状的能力存在误解。

老实说,补间动画本身,即使可以完美执行,也只构成了对这个问题的“黑客”或捷径。尽管如此,既然通常更容易生成两张对齐良好的帧图像,而不是通过文本提示或当前的替代方法来实现指导,因此看到对这种老方法的迭代进展是件好事。

首次发布于 2024 年 10 月 29 日,星期二