人工智能

AnimateLCM:加速个性化扩散模型的动画

过去几年,扩散模型在图像和视频生成任务中取得了巨大的成功和认可。特别是视频扩散模型,由于其能够产生具有高连贯性和保真度的视频而受到关注。这些模型通过其架构中的迭代去噪过程,逐渐将高维高斯噪声转化为真实数据,从而生成高质量的视频。

Stable Diffusion 是图像生成任务中最具代表性的模型之一,它依赖于变分自编码器(VAE)来映射真实图像和下采样的潜在特征。这使得模型能够减少生成成本,而其架构中的跨注意力机制促进了文本条件图像生成。最近,Stable Diffusion 框架为实现更具创新性和有效性的图像或视频生成提供了基础,建立了多个即插即用适配器。然而,绝大多数视频扩散模型所采用的迭代生成过程使得图像生成过程变得耗时且相对昂贵,限制了其应用。

在本文中,我们将讨论 AnimateLCM,一种具有适配器的个性化扩散模型,旨在生成高保真度视频,且步骤和计算成本最小。AnimateLCM 框架的灵感来自一致性模型(Consistency Model),该模型通过蒸馏预训练的图像扩散模型来加速采样,使用最少的步骤。同时,成功的扩展一致性模型,即潜在一致性模型(Latent Consistency Model,LCM),促进了条件图像生成。与直接在原始视频数据集上进行一致性学习不同,AnimateLCM 框架提出了解耦一致性学习策略,解耦运动生成先验和图像生成先验的蒸馏,从而使模型能够同时提高生成内容的视觉质量和训练效率。此外,AnimateLCM 模型提出了从头开始训练适配器或将现有的适配器适应其蒸馏的视频一致性模型,这促进了稳定扩散模型家族中即插即用适配器的组合,以实现不同的功能,而不会损害样本速度。

本文旨在深入介绍 AnimateLCM 框架。我们将探讨其机制、方法论和架构,以及与最先进的图像和视频生成框架的比较。让我们开始吧。

AnimateLCM:个性化扩散模型的动画

扩散模型已成为图像生成和视频生成任务的首选框架,得益于其在生成任务中的效率和能力。绝大多数扩散模型依赖于迭代去噪过程来生成图像,该过程逐渐将高维高斯噪声转化为真实数据。虽然这种方法可以产生相当令人满意的结果,但迭代过程和迭代样本的数量会减慢生成过程,并增加扩散模型的计算要求,这比其他生成框架(如 GAN 或生成对抗网络)要慢得多。在过去的几年中,提出了一致性模型(Consistency Models,CM)作为迭代扩散模型的替代方案,以加速生成过程,同时保持计算要求不变。

一致性模型的亮点在于,它们学习一致性映射,以保持预训练扩散模型引入的轨迹的自一致性。 一致性模型的学习过程使其能够使用最少的步骤生成高质量图像,并消除了计算密集型迭代的需要。 此外,建立在稳定扩散框架上的潜在一致性模型(Latent Consistency Model,LCM)可以与现有的适配器集成到 Web 界面中,实现一系列额外的功能,例如实时图像到图像翻译。相比之下,尽管现有的视频扩散模型可以产生可接受的结果,但在视频样本加速领域仍有待改进,这在视频生成计算成本高的情况下尤为重要。

这就是 AnimateLCM 的由来,AnimateLCM 是一种高保真视频生成框架,需要最少的步骤来完成视频生成任务。遵循潜在一致性模型,AnimateLCM 框架将反向扩散过程视为求解增强概率流,并直接在潜在空间中训练模型来预测此类概率流的解决方案。然而,与直接在原始视频数据上进行一致性学习不同(这需要高训练和计算资源,且常常导致质量较差),AnimateLCM 框架提出了解耦一致性学习策略,解耦运动生成先验和图像生成先验的蒸馏。

AnimateLCM 框架首先对图像基础扩散模型进行一致性蒸馏,将其适应为图像一致性模型,然后对图像一致性模型和图像扩散模型进行 3D 膨胀,以适应 3D 特征。最后,AnimateLCM 框架通过对视频数据进行一致性蒸馏获得视频一致性模型。此外,为了缓解扩散过程中可能的特征损坏,AnimateLCM 框架还提出了使用初始化策略。由于 AnimateLCM 框架建立在稳定扩散框架之上,因此它可以用公开的个性化图像扩散权重替换其训练的视频一致性模型的空间权重,从而实现创新的生成结果。

此外,为了训练特定的适配器或使公开的适配器更好地适应,AnimateLCM 框架提出了适配器的有效加速策略,该策略不需要训练特定的教师模型。

AnimateLCM 框架的贡献可以概括为:提出的 AnimateLCM 框架旨在实现高质量、快速、 高保真视频生成,为了实现这一目标,AnimateLCM 框架提出了解耦蒸馏策略,解耦运动和图像生成先验,结果是更好的生成质量和增强的训练效率。

InstantID:方法论和架构

在其核心,InstantID 框架从扩散模型和采样速度策略中汲取灵感。扩散模型,也称为基于评分的生成模型,已展示出卓越的图像生成能力。在评分方向的指导下,扩散模型实现的迭代采样策略逐渐去噪污染的数据。扩散模型的效率是它们被广泛采用为视频扩散模型的主要原因,通过在添加的时间层上进行训练。另一方面,采样速度和采样加速策略有助于解决扩散模型中的缓慢生成速度。基于蒸馏的加速方法通过精炼的架构或调度器来调整原始扩散权重,从而增强生成速度。

继续讨论,InstantID 框架建立在稳定扩散模型之上,这使得 InstantID 能够应用相关概念。该模型将离散的正向扩散过程视为连续时间的方差保留 SDE。另外,稳定扩散模型是 DDPM 或去噪扩散概率模型的扩展,在该模型中,训练数据点通过具有噪声核的离散马尔可夫链逐渐被扰动,允许不同时间步的噪声数据分布遵循分布。

为了实现最少步骤的高保真视频生成,AnimateLCM 框架使稳定扩散基于的视频模型遵循自一致性属性。AnimateLCM 框架的整体训练结构包括用于教师免费适配和有效一致性学习的解耦一致性学习策略。

从扩散模型到一致性模型的转变

AnimateLCM 框架引入了其自身对稳定扩散模型(Stable Diffusion Model,DM)到一致性模型(Consistency Model,CM)的适应,遵循潜在一致性模型(Latent Consistency Model,LCM)的设计。值得注意的是,尽管稳定扩散模型通常预测添加到样本中的噪声,但它们本质上是 sigma 扩散模型。这与一致性模型形成对比,一致性模型旨在直接预测 PF-ODE 轨迹的解决方案。此外,在具有某些参数的稳定扩散模型中,使用分类器免费指导策略来生成高质量图像是必要的。然而,AnimateLCM 框架采用分类器免费指导增强的 ODE 求解器来采样相同轨迹中的相邻对,从而实现更好的效率和质量。另外,现有模型表明,生成质量和训练效率受到轨迹中离散点数量的影响。离散点数量较少可以加速训练过程,而离散点数量较多会在训练中减少偏差。

解耦一致性学习

对于一致性蒸馏的过程,开发人员观察到,训练中使用的数据对一致性模型的最终生成质量产生了重大影响。然而,当前公开可用的数据集存在主要问题,即它们通常包含水印数据、质量较低的数据,或者包含过于简短或模糊的字幕。另外,直接在大分辨率视频上训练模型计算成本高、耗时,且对于大多数研究人员来说不可行。

鉴于高质量数据集的可用性,AnimateLCM 框架提出了解耦运动先验和图像生成先验的蒸馏。更具体地说,AnimateLCM 框架首先使用过滤后的高质量图像文本数据集将稳定扩散模型蒸馏为图像一致性模型,具有更好的分辨率。然后,框架在稳定扩散模型的层中训练轻量 LoRA 权重,同时冻结稳定扩散模型的权重。一旦模型调整 LoRA 权重,它就作为一个通用的加速模块,并且已被证明与稳定扩散社区中的其他个性化模型兼容。对于推理,AnimateLCM 框架合并 LoRA 权重和原始权重,而不会损害推理速度。一旦 AnimateLCM 框架获得图像生成级别的一致性模型,它就会冻结稳定扩散模型和 LoRA 权重上的权重。另外,模型将 2D 卷积核膨胀为伪 3D 核,以训练视频生成的一致性模型。模型还添加了零初始化和块级残余连接的时间层。整体设置有助于确保模型的输出不会在第一次训练时受到影响。在开源视频扩散模型的指导下,AnimateLCM 框架从稳定扩散模型扩展的时间层中训练一致性模型。

值得注意的是,虽然空间 LoRA 权重旨在在不考虑时间建模的情况下加速采样过程,而时间模块是通过标准扩散技术开发的,但它们的直接集成往往会在训练开始时破坏表示。这带来了挑战,需要有效地将它们合并,而不会产生最小的冲突。通过经验研究,AnimateLCM 框架找到了一个成功的初始化方法,该方法不仅利用了空间 LoRA 权重的一致性先验,还减轻了直接组合的不利影响。

在一致性训练开始时,预训练的空间 LoRA 权重仅被集成到在线一致性模型中,避免将目标一致性模型插入其中。这种策略确保目标模型(作为在线模型的教育向导)不会生成可能对在线模型的学习过程产生不利影响的有缺陷的预测。在训练期间,LoRA 权重通过指数移动平均(EMA)过程逐渐合并到目标一致性模型中,经过几次迭代后实现最佳权重平衡。

教师免费适配

稳定扩散模型和即插即用适配器经常一起使用。然而,观察到即使这些适配器在某种程度上有效,但它们往往会在细节上失去控制,即使大多数适配器都是使用图像扩散模型进行训练的。为了解决这个问题,AnimateLCM 框架选择教师免费适配,这是一种简单但有效的策略,可以使现有的适配器更好地兼容或从头开始训练适配器。这种方法使 AnimateLCM 框架能够实现可控的视频生成和图像到视频生成,使用最少的步骤,而无需教师模型。

AnimateLCM:实验和结果

AnimateLCM 框架采用稳定扩散 v1-5 作为基础模型,并实现了 DDIM ODE 求解器用于训练目的。框架还应用了稳定扩散 v1-5 与开源运动权重作为教师视频扩散模型,实验在 WebVid2M 数据集上进行,无需任何额外或增强的数据。另外,框架采用带有 BLIP 标题的简短文本提示的 TikTok 数据集,用于可控视频生成。

定性结果

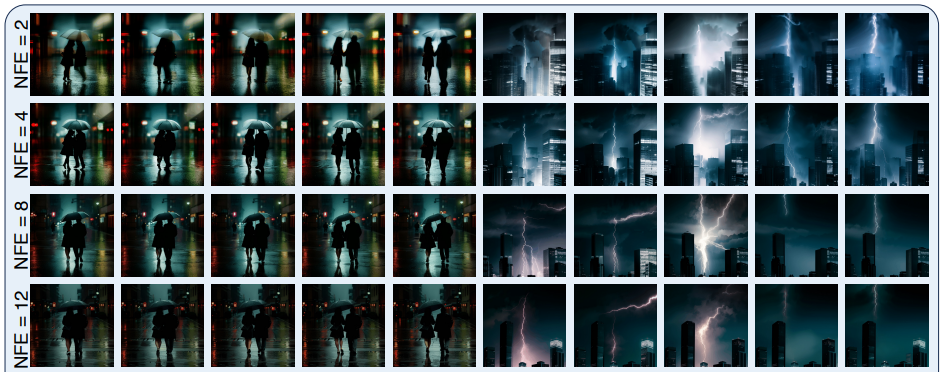

以下图表展示了 AnimateLCM 框架在文本到视频生成、图像到视频生成和可控视频生成中使用的四步生成方法的结果。

如图所示,每个结果都是令人满意的,AnimateLCM 框架生成的结果表明,即使推理步骤不同,AnimateLCM 框架也能够遵循一致性属性,保持相同的运动和风格。

定量结果

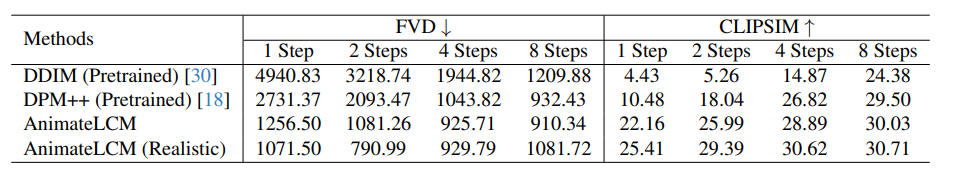

以下图表展示了 AnimateLCM 框架与最先进的 DDIM 和 DPM++ 方法的比较结果。

如图所示,AnimateLCM 框架在低步骤范围(1-4 步)中显著优于现有方法。另外,AnimateLCM 指标在此比较中进行评估,不使用分类器免费指导(CFG),这使得框架能够节省近 50% 的推理时间和峰值内存成本。为了进一步验证其性能,AnimateLCM 框架中的空间权重被替换为公开的个性化真实模型,该模型在保真度和多样性之间取得了良好的平衡,从而进一步提高了性能。

总结

在本文中,我们讨论了 AnimateLCM,一种具有适配器的个性化扩散模型,旨在使用最少的步骤和计算成本生成高保真视频。AnimateLCM 框架的灵感来自于一致性模型,该模型通过蒸馏预训练的图像扩散模型来加速采样,使用最少的步骤。同时,成功的扩展一致性模型,即潜在一致性模型(LCM),促进了条件图像生成。与直接在原始视频数据集上进行一致性学习不同,AnimateLCM 框架提出了解耦一致性学习策略,解耦运动生成先验和图像生成先验的蒸馏,从而使模型能够同时提高生成内容的视觉质量和训练效率。