Anderson 视角

AI 视频完善了猫自拍

AI 视频生成器通常会给出接近但不完全符合预期的结果,难以完全满足文本提示的需求。但是一种新的高级修复方法可以带来显著的改善。

生成式视频系统通常难以制作真正富有创意或奇幻的视频,且常常无法满足用户文本提示的期望。

部分原因在于 纠缠 ——视觉/语言模型必须在训练数据的长度上做出妥协。训练时间太短,概念就不够成熟;训练时间太长,概念虽然准确,但不够灵活,无法融入新颖的组合。

您可以从下面的嵌入式视频中了解这一点。在左边是许多 AI 系统在面对具有挑战性的提示时常见的折衷结果(提示位于视频顶部的所有四个示例中),该提示要求将一些元素以太过奇幻的方式组合在一起,难以成为真实的训练示例。在右边,是一个更好地符合提示的 AI 输出:

点击播放 (无音频)。在右边,我们看到“分解”的 WAN 2.2 实际上更好地满足了提示的要求,与左边的“香草”WAN 2.2 相比,请参阅源视频文件以获得更好的分辨率和更多示例,尽管这些策划版本在这里不在项目网站上存在,并且是为本文编制的。 源

尽管我们必须原谅拍手的鸭子拥有人类的手(!),但很明显,右侧的示例比左侧的示例更好地符合原始文本提示。

有趣的是,两种特征的架构基本上是 相同的 —— 流行且功能强大的 Wan 2.2,这是中国发布的,在今年的开源和爱好者社区中获得了显著的发展。

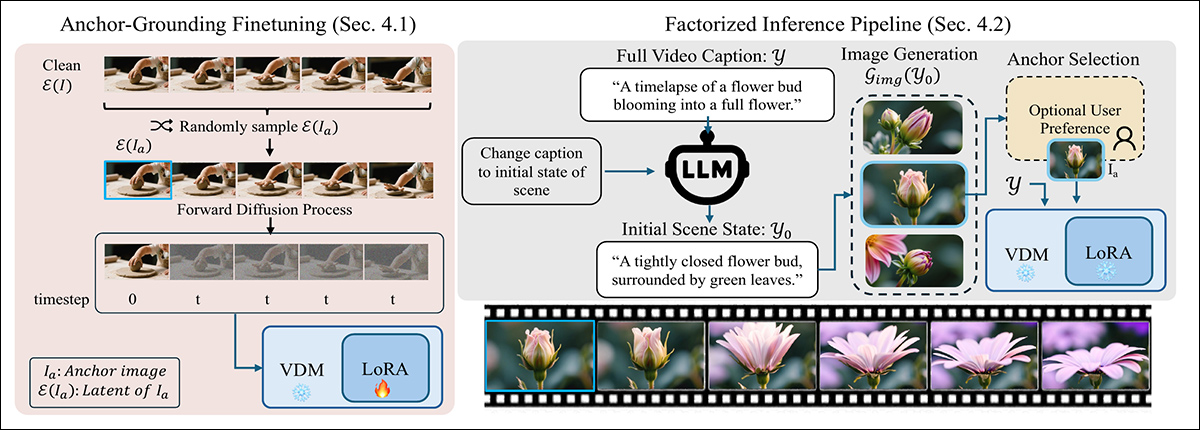

区别在于第二个生成管道是 分解的,在这种情况下,这意味着一个大型语言模型(LLM)被用于重新解释视频的第一个(种子)帧,以便系统更容易地提供用户所需的内容。

这种“视觉锚定”涉及将从增强的提示中精心制作的图像注入生成管道中作为“起始帧”,并使用 LoRA 解释模型来帮助将“入侵者”帧集成到视频创建过程中。

结果在提示忠实度方面相当显著,尤其是对于看起来相当优雅的解决方案:

点击播放 (无音频)。进一步展示“分解”视频生成更好地遵循脚本的示例。请参阅源视频文件以获得更好的分辨率和更多示例,尽管这些策划版本在这里不在项目网站上存在,并且是为本文编制的。

这种解决方案以 新论文 的形式出现,题为 分解视频生成:在文本到视频扩散模型中分离场景构造和时间合成,并附有一个视频丰富的 项目网站。

虽然许多当前系统尝试通过使用语言模型重写模糊或未指定的文本来提高提示准确性,但新工作认为这种策略仍然会导致模型的 内部场景表示 有缺陷时失败。

即使有详细的重写提示,文本到视频模型也经常错误地组合关键元素或生成不兼容的初始状态,从而破坏动画的逻辑。只要第一帧未能反映提示的内容,生成的视频就无法恢复,无论运动模型有多好。

论文指出*:

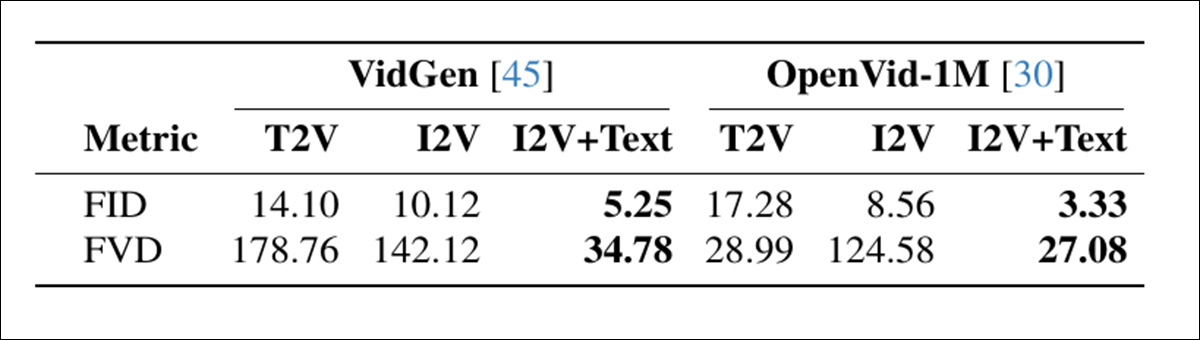

‘[文本到视频] 模型经常生成分布偏移的帧,但仍然可以获得 [评估分数],这表明 它们的运动建模在场景保真度相对较差的情况下仍然相当自然。

‘[图像到视频] 模型表现出相反的行为,强大的 [评估分数] 来自准确的初始场景和较弱的时间一致性,而 I2V+文本平衡了这两个方面。

‘这种对比表明当前 T2V 模型存在 结构上的不匹配:场景接地和时间合成可以从不同的归纳偏差中受益,但现有的架构试图在单个模型中同时学习这两者。 ‘

对生成模式的诊断比较发现,缺乏显式场景锚定的模型在运动方面得分很高,但经常在场景布局上妥协,而图像条件方法则表现出相反的模式:

对两个数据集的视频生成模式进行比较,显示 I2V+文本在帧质量(FID)和时间一致性(FVD)方面实现了最好的性能,突出了将场景构造与运动分离的益处。 来源

这些发现表明,当前模型试图同时学习场景布局和动画,尽管这两项任务需要不同类型的 归纳偏差,并且可以单独处理。

也许最有趣的是,这个“技巧”可以潜在地应用于诸如 Wan 2.1 和 2.2 之类的模型的本地安装,以及类似的视频扩散模型,如 Hunyuan Video。根据传闻,比较爱好者输出的质量与商业生成门户,如 Kling 和 Runway,大多数主要的 API 提供商似乎正在通过 LoRAs 以及——在更大程度上——实际对模型权重进行完全的微调来改进开源产品,如 WAN。因此,这种特定的方法可以代表 FOSS 阵营的赶上。

针对这种方法的测试表明,这种简单且模块化的方法在 T2V-CompBench 基准 上提供了新的最先进的结果,显著改进了所有测试模型。作者指出*:

‘[在] 所有模型中,添加锚点图像一致地提高了组合性能。所有较小的分解模型(CogVideo 5B、Wan 5B 和 Wan 1B)都优于更大的 Wan 14B T2V 模型。

‘我们的分解 Wan 5B 也优于商业 PixVerse-V3 基准,这是基准上报告的最佳模型。 这表明视觉接地实质上增强了场景和动作理解,甚至在较小容量的模型中也是如此。

‘在每个模型家族中,分解版本都优于原始模型。值得注意的是,我们的轻量级锚点接地 LoRA 在 WAN 14B 上实现了与其预训练 I2V 14B 变体(0.661 vs. 0.666)相当的性能,尽管它不需要完全重新训练。 ‘

接下来是 VBench2.0 轮:

分解 T2V 方法在 VBench 2.0 的组合、常识推理、可控性和物理学方面的一致性提高了性能,某些方面的收益甚至超过了 60%——尽管人类保真度仍然低于专有的 Veo 3 基准。

在所有架构中,分解方法在 VBench 的每个类别中提高了评分,除了 人类保真度,即使提示进行了上采样,也略微下降。WAN 5B 模型优于更大的 WAN 14B 模型,强化了早期 T2V-CompBench 结果,即视觉接地对视频合成贡献更多,而不是模型规模。

VBench 上的收益虽然一致,但比 T2V-CompBench 上的收益小,作者将其归因于 VBench 的更严格的二元评分制度。

对于定性测试,论文提供了静态图像,但我们建议读者参阅本文中嵌入的合成视频,以更好地了解,需要注意的是,源视频更丰富、更具多样性,并且具有更高的分辨率和细节。请在 这里 找到它们。关于定性结果,论文指出:

‘锚定视频一致地表现出更准确的场景组合、更强的对象属性绑定和更清晰的时间进展。 ‘

分解方法即使将扩散步骤从 50 个减少到 15 个,也仍然保持稳定,在 T2V-CompBench 上几乎没有性能损失。相比之下,文本仅和上采样基准在相同条件下显著恶化。

虽然减少步骤理论上可以将速度提高三倍,但由于锚点图像生成的固定成本,整个生成管道实际上只变得 2.1 倍更快。然而,结果表明,锚定不仅提高了样本质量,还有助于稳定扩散过程,支持更快、更高效的生成,而不会损失准确性。

项目网站提供了上采样与新方法生成的示例,我们在这里提供了一些(较低分辨率)编辑示例:

点击播放 (无音频)。起始源与作者的分解方法进行比较。

作者总结如下:

‘我们的结果表明,改进的接地可能与增加容量同样重要。最近在 T2V 扩散方面的进展严重依赖于增加模型大小和训练数据,但即使大型模型也经常难以仅从文本中推断出一个连贯的初始场景。

‘这与图像扩散形成对比,在图像扩散中,缩放相对直接;在视频模型中,每个架构改进都必须在额外的时间维度上运行,使缩放变得更加耗费资源。

‘我们的发现表明,改进的接地可以通过解决不同的瓶颈来补充规模:在运动合成开始之前建立正确的场景。

‘通过将视频生成分解为场景组合和时间建模,我们减轻了几个常见的故障模式,而无需显著增加模型大小。我们认为这是一个可以指导未来架构朝着更可靠、更结构化的视频合成发展的补充设计原则。 ‘

结论

尽管纠缠问题非常真实,可能需要专门的解决方案(例如在训练之前改进的策划和分发评估),但看到分解“解开”几个顽固的概念提示编排,将其转化为更准确的渲染,这是一个启示——只需中等程度的 LoRA 条件和显著改进的起始/种子图像。

本地推理与商业解决方案之间的资源差距可能没有想象中那么巨大,因为几乎所有提供商都试图合理化他们对消费者的大量 GPU 资源投入。

根据传闻,当前的许多生成视频提供商似乎都在使用品牌化和“增强”的中国开源模型。这些“中间人”系统似乎拥有的主要“护城河”是,他们已经花费时间训练 LoRAs,或者——以更大的成本和稍微更大的回报——实际上对模型权重进行了完全的微调††。

这种见解可以帮助进一步缩小这一差距,在一个发布场景中,中国人似乎决心(不一定是出于利他或理想主义的原因)去民主化生成人工智能,而西方的商业利益可能更愿意看到模型规模的增加和法规,最终将真正好的模型困在 API 后面,并通过多层内容过滤器。

* 作者的强调,而不是我的。

† 论文没有指定所选择的 GPU 或使用了多少个。

†† 虽然 LoRA 路线更有可能实现,既是由于使用的经济便利性,也是因为全权重(而不是 量化 权重)并不总是可用的。

首次发表于 2025 年 12 月 19 日星期五